Transformers en Vision: Évolution et Défis

Je me souviens de la première fois que j'ai fait le saut des CNNs aux Transformers. C'était comme entrer dans un nouveau monde, plein de potentiel mais aussi de pièges. Ici, je vais vous montrer comment ces modèles ont évolué et ce que cela signifie pour nous, sur le terrain. Les Transformers ont révolutionné les tâches de vision, et comprendre leur évolution et leur application est crucial pour un déploiement efficace. Je vais vous emmener dans mon parcours, soulignant des moments clés et des insights pratiques. Des ViT aux techniques de pré-entraînement, en passant par les modèles Swin et ConvNeXt, jusqu'aux défis de déploiement des modèles de la série SAM, et l'impact des données RF100VL de Roboflow sur la flexibilité des modèles, nous avons beaucoup à couvrir.

Je me souviens parfaitement de la première fois où j'ai délaissé les réseaux de neurones convolutifs pour me lancer dans les Transformers. C'était comme découvrir un territoire inconnu, débordant de promesses mais aussi de pièges à éviter. Si vous êtes du métier, vous savez de quoi je parle. Les Transformers ont complètement bouleversé les tâches de vision, mais pour les déployer efficacement, il faut comprendre comment ils ont évolué et comment les appliquer. Je vais vous partager mon parcours, souligner les moments clés et donner des insights pratiques. On parlera du Vision Transformer (ViT) et des techniques de pré-entraînement, des modèles Swin et ConvNeXt, ainsi que des défis de déploiement des modèles de la série SAM. Et bien sûr, je vous dirai comment j'ai utilisé le dataset RF100VL de Roboflow pour améliorer la flexibilité des modèles. Alors, si vous êtes prêt à plonger dans les détails (et à éviter certains pièges que j'ai rencontrés), restez avec moi.

De CNNs à Transformers : Un Changement de Paradigme

J'ai passé des années à jongler avec les Convolutional Neural Networks (CNNs) pour mes projets de vision par ordinateur. Ils ont dominé les tâches de vision, mais avaient des limites, surtout quand il s'agissait de gérer des motifs complexes. Les CNNs reposent sur des biais inductifs forts, ce qui signifie qu'ils sont excellents pour identifier des caractéristiques locales invariantes. Mais voilà, quand les transformers sont arrivés avec leurs mécanismes d'attention, tout a changé. Tout d'un coup, on pouvait traiter les données visuelles d'une manière beaucoup plus flexible. Ça m'a forcé à repenser mes architectures de modèles et mes processus d'entraînement. Bien sûr, il y a un compromis : une demande de calcul accrue contre une amélioration de la précision. Et croyez-moi, vous le sentez passer sur la facture d'électricité.

Vision Transformer (VIT) : Décryptage du Modèle

Avec le Vision Transformer (VIT), on utilise une taille de patch de 16x16, transformant les images en une séquence de patchs. Ça réduit le biais inductif, ce qui est à double tranchant : d'un côté, ça permet un apprentissage plus flexible, mais de l'autre, ça peut être chaotique sans un bon pré-entraînement. J'ai expérimenté avec l'apprentissage auto-supervisé et les techniques de Masked Autoencoder (MAE) pour améliorer ce pré-entraînement. Mais attention, les problèmes d'échelle arrivent vite : le calcul de la résolution augmente avec la puissance quatre de n. Ça peut être un vrai piège si on n'y prend pas garde.

Swin et ConvNeXt : Les Prochaines Étapes dans l'Évolution des Modèles

Les modèles Swin ont introduit des cartes de caractéristiques hiérarchiques, améliorant ainsi l'efficacité. C'est un vrai soulagement quand on voit la facture de calcul. Ensuite, il y a eu ConvNeXt, qui revisite les réseaux convolutionnels avec une taille de patch de 4x4. Ces modèles cherchent un équilibre entre performance et coût computationnel. C'est un peu comme choisir entre une voiture de sport et une hybride : ça dépend de vos besoins spécifiques et des ressources disponibles. J'ai appris à choisir en fonction des exigences spécifiques de la tâche et de la disponibilité des ressources. Et honnêtement, ce n'est pas toujours évident.

Modèles SAM et Défis de Déploiement

Les modèles de la série SAM offrent une flexibilité impressionnante, mais apportent leur lot de complexités de déploiement. Atteindre une accélération de 40 fois nécessite un ajustement minutieux et une compréhension approfondie des subtilités du modèle. Les défis de déploiement se présentent souvent à cause des limitations matérielles et des problèmes d'intégration. Un conseil : parfois, il est plus rapide de faire des itérations avec des modèles plus simples avant de passer à l'échelle. J'ai constaté qu'il est souvent préférable de commencer simple et de construire à partir de là.

Le Dataset RF100VL de Roboflow : Flexibilité en Action

Le dataset RF100VL de Roboflow offre une base solide pour l'entraînement des modèles. Cette flexibilité permet d'adapter l'entraînement du modèle à des tâches diverses. L'astuce ici est de tirer parti de la diversité du dataset pour améliorer la robustesse du modèle. Mais attention, il ne faut pas abuser des fonctionnalités du dataset ; concentrez-vous sur les points de données pertinents pour votre application spécifique. J'ai vu des équipes se perdre dans des données inutiles, et croyez-moi, ça coûte cher.

Pour plus de détails sur les impacts récents du cloud, consultez cet article sur l'impact des mouvements de Google dans le cloud.

Transformers ont vraiment changé la donne dans le domaine des modèles de vision. Voilà ce que j'ai appris en les intégrant dans mes projets :

- J'ai commencé par décortiquer le Vision Transformer (VIT) avec sa taille de patch de 16 par 16, et rapidement j'ai vu comment le passage au Swin et ConvNeXt, avec leurs patchs de 4 par 4, optimisait la performance.

- Attention, la mise à l'échelle du calcul de résolution avec les transformers, n puissance quatre, peut vraiment alourdir la charge — il faut jongler avec ça intelligemment.

- Les modèles de la série SAM apportent des solutions intéressantes, mais les défis de déploiement restent un vrai casse-tête que je n'ai pas encore totalement résolu.

À l'avenir, je pense que continuer à explorer et à expérimenter avec ces modèles pourrait repousser encore plus les limites de ce qu'on peut faire avec la vision par ordinateur. Si vous êtes prêt à plonger dans le monde des transformers, commencez à expérimenter avec vos propres jeux de données et modèles. Partagez vos découvertes avec la communauté, car c'est comme ça qu'on avance !

Je vous encourage à regarder la vidéo originale "How Transformers Finally Ate Vision" pour approfondir vos connaissances. Croyez-moi, vous ne le regretterez pas. Lien YouTube

Questions Fréquentes

Thibault Le Balier

Co-fondateur & CTO

Issu de l'écosystème startup tech, Thibault a développé une expertise en architecture de solutions IA qu'il met aujourd'hui au service de grands groupes (Atos, BNP Paribas, beta.gouv). Il intervient sur deux axes : la maîtrise des déploiements IA (LLM locaux, sécurisation MCP) et l'optimisation des coûts d'inférence (offloading, compression, gestion des tokens).

Articles liés

Découvrez d'autres articles sur des sujets similaires

Google investit 40 milliards : impact sur le cloud

Je n'aurais jamais cru voir Google investir 40 milliards chez un concurrent cloud. Et pourtant, c'est ce qui se passe et ça bouleverse l'industrie technologique comme jamais. Je vais vous expliquer comment ce mouvement, accompagné des avancées en IA et robotique, transforme le paysage. On va décortiquer cet investissement massif de Google, explorer les performances des modèles d'IA de pointe comme Happy Horse et Grock 4.3, et examiner les dernières innovations en robotique. On touchera aussi aux investissements en infrastructures par les géants de la tech et à une nouvelle approche de la collaboration en IA.

Évolution des Modèles AI : Limites et Opportunités

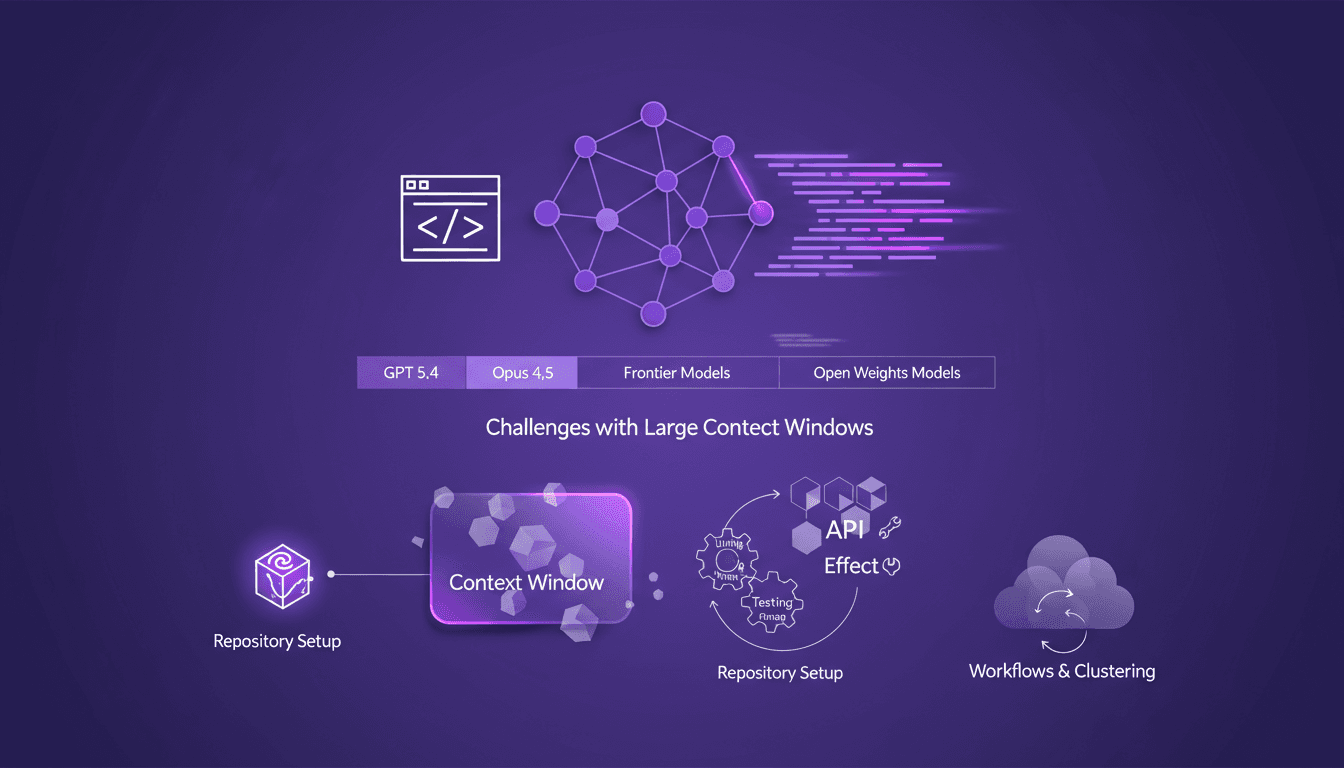

Je me souviens encore de la première fois où j'ai configuré un dépôt pour la génération de code pilotée par l'IA. Ça a été une révolution, mais aussi un champ de mines de pièges potentiels. Dans cette conférence, je vais plonger dans la façon dont des modèles AI comme GPT 5.4 et Opus 4.5 transforment nos workflows, tout en pointant là où ils trébuchent encore. Passer du codage manuel à une génération automatisée de code, c'est notre réalité quotidienne sur le terrain. Mais attention, les fenêtres de contexte larges peuvent être une vraie galère. La configuration de votre dépôt est cruciale pour éviter les embûches, et je vais partager comment j'utilise Effect et d'autres outils pour un développement API efficace. Accrochez-vous, car comprendre ces modèles et leurs limites est essentiel pour quiconque navigue dans le développement assisté par l'IA.

Optimisation des modèles IA : notre approche

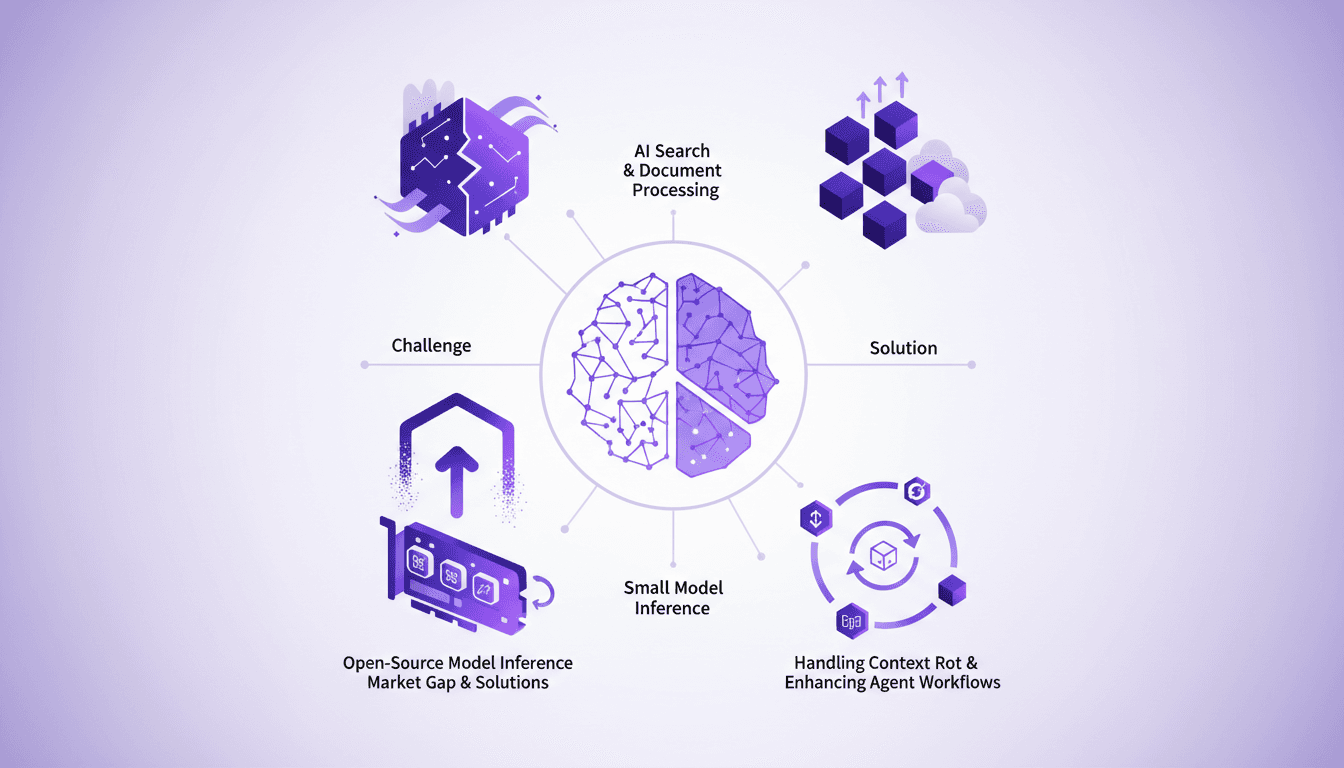

J'ai vu un vide sur le marché pour l'inférence des petits modèles, alors j'ai décidé de construire l'infrastructure moi-même. Avec plus de 3 millions de modèles sur Hugging Face, l'absence d'une infrastructure efficace m'a sauté aux yeux. Pourquoi est-ce crucial ? Parce que les petits modèles sont essentiels pour la recherche AI et le traitement de documents. Et les défis ? Il y en a eu, mais j'ai relevé le défi. Entre le rot contextuel et l'optimisation des workflows d'agents, chaque étape a été un apprentissage. J'ai orchestré le swapping des modèles pour une utilisation efficace des GPUs, tout en soutenant diverses architectures open-source. En bref, nous avons comblé une lacune du marché avec une solution robuste et évolutive.

Modèles Gemma 4 : Révolution de l'IA sur périphérie

J'ai plongé dans le déploiement de l'IA sur des appareils en périphérie avec Gemma 4, et laissez-moi vous dire, c'est un vrai changement de jeu. Mais attention, il y a des nuances à comprendre pour que tout fonctionne parfaitement. Gemma 4 apporte des capacités inédites pour traiter les données localement, réduisant latence et utilisation de la bande passante. J'ai configuré le framework Light RT pour le déploiement, et l'amélioration des performances avec l'accélération NPU est bluffante. Mais ne vous emballez pas trop vite, le passage à la plate-forme croisée nécessite quelques ajustements. L'intégration et le soutien communautaire sont des atouts majeurs. Vous voulez maximiser ces bénéfices ? Je partage ce que j'ai appris sur le terrain.

Boucles Ralph : IA Simples et Efficaces

Je me souviens encore de la première fois que j'ai construit une Boucle Ralph. C'était comme trouver la pièce manquante dans le puzzle du développement piloté par l'IA. On parle ici d'un vrai workflow, pas juste de la théorie. Au lieu d'une complexité inutile, ces boucles simplifient l'automatisation en utilisant des modèles d'IA comme GPT 5.8. Imaginez pouvoir orchestrer des tâches de manière fluide et efficace, tout en tenant compte des défis et des avantages de l'IA dans le développement logiciel. Dans cet article, je vous emmène dans le monde des Boucles Ralph, leur application pratique, et comment elles peuvent véritablement transformer votre manière de travailler. On va explorer ensemble les limites à garder en tête, les considérations de sécurité et d'éthique, et comment faire évoluer ces processus dans des environnements d'équipe. Et oui, l'avenir de l'IA dans l'automatisation des workflows complexes est déjà là. Alors, prêt à plonger?