Évolution des Modèles AI : Limites et Opportunités

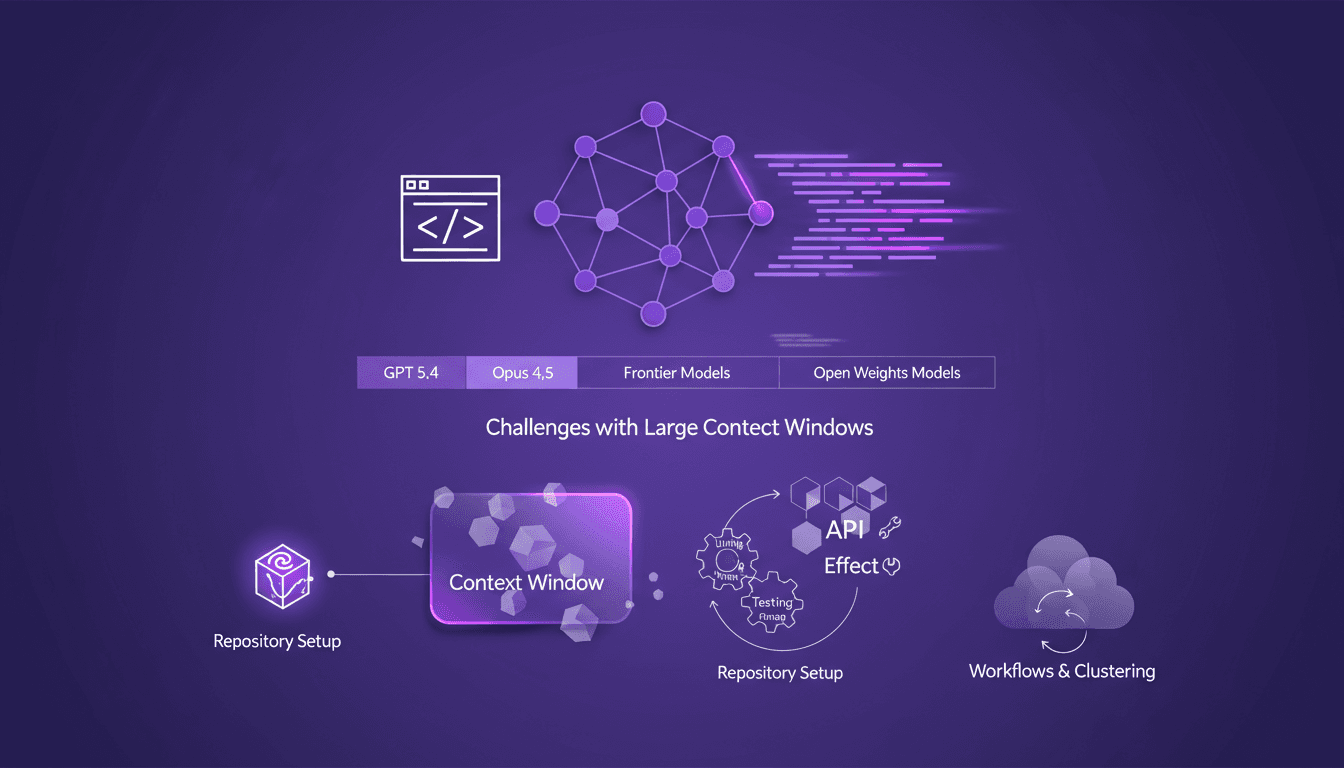

Je me souviens encore de la première fois où j'ai configuré un dépôt pour la génération de code pilotée par l'IA. Ça a été une révolution, mais aussi un champ de mines de pièges potentiels. Dans cette conférence, je vais plonger dans la façon dont des modèles AI comme GPT 5.4 et Opus 4.5 transforment nos workflows, tout en pointant là où ils trébuchent encore. Passer du codage manuel à une génération automatisée de code, c'est notre réalité quotidienne sur le terrain. Mais attention, les fenêtres de contexte larges peuvent être une vraie galère. La configuration de votre dépôt est cruciale pour éviter les embûches, et je vais partager comment j'utilise Effect et d'autres outils pour un développement API efficace. Accrochez-vous, car comprendre ces modèles et leurs limites est essentiel pour quiconque navigue dans le développement assisté par l'IA.

Je me souviens encore de la première fois où j'ai configuré un dépôt pour la génération de code pilotée par l'IA. Ça a été une vraie révolution pour mon workflow, mais aussi un champ de mines de pièges potentiels. Quand on passe du codage manuel à une génération automatisée, les modèles AI comme GPT 5.4 et Opus 4.5 changent la donne. Mais attention, ils ont encore des limites, surtout avec les grandes fenêtres de contexte. J'ai appris à mes dépens que la configuration de votre dépôt est cruciale. Je vais vous montrer comment j'utilise des outils comme Effect pour orchestrer efficacement le développement API. Et pourquoi le linting et les tests sont indispensables dans le développement assisté par l'IA. Le retard des modèles à poids ouverts par rapport aux modèles de pointe est un autre défi à surmonter. Je partagerai aussi l'importance des workflows et du clustering dans les processus AI de longue durée. Ce n'est pas que de la théorie; c'est ce que je vis au quotidien. Alors, plongeons ensemble dans cette évolution des modèles AI, leurs limites et opportunités.

Passer du Codage Manuel à l'Automatisation par l'IA

Je vais être honnête, la transition du codage manuel à l'automatisation par l'IA, c'est un peu un choc au début. J'ai commencé à programmer à l'âge de 12 ans, et pendant des années, coder à la main était mon quotidien. Mais depuis 6 à 8 mois, je n'ai pratiquement pas écrit une seule ligne de code manuellement. C'est assez déstabilisant, mais aussi incroyablement libérateur. D'abord, on configure nos models d'IA pour qu'ils s'intègrent dans nos flux de travail quotidiens. Ensuite, on se rend compte des gains de temps et d'efficacité incroyables que cela permet. Mais attention, il y a des défis à relever.

L'automatisation par l'IA change la donne, mais elle n'est pas sans ses propres complexités.

Intégrer ces modèles dans notre quotidien n'est pas sans accrocs. La courbe d'apprentissage est raide, surtout quand on est habitué à coder chaque petit détail. Mais une fois passé cette étape, l'impact est direct sur l'efficacité. On passe moins de temps sur des tâches répétitives et plus sur l'innovation. Pourtant, il faut être vigilant : ne pas écrire de code à la main ne signifie pas que tout est parfait. La supervision humaine reste essentielle.

Comprendre les Limitations des Modèles d'IA

Les context windows des modèles d'IA, parlons-en. C'est un concept clé à comprendre. Imaginez que chaque modèle a une mémoire limitée, une fenêtre par laquelle il voit le monde. Avec des fenêtres de contexte d'un million de tokens, on pourrait penser qu'on est tranquille. Mais souvent, plus c'est grand, plus c'est confus. J'ai travaillé avec GPT 5.4 et Opus 4.5, et la confusion peut vite s'installer.

Ces modèles, même avec leurs 10 trillions de paramètres, ne peuvent pas tout savoir. Ils apprennent surtout à partir du code, pas des documentations humaines. C'est une limite à garder à l'esprit, surtout quand on veut les utiliser pour des applications concrètes. Prenez garde à ne pas surcharger les modèles avec trop d'informations d'un coup.

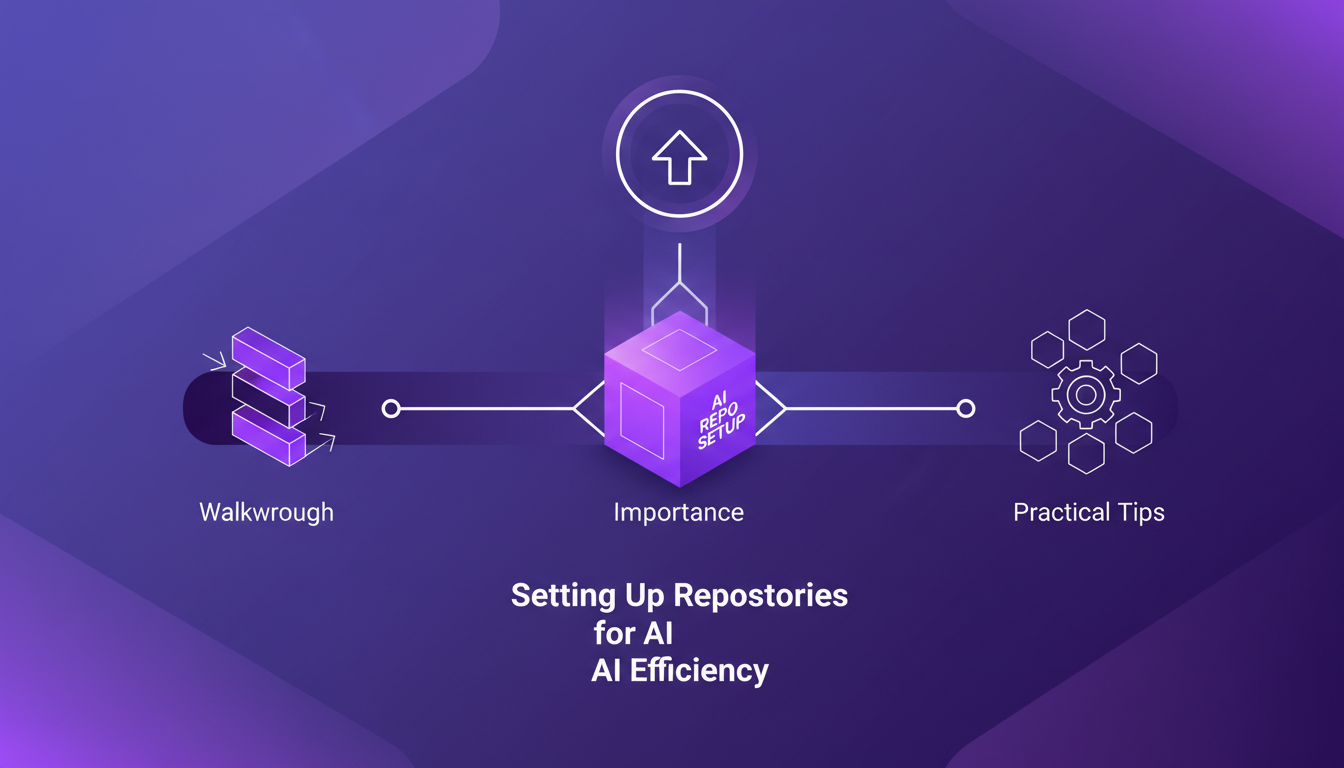

Configurer des Dépôts pour l'Efficacité de l'IA

Passons à quelque chose de plus pratique : la configuration des dépôts. C'est un point crucial pour l'efficacité des projets pilotés par l'IA. D'abord, je clone le repo, c'est la base. Ensuite, je configure les dépôts pour maximiser l'efficacité. Ça peut sembler banal, mais une bonne configuration fait toute la différence.

Utiliser des agents de codage avec un seul appel d'outil est un atout. Mais il faut veiller à ce que ces agents aient accès aux bonnes ressources. La performance du modèle d'IA en dépend directement. Un dépôt bien configuré permet d'éviter les problèmes de performance et d'optimiser l'utilisation des modèles.

Améliorer la Génération de Code par l'IA avec le Linting et les Tests

On parle souvent de linting comme d'un outil de maintien de la qualité du code. Et dans le contexte de l'IA, c'est encore plus crucial. Linting et tests dirigent la génération de code par l'IA, et c'est quelque chose que j'ai expérimenté de manière directe. Mais attention, il y a un compromis entre vitesse et qualité du code.

Intégrer des tests dans le cycle de développement est essentiel. Ça permet de garantir que le code généré par l'IA répond aux standards de qualité. Et avec l'intégration continue, on s'assure que chaque modification est validée. C'est un équilibre à trouver, mais qui paie sur le long terme.

Exploiter Effect et Outils pour le Développement d'API

Enfin, parlons des outils comme Effect pour le développement d'API. Ces outils permettent de simplifier et de rationaliser les processus de développement. Avec des workflows bien définis, on gère même les processus de longue durée sans souci.

Mais il y a un hic : les modèles de poids ouverts ont souvent un retard de trois à six mois par rapport aux modèles de pointe. Il faut donc savoir jongler entre les deux pour tirer le meilleur parti. L'impact sur l'orchestration d'API est direct, et il y a beaucoup à gagner en optimisant ces workflows.

L'IA transforme notre façon de concevoir et déployer le logiciel, et je l'ai expérimenté de première main. Voici ce que j'ai retenu :

- J'ai remarqué que les modèles comme GPT 5.4 et Opus 4.5 sont des game changers, mais attention à leurs limites. Les fenêtres de contexte larges peuvent devenir problématiques, surtout quand on dépasse les 100 000 tokens.

- Le passage du codage manuel à la génération automatisée est en cours, mais ça ne veut pas dire que tout est facile. La configuration des dépôts est cruciale pour tirer le meilleur parti de cette automatisation.

- Je gère mon ID utilisateur à 100 et utilise un agent de codage avec un seul appel d'outil — c'est une configuration qui marche pour moi.

- La mise en production avec la version 4 est bien rodée, mais elle demande encore des ajustements subtils.

L'avenir est prometteur avec ces outils, mais il faut savoir naviguer entre potentiel et limitations. Prêt à plonger plus profondément ? Expérimentez dès aujourd'hui avec ces modèles pour voir comment ils peuvent véritablement transformer votre processus de développement. Pour des insights plus détaillés, regardez la vidéo "Vibe Engineering Effect Apps" de Michael Arnaldi sur YouTube. C'est une mine d'informations pratiques pour qui veut vraiment comprendre ce que ces technologies peuvent apporter.

Questions Fréquentes

Thibault Le Balier

Co-fondateur & CTO

Issu de l'écosystème startup tech, Thibault a développé une expertise en architecture de solutions IA qu'il met aujourd'hui au service de grands groupes (Atos, BNP Paribas, beta.gouv). Il intervient sur deux axes : la maîtrise des déploiements IA (LLM locaux, sécurisation MCP) et l'optimisation des coûts d'inférence (offloading, compression, gestion des tokens).

Articles liés

Découvrez d'autres articles sur des sujets similaires

Boucles Ralph : IA Simples et Efficaces

Je me souviens encore de la première fois que j'ai construit une Boucle Ralph. C'était comme trouver la pièce manquante dans le puzzle du développement piloté par l'IA. On parle ici d'un vrai workflow, pas juste de la théorie. Au lieu d'une complexité inutile, ces boucles simplifient l'automatisation en utilisant des modèles d'IA comme GPT 5.8. Imaginez pouvoir orchestrer des tâches de manière fluide et efficace, tout en tenant compte des défis et des avantages de l'IA dans le développement logiciel. Dans cet article, je vous emmène dans le monde des Boucles Ralph, leur application pratique, et comment elles peuvent véritablement transformer votre manière de travailler. On va explorer ensemble les limites à garder en tête, les considérations de sécurité et d'éthique, et comment faire évoluer ces processus dans des environnements d'équipe. Et oui, l'avenir de l'IA dans l'automatisation des workflows complexes est déjà là. Alors, prêt à plonger?

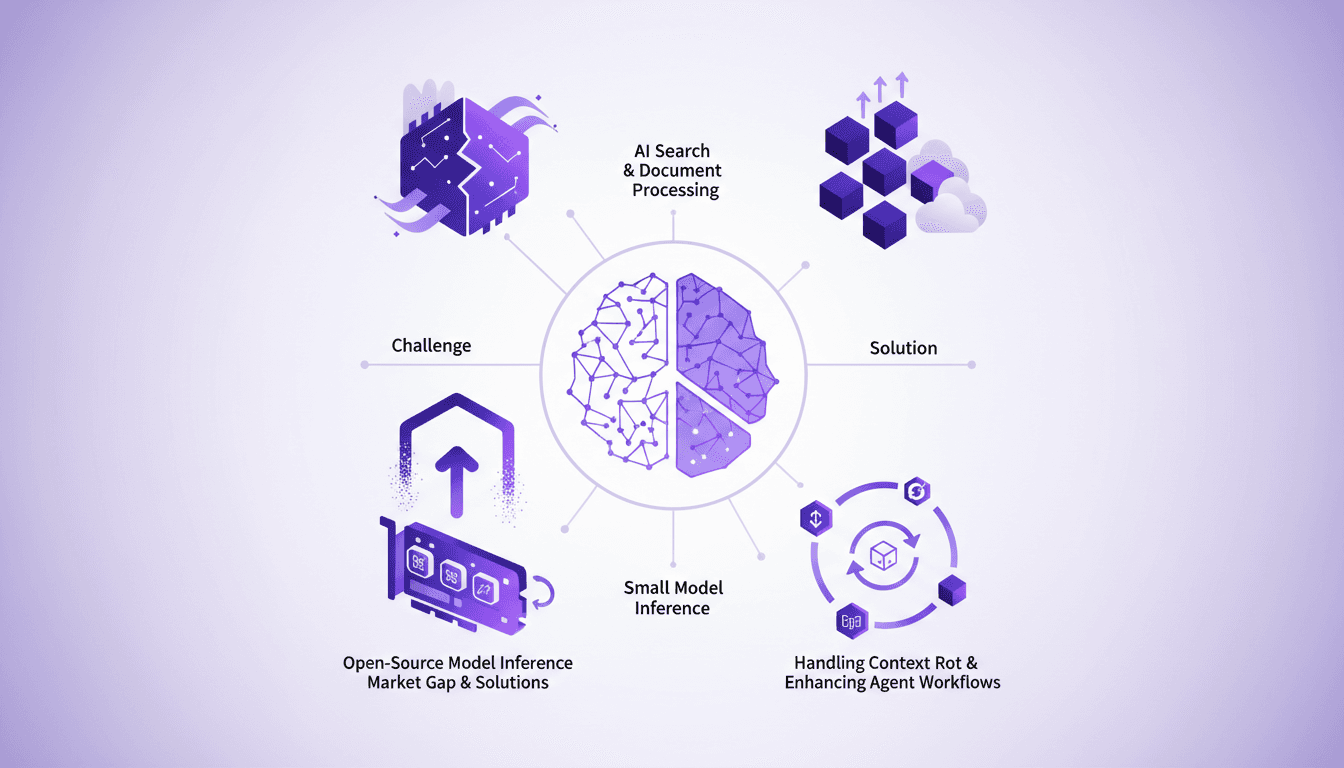

Optimisation des modèles IA : notre approche

J'ai vu un vide sur le marché pour l'inférence des petits modèles, alors j'ai décidé de construire l'infrastructure moi-même. Avec plus de 3 millions de modèles sur Hugging Face, l'absence d'une infrastructure efficace m'a sauté aux yeux. Pourquoi est-ce crucial ? Parce que les petits modèles sont essentiels pour la recherche AI et le traitement de documents. Et les défis ? Il y en a eu, mais j'ai relevé le défi. Entre le rot contextuel et l'optimisation des workflows d'agents, chaque étape a été un apprentissage. J'ai orchestré le swapping des modèles pour une utilisation efficace des GPUs, tout en soutenant diverses architectures open-source. En bref, nous avons comblé une lacune du marché avec une solution robuste et évolutive.

Modèles Gemma 4 : Révolution de l'IA sur périphérie

J'ai plongé dans le déploiement de l'IA sur des appareils en périphérie avec Gemma 4, et laissez-moi vous dire, c'est un vrai changement de jeu. Mais attention, il y a des nuances à comprendre pour que tout fonctionne parfaitement. Gemma 4 apporte des capacités inédites pour traiter les données localement, réduisant latence et utilisation de la bande passante. J'ai configuré le framework Light RT pour le déploiement, et l'amélioration des performances avec l'accélération NPU est bluffante. Mais ne vous emballez pas trop vite, le passage à la plate-forme croisée nécessite quelques ajustements. L'intégration et le soutien communautaire sont des atouts majeurs. Vous voulez maximiser ces bénéfices ? Je partage ce que j'ai appris sur le terrain.

Optimiser les Agents IA : Défis et Solutions

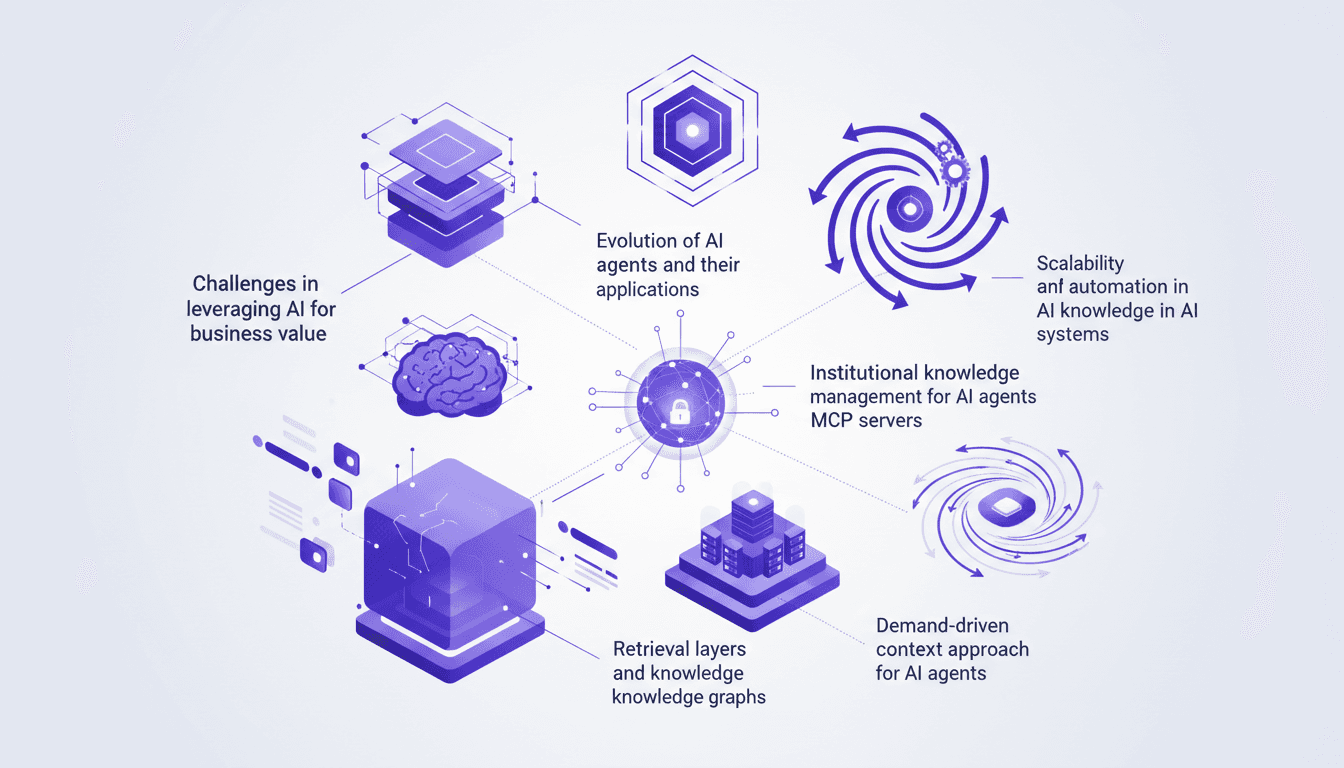

J'ai passé des heures à jongler avec les agents IA, à déchiffrer leurs subtilités et à exploiter leur potentiel. Découvrez comment j'ai abordé les défis de l'intégration de l'IA pour une vraie valeur commerciale. En plongeant dans l'évolution des agents IA, leur applicabilité et la gestion efficace dans une entreprise, je partage mes expériences concrètes. Entre la gestion des connaissances institutionnelles, la construction de serveurs MCP et l'approche contextuelle, je vous explique comment tirer le meilleur parti des agents IA. N'oubliez pas : seulement 20 % de votre documentation est vraiment utile, alors faisons que chaque mot compte.

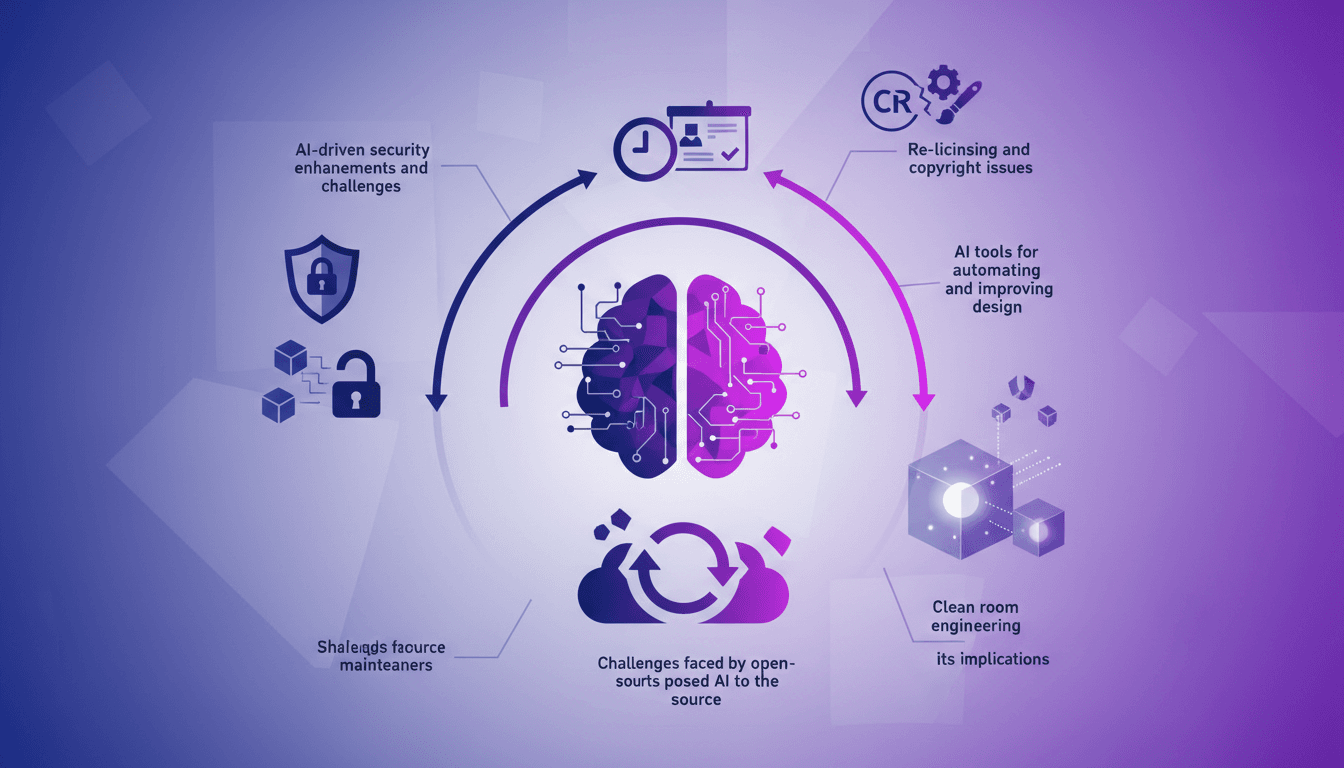

Impact de l'IA sur l'Open Source: Opportunités

Je me souviens de la première fois où j'ai intégré l'IA dans mon projet open source. C'était un véritable tournant, mais pas sans défis. L'IA redessine le paysage open source, en améliorant la sécurité mais aussi en menaçant certains modèles économiques traditionnels. Parlons des implications de cette transformation – des outils d'IA qui boostent la productivité aux enjeux de re-licensing et de droits d'auteur. Les mainteneurs open source doivent jongler avec des défis inédits, sans parler des menaces sur les modèles économiques existants. Et vous, comment votre projet open source s'adapte-t-il à cette nouvelle ère?