Optimisation des modèles IA : notre approche

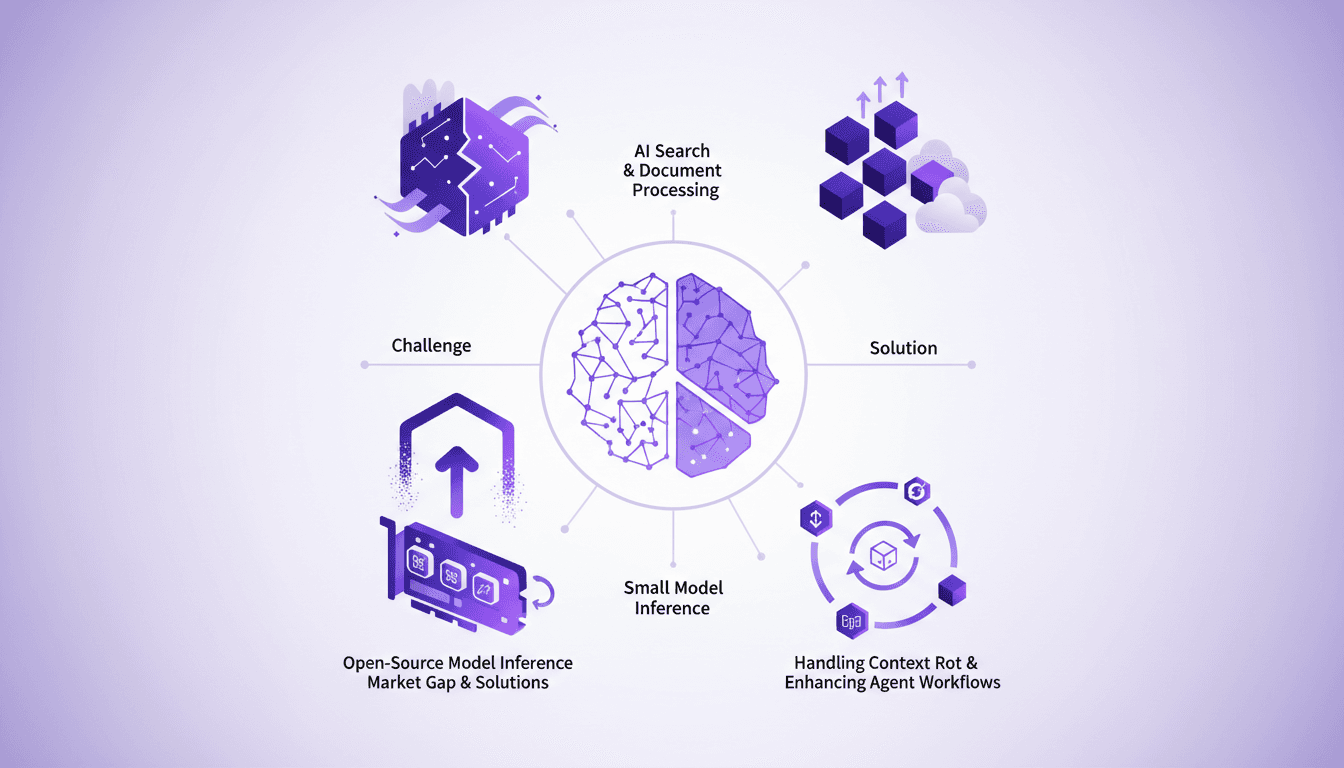

J'ai vu un vide sur le marché pour l'inférence des petits modèles, alors j'ai décidé de construire l'infrastructure moi-même. Avec plus de 3 millions de modèles sur Hugging Face, l'absence d'une infrastructure efficace m'a sauté aux yeux. Pourquoi est-ce crucial ? Parce que les petits modèles sont essentiels pour la recherche AI et le traitement de documents. Et les défis ? Il y en a eu, mais j'ai relevé le défi. Entre le rot contextuel et l'optimisation des workflows d'agents, chaque étape a été un apprentissage. J'ai orchestré le swapping des modèles pour une utilisation efficace des GPUs, tout en soutenant diverses architectures open-source. En bref, nous avons comblé une lacune du marché avec une solution robuste et évolutive.

Il y a quelques mois, en parcourant les modèles sur Hugging Face, un chiffre m'a marqué : 3 millions. Pourtant, malgré cette abondance, l'infrastructure pour l'inférence des petits modèles était quasi inexistante. Alors, je me suis retroussé les manches et j'ai décidé de bâtir cette infrastructure moi-même. Pourquoi ? Parce que dans le domaine de l'IA, l'inférence des petits modèles est un pilier pour la recherche et le traitement des documents. Dans cette présentation, je vais partager comment j'ai abordé les défis de front : gérer le rot contextuel, améliorer les workflows des agents, et optimiser l'utilisation des GPUs grâce au swapping des modèles. Nous avons soutenu divers modèles open-source et architectures, le tout avec une solution évolutive et robuste. Alors, plongeons ensemble dans ces détails techniques et voyons comment combler ce vide a transformé notre approche des modèles IA.

Identifier le Créneau de Marché pour l'Inférence des Petits Modèles

J'ai toujours été frappé par le manque d'infrastructure adéquate pour l'inférence des petits modèles, surtout quand on pense à leur importance dans la recherche en IA et le traitement de documents. C'est là que j'ai senti un vrai décalage sur le marché : beaucoup de solutions se focalisent sur les gros modèles, mais négligent les petits qui sont pourtant essentiels pour des tâches précises. Une inefficacité flagrante dans les solutions d'inférence actuelles, c'est ce que j'ai constaté après quelques années d'expérience en IA. Mon article sur Substack publié il y a quelques mois avait déjà attiré l'attention sur ces questions. Ce n'était pas une surprise quand j'ai décidé de construire une solution pour combler ce vide.

Un chiffre à garder en tête : Il existe actuellement près de 3 millions de modèles open-source sur des plateformes comme Hugging Face. Avec une telle diversité, l'infrastructure doit être prête à gérer ces modèles efficacement.

Surmonter les Défis de l'Inférence des Modèles

L'un des plus grands défis rencontrés est ce que j'appelle la « pourriture du contexte » (ou context rot). C'est cette dégradation de la qualité qui se produit à mesure que le contexte augmente. Cela a un impact direct sur les flux de travail. Ensuite, il y a l'utilisation efficace des GPU. Les solutions d'inférence open-source existantes ont souvent des limites, notamment en matière d'efficacité de l'utilisation des GPU. J'ai dû naviguer à travers ces obstacles, parfois en me brûlant les doigts, mais chaque erreur m'a enseigné quelque chose.

Mise en Œuvre des Solutions : Hot-Swapping et Optimisation GPU

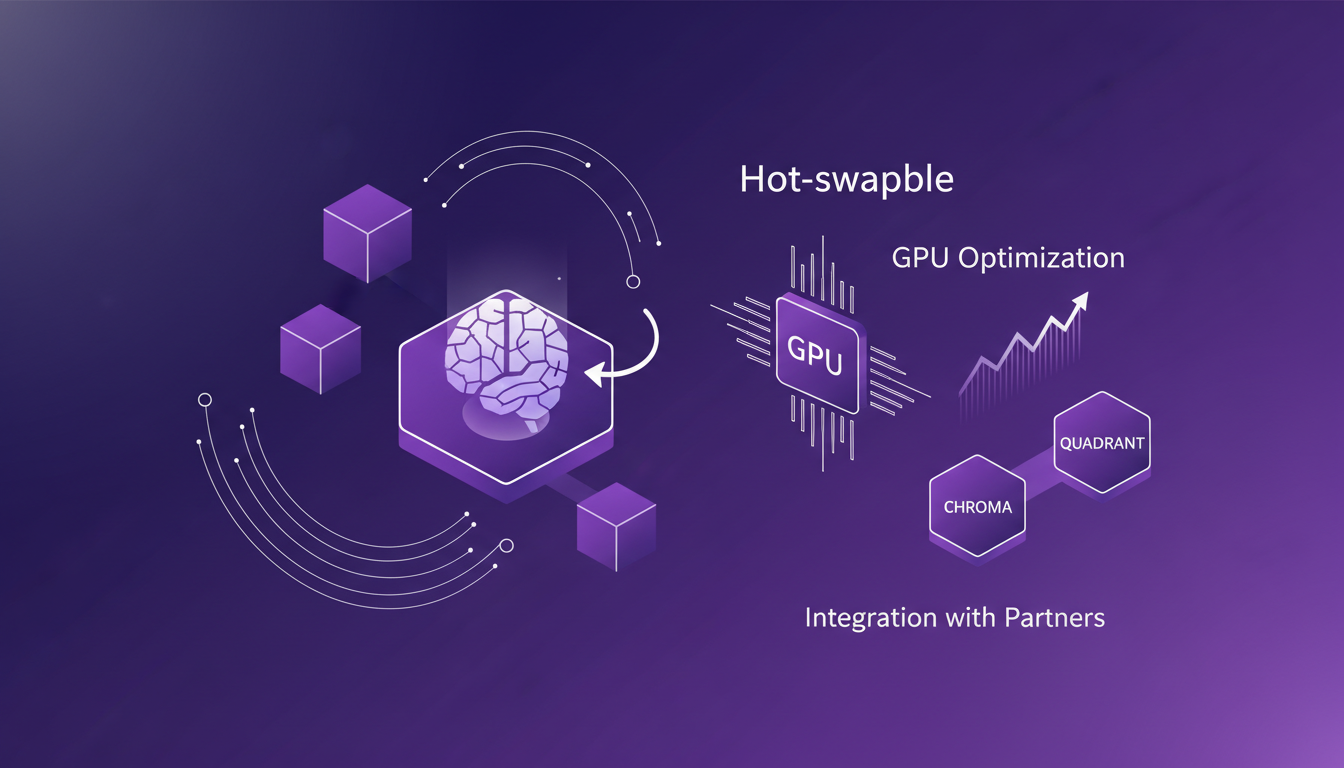

Pour améliorer l'utilisation des GPU, j'ai mis en place le hot-swapping des modèles : une technique qui permet de remplacer un modèle par un autre sans arrêt de l'infrastructure. Cela permet une meilleure utilisation des ressources et des économies de coûts non négligeables. J'ai travaillé avec des partenaires comme Chroma et Quadrant pour intégrer ces solutions. Les bénéfices sont là, mais il faut être conscient des pièges potentiels, comme la surcharge du système.

- Économie de coûts grâce à une meilleure utilisation des GPU

- Intégration avec des partenaires pour des solutions optimisées

- Attention aux possibles surcharges du système

Soutien aux Modèles Open-Source et Architectures

Nous avons également étendu notre soutien à divers modèles open-source en utilisant des méthodes comme le VLAM pour l'entraînement. Cela nous a permis de gérer des architectures variées et de maintenir une flexibilité essentielle dans notre support de modèles. Gérer différents aspects comme la fusion query-key-value et les embeddings positionnels est un défi, mais essentiel pour une inférence efficace.

Construire l'Infrastructure : Primitives, Routage et Auto-Scaling

Notre infrastructure repose sur des primitives telles que encode, score et extract, qui sont vitales pour la gestion des modèles. Nous avons également intégré des solutions d'auto-scaling avec KEDA et Prometheus, ce qui nous a permis d'optimiser la charge de travail et l'utilisation des ressources. Le lancement du moteur d'inférence Superlinked a été un moment clé, et les leçons apprises sont précieuses.

En somme, construire cette infrastructure a été un chemin semé d'embûches, mais chaque défi a renforcé notre capacité à fournir des solutions robustes et efficaces pour l'inférence des petits modèles. L'expérience pratique et les erreurs m'ont permis d'affiner notre approche, et je suis convaincu que nous avons comblé une lacune critique sur le marché.

J'ai construit une infrastructure qui comble le fossé de l'inférence des petits modèles, optimisant l'efficacité et soutenant les modèles open-source de manière efficace. Voici les points clés que j'ai tirés de cette expérience :

- On peut surmonter les défis de l'inférence des modèles IA avec les bons outils et stratégies.

- L'inférence des petits modèles est cruciale pour la recherche IA et le traitement des documents.

- Il y a un vrai manque sur le marché pour des solutions d'inférence de modèles open-source.

- Le hot-swapping des modèles sur GPU change la donne en termes d'efficacité.

En regardant vers l'avenir, je suis convaincu que cette approche va transformer la façon dont nous intégrons et exploitons les modèles IA au quotidien. Mais attention, il faut bien gérer les ressources pour éviter de saturer les GPUs.

Prêt à optimiser l'inférence de vos modèles IA ? Plongez dans notre approche et voyez la différence que cela peut faire dans vos workflows. Regardez la vidéo complète "The Small Model Infrastructure Nobody Built (So We Did) — Filip Makraduli, Superlinked" pour comprendre notre méthode en profondeur : https://www.youtube.com/watch?v=qdh_x-uRs9g

Questions Fréquentes

Thibault Le Balier

Co-fondateur & CTO

Issu de l'écosystème startup tech, Thibault a développé une expertise en architecture de solutions IA qu'il met aujourd'hui au service de grands groupes (Atos, BNP Paribas, beta.gouv). Il intervient sur deux axes : la maîtrise des déploiements IA (LLM locaux, sécurisation MCP) et l'optimisation des coûts d'inférence (offloading, compression, gestion des tokens).

Articles liés

Découvrez d'autres articles sur des sujets similaires

Modèles Gemma 4 : Révolution de l'IA sur périphérie

J'ai plongé dans le déploiement de l'IA sur des appareils en périphérie avec Gemma 4, et laissez-moi vous dire, c'est un vrai changement de jeu. Mais attention, il y a des nuances à comprendre pour que tout fonctionne parfaitement. Gemma 4 apporte des capacités inédites pour traiter les données localement, réduisant latence et utilisation de la bande passante. J'ai configuré le framework Light RT pour le déploiement, et l'amélioration des performances avec l'accélération NPU est bluffante. Mais ne vous emballez pas trop vite, le passage à la plate-forme croisée nécessite quelques ajustements. L'intégration et le soutien communautaire sont des atouts majeurs. Vous voulez maximiser ces bénéfices ? Je partage ce que j'ai appris sur le terrain.

Boucles Ralph : IA Simples et Efficaces

Je me souviens encore de la première fois que j'ai construit une Boucle Ralph. C'était comme trouver la pièce manquante dans le puzzle du développement piloté par l'IA. On parle ici d'un vrai workflow, pas juste de la théorie. Au lieu d'une complexité inutile, ces boucles simplifient l'automatisation en utilisant des modèles d'IA comme GPT 5.8. Imaginez pouvoir orchestrer des tâches de manière fluide et efficace, tout en tenant compte des défis et des avantages de l'IA dans le développement logiciel. Dans cet article, je vous emmène dans le monde des Boucles Ralph, leur application pratique, et comment elles peuvent véritablement transformer votre manière de travailler. On va explorer ensemble les limites à garder en tête, les considérations de sécurité et d'éthique, et comment faire évoluer ces processus dans des environnements d'équipe. Et oui, l'avenir de l'IA dans l'automatisation des workflows complexes est déjà là. Alors, prêt à plonger?

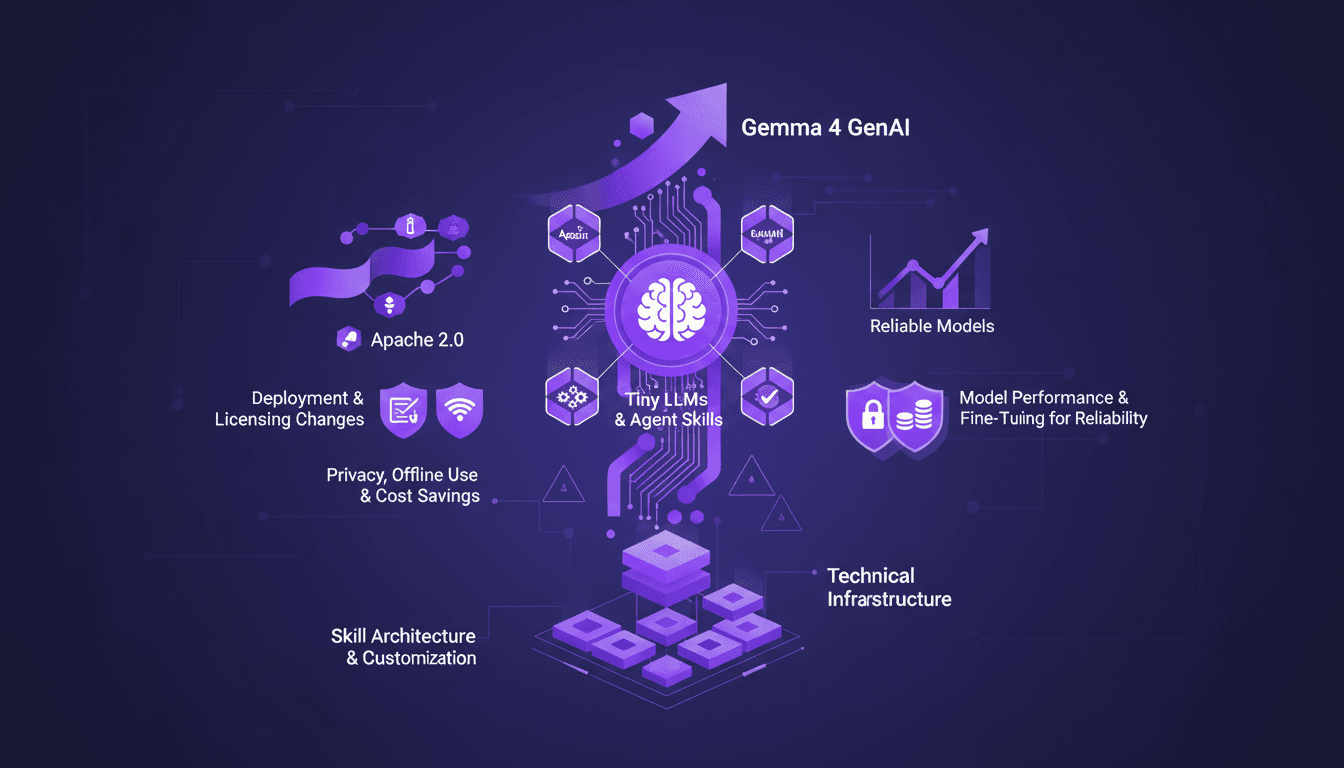

Edge AI : Avantages et Tiny LLMs en Périphérie

J'ai passé plus d'une décennie à plonger dans l'IA Edge, et laissez-moi vous dire, c'est un vrai bouleversement. Exécuter des modèles d'IA directement sur des appareils Edge n'est pas juste une tendance technologique—c'est une solution concrète aux défis du monde réel. Avec le lancement de Gemma 4 et les avancées dans les Tiny LLMs, nous assistons à un changement vers des solutions d'IA plus efficaces et fiables. En parlant de déploiement et de coût, l'IA Edge redéfinit la donne avec des gains en performance, confidentialité, et utilisation hors ligne. Pourtant, le véritable potentiel réside dans la personnalisation et l'architecture des compétences des modèles. Dans cette conférence, nous plongeons dans la structure technique nécessaire pour faire tourner l'IA sur des appareils Edge, les changements de déploiement et de licence, et comment les Tiny LLMs peuvent transformer nos approches actuelles.

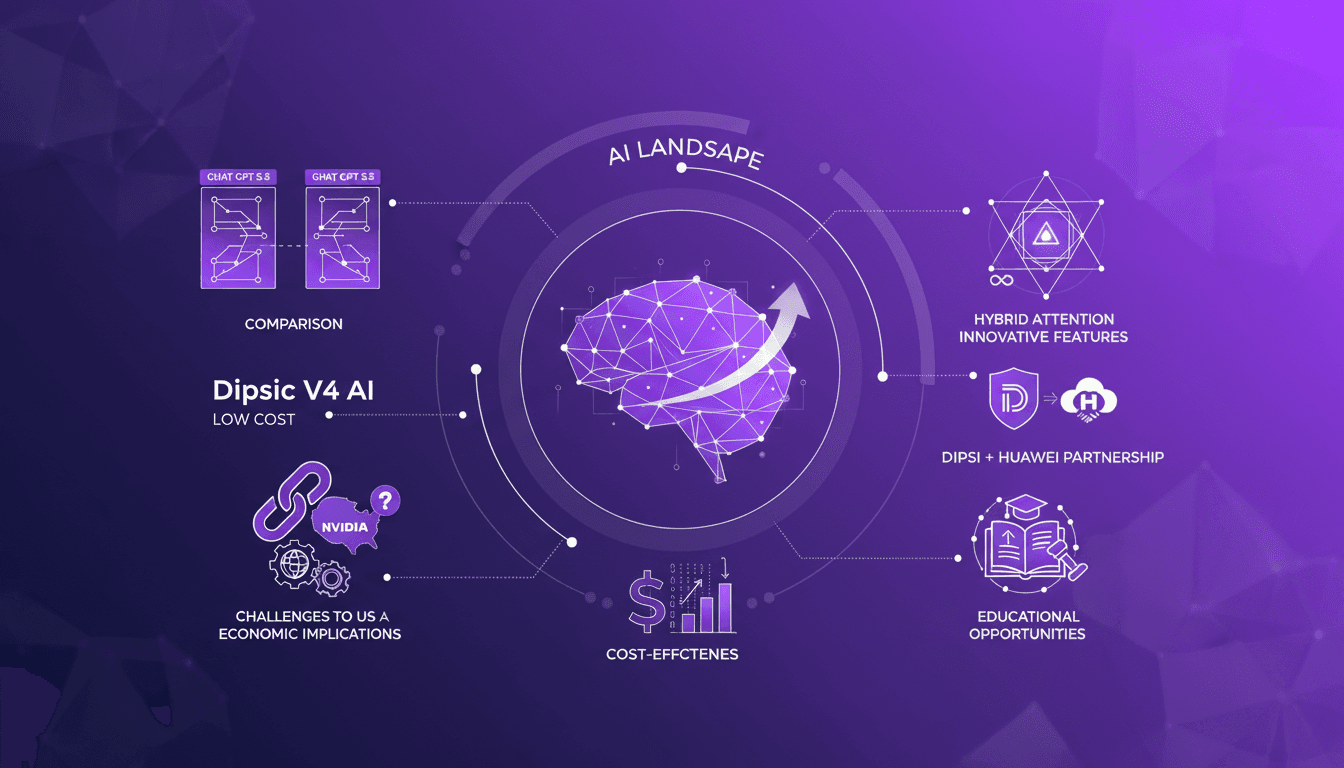

Dipsic V4 : Révolution IA, défis OpenAI

J'ai passé des années dans les tranchées de l'IA, à observer l'évolution des modèles. Mais quand j'ai mis la main sur le Dipsic V4, j'ai su qu'on tenait quelque chose de révolutionnaire. Avec ses 1600 milliards de paramètres, ce modèle n'est pas simplement un autre outil dans le paysage; c'est un potentiel perturbateur face aux géants comme GPT 5.5 d'OpenAI. Je vais vous montrer pourquoi ce modèle fait tant de vagues et comment il redéfinit les règles du jeu. On parlera de ses caractéristiques innovantes, de sa stratégie de prix agressive, et de ce que cela signifie pour des acteurs comme Nvidia et OpenAI. Attention, ça peut changer la donne.

Récursion en IA: Révolutionner les Modèles

J'ai passé des heures à peaufiner des modèles d'IA, et franchement, la récursion est le game changer qu'on attendait. Finies les courses à plus de paramètres, place à l'intelligence. Quand les modèles traditionnels butent sur des limites, la récursion offre une perspective nouvelle. On va explorer comment elle pourrait redéfinir l'efficacité et les capacités de l'IA. On parlera de modèles de raisonnement hiérarchique, de modèles récursifs miniatures, d'apprentissage d'équilibre profond et des défis de l'optimisation. Si vous avez déjà été frustré par les murs de la scalabilité, vous allez adorer ce nouveau paradigme.