Dipsic V4 : Révolution IA, défis OpenAI

J'ai passé des années dans les tranchées de l'IA, à observer l'évolution des modèles. Mais quand j'ai mis la main sur le Dipsic V4, j'ai su qu'on tenait quelque chose de révolutionnaire. Avec ses 1600 milliards de paramètres, ce modèle n'est pas simplement un autre outil dans le paysage; c'est un potentiel perturbateur face aux géants comme GPT 5.5 d'OpenAI. Je vais vous montrer pourquoi ce modèle fait tant de vagues et comment il redéfinit les règles du jeu. On parlera de ses caractéristiques innovantes, de sa stratégie de prix agressive, et de ce que cela signifie pour des acteurs comme Nvidia et OpenAI. Attention, ça peut changer la donne.

J'ai passé des années dans les tranchées de l'IA, observant l'évolution des modèles. Mais quand j'ai mis la main sur Dipsic V4, j'ai su qu'on tenait quelque chose de révolutionnaire. Avec 1600 milliards de paramètres, ce modèle n'est pas juste un autre nom sur la liste; il a le potentiel de bouleverser un espace dominé par des géants comme GPT 5.5 d'OpenAI. Et ce n'est pas que du bruit. Dipsic V4 innove avec une approche hybride de l'attention, et son prix agressif pourrait bien secouer le marché. Imaginez : des actions comme Zipo, AI et Minimax ont déjà dévissé de 9%. On va plonger dans les détails de ce modèle perturbateur, ses implications politiques et économiques, et pourquoi Nvidia et l'industrie IA américaine devraient s'inquiéter. Je vais aussi vous parler des programmes de formation en IA qui émergent autour de cet écosystème. Préparez-vous à repenser vos stratégies.

Introduction à Dipsic V4 : Une Révolution en Marche

Dipsic V4, c'est un monstre de puissance dans le monde de l'IA. Avec 1600 milliards de paramètres dans le modèle V4 Pro, on joue dans une autre cour. Ces spécifications ne sont pas juste des chiffres à la mode : elles changent concrètement la manière dont on utilise et pense l'IA au quotidien. Chaque requête exploite 49 milliards de paramètres actifs, ce qui optimise incroyablement l'efficacité. C'est un peu comme passer d'une voiture à essence à une voiture électrique : tout change, et ça se sent immédiatement.

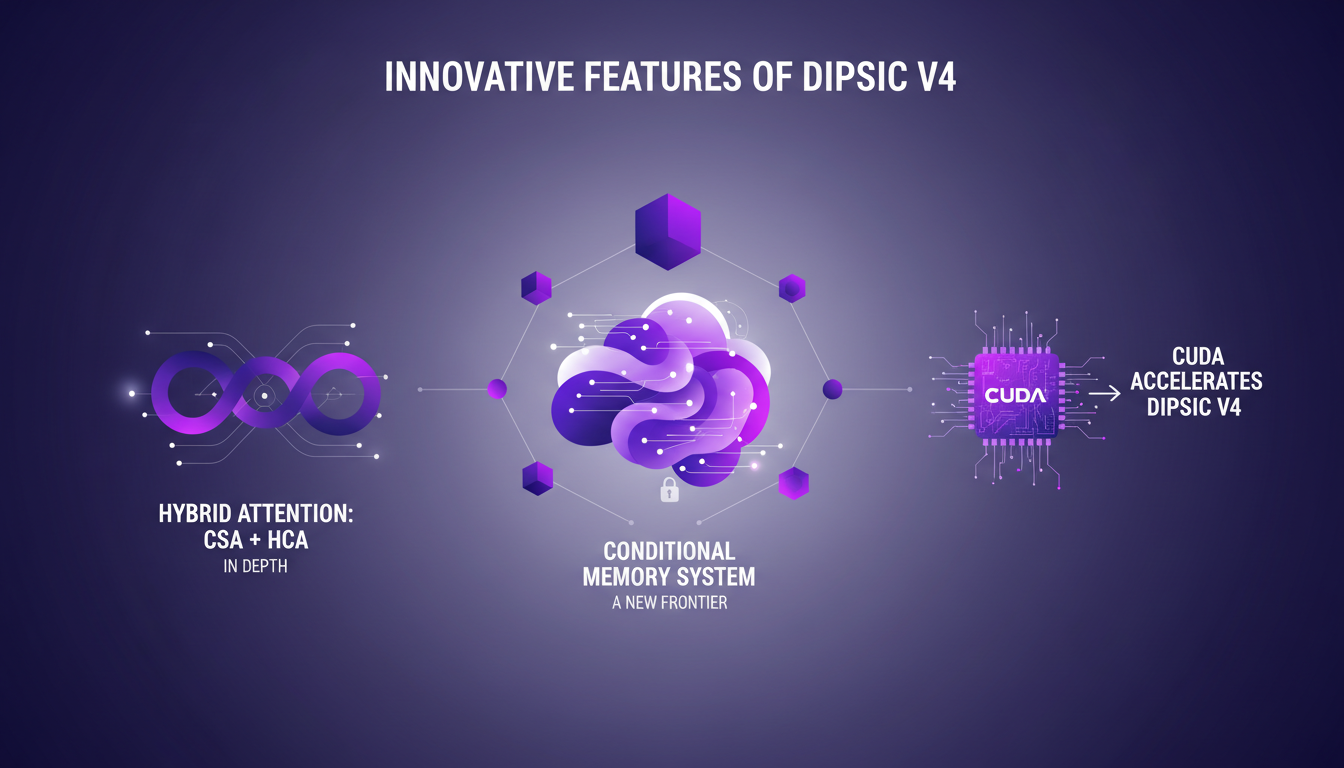

Mais ce qui rend Dipsic V4 vraiment unique, c'est son approche hybride de l'attention avec le hybrid attention : CSA + HCA. Ces termes techniques, en gros, signifient qu'on combine les forces de deux méthodes pour obtenir une performance optimale. En pratique, cela signifie une réduction spectaculaire de la consommation de puissance de calcul et une utilisation optimisée de la mémoire de travail. Dipsic V4 ne fait pas qu'améliorer le passé, il réinvente les règles du jeu.

Dipsic V4 vs GPT 5.5 : Duel au Sommet

En parlant de révolution, comparons Dipsic V4 avec GPT 5.5. Là où Dipsic V4 brille, c'est dans sa capacité à gérer efficacement de vastes contextes, jusqu'à 1 million de tokens, soit environ 750 000 mots. Imaginez lire toute une série de romans en une seule fois. Mais attention, GPT 5.5 garde son avantage sur certains aspects, comme la diversité des applications commerciales.

Le système de mémoire conditionnelle de Dipsic V4 est une innovation majeure. Inspiré de la mémoire humaine, il permet à l'IA d'oublier les détails non pertinents et de compresser l'information de manière efficace. De plus, le KV Cache améliore l'efficacité de la mémoire de travail, ce qui permet de traiter des tâches plus complexes sans exploser les coûts.

Fonctionnalités Innovantes de Dipsic V4

Revenons sur l'approche hybride de l'attention : CSA + HCA. En combinant ces deux méthodes, Dipsic V4 réduit la consommation de puissance tout en augmentant les capacités de traitement. C'est un peu comme passer d'un moteur à piston à un moteur à réaction.

Ensuite, le système de mémoire conditionnelle, c'est vraiment la nouvelle frontière. Il permet à l'IA de fonctionner de manière plus humaine, oubliant ce qui est inutile et se concentrant sur l'essentiel. Et là où CUDA entre en jeu, c'est pour accélérer la performance de Dipsic V4, rendant les traitements encore plus rapides et moins gourmands en énergie.

Coût-Efficacité et Partenariats Stratégiques

Parlons chiffres. Le modèle Dipsic V4 est proposé à un tarif bien plus compétitif que ses concurrents, comme Chat GPT 5.5 et Claud 4.7. C'est un positionnement stratégique qui change la donne du marché. Le partenariat avec Huawei est une autre pièce maîtresse du puzzle, imposant une nouvelle dynamique dans le secteur de l'IA.

Ce partenariat avec Huawei, basé sur l'utilisation de puces et logiciels chinois, bouleverse le marché, concurrençant directement Nvidia et son CUDA. Les implications économiques sont énormes, comme en témoigne une baisse de 9 % des actions de Zipo, AI, et Minimax. Mais attention, le coût n'est qu'une partie de l'équation. Il faut aussi considérer la performance et la pérennité des solutions proposées.

Opportunités Éducatives et Perspectives Futures

Pour ceux qui veulent s'immerger dans l'univers de Dipsic V4, des programmes de formation sont disponibles. Ces ressources permettent de se familiariser avec les modèles, sans prérequis techniques. C'est une porte d'entrée vers l'avenir de l'IA, où la formation continue devient essentielle.

Les implications politiques et économiques de la sortie de Dipsic V4 sont également à prendre en compte. Dans un contexte de rivalités entre les États-Unis et la Chine, ce modèle devient un acteur clé. Pour les praticiens, il est crucial de se préparer à ces changements et d'anticiper les évolutions futures de l'IA.

Dipsic V4, c'est vraiment un bond en avant, pas juste un autre modèle d'IA. En pratique, je vois déjà comment son approche hybride d'attention change la donne. D'abord, en intégrant ces 1600 milliards de paramètres, on obtient une précision que je n'avais pas rencontrée ailleurs. Mais attention, le coût est un facteur à surveiller, même avec leur stratégie tarifaire agressive. Ensuite, les partenariats stratégiques qu'ils ont établis ouvrent la voie à des intégrations plus fluides dans nos flux de travail. Et puis, pour ceux qui comparent avec Chat GPT 5.5, il ne suffit pas de regarder les chiffres. Il faut tester en conditions réelles.

Pour l'avenir, je suis convaincu que maîtriser Dipsic V4 nous permettra de transformer nos projets IA. On ne peut pas se permettre d'ignorer ces nouvelles technologies. Je vous encourage vivement à plonger dans les caractéristiques de Dipsic V4 et à explorer son potentiel. Pour une compréhension plus approfondie, regardez la vidéo originale : elle offre un aperçu essentiel de ce que DeepSeek a accompli face à OpenAI. Lien YouTube

Questions Fréquentes

Thibault Le Balier

Co-fondateur & CTO

Issu de l'écosystème startup tech, Thibault a développé une expertise en architecture de solutions IA qu'il met aujourd'hui au service de grands groupes (Atos, BNP Paribas, beta.gouv). Il intervient sur deux axes : la maîtrise des déploiements IA (LLM locaux, sécurisation MCP) et l'optimisation des coûts d'inférence (offloading, compression, gestion des tokens).

Articles liés

Découvrez d'autres articles sur des sujets similaires

GPT 5.5 : Accélération des Tokens et Stratégie

Je me suis plongé dans GPT 5.5 dès sa sortie, et croyez-moi, cette augmentation de 20% de la vitesse des tokens n'est pas qu'un simple chiffre — c'est un vrai game changer pour les applications en temps réel. Mais ne vous laissez pas tromper, il y a bien plus que de la vitesse sous le capot. Lancé le 23 avril 2026, ce modèle marque une évolution rapide dans les offres d'OpenAI. Ce n'est pas juste une question de nouvelles fonctionnalités ; il s'agit d'un pivot stratégique vers les solutions d'entreprise, optimisant l'infrastructure et redéfinissant l'efficacité. Nous allons explorer ensemble les nouveautés de GPT 5.5, la stratégie de marché d'Entropique, l'impact de Cloud Code sur le paysage du codage, et comment OpenAI redéfinit son approche pour conquérir les marchés d'entreprise.

Maîtriser la tarification AI: Modèles hybrides

Je me souviens encore de la première fois où j'ai dû fixer le prix d'un service AI. La croissance était explosive, mais le modèle de tarification ressemblait à une camisole de force. Parlons de comment on peut s'en libérer. Aujourd'hui, les entreprises AI dépassent les SaaS traditionnels en vitesse, mais leurs stratégies de prix ne suivent pas toujours. Dans cet article, je vais partager des insights pratiques sur comment adopter des modèles de monétisation flexibles et agiles pour les produits AI. On abordera les défis de la tarification AI, comme les coûts imprévisibles et la définition de la valeur, et l'adoption de modèles hybrides. On verra aussi comment basculer vers une tarification basée sur les résultats pour gagner la confiance des clients, grâce à des plafonds d'utilisation et des notifications. Enfin, on discutera du rôle de Stripe pour soutenir les entreprises AI avec des solutions de facturation flexibles. C'est le moment de réinventer notre approche pour être vraiment aligné avec la valeur réelle.

Récursion en IA: Révolutionner les Modèles

J'ai passé des heures à peaufiner des modèles d'IA, et franchement, la récursion est le game changer qu'on attendait. Finies les courses à plus de paramètres, place à l'intelligence. Quand les modèles traditionnels butent sur des limites, la récursion offre une perspective nouvelle. On va explorer comment elle pourrait redéfinir l'efficacité et les capacités de l'IA. On parlera de modèles de raisonnement hiérarchique, de modèles récursifs miniatures, d'apprentissage d'équilibre profond et des défis de l'optimisation. Si vous avez déjà été frustré par les murs de la scalabilité, vous allez adorer ce nouveau paradigme.

Chaîne d'approvisionnement 2.0 : Révolutionner les semi-conducteurs

J'ai passé des années plongé dans les chaînes d'approvisionnement des semi-conducteurs, et croyez-moi, ce n'est pas qu'une question de fabriquer des puces; c'est une véritable symphonie mondiale à orchestrer. On commence par les 1 400 étapes de processus, puis on navigue à travers une douzaine de pays. Mais que se passe-t-il quand une puce à 300 $ bloque une voiture à 50 000 $? C'est là que ça devient sérieux. Avec les puces AI en première ligne, chaque étape, de la fabrication à la livraison, doit être optimisée. Plongeons dans ces défis et découvrons où les opportunités se cachent.

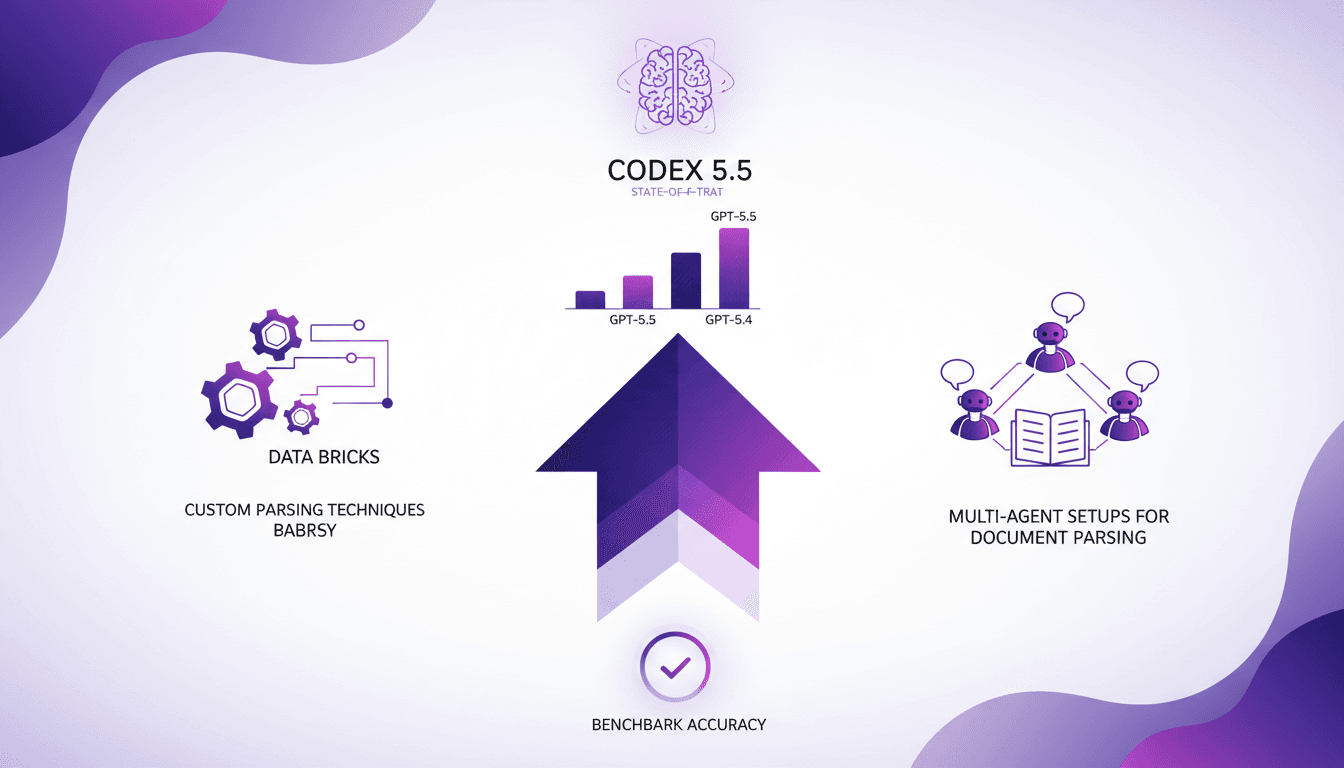

Améliorations GPT-5.5 : Performances et Précision

Je me suis retrouvé jusqu'au cou dans les défis de parsing quand GPT-5.5 est arrivé, et laissez-moi vous dire, c'est un vrai game changer. Mais attention, ce n'est pas sans quelques pièges. Dans l'environnement complexe de Databricks, la configuration stratégique est clé. Avec des améliorations de performance impressionnantes et une précision accrue, GPT-5.5 redéfinit les standards, mais il faut savoir l'apprivoiser. Je vais vous montrer comment j'ai exploité cette puissance, en passant par des techniques de parsing personnalisées et des configurations multi-agents. Préparez-vous à plonger dans les détails techniques et à découvrir comment Codex 5.5 s'impose comme le modèle ultime!