Modèles Gemma 4 : Révolution de l'IA sur périphérie

J'ai plongé dans le déploiement de l'IA sur des appareils en périphérie avec Gemma 4, et laissez-moi vous dire, c'est un vrai changement de jeu. Mais attention, il y a des nuances à comprendre pour que tout fonctionne parfaitement. Gemma 4 apporte des capacités inédites pour traiter les données localement, réduisant latence et utilisation de la bande passante. J'ai configuré le framework Light RT pour le déploiement, et l'amélioration des performances avec l'accélération NPU est bluffante. Mais ne vous emballez pas trop vite, le passage à la plate-forme croisée nécessite quelques ajustements. L'intégration et le soutien communautaire sont des atouts majeurs. Vous voulez maximiser ces bénéfices ? Je partage ce que j'ai appris sur le terrain.

Je me suis lancé dans le déploiement de l'IA sur des appareils en périphérie avec Gemma 4, et croyez-moi, ça change la donne. Mais il y a des subtilités à maîtriser pour que tout fonctionne sans accroc. D'abord, comprendre comment Gemma 4 permet de traiter les données localement est essentiel. Cela réduit non seulement la latence mais aussi l'utilisation de la bande passante. J'ai commencé par configurer le framework Light RT pour le déploiement. L'accélération des performances avec le NPU est époustouflante, mais faites attention, l'intégration multi-plateforme nécessite des ajustements. Par exemple, le modèle Gemma 4 4B, une fois quantifié, a des exigences RAM de 4 Go — cela peut surprendre si vous n'êtes pas préparé. J'ai aussi découvert l'importance du soutien communautaire et des contributions open-source pour enrichir l'expérience. Vous vous demandez comment tirer le meilleur parti de ces modèles ? Je partage mes expériences et les erreurs que j'ai évitées après quelques mauvais départs.

Comprendre Gemma 4 et les Modèles Edge

Gemma 4, c'est la nouvelle frontière de l'AI sur les dispositifs edge, là où l'efficacité règne. Quand j'ai commencé à jouer avec ces modèles, j'ai tout de suite remarqué leur design optimisé pour fonctionner sur des appareils aux ressources limitées. Imaginez : le modèle E2B de Gemma 4 utilise entre 1 et 2 Go de RAM. C'est presque rien comparé à ce qu'on voit d'habitude. Et si vous passez aux modèles plus costauds comme le 4B, après quantification, on parle de 4 Go de RAM. C'est une belle évolution depuis Gemma 3 et ses 270 millions de paramètres. Ça, c'est du concret. Mais attention, tout ça demande une orchestration fine, sinon on se retrouve vite à court de ressources.

Avantages et Défis de l'AI sur les Dispositifs Edge

Quand on parle d'AI sur edge, les avantages sont là. Réduction de la latence, confidentialité accrue... C'est vraiment un game changer pour les applications en temps réel. Avec l'edge AI, on coupe court aux coûts de transmission de données. Mais je ne vais pas vous mentir, ça a ses limites. Le pouvoir de traitement et le stockage sont restreints sur ces appareils. Il faut donc bien calibrer la complexité des modèles avec les capacités de l'appareil. Croyez-moi, j'ai passé des nuits blanches à cause de ça.

- Latence réduite pour des applications en temps réel

- Confidentialité accrue par le traitement local

- Coûts de transmission de données réduits

- Attention à la puissance de traitement limitée

Nouvelles Capacités de Gemma 4 et Déploiement avec Light RT

La grande nouveauté, c'est vraiment les capacités améliorées des modèles Gemma 4. On parle de performance, de support JSON structuré, et de compatibilité avec le matériel natif. Mais ce qui m'a vraiment frappé, c'est le framework Light RT. Une fois configuré, il s'intègre sans souci avec vos appareils edge. La quantification joue ici un rôle crucial en réduisant les exigences en RAM. D'abord, configurez Light RT, ensuite intégrez-le avec votre dispositif edge. J'ai vu ça marcher comme sur des roulettes, mais attention, ça demande une bonne compréhension des besoins de votre plateforme.

Cas d'Utilisation et Accélération NPU

Les cas pratiques, c'est là où ça devient intéressant. Les systèmes d'analyse en temps réel, les appareils IoT, tout ça bénéficie de l'accélération NPU. J'ai testé sur des appareils iOS et IoT et les performances ont explosé, jusqu'à 13 fois plus rapides. Mais là encore, il y a un revers à la médaille : l'intégration NPU peut nécessiter des ajustements matériels supplémentaires. Et attention à la compatibilité avec l'infrastructure existante. J'ai eu quelques surprises là-dessus, pas toujours agréables.

- Analytique en temps réel

- Accélération NPU : jusqu'à 13x plus rapide

- Considérations matérielles supplémentaires possibles

- Compatibilité avec l'infrastructure existante

Intégration Multi-plateforme et Contributions Communautaires

L'intégration multi-plateforme, c'est un atout majeur discuté à la marque 00:50:00. Elle assure une applicabilité large. Grâce à la licence Apache 2.0, les contributions open-source affluent, ce qui stimule l'innovation et le support. D'abord, évaluez vos besoins en plateforme, ensuite, exploitez les ressources communautaires. J'ai vu des collaborations fructueuses se nouer autour de ces licences. C'est un vrai écosystème en ébullition.

- Support multi-plateforme pour une large applicabilité

- Licence Apache 2.0 facilite les contributions open-source

- L'innovation est stimulée par l'implication communautaire

- Commencez par évaluer vos besoins en plateforme

En travaillant avec les modèles Gemma 4, j'ai vraiment vu comment ils transforment le déploiement de l'IA en périphérie. Premièrement, ces modèles apportent des gains d'efficacité et de performance sur des appareils avec une utilisation RAM allant de 1 à 2 Go pour le modèle E2B. Ensuite, la capacité de Gemma 4 à fonctionner avec seulement 4 Go de RAM après quantification est un vrai tournant. Mais attention, il faut équilibrer la complexité du modèle avec les capacités de l'appareil pour éviter les mauvaises surprises. Enfin, s'appuyer sur les ressources de la communauté peut vraiment optimiser vos résultats. Avec Gemma 4, on est à un pas d'une nouvelle ère pour l'IA en périphérie, mais il faut rester vigilant sur les limites matérielles. Prêt à intégrer Gemma 4 sur vos appareils en périphérie ? Plongez dans le processus de déploiement et rejoignez la communauté croissante des innovateurs de l'IA en périphérie. Pour une plongée plus profonde, je vous recommande de regarder la vidéo originale : 'Accelerating AI on Edge' par Chintan Parikh et Weiyi Wang. Cela pourrait vraiment enrichir votre compréhension !

Questions Fréquentes

Thibault Le Balier

Co-fondateur & CTO

Issu de l'écosystème startup tech, Thibault a développé une expertise en architecture de solutions IA qu'il met aujourd'hui au service de grands groupes (Atos, BNP Paribas, beta.gouv). Il intervient sur deux axes : la maîtrise des déploiements IA (LLM locaux, sécurisation MCP) et l'optimisation des coûts d'inférence (offloading, compression, gestion des tokens).

Articles liés

Découvrez d'autres articles sur des sujets similaires

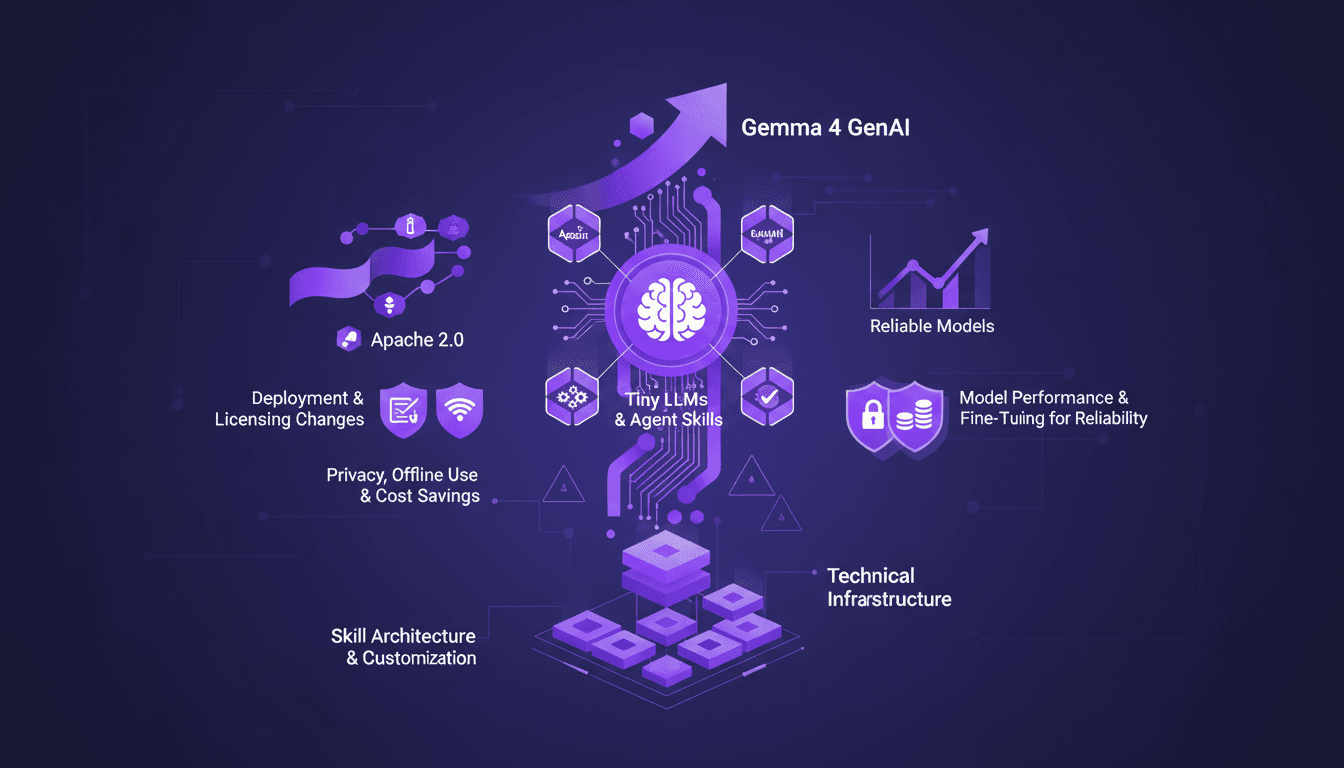

Edge AI : Avantages et Tiny LLMs en Périphérie

J'ai passé plus d'une décennie à plonger dans l'IA Edge, et laissez-moi vous dire, c'est un vrai bouleversement. Exécuter des modèles d'IA directement sur des appareils Edge n'est pas juste une tendance technologique—c'est une solution concrète aux défis du monde réel. Avec le lancement de Gemma 4 et les avancées dans les Tiny LLMs, nous assistons à un changement vers des solutions d'IA plus efficaces et fiables. En parlant de déploiement et de coût, l'IA Edge redéfinit la donne avec des gains en performance, confidentialité, et utilisation hors ligne. Pourtant, le véritable potentiel réside dans la personnalisation et l'architecture des compétences des modèles. Dans cette conférence, nous plongeons dans la structure technique nécessaire pour faire tourner l'IA sur des appareils Edge, les changements de déploiement et de licence, et comment les Tiny LLMs peuvent transformer nos approches actuelles.

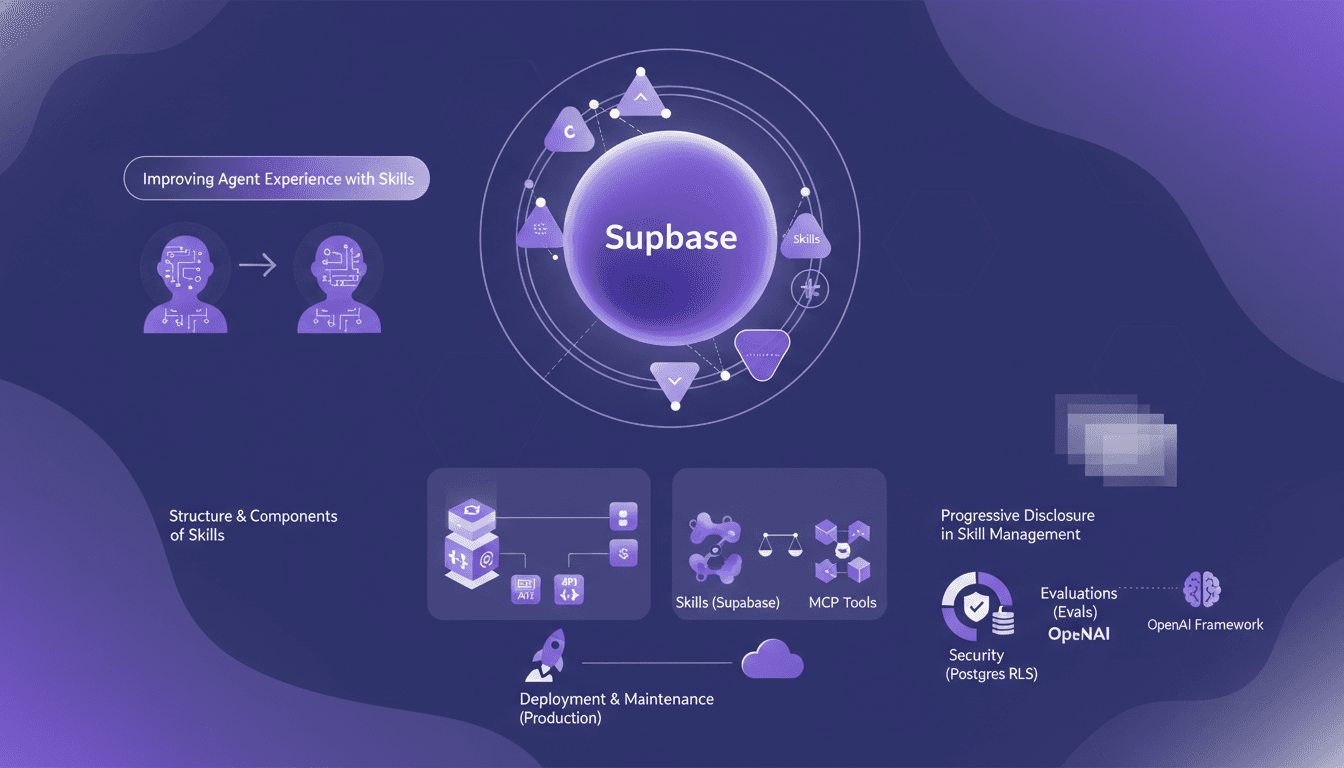

Améliorer les agents avec Supabase : notre méthode

J'ai passé deux mois les mains dans le cambouis de Supabase, à peaufiner les compétences de nos agents IA. Je vous emmène dans les coulisses de notre processus pour non seulement les rendre bons, mais réellement efficaces. Dans cet article, je partage notre approche pour améliorer l'expérience des agents avec Supabase, en examinant la structure et les composants des compétences, et en comparant celles-ci aux outils MCP. On a utilisé des évaluations pour tester le comportement des agents, sans oublier le rôle crucial du cadre d'OpenAI. RLS sur Postgres, déploiement en production — chaque étape avait ses défis. Je vous explique comment j'ai orchestré tout cela, et surtout, ce que j'aurais aimé savoir plus tôt.

Boucles Ralph : IA Simples et Efficaces

Je me souviens encore de la première fois que j'ai construit une Boucle Ralph. C'était comme trouver la pièce manquante dans le puzzle du développement piloté par l'IA. On parle ici d'un vrai workflow, pas juste de la théorie. Au lieu d'une complexité inutile, ces boucles simplifient l'automatisation en utilisant des modèles d'IA comme GPT 5.8. Imaginez pouvoir orchestrer des tâches de manière fluide et efficace, tout en tenant compte des défis et des avantages de l'IA dans le développement logiciel. Dans cet article, je vous emmène dans le monde des Boucles Ralph, leur application pratique, et comment elles peuvent véritablement transformer votre manière de travailler. On va explorer ensemble les limites à garder en tête, les considérations de sécurité et d'éthique, et comment faire évoluer ces processus dans des environnements d'équipe. Et oui, l'avenir de l'IA dans l'automatisation des workflows complexes est déjà là. Alors, prêt à plonger?

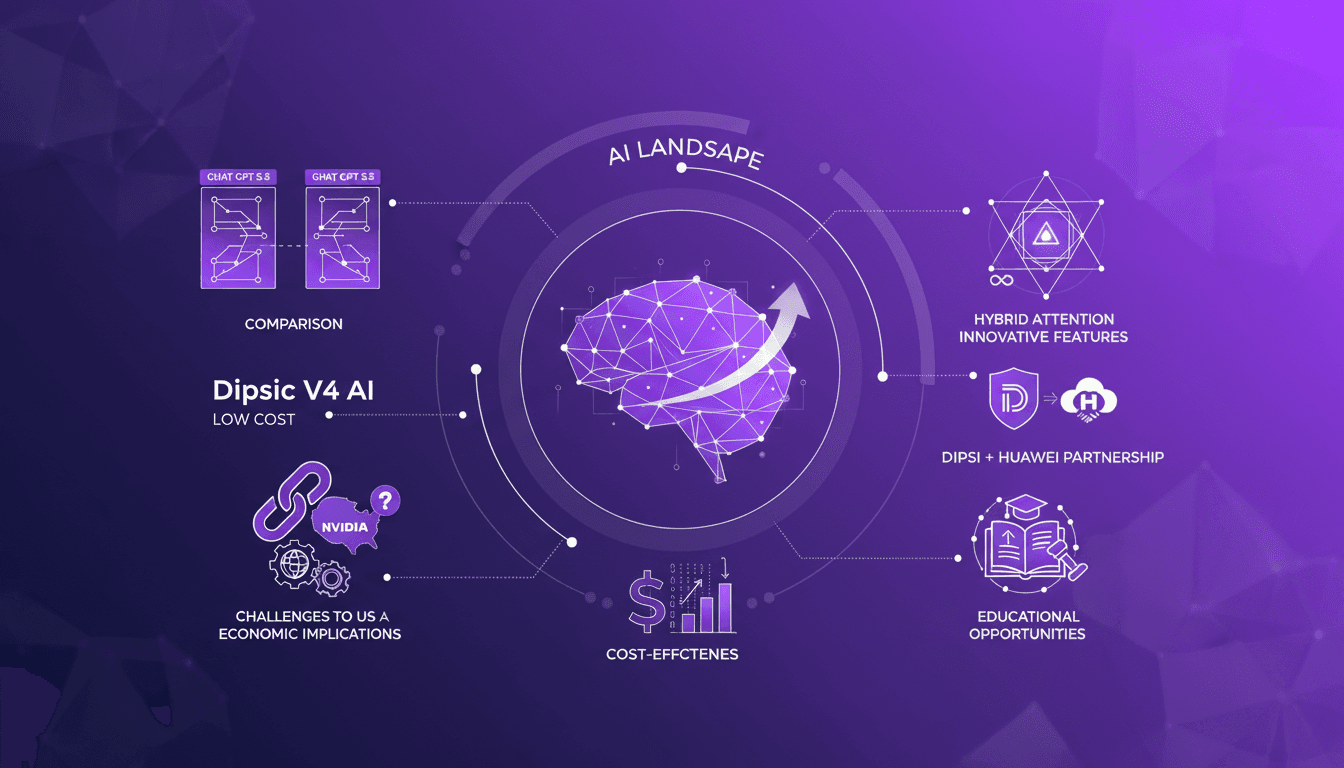

Dipsic V4 : Révolution IA, défis OpenAI

J'ai passé des années dans les tranchées de l'IA, à observer l'évolution des modèles. Mais quand j'ai mis la main sur le Dipsic V4, j'ai su qu'on tenait quelque chose de révolutionnaire. Avec ses 1600 milliards de paramètres, ce modèle n'est pas simplement un autre outil dans le paysage; c'est un potentiel perturbateur face aux géants comme GPT 5.5 d'OpenAI. Je vais vous montrer pourquoi ce modèle fait tant de vagues et comment il redéfinit les règles du jeu. On parlera de ses caractéristiques innovantes, de sa stratégie de prix agressive, et de ce que cela signifie pour des acteurs comme Nvidia et OpenAI. Attention, ça peut changer la donne.

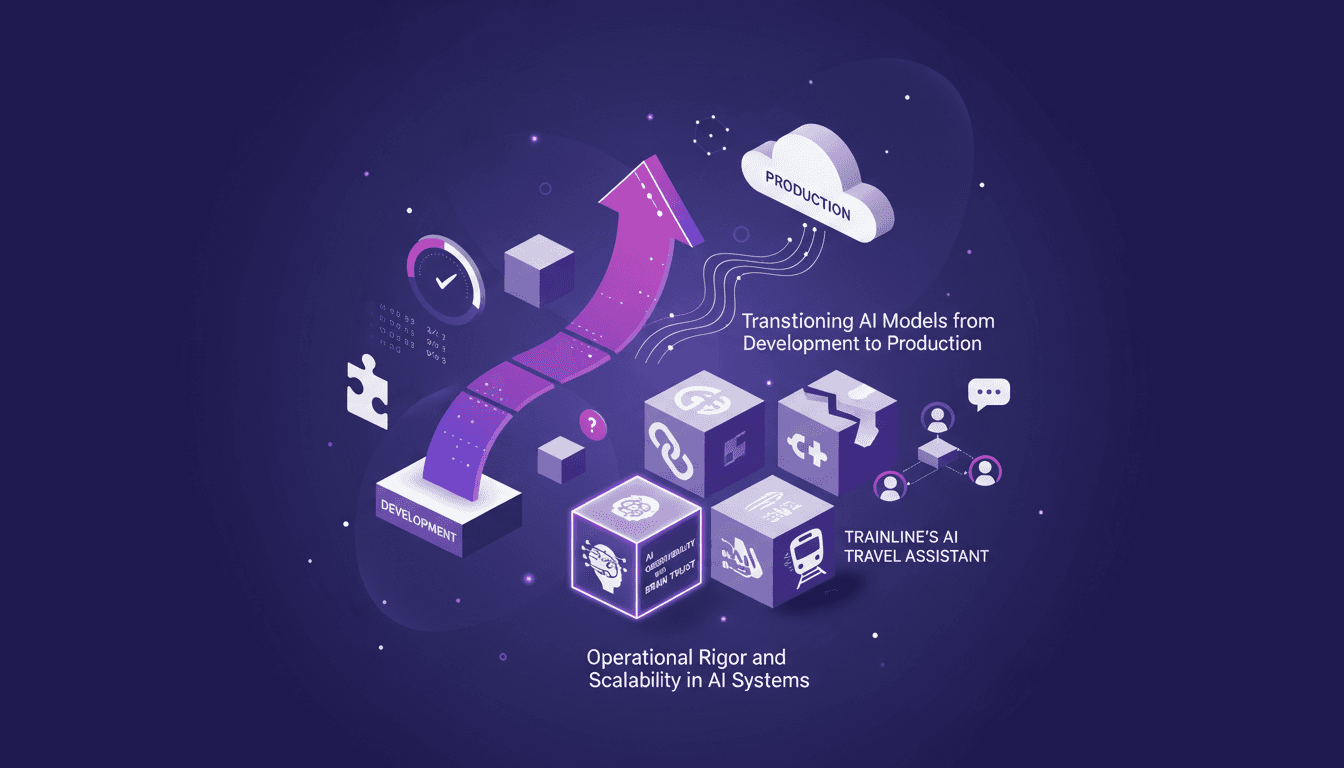

Livrer des Applications IA de Qualité: Guide Pratique

Je suis plongé dans le déploiement de l'IA depuis des années, et croyez-moi, livrer des applications IA de qualité n'est pas une sinécure. Entre faire passer les modèles en production et garantir une rigueur opérationnelle, j'ai affronté—et résolu—ma part de défis. Dans cet article, je vous emmène à travers mon parcours avec les systèmes d'IA, en me concentrant sur les flux de travail pratiques, les outils sur lesquels je compte, et les écueils que j'ai appris à éviter. On parlera de la rigueur opérationnelle et de l'évolutivité, du passage des modèles IA du développement à la production, et des systèmes multi-agents avec l'assistant de voyage IA de Trainline. C'est un guide pratique pour tous ceux qui veulent maîtriser l'art complexe de la livraison d'applications IA de qualité.