Poly AI dans Langmith : Améliorez vos Traces

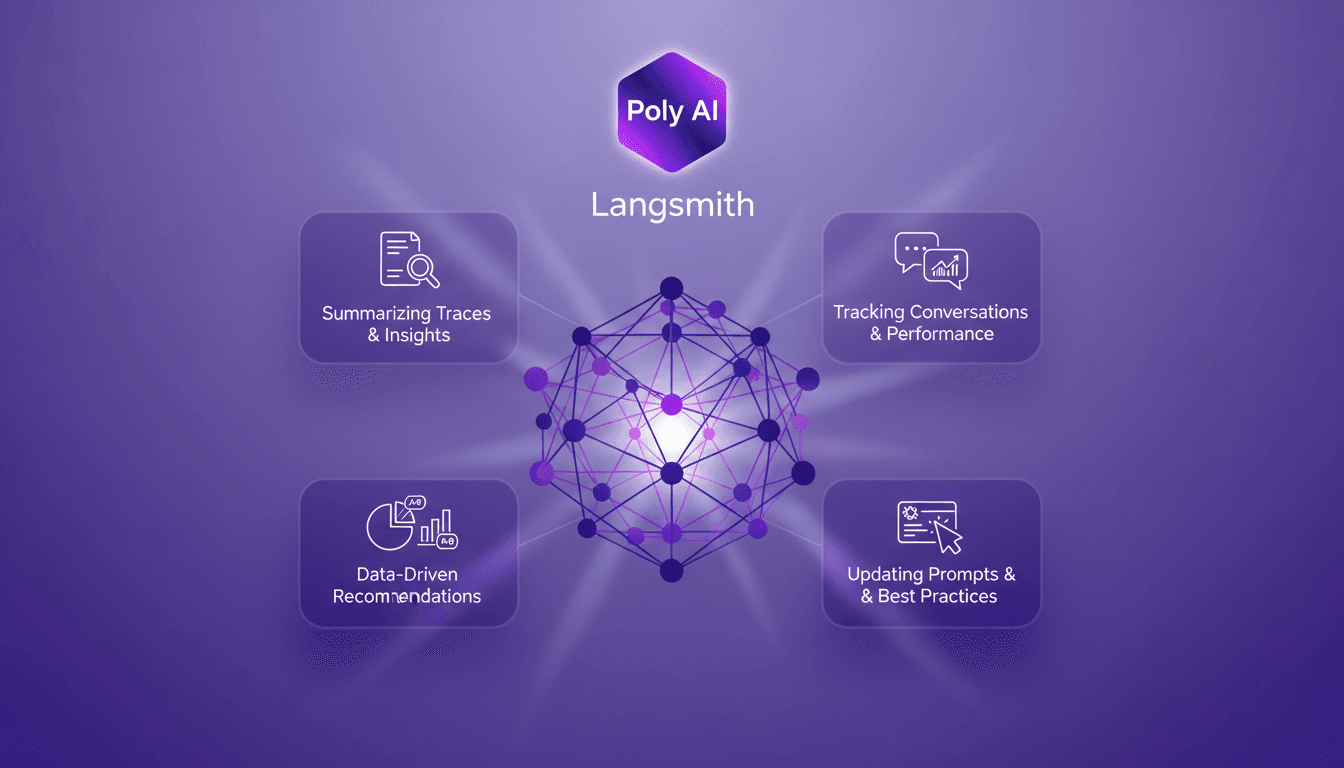

Je viens d'intégrer l'assistant Polly AI dans Langmith et, croyez-moi, c'est comme avoir un copilote survitaminé. Dès les premiers instants, j'ai vu comment il a transformé ma manière de suivre les conversations et de mettre à jour les prompts. Polly offre des outils pour résumer les traces, fournir des insights et faire des recommandations basées sur les données. C'est un vrai changeur de jeu pour optimiser la performance des agents et expérimenter de nouveaux prompts. Dans cet article, je vais vous montrer comment exploiter ces capacités pour booster votre workflow et améliorer vos performances.

Je viens d'intégrer l'assistant Polly AI dans Langmith et, honnêtement, c'est comme avoir un copilote survitaminé. Dès que j'ai plongé dedans, j'ai réalisé à quel point il a transformé ma façon de suivre les conversations et de mettre à jour les prompts. D'abord, Polly offre des outils pour résumer les traces et fournir des insights pertinents, mais attention, ça ne s'arrête pas là. Avec ses recommandations basées sur les données, il est devenu incontournable pour quiconque cherche à optimiser la performance des agents et à expérimenter de nouveaux prompts. La manière dont j'ai pu comparer les expériences et ajuster mes stratégies est un vrai atout. Si vous cherchez à booster votre workflow, suivez-moi : je vais vous montrer comment exploiter au mieux ces capacités. Mais attention, ne tombez pas dans le piège d'en faire trop, les limites existent, et parfois il faut savoir s'arrêter pour vraiment tirer parti des insights fournis.

Démarrage avec Poly AI dans Langmith

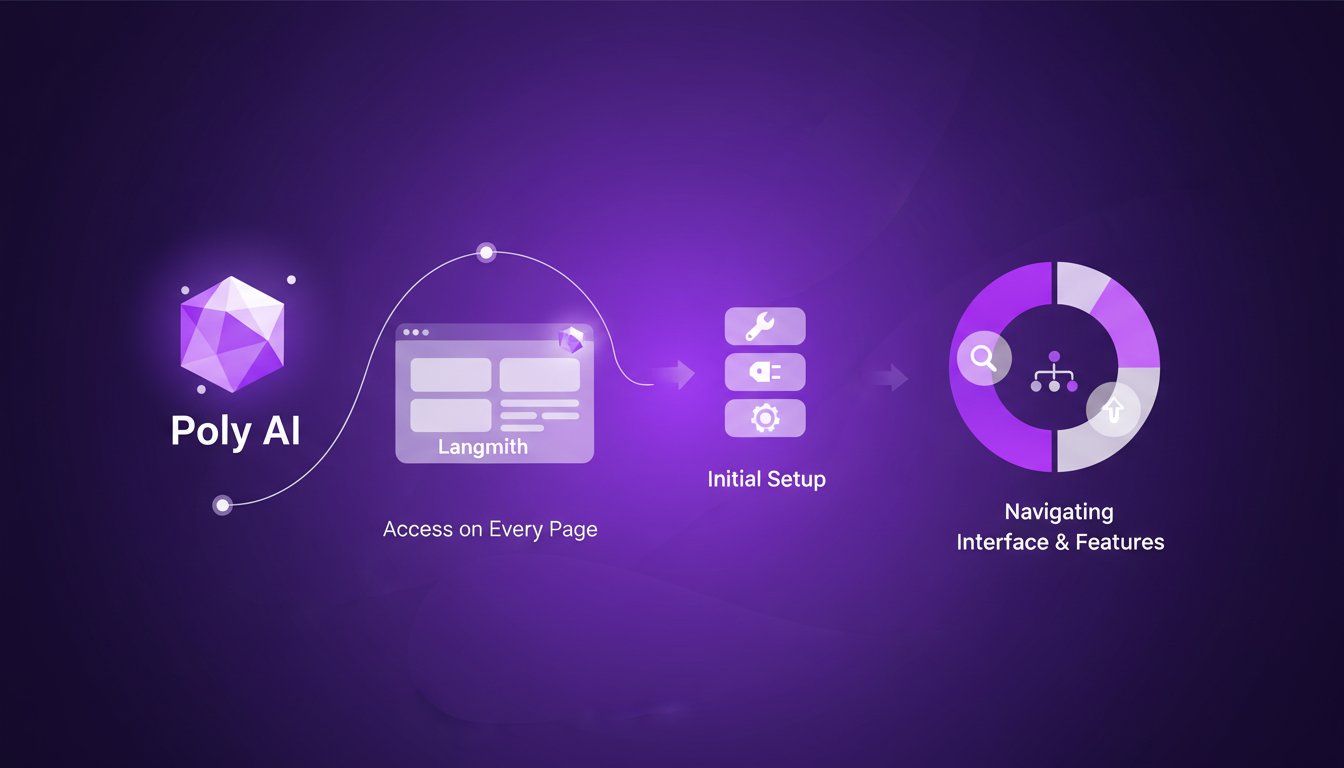

Quand j'ai commencé à utiliser Poly AI sur chaque page de Langmith, j'ai tout de suite vu le potentiel. Imaginez, un assistant IA qui vous suit partout, c'est comme avoir un co-pilote qui ne se perd jamais. La première étape pour intégrer Poly, c'est simple : on se connecte sur la plateforme, et c'est tout. Il n'y a pas de configurations complexes, pas de prises de tête. Une fois Poly activé, son interface est intuitive, avec des onglets clairs pour naviguer entre les fonctionnalités. En somme, l'installation est un jeu d'enfant.

Les premiers avantages sautent aux yeux : on gagne en efficacité immédiate. Plus besoin de jongler entre les pages et de perdre le fil. Poly est là, toujours prêt à aider. Mais attention, chaque outil a ses limites. Poly ne remplace pas le jugement humain, et dans des scénarios très complexes, il se peut qu'on doive encore mettre la main à la pâte.

Résumé des traces et insights

Poly brille vraiment quand il s'agit de résumer des traces de conversation. Au lieu de passer des heures à fouiller des données, Poly fait le tri et nous offre des insights pertinents en quelques secondes. Vous vous demandez comment améliorer votre agent ? Poly vous le dit, clair et net. Les insights sont accessibles directement depuis l'interface, et ils sont actionnables, ce qui change tout pour notre workflow.

Mais soyons réalistes : dans des situations très complexes, les résumés peuvent manquer de nuances. J'ai vu des cas où Poly simplifie un peu trop, donc il faut toujours garder un œil critique sur les résultats.

- Poly résume rapidement les traces.

- Les insights sont directement exploitables.

- Attention : ne pas se fier aveuglément aux résumés dans les scénarios complexes.

Suivi des conversations et performance des agents

Pour suivre les conversations, Poly offre une vue d'ensemble sur la performance des agents. Step-by-step, on commence par ouvrir une trace, puis on laisse Poly analyser. Les métriques de performance sont claires : temps de réponse, taux de succès des interactions, tout y est. Cela permet de voir où l'agent excelle et où il faut encore travailler.

Cependant, il faut savoir équilibrer les détails et la vue d'ensemble. Trop de détails peuvent noyer l'information utile. Je recommande de se concentrer sur les métriques qui comptent vraiment pour votre projet.

- Analyse étape par étape des conversations.

- Métriques de performance essentielles pour les agents.

- Trade-off : trouver un juste milieu entre détail et vue d'ensemble.

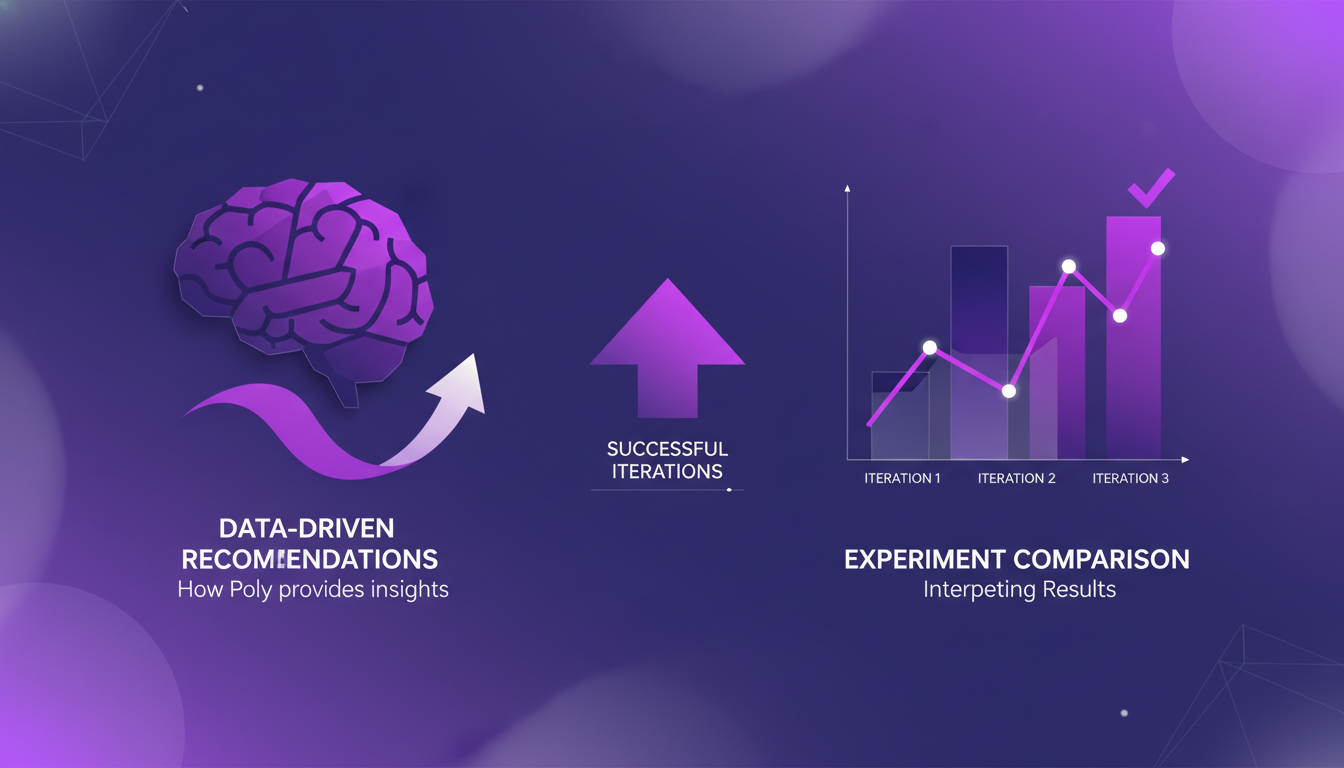

Recommandations basées sur les données et comparaisons d'expériences

Avec Poly, les recommandations basées sur les données sont à portée de clic. J'ai pu comparer différents tests d'agent et voir lequel fonctionnait le mieux, tout en me basant sur des résultats concrets. Par exemple, Poly m'a aidé à identifier des changements de modèle qui ont amélioré la performance de production.

Mais attention, les recommandations basées sur les données ne sont pas infaillibles. Il y a des moments où la perspicacité humaine est indispensable. Ne vous fiez pas uniquement à Poly pour toutes vos décisions stratégiques.

- Comparaison des expériences avec des résultats tangibles.

- Recommandations basées sur des données.

- Limite : ne pas remplacer le jugement humain.

Mise à jour des prompts avec les meilleures pratiques

Enfin, Poly est un allié précieux pour affiner et mettre à jour les prompts. En utilisant les insights de Poly, on peut les améliorer tout en respectant les meilleures pratiques. J'ai vu des cas où de simples modifications ont conduit à des résultats nettement meilleurs.

Par contre, il ne faut pas trop en faire. Garder les prompts simples et clairs est crucial. Trop de complexité peut embrouiller les agents et réduire leur efficacité. En somme, Poly est un outil puissant, mais à utiliser judicieusement.

- Optimisation des prompts basée sur les meilleures pratiques.

- Exemples concrets d'améliorations réussies.

- Attention : ne pas compliquer inutilement les prompts.

Intégrer Poly AI dans Langmith a vraiment été un booster de productivité pour moi. D'abord, je résume les traces, ce qui me permet de gagner du temps et de me concentrer sur l'essentiel. Puis, je suis les performances des agents, ce qui est un vrai game changer pour optimiser notre service client. Les recommandations basées sur les données m'ont permis de mettre à jour mes prompts de manière plus efficace, et je vois déjà la différence dans mon workflow.

- Poly est disponible sur chaque page de Langmith, ce qui simplifie l'accès à ces fonctionnalités.

- Les résumés et insights de Poly transforment la manière dont je gère mes projets.

- Suivre les conversations et comparer les expériences m'aide à tirer parti de chaque interaction.

Prêt à optimiser votre workflow avec Poly AI ? Installez-le dans Langmith aujourd'hui et constatez la différence par vous-même. Et pour une compréhension plus approfondie, regardez la vidéo complète ici : Lien YouTube. Vous verrez, c'est comme discuter avec un collègue qui a déjà tout testé.

Questions Fréquentes

Thibault Le Balier

Co-fondateur & CTO

Issu de l'écosystème startup tech, Thibault a développé une expertise en architecture de solutions IA qu'il met aujourd'hui au service de grands groupes (Atos, BNP Paribas, beta.gouv). Il intervient sur deux axes : la maîtrise des déploiements IA (LLM locaux, sécurisation MCP) et l'optimisation des coûts d'inférence (offloading, compression, gestion des tokens).

Articles liés

Découvrez d'autres articles sur des sujets similaires

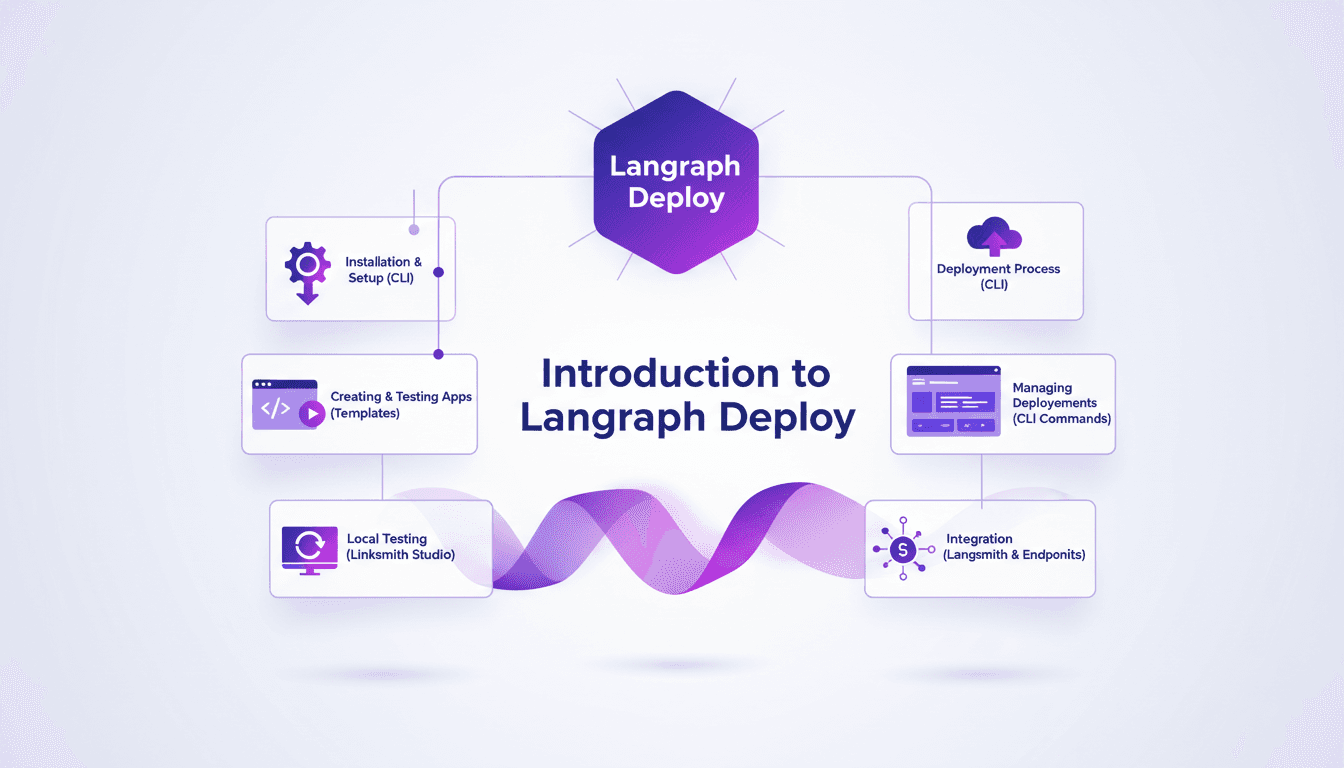

Déployer des Agents avec Langraph CLI: Guide Pratique

Déployer des agents ne devrait pas être un casse-tête. Avec Langraph CLI, j'ai réduit mon temps de déploiement à quelques minutes. D'abord, je configure l'installation du CLI avec une simple commande 'uv tool install langraph cli'. Ensuite, je teste mes applications localement avec Langsmith Studio, ce qui me permet d'itérer rapidement (c'est crucial pour éviter les mauvaises surprises en production). Puis, je crée une nouvelle application Langraph avec 'langraph new' et je suis prêt pour le déploiement. Je vous explique comment j'ai intégré Langsmith, géré mes déploiements et utilisé les endpoints disponibles, tout ça en quelques commandes depuis le terminal. Croyez-moi, une fois que vous aurez goûté à cette simplicité, vous ne reviendrez plus en arrière.

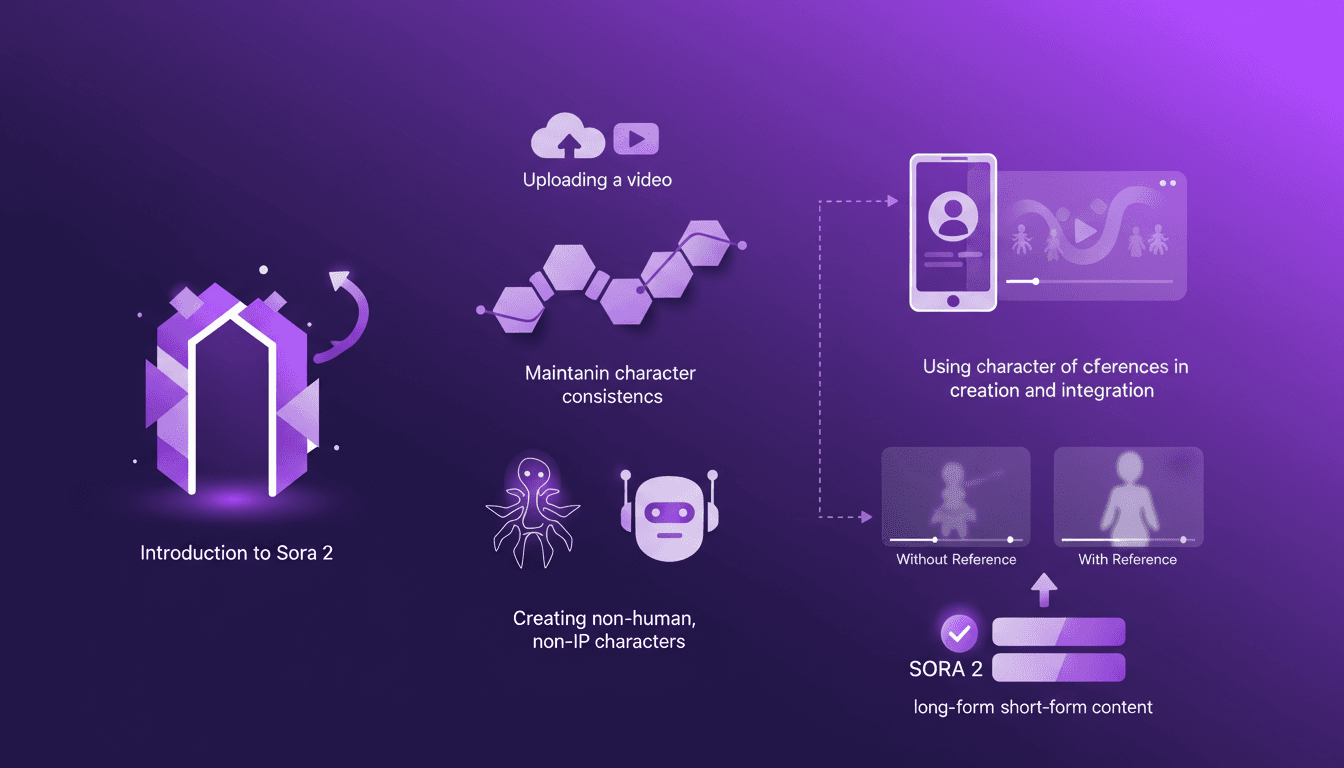

Créer des Personnages Cohérents avec Sora 2

J'ai plongé dans Sora 2 et, croyez-moi, la fonctionnalité de création de personnages est un vrai game changer pour quiconque prend la cohérence vidéo au sérieux. Vous savez à quel point c'est frustrant quand vos personnages générés par l'IA semblent différents à chaque scène ? Sora 2 s'attaque à ce problème de front. Dans cet article, je vous montre comment j'utilise Sora 2 pour maintenir la cohérence des personnages, même lorsque je crée des personnages non humains et non IP. On va parcourir le workflow, de l'importation de votre vidéo initiale à la sortie finale cohérente. Je vais démontrer la création et l'intégration de personnages, et comparer les vidéos avec et sans références de personnages. Sora 2 est un atout majeur pour le contenu long et court. Accrochez-vous, c'est du concret.

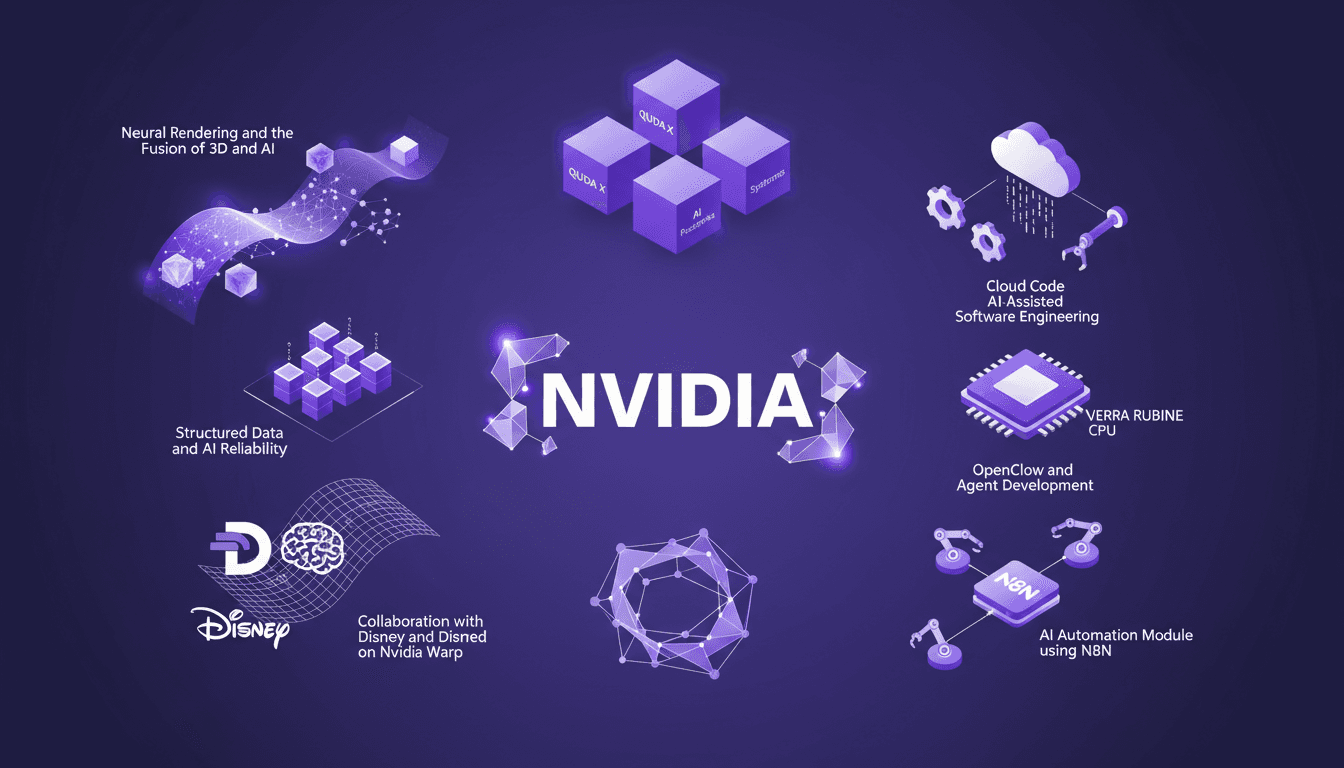

NVIDIA GTC 2026 : Révélation des Nouvelles Plateformes

Je suis allé à des dizaines de conférences, mais l'événement NVIDIA GTC 2026 a vraiment été un tournant. Ils ont dévoilé des plateformes qui vont redéfinir l'IA et l'informatique. Imaginez des CPUs qui transforment notre manière de coder, des rendus neuronaux qui fusionnent 3D et IA, et des collaborations avec Disney et Deep Mind sur Nvidia Warp. C'est immense, et l'impact pour nous, les constructeurs, est direct. On parle ici de QUDA X, de l'ingénierie logicielle assistée par l'IA, et même de refroidissement à 45° par de l'eau chaude. Il y a des années de travail devant nous mais aussi des opportunités incroyables. Plongeons ensemble dans ce qui a été révélé.

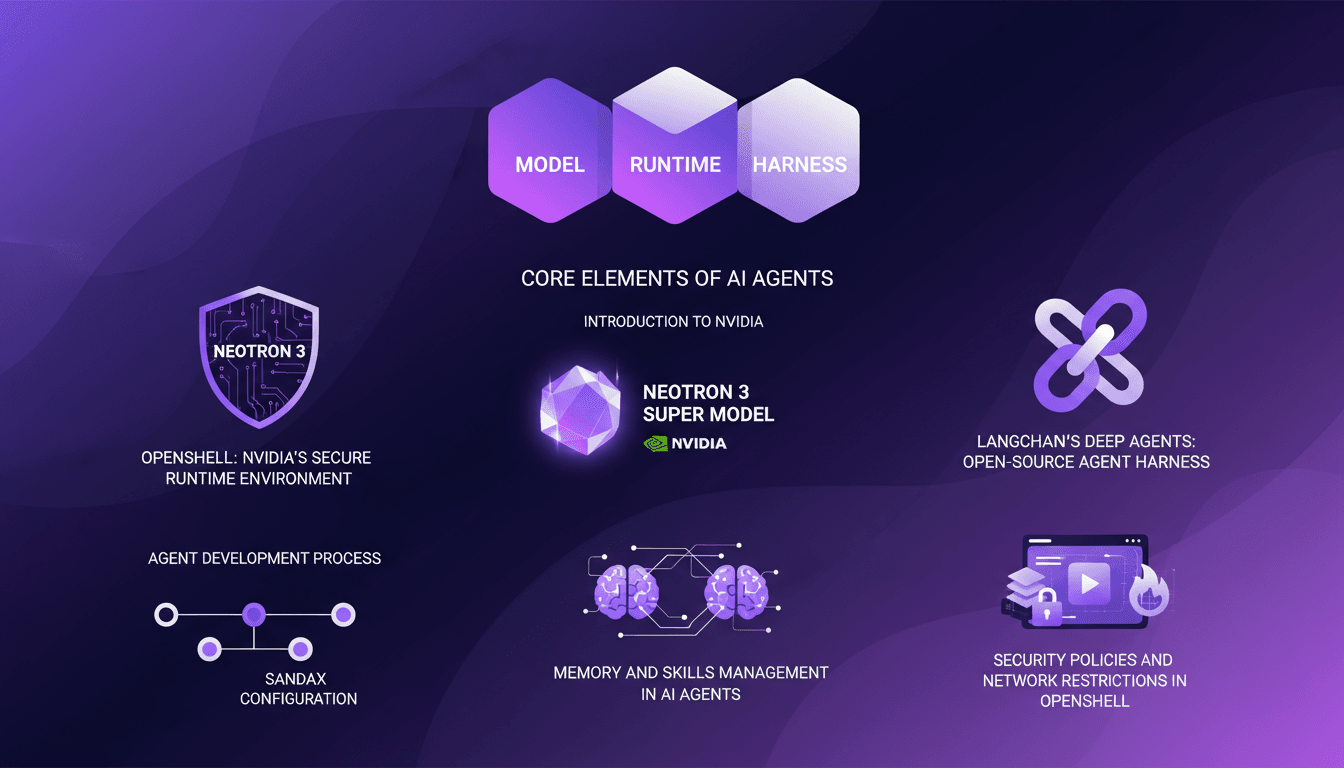

LangChain et Nvidia: Créez votre Agent IA

J'ai plongé tête première dans la construction d'agents IA avec LangChain et la dernière technologie de Nvidia, et c'était un vrai bouleversement. D'abord, j'ai connecté mon modèle Neotron 3, puis j'ai utilisé OpenShell pour sécuriser l'environnement d'exécution. LangChain's Deep Agents m'ont aidé à créer un harnais open-source, et je dois dire que jongler avec la mémoire et les compétences de l'agent était à la fois complexe et fascinant. Mais attention, les politiques de sécurité et les restrictions réseau dans OpenShell peuvent être piégeuses. Si vous cherchez à construire votre propre agent IA, je vous montre comment j'ai orchestré tout ça.

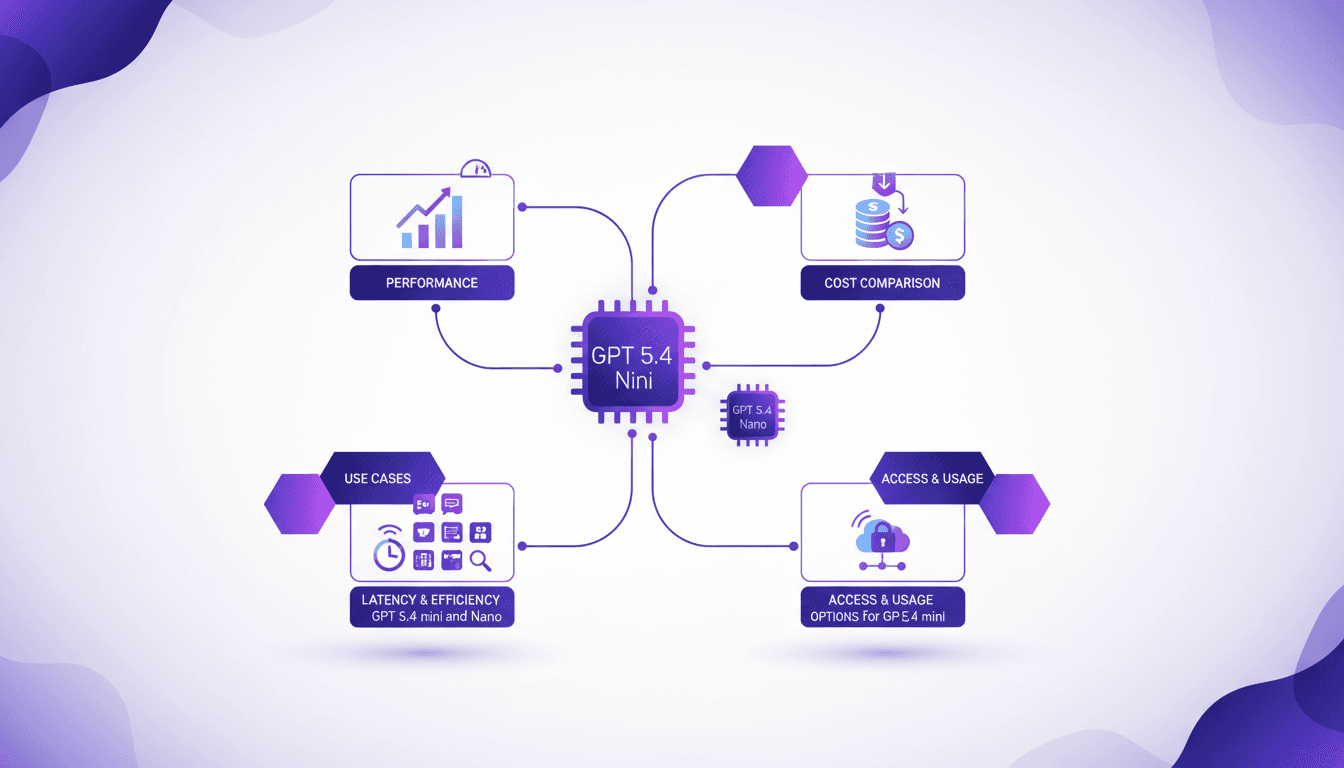

GPT 5.4 Mini : Performance et Coût Comparé

Je plonge tête baissée dans les modèles GPT 5.4 Mini et Nano, et ces versions sont de véritables game changers. Mais attention, il y a des compromis à gérer. Avec l'évolution rapide des modèles d'IA, la série GPT 5.4 propose des options intrigantes pour les développeurs cherchant à équilibrer performance et coût. D'abord, j'ai configuré le Mini pour voir comment il se compare. Ses scores de 54,4 % en performance montrent qu'il tient la route, surtout quand on pense au coût réduit. Ensuite, j'ai testé le Nano, qui affiche 52,5 %. Idéal pour les applications où chaque milliseconde compte. Mais attention aux latences. On verra comment ces modèles peuvent s'intégrer dans vos workflows et surtout, où ils se démarquent vraiment par rapport à la concurrence.