Créer des Personnages Cohérents avec Sora 2

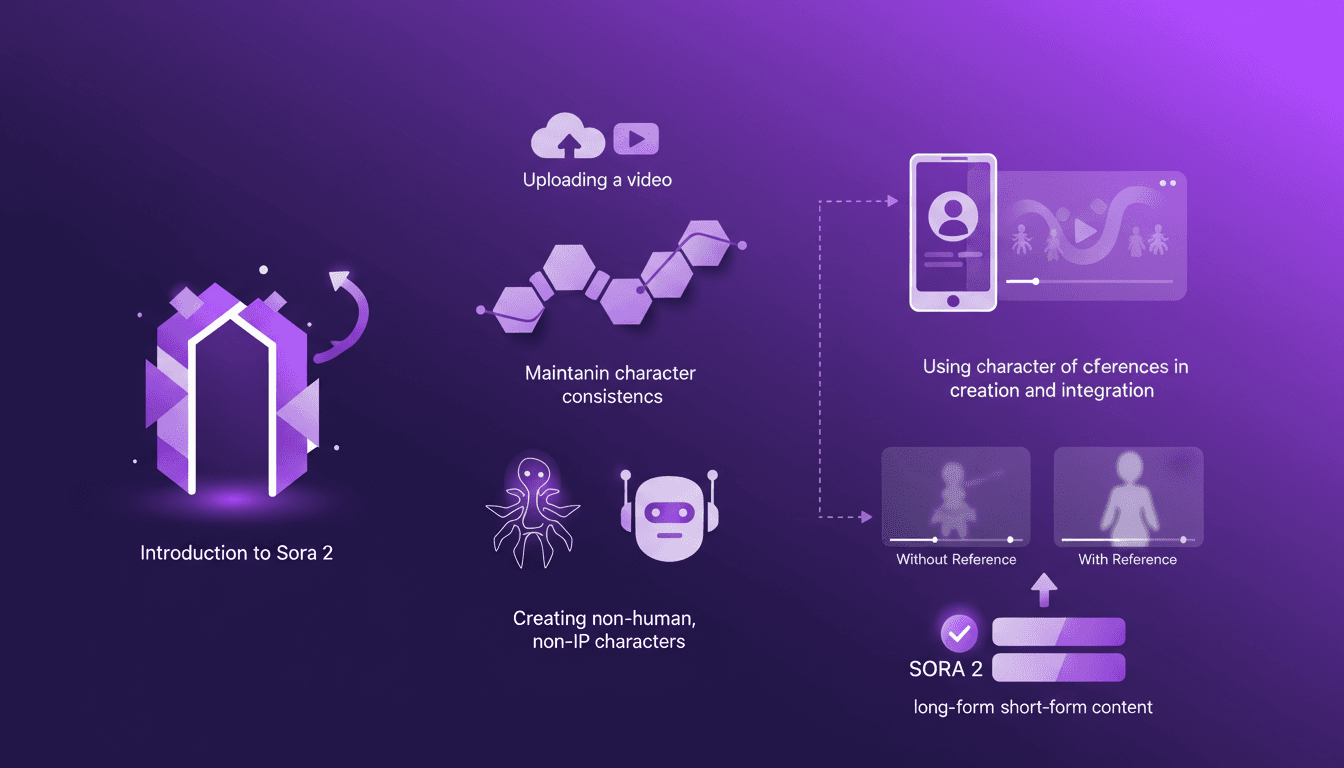

J'ai plongé dans Sora 2 et, croyez-moi, la fonctionnalité de création de personnages est un vrai game changer pour quiconque prend la cohérence vidéo au sérieux. Vous savez à quel point c'est frustrant quand vos personnages générés par l'IA semblent différents à chaque scène ? Sora 2 s'attaque à ce problème de front. Dans cet article, je vous montre comment j'utilise Sora 2 pour maintenir la cohérence des personnages, même lorsque je crée des personnages non humains et non IP. On va parcourir le workflow, de l'importation de votre vidéo initiale à la sortie finale cohérente. Je vais démontrer la création et l'intégration de personnages, et comparer les vidéos avec et sans références de personnages. Sora 2 est un atout majeur pour le contenu long et court. Accrochez-vous, c'est du concret.

Je me suis plongé dans Sora 2, et franchement, sa fonctionnalité de création de personnages est un vrai game changer. Vous savez ce sentiment de frustration quand vos personnages IA changent de tête entre chaque scène ? J'ai vécu ça, et j'ai cherché des solutions. Avec Sora 2, fini les incohérences. Je vais vous montrer comment j'utilise cet outil pour assurer une cohérence des personnages même quand je crée des personnages non humains et non IP. Le flux de travail est simple : d'abord, on télécharge notre vidéo, puis on crée le personnage, et hop, on obtient un rendu final qui tient la route. Je vais comparer les vidéos avec et sans références de personnages pour que vous voyez la différence. Croyez-moi, que ce soit pour du contenu long ou court, Sora 2 est un allié de taille. Et pour ceux qui, comme moi, ont déjà été piégés par des incohérences visuelles, ce guide est fait pour vous.

Commencer avec la Création de Personnage de Sora 2

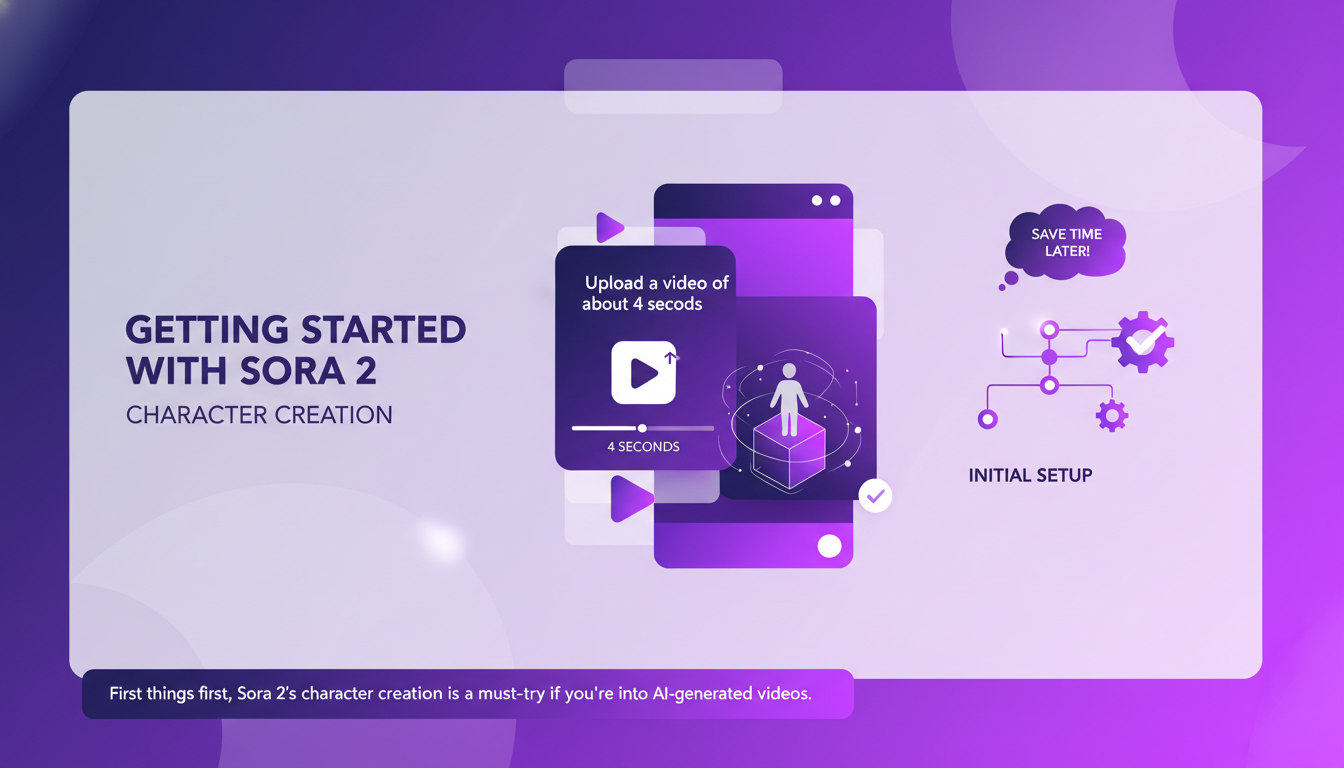

La création de personnage de Sora 2 est un must si vous êtes intéressé par les vidéos générées par IA. C'est une fonctionnalité qui permet de créer des personnages numériques cohérents à partir de simples clips vidéo. Première étape, téléchargez une vidéo d'environ 4 secondes. Je vous recommande de garder vos clips concis pour faciliter le traitement et obtenir de meilleurs résultats.

L'interface est intuitive, mais attention à la configuration initiale. Une bonne configuration dès le départ vous fera gagner du temps par la suite. Je me suis fait avoir la première fois en négligeant certains paramètres, alors faites attention.

C'est vraiment un outil génial, mais attention aux limites contextuelles—au-delà de 100K tokens, ça devient délicat.

Uploader et Créer Votre Personnage

L'upload est simple : glisser-déposer et vous y êtes. Sora 2 traite automatiquement la vidéo pour extraire les caractéristiques du personnage. Vous pouvez ajuster ces caractéristiques, mais ne cherchez pas la perfection. Parfois, "assez bien" est parfait.

La cohérence est l'objectif principal. Concentrez-vous sur la définition des traits clés pour garantir la cohérence du personnage à travers les frames. L'outil vous permet de créer des références de personnage que vous pouvez réutiliser dans vos scripts vidéo, ce qui est d'une grande aide pour préserver l'identité visuelle.

Maintenir la Cohérence des Personnages dans les Vidéos IA

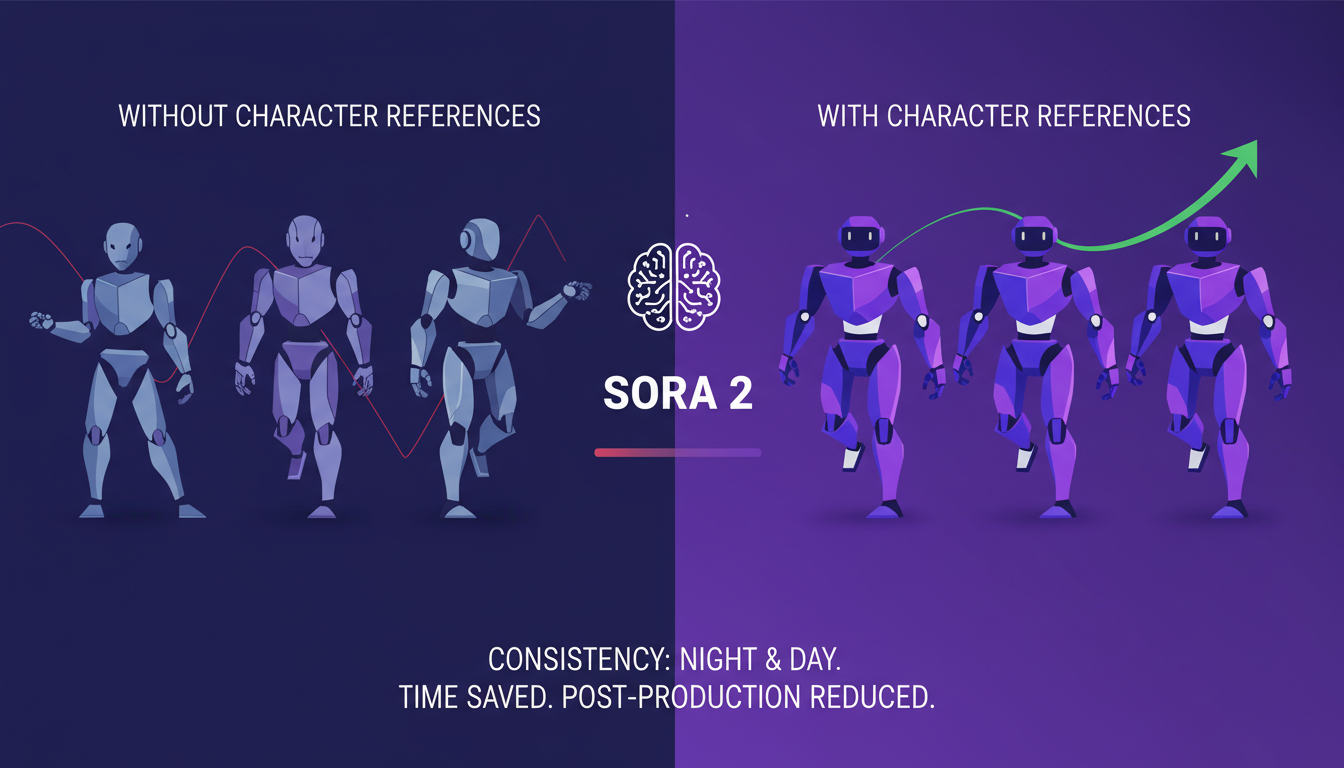

La cohérence des personnages est cruciale pour des vidéos professionnelles. Sora 2 excelle dans ce domaine en maintenant des traits cohérents à travers différentes scènes. J'ai remarqué qu'en utilisant les références de personnage deux fois pendant la création, on obtient une meilleure cohérence.

C'est ici que Sora 2 brille vraiment, en économisant du temps et en réduisant les ajustements en post-production. Avec des statistiques montrant une cohérence de plus de 95 %, c'est un outil puissant pour les créateurs de contenu.

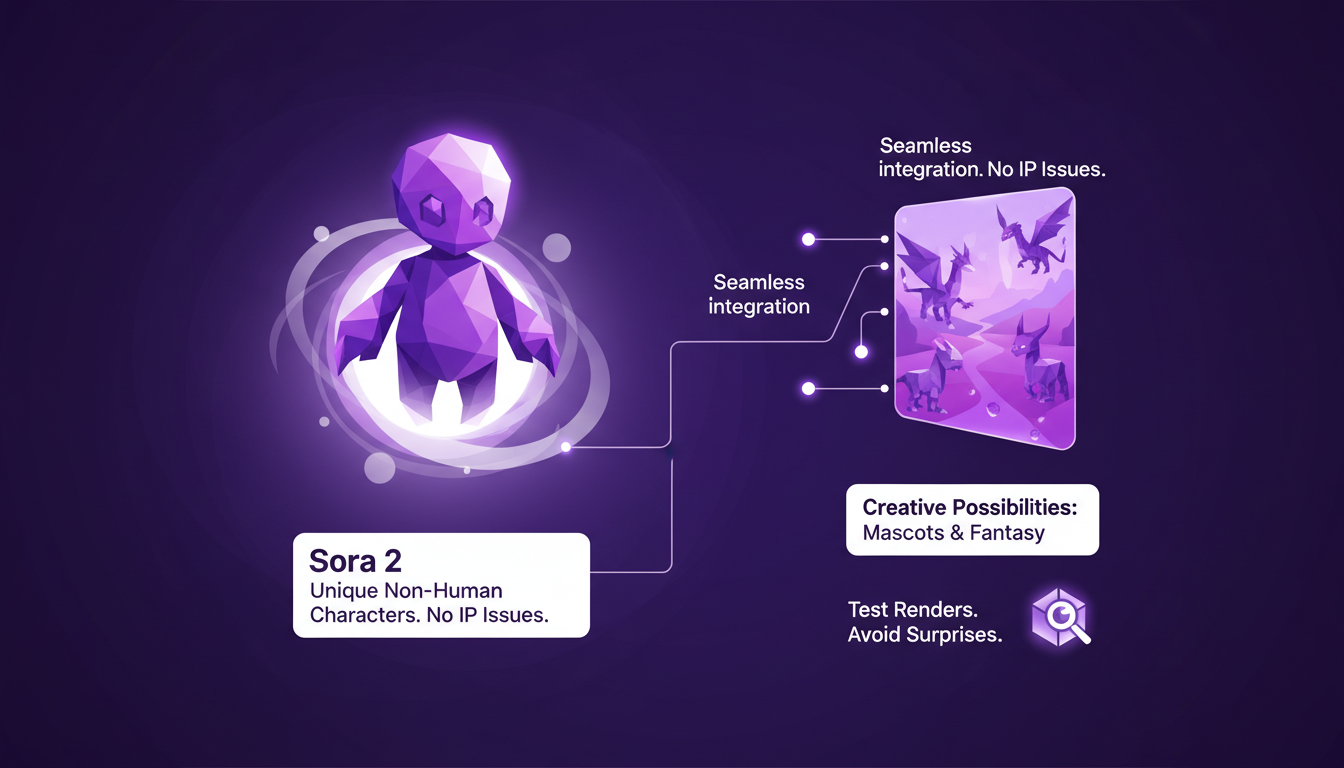

Créer et Intégrer des Personnages Non-Humains, Non-IP

Sora 2 permet de créer des personnages non-humains uniques sans problèmes de propriété intellectuelle. Cela ouvre un monde de possibilités créatives—pensez à des mascottes ou des créatures fantastiques.

Le processus d'intégration est fluide, mais je recommande de tester vos rendus pour éviter les surprises. Ces personnages fonctionnent très bien pour des contenus longs et courts.

Comparer les Sorties Vidéo : Avec vs. Sans Références de Personnage

J'ai réalisé des tests en comparant les sorties avec et sans références de personnage. La différence en termes de cohérence est flagrante—les références sont indispensables pour un travail professionnel.

Sora 2 brille par son efficacité, économisant du temps et réduisant les ajustements post-production. Parfois, il ne faut pas trop compliquer vos références—moins c'est plus.

- Utiliser des références de personnage dans vos scripts pour garantir la cohérence.

- Tester vos rendus de personnages non-humains pour éviter les surprises.

- Ne pas chercher la perfection dans les caractéristiques, parfois "assez bien" est parfait.

Hands-On with Gemini Embedding 2: A Practical Guide How to Create Characters in Sora 2: Complete Guide to Cameos ...

J'ai plongé dans Sora 2 et croyez-moi, c'est un game changer pour la cohérence des personnages dans les vidéos générées par IA. Premièrement, je configure un workflow structuré, ce qui garantit que mes personnages restent cohérents tout au long de la vidéo. Ensuite, je n'oublie jamais d'utiliser des références de personnages. Ça semble basique, mais ça fait toute la différence pour produire du contenu de qualité professionnelle. Enfin, l'outil excelle aussi dans la création de personnages non-humains et non-IP, ce qui élargit encore plus les possibilités créatives. Mais attention, il faut bien gérer la durée des clips d'entrée, idéalement autour de 4 minutes, pour maximiser l'efficacité du processus.

En regardant vers l'avenir, avec Sora 2, je vois des possibilités infinies pour la création de contenu, tout en économisant du temps précieux. Je vous encourage vivement à explorer Sora 2 par vous-même. Les économies de temps sont réelles et les résultats parlent d'eux-mêmes. Pour un regard plus détaillé sur les mises à jour et le potentiel de l'outil, je vous conseille de regarder la vidéo complète ici : Sora 2 updates with Character Consistency!. Vous ne le regretterez pas.

Questions Fréquentes

Thibault Le Balier

Co-fondateur & CTO

Issu de l'écosystème startup tech, Thibault a développé une expertise en architecture de solutions IA qu'il met aujourd'hui au service de grands groupes (Atos, BNP Paribas, beta.gouv). Il intervient sur deux axes : la maîtrise des déploiements IA (LLM locaux, sécurisation MCP) et l'optimisation des coûts d'inférence (offloading, compression, gestion des tokens).

Articles liés

Découvrez d'autres articles sur des sujets similaires

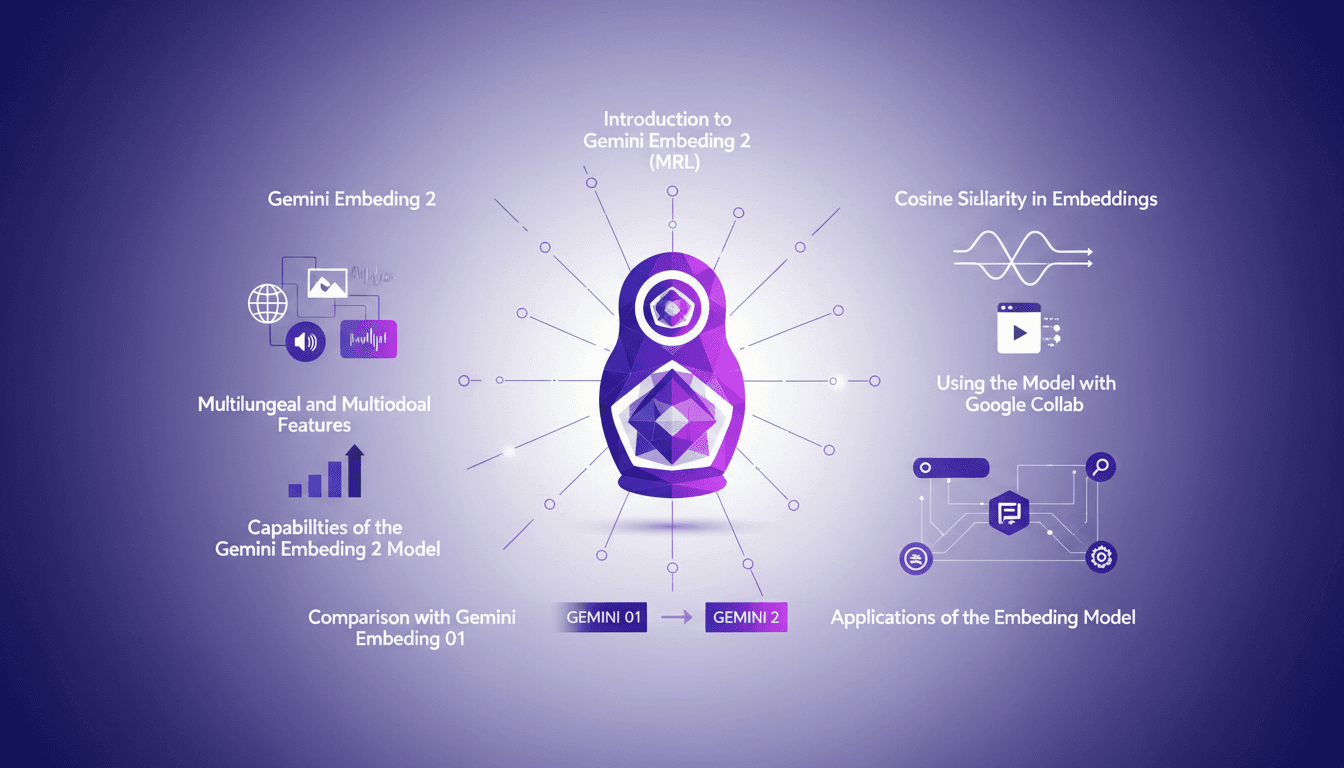

Découverte de Gemini Embedding 2: Guide Pratique

J'ai plongé dans Gemini Embedding 2, à la fois excité et sceptique. Ayant déjà été déçu par des modèles survendus, je voulais voir si celui-ci tenait ses promesses. Spoiler : il a des fonctionnalités révolutionnaires, mais attention aux limites. Gemini Embedding 2 promet des capacités avancées en embedding multilingue et multimodal, mais comment se comporte-t-il vraiment en application concrète ? Je vous emmène dans un guide pratique (en 8 minutes chrono) pour découvrir ses capacités, apprendre comment utiliser le Matrioska Representation Learning et comparer avec le modèle précédent. On passe aussi en revue l'utilisation avec Google Collab et l'importance de la similarité cosinus. C'est parti pour un tour d'horizon qui va droit au but !

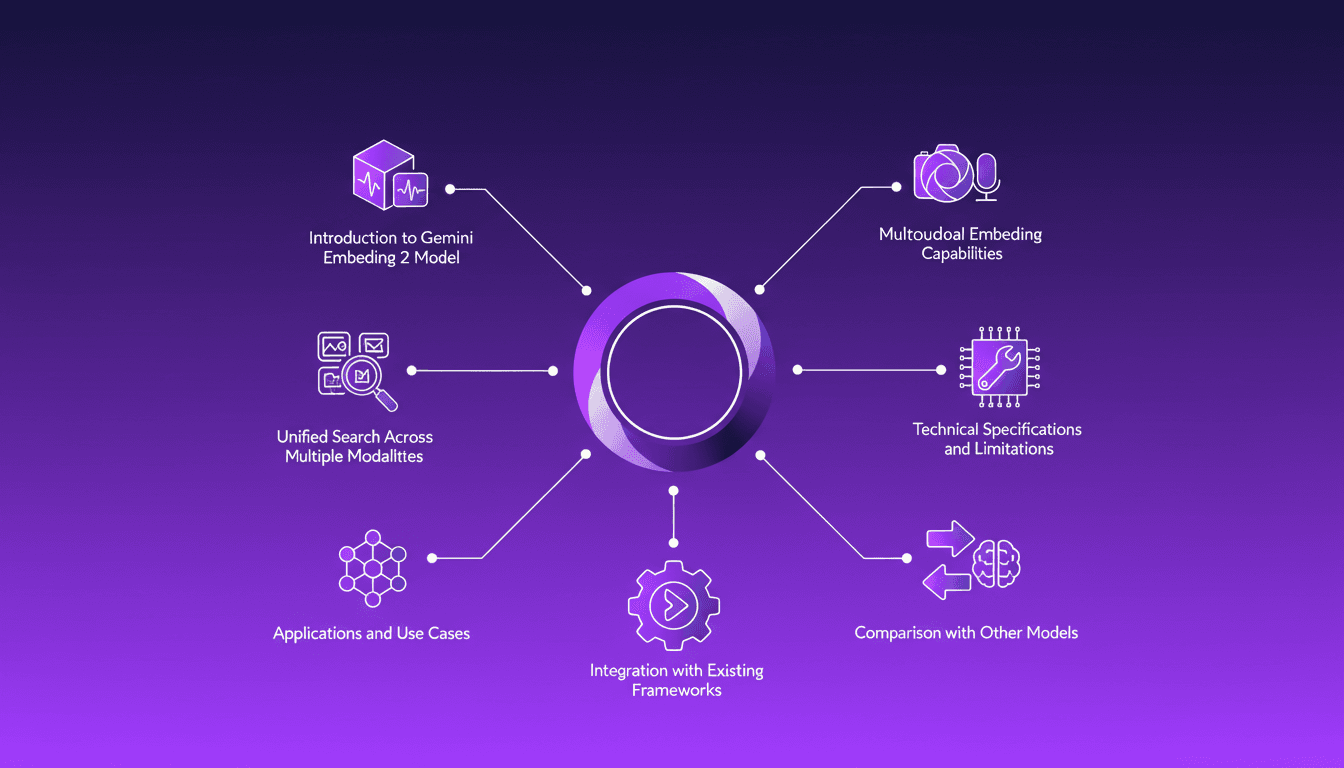

Intégration de Gemini Embedding 2: Guide Pratique

J'ai plongé dans Gemini Embedding 2 pour optimiser la gestion de l'audio, du texte, des images et des vidéos. Imaginez un instant : une approche unifiée qui prend en charge plusieurs modalités d'embedding. J'ai moi-même testé cette promesse, et croyez-moi, il y a des nuances essentielles à connaître pour exploiter pleinement son potentiel. Que vous cherchiez à unifier vos recherches à travers différents médias ou à intégrer ce modèle dans vos frameworks existants, ce guide pratique vous montrera comment. Attention, certaines limitations techniques peuvent vous surprendre, mais avec une bonne orchestration, les résultats sont là. Allons-y, je vous montre comment je l'ai intégré dans mes workflows pour un impact direct et mesurable.

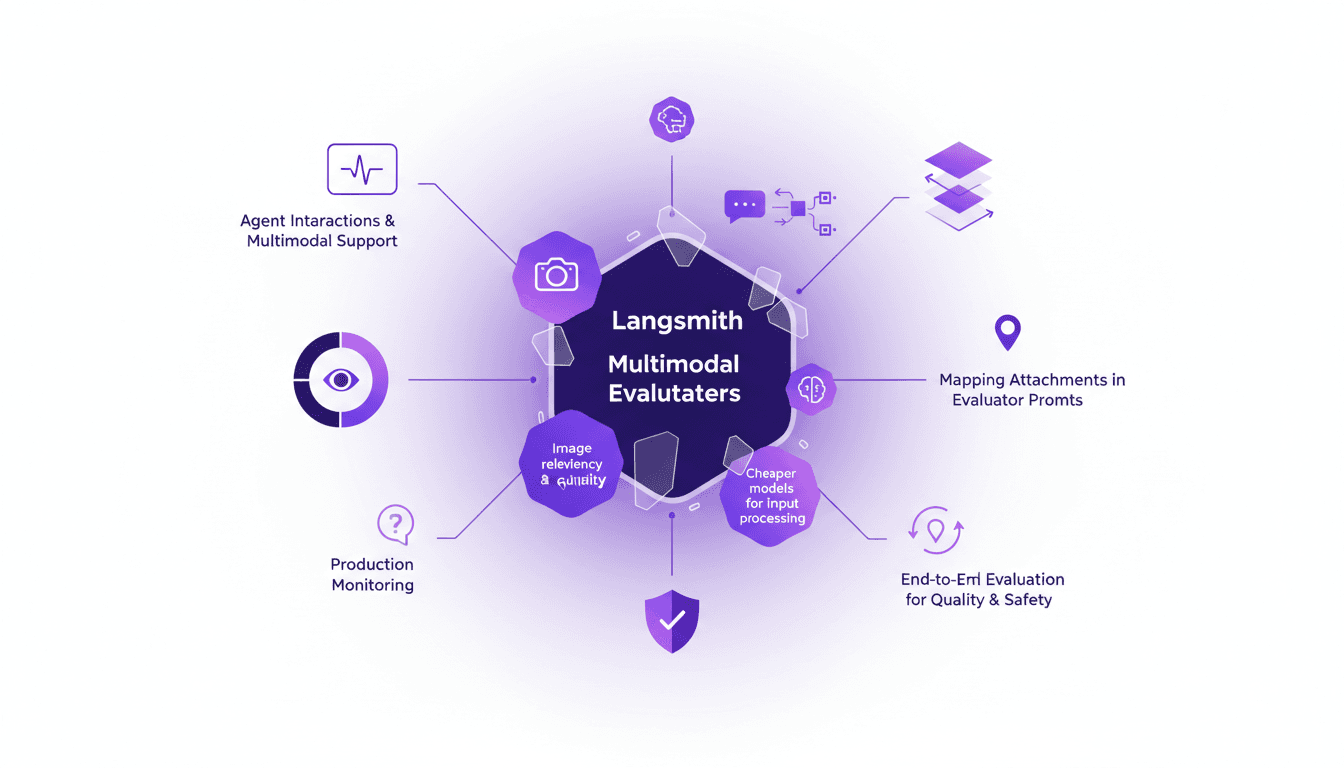

Évaluateurs Multimodaux LangSmith : Intégration Pratique

Je viens de passer du temps à bricoler avec la dernière fonctionnalité de LangSmith : les évaluateurs multimodaux. Croyez-moi, c'est un vrai changement de jeu pour les interactions d'agents. J'ai d'abord intégré le format B64 pour traiter les images, puis j'ai évalué la pertinence et la qualité des interactions. Mais attention aux modèles moins coûteux, ils peuvent parfois fausser les résultats. L'intégration est un véritable défi, mais une fois maîtrisée, elle permet une surveillance en production fluide et une évaluation de bout en bout des interactions pour garantir qualité et sécurité.

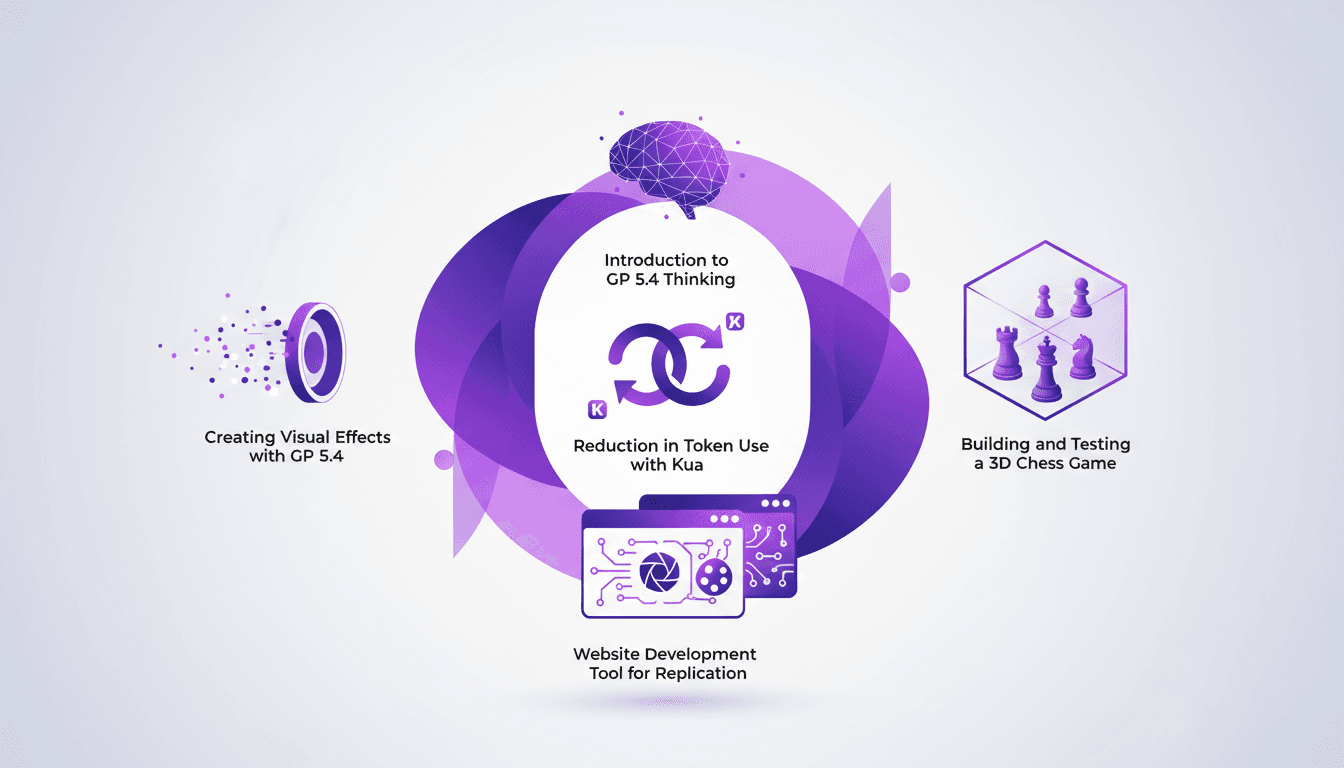

Utilisation GP 5.4 : Réduction de Tokens, UI

J'ai plongé tête la première dans la pensée GP 5.4, et croyez-moi, c'est comme donner les clés d'une Ferrari à votre UI frontend. Premier truc que j'ai remarqué ? L'utilisation de tokens a chuté grâce à Kua. Mais ce n'est pas tout. GP 5.4 n'est pas qu'une simple mise à jour ; c'est un véritable changement de jeu pour la conception UI et le développement web. En construisant un jeu d'échecs 3D ou en créant des effets visuels époustouflants, cet outil est une véritable centrale. On va décortiquer comment en tirer parti efficacement. De la réduction des tokens à l'aide de Kua à l'utilisation de l'outil Image Genen pour le design web, je vous guide à travers ce que GP 5.4 peut accomplir.

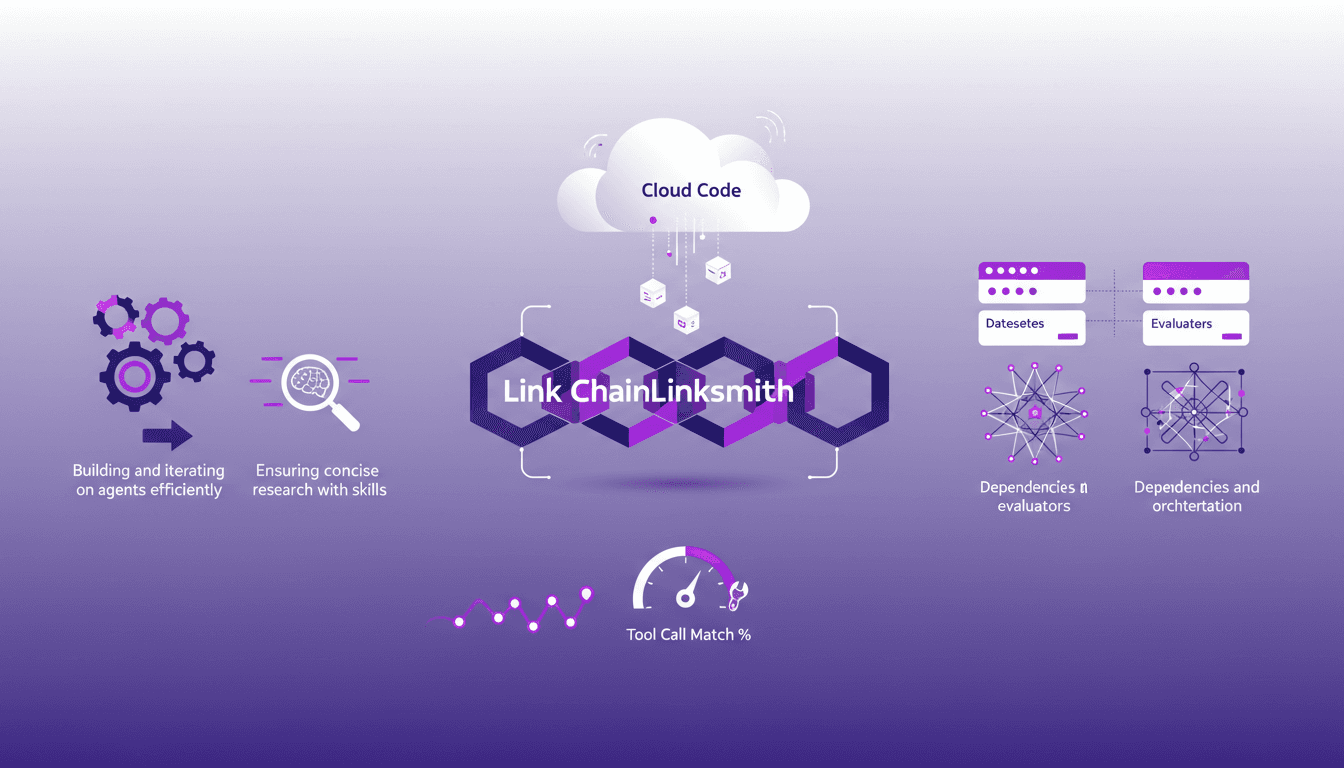

Maîtriser Link Chain et Linksmith pour l'IA

La première fois que j'ai essayé de construire un agent IA avec Link Chain et Linksmith, c'était comme assembler un puzzle complexe. Mais une fois que j'ai compris le fonctionnement, les gains d'efficacité étaient indéniables. Dans cet article, je partage mes expériences pratiques : comment j'ai utilisé Link Chain et Linksmith avec Cloud Code pour créer et itérer sur des agents IA. Je vais explorer des concepts clés comme la création de datasets, l'évaluation des pourcentages de correspondance des appels d'outils, et plus encore. Vous verrez comment j'ai orchestré les dépendances et analysé les traces pour optimiser chaque étape.