Découverte de Gemini Embedding 2: Guide Pratique

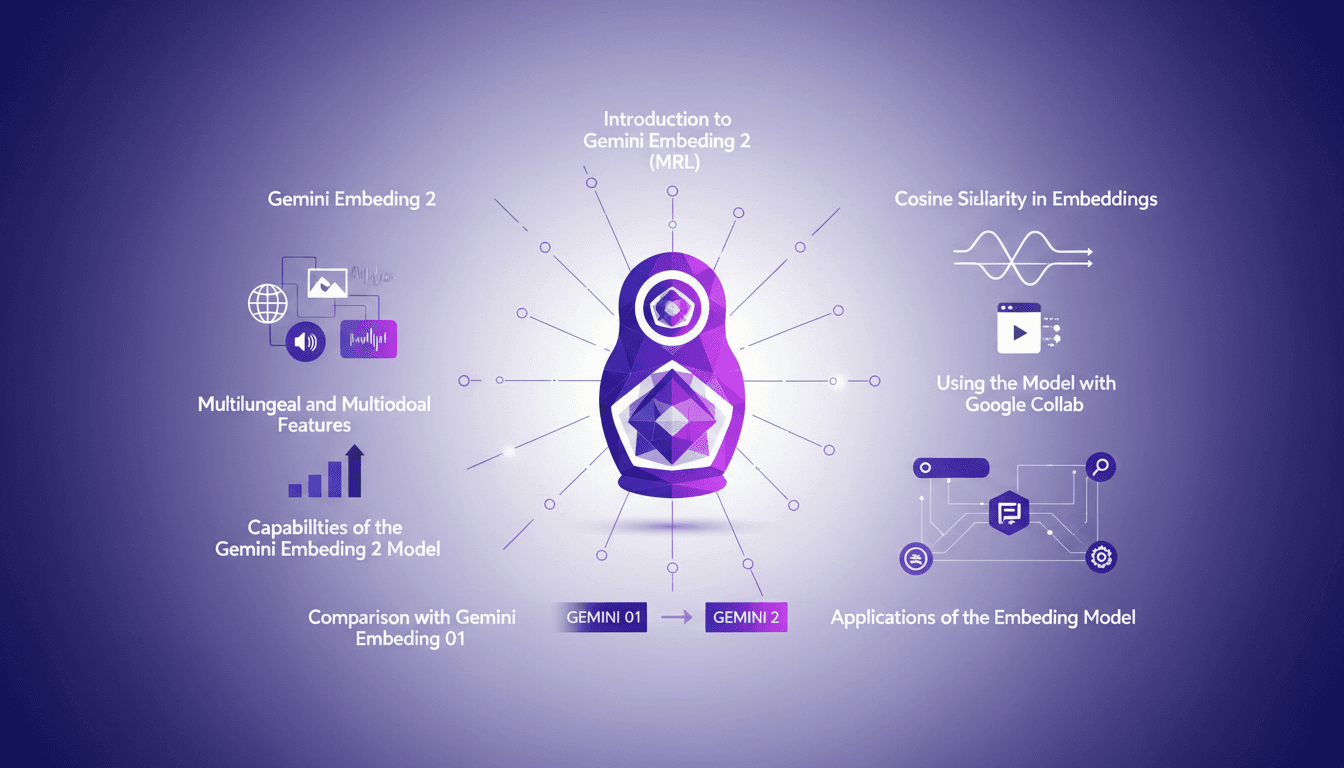

J'ai plongé dans Gemini Embedding 2, à la fois excité et sceptique. Ayant déjà été déçu par des modèles survendus, je voulais voir si celui-ci tenait ses promesses. Spoiler : il a des fonctionnalités révolutionnaires, mais attention aux limites. Gemini Embedding 2 promet des capacités avancées en embedding multilingue et multimodal, mais comment se comporte-t-il vraiment en application concrète ? Je vous emmène dans un guide pratique (en 8 minutes chrono) pour découvrir ses capacités, apprendre comment utiliser le Matrioska Representation Learning et comparer avec le modèle précédent. On passe aussi en revue l'utilisation avec Google Collab et l'importance de la similarité cosinus. C'est parti pour un tour d'horizon qui va droit au but !

J'ai plongé dans Gemini Embedding 2 avec un mélange d'excitation et de scepticisme (un sentiment familier si vous avez déjà été déçu par des modèles survendus). Je voulais voir si cette nouvelle version tenait ses promesses. Spoiler : oui, il y a des fonctionnalités qui changent la donne, mais il y a aussi des limites que vous devez connaître. Gemini Embedding 2 promet des prouesses en embedding multilingue et multimodal, mais qu'en est-il en pratique ? Alors, j'ai pris mes outils et je m'y suis mis. En à peine 8 minutes, je vous propose un guide pratique pour explorer ses capacités, maîtriser le Matrioska Representation Learning et comparer avec Gemini Embedding 01. On passe aussi par Google Collab pour voir comment l'intégrer dans vos workflows quotidiens et comprendre l'importance de la similarité cosinus. C'est parti, on plonge ensemble !

Commencer avec Gemini Embedding 2

Déjà, pour ceux qui veulent plonger dans l'univers de Gemini Embedding 2, la première étape incontournable est de se connecter à Google Collab. Croyez-moi, ça simplifie énormément la mise en route. Mais attention, ne vous faites pas avoir par la limite des 8 192 tokens lorsque vous entrez du texte. J'ai appris ça à mes dépens : ça m'est arrivé de me retrouver bloqué en plein milieu de l'intégration. En plus, le modèle utilise des embeddings doubles pour le texte et les images, ce qui est plutôt cool mais nécessite une bonne compréhension au départ.

Pour les PDF, n'oubliez pas qu'on est limité à 6 pages. C'est crucial si vous intégrez des documents directement. En ce qui concerne les vidéos, il faut rester sur des formats MP4 ou MOV de moins de 120 secondes. Sinon, vous risquez de perdre en performance ou de rencontrer des erreurs gênantes.

Capacités et Caractéristiques de Gemini Embedding 2

Explorons maintenant les fonctionnalités de Gemini Embedding 2. Ce modèle est vraiment un bijou pour ses capacités multilingues et multimodales. On parle de 3 722 dimensions de sortie par défaut—oui, vous avez bien lu—et ça a un impact direct sur les performances. Grâce à l'apprentissage par représentation Matrioska, ou MRL, on peut ajuster ces dimensions (372, 1 536, ou même 768) sans avoir besoin de différents modèles. Cela change la donne, mais comme toujours, il y a un compromis à faire entre performance et complexité.

La similarité cosinus est un atout majeur pour la recherche sémantique. Ça permet des recherches bien plus pertinentes dans vos bases de données. Mais attention, jongler entre performance et complexité peut devenir un véritable casse-tête.

Applications et Cas d'Utilisation Réels

Et là où Gemini Embedding 2 brille vraiment, c'est dans ses applications pratiques. La recherche sémantique, par exemple, peut transformer radicalement l'expérience utilisateur. Les embeddings multimodaux permettent des gains d'efficacité quand on les intègre dans des workflows existants. Par contre, soyez conscients des coûts associés. Certaines économies sont possibles, mais pas partout.

En pratique, le modèle permet de convertir des documents internes en espace d'embedding, ce qui est génial pour les systèmes de chatbots ou de questions-réponses automatisées. Mais attention aux limitations dans des scénarios réels, comme les contraintes de format ou de durée.

Comparaison avec Gemini Embedding 01

Alors, qu'est-ce qui a vraiment changé par rapport à Gemini Embedding 01? Les améliorations sont claires, notamment dans les capacités multilingues. Les benchmarks montrent que Gemini 2 surpasse le modèle précédent, surtout en termes de performance. Mais certains points faibles persistent.

Si vous envisagez de passer à Gemini 2, il faut peser le pour et le contre : le coût en vaut-il la peine pour votre cas d'utilisation spécifique?

Implémentation de Gemini Embedding 2 dans Google Collab

Enfin, pour ceux qui veulent mettre en place Gemini Embedding 2 dans Google Collab, voici un guide pas à pas. D'abord, importez les bonnes bibliothèques. Attention aux erreurs courantes comme des clés API mal configurées. Pour optimiser la performance, quelques astuces peuvent faire la différence, comme ajuster les dimensions de sortie pour équilibrer usage des ressources et qualité des résultats.

En conclusion, intégrer Gemini Embedding 2 dans votre workflow peut être un vrai atout, à condition de bien maîtriser les outils et de connaître les limites potentielles.

- Connectez Google Collab pour le setup initial.

- Considérez les limites de tokens et de pages pour les différentes entrées.

- Adaptez les dimensions de sortie pour un meilleur équilibre entre performance et coût.

- Testez la recherche sémantique pour améliorer l'expérience utilisateur.

- Surveillez les coûts pour ne pas dépasser votre budget.

Alors, avec Gemini Embedding 2, je me suis plongé dans du concret. D'abord, les capacités sont impressionnantes : deux embeddings pour chaque texte et image, ça change la donne ! Mais attention, il faut respecter les limites : six pages max pour les PDFs, et pas plus de 120 secondes pour les vidéos MP4 ou MOV. Ensuite, avec la représentation Matrioska (MRL), j'ai constaté un vrai potentiel pour enrichir nos projets, mais il faut tester, encore et toujours, pour maîtriser. J'ai appris que si on pousse trop fort, on se cogne contre les murs de la complexité.

Pour l'avenir, je vois Gemini Embedding 2 comme un vrai allié pour ceux qui savent naviguer dans ses eaux parfois turbulentes. Prêt à plonger plus en profondeur ? Lancez votre propre projet avec Gemini Embedding 2 sur Google Collab dès aujourd'hui pour voir l'impact de vos propres yeux. Et pour plus de détails, je vous recommande de regarder la vidéo originale 'Gemini Embedding 2 Hands-on in 8 mins!' sur YouTube. Croyez-moi, ça vaut le détour !

Questions Fréquentes

Thibault Le Balier

Co-fondateur & CTO

Issu de l'écosystème startup tech, Thibault a développé une expertise en architecture de solutions IA qu'il met aujourd'hui au service de grands groupes (Atos, BNP Paribas, beta.gouv). Il intervient sur deux axes : la maîtrise des déploiements IA (LLM locaux, sécurisation MCP) et l'optimisation des coûts d'inférence (offloading, compression, gestion des tokens).

Articles liés

Découvrez d'autres articles sur des sujets similaires

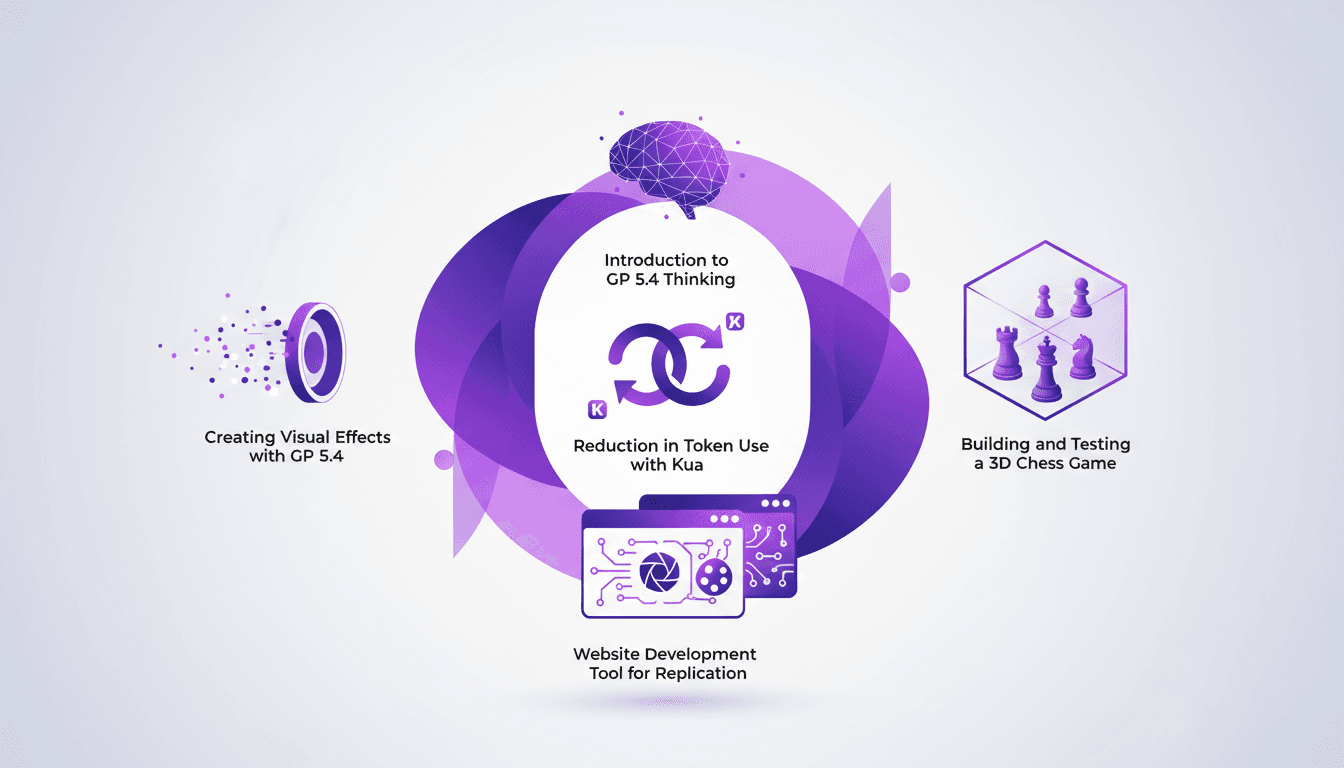

Utilisation GP 5.4 : Réduction de Tokens, UI

J'ai plongé tête la première dans la pensée GP 5.4, et croyez-moi, c'est comme donner les clés d'une Ferrari à votre UI frontend. Premier truc que j'ai remarqué ? L'utilisation de tokens a chuté grâce à Kua. Mais ce n'est pas tout. GP 5.4 n'est pas qu'une simple mise à jour ; c'est un véritable changement de jeu pour la conception UI et le développement web. En construisant un jeu d'échecs 3D ou en créant des effets visuels époustouflants, cet outil est une véritable centrale. On va décortiquer comment en tirer parti efficacement. De la réduction des tokens à l'aide de Kua à l'utilisation de l'outil Image Genen pour le design web, je vous guide à travers ce que GP 5.4 peut accomplir.

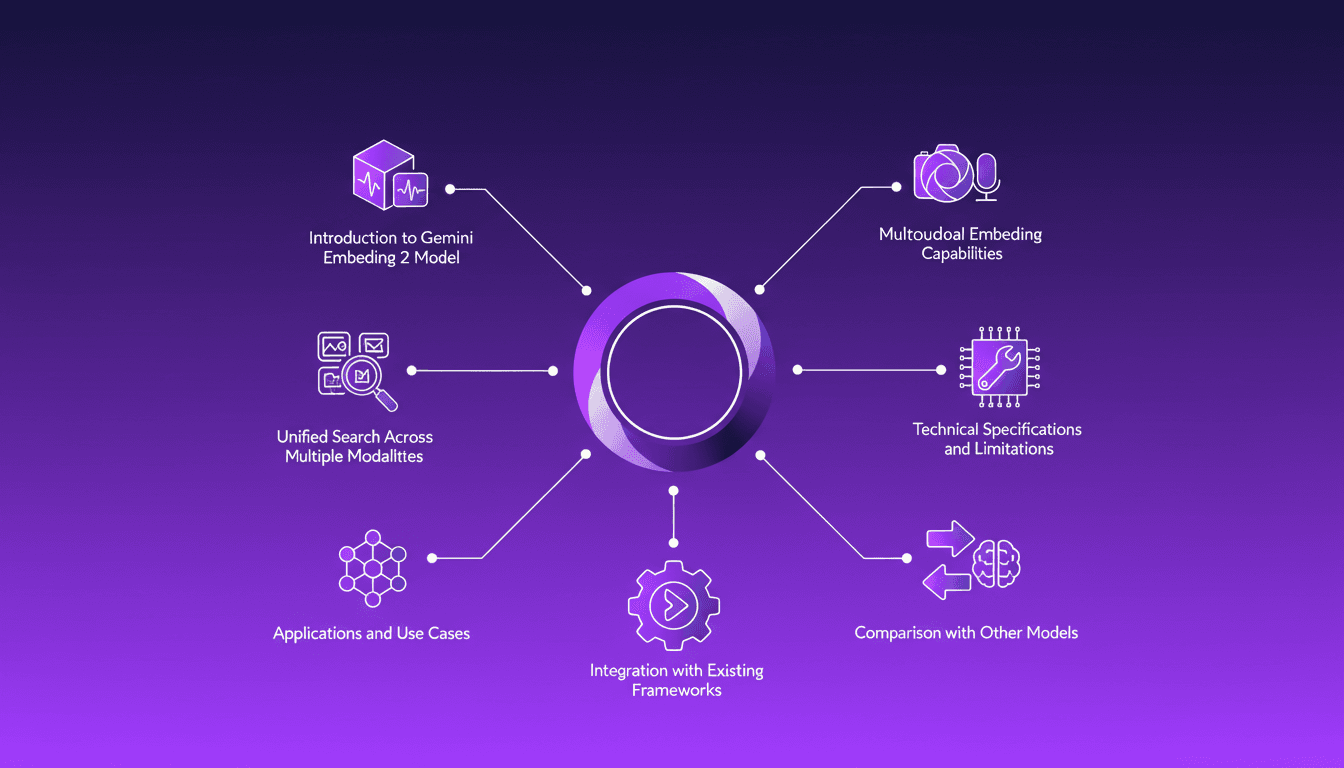

Intégration de Gemini Embedding 2: Guide Pratique

J'ai plongé dans Gemini Embedding 2 pour optimiser la gestion de l'audio, du texte, des images et des vidéos. Imaginez un instant : une approche unifiée qui prend en charge plusieurs modalités d'embedding. J'ai moi-même testé cette promesse, et croyez-moi, il y a des nuances essentielles à connaître pour exploiter pleinement son potentiel. Que vous cherchiez à unifier vos recherches à travers différents médias ou à intégrer ce modèle dans vos frameworks existants, ce guide pratique vous montrera comment. Attention, certaines limitations techniques peuvent vous surprendre, mais avec une bonne orchestration, les résultats sont là. Allons-y, je vous montre comment je l'ai intégré dans mes workflows pour un impact direct et mesurable.

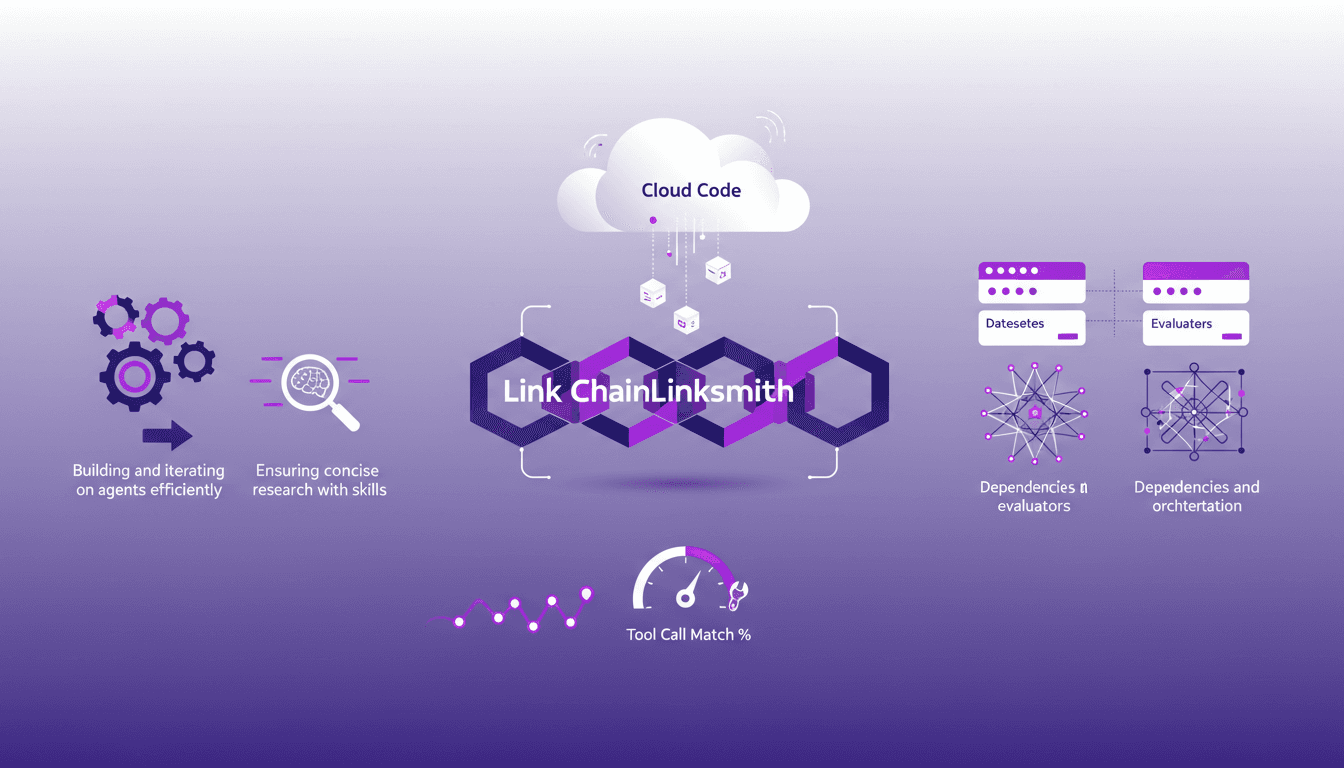

Maîtriser Link Chain et Linksmith pour l'IA

La première fois que j'ai essayé de construire un agent IA avec Link Chain et Linksmith, c'était comme assembler un puzzle complexe. Mais une fois que j'ai compris le fonctionnement, les gains d'efficacité étaient indéniables. Dans cet article, je partage mes expériences pratiques : comment j'ai utilisé Link Chain et Linksmith avec Cloud Code pour créer et itérer sur des agents IA. Je vais explorer des concepts clés comme la création de datasets, l'évaluation des pourcentages de correspondance des appels d'outils, et plus encore. Vous verrez comment j'ai orchestré les dépendances et analysé les traces pour optimiser chaque étape.

GPT-5.3: Optimiser les Résultats de Recherche Web

J'ai passé des années à peaufiner les résultats de recherche, mais depuis que j'ai intégré GPT-5.3, tout a changé. Avec les améliorations récentes, comprendre les requêtes utilisateurs est devenu plus nuancé. Dans cet article, je vous explique comment utiliser ces avancées pour améliorer les résultats de recherche web. On va explorer l'importance du sous-texte, les améliorations apportées par GPT-5.3, et comment cela rend les réponses plus naturelles et conversationnelles. Vous verrez des cas concrets comme la planification d'un voyage à vélo ou les changements de règles au baseball. C'est un outil puissant, mais attention aux limites contextuelles—au-delà de 100K tokens, ça se complique. Je partage comment j'ai orchestré ces éléments pour un impact direct sur l'expérience utilisateur.

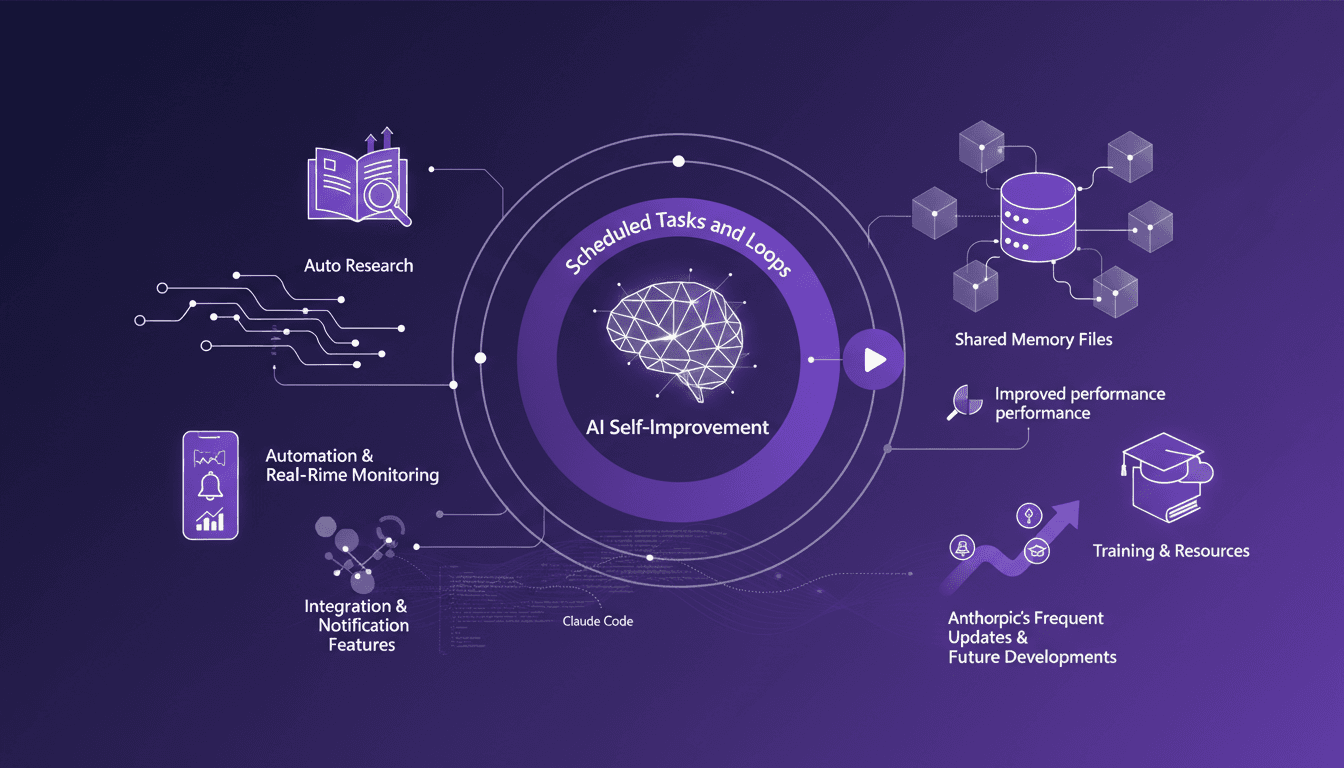

Automatisez Claude Code: Tâches Planifiées

J'ai passé des nuits à affiner Claude Code pour qu'il fonctionne pendant que je dors. Je connecte les tâches planifiées, orchestre les boucles, et optimise les performances pour que tout roule sans mon intervention. Claude Code, c'est un vrai game changer si vous le paramétrez correctement. Imaginez, vos reviews de code se font automatiquement à 6h du matin pendant que vous dormez encore. Attention, il faut éviter de se retrouver à fouiller dans les logs trois jours plus tard pour comprendre ce qui a planté. On va plonger dans l'auto-recherche, l'auto-amélioration, et comment Anthropic pousse les mises à jour. Je partage mes stratégies d'intégration, de notification, et de surveillance en temps réel avec Cloud Code. Si vous êtes prêt à libérer le potentiel de Claude Code, suivez-moi dans cette aventure technique.