Intégration de Gemini Embedding 2: Guide Pratique

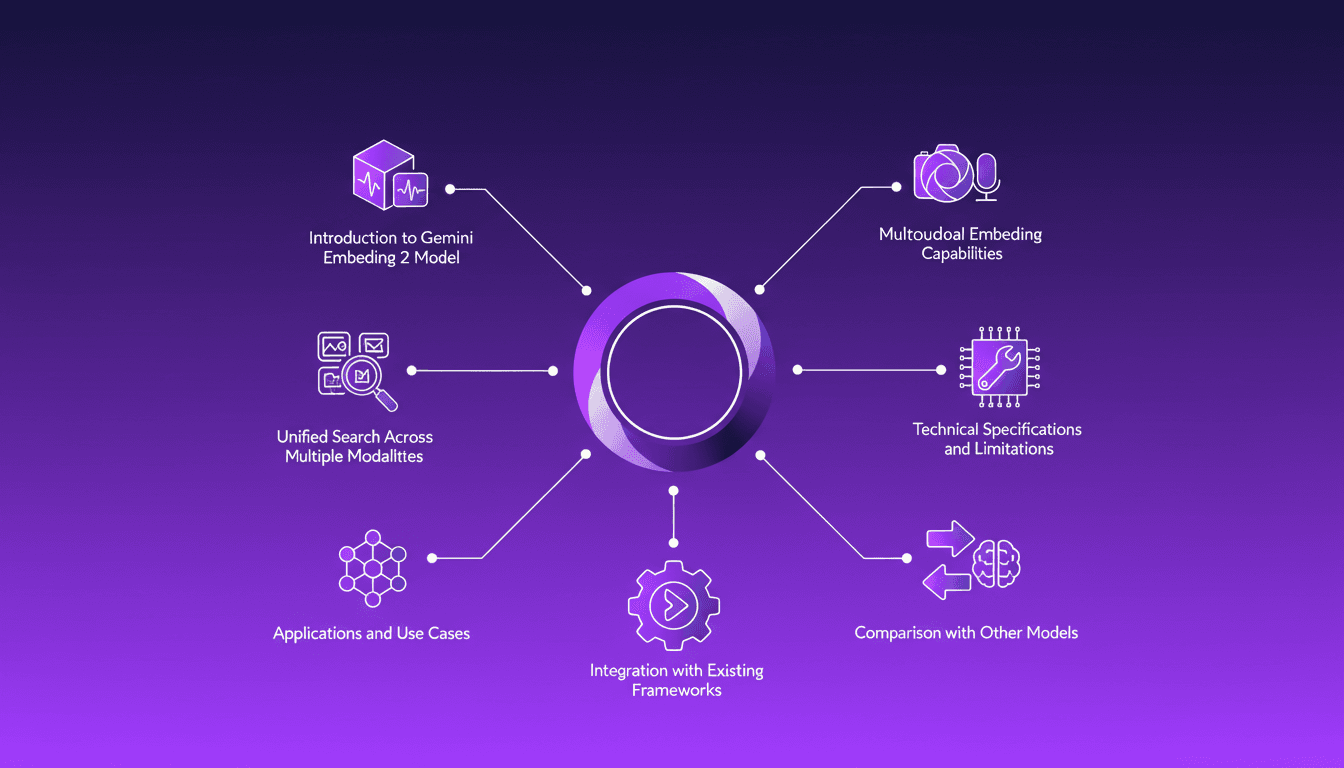

J'ai plongé dans Gemini Embedding 2 pour optimiser la gestion de l'audio, du texte, des images et des vidéos. Imaginez un instant : une approche unifiée qui prend en charge plusieurs modalités d'embedding. J'ai moi-même testé cette promesse, et croyez-moi, il y a des nuances essentielles à connaître pour exploiter pleinement son potentiel. Que vous cherchiez à unifier vos recherches à travers différents médias ou à intégrer ce modèle dans vos frameworks existants, ce guide pratique vous montrera comment. Attention, certaines limitations techniques peuvent vous surprendre, mais avec une bonne orchestration, les résultats sont là. Allons-y, je vous montre comment je l'ai intégré dans mes workflows pour un impact direct et mesurable.

Quand j'ai découvert Gemini Embedding 2, j'ai vu une opportunité pour transformer ma façon de gérer l'audio, le texte, les images et les vidéos. C'est un peu comme trouver la clé d'un coffre-fort rempli de trésors multimodaux. Imaginez : un seul modèle capable de gérer plusieurs types de données avec une fluidité remarquable. Mais attention, tout n'est pas aussi simple qu'il n'y paraît. D'abord, j'ai connecté mes différents contenus (audio, texte, images), puis j'ai exploré les capacités de recherche unifiées du modèle. Mais il y a des pièges techniques que vous devez connaître pour éviter de vous faire avoir. Certaines limitations sont là, et elles peuvent être un vrai casse-tête si vous ne les anticipez pas. Je vais vous montrer comment j'ai intégré Gemini Embedding 2 dans mes frameworks existants et les impacts concrets que cela a eus sur mon workflow. Croyez-moi, c'est un vrai changement de jeu, mais seulement si vous savez comment le piloter correctement.

Comprendre l'Intégration Multimodale avec Gemini

La première fois que j'ai découvert l'embedding multimodal de Gemini, j'ai été impressionné. Intégrer l'audio, le texte, les images et les vidéos dans un espace vectoriel unifié est une avancée majeure. Gemini Embedding 2 nous permet d'explorer les similarités sémantiques entre différents types de contenu, ce qui est révolutionnaire. La clé de cette technologie réside dans l'apprentissage de représentation Matrioska qui préserve le contexte à travers les modalités. Cependant, attention aux limitations de token, qui peuvent impacter la performance. Personnellement, j'ai trouvé la capacité du modèle à gérer divers types de données un vrai game changer, mais il faut surveiller l'utilisation des tokens.

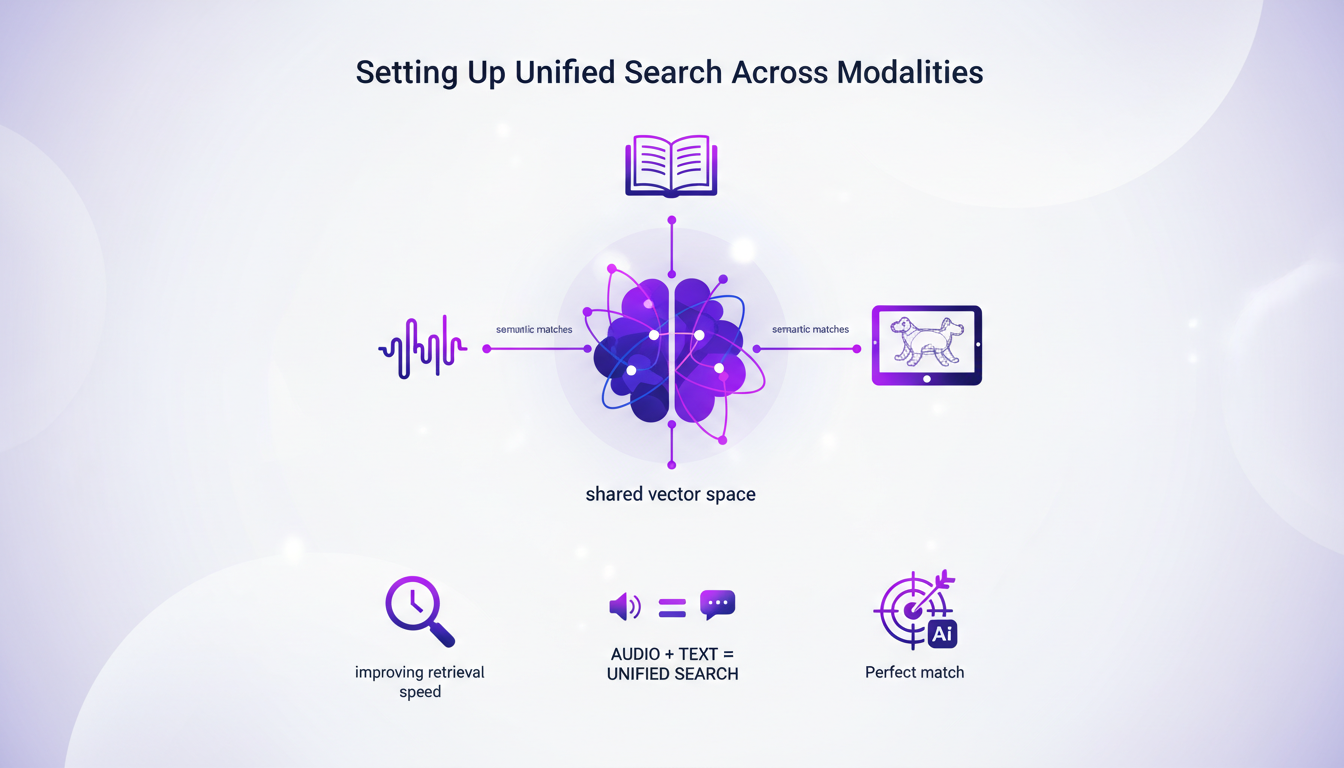

Configurer une Recherche Unifiée à Travers les Modalités

Mettre en place une recherche unifiée est vraiment puissant. Grâce à l'espace vectoriel partagé, j'ai configuré des recherches pour trouver des correspondances sémantiques entre l'audio et le texte, ce qui a nettement amélioré la vitesse de récupération des données. Le modèle a même obtenu un score parfait en associant des croquis similaires, démontrant sa précision. Cependant, le seuil de 3 000 dimensions est une limite à prendre en compte, car elle peut affecter l'efficacité de la recherche. La clé est de trouver un équilibre entre l'étendue et la profondeur de la recherche pour une performance optimale.

- Équilibrer l'étendue et la profondeur de la recherche

- Optimiser l'utilisation des dimensions

- Améliorer la précision des correspondances sémantiques

Spécifications Techniques et Leurs Implications

Avec plus de 3 000 dimensions pour les représentations complètes, Gemini Embedding 2 excelle dans la manipulation des données multimodales. Par exemple, il peut traiter jusqu'à six images simultanément pour leur intégration. Comprendre les cinq modèles et index différents est crucial pour des applications ciblées. J'ai rencontré cinq problèmes distincts qui nécessitaient des configurations de modèle adaptées. Les compromis entre la complexité du modèle et la vitesse de traitement sont inévitables.

- Manipuler jusqu'à six images pour l'intégration

- Utiliser cinq modèles et index pour des applications spécifiques

- Gérer les compromis entre complexité et vitesse

Applications, Cas d'Utilisation et Intégration

Les applications de Gemini vont de la recommandation de contenu aux systèmes de récupération intermodal. J'ai intégré Gemini avec des cadres existants pour améliorer les fonctionnalités sans réorganiser les systèmes. Les cas d'utilisation incluent l'amélioration de la gestion des actifs multimédias et l'optimisation des capacités de recherche. L'intégration nécessite une orchestration minutieuse pour maintenir l'efficacité du système. Il est essentiel de considérer le rapport coût-bénéfice de l'intégration en fonction des besoins spécifiques de l'entreprise.

- Recommandation de contenu

- Systèmes de récupération intermodal

- Amélioration de la gestion des actifs multimédias

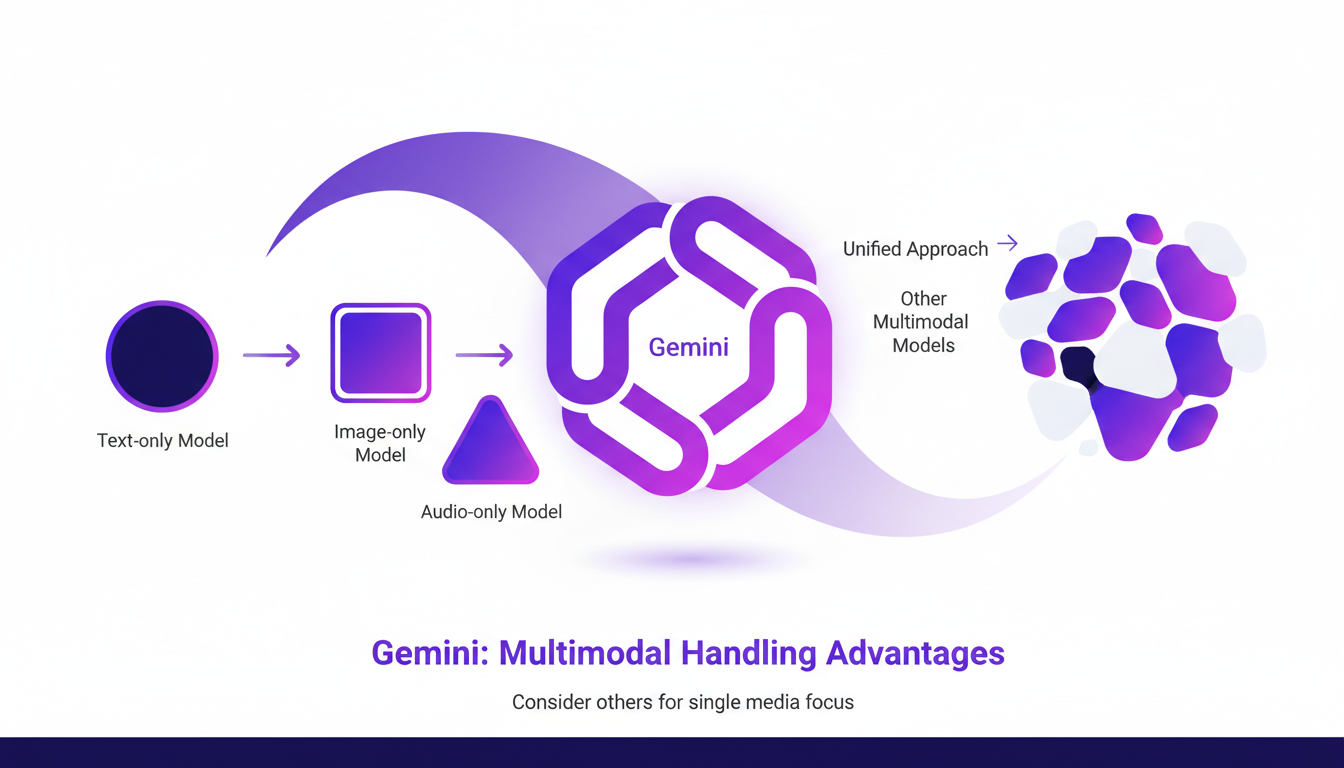

Comparer Gemini à d'Autres Modèles

Gemini se distingue par son approche unifiée, mais ce n'est pas le seul acteur sur le marché. J'ai comparé avec d'autres modèles et trouvé des avantages distincts dans le traitement multimodal. Si votre objectif est uniquement un type de média, considérez d'autres modèles. L'approche globale de Gemini peut faire économiser du temps et des ressources dans des contextes multimodaux. Attention aux affirmations exagérées; chaque modèle ne convient pas à tous les besoins.

- Avantages distincts dans le traitement multimodal

- Économies de temps et de ressources

- Attention aux affirmations exagérées

Alors, Gemini Embedding 2, c'est vraiment un outil qui change la donne pour gérer différents types de médias de manière unifiée. Je l'ai intégré pour améliorer l'efficacité et je peux dire que c'est une solution robuste. Mais attention, il faut comprendre ses limites pour en tirer le meilleur parti.

- D'abord, j'ai passé deux contenus pour des embeddings séparés, et ça fonctionne bien.

- Ensuite, j'ai noté un score parfait de 1 en faisant correspondre les textes 'un croquis de sac à dos' et 'un croquis sac à dos'.

- J'ai intégré six images, et le processus s'est déroulé sans accroc.

Pour l'avenir, je suis vraiment enthousiaste sur comment cette technologie peut transformer nos processus de gestion des médias, mais il faut toujours garder un œil sur ses limites techniques.

Prêt à transformer vos processus de gestion des médias ? Plongez dans Gemini Embedding 2 et voyez la différence. Et pour une compréhension plus approfondie, regardez la vidéo originale, c'est vraiment de pair à pair : voir la vidéo.

Questions Fréquentes

Thibault Le Balier

Co-fondateur & CTO

Issu de l'écosystème startup tech, Thibault a développé une expertise en architecture de solutions IA qu'il met aujourd'hui au service de grands groupes (Atos, BNP Paribas, beta.gouv). Il intervient sur deux axes : la maîtrise des déploiements IA (LLM locaux, sécurisation MCP) et l'optimisation des coûts d'inférence (offloading, compression, gestion des tokens).

Articles liés

Découvrez d'autres articles sur des sujets similaires

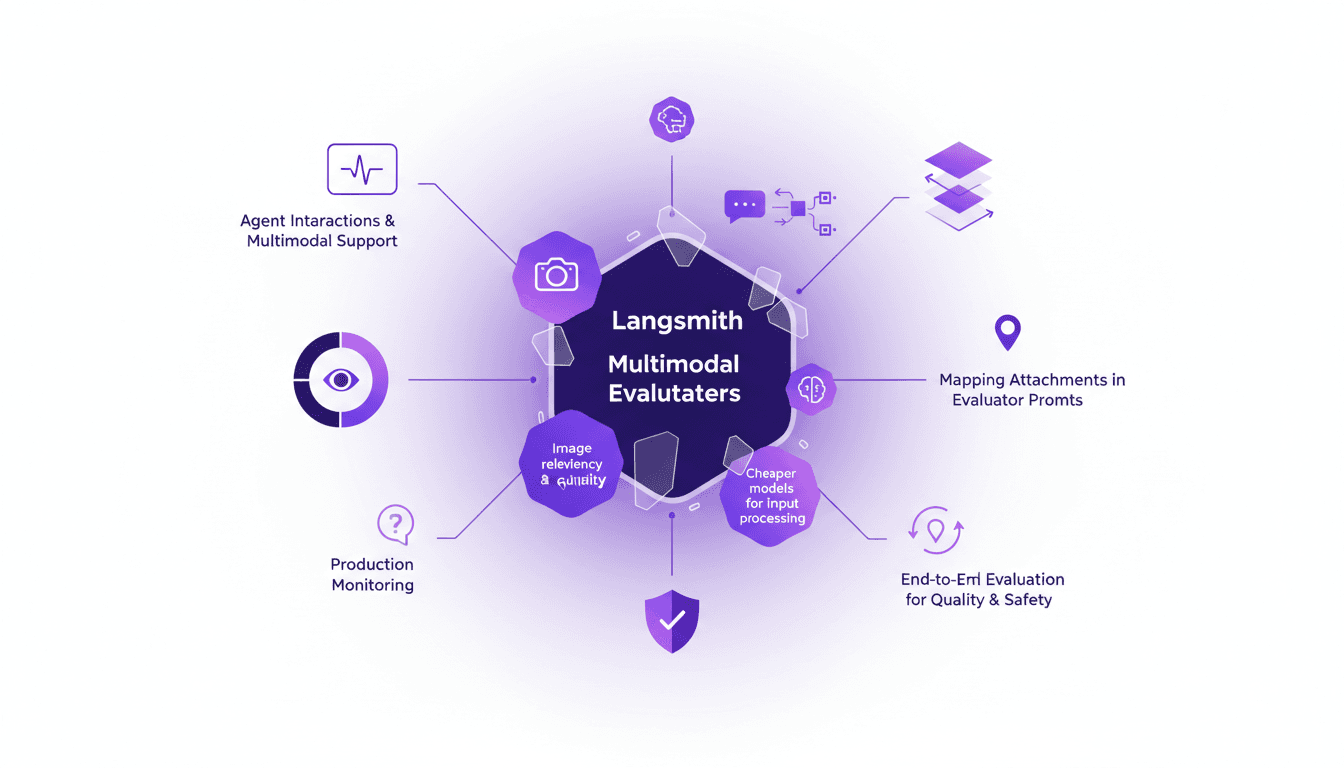

Évaluateurs Multimodaux LangSmith : Intégration Pratique

Je viens de passer du temps à bricoler avec la dernière fonctionnalité de LangSmith : les évaluateurs multimodaux. Croyez-moi, c'est un vrai changement de jeu pour les interactions d'agents. J'ai d'abord intégré le format B64 pour traiter les images, puis j'ai évalué la pertinence et la qualité des interactions. Mais attention aux modèles moins coûteux, ils peuvent parfois fausser les résultats. L'intégration est un véritable défi, mais une fois maîtrisée, elle permet une surveillance en production fluide et une évaluation de bout en bout des interactions pour garantir qualité et sécurité.

Maîtriser Gemini 3.1 : Flash Lite en 14 min

J'ai plongé tête la première dans Gemini 3.1 Flash Lite, prêt à voir si ça pouvait véritablement révolutionner mon workflow. Spoiler : ça l'a fait, mais pas sans quelques accrocs en chemin. Imaginez un modèle capable de comprendre des données multimodales et d'optimiser le SEO programmatique en un clin d'œil. J'ai testé cinq cas d'utilisation différents, et même pour une tâche de traduction, ça a pris à peine une seconde. Mais attention, la configuration technique via les outils de Google n'est pas une promenade de santé. Je vous explique comment j'ai navigué à travers tout ça, avec des comparaisons franches avec la concurrence et un œil sur l'efficacité des coûts. Si vous êtes prêt à optimiser votre SEO, suivez-moi dans cette aventure.

GPT-5.3: Optimiser les Résultats de Recherche Web

J'ai passé des années à peaufiner les résultats de recherche, mais depuis que j'ai intégré GPT-5.3, tout a changé. Avec les améliorations récentes, comprendre les requêtes utilisateurs est devenu plus nuancé. Dans cet article, je vous explique comment utiliser ces avancées pour améliorer les résultats de recherche web. On va explorer l'importance du sous-texte, les améliorations apportées par GPT-5.3, et comment cela rend les réponses plus naturelles et conversationnelles. Vous verrez des cas concrets comme la planification d'un voyage à vélo ou les changements de règles au baseball. C'est un outil puissant, mais attention aux limites contextuelles—au-delà de 100K tokens, ça se complique. Je partage comment j'ai orchestré ces éléments pour un impact direct sur l'expérience utilisateur.

Sécuriser l'IA : Intégration de Prompt Fu

Je me souviens de ma première rencontre avec une faille de sécurité dans un système d'IA. Ce jour-là, j'ai compris que la sécurité ne se résumait pas à cocher une case, mais qu'elle était essentielle au déploiement de l'IA. L'acquisition de Prompt Fu par OpenAI pourrait bien changer la donne. En intégrant Prompt Fu à la plateforme Frontier, OpenAI vise à renforcer la sécurité et à repenser la manière dont nous protégeons l'IA. Avec plus de 125 000 développeurs utilisant Prompt Fu et un quart des entreprises du Fortune 500 lui faisant confiance, cette décision stratégique promet de transformer la sécurité des systèmes d'IA, tout en répondant aux préoccupations liées à la maintenance des projets open source et aux injections de prompts.

GPT 5.4 : Performance, Coût et Controverses

J'ai intégré GPT 5.4 à mon workflow, et laissez-moi vous dire, c'est un véritable game changer—mais pas sans ses petites bizarreries. OpenAI a lancé GPT 5.4, et entre efficacité boostée et gestion des coûts, on découvre un terrain complexe avec des compromis. La tarification à 15 dollars par million de tokens semble alléchante, mais il faut surveiller les désinstallations qui ont explosé de 295% le 28 février. Avec un score de 83% sur le benchmark GDP val, surpassant Opus 4.6, GPT 5.4 promet beaucoup, mais attention aux quiproquos. Plongeons dans les détails techniques et les impacts professionnels que cette nouvelle version pourrait avoir.