LangChain et Nvidia: Créez votre Agent IA

J'ai plongé tête première dans la construction d'agents IA avec LangChain et la dernière technologie de Nvidia, et c'était un vrai bouleversement. D'abord, j'ai connecté mon modèle Neotron 3, puis j'ai utilisé OpenShell pour sécuriser l'environnement d'exécution. LangChain's Deep Agents m'ont aidé à créer un harnais open-source, et je dois dire que jongler avec la mémoire et les compétences de l'agent était à la fois complexe et fascinant. Mais attention, les politiques de sécurité et les restrictions réseau dans OpenShell peuvent être piégeuses. Si vous cherchez à construire votre propre agent IA, je vous montre comment j'ai orchestré tout ça.

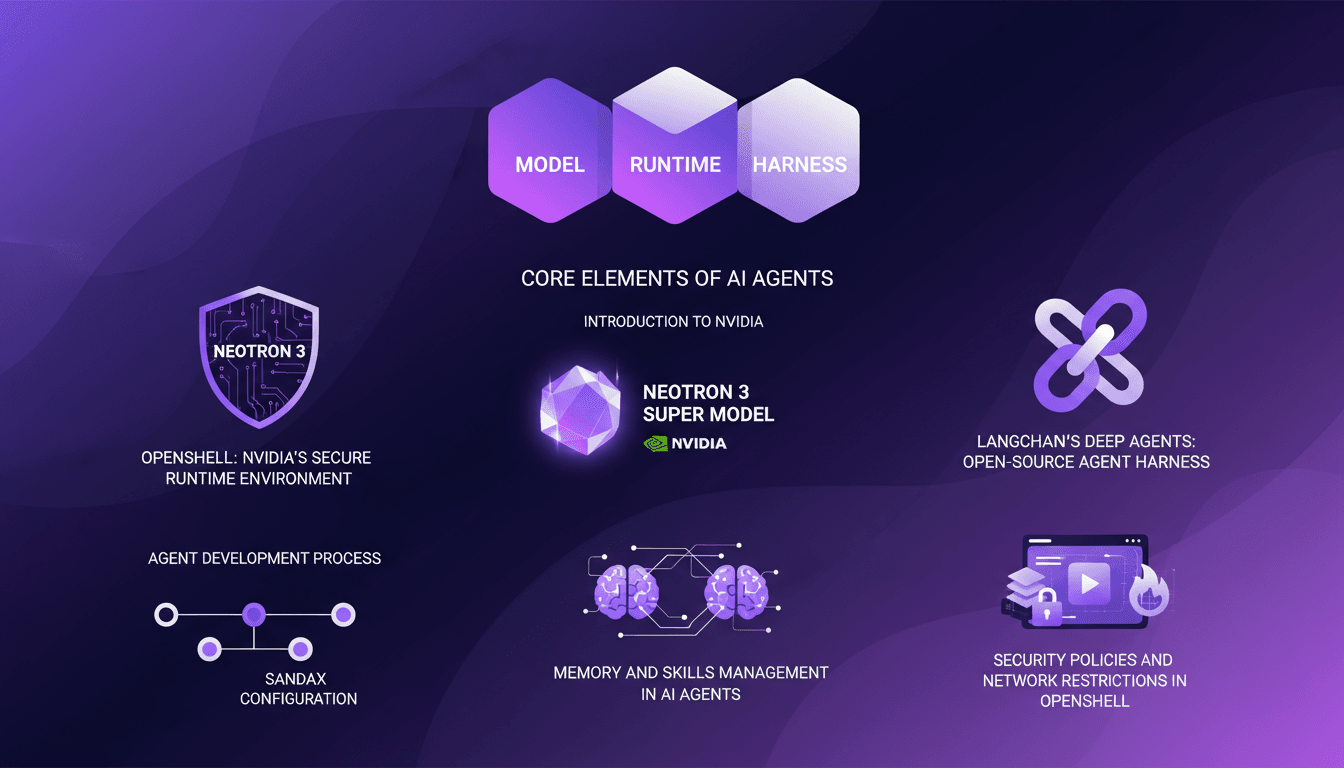

Je me suis lancé dans la construction d'agents IA avec LangChain et la dernière technologie de Nvidia, et ça a été un véritable tournant. Imaginez ceci : trois éléments clés—un modèle, un environnement d'exécution, et un harnais. D'abord, j'ai connecté le Neotron 3 de Nvidia, un super modèle qui surpasse le GPTOS en précision et vitesse. Puis, j'ai sécurisé l'environnement d'exécution avec OpenShell, veillant à ce que mes données soient protégées. LangChain's Deep Agents ont fourni le harnais open-source nécessaire pour orchestrer tout ça. Mais attention, gérer les politiques de sécurité et les restrictions réseau dans OpenShell demande de l'attention. (Croyez-moi, je me suis fait avoir plus d'une fois.) Maintenant, la mémoire et les compétences de l'agent sont en place et prêtes à être déployées. Dans ce tutoriel, je vous montre comment j'ai mis en œuvre cette configuration ambitieuse.

Comprendre l'Architecture des Agents IA

Dans le domaine des agents IA, la structure repose sur trois éléments clés : le modèle, le runtime et le harness. Ces composants sont l’épine dorsale de l’efficacité des agents comme Claude Code, Manis, et OpenClaw. Cela dit, la performance d’un agent est directement liée à la manière dont on orchestre ces éléments. Par exemple, j'ai constaté que Neotron 3, le nouveau modèle de Nvidia, surpasse GPTOS en termes de précision et de vitesse. Le choix des composants peut donc être un vrai jeu d’équilibriste, surtout quand on cherche à maximiser l’efficacité sans exploser les coûts.

Orchestrer ces composants nécessite de bien comprendre leurs rôles respectifs. Le modèle sert d’intelligence centrale, le runtime exécute les tâches, et le harness assure la liaison entre les deux. Mais attention, chaque choix implique des compromis. Par exemple, un modèle plus performant comme Neotron 3 peut nécessiter des ressources plus importantes, ce qui pourrait être un frein pour des projets à budget limité.

Prise en Main de Neotron 3 de Nvidia

Neotron 3 est une avancée majeure dans le monde des modèles IA. Sorti récemment par Nvidia, ce super modèle offre une précision et une vitesse qui dépassent celles de GPTOS. Quand je l'ai intégré à mon workflow, l'amélioration a été immédiate. Toutefois, l’intégration de Neotron 3 n’est pas sans défis. Par exemple, je me suis heurté à des problèmes de compatibilité avec certains environnements existants, ce qui a nécessité des ajustements de configuration.

Pour commencer, il faut bien se préparer en vérifiant la compatibilité des API et en ajustant les paramètres de runtime. Une fois ces étapes franchies, Neotron 3 se révèle être un atout puissant. Mais attention, ne sous-estimez pas le temps nécessaire pour ces ajustements initiaux. Une mauvaise préparation peut conduire à des performances sous-optimales ou à des interruptions de service.

Exploiter les Deep Agents de LangChain

LangChain propose un harness open source qui facilite l'intégration des agents IA. J'ai trouvé cet outil particulièrement utile pour l'ingénierie du contexte, une étape cruciale pour améliorer les performances des agents. En configurant l'environnement de développement et le sandbox de test, j'ai pu équilibrer complexité et performance, ce qui est essentiel pour éviter des surcharges inutiles.

Le sandbox est votre terrain d'essai sécurisé. Je commence généralement par configurer mes variables d'environnement avant de tester les agents dans le sandbox. Cela permet de simuler des scénarios réels sans risques pour le système de production. Mais il faut faire attention à ne pas alourdir le système avec des configurations trop complexes qui pourraient ralentir le processus.

Exécuter et Gérer la Mémoire des Agents IA

La gestion de la mémoire est un aspect crucial de l'exécution des agents IA. J'ai souvent utilisé un middleware pour le traitement de la mémoire, ce qui m'a permis de gérer efficacement les données en arrière-plan. L'intégration d'un backend composite facilite également la gestion des données à grande échelle, mais attention aux pièges courants comme la surcharge de la mémoire, qui peut ralentir l'agent.

Il est essentiel de définir clairement les limites de la mémoire pour chaque agent, afin d'éviter des conflits entre les threads et les sandboxes. Avec le bon setup, on peut alors exécuter des commandes, écrire et lire des fichiers, ce qui enrichit la capacité d'apprentissage de l'agent.

Sécurité et Gestion des Politiques avec OpenShell

OpenShell de Nvidia offre un environnement runtime sécurisé pour les agents IA. En implémentant des politiques de sécurité robustes, on peut exécuter des agents avec différents sets de permissions, sur des environnements GPU accélérés par exemple. Mais il faut constamment équilibrer sécurité et fonctionnalité pour éviter d'entraver les opérations courantes.

Les leçons tirées de mes premières implémentations m'ont appris que la gestion des restrictions réseau peut avoir un impact significatif sur la performance des agents. Il est crucial de revoir régulièrement les politiques de sécurité pour s’adapter aux nouvelles exigences sans compromettre la fonctionnalité des agents.

- Les agents IA reposent sur un modèle, un runtime, et un harness.

- Neotron 3 offre des performances supérieures à GPTOS.

- LangChain facilite l'ingénierie du contexte avec son harness open source.

- Bien gérer la mémoire est essentiel pour éviter les ralentissements.

- Sécurité et fonctionnalité doivent être équilibrées dans OpenShell.

Construire un agent IA avec LangChain et les outils de Nvidia, c'est vraiment un jeu d'orchestration. D'abord, je m'assure de bien comprendre les trois éléments essentiels : le modèle, le runtime et le harnais. Ensuite, je déploie Neotron 3, ce super modèle de chez Nvidia qui écrase littéralement le modèle GPTOS en termes de précision et de vitesse. Enfin, j'encapsule tout ça dans OpenShell, l'environnement runtime sécurisé de Nvidia. Attention cependant, chaque composant a ses limites – par exemple, OpenShell est top pour la sécurité, mais parfois un peu lourd à configurer.

- Points clés :

- 3 éléments clés: modèle, runtime, harnais.

- Neotron 3: modèle super performant, sorti il y a une semaine.

- OpenShell: environnement runtime sécurisé.

En regardant vers l'avenir, je vois ces outils comme des game changers, mais il faut vraiment les maîtriser pour tirer le meilleur parti. Prêt à construire ton propre agent IA ? Plonge-toi dans le setup avec LangChain et Nvidia et transforme ton workflow. Pour aller plus loin, je te recommande de visionner la vidéo originale pour des insights plus profonds. Crois-moi, ça vaut le coup !

Questions Fréquentes

Thibault Le Balier

Co-fondateur & CTO

Issu de l'écosystème startup tech, Thibault a développé une expertise en architecture de solutions IA qu'il met aujourd'hui au service de grands groupes (Atos, BNP Paribas, beta.gouv). Il intervient sur deux axes : la maîtrise des déploiements IA (LLM locaux, sécurisation MCP) et l'optimisation des coûts d'inférence (offloading, compression, gestion des tokens).

Articles liés

Découvrez d'autres articles sur des sujets similaires

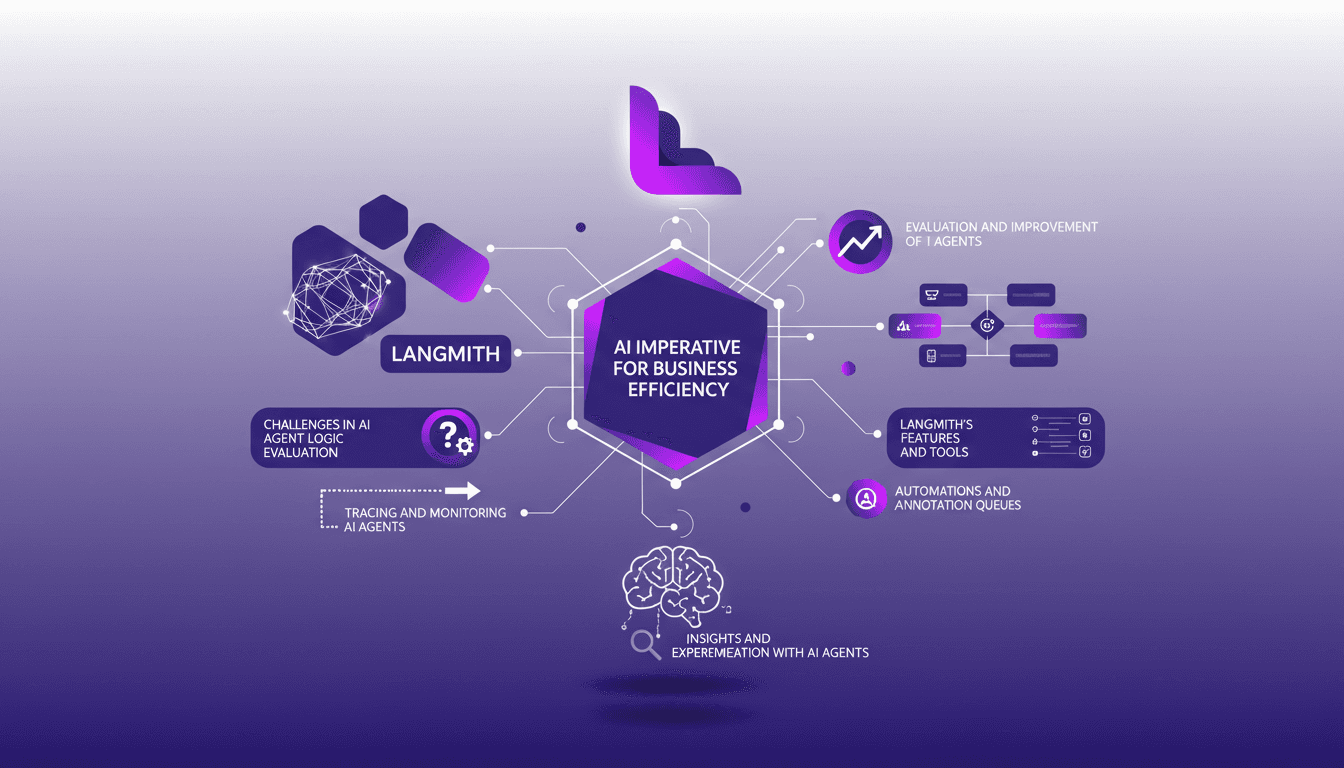

Déboguer et Évaluer des Agents IA avec LangSmith

Je suis tombé dedans avec les agents IA, et croyez-moi, les rendre fiables est un défi. LangSmith a vraiment changé la donne pour moi. Ce n'est pas juste une question de les rendre intelligents, mais de s'assurer qu'ils livrent vraiment. D'abord, je connecte mes agents à LangSmith pour tracer et évaluer leur logique. Ensuite, je m'assure qu'ils franchissent le seuil de score de 8, ce qui garantit une aide précieuse. Les outils de LangSmith, comme les files d'annotation et l'automatisation, me permettent de peaufiner et de publier des agents qui tiennent la route. Mais attention, les limites existent—ne surévaluez pas l'automatisation. Plongez avec moi dans les défis, les outils, et les solutions qui font de LangSmith un allié indispensable pour les agents IA.

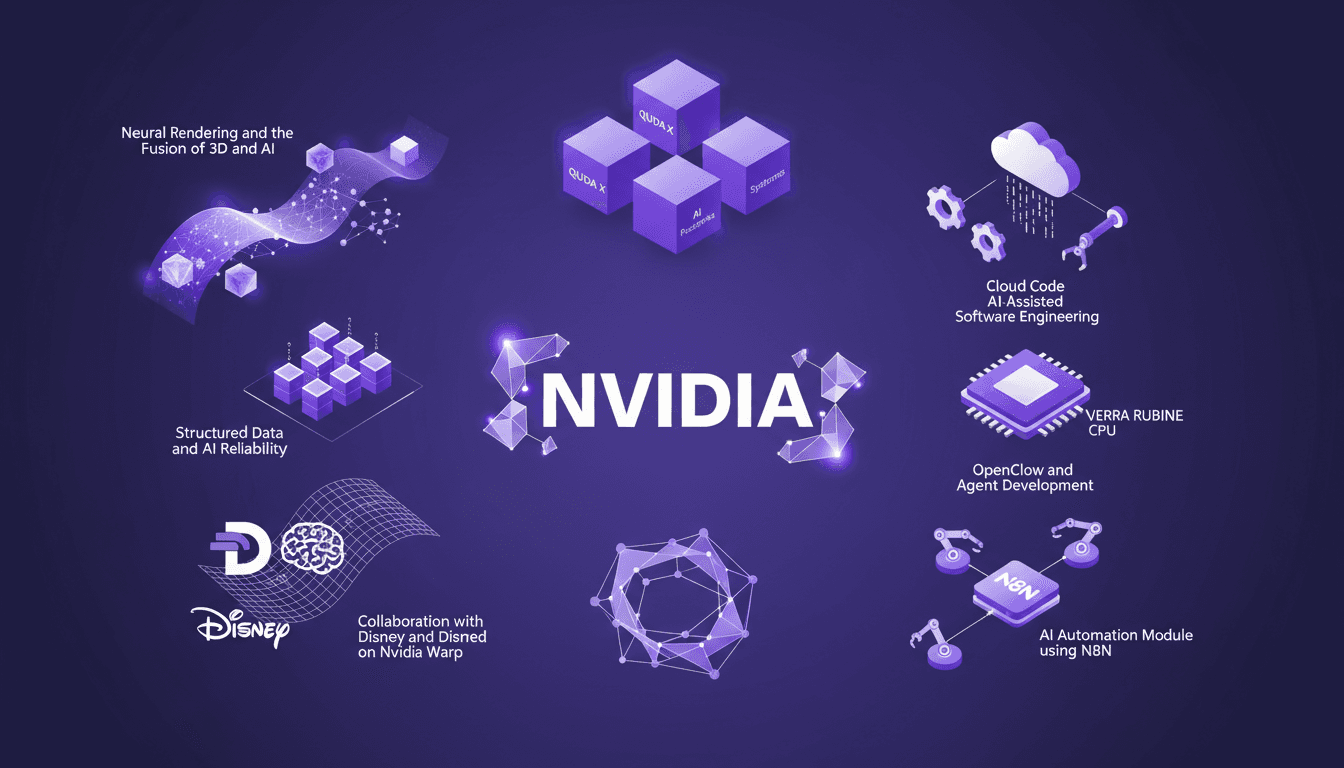

NVIDIA GTC 2026 : Révélation des Nouvelles Plateformes

Je suis allé à des dizaines de conférences, mais l'événement NVIDIA GTC 2026 a vraiment été un tournant. Ils ont dévoilé des plateformes qui vont redéfinir l'IA et l'informatique. Imaginez des CPUs qui transforment notre manière de coder, des rendus neuronaux qui fusionnent 3D et IA, et des collaborations avec Disney et Deep Mind sur Nvidia Warp. C'est immense, et l'impact pour nous, les constructeurs, est direct. On parle ici de QUDA X, de l'ingénierie logicielle assistée par l'IA, et même de refroidissement à 45° par de l'eau chaude. Il y a des années de travail devant nous mais aussi des opportunités incroyables. Plongeons ensemble dans ce qui a été révélé.

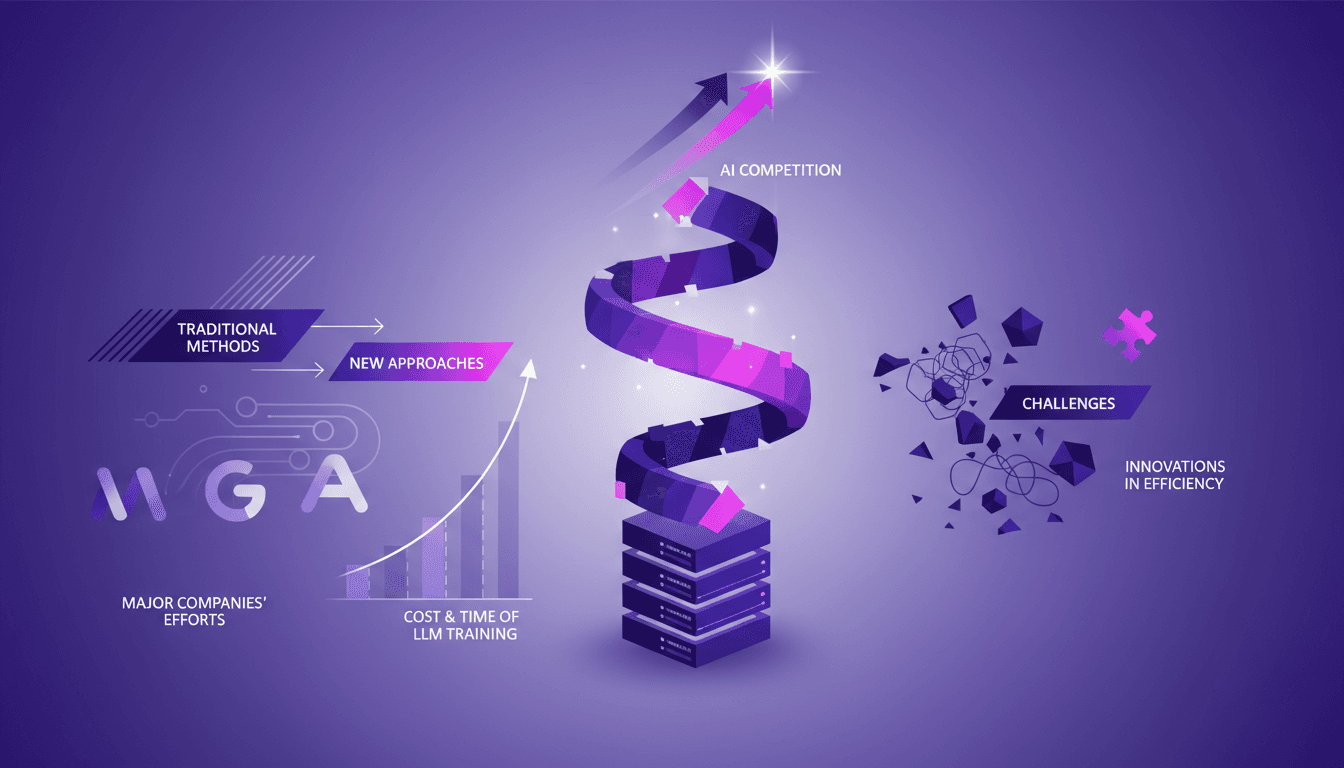

Amélioration AI: Réduction des Coûts et Temps

La première fois que j'ai entendu parler de 'l'amélioration récursive' en IA, j'ai cru que c'était de la science-fiction. Mais en m'y plongeant, j'ai réalisé que c'est notre avenir, si on peut gérer les coûts et le temps. L'entraînement d'un LLM coûte des centaines de millions et prend des mois. Je suis au cœur de cette course pour développer des solutions plus rapides et moins chères. On va décortiquer comment on s'y prend, les défis d'entraînement des modèles, et pourquoi les méthodes traditionnelles ne suffisent plus. Je vous rassure, c'est du concret, pas du blabla corporate.

Ingénieur Aérospatial: Mon Parcours Pratique

Vous avez déjà rêvé de toucher les étoiles, littéralement ? Moi oui, et cela m'a mené à devenir ingénieur aérospatial chez la NASA. Mais, croyez-moi, les rêves ne suffisent pas—il faut un plan concret. Dans ce live, je partage comment j'ai construit le mien, de l'investissement dans des entreprises de fusées à la création de plateformes qui révolutionnent des industries. On parle de coding Vibe, de la plateforme Consult Sphere, et de comment ces outils transforment les aspirations en résultats tangibles. Et n'oublions pas l'importance de la communauté, de la crédibilité, et de la valeur de marque dans tout cela.

Nvidia et OpenClaw : Intégration de Nemo Claw

Je suis entré dans la keynote de Nvidia GTC 2026 avec l'idée de voir les habituelles mises à jour technologiques, mais je suis tombé sur une véritable révolution : l'implication de Nvidia dans le projet OpenClaw avec Nemo Claw. Nvidia ne se contente pas de suivre le mouvement, ils redéfinissent le paysage. OpenClaw, qui a commencé de zéro, compte déjà plus de 50 variations sur GitHub. Et avec l'arrivée de Nemo Claw, on parle de sécurité, d'intégration matérielle et d'applications d'entreprise réinventées. Nvidia ne rigole pas avec leur stratégie matérielle, notamment avec les puces Gro 3 LPU et l'intégration du Grock IP. Mais attention, la vie privée des données reste un sujet brûlant dans ce domaine.