Déployer des Agents avec Langraph CLI: Guide Pratique

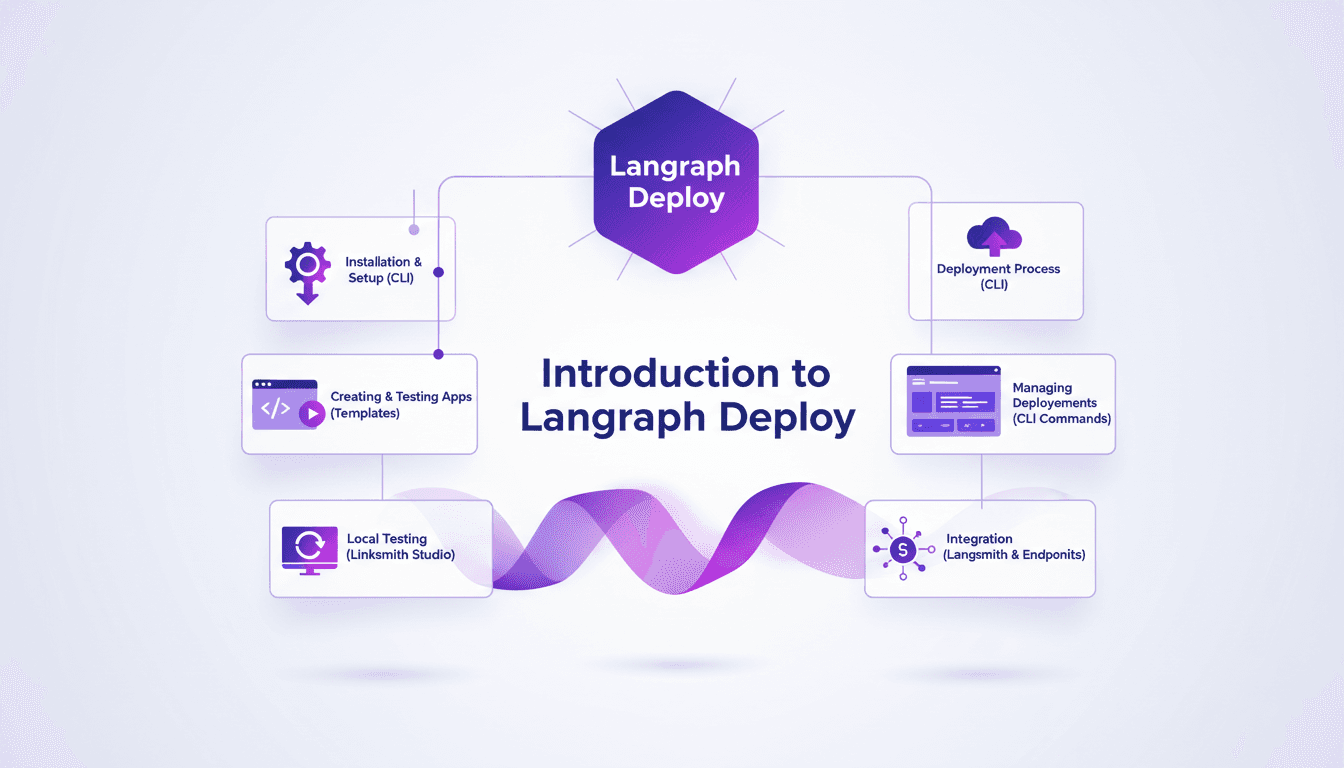

Déployer des agents ne devrait pas être un casse-tête. Avec Langraph CLI, j'ai réduit mon temps de déploiement à quelques minutes. D'abord, je configure l'installation du CLI avec une simple commande 'uv tool install langraph cli'. Ensuite, je teste mes applications localement avec Langsmith Studio, ce qui me permet d'itérer rapidement (c'est crucial pour éviter les mauvaises surprises en production). Puis, je crée une nouvelle application Langraph avec 'langraph new' et je suis prêt pour le déploiement. Je vous explique comment j'ai intégré Langsmith, géré mes déploiements et utilisé les endpoints disponibles, tout ça en quelques commandes depuis le terminal. Croyez-moi, une fois que vous aurez goûté à cette simplicité, vous ne reviendrez plus en arrière.

Déployer des agents ne devrait pas être un casse-tête, mais plutôt une affaire de minutes. Avec Langraph CLI, j'ai pu réduire mon temps de déploiement de manière significative, et je vais vous montrer comment. Je commence par l'installation du CLI avec une commande 'uv tool install langraph cli' (tellement simple que c'en est presque magique). Ensuite, je crée une nouvelle application avec 'langraph new', en utilisant les templates Langraph qui me font gagner un temps fou. J'itère localement avec Linksmith Studio, ce qui me permet de repérer les bugs avant qu'ils n'atteignent la production (croyez-moi, ça m'a sauvé plus d'une fois). Puis, je déploie directement depuis le terminal. L'intégration avec Langsmith et la gestion des déploiements deviennent un jeu d'enfant grâce aux commandes CLI. C'est un vrai game changer, mais attention aux limites de contexte—au-delà de 100K tokens, ça se complique. Je vous guide à travers ce workflow qui a révolutionné ma façon de travailler.

Commencer avec Langraph CLI

Tout d'abord, j'ai téléchargé et installé Langraph CLI en utilisant la commande uv tool install langraph cli. C'est direct, pas de fioritures, et ça me fait gagner un temps précieux. Pourquoi utiliser le CLI ? C'est simple : c'est efficace, direct, et idéal pour ceux d'entre nous qui vivent dans le terminal. Mais attention, assurez-vous que vos variables d'environnement sont correctement configurées dès le départ. Ça m'a évité pas mal de maux de tête par la suite.

Mon langage de choix ici est Python, mais sachez que Langraph supporte aussi d'autres langages. C'est un des nombreux avantages de cet outil, même si parfois je me suis fait avoir par des détails de configuration.

Créer votre première application Langraph

Pour créer une nouvelle application, j'ai utilisé la commande langraph new. C'est un vrai gain de temps. Les modèles de Langraph sont robustes et gèrent la majeure partie du code standard, ce qui me permet de me concentrer sur la logique métier. Mais attention, ces modèles peuvent parfois être trop génériques. Personnalisez-les autant que nécessaire pour éviter les mauvaises surprises.

Tester dès le début peut vous éviter bien des maux de tête. J'exécute toujours des tests basiques juste après la création pour m'assurer que tout fonctionne bien.

Points à retenir

- Utilisation de

langraph newpour un démarrage rapide. - Modèles robustes mais nécessitant souvent des ajustements.

- Testez tôt pour éviter les erreurs plus tard.

Test local avec Linksmith Studio

Linksmith Studio est mon outil de prédilection pour les tests locaux. Il s'intègre parfaitement avec Langraph, ce qui est un vrai plus. L'itération locale est rapide, je peux tester les changements sans avoir à redéployer, c'est un vrai changement de jeu. Mais attention à ne pas trop tester localement. Parfois, il est plus rapide de déployer et de tester dans un environnement réel.

Le retour d'information de Linksmith est précieux pour affiner la fonctionnalité avant de passer en production. C'est un outil que je recommande chaudement.

Points à retenir

- Linksmith Studio pour des tests locaux rapides et efficaces.

- Ne pas trop tester localement, déployez pour des tests réels.

- Utilisez le retour d'information pour affiner vos agents.

Déployer et gérer les agents

Le déploiement avec la commande uvun langraph deploy est simple. Une commande unique, et le tour est joué, réduisant ainsi les erreurs. Gérer les déploiements via le CLI est efficace. Vous pouvez suivre, mettre à jour et revenir en arrière facilement. Cependant, j'ai rencontré des problèmes avec les configurations d'endpoints. Double-vérifiez vos routes !

Les fonctionnalités de déploiement sont riches, mais attention aux limites des API. Planifiez bien votre utilisation pour éviter de mauvaises surprises.

Points à retenir

- Déploiement simple avec

uvun langraph deploy. - Gérer facilement les déploiements via le CLI.

- Attention aux configurations d'endpoints.

Intégrations et fonctionnalités avancées

L'intégration avec Langsmith est fluide. Elle étend les fonctionnalités et optimise la performance. Explorez les endpoints disponibles, ils peuvent étendre les capacités de votre application. Mais attention, les fonctionnalités avancées viennent avec des compromis. Plus de puissance entraîne plus de complexité. Toujours équilibrer l'utilisation des fonctionnalités et les impacts sur la performance.

Si vous souhaitez approfondir le sujet, je vous recommande de consulter des ressources comme LangGraph CLI - LangChain Reference Docs ou What is LangGraph? - IBM pour un aperçu complet.

Points à retenir

- Intégration fluide avec Langsmith pour des performances optimisées.

- Explorez les endpoints pour étendre les capacités.

- Attention aux compromis des fonctionnalités avancées.

Avec Langraph CLI, le déploiement d'agents est devenu un jeu d'enfant. Je connecte facilement tous les points, de l'installation à la mise en production, en quelques minutes. Voici ce que j'ai appris :

- Rapidité : J'ai littéralement transformé un prototype en production en un clin d'œil. C'est un vrai gain de temps.

- Simplicité : Une simple commande

uv tool install langraph cliet c'est parti. Pas besoin de se casser la tête avec des configurations complexes. - Efficacité :

langraph newm'a permis de créer une application Langraph en un rien de temps. - Flexibilité : Avec Linksmith Studio, tester et itérer localement devient un jeu d'enfant.

C'est franchement un game changer pour gérer les déploiements, même si je fais attention aux limites comme la gestion des dépendances externes. Prêt à transformer votre workflow de déploiement ? Je vous conseille fortement de tester Langraph CLI dès aujourd'hui. Pour une compréhension plus profonde, je vous invite à regarder la vidéo complète : lien YouTube.

Questions Fréquentes

Thibault Le Balier

Co-fondateur & CTO

Issu de l'écosystème startup tech, Thibault a développé une expertise en architecture de solutions IA qu'il met aujourd'hui au service de grands groupes (Atos, BNP Paribas, beta.gouv). Il intervient sur deux axes : la maîtrise des déploiements IA (LLM locaux, sécurisation MCP) et l'optimisation des coûts d'inférence (offloading, compression, gestion des tokens).

Articles liés

Découvrez d'autres articles sur des sujets similaires

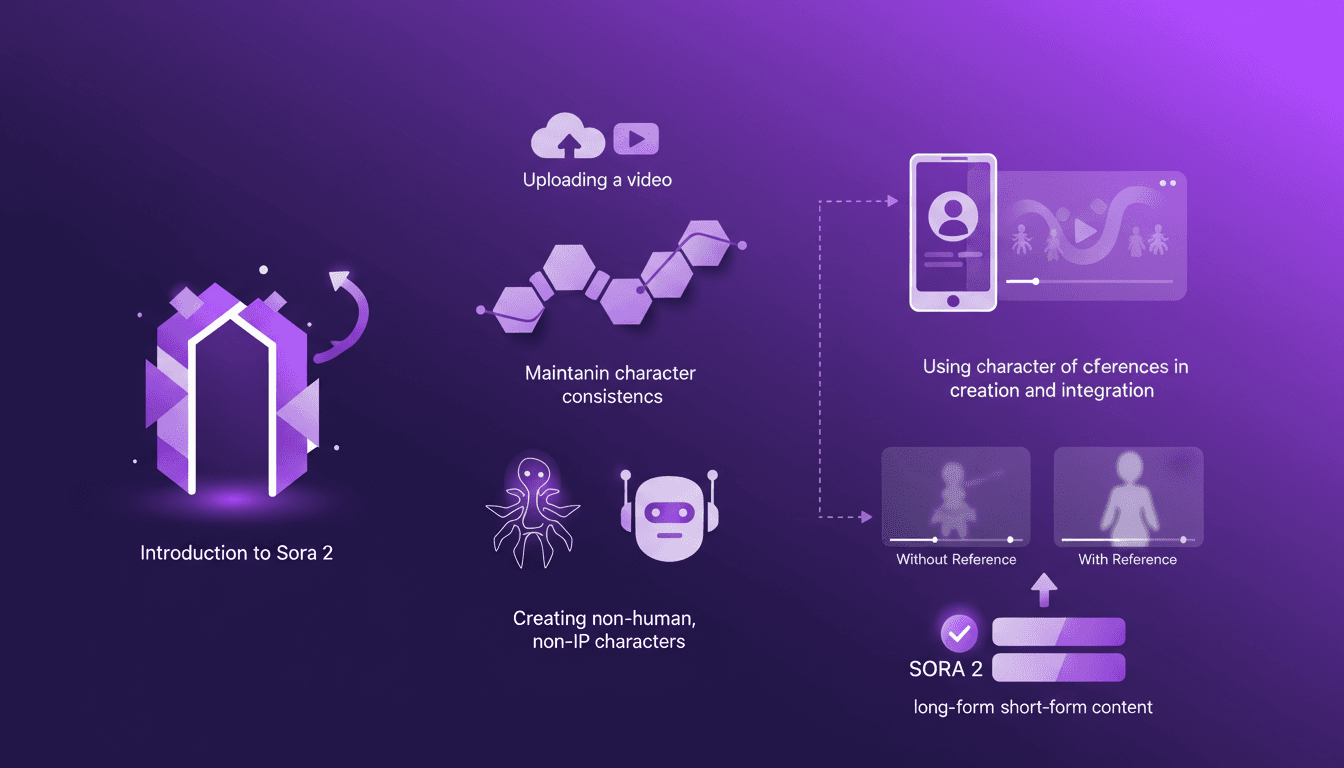

Créer des Personnages Cohérents avec Sora 2

J'ai plongé dans Sora 2 et, croyez-moi, la fonctionnalité de création de personnages est un vrai game changer pour quiconque prend la cohérence vidéo au sérieux. Vous savez à quel point c'est frustrant quand vos personnages générés par l'IA semblent différents à chaque scène ? Sora 2 s'attaque à ce problème de front. Dans cet article, je vous montre comment j'utilise Sora 2 pour maintenir la cohérence des personnages, même lorsque je crée des personnages non humains et non IP. On va parcourir le workflow, de l'importation de votre vidéo initiale à la sortie finale cohérente. Je vais démontrer la création et l'intégration de personnages, et comparer les vidéos avec et sans références de personnages. Sora 2 est un atout majeur pour le contenu long et court. Accrochez-vous, c'est du concret.

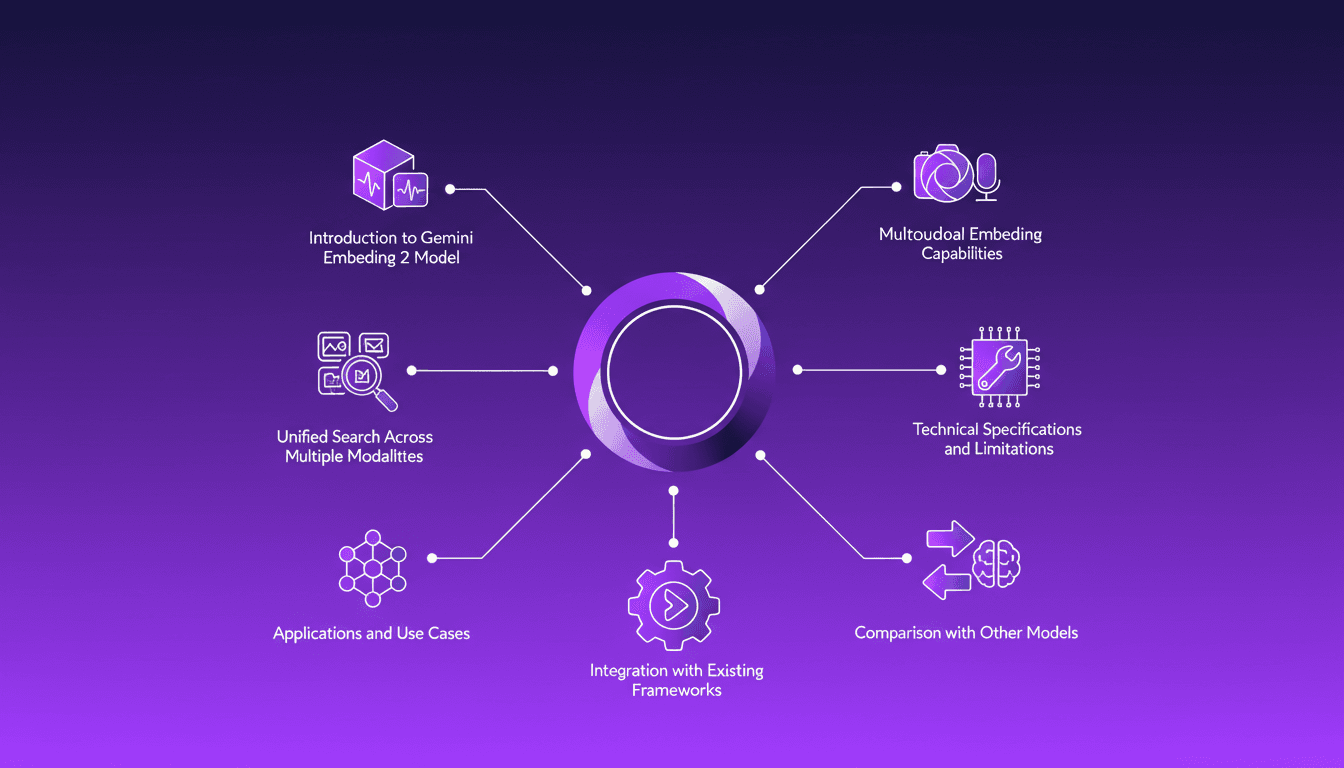

Intégration de Gemini Embedding 2: Guide Pratique

J'ai plongé dans Gemini Embedding 2 pour optimiser la gestion de l'audio, du texte, des images et des vidéos. Imaginez un instant : une approche unifiée qui prend en charge plusieurs modalités d'embedding. J'ai moi-même testé cette promesse, et croyez-moi, il y a des nuances essentielles à connaître pour exploiter pleinement son potentiel. Que vous cherchiez à unifier vos recherches à travers différents médias ou à intégrer ce modèle dans vos frameworks existants, ce guide pratique vous montrera comment. Attention, certaines limitations techniques peuvent vous surprendre, mais avec une bonne orchestration, les résultats sont là. Allons-y, je vous montre comment je l'ai intégré dans mes workflows pour un impact direct et mesurable.

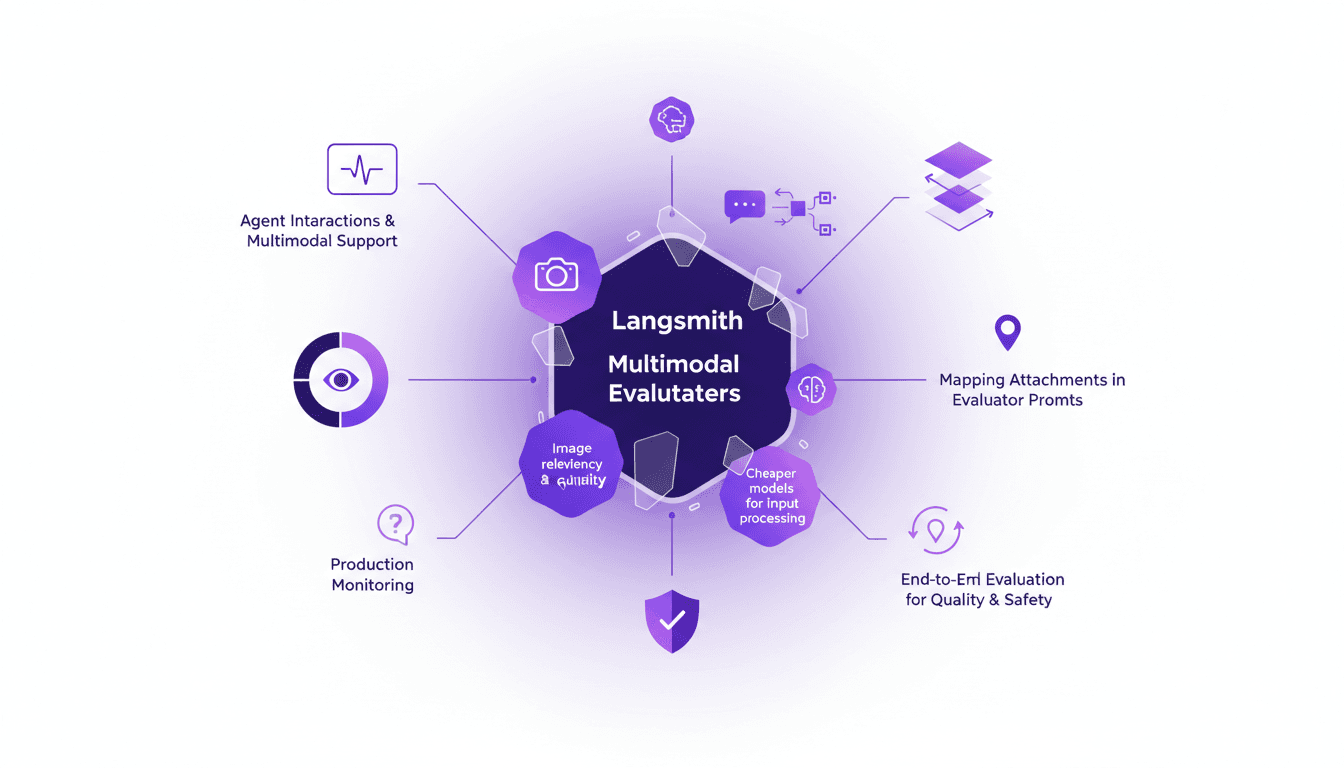

Évaluateurs Multimodaux LangSmith : Intégration Pratique

Je viens de passer du temps à bricoler avec la dernière fonctionnalité de LangSmith : les évaluateurs multimodaux. Croyez-moi, c'est un vrai changement de jeu pour les interactions d'agents. J'ai d'abord intégré le format B64 pour traiter les images, puis j'ai évalué la pertinence et la qualité des interactions. Mais attention aux modèles moins coûteux, ils peuvent parfois fausser les résultats. L'intégration est un véritable défi, mais une fois maîtrisée, elle permet une surveillance en production fluide et une évaluation de bout en bout des interactions pour garantir qualité et sécurité.

GPT 5.4 : Performance, Coût et Controverses

J'ai intégré GPT 5.4 à mon workflow, et laissez-moi vous dire, c'est un véritable game changer—mais pas sans ses petites bizarreries. OpenAI a lancé GPT 5.4, et entre efficacité boostée et gestion des coûts, on découvre un terrain complexe avec des compromis. La tarification à 15 dollars par million de tokens semble alléchante, mais il faut surveiller les désinstallations qui ont explosé de 295% le 28 février. Avec un score de 83% sur le benchmark GDP val, surpassant Opus 4.6, GPT 5.4 promet beaucoup, mais attention aux quiproquos. Plongeons dans les détails techniques et les impacts professionnels que cette nouvelle version pourrait avoir.

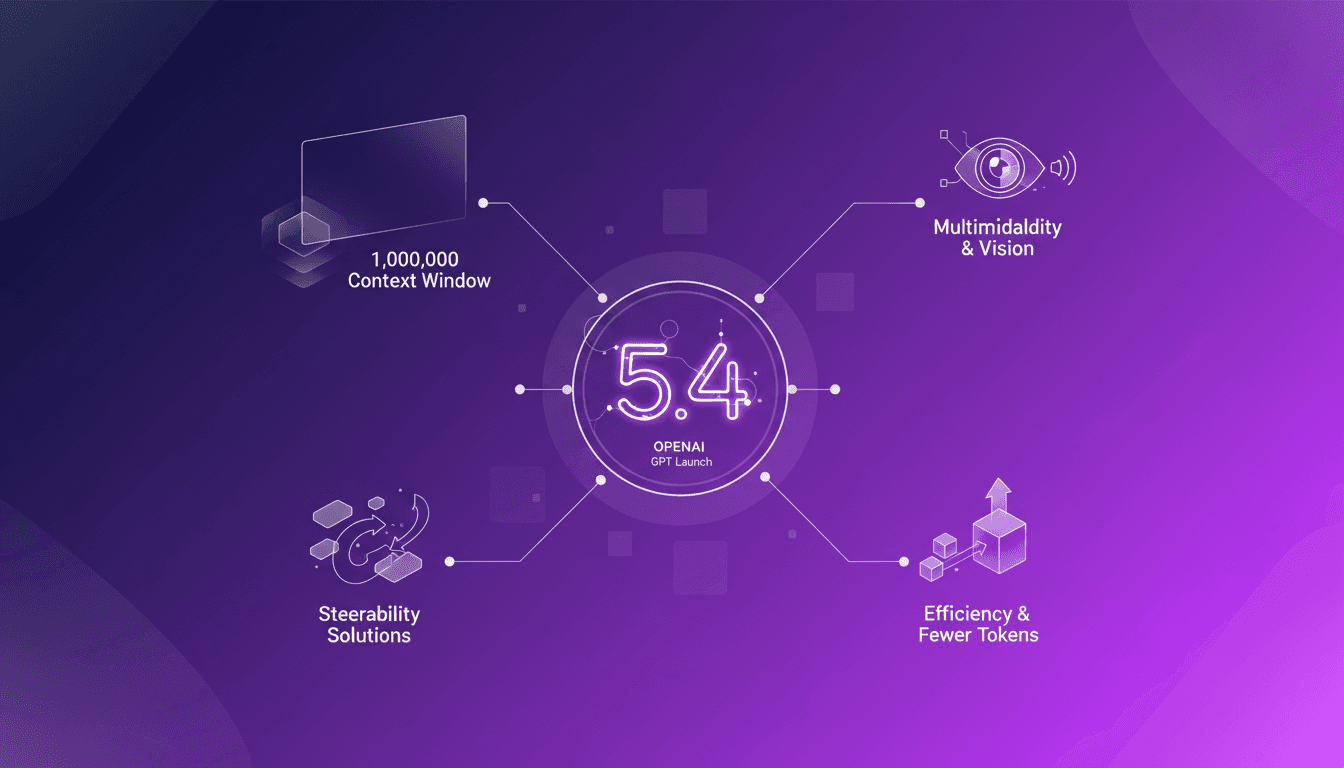

GPT 5.4 : Révolution contextuelle 1 million

J'ai passé des années dans les tranchées avec les modèles d'IA, et le lancement de GPT 5.4 est vraiment un bouleversement. Ce modèle promet un bond énorme avec sa fenêtre de contexte d'un million, ses capacités multimodales améliorées et ses solutions aux problèmes de steerabilité. Mais avant de plonger tête baissée, décortiquons ce que cela signifie pour nous, les constructeurs. Imaginez orchestrer un projet où le contexte n'est plus une limite écrasante, où la vision et le texte se combinent avec fluidité. GPT 5.4 n'est pas qu'une simple mise à jour, c'est une réinvention de la roue, mais attention aux pièges habituels : ne surchargez pas votre projet de promesses sans comprendre les contraintes. Explorons ces nouvelles fonctionnalités et voyons comment elles se confrontent aux applications réelles.