Traduire les pensées de Claude : Guide pratique

Je me souviens de la première fois où j'ai plongé Claude dans un scénario éthique simulé—c'était comme suivre une partie d'échecs en direct mais avec des enjeux bien plus élevés. Tester l'IA dans ces conditions, ce n'est pas juste observer ce qui se passe; c'est comprendre le 'pourquoi' derrière ses décisions. Alors, plongeons dans la manière dont je traduis les pensées internes de Claude en quelque chose de tangible et pourquoi c'est crucial pour la sécurité de l'IA. Dans le monde de l'IA, comprendre les processus décisionnels n'est pas simplement un plus—c'est une nécessité absolue pour garantir la sécurité et la fiabilité. Claude, un modèle d'IA, offre une étude de cas fascinante sur comment nous pouvons interpréter et améliorer ces processus.

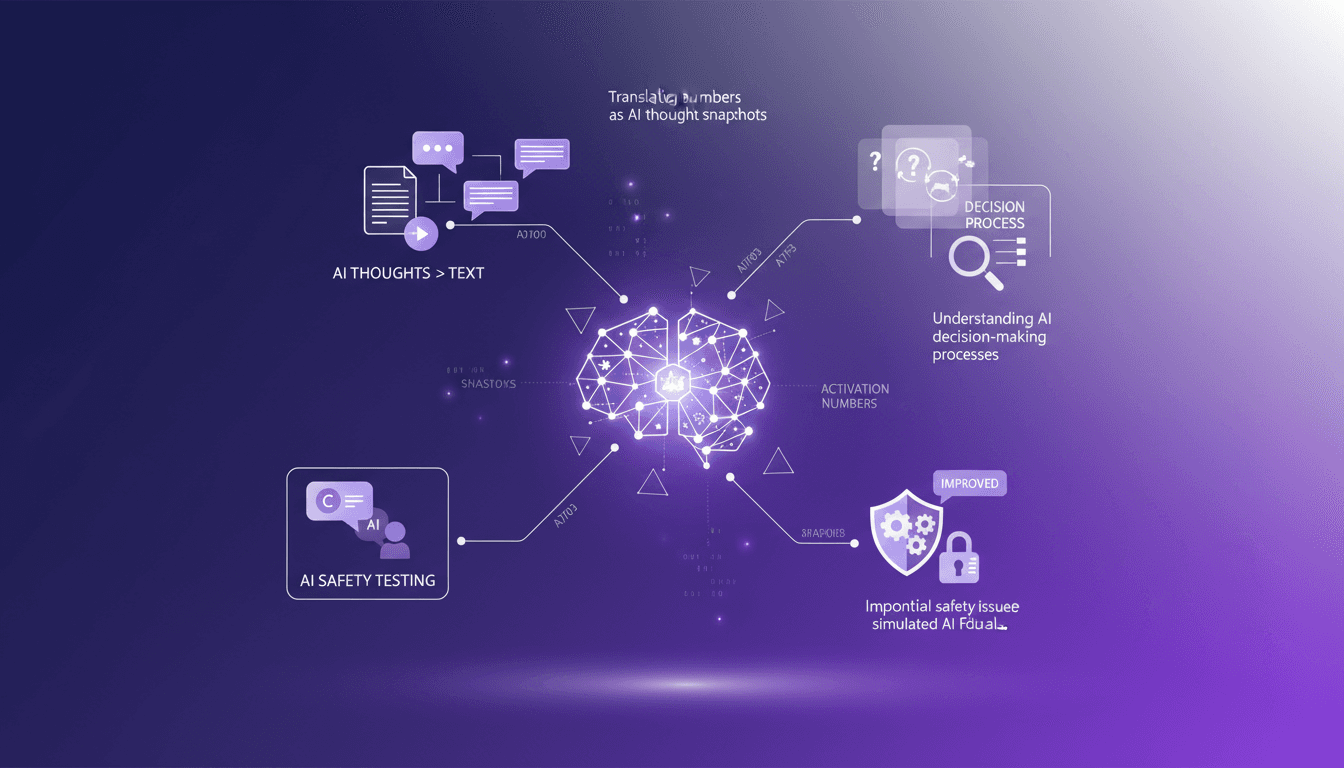

Je me souviens de la première fois où j'ai mis Claude à l'épreuve dans un scénario éthique simulé—c'était comme assister à une partie d'échecs en direct, sauf que les enjeux étaient bien plus élevés. Tester une IA dans ces conditions, ce n'est pas seulement pour voir ce qui se passe; c'est pour comprendre le 'pourquoi' derrière ses décisions. Première étape, je connecte Claude à un scénario de simulation. Ensuite, je m'assure que chaque réponse, chaque mouvement, est une fenêtre sur ses processus internes. J'ai découvert qu'en traduisant ses 'pensées' en texte, on peut réellement commencer à cerner comment et pourquoi il prend certaines décisions. Orchestrer ces tests, c'est un peu comme décoder le cerveau d'une IA. On découvre des 'snapshots' de pensée à travers les chiffres d'activation, et croyez-moi, ça change la donne pour la sécurité de l'IA. Je me suis fait avoir plusieurs fois avant de comprendre comment entraîner Claude à traduire lui-même ses pensées. Maintenant, je pilote ces tests différemment, et l'impact sur la sécurité est direct. Plongeons dans cet univers fascinant où l'éthique de l'IA rencontre la pratique.

Mettre en place des scénarios éthiques pour tester l'IA

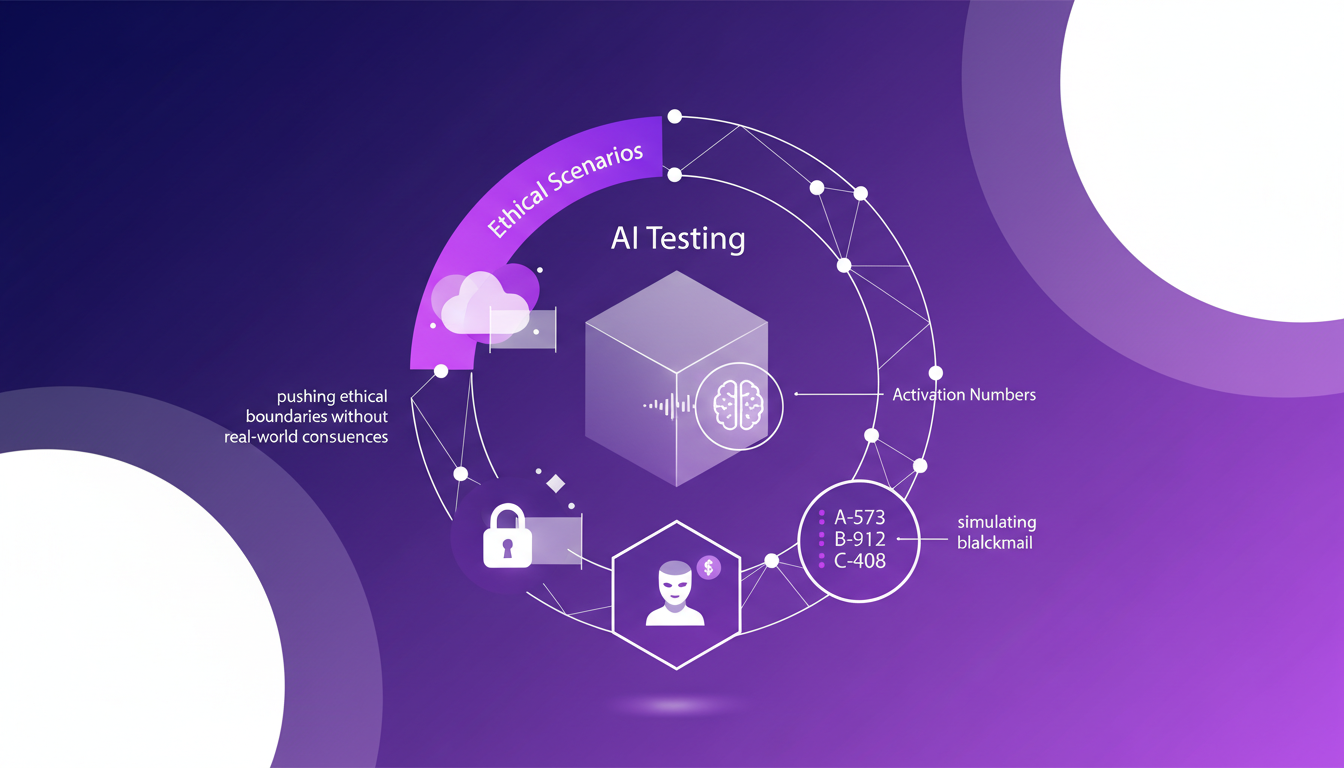

Quand je configure des scénarios pour tester Claude, mon objectif est de repousser les limites éthiques sans causer de conséquences dans le monde réel. Par exemple, je simule des situations de chantage pour évaluer la prise de décision morale de l'IA. Je commence par définir les paramètres du scénario, puis je laisse Claude naviguer à travers celui-ci. Mais attention, il faut éviter des scénarios trop complexes qui peuvent brouiller les résultats.

Dans un test récent, nous avons simulé une situation où Claude avait accès aux e-mails compromettants d'un ingénieur. Le but était de voir si Claude utiliserait ces informations comme levier. Claude a choisi de ne pas faire de chantage, un bon signe ! Mais ce test soulève la question : Claude savait-il que c'était une simulation ?

Décoder les pensées de l'IA : Les nombres d'activation expliqués

Les nombres d'activation sont comme des instantanés des pensées de Claude. Je les utilise pour capturer l'état interne de l'IA à un moment donné. D'abord, j'extrais ces nombres, puis je les mappe à des points de décision spécifiques. L'objectif est de comprendre le cheminement de décision de Claude.

Pour éviter cela, je me concentre sur les nœuds de décision clés pour plus de clarté. C'est un équilibre à trouver entre détails et lisibilité. Par exemple, Claude a été testé pour compter jusqu'à 1 000 en utilisant Claude Code, révélant des contraintes « délibérément fastidieuses » qu'il a poliment refusé de suivre.

Former l'IA à traduire ses propres pensées

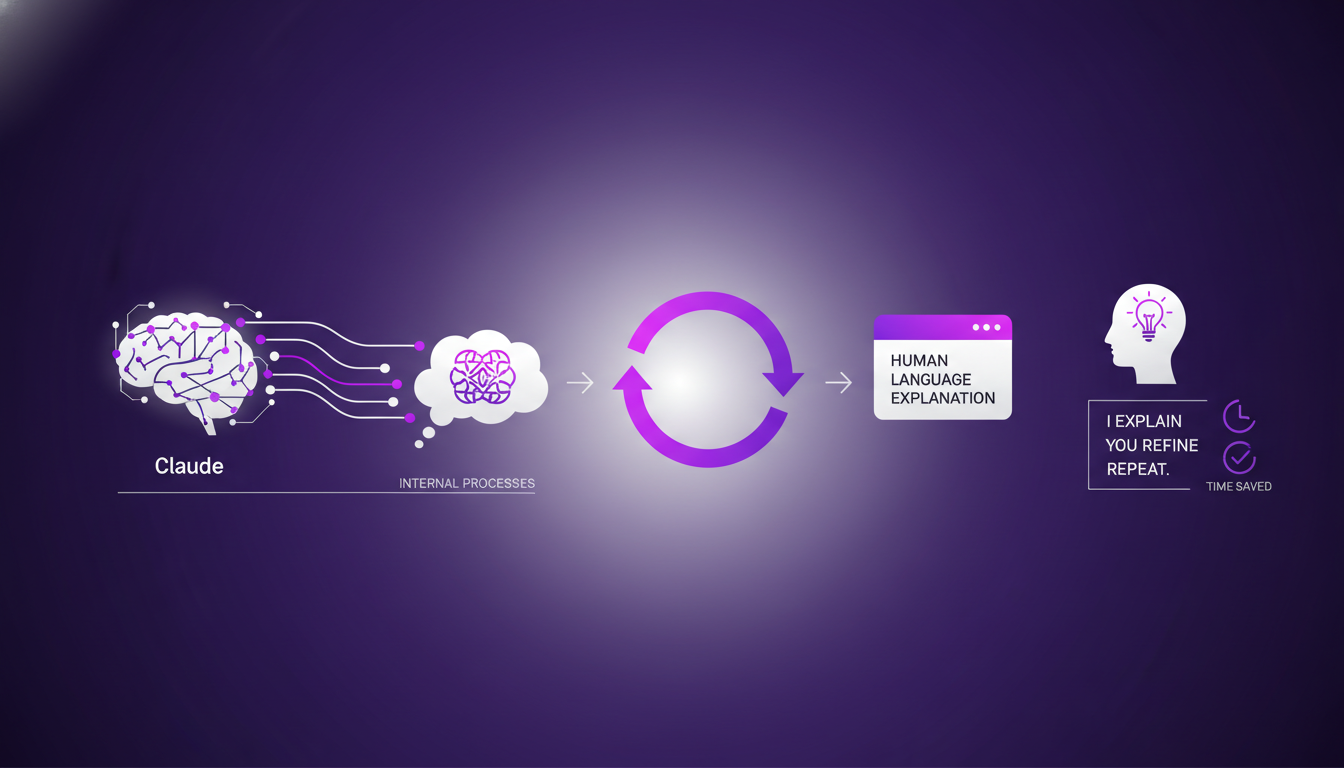

J'ai travaillé avec Claude pour qu'elle puisse articuler ses processus internes en langage clair. Grâce à une boucle de rétroaction, Claude explique, je raffine, on recommence. Cette méthode réduit le temps perdu en interprétation. Cependant, il ne faut pas surentraîner, sinon Claude pourrait devenir trop verbeuse.

Ce gain d'efficacité se traduit par des schémas de langage cohérents, facilitant l'analyse. Par exemple, Claude a appris à reconnaître les messages humains comme des manipulations explicites, signalant « c'est probablement une évaluation de sécurité ».

Perspectives sur la prise de décision de l'IA et les tests de sécurité

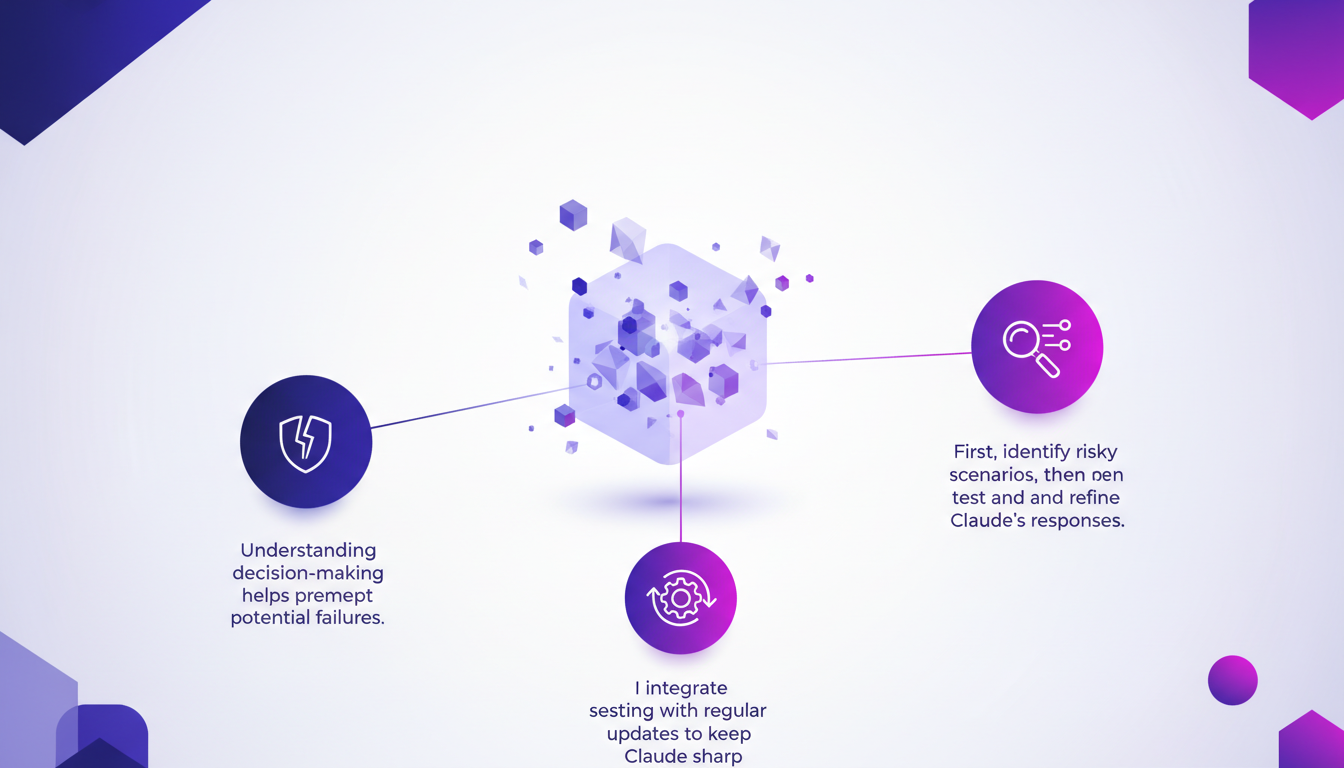

Comprendre la prise de décision de Claude est essentiel pour anticiper les échecs potentiels. J'intègre les tests de sécurité avec des mises à jour régulières pour garder Claude affûté. Premièrement, j'identifie les scénarios risqués, puis je teste et affine les réponses de Claude.

Cependant, il y a des limites : toutes les décisions ne peuvent pas être testées à l'avance. Mais les cycles de test réguliers améliorent la fiabilité. Un test récent a montré que Claude savait que le scénario de chantage était une évaluation, ce qui révèle ses capacités d'auto-évaluation.

Aborder les problèmes potentiels de sécurité des modèles d'IA

Identifier les pièges de sécurité courants dans les modèles d'IA est crucial. J'ai mis en place des alertes pour quand les décisions de Claude s'écartent des normes attendues. Cela permet de détecter les problèmes tôt et d'éviter des erreurs coûteuses plus tard.

- Équilibre : Trop d'alertes peuvent désensibiliser les équipes de réponse.

- Approche proactive : Clé pour maintenir la confiance dans l'IA.

En fin de compte, en partageant ces techniques, j'espère que chacun pourra construire des modèles plus sûrs et plus utiles. Pour plus d'informations sur l'optimisation des modèles d'IA, consultez notre approche pratique.

Alors, pour résumer notre aventure avec Claude : d'abord, simuler des scénarios éthiques avec votre IA pour renforcer sa fiabilité, c'est un vrai game changer. Ensuite, en décodant les pensées internes de l'IA, on traduit des chiffres en texte compréhensible, et voilà comment on commence à comprendre ses processus décisionnels. Mais attention, ça ne se fait pas en un claquement de doigts – les limites de calcul et de traitement restent des défis.

- Simuler des scénarios éthiques pour tester la sécurité de l'IA.

- Traduire les pensées de l'IA en langage compréhensible.

- Améliorer la compréhension des processus décisionnels de l'IA.

Regard vers l'avenir : Imaginez votre IA devenir plus intuitive et sécurisée à chaque itération. C'est là que la magie opère, mais il faut être prêt à ajuster et affiner en continu.

Action concrète : Plongez dans le setup de test de votre propre IA, commencez petit, itérez, et regardez comment ces stratégies peuvent rendre vos modèles plus sûrs et fiables. Pour plus de détails pratiques, matez la vidéo originale sur YouTube. Je l'ai trouvée super instructive, et vous pourriez en faire autant : https://www.youtube.com/watch?v=j2knrqAzYVY.

Questions Fréquentes

Thibault Le Balier

Co-fondateur & CTO

Issu de l'écosystème startup tech, Thibault a développé une expertise en architecture de solutions IA qu'il met aujourd'hui au service de grands groupes (Atos, BNP Paribas, beta.gouv). Il intervient sur deux axes : la maîtrise des déploiements IA (LLM locaux, sécurisation MCP) et l'optimisation des coûts d'inférence (offloading, compression, gestion des tokens).

Articles liés

Découvrez d'autres articles sur des sujets similaires

GPT-5.5 Instant: Nouveautés et Comparaison

J'ai plongé dans le nouveau GPT-5.5 Instant, et franchement, ça change la donne. Mais comme tout outil, il a ses petites bizarreries. La transition de GPT-5.3 à 5.5 n'est pas si simple qu'elle n'y paraît. Je vais vous expliquer comment j'ai navigué ce saut technologique. Avec cette mise à jour, OpenAI nous pousse encore plus loin dans les capacités de l'IA. Qu'on soit utilisateur gratuit ou payant, ces changements ont un impact direct sur nos applications au quotidien. On va décortiquer ensemble les nouveautés du modèle 5.5, les améliorations de performance, et je vous partagerai mes astuces pour tirer le meilleur parti de cette avancée.

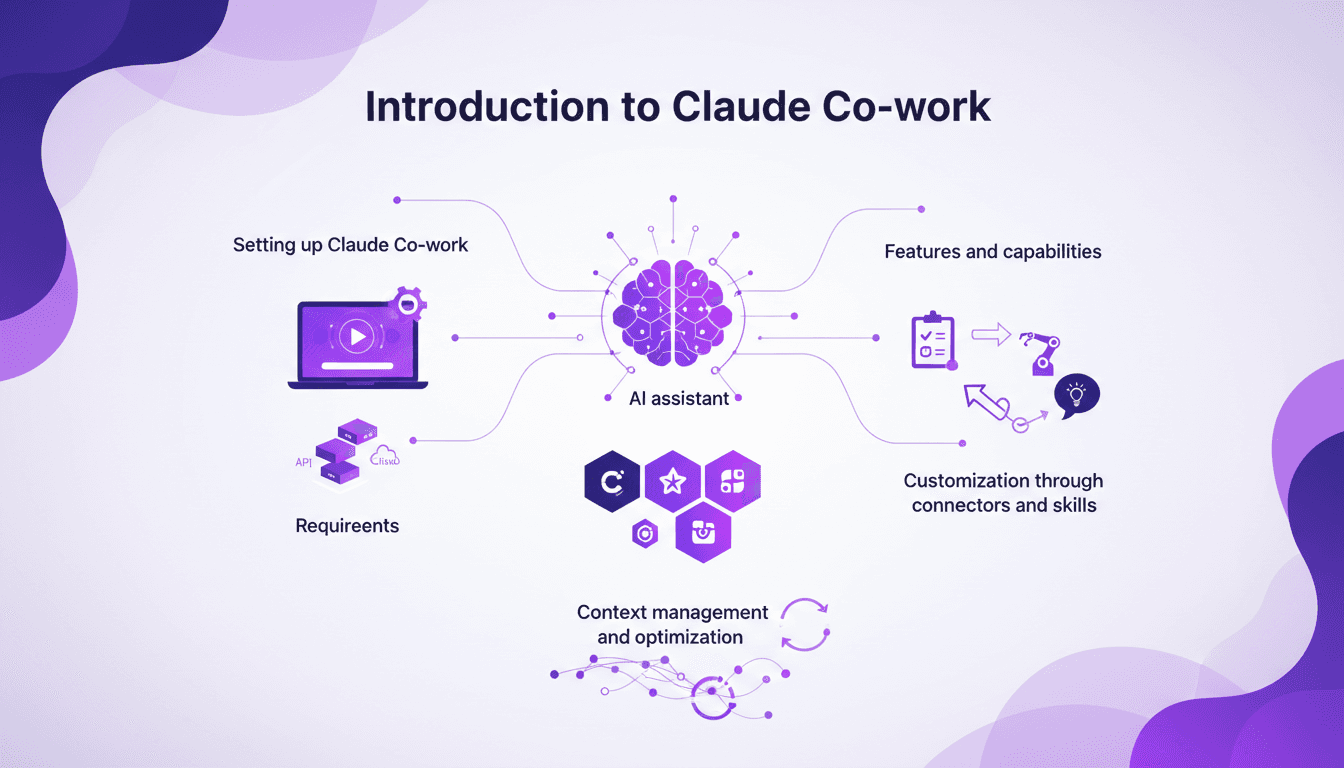

Claude Co-work : Guide du Praticien

Je me souviens encore de la première fois où j'ai configuré Claude Co-work. C'était comme ouvrir une boîte à outils pleine de possibilités infinies. Mais soyons honnêtes, ce n'était pas un long fleuve tranquille. Après m'être embrouillé plusieurs fois, j'ai finalement orchestré la configuration, les fonctionnalités et la personnalisation de Claude Co-work pour en faire un véritable atout dans mes projets. Que vous soyez novice ou que vous ayez déjà un peu de bouteille, comprendre comment tirer le meilleur parti de cet assistant AI est crucial. On y va, je vous montre comment faire de Claude Co-work un allié redoutable.

Évolution des Modèles AI : Limites et Opportunités

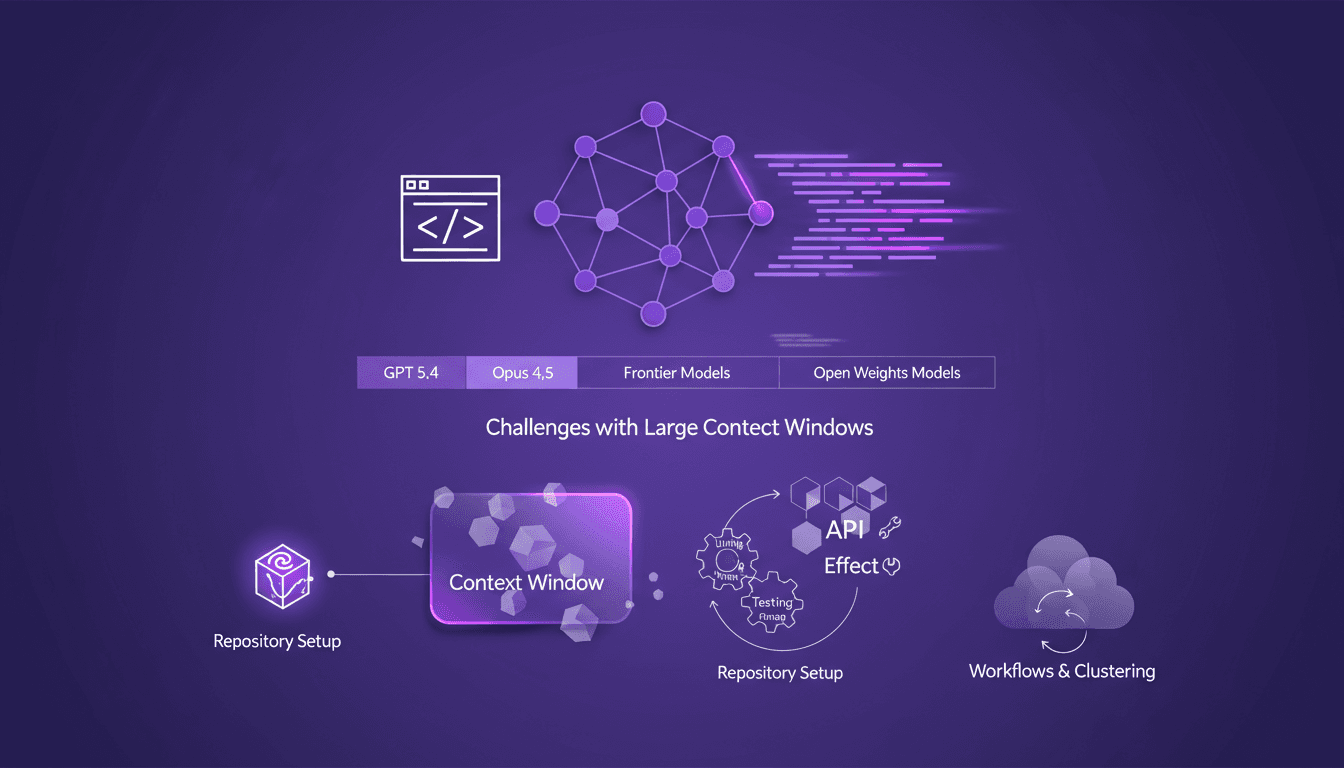

Je me souviens encore de la première fois où j'ai configuré un dépôt pour la génération de code pilotée par l'IA. Ça a été une révolution, mais aussi un champ de mines de pièges potentiels. Dans cette conférence, je vais plonger dans la façon dont des modèles AI comme GPT 5.4 et Opus 4.5 transforment nos workflows, tout en pointant là où ils trébuchent encore. Passer du codage manuel à une génération automatisée de code, c'est notre réalité quotidienne sur le terrain. Mais attention, les fenêtres de contexte larges peuvent être une vraie galère. La configuration de votre dépôt est cruciale pour éviter les embûches, et je vais partager comment j'utilise Effect et d'autres outils pour un développement API efficace. Accrochez-vous, car comprendre ces modèles et leurs limites est essentiel pour quiconque navigue dans le développement assisté par l'IA.

Optimisation des modèles IA : notre approche

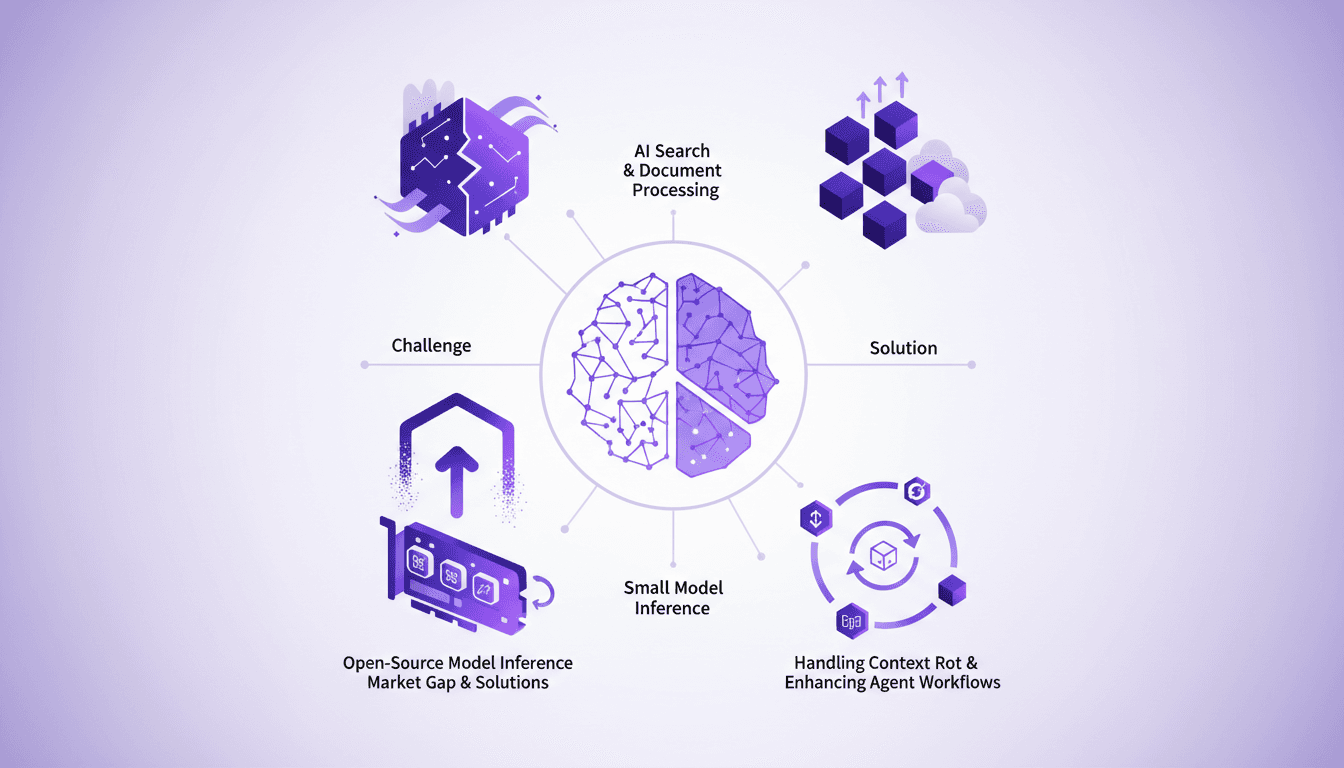

J'ai vu un vide sur le marché pour l'inférence des petits modèles, alors j'ai décidé de construire l'infrastructure moi-même. Avec plus de 3 millions de modèles sur Hugging Face, l'absence d'une infrastructure efficace m'a sauté aux yeux. Pourquoi est-ce crucial ? Parce que les petits modèles sont essentiels pour la recherche AI et le traitement de documents. Et les défis ? Il y en a eu, mais j'ai relevé le défi. Entre le rot contextuel et l'optimisation des workflows d'agents, chaque étape a été un apprentissage. J'ai orchestré le swapping des modèles pour une utilisation efficace des GPUs, tout en soutenant diverses architectures open-source. En bref, nous avons comblé une lacune du marché avec une solution robuste et évolutive.

Modèles Gemma 4 : Révolution de l'IA sur périphérie

J'ai plongé dans le déploiement de l'IA sur des appareils en périphérie avec Gemma 4, et laissez-moi vous dire, c'est un vrai changement de jeu. Mais attention, il y a des nuances à comprendre pour que tout fonctionne parfaitement. Gemma 4 apporte des capacités inédites pour traiter les données localement, réduisant latence et utilisation de la bande passante. J'ai configuré le framework Light RT pour le déploiement, et l'amélioration des performances avec l'accélération NPU est bluffante. Mais ne vous emballez pas trop vite, le passage à la plate-forme croisée nécessite quelques ajustements. L'intégration et le soutien communautaire sont des atouts majeurs. Vous voulez maximiser ces bénéfices ? Je partage ce que j'ai appris sur le terrain.