Modèles audio OpenAI: Intégration en temps réel

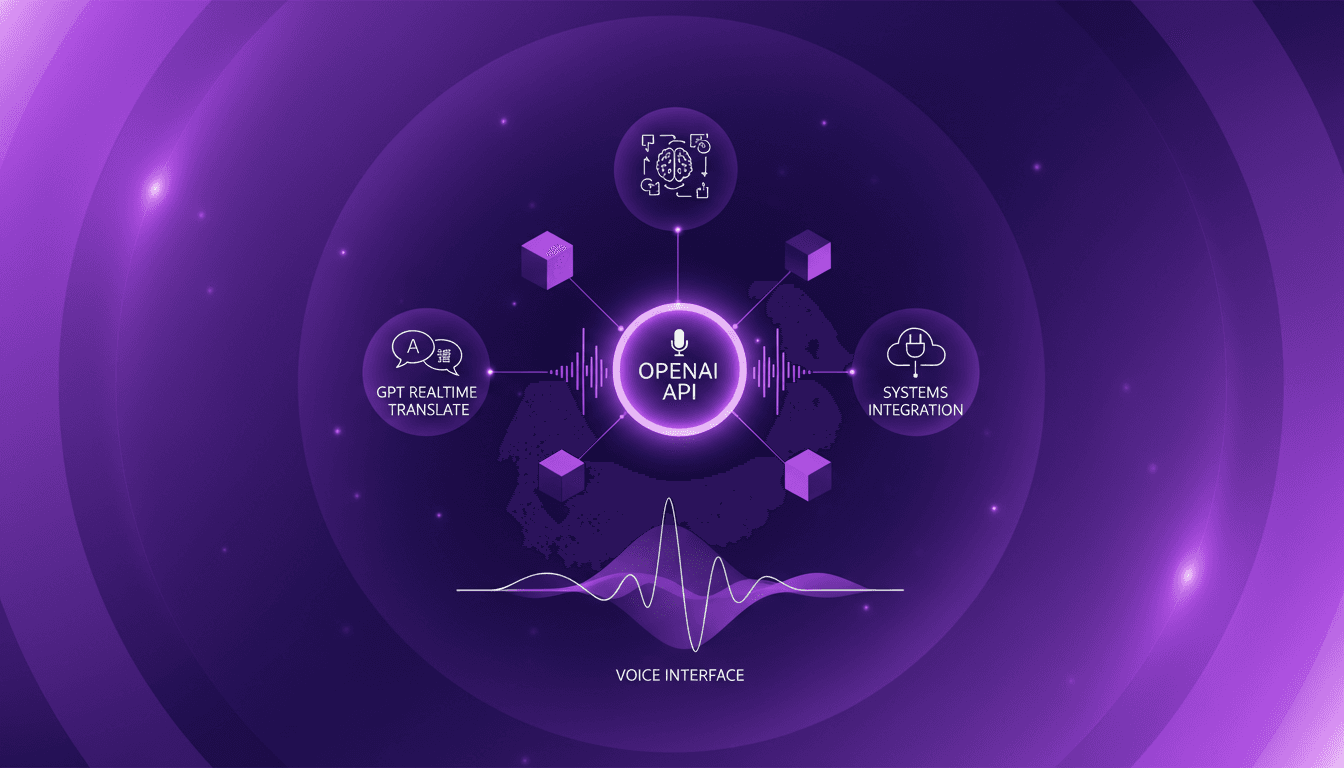

Je me souviens encore de la première fois que j'ai intégré des modèles vocaux dans mon système. C'était le chaos total, mais les résultats ont changé la donne. Aujourd'hui, avec les nouveaux modèles audio en temps réel d'OpenAI, on passe à un niveau complètement différent. Imaginez, traduire en direct dans 70 langues ou utiliser des agents vocaux capables de raisonner intelligemment. Dans cet article, je vais vous montrer comment ces modèles peuvent révolutionner votre workflow. De la traduction en temps réel aux assistants vocaux intelligents, chaque étape d'intégration est cruciale. Attention aux termes techniques et au switch linguistique – ça peut devenir un casse-tête si mal géré. Mais bien orchestré, la voix devient une interface principale d'interaction. Prêt à transformer votre système ? Allons-y !

Je me souviens encore de la première fois que j'ai intégré des modèles vocaux dans mon système. C'était le chaos total, mais les résultats ont vraiment changé la donne. Aujourd'hui, avec les nouveaux modèles audio en temps réel d'OpenAI, on passe à un niveau complètement différent. Imaginez pouvoir traduire instantanément dans 70 langues ou encore utiliser des agents vocaux qui raisonnent en temps réel. C'est exactement ce que ces modèles promettent. Dans cet article, je vous montre comment intégrer ces nouvelles solutions dans votre workflow. D'abord, il y a le modèle GPT Realtime Translate pour les traductions live, puis le modèle GPT Realtime 2 pour un raisonnement intelligent dans les agents vocaux. Attention cependant aux termes techniques et au passage d'une langue à l'autre – c'est un vrai casse-tête si ce n'est pas bien géré. Mais si on orchestre tout ça correctement, la voix devient l'interface principale. Prêt à transformer votre système ? Allons-y, il est temps d'intégrer ces solutions et de voir l'impact direct sur votre business.

Démarrage avec les modèles audio en temps réel

OpenAI a récemment introduit de nouveaux modèles audio en temps réel dans l'API, et ça change vraiment la donne. C'est fascinant de voir comment ces modèles peuvent transformer notre façon de travailler avec l'audio et le langage. Pour commencer, il est crucial de configurer correctement votre environnement d'intégration. J'ai découvert qu'il est essentiel d'avoir une machine avec suffisamment de puissance de traitement, surtout quand on commence à traiter des flux audio en temps réel. Mais attention, cela ne s'arrête pas là. Comprendre ce que ces modèles peuvent vraiment faire est la première étape vers une intégration réussie.

Ce que j'ai trouvé particulièrement impressionnant, c'est la capacité de ces modèles à gérer des termes techniques sans problème, tout en permettant une communication fluide. Mais attention aux premiers défis : la latence peut parfois poser problème si votre réseau n'est pas optimisé. J'ai surmonté cela en ajustant mes réglages de réseau et en utilisant des serveurs plus proches de ma localisation. Pensez-y avant de vous lancer.

- Configurer la puissance de traitement adéquate

- Optimiser le réseau pour réduire la latence

- Comprendre les capacités du modèle pour une intégration fluide

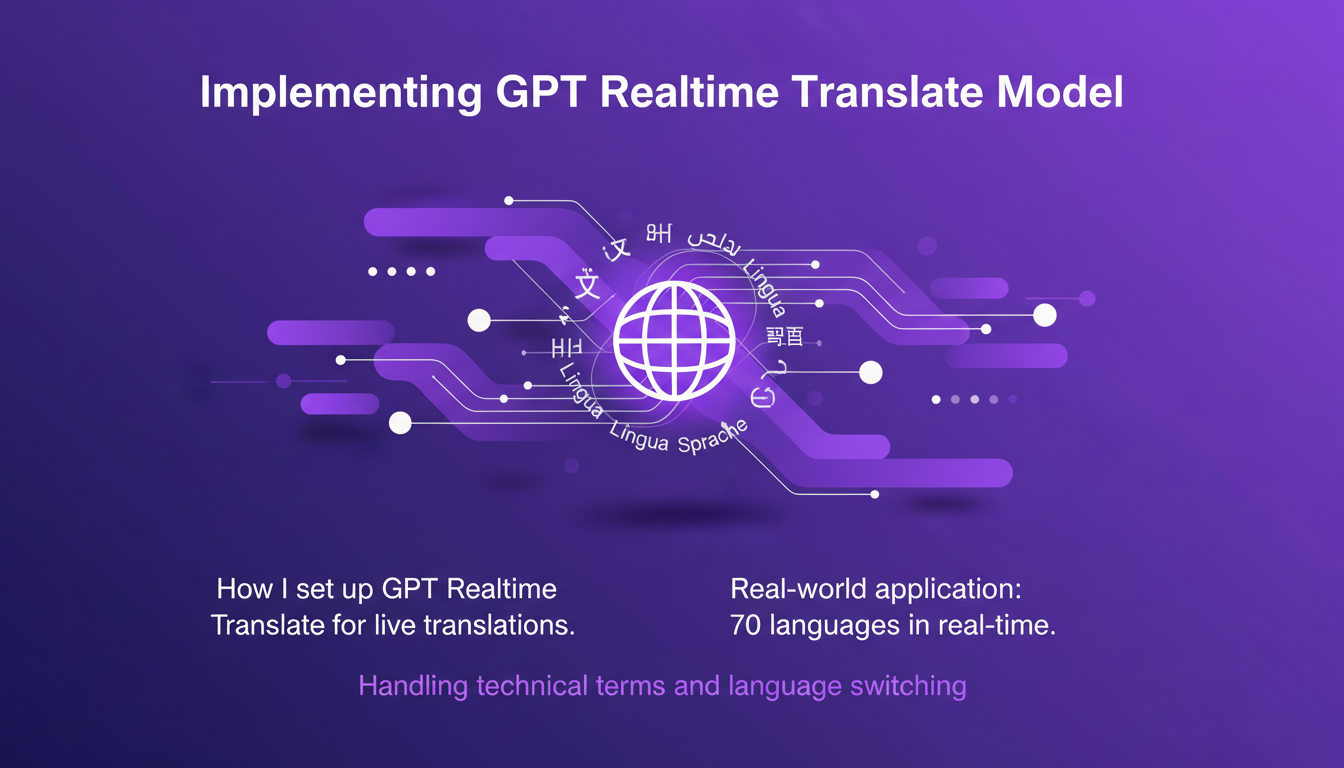

Implémentation du modèle GPT Realtime Translate

Implémenter le modèle GPT Realtime Translate pour des traductions en direct est une expérience unique. J'ai configuré ce modèle pour offrir des traductions instantanées dans 70 langues. Imaginez la portée que cela offre dans des contextes tels que les conférences internationales ou le support client multilingue. Mais attention, changer de langue à la volée nécessite une gestion rigoureuse des termes techniques et du contexte linguistique.

Le modèle peut traduire en direct dans 70 langues, offrant une communication naturelle entre les interlocuteurs.

Ce que j'ai remarqué, c'est que le modèle gère très bien les interruptions et les changements rapides de langue. Cependant, il peut rencontrer des problèmes dans des environnements très bruyants. Pour pallier cela, j'ai intégré des filtres de bruit supplémentaires, ce qui a amélioré considérablement la qualité des traductions.

- Traductions en direct dans 70 langues

- Gestion des termes techniques

- Problèmes potentiels dans les environnements bruyants

Exploiter GPT Realtime 2 pour des agents vocaux intelligents

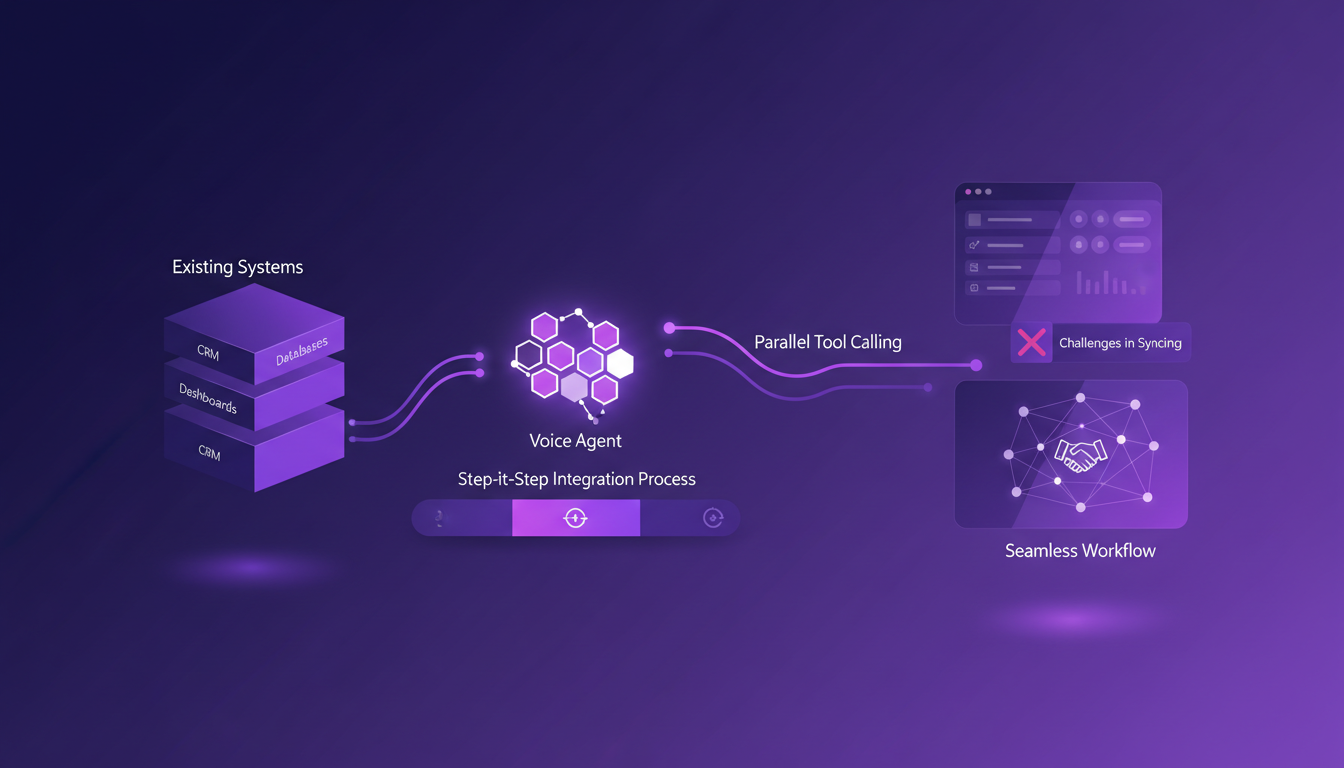

Le modèle GPT Realtime 2 va au-delà des simples commandes vocales. Avec une intégration aux systèmes existants comme les CRM et les tableaux de bord, il apporte un niveau d'interaction utilisateur jamais vu auparavant. Ce modèle permet un raisonnement en temps réel, ce qui améliore considérablement l'interaction avec l'utilisateur. Mais soyons clairs, il y a des compromis à faire entre la puissance de traitement nécessaire et le temps de réponse.

J'ai intégré ce modèle à notre CRM, et la façon dont il peut raisonner et agir en temps réel est impressionnante. Par contre, attendez-vous à des besoins en puissance de calcul élevés, surtout si vous traitez de gros volumes de données. C'est un équilibre à trouver entre performance et rapidité.

- Intégration avec des systèmes existants

- Raisonnement en temps réel pour une meilleure interaction

- Compromis entre puissance de traitement et temps de réponse

Intégration des agents vocaux aux systèmes existants

Intégrer des agents vocaux aux systèmes actuels nécessite une approche méthodique. J'ai commencé par cartographier nos systèmes existants, puis j'ai procédé à une intégration étape par étape. Le principal défi a été de synchroniser les données avec notre CRM et nos tableaux de bord. Cependant, avec une bonne orchestration, cela devient fluide.

La clé est d'utiliser des appels d'outils parallèles pour rendre le processus transparent. Mais attention aux coûts : chaque appel et chaque intégration supplémentaire peut rapidement faire grimper la facture. Cependant, les gains d'efficacité en valent souvent la peine.

- Processus d'intégration étape par étape

- Défis de synchronisation avec le CRM

- Coûts et gains d'efficacité

L'avenir de la voix comme interface principale

Avec ces avancées, la voix est prête à devenir l'interface principale. Ces modèles peuvent remodeler l'interaction utilisateur de manière radicale. Préparer les entreprises à ces avancées est crucial pour rester compétitif. Mais n'oublions pas de trouver l'équilibre entre innovation et mise en œuvre pratique.

Il est fascinant de voir comment ces modèles peuvent non seulement préserver le contexte, mais aussi agir directement au sein des produits que nous utilisons déjà. La voix est sur le point de devenir le canal principal, et c'est excitant de penser à ce que nous pourrons construire avec ces nouveaux modèles.

- Voix comme interface principale

- Remodeler l'interaction utilisateur

- Équilibre entre innovation et mise en œuvre pratique

Alors, après avoir mis en place et intégré les modèles audio en temps réel d'OpenAI, je peux dire qu'on a vraiment franchi un cap dans notre interaction avec la technologie. D'abord, le modèle GPT Realtime Translate est une vraie prouesse : traduire en temps réel dans 70 langues, c'est juste énorme pour les réunions internationales. Ensuite, le modèle GPT Realtime 2 pour les agents vocaux intelligents ajoute une couche de raisonnement qui change le jeu. Mais attention, gérer les termes techniques et les changements de langue peut être piégeux.

Regardez, avec ces modèles, on ne parle plus seulement d'efficacité, mais de transformation radicale. Prêt à transformer votre workflow avec l'intégration vocale ? Commencez à expérimenter ces modèles et observez l'impact par vous-même. Et si vous voulez vraiment comprendre comment tout ça peut s'intégrer dans votre quotidien, je vous recommande de regarder la vidéo complète ici : lien YouTube.

Questions Fréquentes

Thibault Le Balier

Co-fondateur & CTO

Issu de l'écosystème startup tech, Thibault a développé une expertise en architecture de solutions IA qu'il met aujourd'hui au service de grands groupes (Atos, BNP Paribas, beta.gouv). Il intervient sur deux axes : la maîtrise des déploiements IA (LLM locaux, sécurisation MCP) et l'optimisation des coûts d'inférence (offloading, compression, gestion des tokens).

Articles liés

Découvrez d'autres articles sur des sujets similaires

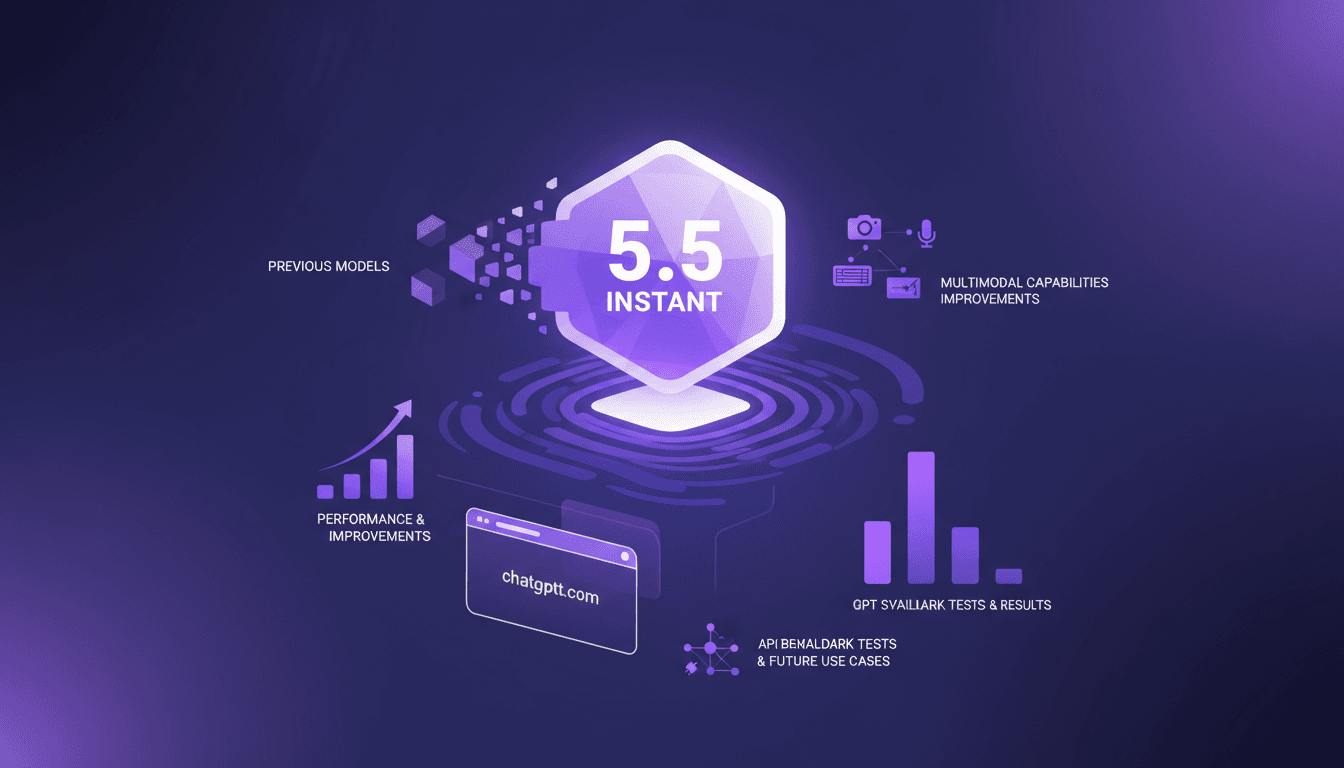

GPT 5.5 Instant : Révolution et Comparaison

Je me suis plongé dans le dernier modèle d'OpenAI, le GPT 5.5 Instant, et ce n'est pas juste une simple mise à jour. C'est un véritable tournant dans le monde de l'IA. Je vais vous expliquer ce que j'ai découvert. Avec ses capacités multimodales et ses améliorations de performance, les promesses sont grandes. Mais comment se compare-t-il vraiment à ses prédécesseurs ? Je vais vous montrer comment il se comporte dans des tests de référence, comment son API pourrait transformer nos cas d'usage futurs, et pourquoi il pourrait bien surpasser le modèle Claude Haiku 4.5. Accrochez-vous, car le voyage est fascinant.

IBM Granite ASR : Configurer et Optimiser

J'ai plongé dans les modèles ASR de la série Granite d'IBM pour voir s'ils sont vraiment rapides comme ils le prétendent. Spoiler : ils sont impressionnants, mais décomposons tout ça. Avec les modèles ASR pilotés par l'IA devenant cruciaux pour les applications en temps réel, la série Granite d'IBM promet rapidité et précision. Mais comment se comportent-ils vraiment dans une configuration pratique ? Je connecte mon environnement, je configure les exigences techniques, et je teste le modèle Granite Speech 4.1. Résultat : un taux d'erreur de mots de 5,33 et une précision de 95 %. Mais attention, il y a des compromis. Configurez correctement ou vous serez déçu. C'est un jeu d'équilibre entre performance et ressources.

GPT-5.5 Instant: Nouveautés et Comparaison

J'ai plongé dans le nouveau GPT-5.5 Instant, et franchement, ça change la donne. Mais comme tout outil, il a ses petites bizarreries. La transition de GPT-5.3 à 5.5 n'est pas si simple qu'elle n'y paraît. Je vais vous expliquer comment j'ai navigué ce saut technologique. Avec cette mise à jour, OpenAI nous pousse encore plus loin dans les capacités de l'IA. Qu'on soit utilisateur gratuit ou payant, ces changements ont un impact direct sur nos applications au quotidien. On va décortiquer ensemble les nouveautés du modèle 5.5, les améliorations de performance, et je vous partagerai mes astuces pour tirer le meilleur parti de cette avancée.

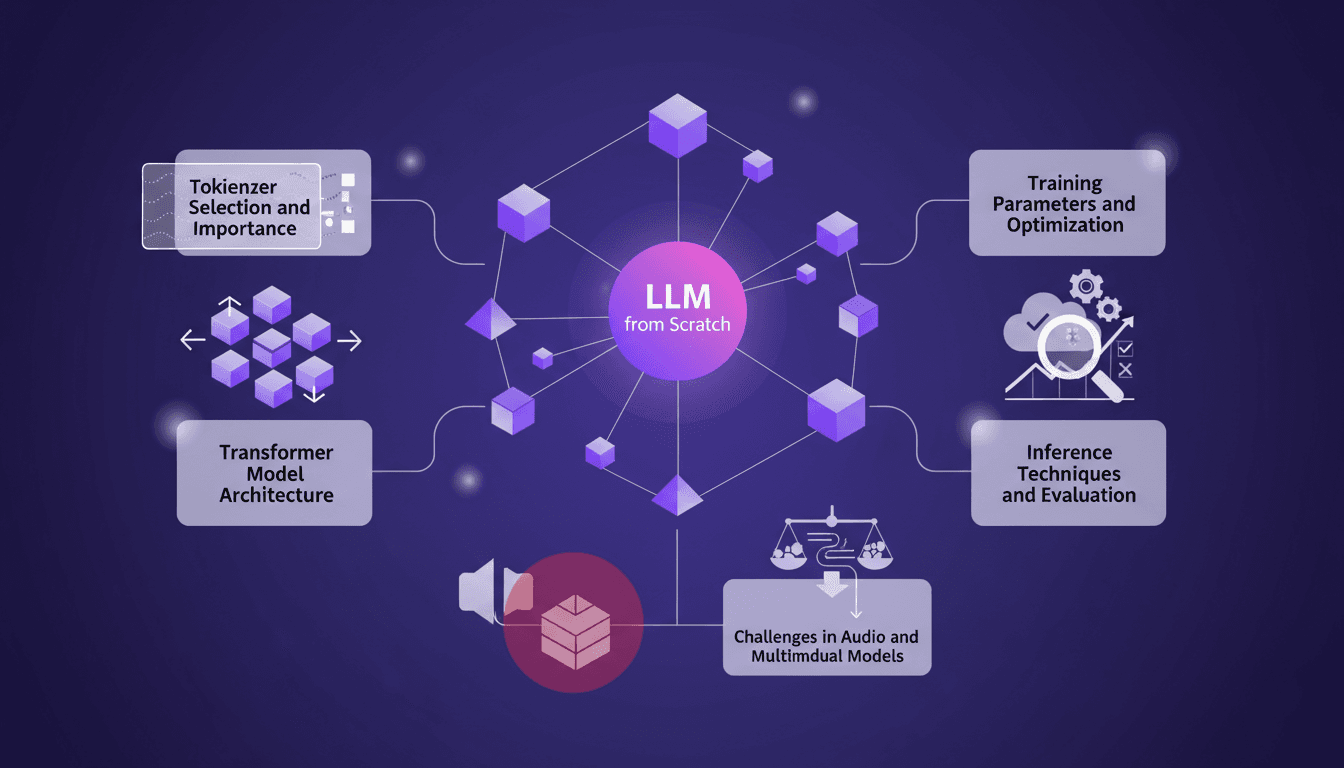

Former un LLM de A à Z : Guide Pratique

Je me souviens de la première fois où j'ai décidé de former un LLM à partir de zéro. C'était comme escalader une montagne sans carte. Mais une fois que vous comprenez les rouages, c'est comme orchestrer une symphonie. Dans ce guide, je vous emmène dans mon aventure pour construire un LLM localement, inspiré par le Nano GPT d'Andre Karpathy. On va plonger dans le choix du tokenizer, l'architecture des modèles Transformers, les paramètres d'entraînement, et bien plus encore. Je partage les erreurs que j'ai faites, les solutions que j'ai trouvées, et comment j'ai optimisé pour l'efficacité. C'est un guide pratique pour ceux qui veulent vraiment comprendre chaque étape du processus sans perdre de temps sur des détails inutiles.

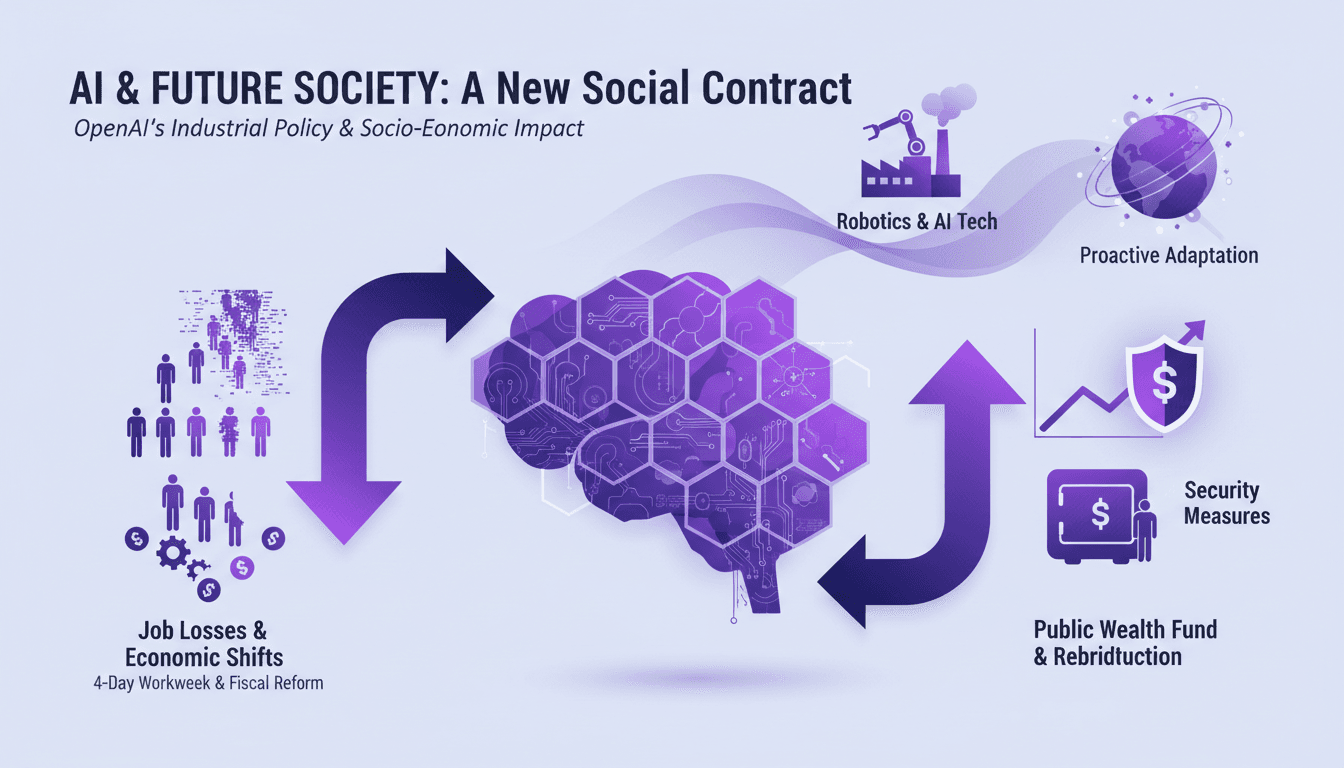

Impact socio-économique de l'IA : Ce qu'il faut savoir

J'ai été dans les tranchées de l'IA, et laissez-moi vous dire, elle remodèle déjà nos industries et nos emplois. C'est du concret, pas juste de la théorie. Aujourd'hui, on plonge dans l'impact socio-économique de l'IA, en particulier du LAGI. On parle de pertes d'emplois, de nouvelles propositions de semaines de travail, et même d'un fonds public pour redistribuer les bénéfices de l'IA. Et si on ne s'adapte pas, on est déjà en retard. Le temps presse—on ne parle pas de 10 ans, mais de mois avant que ces changements ne deviennent notre quotidien. Alors, comment se préparer à cette nouvelle réalité économique ? On explore les politiques d'OpenAI et les mesures de sécurité pour ces modèles avancés, ainsi que les dernières avancées en robotique. Préparez-vous à une discussion franche sur les défis et opportunités que cette technologie nous impose.