GPT 5.5 Instant : Révolution et Comparaison

Je me suis plongé dans le dernier modèle d'OpenAI, le GPT 5.5 Instant, et ce n'est pas juste une simple mise à jour. C'est un véritable tournant dans le monde de l'IA. Je vais vous expliquer ce que j'ai découvert. Avec ses capacités multimodales et ses améliorations de performance, les promesses sont grandes. Mais comment se compare-t-il vraiment à ses prédécesseurs ? Je vais vous montrer comment il se comporte dans des tests de référence, comment son API pourrait transformer nos cas d'usage futurs, et pourquoi il pourrait bien surpasser le modèle Claude Haiku 4.5. Accrochez-vous, car le voyage est fascinant.

J'ai plongé tête la première dans le dernier modèle d'OpenAI, le GPT 5.5 Instant. Et laissez-moi vous dire, ce n'est pas juste une mise à jour de plus. C'est un changement radical, un vrai tournant dans le monde de l'IA. D'abord, j'ai comparé ses capacités multimodales avec celles des anciennes versions, et la différence est flagrante. On parle ici d'une précision de détection d'IA de 98%, ce qui est énorme. Ensuite, j'ai testé son efficacité et sa performance, et les résultats sont impressionnants. Mais attention, il y a des limites - notamment en termes d'accessibilité via chatgptt.com. Je vais aussi vous parler de l'API et de comment elle pourrait bien redéfinir nos futurs cas d'usage. Et pour couronner le tout, on le mettra face au modèle Claude Haiku 4.5. C'est pas juste théorique, je vous raconte ce que j'ai vécu, ce que j'ai testé, et comment j'ai dû orchestrer mes workflows pour tirer le meilleur parti de cette nouvelle version.

Démystifier GPT 5.5 Instant : Quoi de Neuf

Je commence chaque journée en intégrant les dernières avancées technologiques, et GPT 5.5 Instant a immédiatement capté mon attention. C'est un modèle qui promet d'améliorer la raisonnement multimodal de 7 % par rapport aux versions précédentes. Maintenant, ne vous y trompez pas, 7 % peut sembler modeste, mais dans le domaine de l'IA, c'est un bond en avant significatif. L'une des caractéristiques les plus frappantes est son taux de détection IA de 98 %, ce qui signifie que les utilisations pratiques deviennent beaucoup plus fiables.

Dans mes premières interactions, j'ai remarqué que les réponses étaient non seulement plus rapides, mais aussi plus précises. C'est comme si le modèle anticipait mes questions avant même que je les pose. Je me suis retrouvé à tester cette nouvelle version sur chatgptt.com, où elle est disponible gratuitement pour tous les utilisateurs. La différence avec le modèle précédent est frappante. En tant que constructeur, chaque milliseconde compte, et cette rapidité est un gain de temps précieux.

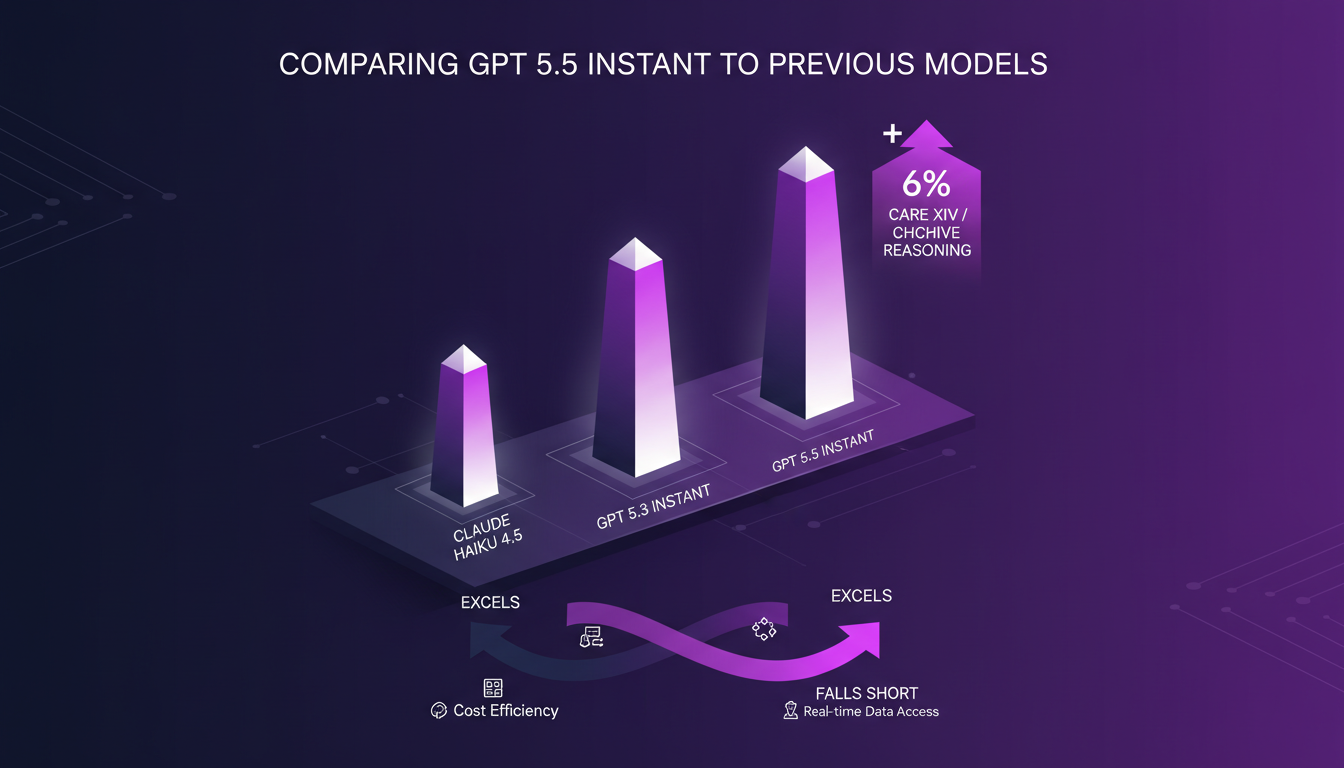

Comparaison de GPT 5.5 Instant avec les Modèles Précédents

Passons maintenant à la comparaison directe. J'ai pris le temps de tester GPT 5.5 Instant face à GPT 5.3 Instant et Claude Haiku 4.5. La première chose que j'ai remarquée, c'est une amélioration de 6 % dans le raisonnement du care XIV ou CH archive. C'est dans ces tâches que GPT 5.5 brille vraiment, mais quelques compromis subsistent.

Alors, où GPT 5.5 excelle-t-il vraiment ? La vitesse et l'intelligence visuelle sont ses points forts. Mais attention, lorsque les tâches deviennent trop complexes, le modèle peut encore trébucher. J'ai découvert que dans certains cas, Claude Haiku 4.5 avait un léger avantage en termes de coût d'utilisation des tokens. En pratique, cela signifie que si votre application nécessite une grande précision sans compromis de coût, GPT 5.5 Instant est votre meilleur choix.

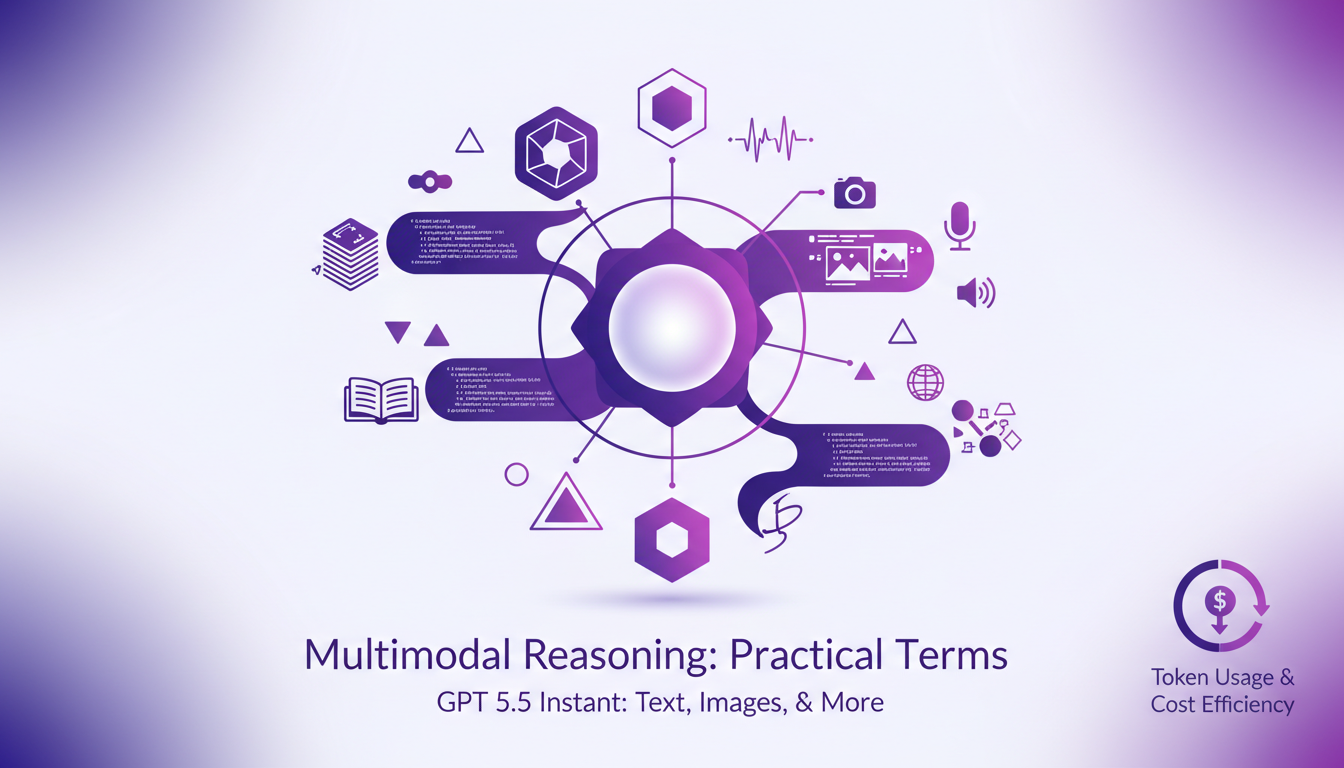

Capacités Multimodales : Le Véritable Potentiel

Parlons des capacités multimodales, un domaine où GPT 5.5 Instant fait vraiment la différence. La possibilité de traiter à la fois le texte et les images est un véritable atout. Imaginez un outil qui peut non seulement lire vos mots mais aussi comprendre vos images. C'est exactement ce que j'ai expérimenté en testant ce modèle.

Mais il y a un hic : l'utilisation des tokens. Bien que le modèle soit plus efficace, les tâches complexes peuvent consommer plus de tokens, ce qui augmente les coûts. J'ai appris à mes dépens que dépasser les limites de contexte peut rapidement conduire à des performances sous-optimales. Alors, utilisez-le judicieusement, surtout pour des tâches lourdes en multimodalité.

Performance et Expérience Utilisateur

En termes de performance, GPT 5.5 Instant ne déçoit pas. J'ai constaté des gains d'efficacité notables grâce à un traitement plus rapide et une latence réduite. En testant sur chatgptt.com, l'amélioration de l'expérience utilisateur est évidente. Les réponses sont non seulement plus rapides mais aussi plus pertinentes.

Les tests de benchmarks confirment ces impressions. Bien que les chiffres soient impressionnants, je reste prudent quant à l'accessibilité. Pour certains, la vitesse et la précision peuvent ne pas justifier le coût accru en tokens. Pourtant, pour ceux qui recherchent une balance entre performance et accessibilité, GPT 5.5 reste une option solide.

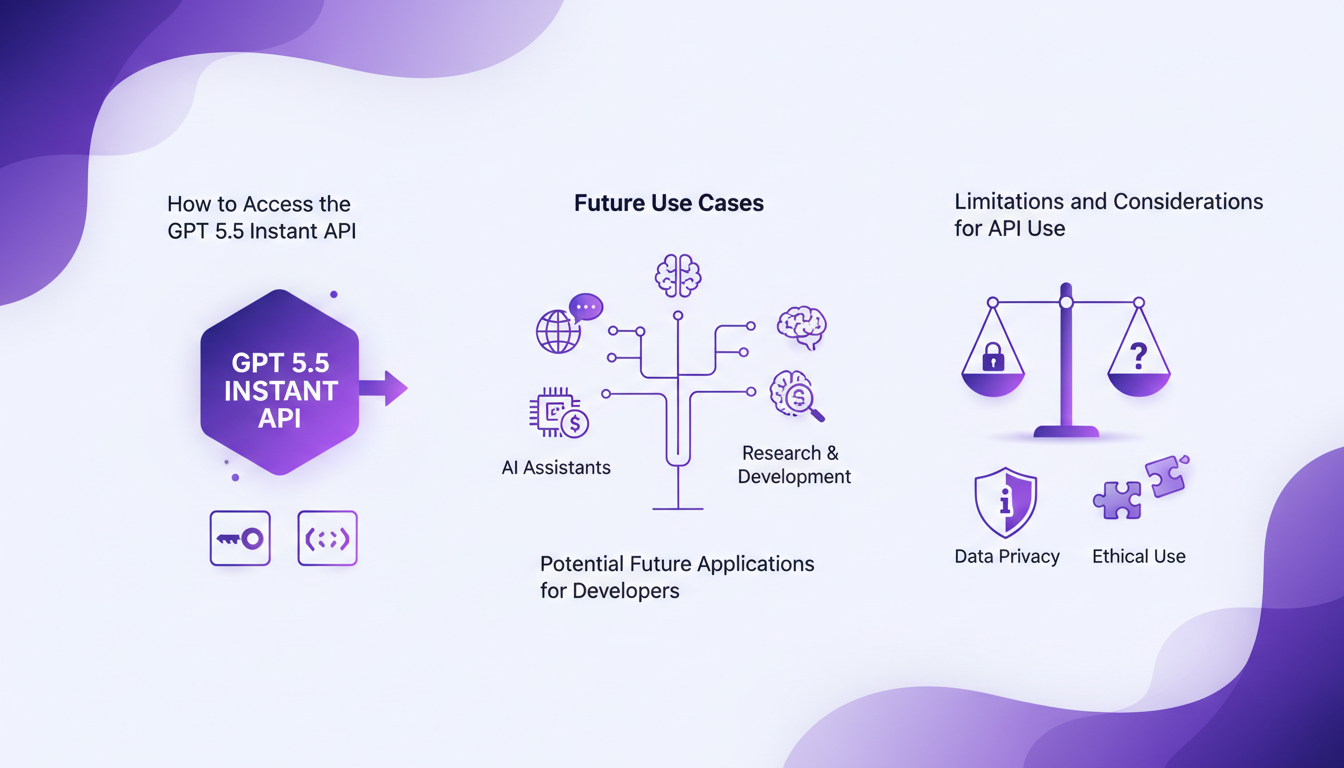

Disponibilité de l'API et Cas d'Utilisation Futurs

Accéder à l'API GPT 5.5 Instant est une opportunité excitante pour les développeurs. Bien que l'API ne soit pas encore disponible, les perspectives d'applications futures sont vastes. Que ce soit pour des intégrations dans des applications existantes ou pour de nouveaux projets innovants, les possibilités sont nombreuses.

Mais attention aux limites. L'utilisation de l'API nécessite une gestion prudente des tokens pour éviter une explosion des coûts. En comparaison avec les offres API actuelles, GPT 5.5 Instant se positionne comme une option robuste pour ceux qui cherchent à tirer parti des dernières avancées en IA.

GPT 5.5 Instant est un véritable bond en avant, mais n'oublions pas qu'il a ses limites comme tout outil. Voici les points clés à retenir :

- Je constate une précision de détection à 98% sur un modèle spécifique, ce qui est énorme pour affiner nos analyses.

- Le modèle GPT 5.5 Instant, avec ses capacités multimodales, simplifie les tâches qui nécessitaient autrefois plusieurs outils distincts.

- En termes d'efficacité, l'amélioration est nette, mais attention aux limites de performance en contexte complexe.

En regardant vers l'avenir, j'ai hâte de voir comment ces nouvelles capacités vont transformer nos workflows quotidiens. C'est un véritable changement de jeu, mais maîtriser ses subtilités est crucial pour éviter les pièges.

Prêt à plonger dans GPT 5.5 Instant ? Rendez-vous sur chatgptt.com pour tester ses capacités aujourd'hui. Et pour une compréhension plus profonde, regarde la vidéo originale sur YouTube. C'est comme discuter avec un collègue qui a déjà exploré le terrain.

Questions Fréquentes

Thibault Le Balier

Co-fondateur & CTO

Issu de l'écosystème startup tech, Thibault a développé une expertise en architecture de solutions IA qu'il met aujourd'hui au service de grands groupes (Atos, BNP Paribas, beta.gouv). Il intervient sur deux axes : la maîtrise des déploiements IA (LLM locaux, sécurisation MCP) et l'optimisation des coûts d'inférence (offloading, compression, gestion des tokens).

Articles liés

Découvrez d'autres articles sur des sujets similaires

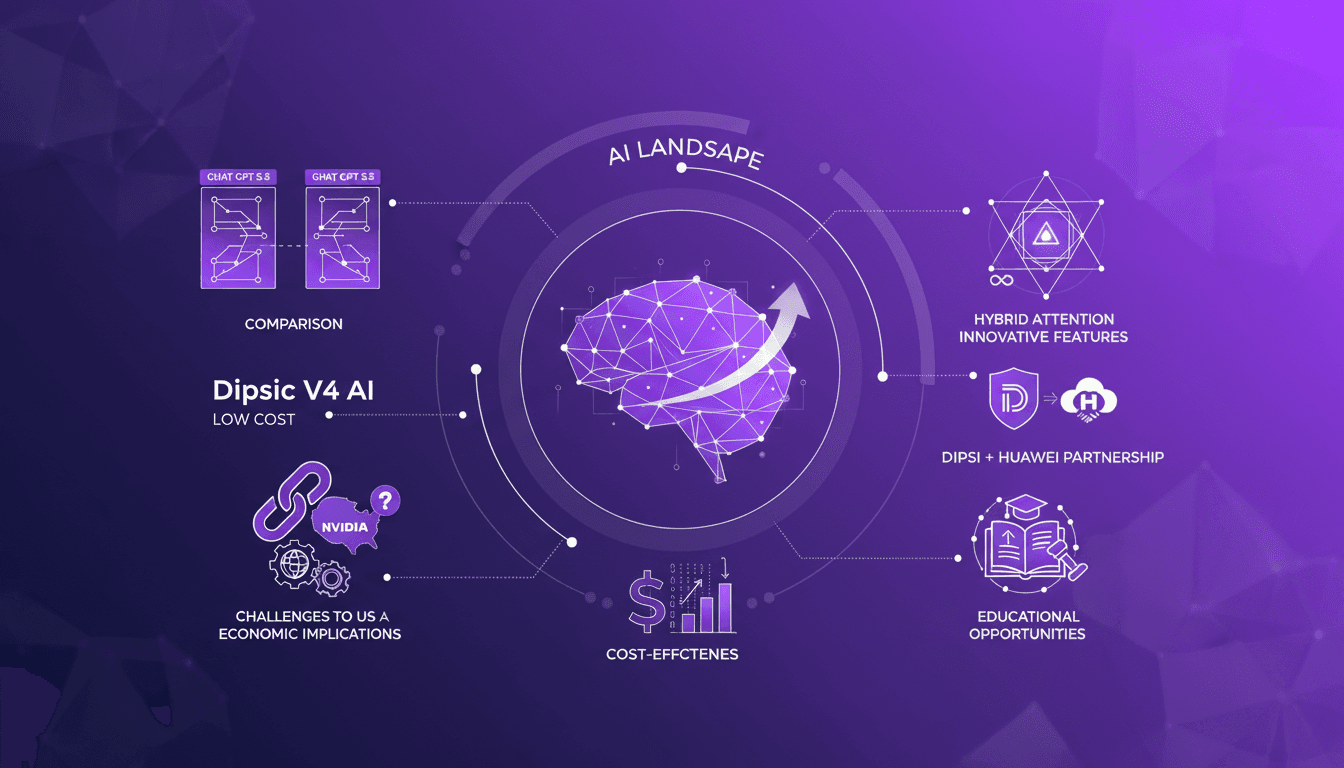

Dipsic V4 : Révolution IA, défis OpenAI

J'ai passé des années dans les tranchées de l'IA, à observer l'évolution des modèles. Mais quand j'ai mis la main sur le Dipsic V4, j'ai su qu'on tenait quelque chose de révolutionnaire. Avec ses 1600 milliards de paramètres, ce modèle n'est pas simplement un autre outil dans le paysage; c'est un potentiel perturbateur face aux géants comme GPT 5.5 d'OpenAI. Je vais vous montrer pourquoi ce modèle fait tant de vagues et comment il redéfinit les règles du jeu. On parlera de ses caractéristiques innovantes, de sa stratégie de prix agressive, et de ce que cela signifie pour des acteurs comme Nvidia et OpenAI. Attention, ça peut changer la donne.

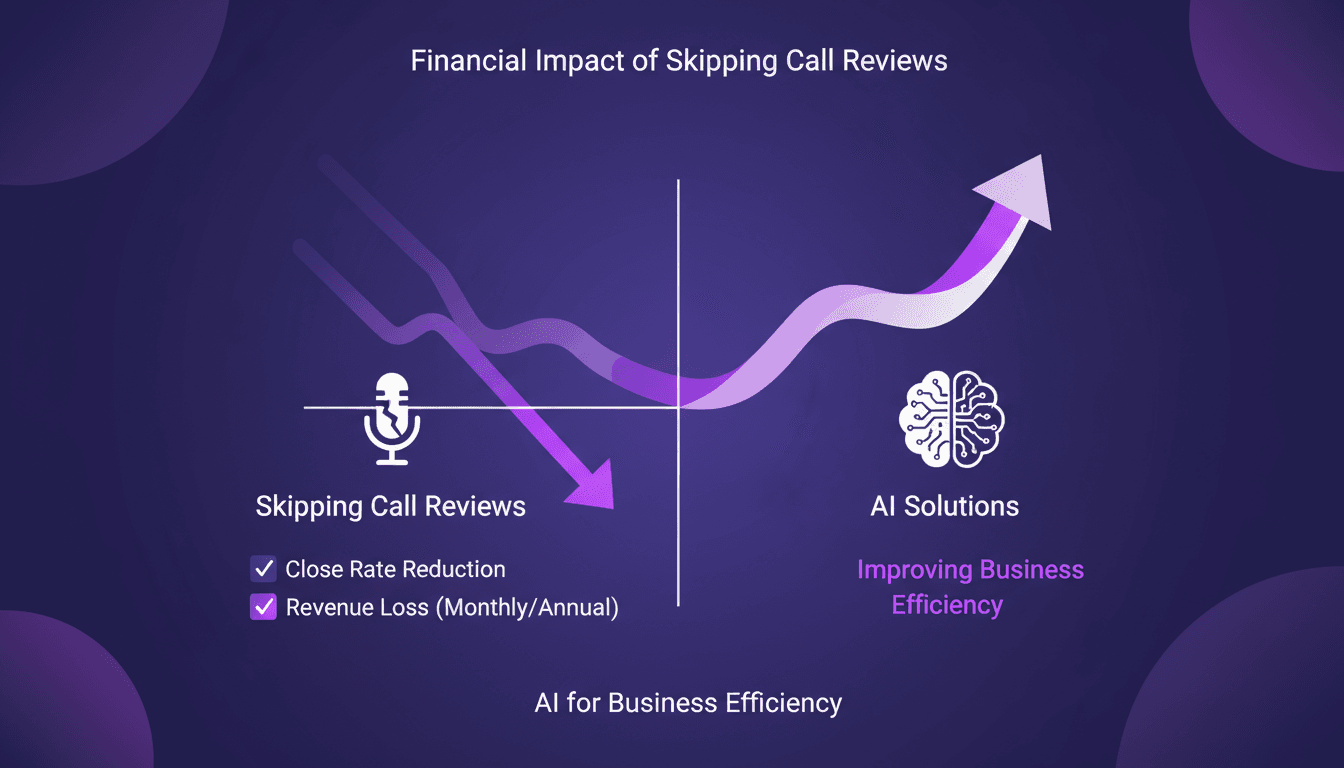

Économiser $360K : l'impact des revues d'appels

J'ai découvert que je perdais 360 000 $ par an sans m'en rendre compte. La cause ? Ignorer les révisions d'appels. Dans le monde rapide de la vente, ces petites négligences peuvent coûter cher. J'ai commencé à utiliser l'IA pour analyser mes appels et améliorer mes taux de fermeture. On parle de solutions concrètes ici, pas de théorie. D'abord, j'ai identifié les lacunes dans mes processus actuels, puis j'ai intégré l'IA pour les combler. Résultat ? Une augmentation directe de l'efficacité et une protection de mes revenus. Attention, ne sous-estimez pas l'impact potentiel de ces outils. Parfois, un ajustement simple peut changer la donne.

Intégrer Codex et Google Calendar pour réunions efficaces

Vous êtes déjà retrouvé en panique avant une réunion de vente, essayant de rassembler les détails clients et de préparer votre présentation à la dernière minute ? Moi aussi, et c'est loin d'être agréable. Mais depuis que j'utilise Codex, ma préparation est devenue un jeu d'enfant. J'intègre Codex avec Google Calendar et Salesforce pour obtenir toutes les infos nécessaires en un clin d'œil. Dans cet article, je vous montre comment je fais, en partageant les workflows et outils que j'utilise au quotidien. Spoiler : les erreurs que j'ai faites vous éviteront bien des maux de tête.

Évolution des ingénieurs logiciels: Rôle clé

J'ai passé assez de temps dans les tranchées du génie logiciel pour voir notre rôle se transformer. D'abord codeurs, puis architectes systèmes, aujourd'hui, nous orchestrons des écosystèmes complexes. L'arrivée des modèles de langage avancés a bouleversé nos flux de travail quotidiens. Quand je configure une architecture, je ne me contente plus d'écrire du code, je conçois des systèmes entiers. Ces modèles ne remplacent pas notre expertise; ils la magnifient. Mais attention, un bon ingénieur reste l'auteur de ses applications, même avec un outil puissant en main. Envie de découvrir comment ces évolutions redéfinissent notre métier? Plongeons ensemble dans cet univers fascinant.

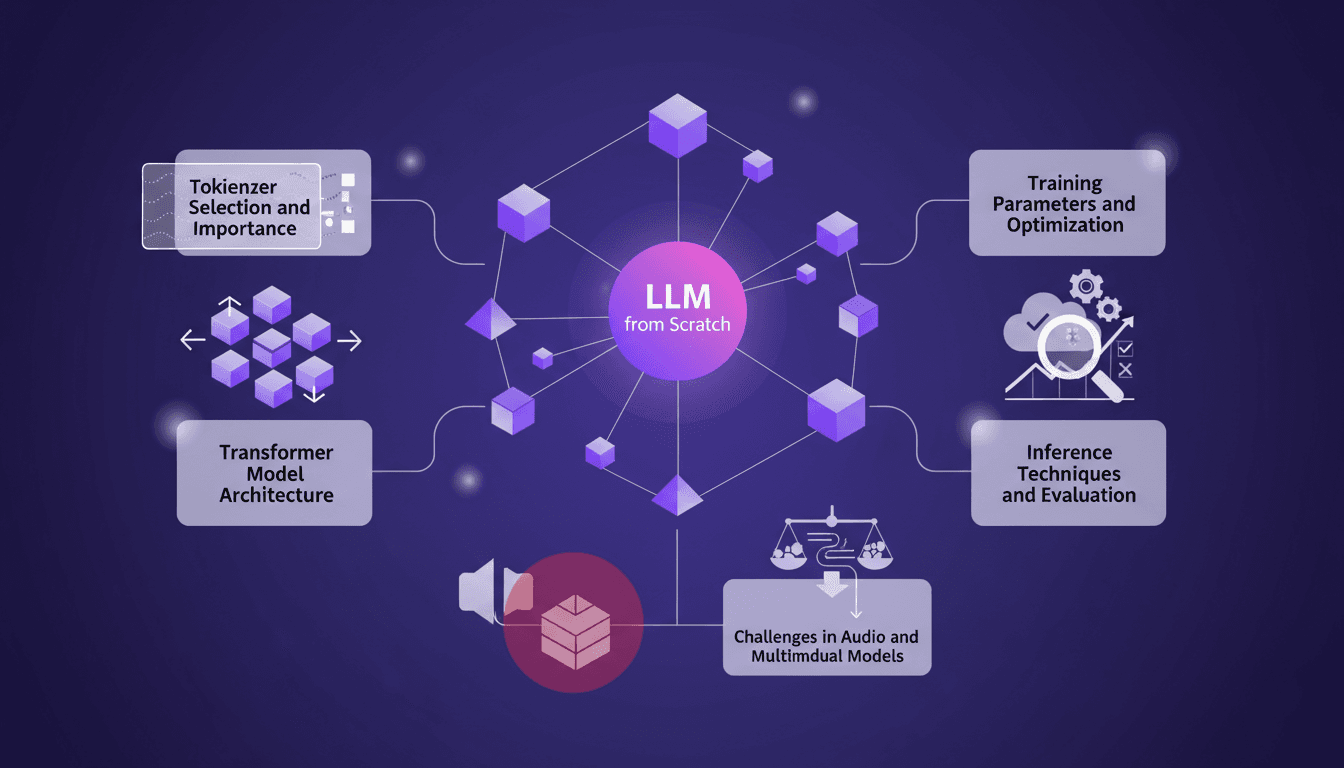

Former un LLM de A à Z : Guide Pratique

Je me souviens de la première fois où j'ai décidé de former un LLM à partir de zéro. C'était comme escalader une montagne sans carte. Mais une fois que vous comprenez les rouages, c'est comme orchestrer une symphonie. Dans ce guide, je vous emmène dans mon aventure pour construire un LLM localement, inspiré par le Nano GPT d'Andre Karpathy. On va plonger dans le choix du tokenizer, l'architecture des modèles Transformers, les paramètres d'entraînement, et bien plus encore. Je partage les erreurs que j'ai faites, les solutions que j'ai trouvées, et comment j'ai optimisé pour l'efficacité. C'est un guide pratique pour ceux qui veulent vraiment comprendre chaque étape du processus sans perdre de temps sur des détails inutiles.