IBM Granite ASR : Configurer et Optimiser

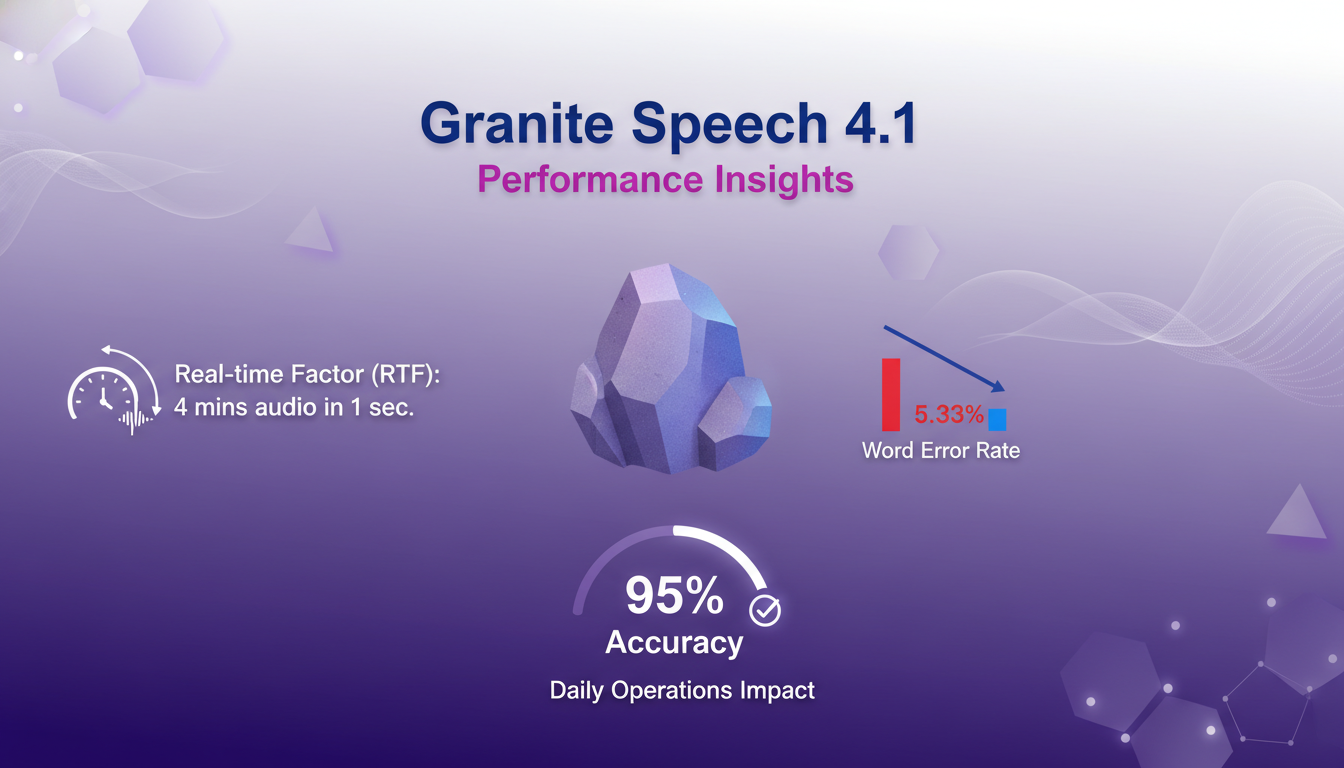

J'ai plongé dans les modèles ASR de la série Granite d'IBM pour voir s'ils sont vraiment rapides comme ils le prétendent. Spoiler : ils sont impressionnants, mais décomposons tout ça. Avec les modèles ASR pilotés par l'IA devenant cruciaux pour les applications en temps réel, la série Granite d'IBM promet rapidité et précision. Mais comment se comportent-ils vraiment dans une configuration pratique ? Je connecte mon environnement, je configure les exigences techniques, et je teste le modèle Granite Speech 4.1. Résultat : un taux d'erreur de mots de 5,33 et une précision de 95 %. Mais attention, il y a des compromis. Configurez correctement ou vous serez déçu. C'est un jeu d'équilibre entre performance et ressources.

Je me suis immergé dans les modèles ASR de la série Granite d'IBM, curieux de voir s'ils tiennent vraiment leurs promesses de vitesse. Et je vous le dis tout de suite : ils sont impressionnants. Mais comme toujours, le diable est dans les détails. Dans un monde où les modèles ASR pilotés par l'IA deviennent essentiels pour les applications en temps réel, la série Granite promet rapidité et précision. Alors, comment ça se passe vraiment une fois en place ? J'ai configuré l'environnement, respecté les exigences techniques, et je me suis lancé avec le modèle Granite Speech 4.1. Avec un taux d'erreur de mots de 5,33 et une précision de 95 %, on est clairement sur du costaud. Par contre, ne vous faites pas piéger : les compromis sont là et il faut les orchestrer intelligemment. Ne négligez pas la configuration initiale, sinon c'est la déception assurée. En optimisant bien, le gain est réel, mais la route n'est pas sans embûches.

Configuration des Modèles ASR Granite d'IBM

En tant que praticien, la première chose que je fais, c'est de connecter mon système à l'API d'IBM pour configurer les modèles ASR Granite. Franchement, c'est là que les choses commencent à se corser. Les modèles font chacun 2 milliards de paramètres, donc assurez-vous que votre système est prêt à encaisser. J'ai dû m'assurer que mes serveurs étaient à jour et suffisamment puissants pour gérer ces mastodontes.

Ensuite, la configuration initiale. Franchement, j'ai perdu des heures à ajuster les réglages pour optimiser les performances. Attention, ne sous-estimez pas la charge de ressource nécessaire — ces modèles sont lourds. J'ai dû revoir mes allocations de CPU et de mémoire plusieurs fois avant de trouver le bon équilibre.

- Connectez-vous à l'API d'IBM et configurez vos paramètres initiaux.

- Assurez-vous que votre infrastructure technique est à la hauteur.

- Surveillez de près l'allocation des ressources.

Granite Speech 4.1 : Aperçus des Performances

Maintenant, parlons du modèle Granite Speech 4.1, qui mène la danse sur le leaderboard open ASR avec un taux d'erreur de mots de 5,33. Ça veut dire 95% de précision. Impressionnant, mais dans le concret, qu'est-ce que ça donne ? Cette précision est cruciale pour les opérations quotidiennes, surtout quand le modèle peut traiter 4 minutes d'audio en une seconde. C'est ce qu'on appelle le facteur temps réel (RTF). Imaginez transcrire une heure d'audio en seulement 16 secondes !

En termes de support multilingue, on parle de sept langues, ce qui est un atout majeur pour des projets globaux. Mais attention, ça reste limité comparé à certains concurrents. Le modèle excelle dans des environnements où la vitesse et la précision sont essentielles.

- Facteur temps réel : 4 minutes d'audio en 1 seconde.

- Taux d'erreur de mots : 5,33.

- Précision : 95%.

- Supporte sept langues.

Exploration des Fonctionnalités du Modèle Plus

Passons au Modèle Plus. Ce modèle ajoute une dimension supplémentaire avec le biais de mots-clés, qui personnalise la reconnaissance. Vous pouvez orienter le modèle pour qu'il reconnaisse mieux certains termes ou acronymes. Parfait pour des secteurs de niche.

La diarisation est une autre fonctionnalité clé, permettant d'identifier précisément les locuteurs. Pour des podcasts ou des réunions, c'est un vrai plus. Mais attention, ces fonctionnalités demandent plus de ressources, donc c'est un équilibre à trouver entre richesse des fonctionnalités et demande de traitement.

- Biais de mots-clés pour personnalisation.

- Diarisation pour identifier les locuteurs.

- Idéal pour transcriptions de podcasts.

- Équilibre entre fonctionnalités et ressources.

Avantages des Modèles Non-Auto Régressifs

Les modèles non-auto régressifs boostent le débit. Grâce à l'NLE (Non-Auto Regressive LLM-based Editing), j'ai pu éditer des transcriptions en un clin d'œil. C'est rapide, mais attention aux compromis en termes de complexité. Souvent, plus c'est rapide, plus c'est complexe à gérer.

Ces modèles brillent dans des scénarios où la rapidité est cruciale, mais où la complexité peut être gérée, comme dans les environnements de forte charge de travail.

- Boost de débit avec les modèles non-auto régressifs.

- NLE pour éditer rapidement les transcriptions.

- Compromis entre vitesse et complexité.

- Idéal pour environnements à forte charge.

Navigation des Compromis et Limitations

Enfin, un mot sur les limitations. Dans des environnements à forte charge, les modèles ASR grands comme ceux-ci peuvent être coûteux. J'ai appris à mes dépens que parfois, il vaut mieux opter pour des modèles plus simples pour gagner en efficacité. Le coût d'exploitation peut vite devenir un facteur limitant si on n'y prend pas garde.

En tirant des leçons de mes erreurs, j'orchestre maintenant mes choix de modèles en fonction du contexte et des besoins réels. C'est une question de balance entre performance et coût.

- Comprendre les limitations en environnement à forte charge.

- Les coûts des modèles ASR grands peuvent être élevés.

- Parfois, optez pour des modèles plus simples pour l'efficacité.

- Leçons tirées de mes propres erreurs.

Pour plus d'informations sur l'évolution des technologies AI, je vous recommande de lire notre article sur GPT 5.5 Instant.

Les modèles ASR Granite d'IBM, c'est du costaud — rapides et précis, ils ont tout pour plaire. Mais attention, il faut bien comprendre comment les configurer et où se situent leurs limites pour en tirer le meilleur parti. Voici ce que j'ai retenu :

- Chaque modèle ASR pèse 2 milliards, un vrai mastodonte, mais ça en vaut la peine pour la précision.

- Le modèle Granite Speech 4.1 affiche un taux d'erreur de mots de 5,33, pas mal du tout !

- Avec un taux de précision de 95 %, ce modèle ne rigole pas.

Cela dit, il faut les utiliser judicieusement pour un impact maximal. Je suis convaincu que ces modèles peuvent transformer notre façon de traiter la reconnaissance vocale. Prêt à plonger dans l'univers des modèles ASR d'IBM ? Allez-y, essayez, et partagez vos expériences. Pour aller plus loin, je vous conseille de regarder la vidéo complète ici : YouTube. Vous verrez, ça vaut le coup !

Questions Fréquentes

Thibault Le Balier

Co-fondateur & CTO

Issu de l'écosystème startup tech, Thibault a développé une expertise en architecture de solutions IA qu'il met aujourd'hui au service de grands groupes (Atos, BNP Paribas, beta.gouv). Il intervient sur deux axes : la maîtrise des déploiements IA (LLM locaux, sécurisation MCP) et l'optimisation des coûts d'inférence (offloading, compression, gestion des tokens).

Articles liés

Découvrez d'autres articles sur des sujets similaires

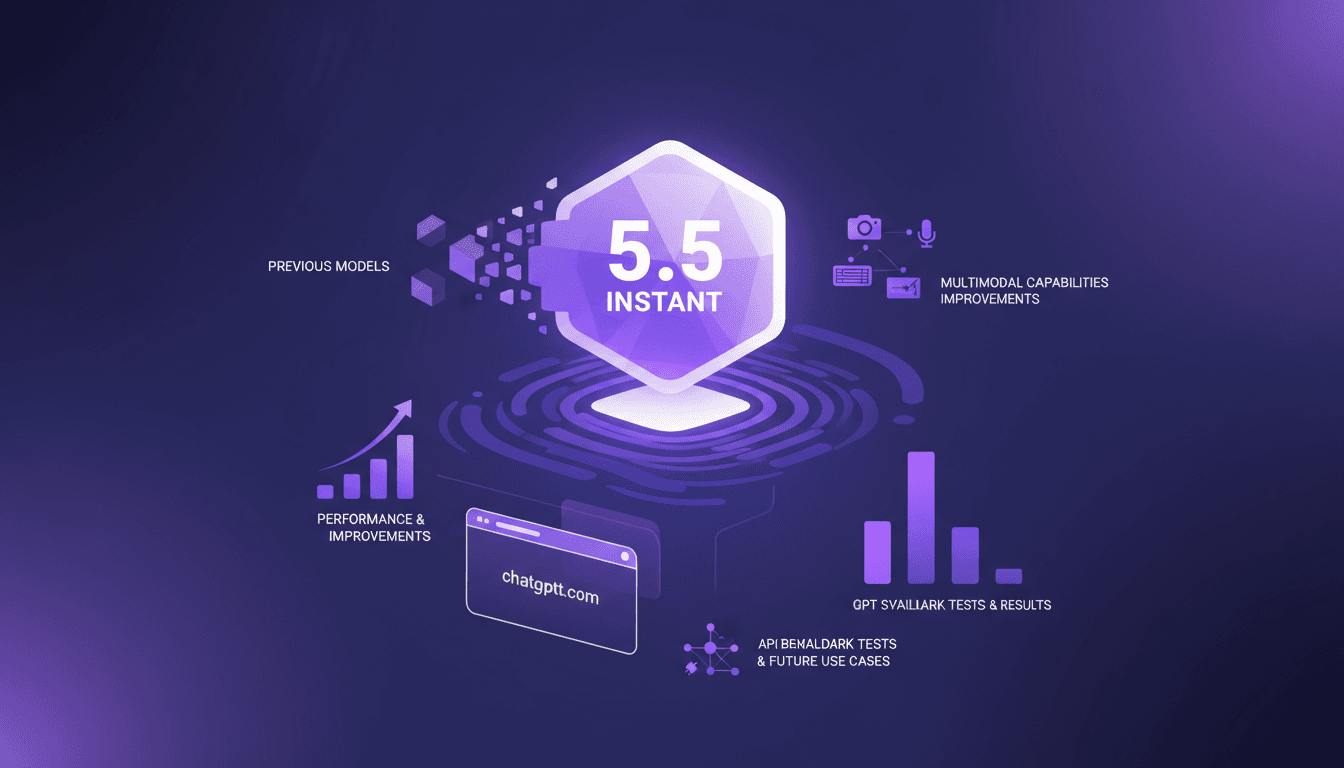

GPT 5.5 Instant : Révolution et Comparaison

Je me suis plongé dans le dernier modèle d'OpenAI, le GPT 5.5 Instant, et ce n'est pas juste une simple mise à jour. C'est un véritable tournant dans le monde de l'IA. Je vais vous expliquer ce que j'ai découvert. Avec ses capacités multimodales et ses améliorations de performance, les promesses sont grandes. Mais comment se compare-t-il vraiment à ses prédécesseurs ? Je vais vous montrer comment il se comporte dans des tests de référence, comment son API pourrait transformer nos cas d'usage futurs, et pourquoi il pourrait bien surpasser le modèle Claude Haiku 4.5. Accrochez-vous, car le voyage est fascinant.

GPT-5.5 Instant: Nouveautés et Comparaison

J'ai plongé dans le nouveau GPT-5.5 Instant, et franchement, ça change la donne. Mais comme tout outil, il a ses petites bizarreries. La transition de GPT-5.3 à 5.5 n'est pas si simple qu'elle n'y paraît. Je vais vous expliquer comment j'ai navigué ce saut technologique. Avec cette mise à jour, OpenAI nous pousse encore plus loin dans les capacités de l'IA. Qu'on soit utilisateur gratuit ou payant, ces changements ont un impact direct sur nos applications au quotidien. On va décortiquer ensemble les nouveautés du modèle 5.5, les améliorations de performance, et je vous partagerai mes astuces pour tirer le meilleur parti de cette avancée.

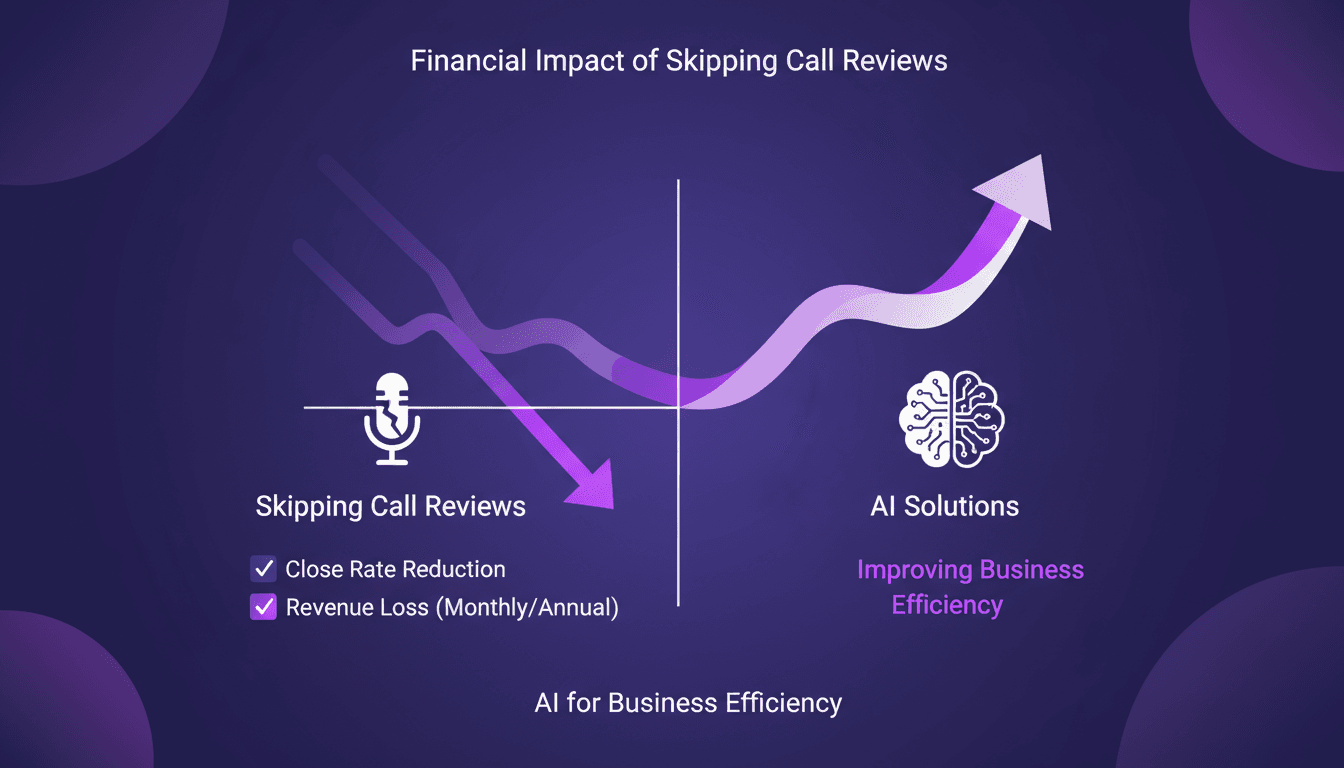

Économiser $360K : l'impact des revues d'appels

J'ai découvert que je perdais 360 000 $ par an sans m'en rendre compte. La cause ? Ignorer les révisions d'appels. Dans le monde rapide de la vente, ces petites négligences peuvent coûter cher. J'ai commencé à utiliser l'IA pour analyser mes appels et améliorer mes taux de fermeture. On parle de solutions concrètes ici, pas de théorie. D'abord, j'ai identifié les lacunes dans mes processus actuels, puis j'ai intégré l'IA pour les combler. Résultat ? Une augmentation directe de l'efficacité et une protection de mes revenus. Attention, ne sous-estimez pas l'impact potentiel de ces outils. Parfois, un ajustement simple peut changer la donne.

Intégrer Codex et Google Calendar pour réunions efficaces

Vous êtes déjà retrouvé en panique avant une réunion de vente, essayant de rassembler les détails clients et de préparer votre présentation à la dernière minute ? Moi aussi, et c'est loin d'être agréable. Mais depuis que j'utilise Codex, ma préparation est devenue un jeu d'enfant. J'intègre Codex avec Google Calendar et Salesforce pour obtenir toutes les infos nécessaires en un clin d'œil. Dans cet article, je vous montre comment je fais, en partageant les workflows et outils que j'utilise au quotidien. Spoiler : les erreurs que j'ai faites vous éviteront bien des maux de tête.

Évolution des ingénieurs logiciels: Rôle clé

J'ai passé assez de temps dans les tranchées du génie logiciel pour voir notre rôle se transformer. D'abord codeurs, puis architectes systèmes, aujourd'hui, nous orchestrons des écosystèmes complexes. L'arrivée des modèles de langage avancés a bouleversé nos flux de travail quotidiens. Quand je configure une architecture, je ne me contente plus d'écrire du code, je conçois des systèmes entiers. Ces modèles ne remplacent pas notre expertise; ils la magnifient. Mais attention, un bon ingénieur reste l'auteur de ses applications, même avec un outil puissant en main. Envie de découvrir comment ces évolutions redéfinissent notre métier? Plongeons ensemble dans cet univers fascinant.