2025 : agents vocaux, comment se préparer

Je me souviens de la première fois où j'ai intégré un agent de chat à une interface vocale. C'était comme donner une âme à mes lignes de code. Avec 2025 désignée comme l'année des agents de chat, il est temps d'exploiter la voix comme un puissant médium. Les agents vocaux transforment les interactions, les rendant plus naturelles et engageantes. Dans cette présentation, je vais expliquer comment se préparer à ce changement, en discutant des avantages de la voix par rapport au texte, comment le produit Voice Engine peut être intégré par les développeurs, et les options d'abstraction plus élevées disponibles. Nous plongeons dans un monde où les interactions homme-machine sont sur le point de devenir aussi naturelles que nos conversations quotidiennes.

Je me souviens encore de cette première fois où j'ai intégré un agent de chat à une interface vocale. C'était comme insuffler une âme à mes lignes de code. Avec l'année 2025 désignée comme celle des agents de chat, il est grand temps d'exploiter la voix comme un médium puissant. On n'est plus dans la science-fiction : les agents vocaux transforment déjà nos interactions, les rendant plus naturelles et engageantes. J'ai expérimenté moi-même les avantages de la voix par rapport au texte—le naturel des échanges est incomparable. Mais attention, réussir cette transition ne se fait pas en un claquement de doigts. Dans cette présentation, je vais vous montrer comment se préparer à ce changement : d'abord, comprendre les options disponibles avec le produit Voice Engine; ensuite, explorer les bundles d'abstraction plus élevés qui facilitent l'intégration des agents vocaux pour les développeurs. Croyez-moi, on est sur le point de franchir un cap où les interactions homme-machine deviennent aussi fluides que nos conversations quotidiennes. Prêts à donner une voix à votre code ?

Pourquoi 2025 est l'année des agents conversationnels

En 2025, les agents conversationnels vont dominer le marché, c'est presque une certitude. J'ai vu tellement de projets passer de simples interfaces de chat à des agents vocaux complets ces dernières années. La voix ajoute une couche de personnalité et d'accessibilité qui manquait souvent aux interactions purement textuelles. Imaginez, avec les technologies Text to Speech (TTS) et Speech to Text (STT) qui mûrissent à une vitesse incroyable, on peut maintenant proposer des interactions dans des milliers de voix et de langues différentes. Cela ouvre des portes insoupçonnées pour atteindre un public mondial.

Ce qui est vraiment fascinant, c'est qu'un simple prompt peut désormais analyser et déployer un agent vocal. Cela a changé la donne pour de nombreuses entreprises, en particulier celles qui veulent intégrer l'AI plus profondément dans leurs applications. C'est comme si tout le monde devait devenir AI-first pour ne pas être dépassé. Mais attention, cette transition ne se fait pas sans défis.

C'est vraiment génial comme outil, mais attention aux limites de contexte — au-delà de 100K tokens, ça devient compliqué.

Voix vs Texte : Les avantages d'une interaction naturelle

Je dois dire que la voix est intrinsèquement plus interactive et engageante que le texte. En tant que développeur, je le vois tout le temps : la communication en temps réel imite mieux une conversation humaine. Cela réduit considérablement la charge cognitive des utilisateurs. Parfois, la voix peut être beaucoup plus efficace pour accomplir des tâches rapides.

Cependant, il y a des compromis à faire. Toutes les situations ne sont pas propices aux interactions vocales. Par exemple, dans des environnements bruyants, le texte peut encore avoir son mot à dire. Mais pour tout ce qui est intégration en temps réel et tâches rapides, la voix est un choix naturel.

- La voix réduit la charge cognitive.

- Idéal pour les tâches rapides et interactives.

- Pas adapté à tous les environnements.

Démarrer avec le moteur vocal

Quand j'ai intégré le Voice Engine dans mon système, j'ai été impressionné par ses capacités. Le modèle V3 est particulièrement performant pour le texte à la parole, et il est incroyablement facile à personnaliser. J'ai pu l'intégrer en quelques étapes simples, en veillant à ne pas trop le personnaliser pour éviter les problèmes de performance.

Ce qui est vraiment pratique, c'est la scalabilité et la simplicité d'utilisation. Mais attention, l'over-customization peut entraîner des problèmes de performance. Il faut trouver le bon équilibre entre personnalisation et efficacité.

- Modèle V3 pour des fonctionnalités avancées.

- Facilité d'intégration et de personnalisation.

- Attention à l'over-customization.

Options pour les développeurs : Intégration vocale

Quand il s'agit d'intégrer des capacités vocales, vous avez principalement deux options : l'intégration via SDK ou des bundles à plus haute abstraction. L'SDK offre plus de contrôle, mais nécessite des connaissances techniques plus approfondies. En revanche, les bundles simplifient le processus, idéaux pour un déploiement rapide.

Personnellement, j'ai choisi mon approche en fonction des besoins spécifiques du projet. Mais attention, trouver le bon équilibre entre contrôle et simplicité peut être délicat.

- SDK pour un contrôle accru.

- Bundles pour une simplicité de déploiement.

- L'équilibre entre contrôle et simplicité est crucial.

Tirer parti des bundles à plus haute abstraction

Les bundles à plus haute abstraction pour les agents vocaux permettent une mise en œuvre rapide sans nécessiter une plongée technique approfondie. J'ai récemment piloté ces bundles dans un projet, et cela a vraiment simplifié l'orchestration des agents avec les LLM et l'appel d'outils.

Cependant, ces solutions peuvent ne pas convenir aux applications très personnalisées ou de niche. Il est crucial de bien évaluer vos besoins avant de choisir cette voie.

- Déploiement rapide et simplifié.

- Orchestration d'agents avec LLMs et appel d'outils.

- Limitations pour les applications très personnalisées.

Les agents vocaux, c'est vraiment le futur de notre interaction avec la technologie. D'ici 2025, on parle déjà de l'année des agents de chat. Pourquoi ? Parce qu'avec des modèles comme V3 pour la synthèse vocale, on peut créer des expériences utilisateur hyper engageantes. Imagine : des milliers de voix et de langues à ta disposition. Mais attention, ne te perds pas dans la multitude d'options — choisis celles qui s'intègrent vraiment dans ton workflow.

- Mets-toi à expérimenter avec l'intégration vocale dès maintenant pour ne pas rater le coche.

- Exploite la puissance du modèle de synthèse vocale V3 et teste différentes voix.

- Garde à l'esprit qu'il y a des limites, surtout en termes de complexité et de coût d'intégration.

Personnellement, je suis convaincu que ces agents vont transformer notre manière de travailler d'ici peu. Alors, pourquoi attendre ? Regarde la vidéo complète de Luke Harries (https://www.youtube.com/watch?v=DCZZ3AJKzuc) pour vraiment plonger dans le sujet. Tu verras, c'est un vrai game changer.

Questions Fréquentes

Thibault Le Balier

Co-fondateur & CTO

Issu de l'écosystème startup tech, Thibault a développé une expertise en architecture de solutions IA qu'il met aujourd'hui au service de grands groupes (Atos, BNP Paribas, beta.gouv). Il intervient sur deux axes : la maîtrise des déploiements IA (LLM locaux, sécurisation MCP) et l'optimisation des coûts d'inférence (offloading, compression, gestion des tokens).

Articles liés

Découvrez d'autres articles sur des sujets similaires

Maîtriser les Compétences IA à Grande Échelle

J'ai été dans les tranchées, à construire des workflows IA qui ne se contentent pas de fonctionner, mais qui s'échelonnent vraiment. Parlons des compétences en IA, ces unités de travail discrètes qui changent la donne si vous savez les gérer correctement. Dans un monde où l'IA bouleverse les industries, comprendre comment développer, gérer et partager efficacement ces compétences est vital. Ce n'est pas de la théorie, c'est de l'application concrète. Nick Nisi et Zack Proser de WorkOS explorent la structure et les composants des compétences, la gestion du contexte et du score de confiance, et comment les partager au sein des équipes. Si vous êtes fatigué des discours creux et que vous voulez des outils qui fonctionnent au quotidien, c’est ici que ça se passe.

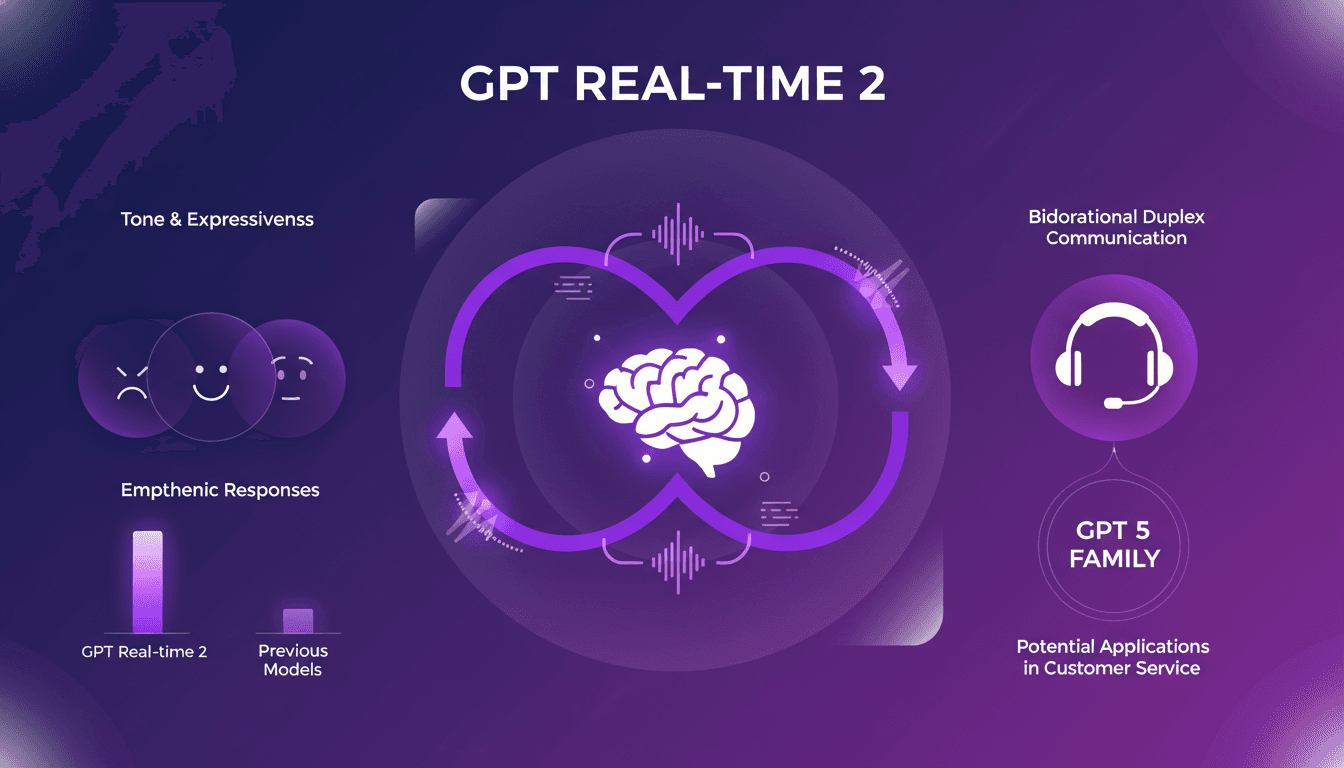

GPT Realtime-2 : Révolution pour les agents vocaux

J'ai mis les mains sur GPT Realtime-2 et croyez-moi, c'est un vrai game changer pour les agents vocaux. Quand je l'ai intégré pour la première fois, la fluidité et la réactivité m'ont bluffé. Dans ma pratique quotidienne avec les modèles d'IA, je combats les problèmes de latence et de manque d'expressivité. GPT Realtime-2 aborde ces défis de front, et ce n'est pas juste du bruit marketing. Il y a une amélioration notable dans la communication bidirectionnelle et l'expressivité tonale des agents. Les réponses sont plus empathiques, les conversations plus naturelles. Comparé aux modèles précédents, c'est une avancée significative. En service client, les applications potentielles sont énormes. Intégré dans la famille GPT 5, ce modèle redéfinit les limites de ce que les agents vocaux peuvent accomplir.

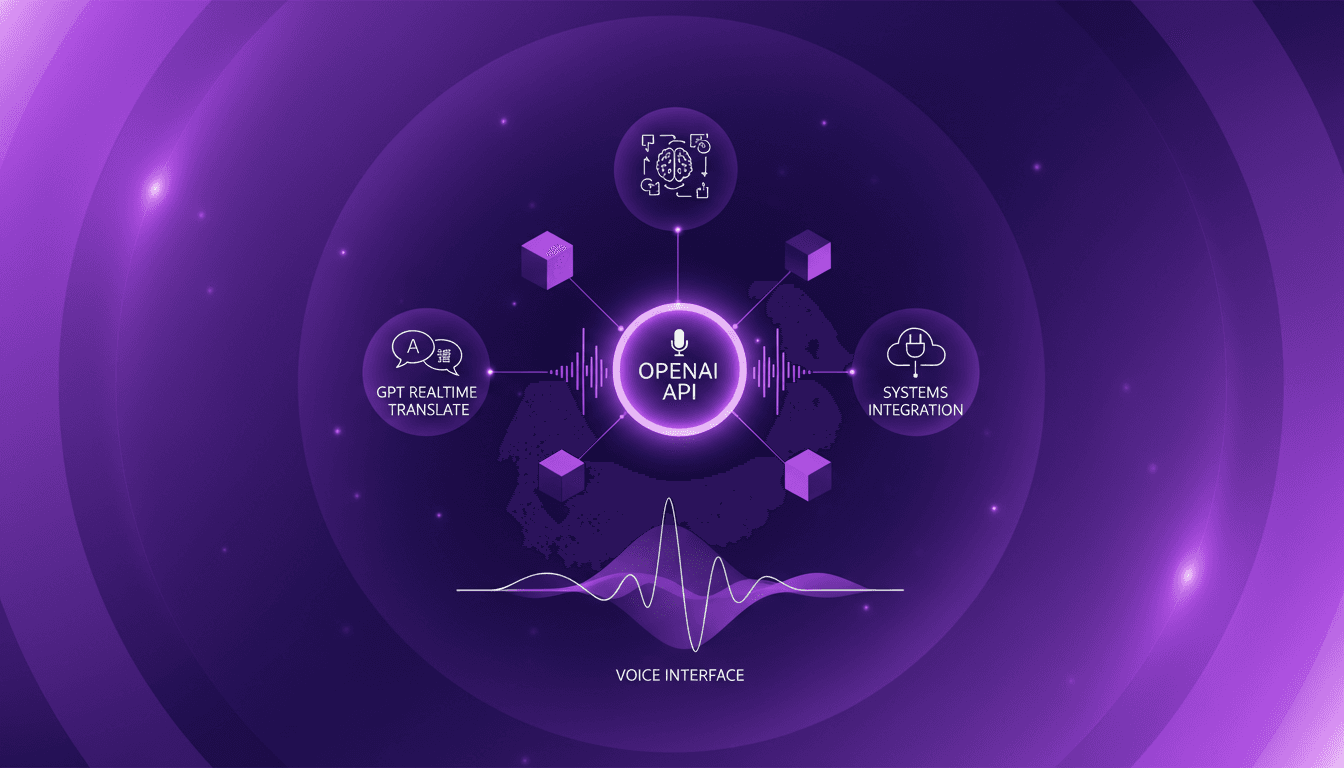

Modèles audio OpenAI: Intégration en temps réel

Je me souviens encore de la première fois que j'ai intégré des modèles vocaux dans mon système. C'était le chaos total, mais les résultats ont changé la donne. Aujourd'hui, avec les nouveaux modèles audio en temps réel d'OpenAI, on passe à un niveau complètement différent. Imaginez, traduire en direct dans 70 langues ou utiliser des agents vocaux capables de raisonner intelligemment. Dans cet article, je vais vous montrer comment ces modèles peuvent révolutionner votre workflow. De la traduction en temps réel aux assistants vocaux intelligents, chaque étape d'intégration est cruciale. Attention aux termes techniques et au switch linguistique – ça peut devenir un casse-tête si mal géré. Mais bien orchestré, la voix devient une interface principale d'interaction. Prêt à transformer votre système ? Allons-y !

Transformers en Vision: Évolution et Défis

Je me souviens de la première fois que j'ai fait le saut des CNNs aux Transformers. C'était comme entrer dans un nouveau monde, plein de potentiel mais aussi de pièges. Ici, je vais vous montrer comment ces modèles ont évolué et ce que cela signifie pour nous, sur le terrain. Les Transformers ont révolutionné les tâches de vision, et comprendre leur évolution et leur application est crucial pour un déploiement efficace. Je vais vous emmener dans mon parcours, soulignant des moments clés et des insights pratiques. Des ViT aux techniques de pré-entraînement, en passant par les modèles Swin et ConvNeXt, jusqu'aux défis de déploiement des modèles de la série SAM, et l'impact des données RF100VL de Roboflow sur la flexibilité des modèles, nous avons beaucoup à couvrir.

Ouvrir un studio de danse: agir maintenant

J'ai moi-même été dans les chaussures de Phil, rêvant en grand tout en hésitant. Quand il s'agit d'ouvrir un studio de danse, il doit agir maintenant, pas demain. J'ai vu de mes propres yeux comment la confiance et la responsabilité peuvent transformer des rêves en réalité. Phil a cette aspiration brûlante, mais sans action, elle restera simplement un souhait. La clé réside dans le fait de transformer ce besoin pressant en moteur de succès, en utilisant l'influence des réseaux sociaux pour attirer le soutien nécessaire. L'urgence d'agir est bien réelle, et cela nécessite une prise de décision rapide. Si vous avez passé quatre ans à rêver, il est temps de passer à l'action.