Sécuriser votre serveur MCP en production

Je me souviens de la première fois que mon serveur MCP a été mis à l'épreuve dans le monde réel - ce fut un désastre. Les tokens fuyaient de partout, et la conformité était un cauchemar. Mais j'ai appris. Aujourd'hui, sécuriser les serveurs MCP ne se limite pas à cocher des cases, c'est littéralement construire une forteresse. Avec la réglementation qui se resserre et les menaces qui évoluent, il est crucial de maîtriser les workflows pour rendre votre serveur MCP robuste et conforme. Parlons conception sécurisée, migration de serveurs locaux à distants, gestion dynamique des clients et des tokens, et bien plus encore. Et croyez-moi, comprendre les spécifications - plus de dix pour un serveur d'autorisation de niveau entreprise - fait toute la différence.

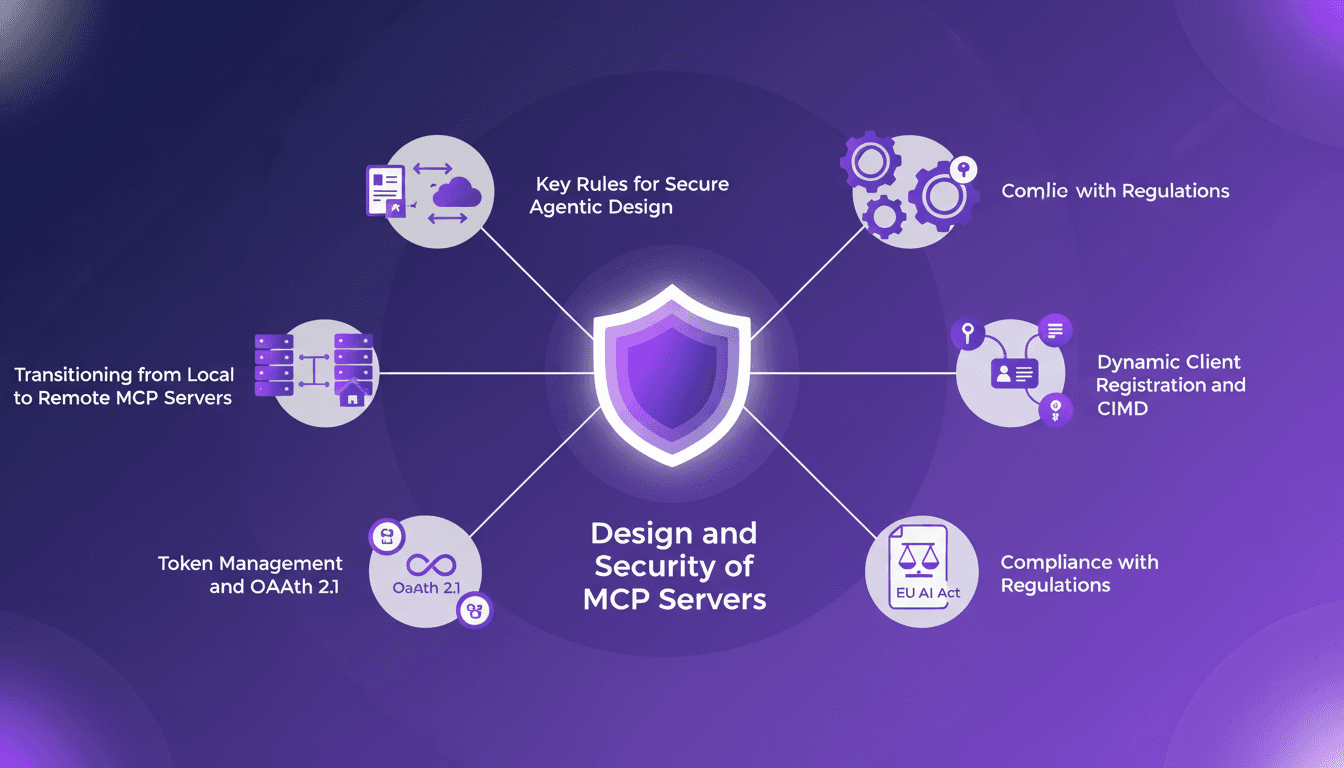

Je me souviens de la première fois que mon serveur MCP a dû affronter le monde réel. C'était un désastre total. Les tokens fuyaient et la conformité était un cauchemar. Mais j'ai appris mes leçons. Dans le paysage actuel, sécuriser un serveur MCP, ce n'est pas juste cocher des cases, c'est littéralement construire une forteresse. Les réglementations se resserrent et les menaces évoluent—il est donc impératif de maîtriser les workflows qui rendent votre serveur MCP robuste et conforme. Première étape : comprendre les spécifications, et il y en a plus de dix à implémenter pour un serveur d'autorisation de niveau entreprise. Ensuite, la transition des serveurs locaux aux serveurs distants est essentielle. Parlons également de l'enregistrement dynamique des clients et du CIMD, de la gestion des tokens et de l'OAuth 2.1, sans oublier la conformité avec des régulations comme le EU AI Act. Chaque étape a son importance et, croyez-moi, comprendre ces éléments fait toute la différence.

Comprendre les serveurs MCP et les bases de la sécurité

Les serveurs MCP, ou Multi-Client Protocol, jouent un rôle crucial dans les infrastructures modernes, en particulier dans les systèmes d'IA agentiques. Ils permettent à plusieurs clients de communiquer simultanément avec un serveur, facilitant ainsi des interactions dynamiques et continues. Pourtant, ces serveurs présentent souvent des failles de sécurité importantes. J'ai moi-même remarqué que 50 % des serveurs MCP utilisent encore des méthodes de sécurité dépassées. C'est énorme et ça peut coûter cher si on ne fait rien.

Une des erreurs courantes dans la conception des serveurs MCP est l'utilisation de credentials à longue durée de vie et non ciblés. Il est essentiel d'aller au-delà de ces pratiques pour garantir la sécurité de nos systèmes. Personnellement, j'ai été brûlé par cela plusieurs fois avant de comprendre l'importance de concevoir des interfaces optimisées pour les cas d'utilisation spécifiques des agents.

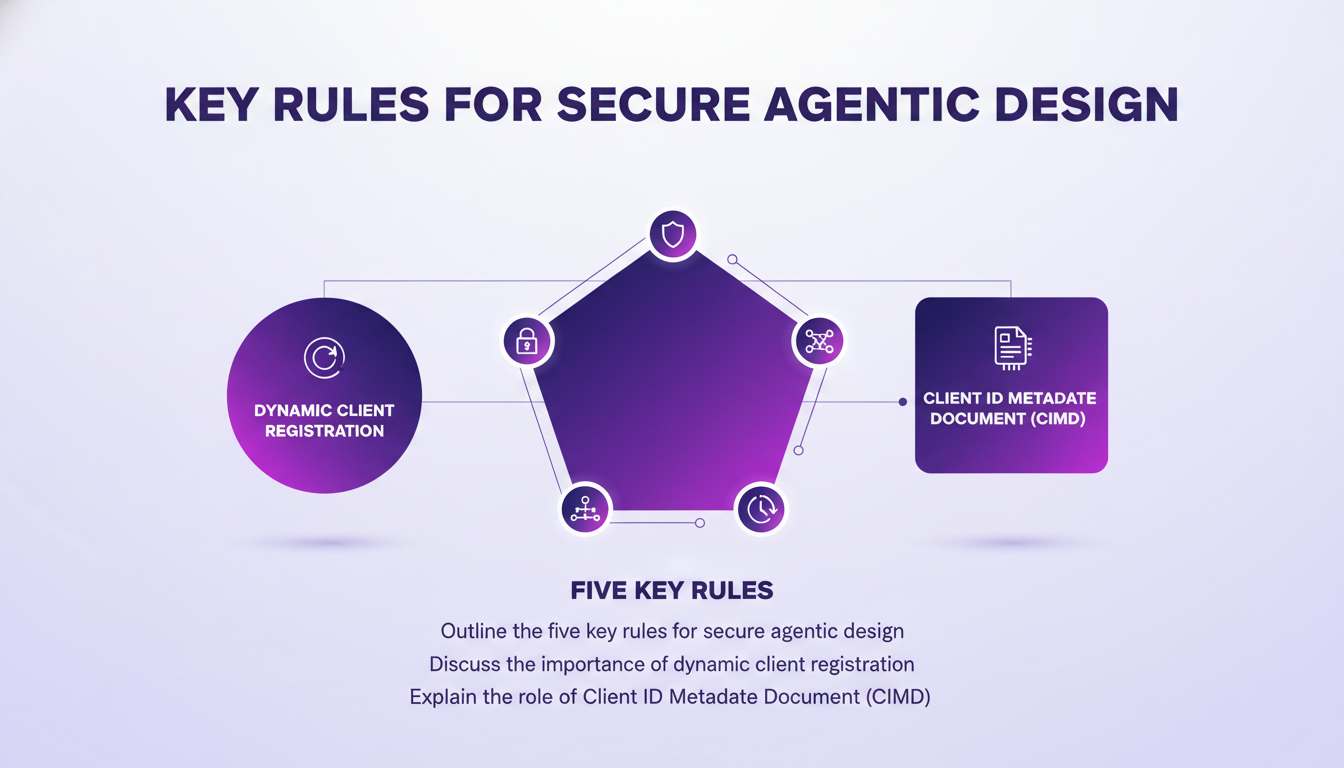

Règles clés pour un design agentique sécurisé

Pour concevoir un serveur MCP sécurisé, il faut suivre cinq règles clés. Premièrement, il est crucial de réduire la surface d'attaque. Cela signifie restreindre l'accès aux fonctions non essentielles. Ensuite, il faut adopter l'enregistrement dynamique des clients, surtout avec une architecture MCP qui implique de nombreux clients et serveurs.

Le Client ID Metadata Document (CIMD) joue ici un rôle crucial, car il aide à gérer efficacement les métadonnées des clients. Cependant, gérer 200,000 tokens peut être un véritable défi. C'est là que j'ai appris à orchestrer les processus différemment pour éviter les surcharges inutiles.

- Réduire la surface d'attaque

- Adopter l'enregistrement dynamique des clients

- Utiliser le CIMD pour la gestion des métadonnées

- Contrainte des entrées au niveau du schéma

- Traiter la documentation comme une couche défensive

Transition des serveurs MCP locaux vers distants

Passer d'un serveur MCP local à un environnement distant n'est pas une mince affaire. J'ai moi-même rencontré des problèmes où 20 de mes 22 requêtes échouaient avec seulement 20 connexions simultanées. Cela m'a poussé à repenser ma stratégie et à adopter des solutions plus robustes pour gérer la concurrence.

Pour réussir cette transition, il est essentiel de :

- Évaluer la sécurité et la gestion des tokens

- Optimiser les transports HTTP streamables pour la production

- Éviter les transports IO standards qui s'effondrent sous la concurrence

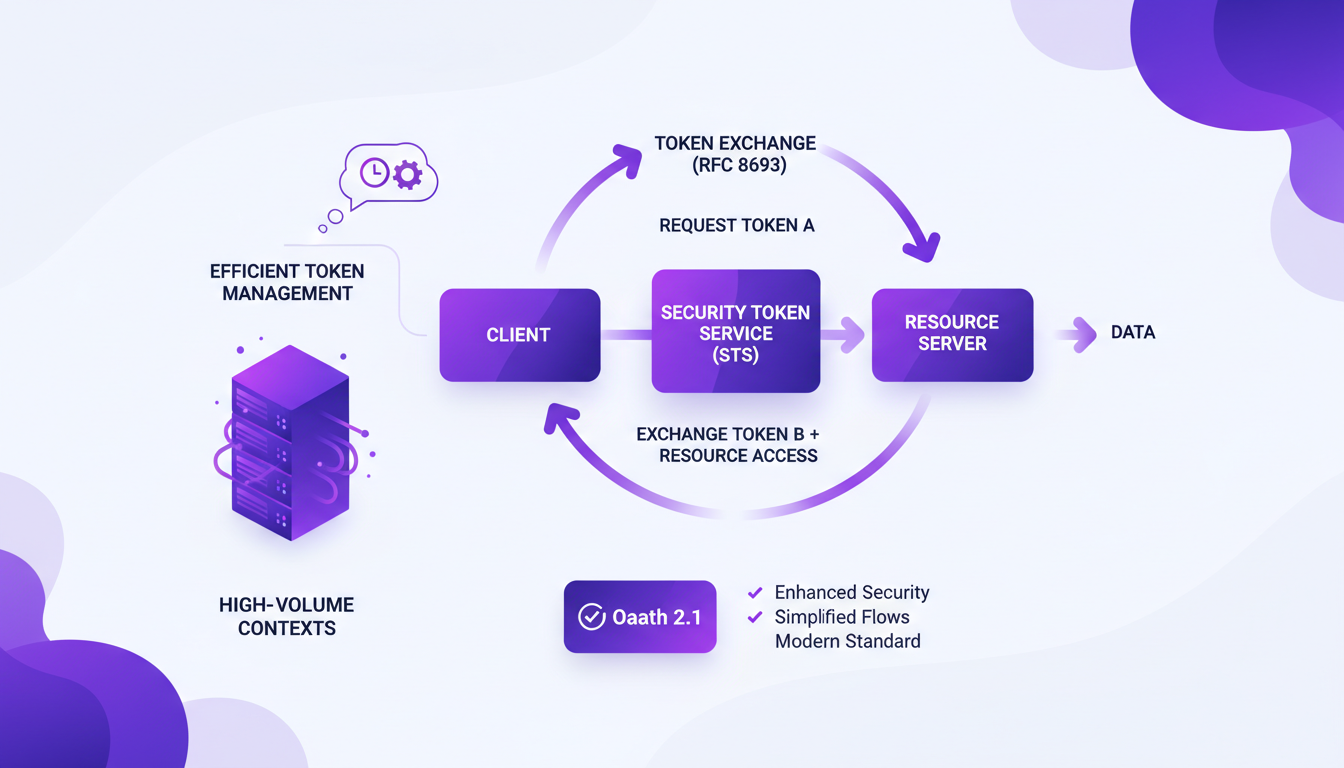

Gestion des tokens et OAuth 2.1

La gestion des tokens est un élément clé pour assurer la sécurité dans les environnements à haut volume. Le flux d'échange de tokens défini par le RFC 8693 est une méthode efficace à mettre en œuvre. En comparaison, OAuth 2.1 offre des avantages significatifs par rapport à l'OAuth traditionnel, notamment en termes de sécurité et de gestion des autorisations.

Dans mes projets, j'ai souvent constaté que plus de 10 spécifications sont nécessaires pour mettre en place un serveur d'autorisation de niveau entreprise pour MCP. Cela peut sembler complexe, mais en orchestrant correctement les processus, on peut atteindre une gestion des tokens efficace et sécurisée.

Assurer la conformité et la sécurité de niveau entreprise

Respecter des réglementations comme le EU AI Act est crucial pour toute entreprise qui souhaite déployer des systèmes MCP sécurisés. Le masquage des données personnelles identifiables (PII) est essentiel pour protéger les informations sensibles.

Pour garantir une sécurité de niveau entreprise, il faut :

- Réaliser des mises à jour de sécurité continues

- Procéder à des audits réguliers

- Adopter des stratégies de masquage de données pour les PII

Sécuriser un serveur MCP, ce n'est pas une mince affaire, mais avec les bonnes stratégies de conception et de gestion, c'est faisable. Je partage quelques points clés :

- Gestion des tokens : J'ai appris que maintenir plus de 200 000 tokens pour un contexte est crucial, mais attention, la gestion doit être solide pour éviter les fuites.

- Conception agentique sécurisée : Il faut implanter plus de dix spécifications pour un serveur d'autorisation de niveau entreprise. J'ai souvent tâtonné avant de trouver la bonne combinaison.

- Transfert vers le MCP distant : La transition de local à distant n'est pas simple; j'ai vu 20 requêtes échouer sur 22 avec seulement 20 connexions simultanées. Regarder vers l'avenir, c'est se préparer à fortifier votre serveur MCP. Les enjeux sont grands, mais les bénéfices le sont aussi. Prêt à renforcer votre serveur MCP ? Commencez à appliquer ces stratégies dès aujourd'hui et évitez les pièges que j'ai rencontrés. Pour une compréhension plus approfondie, regardez la vidéo complète de Tun Shwe. C'est un vrai atout pour tous ceux qui veulent sécuriser efficacement leur infrastructure.

Questions Fréquentes

Thibault Le Balier

Co-fondateur & CTO

Issu de l'écosystème startup tech, Thibault a développé une expertise en architecture de solutions IA qu'il met aujourd'hui au service de grands groupes (Atos, BNP Paribas, beta.gouv). Il intervient sur deux axes : la maîtrise des déploiements IA (LLM locaux, sécurisation MCP) et l'optimisation des coûts d'inférence (offloading, compression, gestion des tokens).

Articles liés

Découvrez d'autres articles sur des sujets similaires

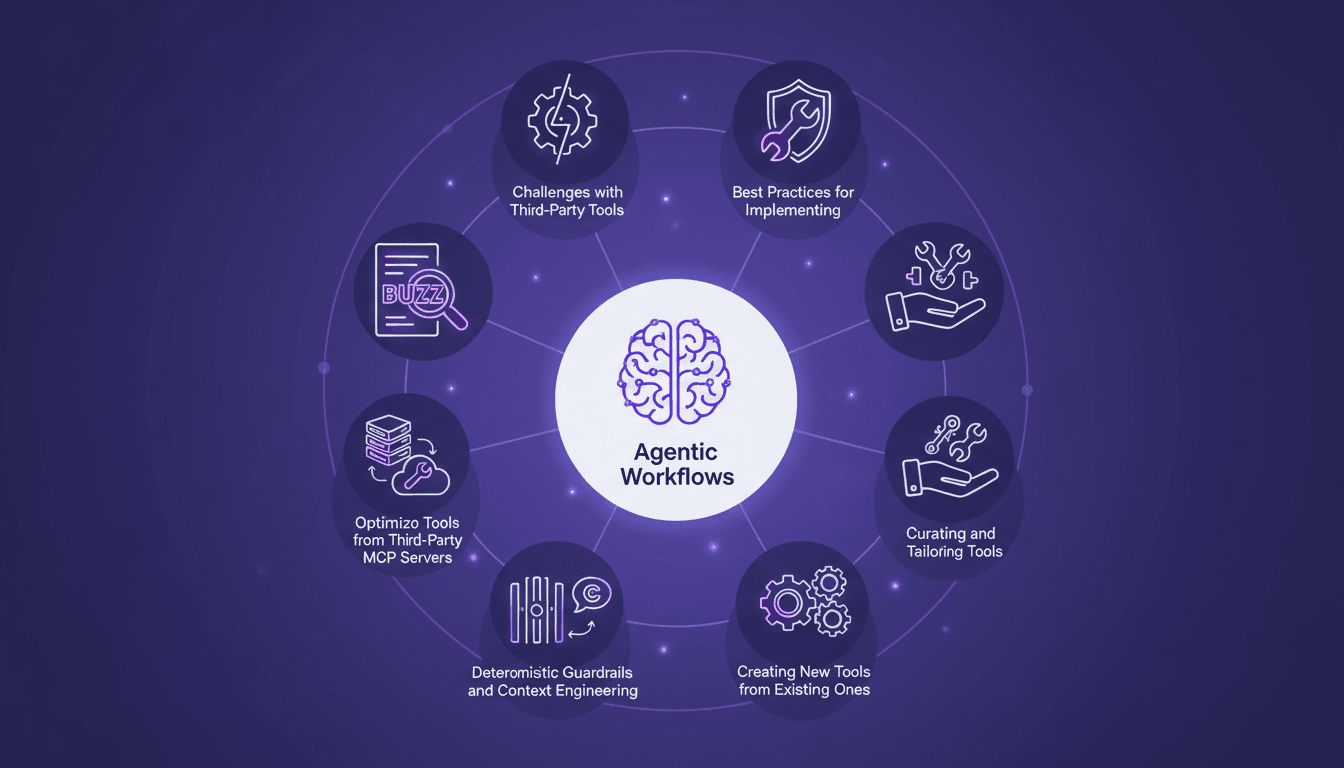

Optimisation des outils tiers: flux de travail agentiques

J'ai passé des années à bidouiller des outils tiers, et crois-moi, les adapter à ton flux de travail sans les casser, c'est tout un art. Quand j'ai commencé avec un serveur MCP public, je me suis fait avoir par les workflows agentiques et les garde-fous déterministes. Mais une fois que tu maîtrises ça, c'est un vrai changement de jeu. Dans cet article, je te montre comment j'ai optimisé les outils à partir de serveurs MCP tiers, avec des conseils pratiques et des applications réelles. Que tu gères des tokens JWT ou que tu adaptes des outils pour des cas d'utilisation spécifiques, je suis là pour t'aider.

Percées en IA : Attention Résiduelle Révolutionne

Je me souviens la première fois que j'ai vu l'impact de l'attention résiduelle sur les modèles d'IA. C'était comme allumer un interrupteur. Tout d'un coup, les inefficacités qui hantaient l'apprentissage profond depuis des années étaient exposées et corrigées. Depuis 2015, les fondations de l'IA n'avaient pas bougé, mais cette percée change la donne. L'attention résiduelle améliore la dégradation du signal dans les réseaux de neurones profonds, rendant les modèles plus efficaces. Comparée aux méthodes traditionnelles, elle offre des performances supérieures sur les benchmarks. Avec l'open-source, l'impact potentiel est immense, surtout dans les laboratoires chinois où les contraintes matérielles stimulent l'innovation. Mais attention, ne sous-estimez pas la complexité de l'intégration.

Environnements RL pour LLM : Guide Pratique

Quand j'ai plongé dans l'ingénierie des environnements RL pour les modèles de langage, j'ai été submergé par la complexité. Mais j'ai navigué à travers en utilisant des outils comme la série O1 d'OpenAI et le DeepSeek R1. Le RL change la donne pour les modèles de langage, mais c'est un défi à relever. Je vais vous montrer comment construire et optimiser ces environnements efficacement. Nous parlerons des environnements RL pour les LLMs, de la bibliothèque Verifiers de Prime Intellect, et des défis et techniques en RL pour les LLMs. J'ai utilisé des milliers d'environnements RL et je vais partager ce que j'ai appris. Si vous êtes prêt à creuser, lisez la suite.

Passer du Codage à l'Ingénierie Logicielle

J'ai passé assez de nuits blanches à coder pour comprendre que le vrai défi n'est pas la quantité de code qu'on écrit, mais les solutions qu'on livre. Dans un monde où on peut écrire du code 55 fois plus vite, l'erreur serait de rester focalisé sur la production de lignes de code. Ce qui compte vraiment c'est l'ingénierie logicielle axée sur la solution, l'adoption de l'IA, et comment on intègre tout ça dans nos plateformes. Si vous vous êtes déjà demandé pourquoi votre productivité ne s'améliore que de 14% malgré tous vos efforts, c'est peut-être parce que vous n'avez pas encore adopté cette approche holistique qui pousse au-delà du simple codage.

Agentic Engineering : Collaborer avec l'IA

Je me souviens de mes premiers pas avec les outils IA. C'était un peu comme découvrir un nouveau continent. Mais l'astuce, ce n'était pas juste d'utiliser l'IA, c'était de travailler avec elle. C'est là qu'intervient l'engineering agentique. Aujourd'hui, collaborer avec l'IA va au-delà de l'automatisation. Il s'agit de créer un véritable partenariat avec la technologie. Dans cet article, je vais partager comment moi et d'autres ingénieurs faisons cette transition, en intégrant les modèles IA dans nos processus de développement, en gérant le contexte de manière efficace, et en configurant des agents IA qui s'adaptent à nos besoins. On n'est plus dans l'utilisation passive ; on orchestre activement. Prêt à explorer ce nouvel horizon ?