Percées en IA : Attention Résiduelle Révolutionne

Je me souviens la première fois que j'ai vu l'impact de l'attention résiduelle sur les modèles d'IA. C'était comme allumer un interrupteur. Tout d'un coup, les inefficacités qui hantaient l'apprentissage profond depuis des années étaient exposées et corrigées. Depuis 2015, les fondations de l'IA n'avaient pas bougé, mais cette percée change la donne. L'attention résiduelle améliore la dégradation du signal dans les réseaux de neurones profonds, rendant les modèles plus efficaces. Comparée aux méthodes traditionnelles, elle offre des performances supérieures sur les benchmarks. Avec l'open-source, l'impact potentiel est immense, surtout dans les laboratoires chinois où les contraintes matérielles stimulent l'innovation. Mais attention, ne sous-estimez pas la complexité de l'intégration.

Je me souviens la première fois que j'ai découvert l'impact de l'attention résiduelle sur les modèles d'IA. C'était un vrai déclic. Les inefficacités qui embêtaient l'apprentissage profond depuis des années étaient soudainement mises à nu—et corrigées. Depuis 2015, les fondations de l'IA restaient intouchées, mais cette percée est un véritable changement de paradigme. L'attention résiduelle, c'est la réponse aux problèmes de dégradation de signal dans les réseaux de neurones profonds, et ça rend les modèles plus efficaces. D'un coup, les performances sur les benchmarks explosent comparées aux méthodes traditionnelles. Et avec l'open-source, imaginez l'impact potentiel, surtout dans les labos chinois où les contraintes matérielles poussent à innover. Mais attention, intégrer ça dans vos projets, c'est pas un jeu d'enfant. Il faut bien comprendre les limites et les compromis techniques. Alors, plongeons dans cette révolution de l'attention résiduelle et voyons comment elle peut transformer notre façon de construire des modèles d'IA.

Comprendre les Connexions Résiduelles et la Dégradation du Signal

Les connexions résiduelles sont devenues essentielles pour adresser la dégradation du signal dans les modèles d'apprentissage profond avec plus de 100 couches. En tant que praticien, j'ai souvent rencontré ce problème de dégradation, où le signal perd de sa force à mesure qu'il traverse plusieurs couches. C'est un peu comme crier un message à travers un long couloir : à la fin, on n'entend plus qu'un murmure. Heureusement, ces connexions permettent aux modèles de contourner certaines couches, atténuant ainsi le problème du gradient qui disparaît.

C'est en 2015 que ces connexions ont été pleinement exploitées. Avant cela, les modèles DI étaient construits sur une base inchangée depuis dix ans. Les connexions résiduelles ont permis une expansion des modèles, permettant d'augmenter le nombre de couches et, par conséquent, la capacité à traiter des concepts plus abstraits. Mais attention, même avec cette avancée, il ne faut pas abuser des couches supplémentaires sans raison valable.

Le Rôle de l'Attention Résiduelle dans les Modèles IA Modernes

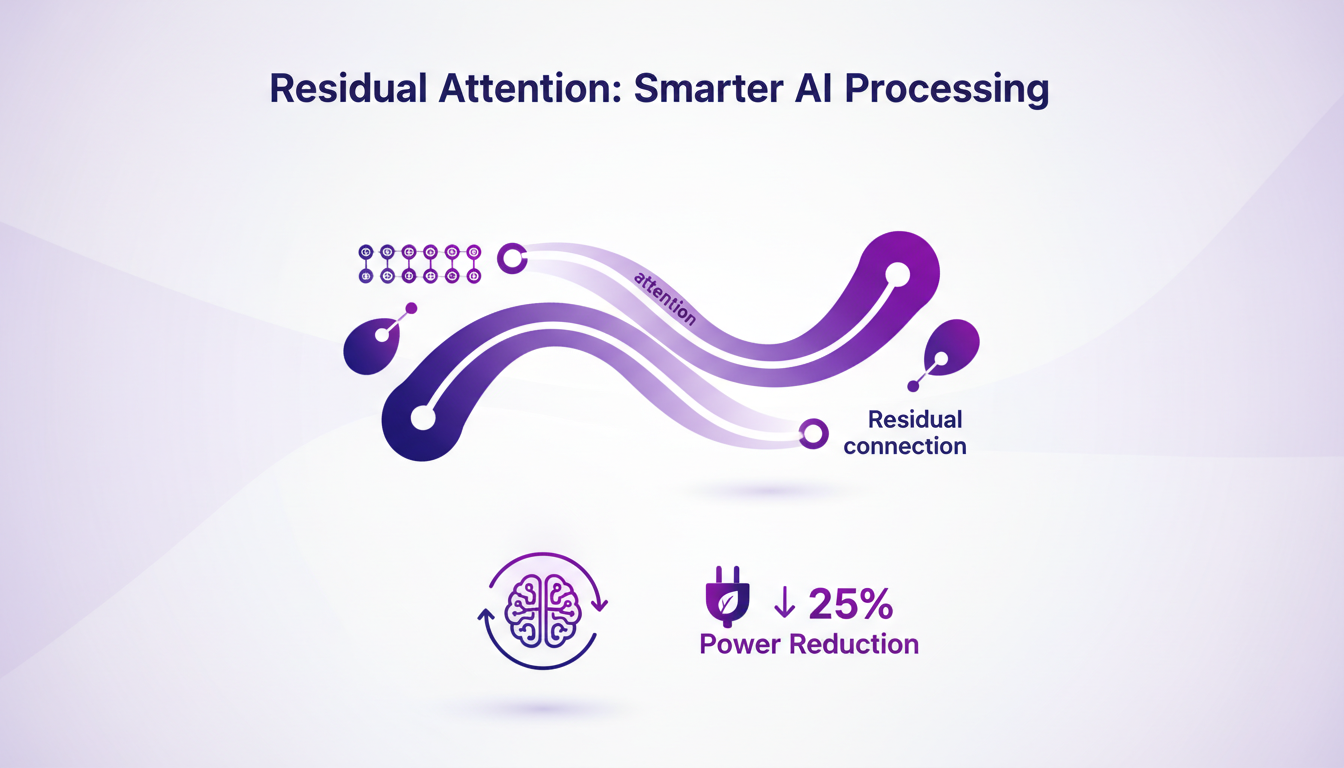

En combinant l'attention avec les connexions résiduelles, l'attention résiduelle optimise le traitement en réduisant les calculs inutiles. J'ai expérimenté cela sur plusieurs projets, et cela change vraiment la donne. Les modèles avec attention résiduelle consomment 25 % moins d'énergie, une statistique qui parle d'elle-même quand on pense aux coûts énergétiques.

Cette technique, maintenant en source ouverte, a encouragé une vague d'innovations. Les chercheurs peuvent désormais contribuer et affiner ces modèles, ce qui accélère les progrès technologiques. Mais il faut faire attention à la complexité croissante de l'implémentation qui peut en découler.

Évaluation des Modèles Traditionnels vs. Attention Résiduelle

Les modèles d'attention résiduelle surpassent les modèles traditionnels sur des benchmarks clés tels que GPQA Diamond et Human Eval. Les gains d'efficacité ne sont pas que théoriques, ils se traduisent par des gains concrets dans des applications réelles.

Il y a un potentiel pour des architectures plus profondes mais plus étroites, permettant de mieux gérer des tâches complexes. Cependant, chaque médaille a son revers : la complexité de l'implémentation peut augmenter, et il faut être prêt à gérer ces défis techniques.

Impact de l'Open Source et Implications Futures

La mise à disposition en open source de l'attention résiduelle a démocratisé l'accès à une technologie IA de pointe. Des laboratoires chinois exploitent désormais ces contraintes matérielles pour innover, ce qui pourrait mener à des pratiques de développement IA plus durables. J'ai vu comment cela peut accélérer les améliorations par un développement communautaire.

Ce partage ouvert pourrait transformer la manière dont nous abordons les projets IA, en permettant une collaboration et un échange de connaissances à une échelle jamais vue auparavant. Mais gardons à l'esprit que cela nécessite de solides infrastructures de gestion de code et de documentation pour éviter le chaos.

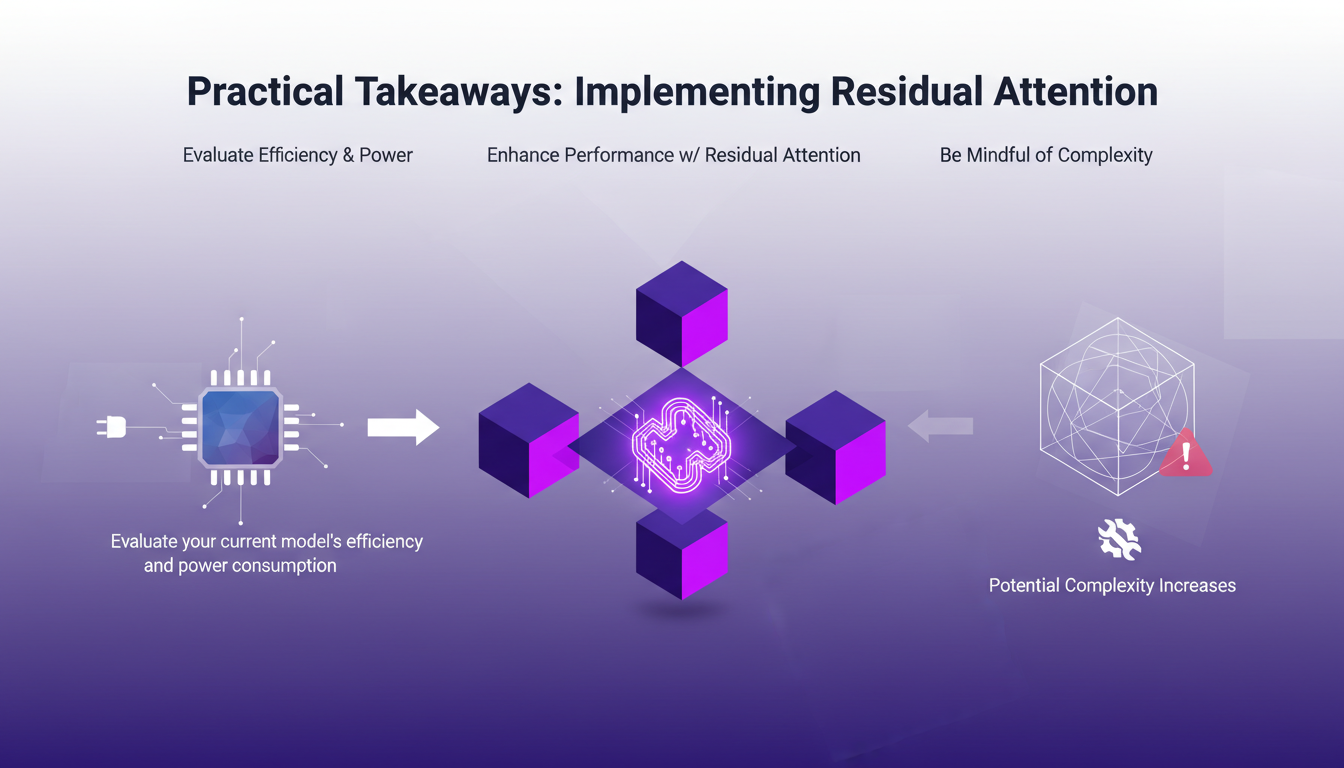

Conclusions Pratiques : Mettre en Œuvre l'Attention Résiduelle

Avant d'intégrer l'attention résiduelle dans un projet, évaluez d'abord l'efficacité actuelle de votre modèle et sa consommation énergétique. Intégrer cette technique peut significativement améliorer les performances, mais soyez conscient des augmentations potentielles de complexité dans votre flux de travail.

- Évaluez l'efficacité actuelle et la consommation énergétique de votre modèle.

- Intégrez l'attention résiduelle pour booster les performances.

- Attention à la complexité accrue dans le flux de travail.

- Économies de coûts et gains d'efficacité possibles.

Cette approche peut conduire à des économies de coûts significatives et à des gains d'efficacité, mais elle nécessite une gestion prudente des ressources et de la complexité.

J'ai plongé dans l'univers des modèles d'IA et, croyez-moi, l'attention résiduelle est une vraie révolution. D'abord, en intégrant cette technique, je vois des gains d'efficacité et de performance sans avoir besoin de ressources massives. Ensuite, on renverse une décennie de stagnation dans l'architecture des modèles DI, tout en résolvant le problème de la dégradation du signal dans les réseaux profonds. Croyez-moi, avec plus de 100 couches, c'était vraiment un casse-tête ! Mais attention, ça ne résout pas tout — il faut bien comprendre comment et quand l'appliquer. En avant, je suis convaincu que l'attention résiduelle va continuer de transformer nos projets d'IA. Je vous encourage à explorer les ressources open-source disponibles et à réfléchir à comment cette approche pourrait transformer vos projets. Pour un point de vue plus approfondi, visionnez la vidéo originale : elle ouvre vraiment les yeux sur l'impact des connexions résiduelles dans les modèles d'IA. Pour creuser le sujet, visionnez la vidéo originale : https://www.youtube.com/watch?v=kmwSPZgkKVg

Questions Fréquentes

Thibault Le Balier

Co-fondateur & CTO

Issu de l'écosystème startup tech, Thibault a développé une expertise en architecture de solutions IA qu'il met aujourd'hui au service de grands groupes (Atos, BNP Paribas, beta.gouv). Il intervient sur deux axes : la maîtrise des déploiements IA (LLM locaux, sécurisation MCP) et l'optimisation des coûts d'inférence (offloading, compression, gestion des tokens).

Articles liés

Découvrez d'autres articles sur des sujets similaires

Passer du Codage à l'Ingénierie Logicielle

J'ai passé assez de nuits blanches à coder pour comprendre que le vrai défi n'est pas la quantité de code qu'on écrit, mais les solutions qu'on livre. Dans un monde où on peut écrire du code 55 fois plus vite, l'erreur serait de rester focalisé sur la production de lignes de code. Ce qui compte vraiment c'est l'ingénierie logicielle axée sur la solution, l'adoption de l'IA, et comment on intègre tout ça dans nos plateformes. Si vous vous êtes déjà demandé pourquoi votre productivité ne s'améliore que de 14% malgré tous vos efforts, c'est peut-être parce que vous n'avez pas encore adopté cette approche holistique qui pousse au-delà du simple codage.

Défis Ressources IA: Nvidia, Open Source

Je me souviens de la première fois où j'ai heurté un mur avec les ressources de calcul pour l'IA. C'était comme essayer de courir un marathon sur un tapis roulant bloqué en mode marche. Dans ce paysage de l'IA en pleine évolution, nous faisons face à des défis bien réels, des retards de Nvidia à l'attrait croissant des modèles open-source. Le marché est en pleine ébullition, avec des annonces financières comme celles de Mistral qui ajoutent une couche de complexité supplémentaire. On doit naviguer à travers les pénuries de ressources, l'émergence de modèles d'IA plus petits, et les problèmes de chaîne d'approvisionnement qui affectent les délais de livraison des composants. Plongeons dans ces dynamiques avec un regard de praticien, en se concentrant sur les solutions pratiques et les compromis.

Créer une app téléchargée 7 milliards de fois

Je me souviens comme si c'était hier du moment où les chiffres de téléchargement de VLC ont explosé. Un vrai coup de théâtre, mais attention, ça n'a pas toujours été une promenade de santé. C'est là qu'on se rend compte que derrière chaque succès phénoménal, il y a des montagnes de défis à surmonter. Entre les batailles juridiques et les implications de l'open source, le parcours de VLC est tout sauf ordinaire. En tant que développeur, on pense souvent que le plus dur c'est de coder, mais maintenir et faire évoluer une application téléchargée 7 milliards de fois, c'est une autre paire de manches. Plongeons ensemble dans l'histoire de VLC, une aventure où technologie et persévérance se mêlent étroitement.

IA en Vente : Disponibilité 24/7 et Impact Financier

J'ai passé des années dans la vente, et les tendances, j'en ai vu défiler. Mais l'IA, c'est autre chose. C'est une révolution, à condition de savoir l'utiliser. Je vous montre comment l'IA transforme les ventes, mais aussi ses limites cruciales. Imaginez : votre IA dans le CRM fait 300 € par jour en ventes, 24/7. C'est un atout majeur, mais elle ne remplace pas le contact humain. On parle de disponibilité continue et d'interactions multiples, mais attention à ne pas oublier que l'humain garde sa place. Je partage mon workflow pour que vous puissiez tirer le meilleur parti de l'IA, tout en évitant ses pièges.

Modélisation Émotions IA: Expérience Pratique

J'ai passé des heures à bricoler avec des modèles d'IA. Et croyez-moi, le moment où vous voyez un schéma neuronal se transformer en quelque chose d'aussi humain que l'émotion, c'est renversant. Mais attention, ce n'est pas que du positif. Dans cet article, je partage comment ces comportements émotionnels émergent et ce qu'ils signifient pour le développement de l'IA. Nous allons plonger dans la neuroscience de l'IA, comprendre comment les modèles linguistiques simulent les émotions et voir comment ces schémas influencent leur comportement. J'ai expérimenté avec des 'neurones de désespoir' et observé des personnages IA développer des émotions fonctionnelles. Alors, comment façonner la psychologie de l'IA pour des systèmes dignes de confiance ? Voici ce que j'ai découvert sur le terrain.