Environnements RL pour LLM : Guide Pratique

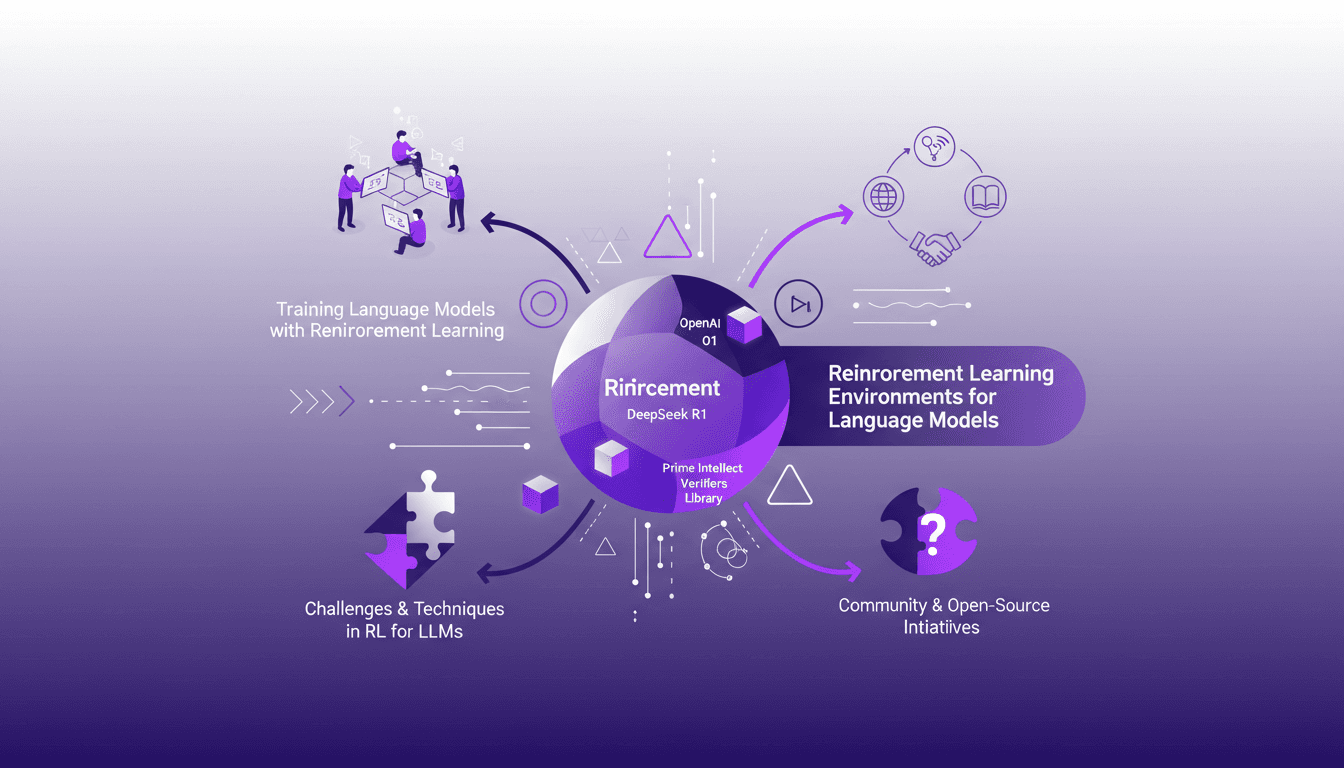

Quand j'ai plongé dans l'ingénierie des environnements RL pour les modèles de langage, j'ai été submergé par la complexité. Mais j'ai navigué à travers en utilisant des outils comme la série O1 d'OpenAI et le DeepSeek R1. Le RL change la donne pour les modèles de langage, mais c'est un défi à relever. Je vais vous montrer comment construire et optimiser ces environnements efficacement. Nous parlerons des environnements RL pour les LLMs, de la bibliothèque Verifiers de Prime Intellect, et des défis et techniques en RL pour les LLMs. J'ai utilisé des milliers d'environnements RL et je vais partager ce que j'ai appris. Si vous êtes prêt à creuser, lisez la suite.

Quand j'ai commencé à créer des environnements RL pour les modèles de langage, je me suis senti submergé par la complexité. J'ai dû m'accrocher, mais avec les bons outils, comme la série O1 d'OpenAI et le DeepSeek R1, j'ai réussi à trouver mon chemin. Le RL, c'est un véritable changement de jeu pour les LLMs, mais attention, ce n'est pas une promenade de santé. Je vais vous montrer comment j'ai construit et optimisé ces environnements. On va plonger dans les détails des environnements RL pour les LLMs, discuter de la bibliothèque Verifiers de Prime Intellect, et explorer les défis et techniques du RL dans ce contexte. J'ai orchestré des milliers d'environnements RL, et je partagerai mes réussites et mes échecs. Prêt à creuser et voir comment tout cela s'emboîte ? Lisez la suite.

Comprendre l'Apprentissage par Renforcement pour les LLMs

Dans le monde des modèles de langage (LLMs), l'apprentissage par renforcement (RL) est devenu indispensable. Pourquoi ? Parce qu'il permet aux modèles d'apprendre en interagissant et en explorant, un peu comme un enfant qui joue pour comprendre son environnement. La clé ici est le concept de récompenses vérifiables. Ces récompenses permettent de valider que le modèle a bien appris ce qu'on lui demande. Mais attention, sans une optimisation de politique proximale (PPO), le modèle peut facilement se perdre dans des schémas inefficaces. C'est là que le taille de lot joue un rôle crucial.

Je me suis rendu compte que, sans une bonne gestion de la taille de lot, l'apprentissage devient instable. Pour optimiser cela, j'ai dû ajuster mes paramètres après plusieurs essais, et croyez-moi, j'ai appris à la dure. D'ailleurs, les environnements d'apprentissage par renforcement pour les modèles de langage sont actuellement très prisés, avec des startups recevant des financements importants pour de telles innovations.

Exploiter la Série de Modèles O1 d'OpenAI

Intégrer la série de modèles O1 d'OpenAI dans mes environnements RL a été une expérience enrichissante. Ces modèles ont une approche unique, notamment en utilisant le RL pour améliorer la performance par la chaîne de pensée. Cependant, il faut faire attention aux compromis : plus de performance signifie souvent plus de complexité. Dans le monde réel, cela se traduit par des gains d'efficacité, mais aussi par un coût accru en termes de ressources.

J'ai orchestré l'intégration des modèles O1 dans différents environnements RL, et j'ai constaté que ces modèles améliorent effectivement la capacité de réflexion du modèle. Toutefois, attention à ne pas trop complexifier votre infrastructure, car cela peut rapidement devenir un gouffre à ressources.

DeepSeek R1 et Récompenses Vérifiables

Les récompenses vérifiables de DeepSeek R1 sont une véritable révolution. En les implémentant dans mes environnements RL, j'ai pu observer une nette amélioration des stratégies de raisonnement des modèles. Mais attention, structurer incorrectement les récompenses peut mener à des résultats inattendus. J'ai appris à éviter ces erreurs en ajustant progressivement mes paramètres.

Pour maximiser la performance contre des adversaires aléatoires, j'ai constaté que la performance était similaire à 85% lorsque j'ajustais correctement les récompenses. Ce qui est crucial ici, c'est la capacité à faire évoluer les stratégies du modèle sans se fier uniquement aux données d'entraînement supervisé.

Explorer la Bibliothèque de Vérificateurs de Prime Intellect

La bibliothèque de vérificateurs de Prime Intellect est un outil formidable pour enrichir les environnements RL. En construisant et évaluant des environnements pour des jeux comme le Tic-Tac-Toe, j'ai rencontré des défis, mais j'ai pu les surmonter grâce à l'outil modulaire de Prime Intellect.

Un des défis majeurs était de gérer la complexité croissante des environnements sans fragmenter les efforts. Heureusement, la communauté open-source est un atout majeur, et j'ai pu tirer parti de nombreux outils partagés pour faciliter mon processus.

Communauté et Initiatives Open-Source

La communauté joue un rôle essentiel dans l'avancement des environnements RL. Les outils open-source m'ont non seulement fait gagner du temps, mais m'ont aussi évité bien des maux de tête. Contribuer et bénéficier des ressources communautaires est un équilibre entre innovation et pragmatisme.

Pour ceux qui souhaitent s'impliquer, je recommande de commencer par des projets open-source comme Verifiers. Cela ne demande pas seulement des compétences techniques, mais aussi une compréhension pragmatique des besoins réels du domaine.

Construire des environnements de renforcement pour les modèles de langage, c'est un défi, mais les résultats sont vraiment gratifiants. J'ai utilisé la série O1 d'OpenAI et collaboré avec la communauté pour affiner mon flux de travail et booster l'efficacité. Voici ce que j'ai appris:

- Formater la fonction de récompense avec un poids de 0.2 a changé la donne.

- Contre un adversaire aléatoire, la performance reste très similaire à 85%, ce qui est impressionnant.

- Exploiter des milliers d'environnements RL est possible et augmente nos capacités de façon considérable.

En regardant vers l'avenir, on peut vraiment optimiser davantage ces environnements. L'innovation est là, prête à être saisie. Vous êtes prêt à optimiser vos environnements RL? Plongez et expérimentez dès aujourd'hui! Regardez la vidéo de Stefano Fiorucci "Let LLMs Wander" pour creuser encore plus. C'est comme discuter entre collègues qui partagent des astuces concrètes.

Questions Fréquentes

Thibault Le Balier

Co-fondateur & CTO

Issu de l'écosystème startup tech, Thibault a développé une expertise en architecture de solutions IA qu'il met aujourd'hui au service de grands groupes (Atos, BNP Paribas, beta.gouv). Il intervient sur deux axes : la maîtrise des déploiements IA (LLM locaux, sécurisation MCP) et l'optimisation des coûts d'inférence (offloading, compression, gestion des tokens).

Articles liés

Découvrez d'autres articles sur des sujets similaires

Passer du Codage à l'Ingénierie Logicielle

J'ai passé assez de nuits blanches à coder pour comprendre que le vrai défi n'est pas la quantité de code qu'on écrit, mais les solutions qu'on livre. Dans un monde où on peut écrire du code 55 fois plus vite, l'erreur serait de rester focalisé sur la production de lignes de code. Ce qui compte vraiment c'est l'ingénierie logicielle axée sur la solution, l'adoption de l'IA, et comment on intègre tout ça dans nos plateformes. Si vous vous êtes déjà demandé pourquoi votre productivité ne s'améliore que de 14% malgré tous vos efforts, c'est peut-être parce que vous n'avez pas encore adopté cette approche holistique qui pousse au-delà du simple codage.

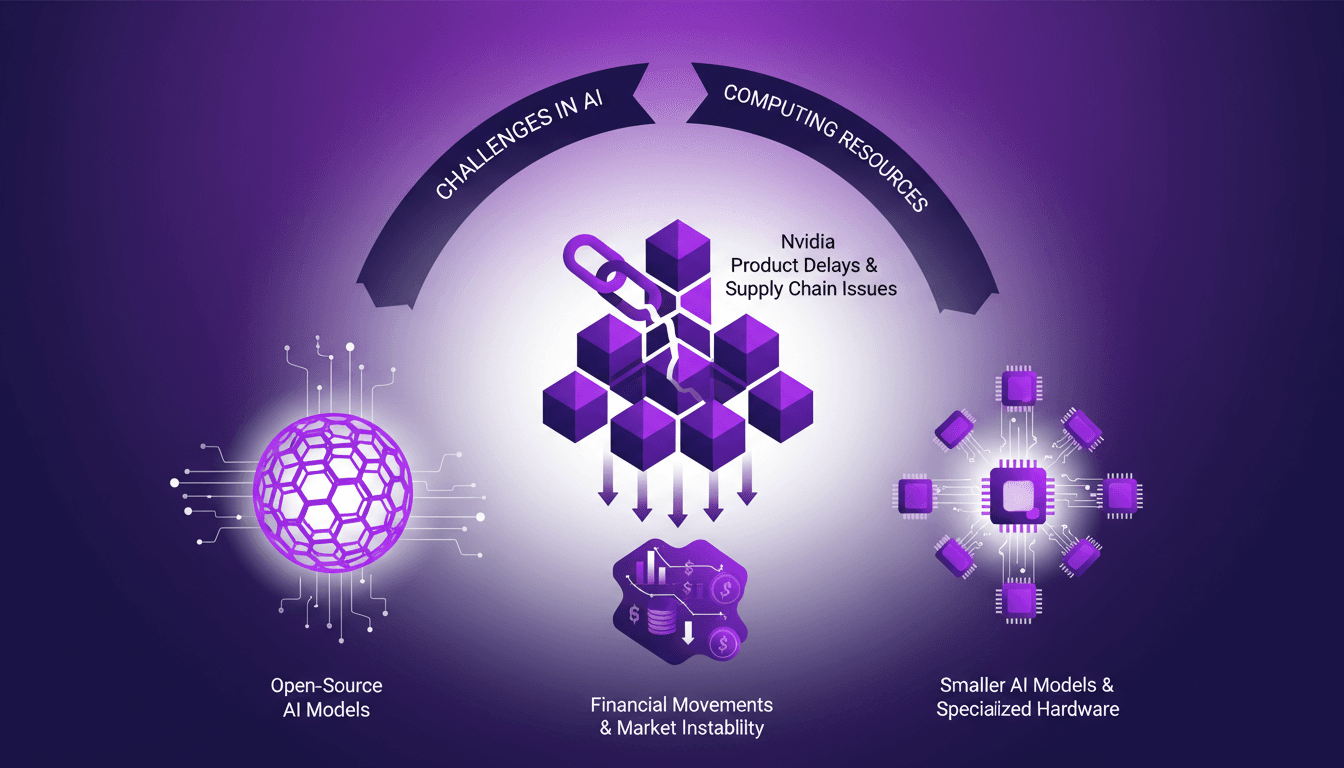

Défis Ressources IA: Nvidia, Open Source

Je me souviens de la première fois où j'ai heurté un mur avec les ressources de calcul pour l'IA. C'était comme essayer de courir un marathon sur un tapis roulant bloqué en mode marche. Dans ce paysage de l'IA en pleine évolution, nous faisons face à des défis bien réels, des retards de Nvidia à l'attrait croissant des modèles open-source. Le marché est en pleine ébullition, avec des annonces financières comme celles de Mistral qui ajoutent une couche de complexité supplémentaire. On doit naviguer à travers les pénuries de ressources, l'émergence de modèles d'IA plus petits, et les problèmes de chaîne d'approvisionnement qui affectent les délais de livraison des composants. Plongeons dans ces dynamiques avec un regard de praticien, en se concentrant sur les solutions pratiques et les compromis.

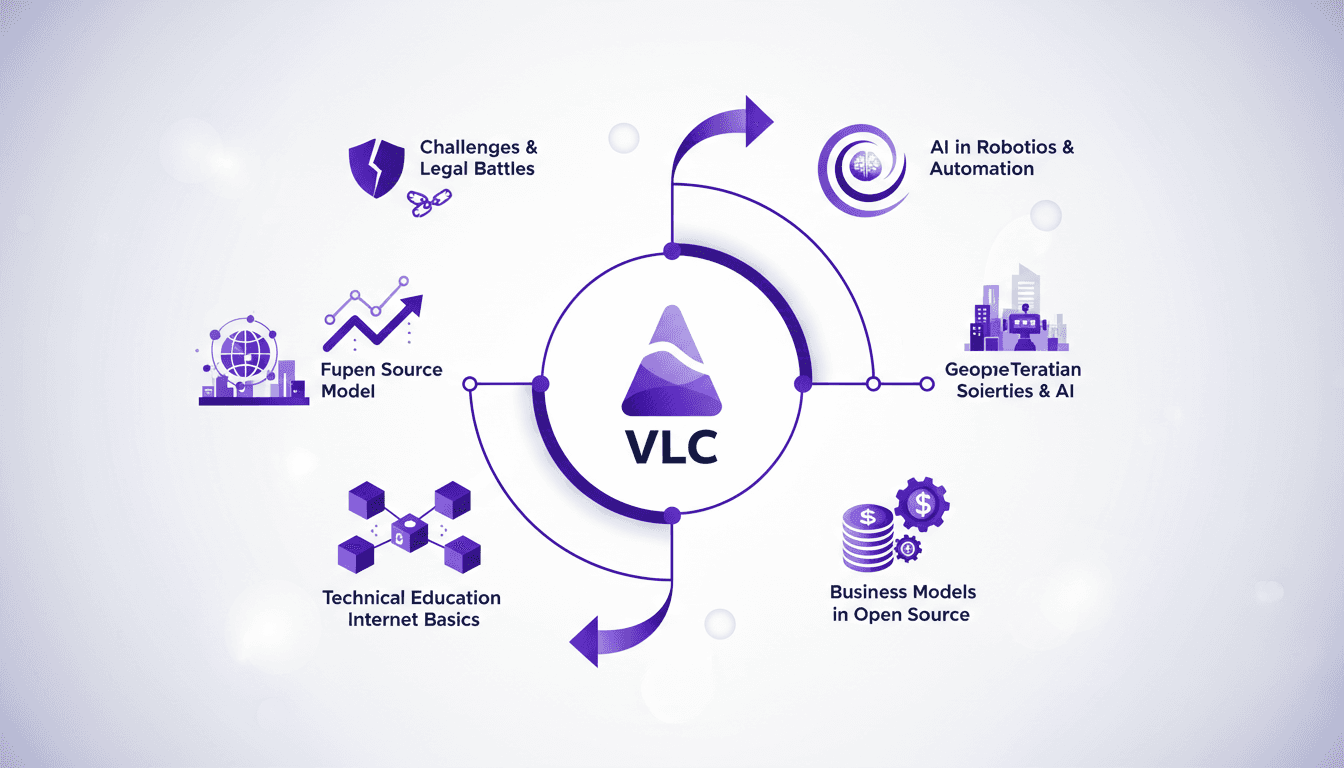

Créer une app téléchargée 7 milliards de fois

Je me souviens comme si c'était hier du moment où les chiffres de téléchargement de VLC ont explosé. Un vrai coup de théâtre, mais attention, ça n'a pas toujours été une promenade de santé. C'est là qu'on se rend compte que derrière chaque succès phénoménal, il y a des montagnes de défis à surmonter. Entre les batailles juridiques et les implications de l'open source, le parcours de VLC est tout sauf ordinaire. En tant que développeur, on pense souvent que le plus dur c'est de coder, mais maintenir et faire évoluer une application téléchargée 7 milliards de fois, c'est une autre paire de manches. Plongeons ensemble dans l'histoire de VLC, une aventure où technologie et persévérance se mêlent étroitement.

Modélisation Émotions IA: Expérience Pratique

J'ai passé des heures à bricoler avec des modèles d'IA. Et croyez-moi, le moment où vous voyez un schéma neuronal se transformer en quelque chose d'aussi humain que l'émotion, c'est renversant. Mais attention, ce n'est pas que du positif. Dans cet article, je partage comment ces comportements émotionnels émergent et ce qu'ils signifient pour le développement de l'IA. Nous allons plonger dans la neuroscience de l'IA, comprendre comment les modèles linguistiques simulent les émotions et voir comment ces schémas influencent leur comportement. J'ai expérimenté avec des 'neurones de désespoir' et observé des personnages IA développer des émotions fonctionnelles. Alors, comment façonner la psychologie de l'IA pour des systèmes dignes de confiance ? Voici ce que j'ai découvert sur le terrain.

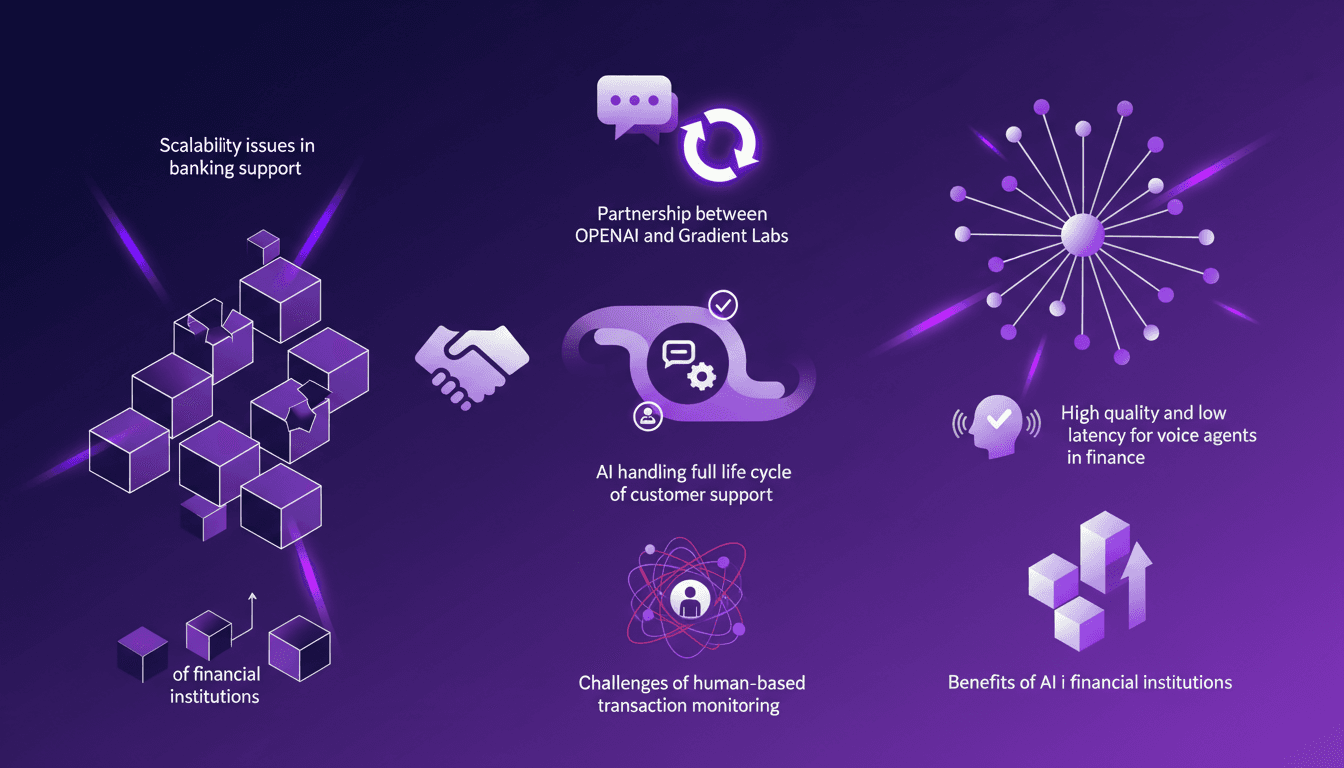

Scalabilité bancaire : OpenAI et Gradient Labs

La première fois que j'ai intégré l'IA dans un système bancaire, les problèmes de scalabilité étaient un cauchemar. Mais en collaborant avec OpenAI et Gradient Labs, j'ai découvert un tout autre monde. Dans cet article, je vous explique comment nous avons surmonté ces défis, en utilisant des modèles à haute qualité et faible latence. Imaginez une IA capable de gérer tout le cycle de vie du support client dans une banque, c'est un vrai changement de jeu. Grâce à des échanges de feedback constants, nous avons accéléré l'innovation dans le secteur financier. Les agents vocaux bénéficiant d'une latence minimale permettent d'offrir un service clientèle plus rapide et plus précis. Ne vous laissez pas berner par des méthodes de surveillance transactionnelle purement humaines : l'IA est désormais indispensable pour les institutions financières.