Optimiser Pydantic: Agents en Production

Je me suis plongé dans la production avec Pydantic, jonglant avec des agents et repoussant les limites de performance. Optimiser notre configuration n'était pas une promenade de santé, mais chaque étape, chaque outil — de Jepper à Beautiful Soup — a transformé notre approche. Au cœur des environnements de production, l'efficacité règne. Pydantic propose des outils robustes, mais les déployer efficacement exige finesse et optimisation. Je vous emmène à travers les subtilités de l'observabilité avec Logfire, les variables gérées et les techniques d'optimisation des prompts. Quelques challenges m'ont donné du fil à retordre, comme l'analyse des relations politiques. Mais avec les bons ajustements, même les données privées peuvent être optimisées. Un aperçu des outils que j'ai intégrés : deux outils principaux enregistrés avec l'agent principal, et un outil appelé 'extract political relations'.

Je suis entré dans le vif du sujet de la production avec Pydantic, jonglant avec des agents tout en repoussant les limites de performance. Quand j'ai commencé, je savais que l'efficacité était la clé dans les environnements de production. Pydantic m'a offert des outils robustes, et je pensais que les déployer serait simple. Mais je me suis vite rendu compte que ça nécessitait une optimisation pointue et un regard affûté. J'ai intégré Jepper et Logfire dans notre flux de travail, orchestré des variables gérées, tout en optimisant nos prompts. C'était loin d'être simple, surtout lorsqu'il s'agissait d'analyser des relations politiques complexes. Heureusement, avec des outils comme Beautiful Soup pour traiter le HTML, et des optimisations de données privées, j'ai pu surmonter ces défis. Je vais vous montrer comment j'ai utilisé deux outils principaux enregistrés avec l'agent et un outil pour extraire les relations politiques. Si vous êtes prêt à optimiser votre environnement de production, suivez-moi dans cette aventure.

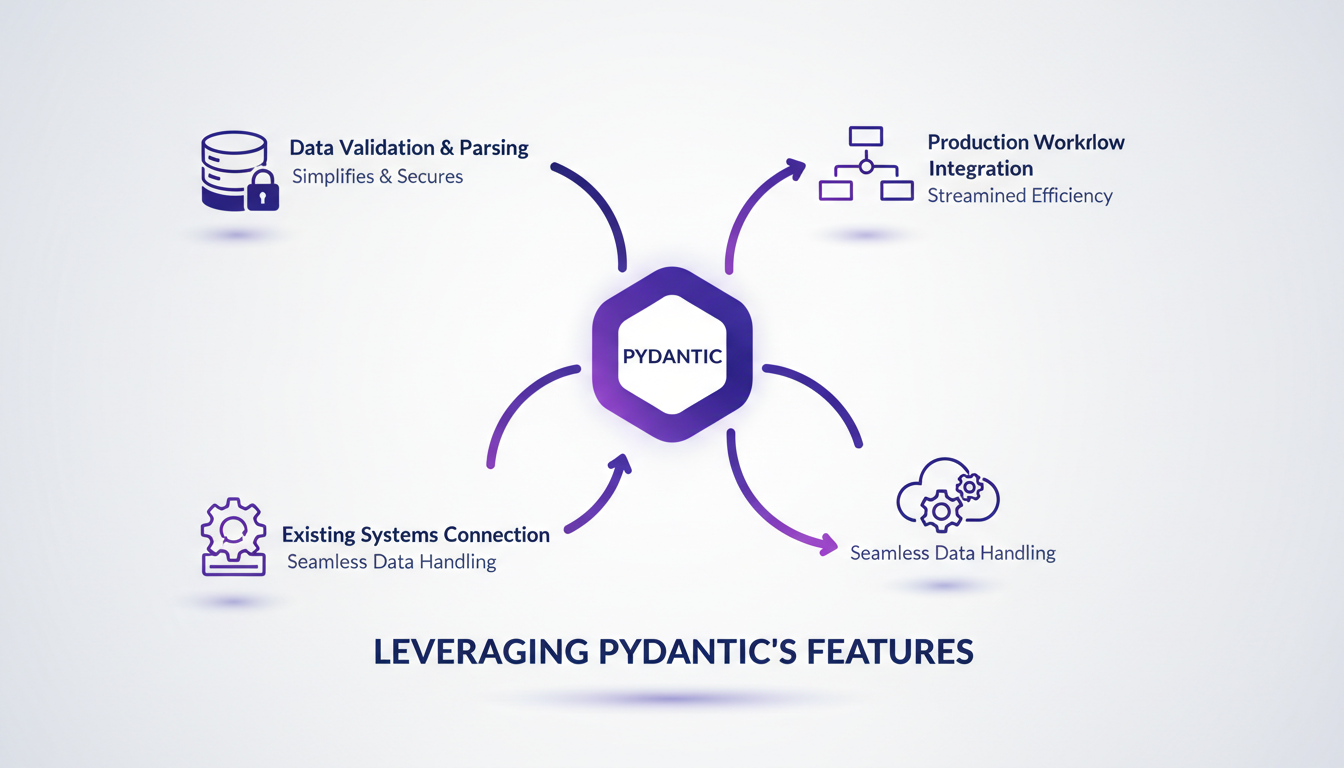

Exploiter les fonctionnalités de Pydantic

Intégrer Pydantic dans notre flux de production a été un véritable tournant. D'abord, je l'ai utilisé pour structurer la validation des données, ce qui a simplifié considérablement le traitement des erreurs. Pydantic, créé par Samuel Colvin, offre des outils puissants comme la validation de données et un cadre agent AI. J'ai connecté Pydantic à nos systèmes existants pour optimiser la gestion des données, et cela a été une révélation. Mais attention aux goulets d'étranglement de performance avec de grands ensembles de données.

Pour maximiser l'efficacité, voici quelques astuces pratiques :

- Utiliser les modèles Pydantic pour structurer les données dès le départ.

- Configurer les paramètres de validation pour éviter les traitements superflus.

- Surveiller l'usage de la mémoire et des temps de réponse avec des ensembles de données importants.

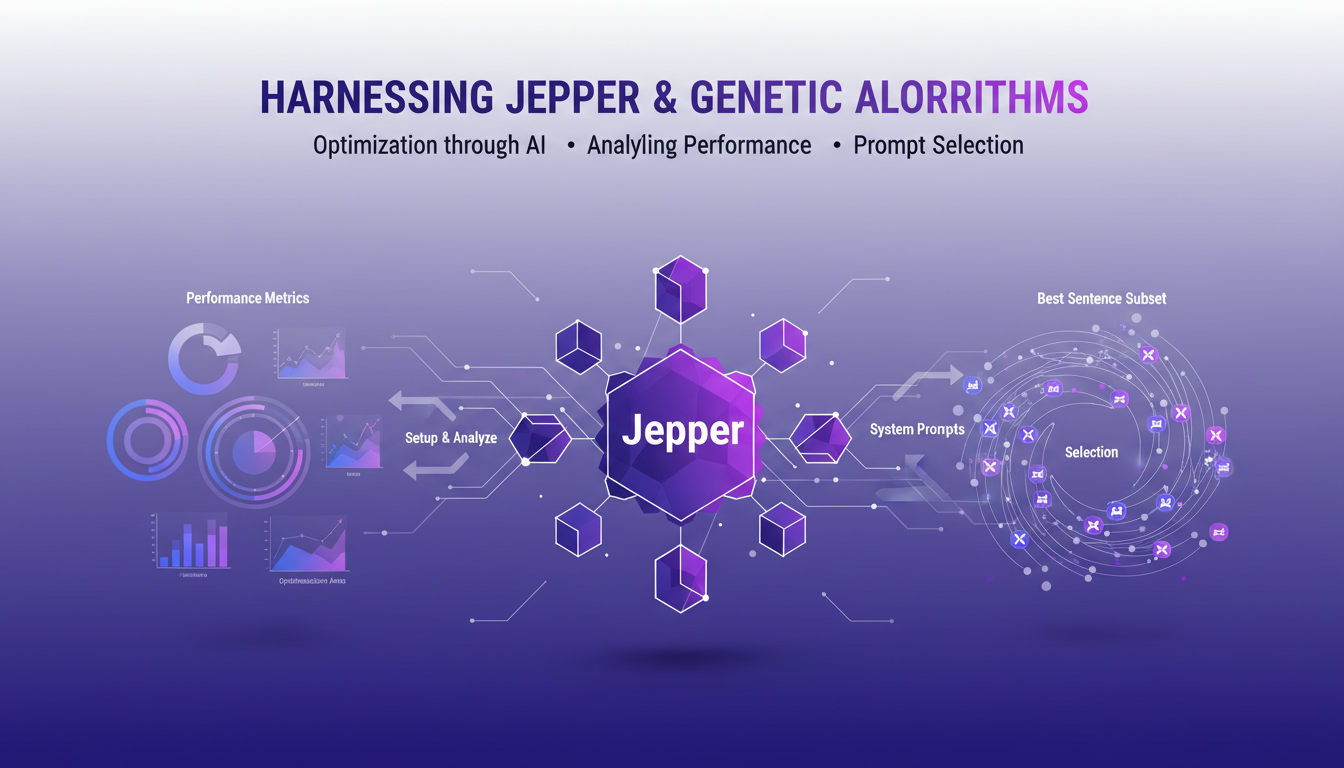

Exploiter Jepper et les algorithmes génétiques

Jepper, notre bibliothèque d'optimisation basée sur les algorithmes génétiques, a joué un rôle clé dans l'amélioration de nos systèmes. Pour commencer, j'ai configuré Jepper afin d'analyser les métriques de performance et identifier les zones à optimiser. Grâce aux algorithmes génétiques, nous avons pu sélectionner le meilleur sous-ensemble de phrases pour nos invites système, ce qui nous a permis d'atteindre une efficacité optimale.

Cependant, il y a des compromis à considérer entre le coût computationnel et les gains d'optimisation. Parfois, des méthodes plus simples peuvent être plus rapides. Ne surestimez pas les algorithmes génétiques pour chaque problème. Voici quelques conseils :

- Évaluez le coût en calcul avant de choisir une méthode d'optimisation.

- Testez avec des échantillons plus petits avant de passer à grande échelle.

- Gardez en tête que la simplicité peut l'emporter sur la complexité dans certains cas.

Améliorer l'observabilité avec Logfire

Avec Logfire, j'ai orchestré le suivi des métriques de performance en temps réel grâce aux variables gérées. Cela a transformé notre capacité à diagnostiquer les problèmes rapidement. Cependant, nous avons fait face à des défis pour assurer une journalisation précise et l'intégrité des données.

L'équilibre entre l'observabilité et la charge du système est crucial. Il est important de savoir quoi surveiller et quoi ignorer pour ne pas surcharger le système.

"Logfire va au-delà des journaux standards, des métriques et des traces, en incluant des fonctionnalités comme l'évaluation et les variables gérées."

Les sorties structurées jouent un rôle crucial dans l'amélioration de la prise de décision.

- Utilisez les variables gérées pour suivre des objets définis par des modèles Pydantic dans Logfire.

- Évitez une surcharge de données en choisissant judicieusement les métriques à suivre.

- Intégrez des sorties structurées pour mieux interpréter les données.

Techniques d'optimisation des invites

Optimiser les invites est essentiel pour améliorer la précision du système. En affinant les invites à l'aide des métriques de performance, j'ai atteint un taux de précision de 96%. Le nombre optimal de phrases sélectionnées était de 20, ce qui s'est avéré crucial pour nos performances.

Mais attention à ne pas trop optimiser. Garder de la flexibilité dans les invites est essentiel pour s'adapter aux variations des données d'entrée.

Comment l'optimisation des invites impacte directement l'expérience utilisateur et la sortie du système :

- Affiner les invites améliore la précision et la cohérence des réponses.

- Tester différentes configurations pour trouver l'équilibre optimal.

- Rester flexible pour s'adapter aux changements de contexte.

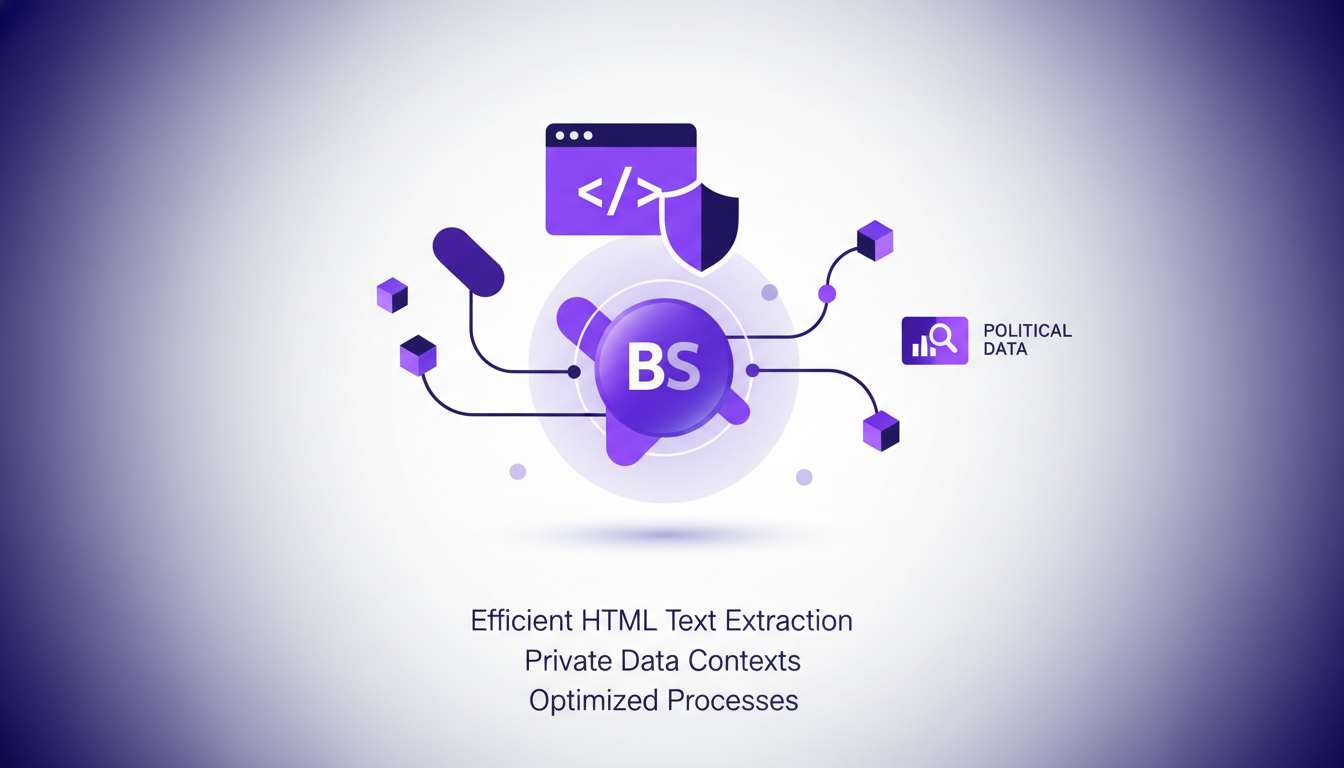

Gérer les données privées et HTML avec Beautiful Soup

En utilisant Beautiful Soup, j'ai pu extraire efficacement du texte HTML tout en respectant la confidentialité des données. J'ai abordé les défis de l'analyse des relations politiques avec un outil d'extraction dédié.

Il est crucial d'assurer la protection des données tout en optimisant les processus d'extraction. Attention aux fuites de données — il faut toujours nettoyer les entrées et sorties.

- Sanitiser les données pour éviter les fuites potentielles.

- Équilibrer la vitesse d'extraction avec l'intégrité et la précision des données.

- Utiliser Beautiful Soup pour traiter efficacement les contenus HTML.

En intégrant ces techniques, nous avons non seulement amélioré notre flux de travail mais aussi renforcé notre capacité à gérer les données en toute sécurité. Pour approfondir ces approches dans d'autres domaines, consultez nos articles sur la modélisation financière avec GPT-5.5 et l'automatisation des tâches financières avec RAMP Sheets.

En utilisant Pydantic, Jepper et Logfire, j'ai vraiment pu optimiser mes agents en production. D'abord, j'ai connecté deux outils différents à l'agent principal. Ça m'a permis d'élargir mes perspectives et d'améliorer mes performances. Ensuite, j'ai choisi les 20 phrases les plus pertinentes pour le prompt du système, ce qui a été un vrai game changer. Mais attention, il faut bien orchestrer ces outils pour maximiser les gains. Enfin, l'outil d'extraction des relations politiques a semblé un peu limité, donc je ne l'utiliserais pas pour tout. Avec ces stratégies, je vois déjà des gains de performance significatifs. Pour l'avenir, je suis vraiment enthousiaste à l'idée de continuer à affiner mes workflows. Prêt à booster votre environnement de production ? Plongez dans ces outils et commencez à peaufiner vos processus dès aujourd'hui. Et si vous voulez approfondir, je vous recommande de regarder la vidéo originale de Samuel Colvin sur YouTube pour des insights encore plus poussés. C'est un must pour quiconque s'intéresse à l'optimisation en production.

Questions Fréquentes

Thibault Le Balier

Co-fondateur & CTO

Issu de l'écosystème startup tech, Thibault a développé une expertise en architecture de solutions IA qu'il met aujourd'hui au service de grands groupes (Atos, BNP Paribas, beta.gouv). Il intervient sur deux axes : la maîtrise des déploiements IA (LLM locaux, sécurisation MCP) et l'optimisation des coûts d'inférence (offloading, compression, gestion des tokens).

Articles liés

Découvrez d'autres articles sur des sujets similaires

GPT-5.5 : Révolution dans l'Industrie Financière

J'ai plongé dans GPT-5.5 pour la modélisation financière, et les résultats ont été tout simplement transformateurs. Passer de GPT-4 à cette version a été un véritable bond en avant, avec une amélioration de 19 points de pourcentage. Je vais vous montrer comment ce modèle gère à la fois les données structurées et non structurées de manière plus efficace que jamais. Mais attention, tout n'est pas rose : j'ai rencontré des défis, notamment dans le traitement des cas d'utilisation complexes en finance. Pourtant, en orchestrant correctement cette technologie, l'impact sur l'industrie financière est indéniable.

GPT 5.5 : Révolution dans la finance

Quand j'ai intégré GPT 5.5 dans mon workflow, c'était comme installer un turbo sur un moteur classique. Les tâches qui prenaient des heures se faisaient en minutes, et la précision était incroyable. Avec l'arrivée de GPT 5.5, on est face à un changement de paradigme dans la façon dont l'IA gère le raisonnement complexe et les tâches de données, surtout dans le secteur financier. On parle d'une amélioration de 19 points de pourcentage par rapport à la version précédente, ce qui transforme notre approche de l'efficacité et de la qualité au quotidien.

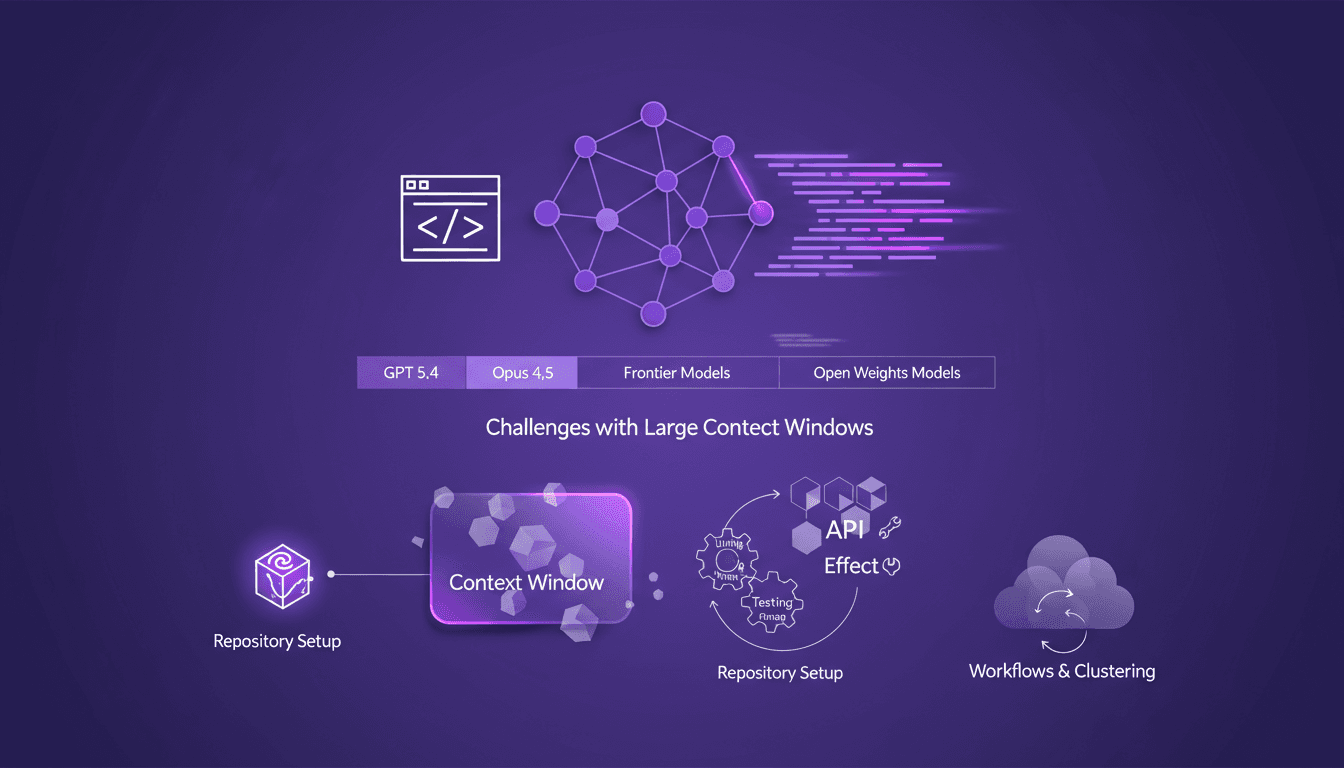

Évolution des Modèles AI : Limites et Opportunités

Je me souviens encore de la première fois où j'ai configuré un dépôt pour la génération de code pilotée par l'IA. Ça a été une révolution, mais aussi un champ de mines de pièges potentiels. Dans cette conférence, je vais plonger dans la façon dont des modèles AI comme GPT 5.4 et Opus 4.5 transforment nos workflows, tout en pointant là où ils trébuchent encore. Passer du codage manuel à une génération automatisée de code, c'est notre réalité quotidienne sur le terrain. Mais attention, les fenêtres de contexte larges peuvent être une vraie galère. La configuration de votre dépôt est cruciale pour éviter les embûches, et je vais partager comment j'utilise Effect et d'autres outils pour un développement API efficace. Accrochez-vous, car comprendre ces modèles et leurs limites est essentiel pour quiconque navigue dans le développement assisté par l'IA.

Évolution des rôles d'ingénieur: s'adapter ou périr

Je me souviens encore du moment où j'ai réalisé que mes compétences en ingénierie devenaient obsolètes. C'était un vrai électrochoc, qui m'a forcé à revoir ma façon de concevoir des systèmes et à m'adapter. Dans le monde technologique en perpétuel mouvement, la seule constante, c'est le changement. En tant qu'ingénieurs, nous devons évoluer ou risquer de rester sur le carreau. Cet article explore comment les ingénieurs peuvent rester pertinents en adoptant un apprentissage continu et en relevant les défis du scaling dans les organisations modernes. Il est impératif d'intégrer de nouvelles compétences en design de systèmes et de s'ajuster aux nouvelles réalités pour ne pas se faire dépasser.

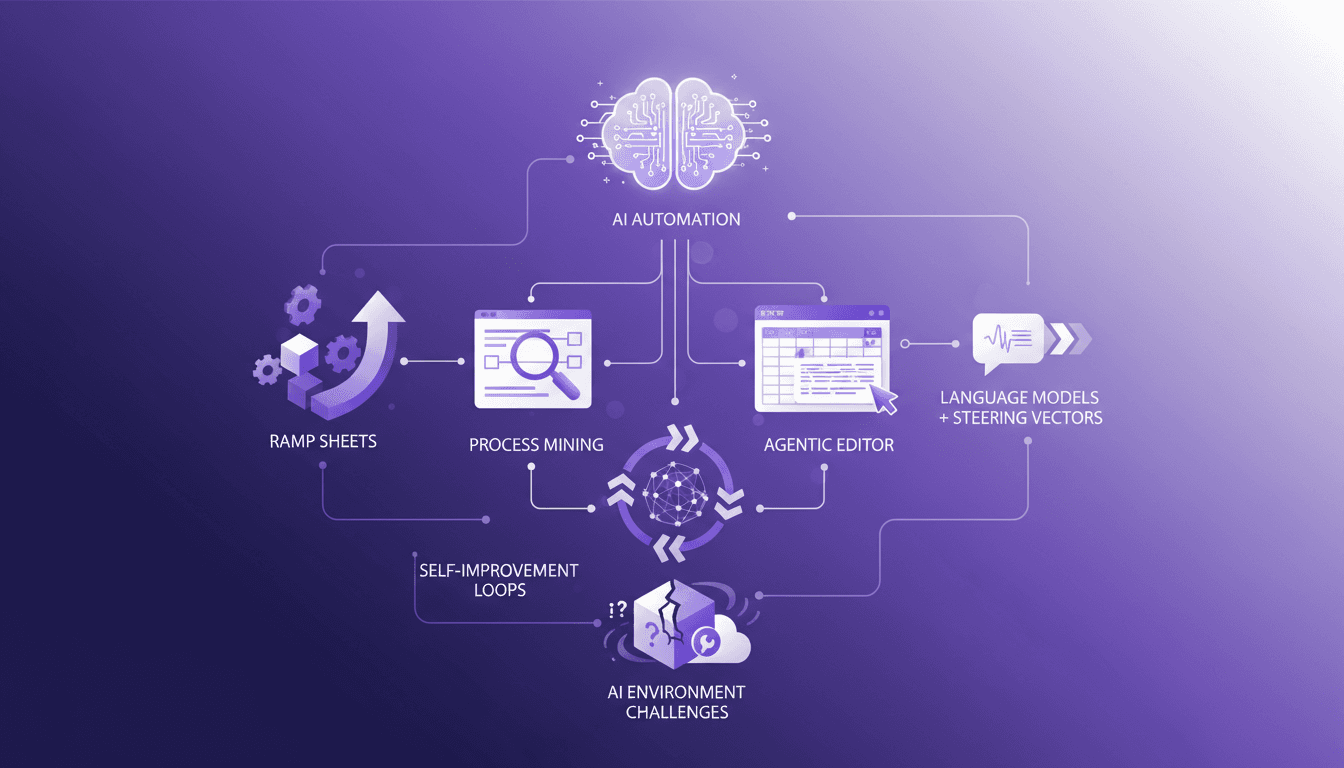

Automatiser les tâches financières avec RAMP

J'ai été plongé jusqu'au cou dans les tableurs, et laissez-moi vous dire, RAMP Sheets est un vrai game changer. Je l'ai lancé en novembre, et depuis, ça automatise les tâches financières d'une manière que je n'aurais jamais imaginée. Dans le monde de la finance, 99% du temps est passé dans les feuilles de calcul. RAMP Sheets vise à réduire ce pourcentage en intégrant l'IA directement dans Excel, automatisant les tâches répétitives et permettant une manipulation plus intelligente des données. L'éditeur de tableur agentique et ses fonctionnalités, les boucles d'auto-surveillance et d'amélioration des systèmes IA, et les défis de construction d'environnements IA et d'évaluation sont au cœur de notre discussion aujourd'hui. C'est fou comment cinq couches peuvent changer tout un paradigme.