OpenRAG: Construire avec une pile open-source RAG

Avez-vous déjà essayé de construire une solution RAG à partir de zéro ? Je l'ai fait, et laissez-moi vous dire, OpenRAG est un véritable changeur de jeu. Ce n'est pas juste un autre ensemble d'outils—c'est une véritable puissance open-source pour la génération augmentée par récupération. Dans cet article, je vais vous guider à travers mon expérience avec OpenRAG, de la gestion des documents à l'indexation de recherche, et comment cela me fait gagner du temps et m'évite bien des maux de tête. Plongeons dans les composants et voyons comment ils s'intègrent dans un workflow d'IA robuste.

Vous avez déjà essayé de construire une solution RAG à partir de rien ? Je l'ai fait. Et croyez-moi, OpenRAG a changé la donne. Ce n'est pas juste un autre ensemble d'outils, c'est une pile complète open-source pour la génération augmentée par récupération qui transforme vraiment la manière dont je gère les projets d'IA. Avant OpenRAG, je jonglais constamment avec la gestion des documents, l'indexation de recherche (et je me suis souvent brûlé les ailes avec des solutions partiales et coûteuses). Mais depuis que j'ai intégré OpenRAG dans mon workflow, j'ai vu une réduction significative des tracas et des coûts. Je vais vous montrer comment Dockling facilite le traitement des documents, comment Open Search booste l'indexation et pourquoi Langflow rend l'orchestration visuelle presque intuitive. Ajoutez à cela l'avantage de la récupération agentique et vous avez un système qui non seulement fonctionne, mais qui évolue avec vos besoins. Et ce n'est pas tout—l'engagement avec la communauté open-source ouvre la porte à une collaboration sans fin. Plongeons ensemble dans cette aventure.

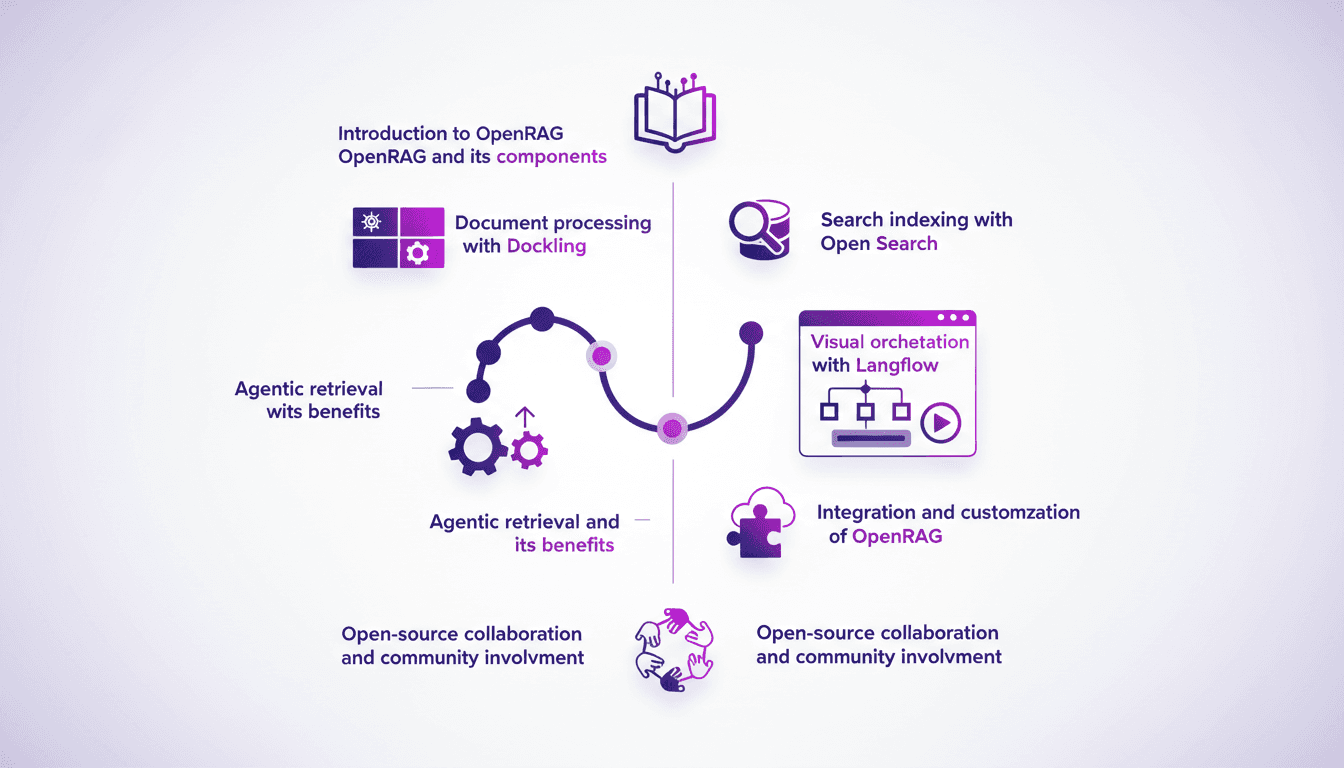

Comprendre OpenRAG et ses Composants

Quand je suis tombé sur OpenRAG, un outil open-source impressionnant pour la RAG (Retrieval Augmented Generation), j'ai immédiatement vu son potentiel pour transformer nos flux de travail AI. OpenRAG, c’est un peu comme un couteau suisse pour les développeurs, intégrant des outils essentiels comme Dockling, Open Search, et Langflow. Dans sa version 0.4.0, il offre des fonctionnalités robustes qui permettent de gérer efficacement moins d'un million de tokens de données. À noter, le modèle vision de 258 millions de Granite Dockling est crucial pour le traitement. Connaître ces composants, c'est comme avoir une boîte à outils d'élite pour construire des systèmes RAG personnalisés.

Avec OpenRAG, on peut dire adieu aux limitations des anciens systèmes que j'utilisais il y a six mois ou un an. Les gains d'efficacité et les améliorations en termes de traitement de données sont indéniables.

Traitement de Documents avec Dockling

Passons à Dockling, un outil qui traite les documents avec une précision chirurgicale. En utilisant le modèle 3B de Granite, Dockling est capable de transformer des documents complexes en données structurées et exploitables. Le workflow est simple : charger, traiter et récupérer les documents. Attention cependant, il est essentiel d'optimiser pour moins d'un million de tokens pour éviter de se retrouver coincé avec des limitations de données.

Ce que j'apprécie vraiment, c’est la rapidité de traitement qui permet de gagner un temps précieux, surtout dans des projets de grande envergure. J'ai déjà vu des gains d'efficacité significatifs en adoptant Dockling pour divers types de documents, du PDF au Word, en passant par les présentations.

Indexation de Recherche avec Open Search

Open Search est une véritable révélation pour quiconque cherche à combiner recherche vectorielle et par mots-clés. Les modèles d’embedding améliorent la précision et la pertinence des résultats de recherche. D’abord, on indexe ses données ; ensuite, on affine pour obtenir des résultats optimaux.

"L'Open Search, c'est un peu le moteur de recherche sur stéroïdes pour vos données."

Mais attention, il faut trouver un équilibre entre la vitesse de recherche et la précision. Grâce à sa nature open-source, les coûts restent maîtrisés, ce qui est toujours un atout pour les budgets serrés.

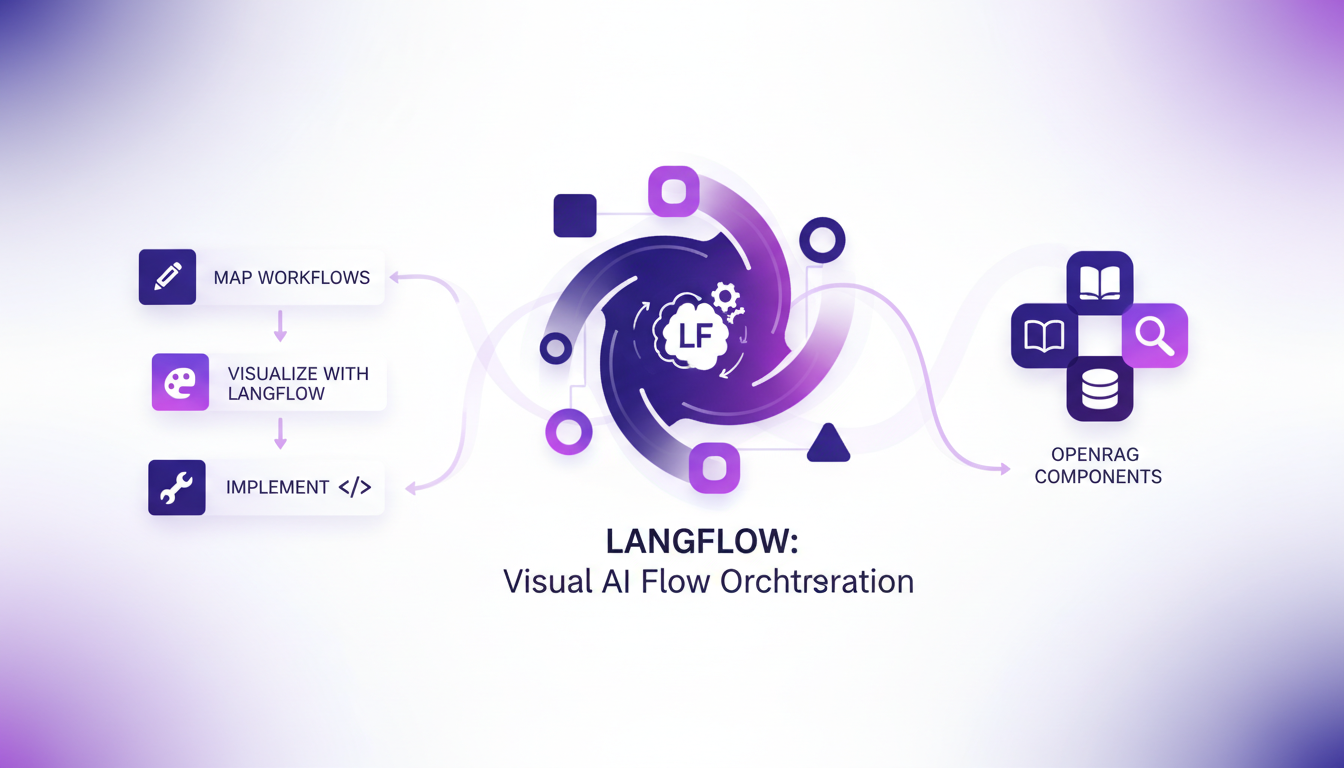

Orchestration Visuelle avec Langflow

Langflow simplifie l'orchestration des flux AI avec des outils visuels intuitifs. Il s'intègre parfaitement avec les composants d'OpenRAG, ce qui facilite la création de workflows AI complexes. D'abord, on cartographie ses flux AI ; puis, on implémente avec Langflow. Attention, cependant, à ne pas compliquer les flux, car cela peut vite devenir lourd.

La véritable force de Langflow réside dans sa capacité à réduire le temps de configuration et les erreurs. Cela m'a permis d'optimiser mes projets sans passer des heures sur des détails techniques.

Récupération Agentique et Personnalisation d'OpenRAG

La récupération agentique, c'est un peu comme avoir un assistant AI qui sait exactement quoi chercher et comment utiliser les résultats. Cela offre une flexibilité énorme dans la personnalisation d'OpenRAG pour répondre aux besoins spécifiques d'un projet. Personnaliser OpenRAG, c’est aussi tirer parti des plugins et modules de la communauté.

Mais attention à la compatibilité avec les systèmes existants, c'est un point crucial. L'implication de la communauté dans OpenRAG booste l'innovation et le support, un véritable atout pour tous les utilisateurs.

OpenRAG, ce n'est pas juste une pile technologique, c'est une boîte à outils pour l'efficacité et l'innovation en RAG. J'ai intégré Dockling pour le traitement des documents et Open Search pour l'indexation, et ça change la donne. Chaque composant, de l'orchestration visuelle de Langflow à la personnalisation open-source, joue un rôle crucial. Voici mes principaux constats :

- Dockling gère jusqu'à 258 millions de modèles de vision, ce qui optimise grandement le traitement des documents.

- Open Search permet une indexation rapide, même pour des données de moins d'un million de tokens.

- Langflow offre une orchestration visuelle qui simplifie les flux de travail complexes.

Et avec la communauté open-source, il est facile d'adapter OpenRAG à vos besoins spécifiques. Si vous êtes prêt à optimiser vos flux de travail en RAG, plongez dans OpenRAG et commencez à créer des solutions plus intelligentes dès aujourd'hui. Pour une compréhension plus approfondie, regardez la vidéo originale 'OpenRAG: An open-source stack for RAG' de Phil Nash sur YouTube.

Soyez prêt à transformer votre efficacité tout en gardant un œil sur les limites techniques.

Questions Fréquentes

Thibault Le Balier

Co-fondateur & CTO

Issu de l'écosystème startup tech, Thibault a développé une expertise en architecture de solutions IA qu'il met aujourd'hui au service de grands groupes (Atos, BNP Paribas, beta.gouv). Il intervient sur deux axes : la maîtrise des déploiements IA (LLM locaux, sécurisation MCP) et l'optimisation des coûts d'inférence (offloading, compression, gestion des tokens).

Articles liés

Découvrez d'autres articles sur des sujets similaires

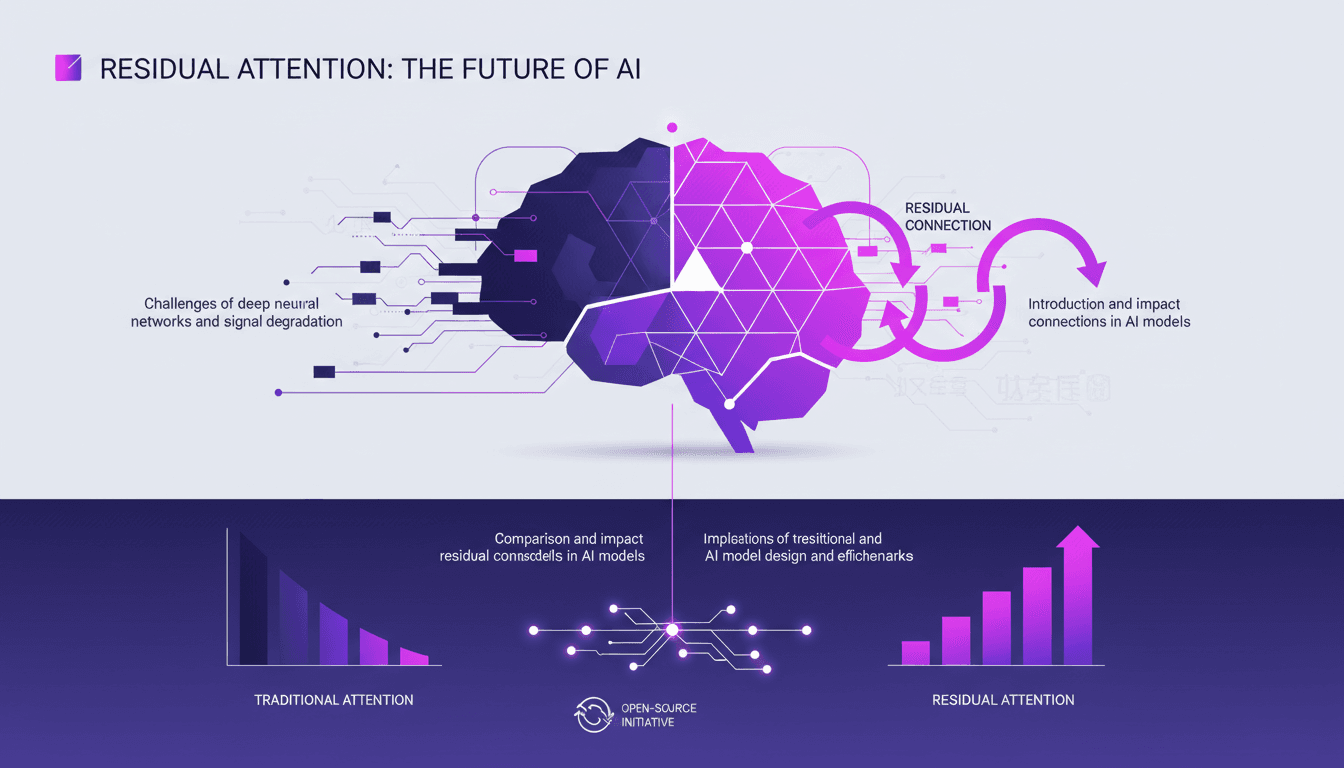

Percées en IA : Attention Résiduelle Révolutionne

Je me souviens la première fois que j'ai vu l'impact de l'attention résiduelle sur les modèles d'IA. C'était comme allumer un interrupteur. Tout d'un coup, les inefficacités qui hantaient l'apprentissage profond depuis des années étaient exposées et corrigées. Depuis 2015, les fondations de l'IA n'avaient pas bougé, mais cette percée change la donne. L'attention résiduelle améliore la dégradation du signal dans les réseaux de neurones profonds, rendant les modèles plus efficaces. Comparée aux méthodes traditionnelles, elle offre des performances supérieures sur les benchmarks. Avec l'open-source, l'impact potentiel est immense, surtout dans les laboratoires chinois où les contraintes matérielles stimulent l'innovation. Mais attention, ne sous-estimez pas la complexité de l'intégration.

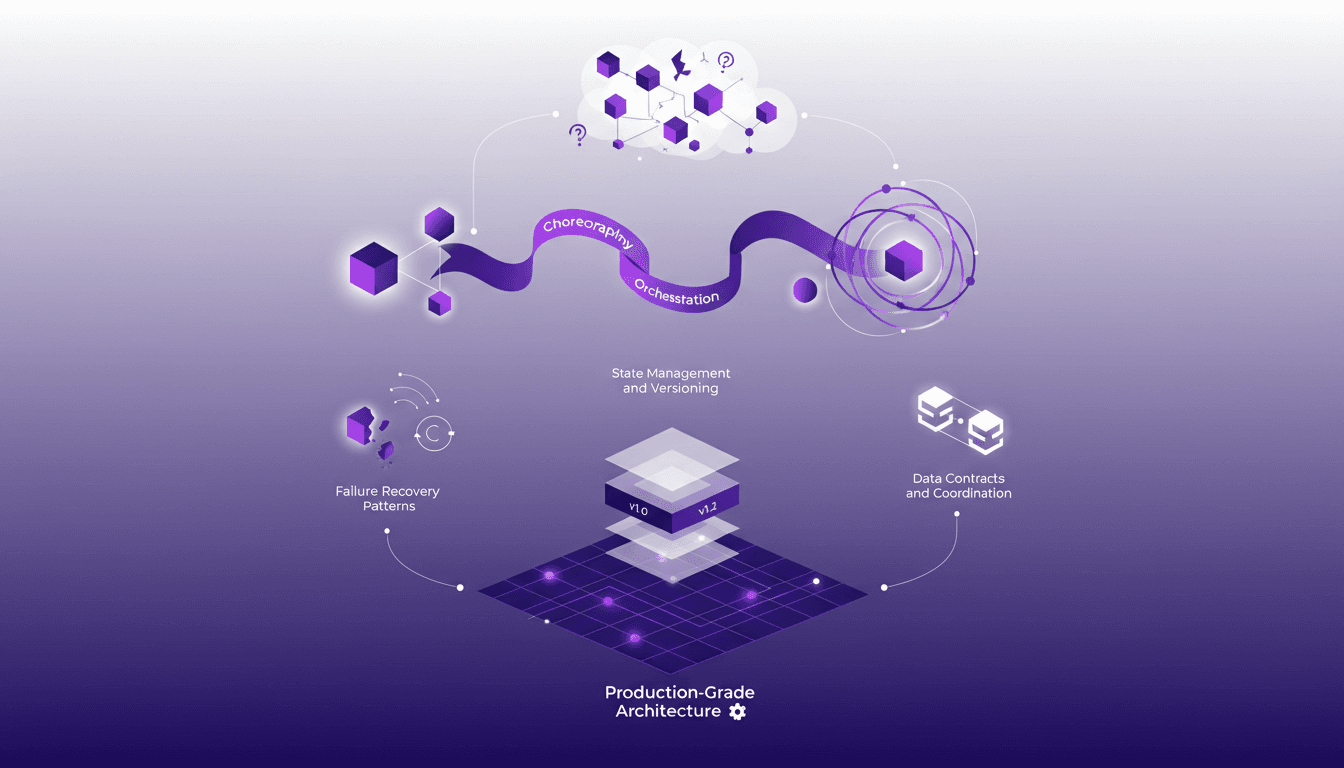

Orchestration Multi-Agent: Modèles qui Marchent

Après 18 ans à construire des systèmes de données, j’ai compris que le chaos est la norme sans la bonne orchestration. Dans les systèmes distribués, gérer plusieurs agents peut vite devenir un cauchemar. Mais en appliquant les bons modèles d'orchestration multi-agent, j'ai transformé cette complexité en une machine bien huilée. On plonge dans les stratégies réelles qui fonctionnent : de la gestion de l'état aux contrats de données, en passant par la récupération après échec. Si vous avez déjà vu deux agents calculer des scores de crédit différents pour le même client (750 contre 680), vous savez de quoi je parle. Bienvenue dans le monde de l'architecture de production multi-agent, là où chaque décision compte pour l'efficacité, le coût et la fiabilité.

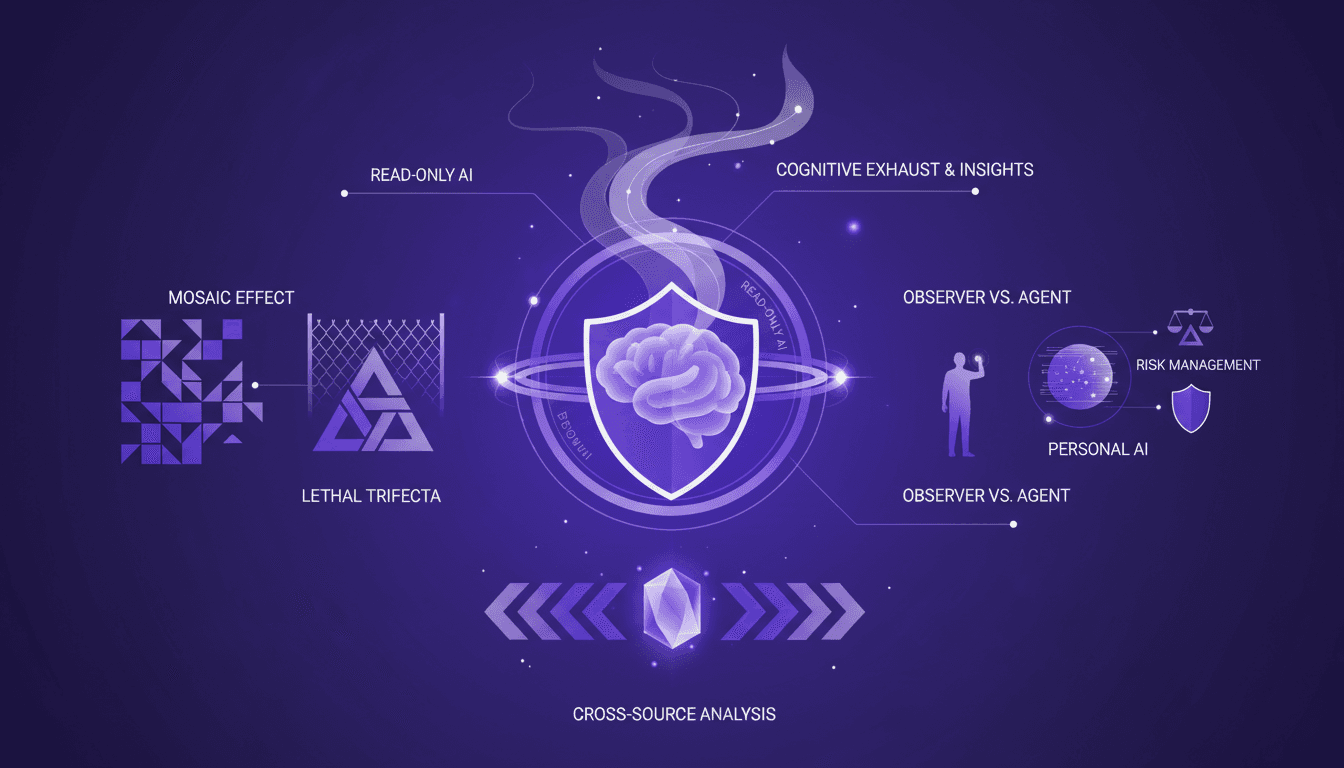

IA en lecture seule pour sécurité améliorée

J'ai passé assez de temps dans les tranchées de l'IA pour reconnaître ce qui est sous-estimé. L'IA en lecture seule, par exemple, peut transformer radicalement la sécurité et l'analyse. Imaginez un instant : réduire de 30 secondes vos vérifications météo. Cela peut paraître trivial, mais accumulez ces petits gains et vous comprendrez pourquoi je dis que c'est un game changer. Dans cette conférence, je partage comment l'IA en lecture seule peut non seulement optimiser votre flux de travail, mais aussi offrir une défense solide contre les fumées cognitives et l'effet mosaïque, deux concepts souvent négligés mais cruciaux pour tout praticien. Je vais vous montrer comment ces approches, combinées à une analyse croisée des sources, peuvent révéler des insights uniques et renforcer la sécurité de vos systèmes personnels d'IA.

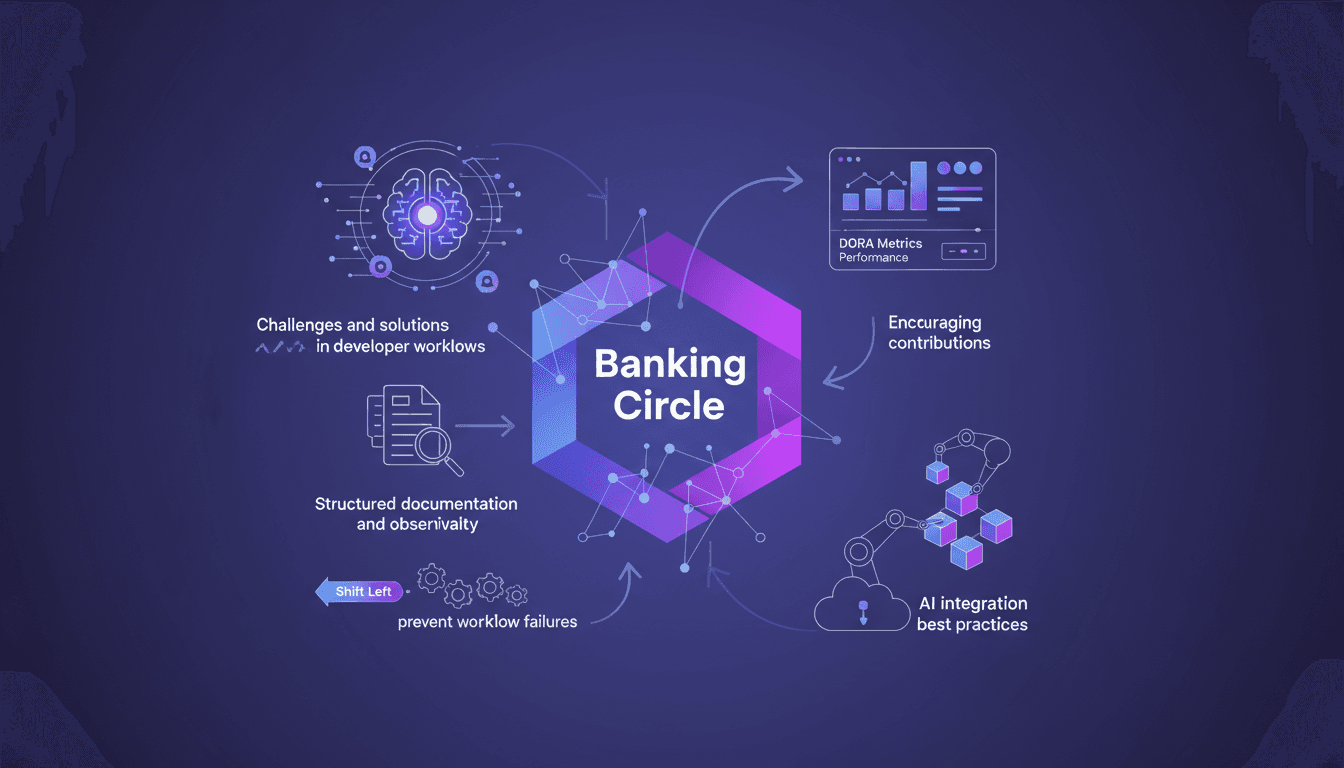

Ingénierie API: Cas Pratique et Intégration AI

J'ai passé des heures à plonger dans l'ingénierie des plateformes chez Banking Circle, où nous traitons la somme colossale de 1 000 milliards d'euros. Avec 700 institutions financières qui comptent sur nous, notre mission est de rationaliser les flux de travail via des solutions basées sur des API et l'intégration de l'IA. Mais rien n'est simple. Je vais vous montrer comment nous abordons ces défis : l'auto-service, les API, et l'intégration des agents IA. Notre équipe de 250 ingénieurs est à la pointe, utilisant des métriques comme Dora pour mesurer le succès. Venez découvrir comment nous anticipons les échecs de workflow avec des pratiques 'shift left' et encourageons les contributions à nos plateformes internes.

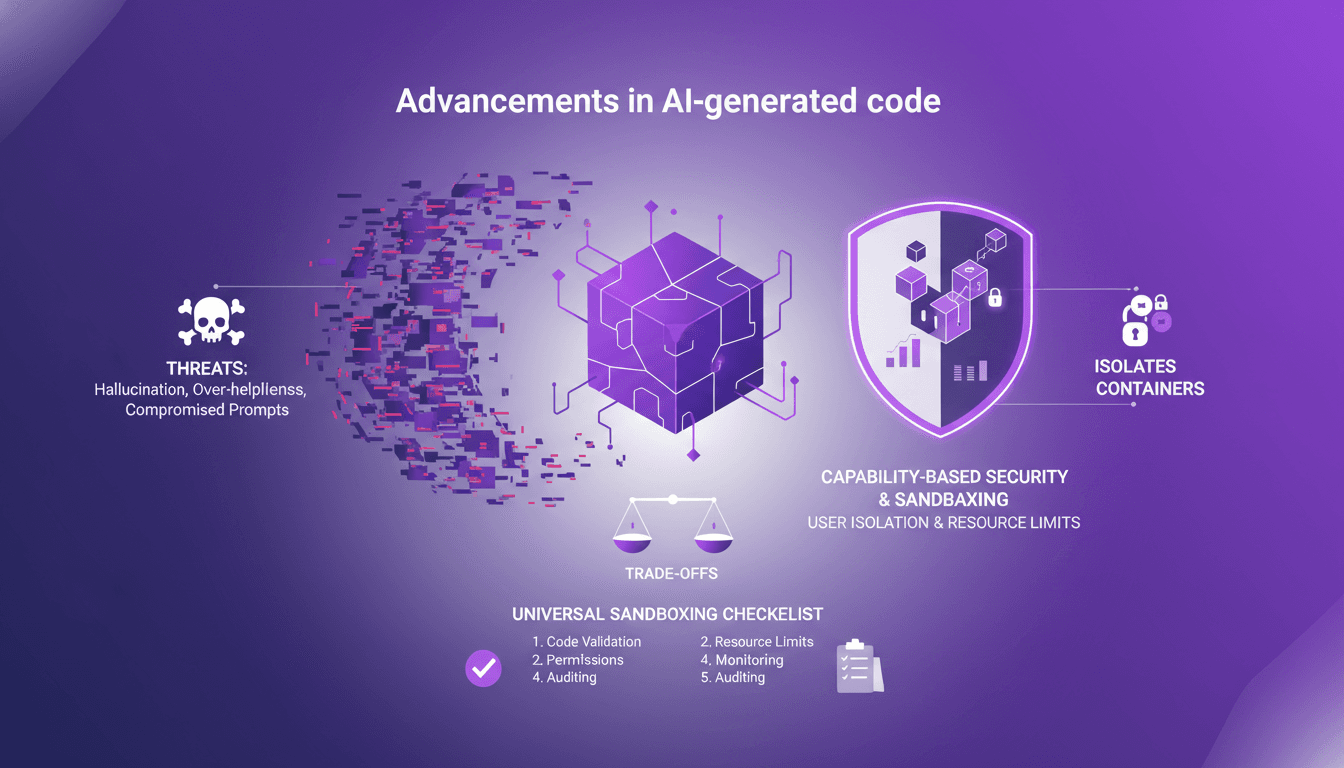

Sandboxing du code AI : Sécurisez vos projets

Je me suis fait avoir par du code généré par l'IA plus de fois que je ne voudrais l'admettre. Des hallucinations qui ont planté mon serveur aux suggestions 'trop utiles' qui m'ont mené dans des impasses. J'ai compris qu'il fallait absolument isoler ce code dans un bac à sable. D'abord, je vais expliquer pourquoi la mise en bac à sable est cruciale, puis comment je l'ai configurée pour protéger mes projets. Avec l'essor du code généré par l'IA, adopter des pratiques de sécurité solide est essentiel. Nous allons explorer les menaces posées par ce code et comment le sandboxing peut mitiger ces risques. (Indice : les conteneurs et les isolats ont leurs propres compromis.)