Extraction rapide d'intelligence audio: workflow AI

J'ai passé des heures interminables dans les centres de contact, où chaque minute est cruciale. Quand j'ai décidé de m'attaquer à l'extraction rapide d'intelligence à partir de flux audio chaotiques, je savais que je m'attaquais à un géant. Mais j'ai trouvé comment mécaniser le processus pour gagner du temps et améliorer l'efficacité. Les centres de contact, essentiels pour l'interaction avec les clients, sont confrontés à des défis majeurs : recrutement, formation, productivité. L'IA peut transformer le jeu, surtout pour résumer et extraire des données audio. Plongeons dans le workflow, l'architecture technique et les résultats.

Dans les centres de contact, chaque minute compte, et j’y ai passé assez de temps pour le savoir. Quand j'ai entrepris de mécaniser l'extraction rapide d'intelligence à partir de flux audio désordonnés, je savais que je m'attaquais à un mastodonte. Mais en orchestrant le bon workflow, j'ai réussi à transformer ce processus en quelque chose de beaucoup plus efficace. Les statistiques parlent d'elles-mêmes : plus de 50 % des centres de contact considèrent le recrutement, la formation et la productivité comme des obstacles critiques. Avec des appels moyens de 6,5 minutes et un temps de traitement post-appel de 6,3 minutes, il y a clairement de la marge pour améliorer. L'IA, avec sa capacité à résumer et extraire des données audio, peut vraiment changer la donne. Alors, comment j'ai fait ? Je vais partager mon expérience, de l'architecture technique à la mise en œuvre du workflow, en passant par les résultats concrets. Et bien sûr, quelques pièges à éviter en cours de route.

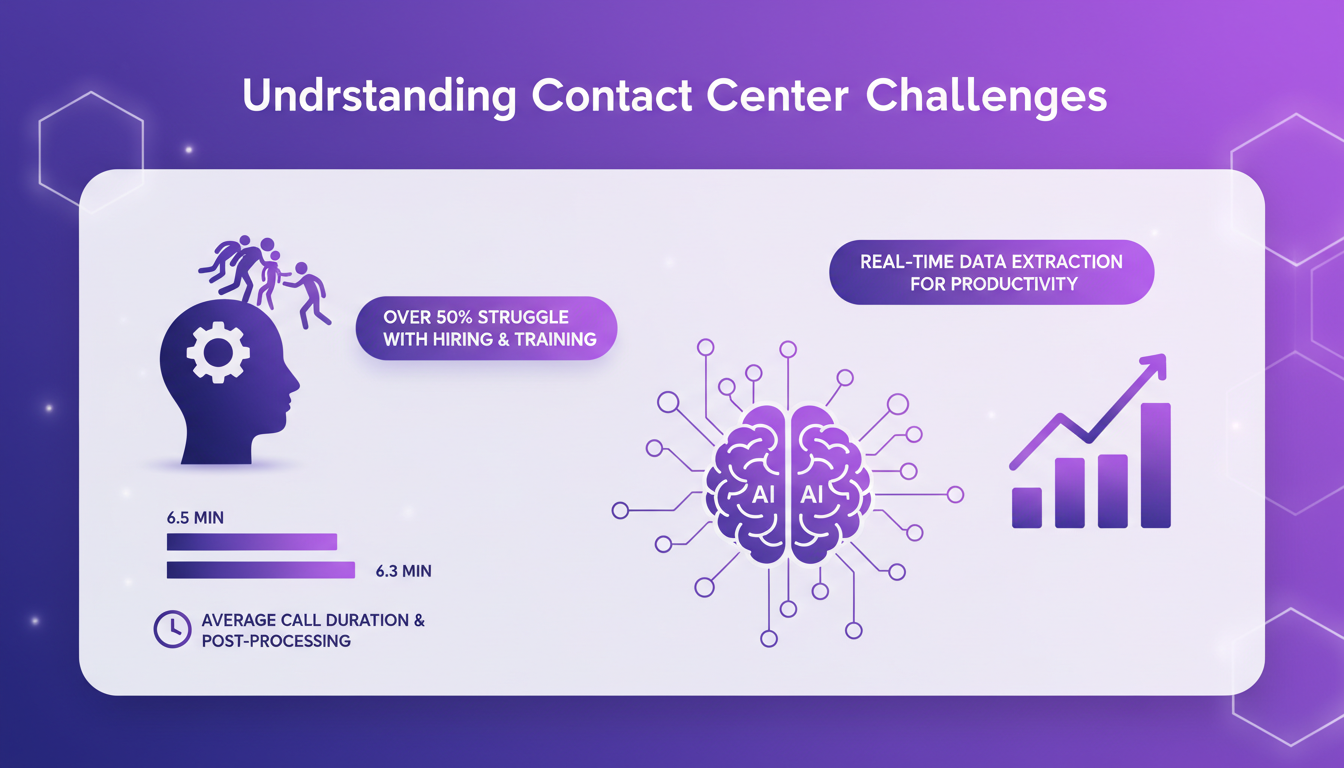

Comprendre les Défis des Centres de Contact

Dans le domaine des centres de contact, les défis sont nombreux et souvent sous-estimés. Plus de 50 % des centres de contact identifient l'embauche et la formation comme des obstacles critiques. C’est un chiffre qui parle de lui-même et qui montre à quel point il est difficile de maintenir une équipe opérationnelle efficace. En moyenne, la durée d'un appel est de 6,5 minutes, mais ce qui est frappant, c'est que le temps de post-traitement est presque identique, à 6,3 minutes. C’est une inefficacité flagrante.

Le besoin d'extraction de données en temps réel devient impératif pour booster la productivité et équilibrer le bien-être des opérateurs avec la gestion de la charge de travail. L'équilibre est délicat, mais nécessaire pour éviter le burnout des agents.

Mécanisation de la Résumé et de l'Extraction de Données

Pour répondre à ces défis, j'ai mis en place un moteur de reconnaissance vocale avec une précision de 90 %. C'est une étape essentielle, car sans une transcription précise, tout le reste du processus est compromis. J'ai optimisé l'utilisation des tokens pour réduire le temps de traitement, ce qui est crucial lorsque chaque milliseconde compte.

En utilisant l'IA générative et les LLM (modèles de langage de grande taille), nous avons pu extraire des données nuancées en temps réel. Mais attention, il y a toujours un compromis entre la vitesse et la précision dans le traitement en temps réel.

Implémentation du Flux de Travail AI et Résultats

J'ai intégré un flux de travail qui rationalise le traitement des données audio. Cela a considérablement réduit le temps de traitement après appel. Avant, nos opérateurs passaient presque autant de temps à traiter les données qu'à parler avec les clients. Grâce à l'IA, ce temps a été réduit de près de 50 %.

Les analyses de sentiment et acoustiques sont devenues plus précises, mais gare à l'optimisation des tokens, qui peut parfois devenir un piège.

Architecture Technique pour l'Extraction à Faible Latence

J'ai construit une architecture robuste pour le traitement en temps réel, en équilibrant la charge entre les modèles d'IA et les ressources système. C'est un défi constant de gérer les contraintes, mais avec des solutions évolutives, nous avons pu maintenir une performance optimale.

Notre feuille de route à venir inclut des améliorations continues et une mise à l'échelle pour répondre à des demandes croissantes. C'est un voyage sans fin, mais chaque étape nous rapproche d'un centre de contact plus efficace.

Bien-être des Opérateurs et Gestion de la Main-d'œuvre

Les outils d'IA soulagent les opérateurs des tâches répétitives, ce qui améliore la gestion de la main-d'œuvre grâce à des insights de données plus précis. La réduction potentielle du burnout est réelle, mais il est crucial de surveiller et d'adapter en fonction des retours des opérateurs.

Il est important de ne pas abuser des technologies et de veiller à ce qu'elles servent réellement les opérateurs plutôt que de les surcharger.

En intégrant l'extraction d'intelligence à faible latence dans les centres de contact, j'ai vraiment simplifié les workflows. Résultat ? Une productivité en hausse. On sait tous que recruter, former et maintenir la productivité, c'est la croix et la bannière pour plus de 50% des centres. Mais avec l'IA, on réduit le temps de traitement post-appel de 6,3 minutes en moyenne. C'est du concret, pas de la théorie.

- L'automatisation des résumés et l'extraction de données optimisent l'efficacité des opérateurs.

- La mise en œuvre de l'IA dans les workflows améliore la productivité globale.

- L'architecture technique pour une extraction rapide pose des défis, mais ça vaut le coup.

L'avenir ? Encore des défis à relever, mais le potentiel est là. Prêt à transformer votre centre de contact avec l'IA ? Discutons-en. Et pour ceux qui veulent aller plus loin, je vous conseille de regarder la vidéo originale de Dippu Kumar Singh. C'est une mine d'or pour comprendre comment extraire de l'intelligence de flux audio complexes. Voir la vidéo.

Questions Fréquentes

Thibault Le Balier

Co-fondateur & CTO

Issu de l'écosystème startup tech, Thibault a développé une expertise en architecture de solutions IA qu'il met aujourd'hui au service de grands groupes (Atos, BNP Paribas, beta.gouv). Il intervient sur deux axes : la maîtrise des déploiements IA (LLM locaux, sécurisation MCP) et l'optimisation des coûts d'inférence (offloading, compression, gestion des tokens).

Articles liés

Découvrez d'autres articles sur des sujets similaires

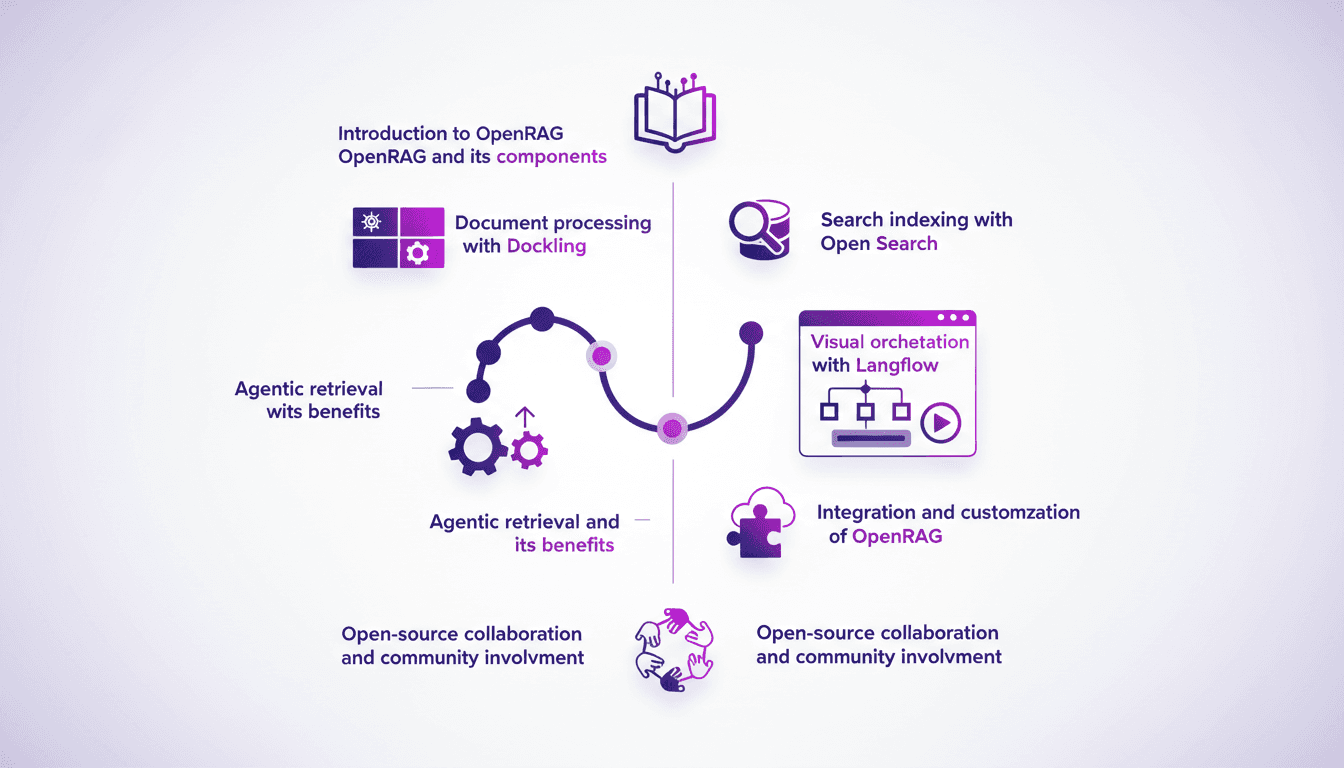

OpenRAG: Construire avec une pile open-source RAG

Avez-vous déjà essayé de construire une solution RAG à partir de zéro ? Je l'ai fait, et laissez-moi vous dire, OpenRAG est un véritable changeur de jeu. Ce n'est pas juste un autre ensemble d'outils—c'est une véritable puissance open-source pour la génération augmentée par récupération. Dans cet article, je vais vous guider à travers mon expérience avec OpenRAG, de la gestion des documents à l'indexation de recherche, et comment cela me fait gagner du temps et m'évite bien des maux de tête. Plongeons dans les composants et voyons comment ils s'intègrent dans un workflow d'IA robuste.

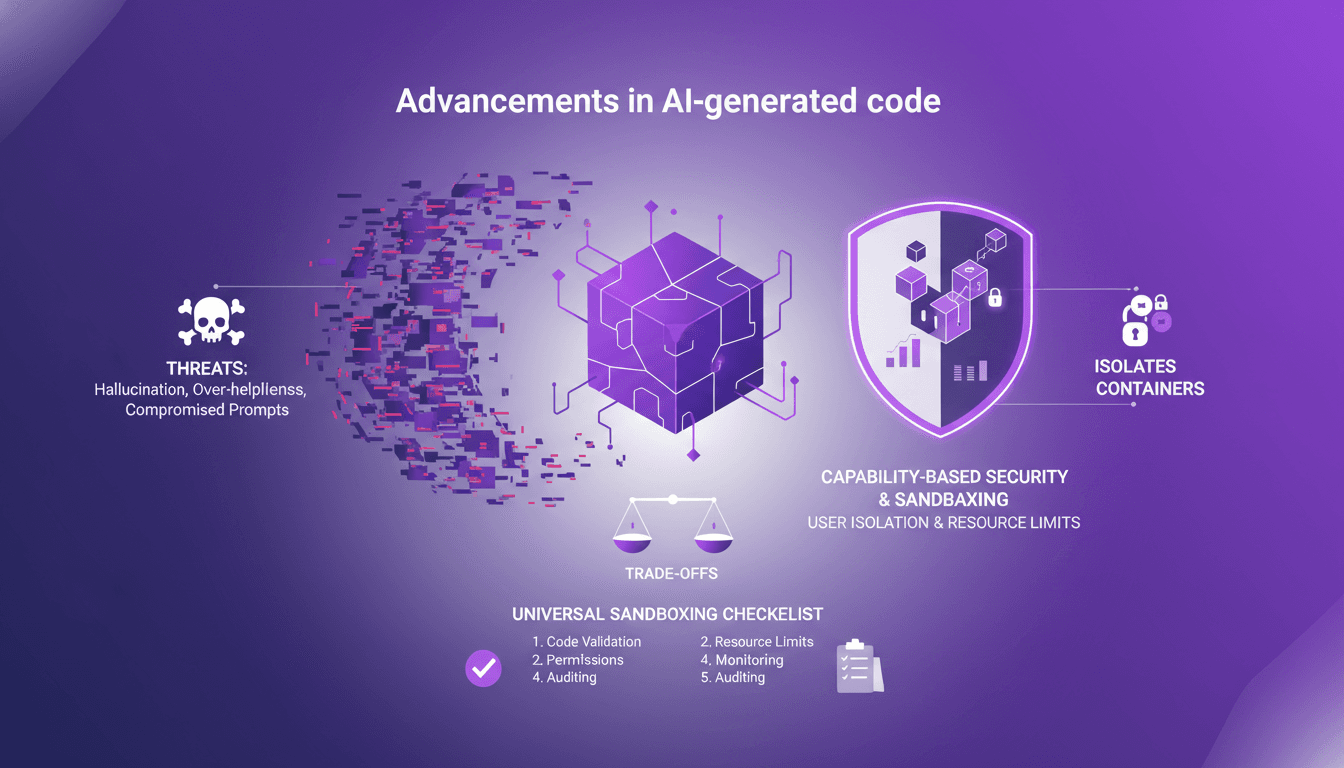

Sandboxing du code AI : Sécurisez vos projets

Je me suis fait avoir par du code généré par l'IA plus de fois que je ne voudrais l'admettre. Des hallucinations qui ont planté mon serveur aux suggestions 'trop utiles' qui m'ont mené dans des impasses. J'ai compris qu'il fallait absolument isoler ce code dans un bac à sable. D'abord, je vais expliquer pourquoi la mise en bac à sable est cruciale, puis comment je l'ai configurée pour protéger mes projets. Avec l'essor du code généré par l'IA, adopter des pratiques de sécurité solide est essentiel. Nous allons explorer les menaces posées par ce code et comment le sandboxing peut mitiger ces risques. (Indice : les conteneurs et les isolats ont leurs propres compromis.)

Percées en IA : Attention Résiduelle Révolutionne

Je me souviens la première fois que j'ai vu l'impact de l'attention résiduelle sur les modèles d'IA. C'était comme allumer un interrupteur. Tout d'un coup, les inefficacités qui hantaient l'apprentissage profond depuis des années étaient exposées et corrigées. Depuis 2015, les fondations de l'IA n'avaient pas bougé, mais cette percée change la donne. L'attention résiduelle améliore la dégradation du signal dans les réseaux de neurones profonds, rendant les modèles plus efficaces. Comparée aux méthodes traditionnelles, elle offre des performances supérieures sur les benchmarks. Avec l'open-source, l'impact potentiel est immense, surtout dans les laboratoires chinois où les contraintes matérielles stimulent l'innovation. Mais attention, ne sous-estimez pas la complexité de l'intégration.

Passer du Codage à l'Ingénierie Logicielle

J'ai passé assez de nuits blanches à coder pour comprendre que le vrai défi n'est pas la quantité de code qu'on écrit, mais les solutions qu'on livre. Dans un monde où on peut écrire du code 55 fois plus vite, l'erreur serait de rester focalisé sur la production de lignes de code. Ce qui compte vraiment c'est l'ingénierie logicielle axée sur la solution, l'adoption de l'IA, et comment on intègre tout ça dans nos plateformes. Si vous vous êtes déjà demandé pourquoi votre productivité ne s'améliore que de 14% malgré tous vos efforts, c'est peut-être parce que vous n'avez pas encore adopté cette approche holistique qui pousse au-delà du simple codage.

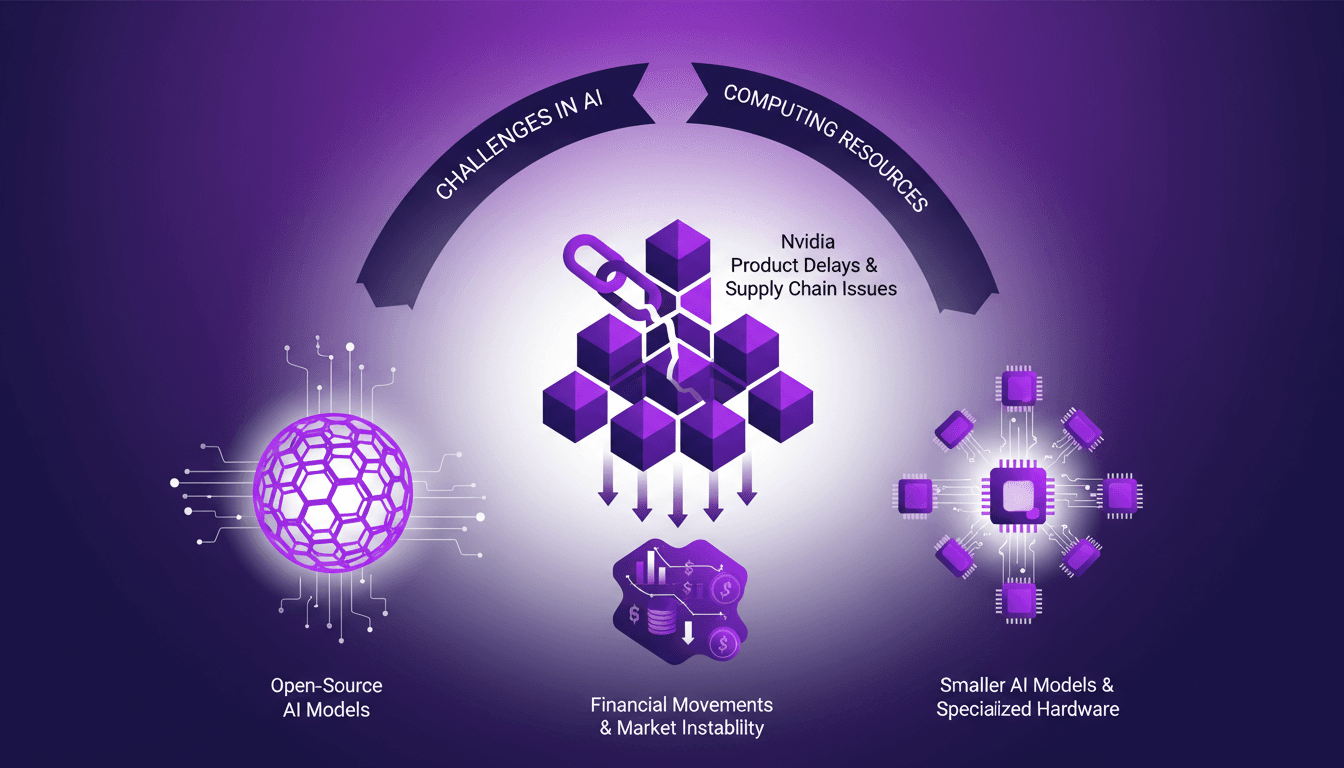

Défis Ressources IA: Nvidia, Open Source

Je me souviens de la première fois où j'ai heurté un mur avec les ressources de calcul pour l'IA. C'était comme essayer de courir un marathon sur un tapis roulant bloqué en mode marche. Dans ce paysage de l'IA en pleine évolution, nous faisons face à des défis bien réels, des retards de Nvidia à l'attrait croissant des modèles open-source. Le marché est en pleine ébullition, avec des annonces financières comme celles de Mistral qui ajoutent une couche de complexité supplémentaire. On doit naviguer à travers les pénuries de ressources, l'émergence de modèles d'IA plus petits, et les problèmes de chaîne d'approvisionnement qui affectent les délais de livraison des composants. Plongeons dans ces dynamiques avec un regard de praticien, en se concentrant sur les solutions pratiques et les compromis.