Construire des Juges LLM: Optimisation avec GAPA

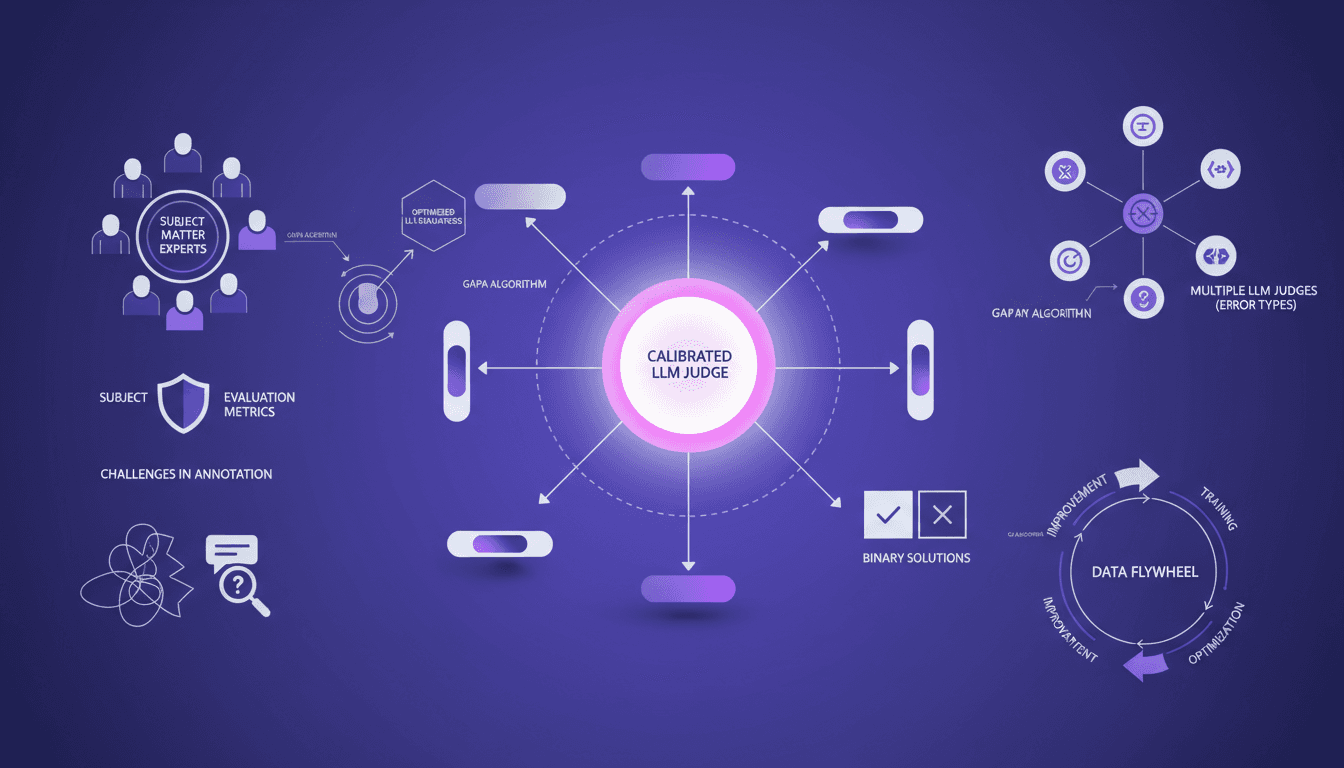

J'ai passé des années à construire des systèmes d'IA, et si j'ai bien appris une chose, c'est que des juges LLM calibrés sont cruciaux. Je vais vous expliquer comment j'utilise des outils comme l'algorithme GAPA pour optimiser ces évaluateurs, les rendant non seulement fonctionnels mais efficaces. Dans le développement de l'IA, la précision et la fiabilité des juges LLM peuvent faire ou défaire votre système. Avec des outils comme GAPA et des insights d'experts, nous pouvons affiner ces juges pour gérer des types d'erreurs spécifiques et s'améliorer continuellement grâce à une approche de roue de données. Je détaille comment les experts définissent les métriques d'évaluation, les défis de l'annotation des traces de conversation, et les stratégies pour construire plusieurs juges LLM pour des erreurs spécifiques. Avec le GI algorithm et une précision de 61% sur le jeu de validation, nous atteignons le par à la frontière. C'est un game changer, mais attention à ne pas brûler les étapes.

J'ai passé des années à peaufiner des systèmes d'IA et, croyez-moi, calibrer des juges LLM, c'est pas une option, c'est une nécessité. Imaginez votre système sans ça, c'est comme piloter à l'aveugle. Alors, je vous emmène dans ma routine : je connecte l'algorithme GAPA, j'oriente les métriques grâce à des experts, et je m'assure que ces évaluateurs ne soient pas juste des gadgets, mais bien des outils hyper efficaces. On parle de précision, de fiabilité — deux mots qui font toute la différence entre un projet qui cartonne et un qui s'écrase. Avec GAPA, et un coup de pouce de la part d'experts, je calibre les juges pour qu'ils gèrent des erreurs spécifiques et s'améliorent en continu — une vraie roue de données. Et puis, le GI algorithm qui arrive à 61% de précision sur le jeu de validation, ça vous parle ? C'est énorme, mais attention, faut pas griller les étapes. On plonge dans l'importance des métriques d'évaluation, les défis de l'annotation des traces de conversation, et comment construire plusieurs juges LLM pour des erreurs spécifiques. Vous allez voir, c'est un game changer.

Le Rôle des Juges LLM Calibrés

Dans le développement de l'IA, les juges LLM calibrés sont un peu comme le GPS de notre voiture : sans eux, on risque de se perdre dans un dédale d'évaluations biaisées. Pourquoi sont-ils si essentiels ? Parce qu'ils garantissent que nos modèles d'IA sont en phase avec les objectifs du projet, tant en test offline qu'en évaluation en ligne. J'ai appris à la dure que sans calibration, on peut se retrouver avec un biais de conformité à 98% lors des premiers essais.

Pour éviter les pièges d'un juge non calibré, j'oriente ces outils de manière à ce qu'ils ne soient pas seulement des suiveurs de conformité. La clé est de les aligner sur des annotations humaines, ce qui demande une itération constante, mais le jeu en vaut la chandelle. Attention : sans calibration, un juge pourrait privilégier la politesse plutôt que l'exactitude factuelle, ce qui est loin d'être idéal.

Optimisation avec l'Algorithme GAPA

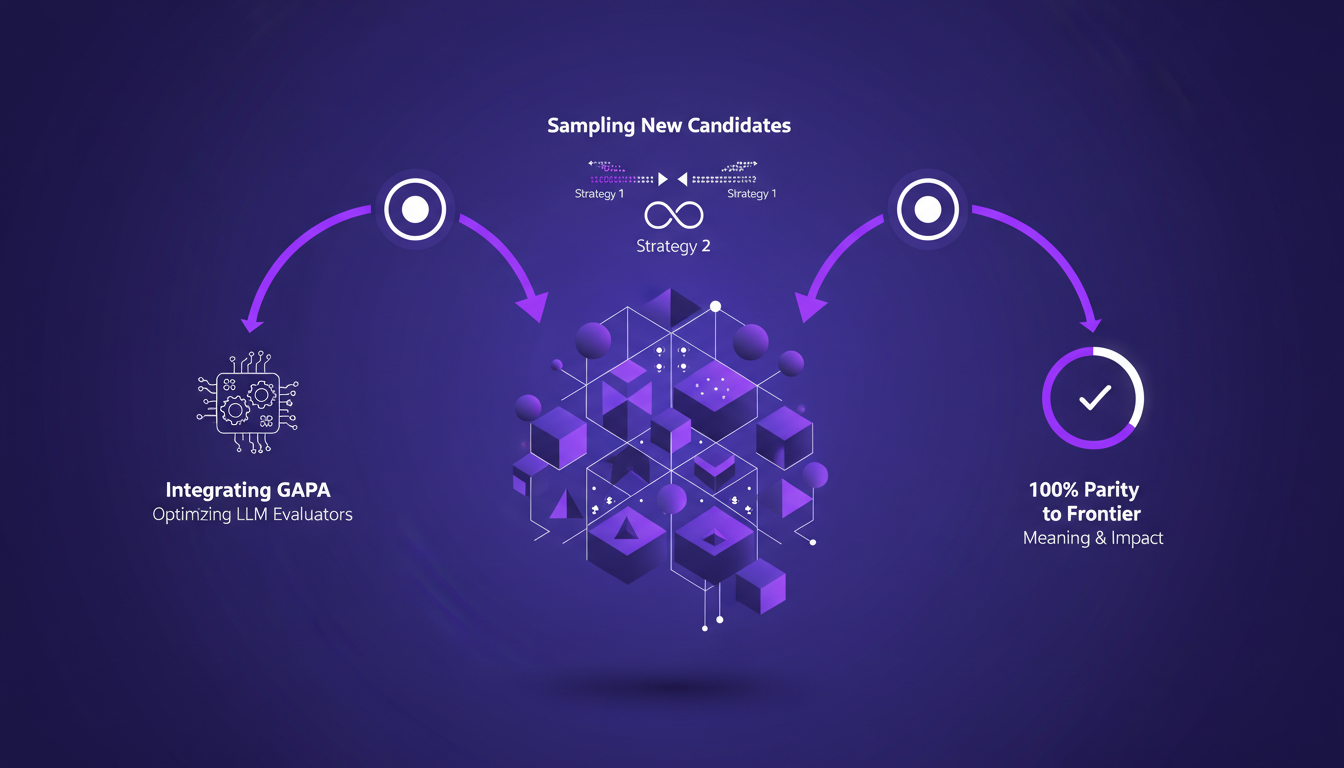

Quand on parle d'optimisation des évaluateurs LLM, l'algorithme GAPA est mon outil de prédilection. Je l'intègre pour optimiser les évaluateurs en utilisant deux stratégies de sampling dans l'algorithme GI. Parvenir à 100% sur le par to frontier est crucial : cela signifie qu'on a atteint la frontière de performance maximale.

Mais bien sûr, il y a des compromis. Parfois, l'optimisation nous pousse à atteindre une précision de 61% sur le jeu de validation, ce qui est correct, mais pas encore optimal. L'équilibre entre précision et performance est un exercice délicat, mais nécessaire pour ne pas perdre en efficacité.

Définir des Métriques avec des Experts en la Matière

Lorsque je travaille avec des experts pour définir les métriques d'évaluation, le défi est de faire en sorte que leurs intuitions s'alignent avec les besoins techniques. C'est là que les solutions binaires rentrent en jeu. Plutôt que de complexifier avec des systèmes de notation compliqués, on peut simplifier le processus d'apprentissage des juges LLM.

Éviter les erreurs courantes dans la définition des métriques est essentiel. Par exemple, trop se concentrer sur un aspect peut donner une image biaisée de l'évaluation globale. Ainsi, en collaborant avec des experts, on obtient une évaluation plus nuancée et adaptée aux cas d'usage spécifiques.

Relever les Défis d'Annotation et d'Évaluation

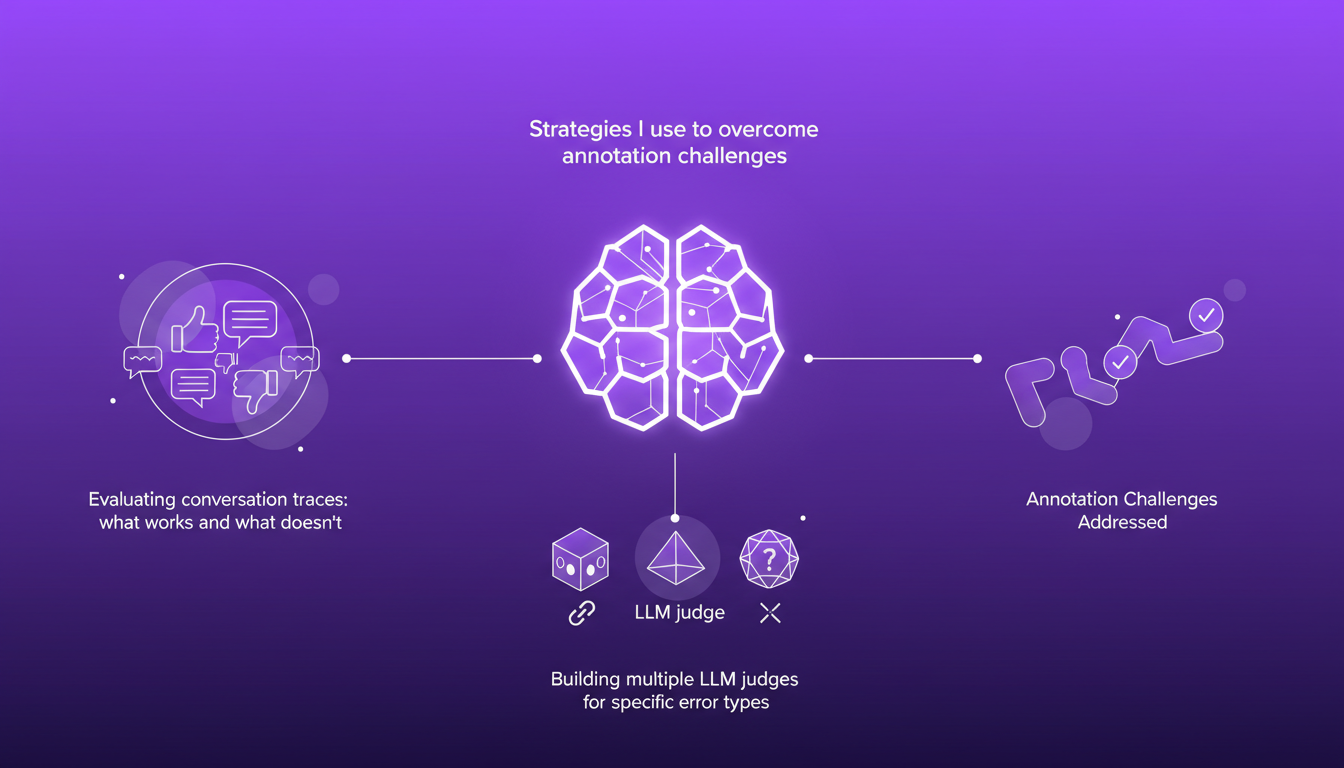

L'annotation peut être un véritable casse-tête, mais j'ai développé quelques stratégies pour surmonter ces obstacles. L'évaluation des traces de conversation, par exemple, nécessite une approche nuancée : certains types d'erreurs comme les problèmes d'adhésion aux politiques ou de style de réponse doivent être traités spécifiquement.

Construire plusieurs juges LLM pour différents types d'erreurs s'avère plus efficace qu'un juge unique pour tout évaluer. Cela dit, attention aux pièges courants de l'annotation, comme ignorer les erreurs mineures qui peuvent s'accumuler.

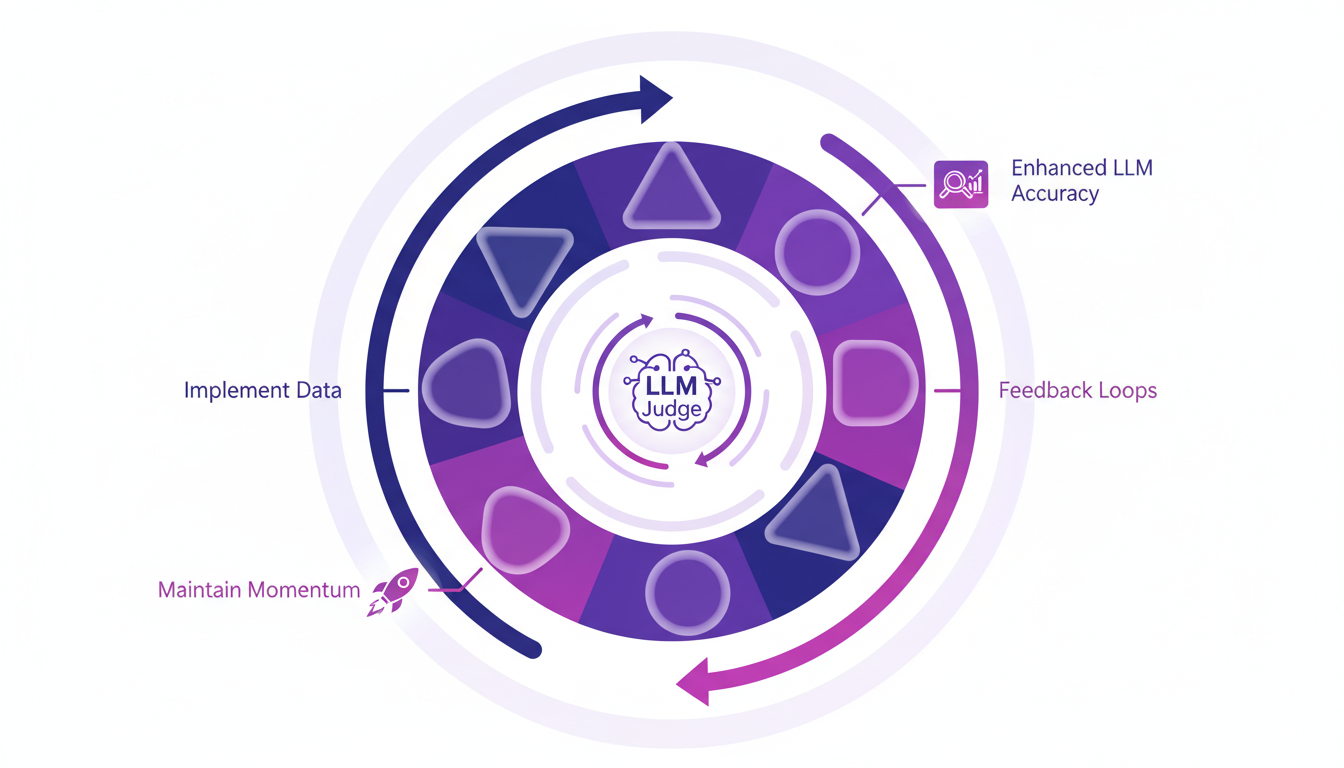

Amélioration Continue avec le Data Flywheel

La mise en œuvre d'un data flywheel est le Saint Graal pour l'amélioration continue de l'IA. Avec des boucles de rétroaction constantes, on améliore la précision des juges LLM et on garde le momentum dans les cycles de données. Des conseils pratiques ? Ne jamais sous-estimer le rôle de l'algorithme GI pour maintenir ces améliorations.

En fin de compte, l'optimisation continue de vos modèles passe par l'observation attentive des nouvelles données et l'ajustement en temps réel. Ne l'oubliez pas : plus on va vite, plus on s'améliore rapidement, mais toujours avec un œil critique sur la qualité des données.

Construire des juges LLM efficaces, ce n'est pas juste les mettre en place. C'est un travail continu d'optimisation et de collaboration avec des experts. Premier point clé : j'utilise l'algorithme GAPA pour affiner mes évaluateurs LLM. C'est vraiment un game changer pour atteindre une précision de 61% sur le jeu de validation. Ensuite, je m'assure d'intégrer les experts du domaine pour définir les métriques d'évaluation, parce qu'on ne sait jamais tout seul. Enfin, je gère les défis liés à l'annotation et à l'évaluation des traces de conversation, ce qui est souvent plus complexe qu'on le pense. Avec le bon volant de données, on peut atteindre le 100% par rapport à la frontière, mais attention aux limites : tout n'est pas parfait dès le départ. Pour l'avenir, je vois une transformation réelle en intégrant ces stratégies dans nos workflows AI. Maintenant, je vous encourage vivement à intégrer ces stratégies et à améliorer les performances de votre système. Regardez la vidéo 'Judge the Judge' de Mahmoud Mabrouk sur YouTube pour approfondir le sujet. C'est comme discuter avec un collègue qui a de l'expérience sur le terrain.

Questions Fréquentes

Thibault Le Balier

Co-fondateur & CTO

Issu de l'écosystème startup tech, Thibault a développé une expertise en architecture de solutions IA qu'il met aujourd'hui au service de grands groupes (Atos, BNP Paribas, beta.gouv). Il intervient sur deux axes : la maîtrise des déploiements IA (LLM locaux, sécurisation MCP) et l'optimisation des coûts d'inférence (offloading, compression, gestion des tokens).

Articles liés

Découvrez d'autres articles sur des sujets similaires

Mythos : Révolution et Risques en Cybersécurité

Je suis tombé sur Mythos lors d'un audit de sécurité, et là, tout a changé. Imaginez dénicher des vulnérabilités qui se cachaient depuis des décennies avec un modèle d'IA qui ne coûte que 50 dollars par exploit. Incroyable, non ? Mais attention, ce n'est pas sans risques. Dans le monde de la cybersécurité, Mythos bouleverse le paysage en découvrant des vulnérabilités zero-day qui échappaient à la détection depuis des années. Mais avec un tel pouvoir vient une grande responsabilité. Découvrons ensemble comment Mythos révolutionne l'industrie de la cybersécurité et ce qu'il faut surveiller de près.

Impact de l'IA sur le Développement Web: Pratique

La première fois que j'ai intégré l'IA dans mon flux de travail de développement web, c'était comme ajouter un moteur turbo à une voiture classique. Tout était soudainement plus rapide et efficace. Mais attention, comme tout outil puissant, l'IA apporte son lot de défis. Plongeons-nous dans la manière dont l'IA redéfinit le développement web. De l'optimisation du code aux navigateurs propulsés par l'IA, on se retrouve face à une révolution. J'ai construit deux compétences personnalisées avec un créateur de compétences, et en six mois, la qualité des modèles d'IA a bouleversé le jeu pour les développeurs web. Voyons comment naviguer dans ce nouvel horizon.

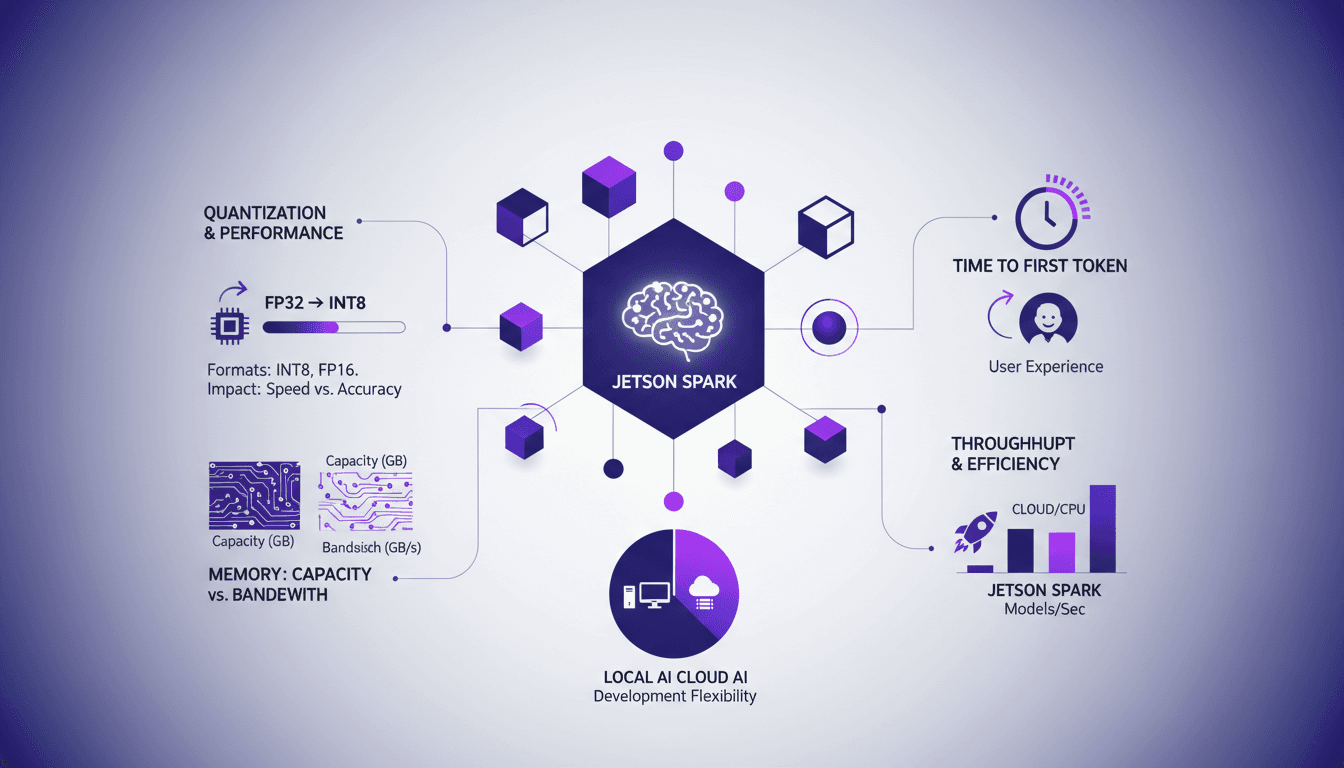

Jetson Spark: Exploiter sa puissance en local

J'ai plongé les mains dans le cambouis avec Jetson Spark, et croyez-moi, exécuter des modèles de langage de grande taille localement change la donne. Je vais vous montrer comment j'ai configuré mon environnement, les embûches que j'ai rencontrées, et l'impact réel sur le terrain. Avec ses 128 Go de mémoire unifiée, le Jetson Spark permet de manipuler des modèles de 200 milliards de paramètres directement sur site. Mais attention, sans une bonne gestion de la quantification et de la bande passante mémoire, vous risquez de vous brûler les ailes. En comparant le développement AI local avec les solutions cloud, je partage mes conclusions sur l'efficacité et le débit des modèles. Si vous êtes curieux de savoir comment le Jetson Spark se mesure aux solutions cloud, cet article est pour vous.

Traitement du Cancer: AI et Séquençage Cellulaire

Je me souviens du jour où Sid Severy a partagé son parcours avec nous. Ce n'était pas seulement une lutte contre le cancer; c'était une réécriture des règles avec l'IA et la technologie médicale de pointe. Imaginez utiliser l'IA et le séquençage cellulaire pour révolutionner un plan de traitement. Dans cette conférence, je vais plonger dans l'histoire de Sid, un microcosme de comment l'IA redéfinit le traitement du cancer. On parle de vaccins personnalisés à ARNm et de naviguer dans le processus d'approbation de l'IMD pour patient unique de la FDA. Accrochez-vous, c'est là où la technologie rencontre la médecine de front.

Exploration d'idées avec Codex: Efficacité Maximale

Je me souviens encore de la première fois où j'ai intégré Codex dans notre flux de travail chez Braintrust. C'était comme actionner un interrupteur sur notre processus d'innovation. Les idées, qui flottaient auparavant, se transformaient en prototypes concrets que nous pouvions tester et itérer en temps réel. Dans cet article, je vais vous montrer comment Codex a révolutionné notre manière de gérer les retours clients et d'innover. On parle d'une exploration d'idées ultra-efficace, de feedback en temps réel et d'une boucle de rétroaction raccourcie. Avec Codex, nous engageons nos clients de manière active et générons des retours de haute qualité.