Clonage Vocal : Modèle Efficace pour Usage Commercial

Je me suis lancé dans le clonage vocal par nécessité—mes clients avaient besoin de voix off uniques sans les interminables sessions d'enregistrement. C'est là que je suis tombé sur ce modèle de clonage vocal. Premier réflexe? Le comparer à Eleven Labs pour voir s'il tenait la route. Le clonage vocal, ce n'est pas juste imiter des tons—c'est créer une solution évolutive pour des applications commerciales. Dans cet article, je vous emmène dans les coulisses de ce modèle : ses forces, ses faiblesses et les limitations à surveiller. Si vous avez déjà joué avec le clonage vocal, vous savez que les spécifications techniques et les considérations légales sont essentielles. Je vais vous guider à travers les nuances du modèle, son potentiel commercial, et comment il se compare vraiment à Eleven Labs.

J'ai plongé dans le clonage vocal par pure nécessité. Mes clients avaient besoin de voix off uniques sans passer par des sessions d'enregistrement interminables. Et c'est là que j'ai découvert ce modèle de clonage vocal. Mon premier réflexe ? Le confronter à Eleven Labs pour voir s'il peut vraiment rivaliser. Le clonage vocal, ce n'est pas juste imiter des tons—c’est une solution scalable pour des applications commerciales. Alors, si vous êtes comme moi, un praticien qui cherche à optimiser ses workflows, cet article est pour vous. Je vais vous parler des spécifications techniques, des points forts, mais aussi des pièges à éviter. Par exemple, avez-vous déjà pensé à la question de la licence commerciale ? Ou encore, comment gérer l'accent et le support linguistique ? Attention, au-delà d'un certain seuil, les limites du modèle deviennent apparentes, et c'est là que vous pouvez vous faire avoir. Allez, embarquez avec moi et voyons comment ce modèle se compare vraiment à Eleven Labs.

Présentation du Modèle de Clonage Vocal

J'ai récemment mis la main sur un modèle de clonage vocal qui pourrait bien changer la donne pour les professionnels du secteur. En premier lieu, on parle ici d'un modèle avec 500 millions de paramètres, sous licence MIT, ce qui signifie que vous pouvez l'exploiter commercialement sans vous poser de questions juridiques interminables. Contrairement aux systèmes traditionnels de text-to-speech, ce modèle excelle dans le clonage vocal. J'ai été frappé par la profondeur et la naturalité des voix générées, même par rapport à des solutions déjà établies. Je me suis fait avoir plusieurs fois par la ressemblance avec des voix réelles.

C'est un modèle qui ne se contente pas de lire un texte, mais qui imite les nuances vocales d'une personne donnée. Si vous avez déjà utilisé des outils comme Eleven Labs, vous serez intéressé de savoir que selon un sondage, 31 personnes sur 50 préfèrent ce modèle à Eleven Labs.

Comparaison avec Eleven Labs

En explorant les préférences des utilisateurs, j'ai remarqué que ce modèle est souvent choisi pour sa rapidité et sa précision. Alors que Eleven Labs a ses qualités, notamment en matière d'intonation et d'émotion, ce modèle-ci passe à la vitesse supérieure avec une qualité sonore et une fluidité qui m'ont vraiment impressionné. Le temps de génération du son est plus rapide sur les configurations que j'ai testées.

Voici un aperçu des comparaisons :

| Critère | Modèle de Clonage Vocal | Eleven Labs |

|---|---|---|

| Vitesse | 8 secondes pour un clip de 12 secondes | Variable |

| Précision | Très précise | Bonne |

| Naturel | Élevée | Élevée |

Malgré ses avantages, Eleven Labs garde l'avantage sur certains aspects émotionnels, mais c'est une question de préférence personnelle selon moi.

Spécifications Techniques et Paramètres

Passons maintenant aux détails techniques. Ce modèle utilise la Classifier Free Guidance (CFG), un paramètre clé qui oriente la génération vocale sans classificateur. En ajustant ce paramètre, j'ai pu influencer l'expressivité du modèle, ce qui est crucial pour des voix plus dynamiques. Attention toutefois, une exagération excessive peut conduire à une instabilité. Je me suis fait avoir en poussant certains paramètres trop loin, et le résultat était un son déformé.

Pour optimiser les profils vocaux, j'ai réglé les paramètres de manière itérative :

- Commencez par des valeurs de CFG modérées pour tester la stabilité.

- Ajustez progressivement l'exagération pour plus d'expressivité.

- Évitez de pousser au-delà de 0.8 si vous ne voulez pas risquer une dégradation de la qualité.

Soutien des Accents et des Langues

Ce modèle est non seulement versatile en termes d'accents, mais il gère également plusieurs langues avec une efficacité impressionnante. J'ai testé avec des voix anglaises, françaises et même espagnoles, et la qualité reste constante. Cependant, j'ai remarqué que certains accents plus exotiques peuvent manquer de finesse. C'est là que le modèle montre ses limites, mais dans la plupart des cas d'utilisation courants, cela fonctionne très bien.

Pour un client, j'ai orchestré une campagne publicitaire multilingue qui a reçu des retours positifs, notamment grâce à cette flexibilité linguistique.

Formation du Modèle, Sourcing des Données et Considérations Légales

Le modèle a été entraîné sur 500 millions d'heures de données nettoyées. Ça semble colossal, et ça l'est. Cela signifie qu'il y a une vaste base de données qui alimente chaque nuance vocale. Cependant, il est crucial de veiller aux aspects légaux, notamment le watermarking des sorties pour éviter les soucis de droits d'auteur. Je vous conseille vivement de suivre ces pratiques pour protéger votre travail.

En ce qui concerne la licence, l'utilisation commerciale est facilitée par la licence MIT, mais soyez vigilants aux implications légales dans votre secteur spécifique.

En résumé, ce modèle de clonage vocal est une avancée significative pour les créateurs de contenu et les entreprises cherchant à intégrer des solutions vocales plus naturelles et précises. Cependant, maîtriser les paramètres et comprendre les restrictions légales sont essentiels pour en tirer le meilleur parti.

Naviguer dans le monde du clonage vocal, ce n'est pas juste une question de spécifications techniques, c'est trouver l'outil qui s'intègre parfaitement à ton workflow et répond aux besoins de tes clients. J'ai testé ce modèle comme alternative robuste à Eleven Labs, mais attention, chaque outil a ses petites particularités. Quelques points à retenir :

- 500 millions d'heures de données nettoyées, ça donne une idée de la puissance derrière ce modèle.

- Comparé aux 11 labs que j'ai déjà utilisés, celui-ci offre des nuances intéressantes.

- Petit bémol, les licences commerciales peuvent être un peu complexes à naviguer.

En regardant vers l'avenir, ce modèle de clonage vocal pourrait bien révolutionner nos projets audio, mais il faut rester vigilant aux limitations des paramètres techniques.

Prêt à le tester toi-même ? Plonge-toi dedans, ajuste les paramètres, et vois comment ça transforme tes projets. Partage tes expériences et affinons ensemble nos workflows. Pour une compréhension plus poussé, je t'invite à regarder la vidéo complète ici : Lien YouTube.

Questions Fréquentes

Thibault Le Balier

Co-fondateur & CTO

Issu de l'écosystème startup tech, Thibault a développé une expertise en architecture de solutions IA qu'il met aujourd'hui au service de grands groupes (Atos, BNP Paribas, beta.gouv). Il intervient sur deux axes : la maîtrise des déploiements IA (LLM locaux, sécurisation MCP) et l'optimisation des coûts d'inférence (offloading, compression, gestion des tokens).

Articles liés

Découvrez d'autres articles sur des sujets similaires

Kokoro TTS : le roi du Text-to-Speech

J'ai découvert Kokoro TTS en cherchant une solution Text-to-Speech robuste et économique. Contrairement aux options surévaluées qui épuisent votre budget, Kokoro propose une alternative rafraîchissante avec sa licence Apache 2.0. Je compare ici Kokoro à 11 Labs et explique pourquoi ce pourrait être votre prochain outil de prédilection. Avec 10 packs de voix uniques et un classement impressionnant sur la leaderboard de Hugging Face TTS Arena, Kokoro ne se contente pas de promettre, il délivre. Je passe en revue ses spécifications techniques, ses cas d'utilisation et sa facilité d'implémentation pour vous montrer comment l'intégrer efficacement dans vos projets.

Kokoro TTS : Leader Open Source en Synthèse Vocale

Je suis tombé sur Kokoro TTS en cherchant une alternative gratuite aux solutions de synthèse vocale payantes comme ElevenLabs. Ce modèle open-source n'est pas juste une copie, c'est une véritable révolution dans l'univers TTS. Avec 82 milliards de paramètres et une licence Apache 2.0, il est parfait pour les applications commerciales. Je compare ses performances avec celles d'ElevenLabs, notamment en termes d'expressivité émotionnelle et de précision de prononciation. Vous pouvez l'intégrer facilement dans vos projets grâce à sa simplicité d'utilisation et ses packs vocaux uniques. Suivez-moi pour explorer comment ce modèle peut transformer vos applications audio.

Manus AI : Automatisation et Créativité Réinventées

Je me suis plongé dans Manus AI, pensant que c'était juste un outil de plus, mais il a bouleversé mon flux de travail. De la programmation de jeux à la planification de voyages, cet agent AI est un véritable game changer. Développé par Meta GPT, il offre une réalisation de tâches en zero-shot qui va au-delà du battage médiatique. Je vais vous montrer comment je l'ai intégré dans mes projets quotidiens. Mais attention, il faut connaître ses limites et savoir l'orchestrer efficacement. Et puis il y a Open Manis, l'alternative open-source, qui a déjà récolté 8 000 étoiles sur son repo. Prêt à découvrir ce que Manus peut vraiment faire ?

Modèles StepFun AI : Efficacité et Impact Futur

J'ai plongé dans l'écosystème de StepFun AI, intrigué par ses capacités de génération de vidéo à partir de texte. En explorant ses modèles et ses métriques de performance, j'ai découvert un acteur ambitieux venu de Chine. Avec 30 milliards de paramètres et la capacité de générer jusqu'à 200 images par seconde, StepFun AI promet de secouer le paysage de l'IA. Mais attention, le modèle Step video t2v nécessite 80 Go de mémoire GPU. Comparé à d'autres modèles, il y a des compromis à considérer, mais son potentiel est indéniable. Découvrons ensemble ce qui fait la force de StepFun AI et comment il pourrait redéfinir l'industrie.

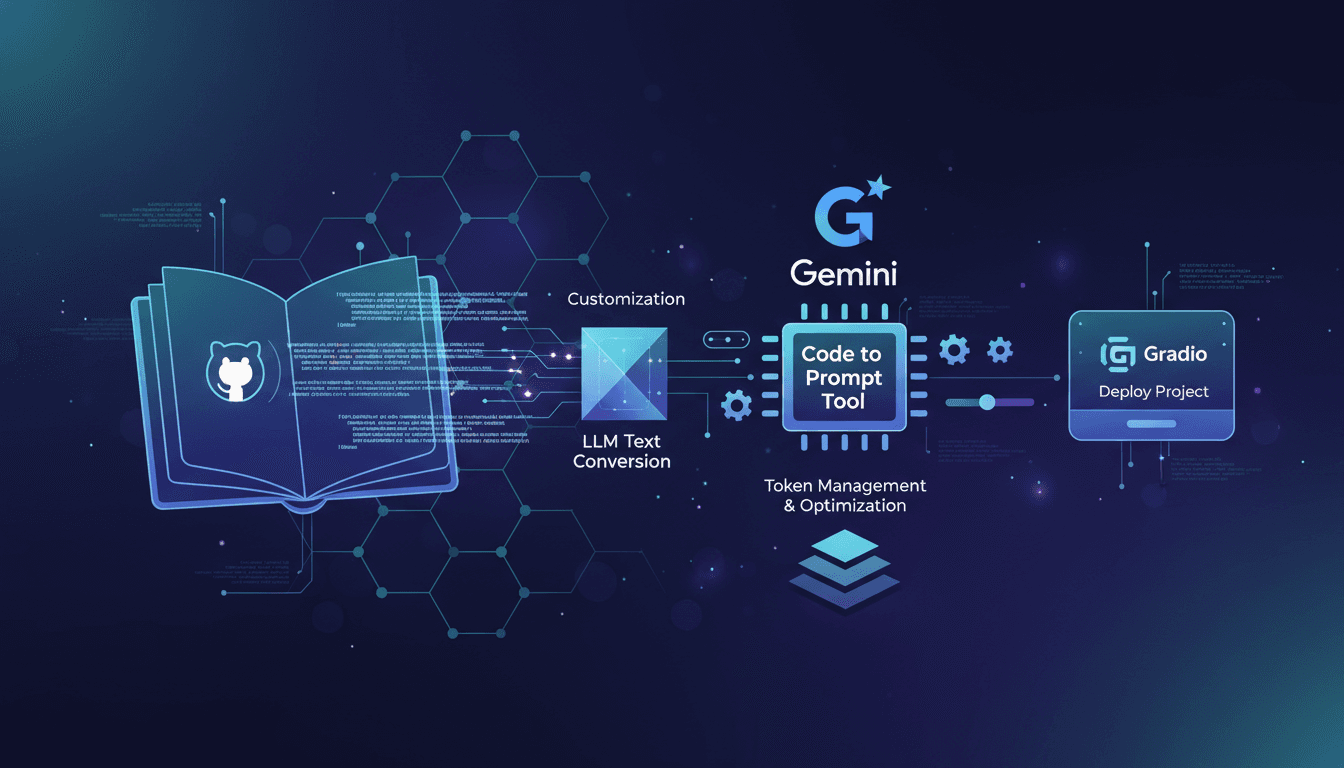

Transformer dossier en LLM rapidement

Vous avez déjà regardé un amas de code en vous demandant comment le rendre intelligible en un claquement de doigts ? Eh bien, c'est exactement là qu'intervient Code to Prompt. J'ai traversé ça et voici comment j'ai fait fonctionner ce processus. On va plonger dans la transformation des dépôts GitHub en texte compatible avec les modèles LLM en utilisant cet outil, et tirer parti de Google Gemini. Il s'agit de rendre vos bases de code non seulement lisibles, mais exploitables. Je vous guide à travers l'intégration de Code to Prompt, l'optimisation de la gestion des tokens, et le déploiement de projets avec le code Gradio. Un vrai changement de jeu, mais attention aux limites des tokens.