Optimiser Réseaux IA: Défis et Solutions

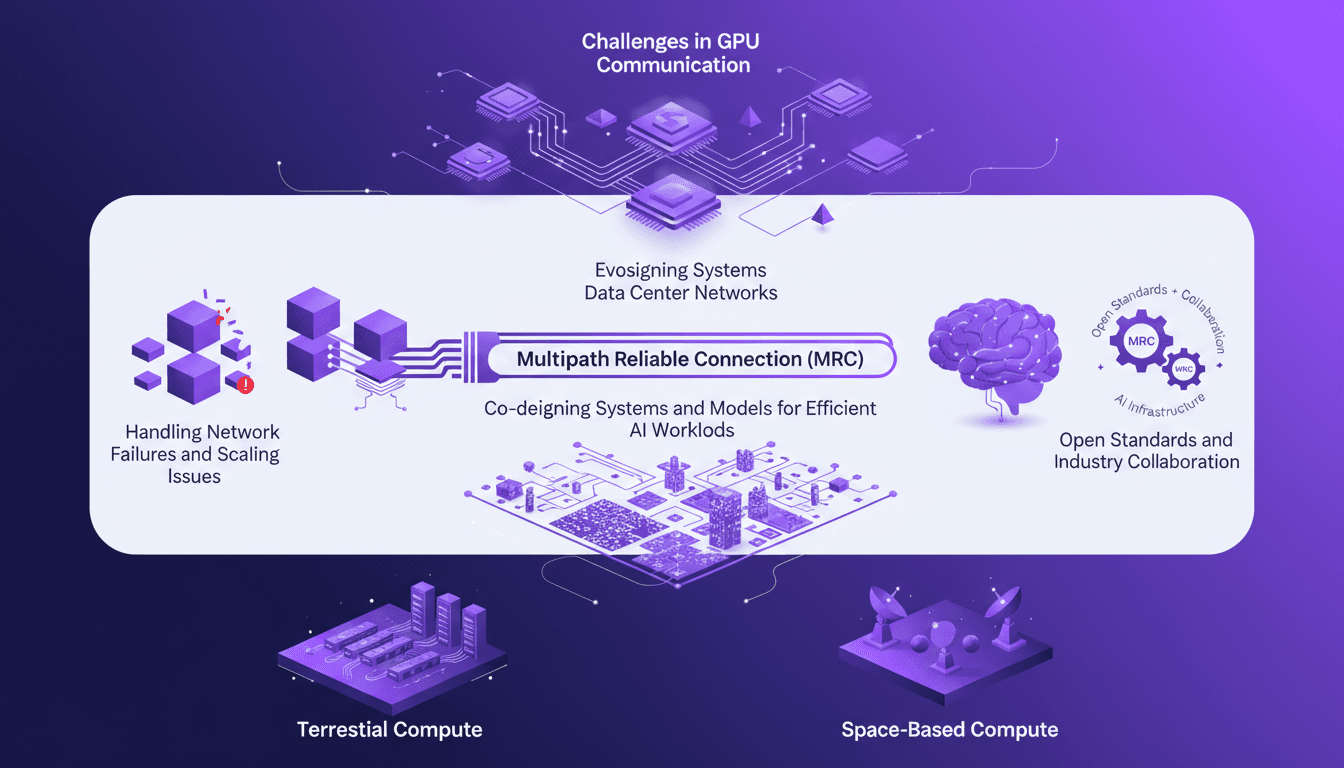

J'ai passé des heures à batailler avec les complexités de l'entraînement des modèles IA, et une chose est claire : notre infrastructure réseau actuelle, c'est comme rouler une Formule 1 dans les rues de Paris. Les modèles IA ont besoin de circuits rapides, pas de bouchons. En explorant les défis de communication GPU et l'évolution des réseaux de centres de données, je me suis rendu compte que l'IA nécessite un réseau de superordinateurs d'un genre nouveau. On doit co-concevoir systèmes et modèles pour des charges IA efficaces, gérer les pannes réseau, et envisager l'intégration verticale. Explorons comment ces éléments peuvent transformer notre approche des centres de données (et pourquoi les standards ouverts sont cruciaux).

J'ai passé des heures à jongler avec les subtilités de l'entraînement des modèles IA, et si j'ai bien appris une chose, c'est que notre infrastructure réseau actuelle ne fait pas l'affaire. Imaginez rouler une voiture de course sur une route de campagne sinueuse – on gaspille toute la puissance. Nos modèles IA sont comme ces bolides, et avec l'évolution rapide de l'IA, il est temps de repenser la conception et la mise en œuvre des réseaux de centres de données. D'abord, il y a les défis de communication GPU – parfois, dix personnes choisissent le même chemin, et le réseau ralentit à vue d'œil. Ensuite, il faut parler de la connexion fiable multipath (MRC) et de son impact. Et là, on doit co-concevoir les systèmes et modèles pour des charges de travail IA vraiment efficaces. Enfin, il y a la gestion des pannes réseau et les problèmes de mise à l'échelle, sans oublier l'importance des standards ouverts et de la collaboration dans le secteur. Alors plongeons dans ce podcast, et voyons pourquoi l'IA a besoin d'un nouveau type de réseau de superordinateurs.

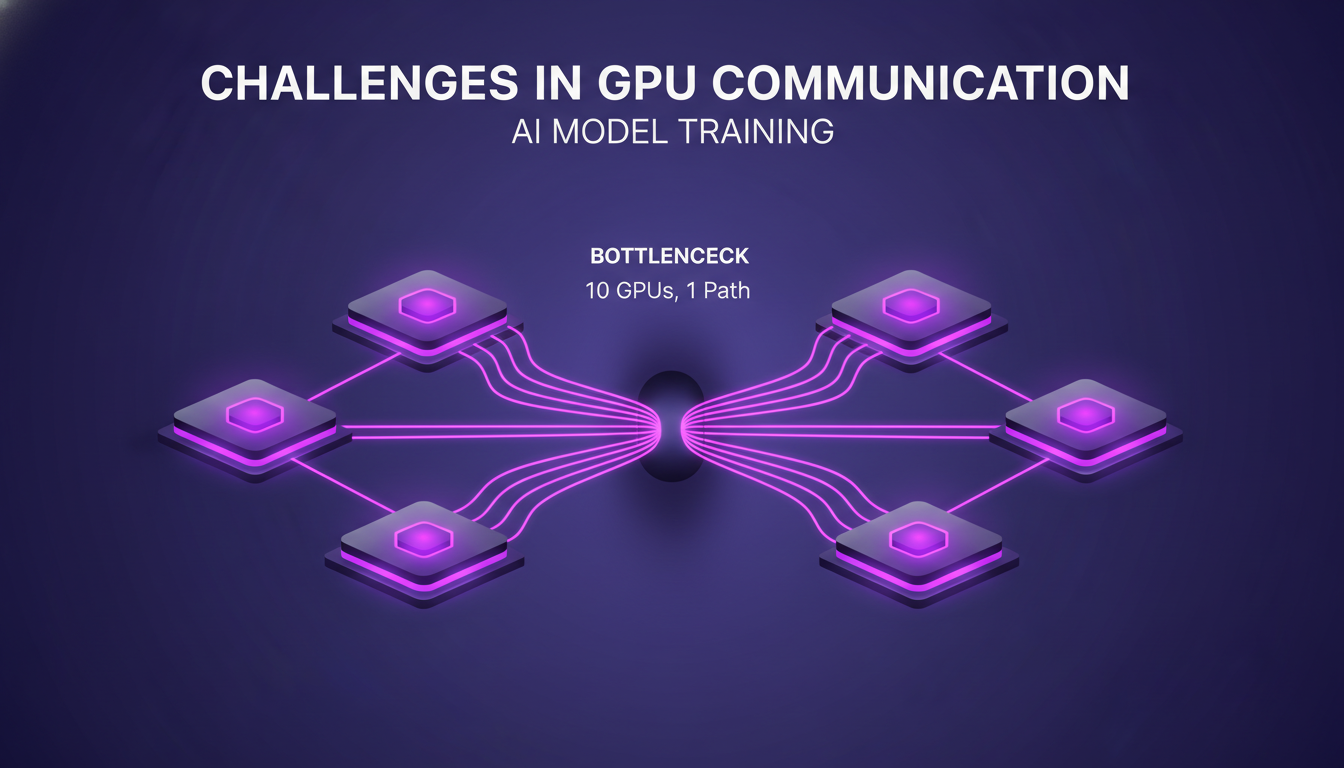

Défis dans la Communication GPU pour l'Entraînement des Modèles IA

Je me souviens encore de ma première expérience avec l'entraînement de modèles IA sur des clusters de GPU. C'était comme essayer de faire passer un troupeau d'éléphants à travers une porte de jardin. La communication à haute vitesse et à faible latence entre les GPU est cruciale, mais souvent les réseaux actuels créent des goulots d'étranglement qui ralentissent le temps d'entraînement. Quand j'ai vu dix GPU choisir le même chemin, j'ai su que ça allait être un désastre. La performance chute dramatiquement, et dans ce domaine, chaque milliseconde compte. Même les plus petites latences sont perceptibles et peuvent entraîner l'arrêt de l'utilisation du lien.

Alors, que faire ? Explorer des alternatives aux standards Ethernet traditionnels. Il est temps de repenser la façon dont nos réseaux sont conçus pour supporter ces charges de travail massives. Dans ce contexte, l'évolution des réseaux de centres de données devient essentielle.

Évolution et Conception des Réseaux de Centres de Données

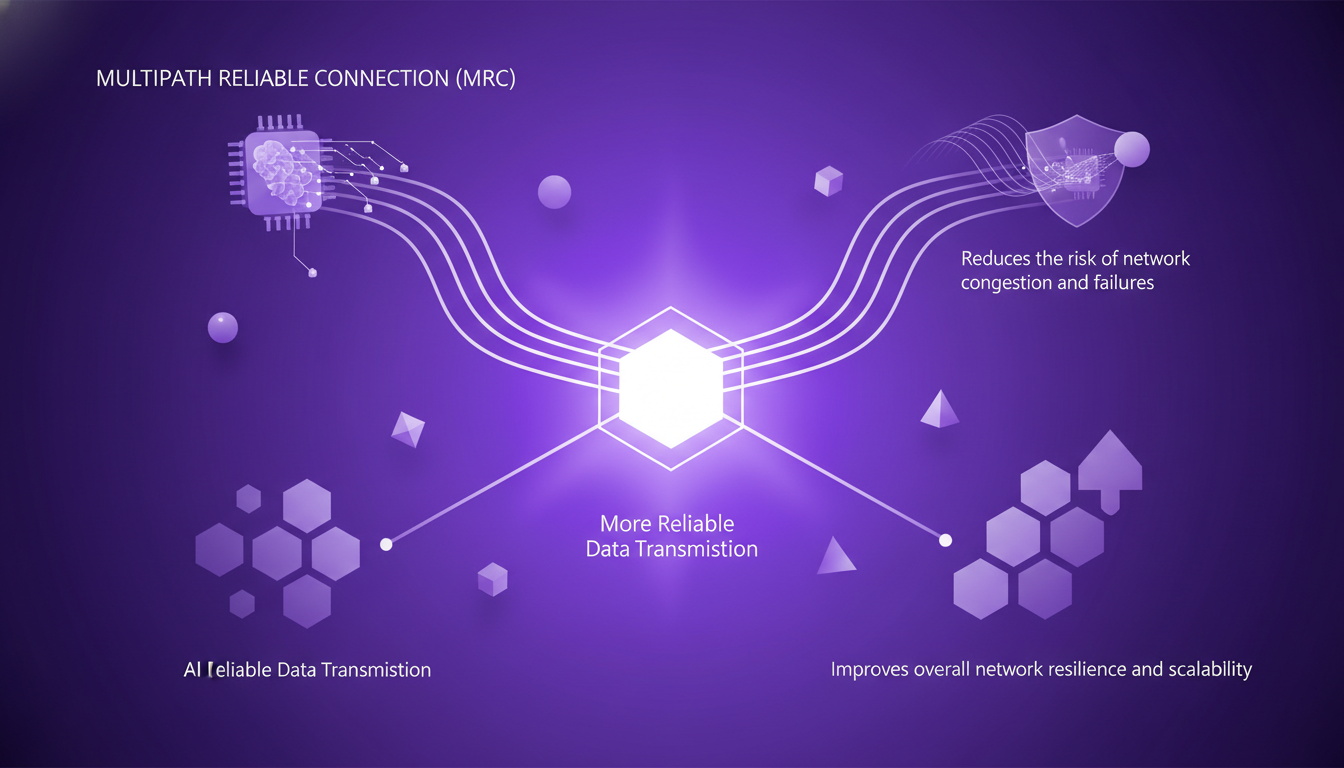

J'ai toujours cru que les centres de données devaient évoluer en harmonie avec les besoins des charges de travail IA. Concevoir des réseaux capables de gérer d’immenses volumes de données, c'est un défi constant. Récemment, j'ai découvert que la Multipath Reliable Connection (MRC) pourrait être une véritable révolution. Elle offre une connexion plus fiable, ce qui est crucial lorsque l’on parle de réseaux de centres de données à grande échelle.

IPv6 Segment Routing ajoute une autre dimension à cette discussion, en permettant une efficacité accrue dans le routage. Cependant, même avec ces innovations, il faut toujours peser le pour et le contre entre le coût et la performance.

La Multipath Reliable Connection (MRC) et Son Impact

La MRC est un outil que j'ai commencé à intégrer récemment, et les résultats sont impressionnants. Elle permet une transmission de données plus fiable à travers les réseaux, réduisant le risque de congestion et d'échecs. Cela améliore la résilience et l'évolutivité générale du réseau. Comparée aux connexions à chemin unique traditionnelles, la MRC offre un niveau de fiabilité que je n'avais pas vu auparavant.

Mais attention, intégrer la MRC dans une infrastructure existante n'est pas sans défis. Il faut être prêt à ajuster et à optimiser pour tirer le meilleur parti de cette technologie.

Gestion des Pannes Réseau et Problèmes de Scalabilité

Rien n'est plus frustrant que de voir un entraînement IA stoppé net à cause d'une panne réseau. Ça coûte du temps et des ressources. J'ai appris qu'anticiper et mitiger ces pannes est crucial. Ajouter plus de GPU n'est pas toujours la solution ; parfois, ça empire les choses, car les réseaux ne sont pas préparés pour cette échelle.

Se concentrer sur les standards ouverts et la collaboration industrielle peut vraiment aider ici. Il s'agit de trouver le bon équilibre entre l'intégration verticale et l'interopérabilité.

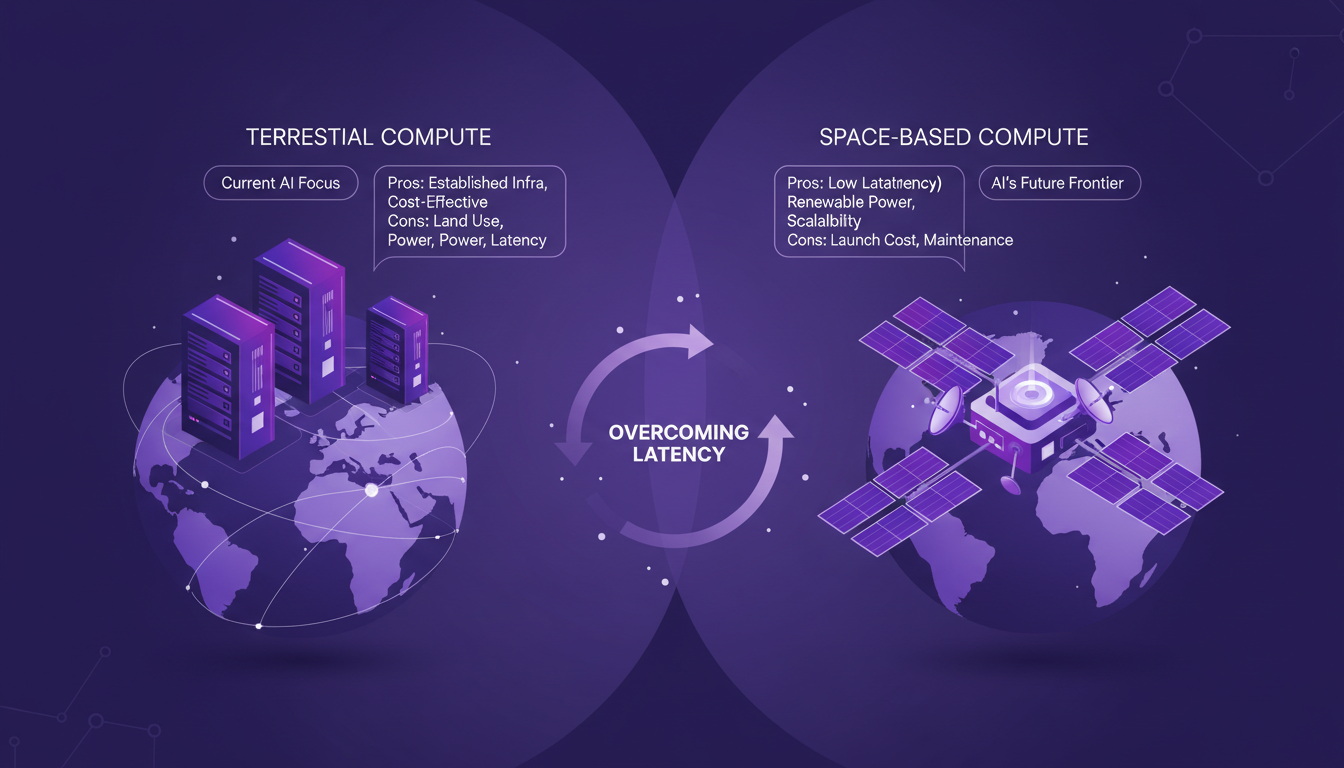

Centres de Calcul Terrestres vs. Spatiaux

Explorons maintenant une idée un peu futuriste : les centres de calcul spatiaux. L'idée est séduisante : éliminer les problèmes de latence terrestre en se basant dans l'espace. Mais est-ce vraiment faisable ? Les coûts et la faisabilité technologique restent des obstacles majeurs.

Dans l'avenir, ces centres pourraient jouer un rôle, mais pour l'instant, les défis sont encore nombreux.

En repensant notre infrastructure IA, on doit faire plus que juste ajouter des GPU. D'abord, il faut résoudre les problèmes de communication. J'ai remarqué que si dix personnes empruntent le même chemin réseau, ça ralentit tout, et en quelques millisecondes, tout le monde abandonne la connexion. Ensuite, l'évolution des data centers est cruciale. Je conçois mes réseaux pour être plus adaptables, et les solutions comme la Multipath Reliable Connection (MRC) sont des game changers si elles sont bien intégrées. Mais attention, il y a des limites ; les co-designs systèmes/modèles doivent être en harmonie pour vraiment maximiser l'efficacité des charges de travail IA.

En avant, c'est à nous de réinventer ces systèmes pour que l'IA soit plus performante. Je vous encourage à rejoindre la conversation sur comment on peut collectivement mener ces changements. Regardez l'épisode 18 du Podcast OpenAI pour explorer ce sujet en profondeur. Ensemble, construisons l'avenir de l'infrastructure IA.

Lien: YouTube

Questions Fréquentes

Thibault Le Balier

Co-fondateur & CTO

Issu de l'écosystème startup tech, Thibault a développé une expertise en architecture de solutions IA qu'il met aujourd'hui au service de grands groupes (Atos, BNP Paribas, beta.gouv). Il intervient sur deux axes : la maîtrise des déploiements IA (LLM locaux, sécurisation MCP) et l'optimisation des coûts d'inférence (offloading, compression, gestion des tokens).

Articles liés

Découvrez d'autres articles sur des sujets similaires

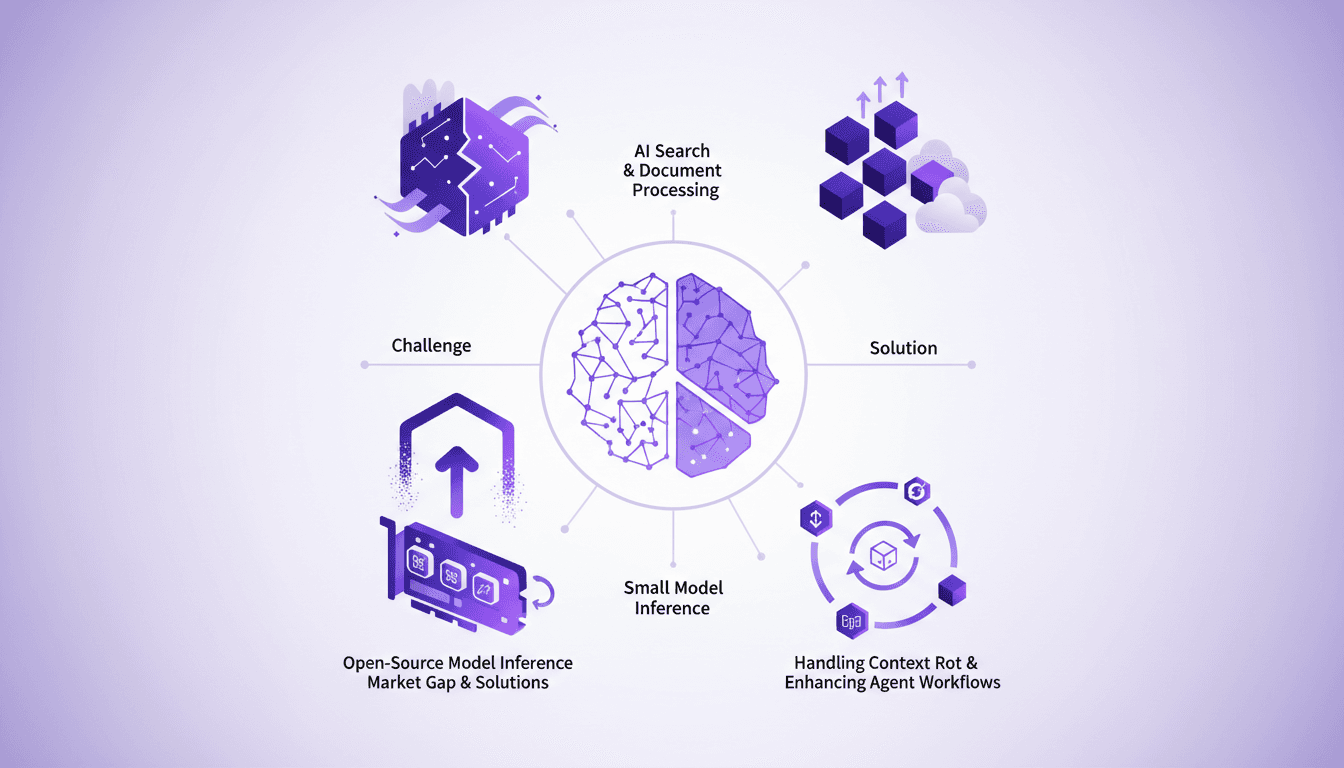

Optimisation des modèles IA : notre approche

J'ai vu un vide sur le marché pour l'inférence des petits modèles, alors j'ai décidé de construire l'infrastructure moi-même. Avec plus de 3 millions de modèles sur Hugging Face, l'absence d'une infrastructure efficace m'a sauté aux yeux. Pourquoi est-ce crucial ? Parce que les petits modèles sont essentiels pour la recherche AI et le traitement de documents. Et les défis ? Il y en a eu, mais j'ai relevé le défi. Entre le rot contextuel et l'optimisation des workflows d'agents, chaque étape a été un apprentissage. J'ai orchestré le swapping des modèles pour une utilisation efficace des GPUs, tout en soutenant diverses architectures open-source. En bref, nous avons comblé une lacune du marché avec une solution robuste et évolutive.

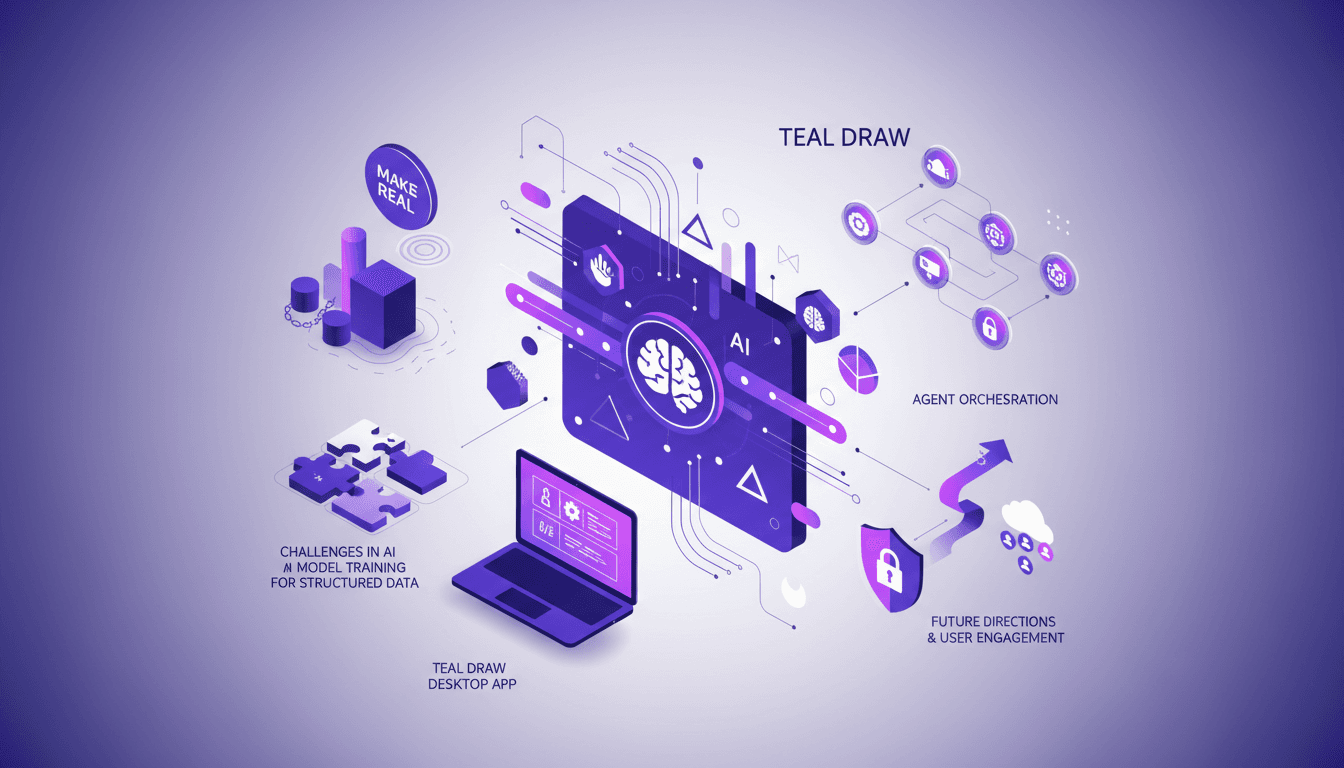

Agents sur Canvas : Orchestration dans tldraw

Je me souviens de ma première rencontre avec tldraw — j'ai connecté mes composants React et, soudain, la toile s'est animée. Ce n'est pas juste dessiner; c'est orchestrer des agents d'IA en temps réel. On va plonger ensemble dans cette aventure, en explorant l'intégration de l'IA, l'orchestration d'agents, et les applications concrètes. Je vous parlerai du projet Make Real, des défis du modèle d'IA, et des mesures de sécurité que j'ai mises en place. Tout est question de rendre les concepts d'IA complexes, efficaces et applicables.

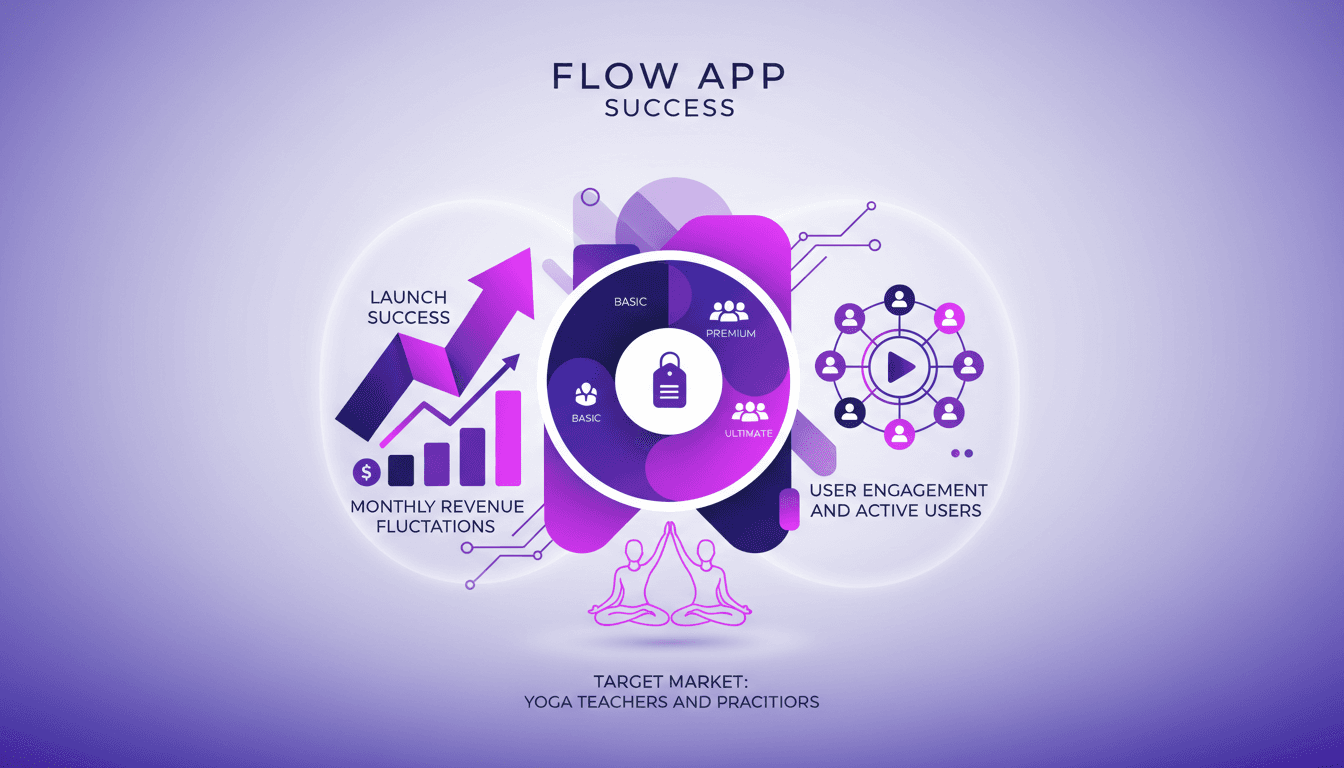

Succès fulgurant Flow App : 120K en 24h

J'ai lancé Flow App et en 24 heures, on a touché 120K. Incroyable ? Absolument, mais pas sans accrocs. On a conçu cette appli pour les profs de yoga, révolutionné leur manière de travailler avec un modèle d'abonnement. Et là, je vous raconte tout : la stratégie de lancement, les erreurs, les succès, et les leçons apprises en chemin. C'était une aventure pleine de rebondissements (croyez-moi, j'ai essuyé quelques plâtres). Mais à la fin, l'impact business est direct : des utilisateurs engagés, des revenus fluctuants, et un marché cible bien défini. Pas de théorie ici, juste du concret.

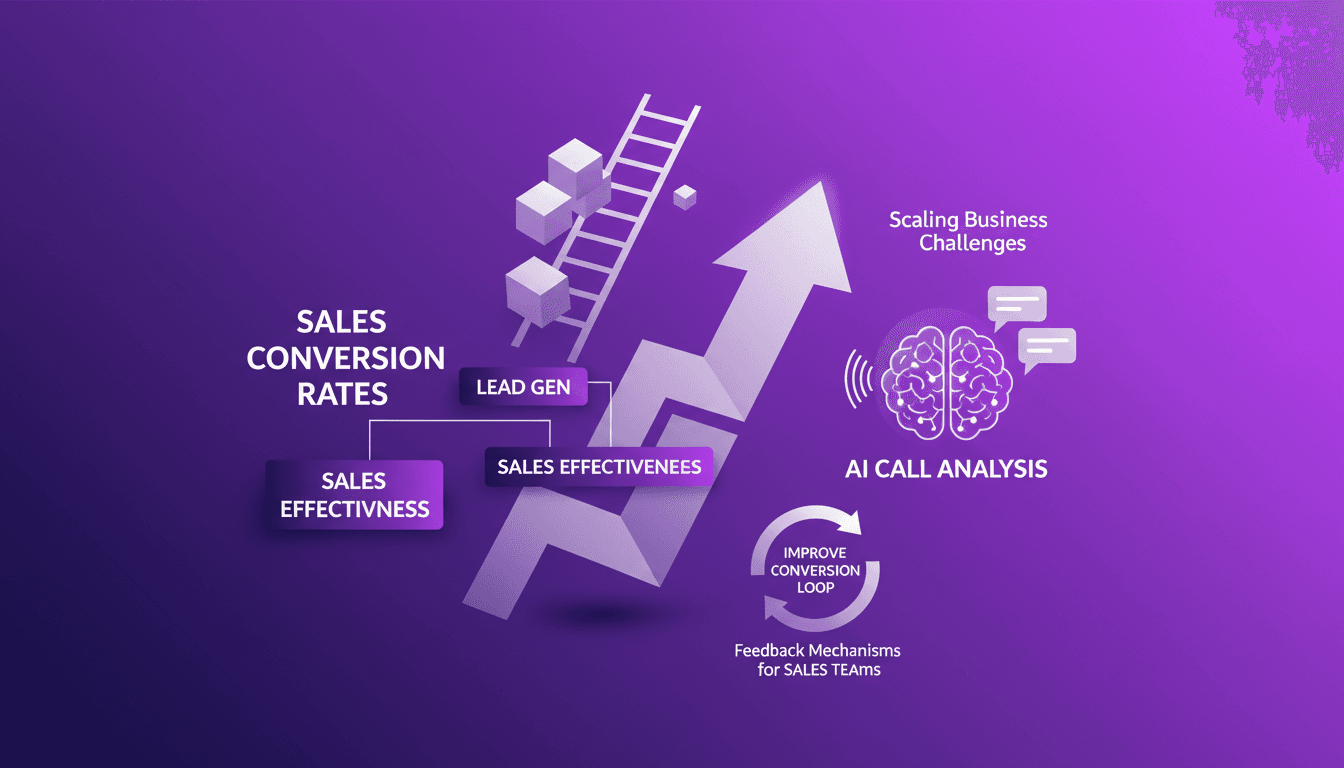

Améliorer le Taux de Conversion avec l'IA

J'ai passé des années dans les tranchées de la vente, et rien ne fait plus mal que de voir une pile de prospects se transformer en poussière. Mais voilà le truc : l'IA peut renverser la vapeur si vous savez l'utiliser. Dans cet article, je vais vous montrer comment exploiter l'IA pour booster vos taux de conversion. On va plonger dans les workflows réels, éviter les pièges courants, et voir comment l'IA peut vraiment changer la donne, notamment dans l'analyse des appels de vente. En gros, si vous voulez que votre pile de 100 leads ne devienne pas juste 15 closings, mais carrément plus, il est temps de prendre en main ces outils d'IA.

Formation en chant: Devenir pro et surmonter les doutes

Je me souviens encore de la première fois où j'ai rêvé de monter sur une grande scène, les lumières, la foule, la musique. Ça semblait être un rêve lointain. Pourtant, après dix ans de formation intense et de défis personnels, je suis prête à affronter une audience de 1000 personnes le 22 mai. Je vous raconte comment j'ai surmonté mes doutes, trouvé le soutien financier en tant qu'artiste, et gardé en tête ce rêve ultime de décrocher un Grammy. Ma trajectoire n'a pas été un long fleuve tranquille, mais elle m'a appris à orchestrer mes propres succès et à naviguer dans les eaux tumultueuses de l'industrie musicale. Restez avec moi pour découvrir ce qui m'attend sur cette scène.