Nvidia Neimotron 3 Nano : Modèle LLM pour l'Edge

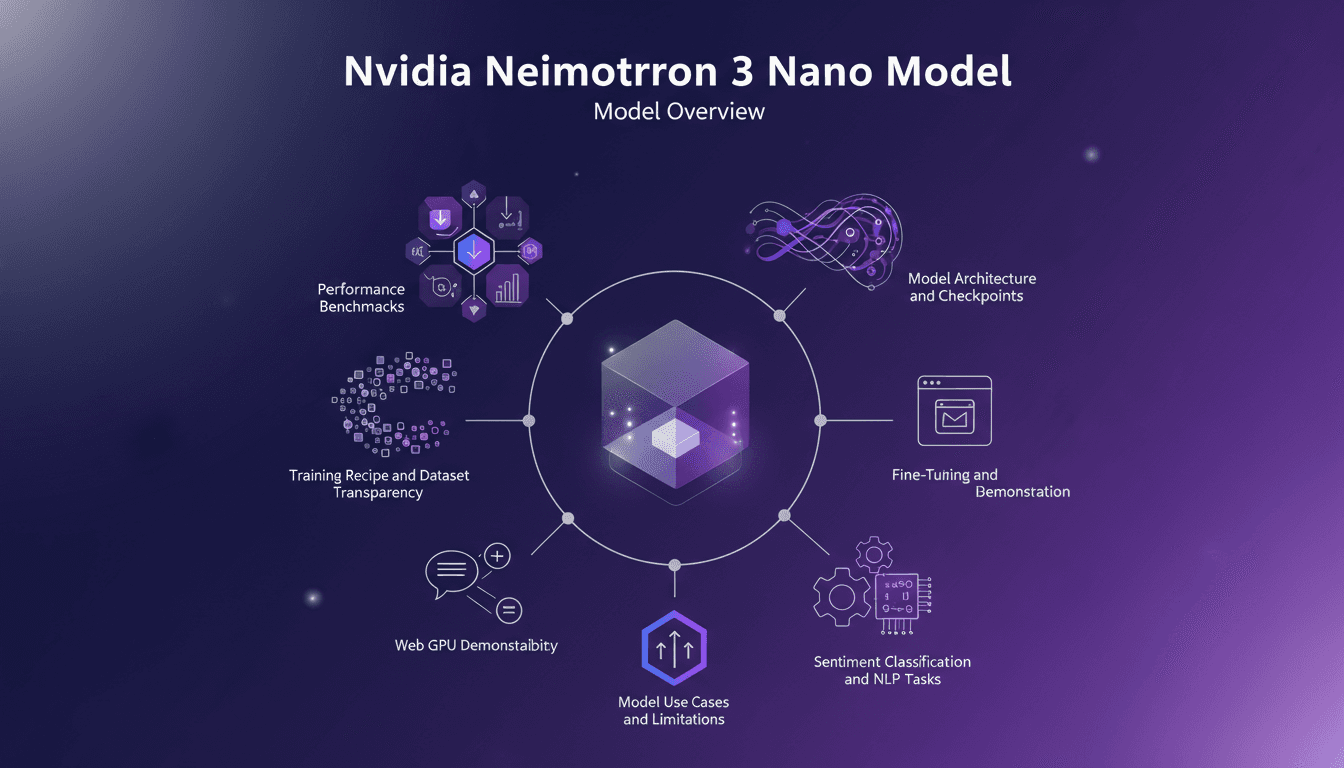

J'ai mis la main sur le Nvidia Neimotron 3 Nano, et c'est un véritable changeur de jeu pour le calcul en périphérie. Avec ses 4 milliards de paramètres, ce modèle promet de repousser les limites de l'IA à la périphérie. Mais au-delà du battage médiatique, comment se comporte-t-il réellement ? Je vous emmène dans les coulisses de sa mise en place, de ce qui a fonctionné et des pièges à éviter. Nous allons explorer l'architecture du modèle, les benchmarks de performance, et je partagerai mes découvertes sur les cas d'utilisation et les limites. Préparez-vous à plonger dans l'univers du Neimotron 3 Nano et à découvrir comment il rivalise avec des modèles comme le Quen 3.5, avec une performance supérieure de 10 points de pourcentage sur ifbench.

J'ai mis la main sur le Nvidia Neimotron 3 Nano, et croyez-moi, c'est une révolution pour le calcul en périphérie. Imaginez un modèle avec 4 milliards de paramètres, conçu pour amener l'IA au-delà de ses limites actuelles. Mais, avant de sauter de joie, prenons un moment pour voir ce que cela signifie vraiment en pratique. D'abord, je l'ai configuré (pas sans quelques accrocs, je vous le dis), et j'ai testé ses performances, en le comparant à des modèles comme le Quen 3.5. Spoiler : il surpasse le Quen de 10 points de pourcentage sur ifbench ! Je vais vous guider à travers l'architecture du modèle, les checkpoints, et comment il se comporte sur les tâches de classification de sentiment et de NLP. Mais attention, il y a des limites à connaître. Préparez-vous, car dans cette vidéo, nous plongeons dans tout ce que le Neimotron 3 Nano peut faire, et comment vous pouvez l'intégrer dans votre propre workflow.

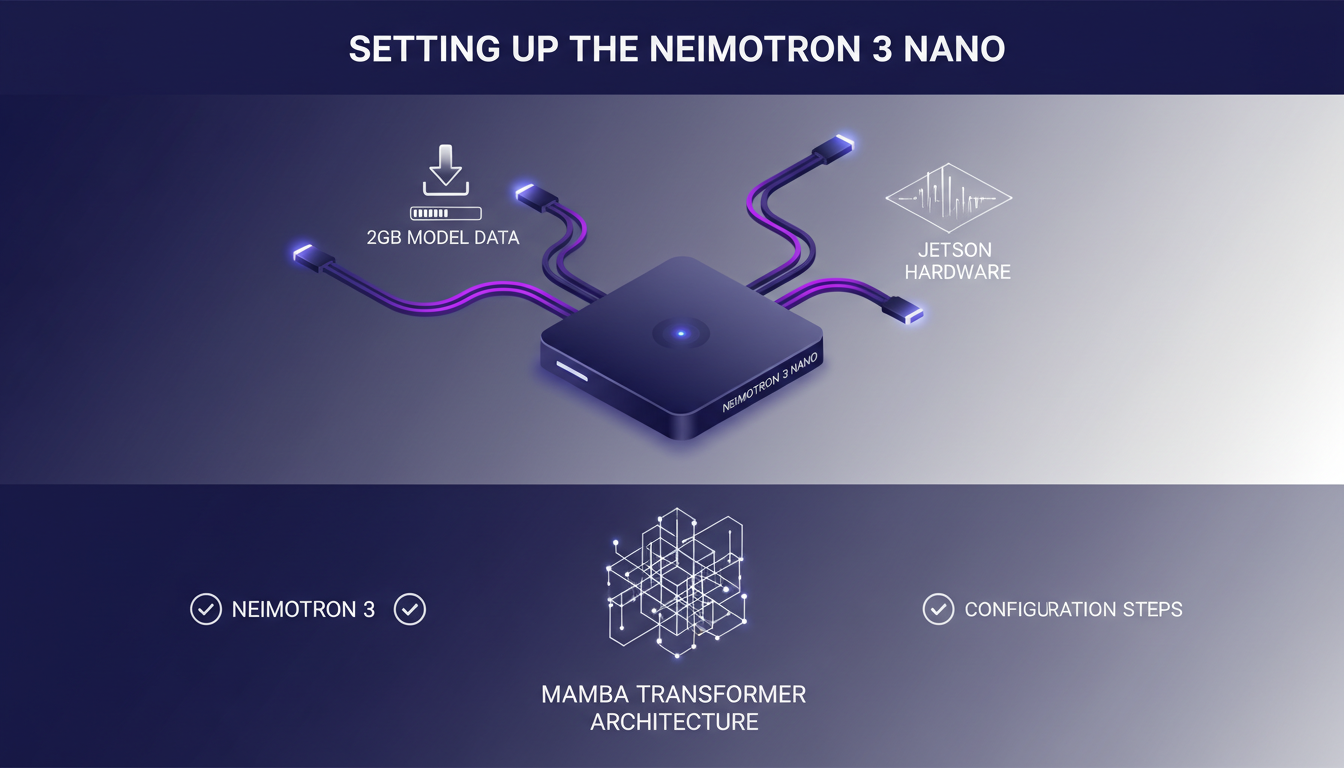

Mise en place du Neimotron 3 Nano

Installer le Neimotron 3 Nano est un peu comme connecter une fusée à son pas de tir. Tout commence par la connexion au matériel Jetson. Si vous avez déjà fait ça, c'est une promenade de santé, mais attention aux problèmes de compatibilité. J'ai eu ma part de soucis avec des versions de pilotes qui ne s'entendent pas avec le matériel.

Ensuite, j'ai téléchargé 2 Go de données de modèle pour la démo Web GPU. Assurez-vous que votre bande passante peut suivre, sinon vous allez râler. Une fois cela terminé, la configuration de l'architecture Mamba Transformer est primordiale. Je vais vous guider à travers les étapes essentielles.

La quantification est cruciale pour la performance. J'ai implémenté cela de manière efficace en utilisant des techniques de quantification qui réduisent l'utilisation de la mémoire sans sacrifier la précision. Ne sous-estimez pas cet aspect, sinon vous risquez de vous retrouver avec des performances dégradées.

Architecture du modèle et performance

Le Neimotron 3 Nano surpasse le Quen 3.5 de 10 points de pourcentage sur ifbench, et cela compte vraiment. Avec ses 4 milliards de paramètres, c'est une bête de course, comparée aux 3,54 milliards du Quen 3.5. Mais attention, plus de paramètres signifient aussi plus de complexité.

La distillation et l'apprentissage par renforcement sont les secrets de sa performance. En gros, on distille les modèles plus grands pour en tirer le meilleur et on utilise l'apprentissage par renforcement pour affiner le tout. Mais cela a aussi ses limites; plus de complexité peut signifier des temps de traitement plus longs.

Recette d'entraînement et transparence des jeux de données

La transparence de Nvidia dans sa recette d'entraînement est rafraîchissante. Vous pouvez savoir exactement quels jeux de données ont été utilisés, ce qui est rare de nos jours. La transparence permet de mieux comprendre les résultats et d'apprendre des erreurs potentielles.

Les choix de jeux de données ont un impact significatif sur les résultats. J'ai navigué à travers ces décisions en me concentrant sur des jeux de données variés pour éviter les biais. L'apprentissage par renforcement intervient également ici, influençant les résultats d'entraînement de manière significative.

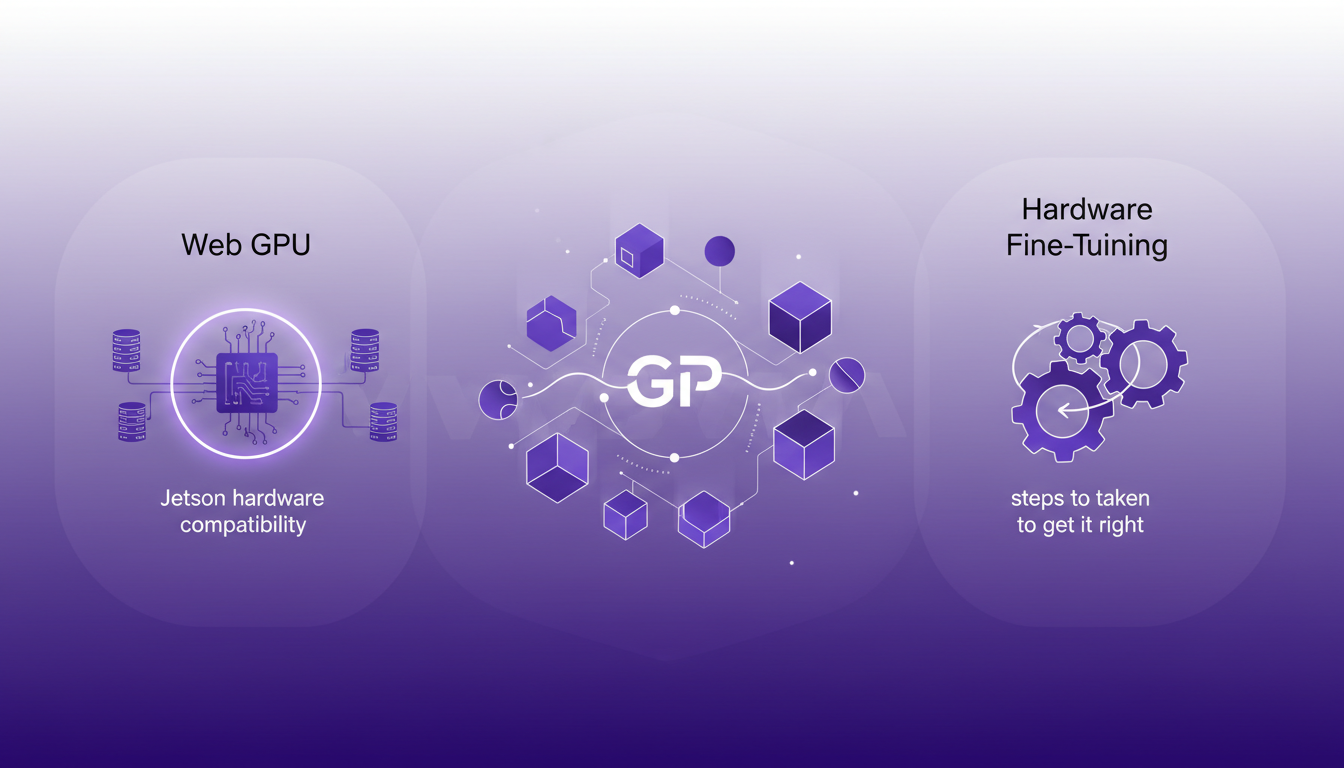

Web GPU et compatibilité matérielle

L'exécution du modèle sur Web GPU a été étonnamment fluide. Je vais vous guider à travers le processus. La compatibilité avec le matériel Jetson est cruciale. J'ai testé plusieurs configurations et certaines se sont avérées capricieuses.

Le réglage fin peut être délicat. J'ai dû ajuster certains paramètres pour obtenir une performance optimale. Mais attention, toutes les configurations matérielles ne se valent pas. Soyez vigilant aux spécifications de votre matériel.

Cas d'utilisation pratiques et limitations

La classification des sentiments a été un jeu d'enfant avec ce modèle. Je vais vous montrer comment je l'ai configuré. Les tâches NLP sont là où le Neimotron excelle. J'ai testé des tâches spécifiques et les résultats ont été impressionnants.

Mais ne surestimez pas ses capacités. Il y a des limitations à prendre en compte. L'efficacité et le coût sont toujours des préoccupations, et j'ai optimisé les deux grâce à des ajustements de quantification et à l'utilisation judicieuse des ressources.

- La compatibilité matérielle est essentielle pour des performances optimales.

- Attention aux pièges des jeux de données biaisés.

- Optimisez toujours pour le coût et l'efficacité.

J'ai plongé dans l'univers du Neimotron 3 Nano de Nvidia, et je dois dire, c'est un outil puissant pour le edge computing, mais il demande un peu de doigté. D'abord, voilà mes trois points clés :

- Avec ses 4 milliards de paramètres, le Neimotron 3 Nano surpasse le Quen 3.5 de 3,54 milliards, offrant une performance 10 points de pourcentage meilleure sur le benchmark ifbench.

- Son architecture et ses checkpoints vous donnent un sérieux levier, mais attention à la configuration initiale, ça peut être un peu piégeux.

- En termes de transparence des datasets et des recettes d'entraînement, c'est un vrai game changer, mais ne vous attendez pas à une solution clé en main.

Pour ceux qui veulent explorer plus loin, je vous encourage à tester le Neimotron 3 Nano dans votre propre environnement. Avec un peu de patience, les résultats valent l'effort. Prêt à plonger plus profondément ? Allez voir la vidéo complète ici : [YouTube link]. Vous verrez par vous-même comment ça peut transformer vos projets.

Questions Fréquentes

Thibault Le Balier

Co-fondateur & CTO

Issu de l'écosystème startup tech, Thibault a développé une expertise en architecture de solutions IA qu'il met aujourd'hui au service de grands groupes (Atos, BNP Paribas, beta.gouv). Il intervient sur deux axes : la maîtrise des déploiements IA (LLM locaux, sécurisation MCP) et l'optimisation des coûts d'inférence (offloading, compression, gestion des tokens).

Articles liés

Découvrez d'autres articles sur des sujets similaires

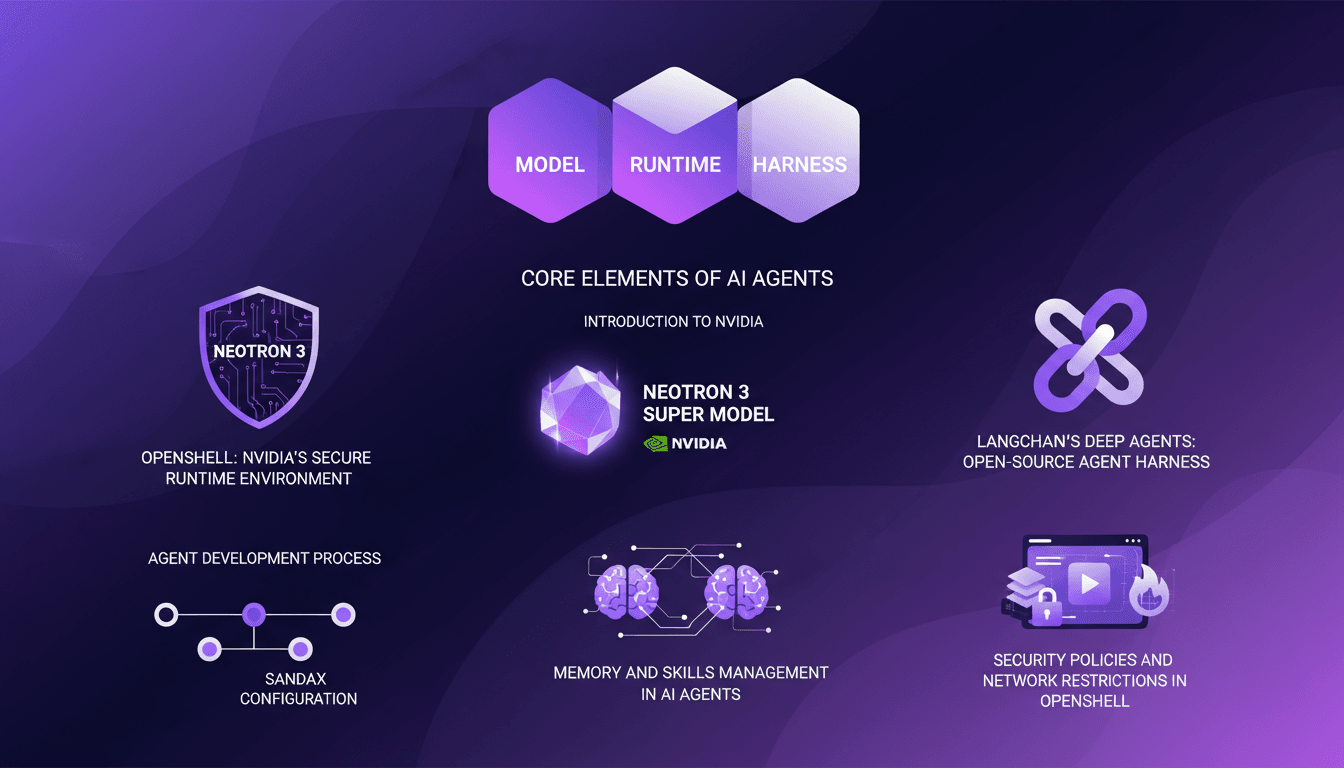

LangChain et Nvidia: Créez votre Agent IA

J'ai plongé tête première dans la construction d'agents IA avec LangChain et la dernière technologie de Nvidia, et c'était un vrai bouleversement. D'abord, j'ai connecté mon modèle Neotron 3, puis j'ai utilisé OpenShell pour sécuriser l'environnement d'exécution. LangChain's Deep Agents m'ont aidé à créer un harnais open-source, et je dois dire que jongler avec la mémoire et les compétences de l'agent était à la fois complexe et fascinant. Mais attention, les politiques de sécurité et les restrictions réseau dans OpenShell peuvent être piégeuses. Si vous cherchez à construire votre propre agent IA, je vous montre comment j'ai orchestré tout ça.

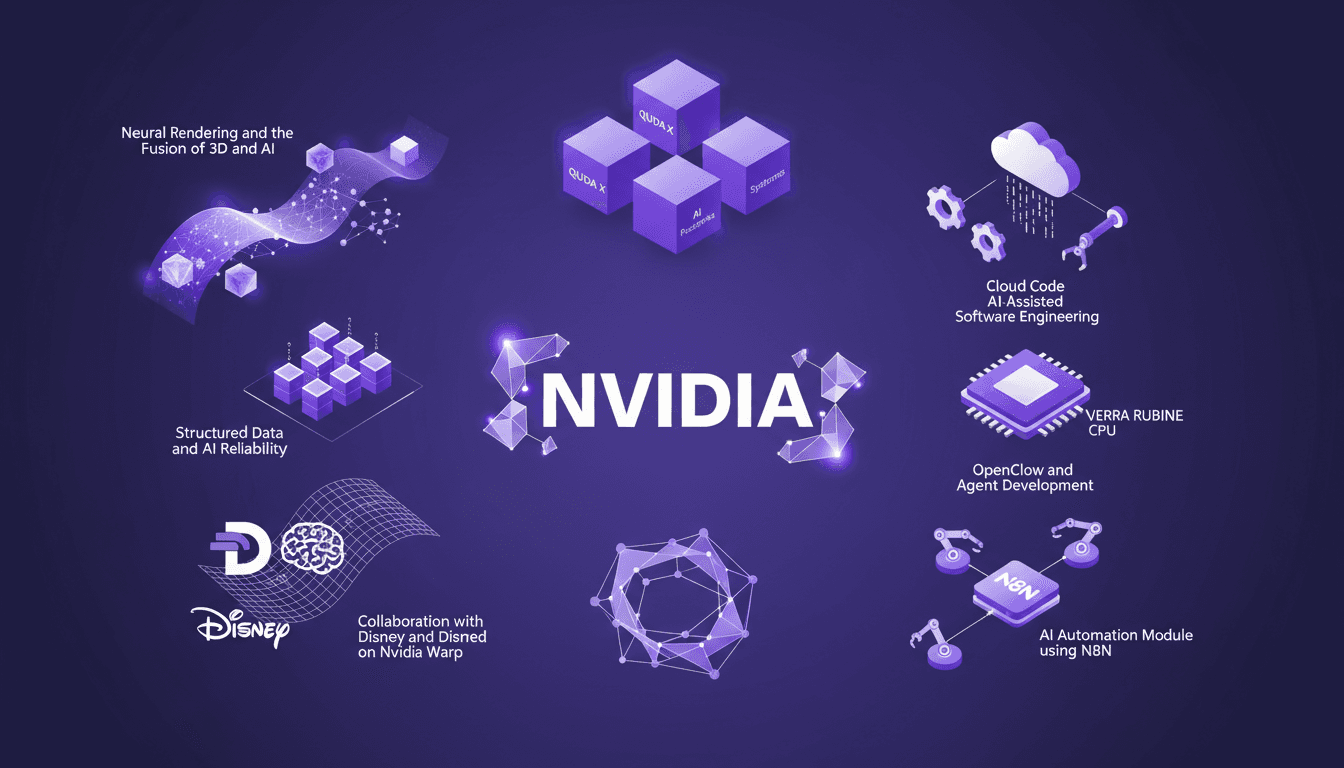

NVIDIA GTC 2026 : Révélation des Nouvelles Plateformes

Je suis allé à des dizaines de conférences, mais l'événement NVIDIA GTC 2026 a vraiment été un tournant. Ils ont dévoilé des plateformes qui vont redéfinir l'IA et l'informatique. Imaginez des CPUs qui transforment notre manière de coder, des rendus neuronaux qui fusionnent 3D et IA, et des collaborations avec Disney et Deep Mind sur Nvidia Warp. C'est immense, et l'impact pour nous, les constructeurs, est direct. On parle ici de QUDA X, de l'ingénierie logicielle assistée par l'IA, et même de refroidissement à 45° par de l'eau chaude. Il y a des années de travail devant nous mais aussi des opportunités incroyables. Plongeons ensemble dans ce qui a été révélé.

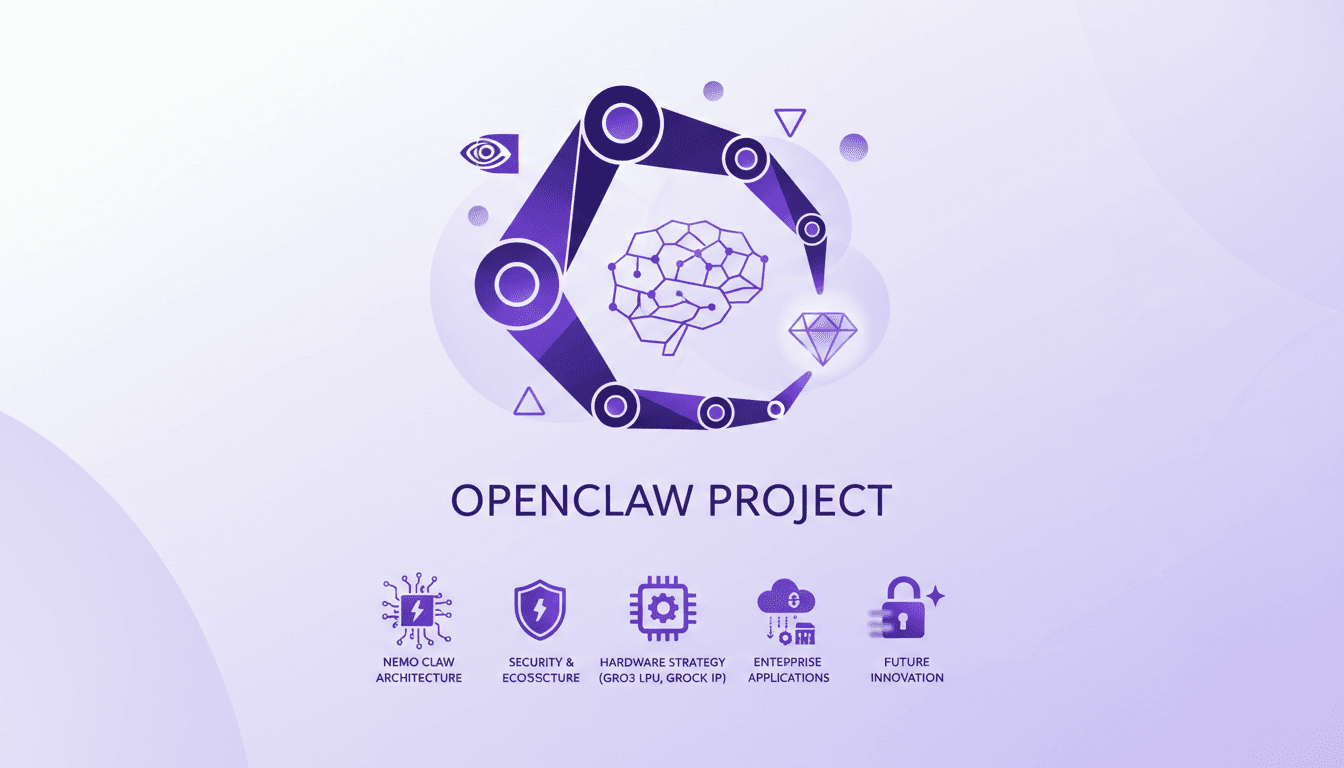

Nvidia et OpenClaw : Intégration de Nemo Claw

Je suis entré dans la keynote de Nvidia GTC 2026 avec l'idée de voir les habituelles mises à jour technologiques, mais je suis tombé sur une véritable révolution : l'implication de Nvidia dans le projet OpenClaw avec Nemo Claw. Nvidia ne se contente pas de suivre le mouvement, ils redéfinissent le paysage. OpenClaw, qui a commencé de zéro, compte déjà plus de 50 variations sur GitHub. Et avec l'arrivée de Nemo Claw, on parle de sécurité, d'intégration matérielle et d'applications d'entreprise réinventées. Nvidia ne rigole pas avec leur stratégie matérielle, notamment avec les puces Gro 3 LPU et l'intégration du Grock IP. Mais attention, la vie privée des données reste un sujet brûlant dans ce domaine.

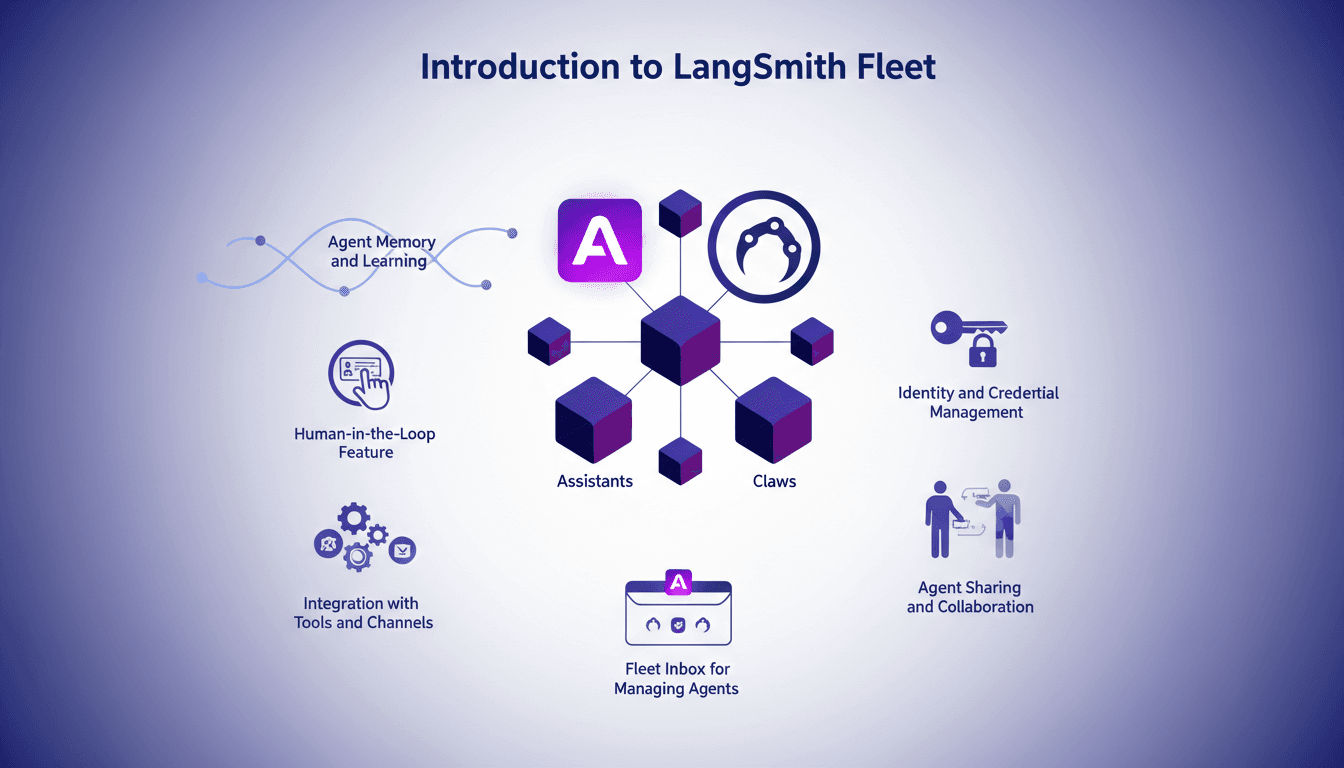

LangSmith Fleet: Démarrage Rapide et Efficace

Je me suis lancé dans LangSmith Fleet en pensant que c'était juste un outil de plus. Mais une fois que je l'ai intégré dans mon workflow, j'ai réalisé que c'était un véritable game changer. Je vais vous montrer comment je l'ai configuré, les pièges que j'ai rencontrés et les gains d'efficacité que j'ai obtenus. LangSmith Fleet offre une plateforme robuste pour gérer les agents IA, que ce soit pour des assistants ou des griffes. Comprendre la mémoire des agents, utiliser les fonctionnalités de boucle humaine, intégrer avec des outils et des canaux... C'est tout sauf théorique, c'est du concret avec un impact direct sur votre workflow quotidien.

Créer des paysages sonores efficaces vidéos

Je me souviens encore de ma première réalisation sur le pouvoir du son dans une vidéo. Un projet simple, mais dès que j'ai ajouté une musique de fond, tout a changé. C'est là que j'ai compris que l'audio n'est pas juste un accessoire, c'est un véritable game changer. Aujourd'hui, dans le paysage médiatique, le son joue un rôle crucial dans la perception des spectateurs. Que ce soit par la répétition subtile d'un thème ou l'usage stratégique de la musique, les éléments sonores peuvent faire ou défaire votre contenu. Dans cette vidéo, je partage comment j'ai orchestré des ambiances sonores efficaces et l'impact de la répétition auditive sur la création d'atmosphères.