Rendu Multilingue: ChatGPT Images 2.0 en Action

Je me suis plongé dans ChatGPT Images 2.0 en m'attendant aux bizarreries habituelles de l'IA, mais ce que j'ai découvert a changé la donne en matière de rendu de texte multilingue. Je vous emmène à travers mon parcours pour créer des affiches de villes dans différentes langues. Avec cette mise à jour, ChatGPT Images 2.0 promet des capacités multilingues améliorées et un rendu plus précis des petits textes. Mais qu'en est-il vraiment dans des applications concrètes ? Je vais vous montrer comment j'ai surmonté les défis du rendu multilingue et comment, en jonglant avec les retours des utilisateurs dans différentes régions, j'ai pu traduire et rendre des documents techniques de 100 pages. C'est vraiment génial comme outil, mais attention aux limites contextuelles - au-delà de 100K tokens, ça devient compliqué.

Je me suis plongé dans ChatGPT Images 2.0 en m'attendant aux bizarreries habituelles de l'IA, mais je suis tombé sur un véritable changement de paradigme en matière de rendu de texte multilingue. Imaginez-vous créer des affiches de villes dans toutes les langues et vous vous rendrez vite compte des défis – et des surprises – que j'ai rencontrés. D'abord, j'ai testé le rendu des petits textes, souvent source de frustration avec d'autres outils. Puis, en jonglant avec les retours utilisateurs de diverses régions, j'ai pu traduire et rendre un document technique de 100 pages. Pas mal, hein ? Mais attention, ne vous laissez pas surprendre par les limites contextuelles. ChatGPT Images 2.0 est puissant, mais au-delà de 100K tokens, les choses se compliquent. Si vous avez déjà été brûlé par un outil qui promettait monts et merveilles, vous comprendrez pourquoi je suis prudent. Cette fois, les résultats sont bel et bien là, et ils vont au-delà de mes attentes, même si je reste vigilant face aux contraintes techniques.

Configurer le rendu de texte multilingue

Première étape cruciale dans notre processus de génération d'images multilingues : configurer les paramètres linguistiques pour des sorties textuelles variées. J'ai d'abord connecté le modèle de rendu pour gérer plusieurs langues sans accroc. Ça peut sembler évident, mais attention aux nuances spécifiques à chaque langue : elles peuvent vous jouer des tours. Je me suis basé sur un modèle de base pour gagner du temps, un choix stratégique qui s'est avéré payant.

L'outil GPT Image Generation 2.0 est capable de générer du texte dans toutes les langues de manière correcte, ce qui est une véritable révolution. Mais gardez à l'esprit que les différences culturelles peuvent impacter le rendu final. En travaillant sur le modèle, j'ai dû ajuster certaines configurations pour m'assurer que le rendu soit fidèle à chaque langue.

Créer des affiches de ville dans différentes langues

Passons maintenant à la création d'affiches de ville. Je commence par sélectionner des thèmes urbains pertinents, puis je choisis le texte approprié dans différentes langues. C'est là que la démonstration de l'outil avec des scripts complexes comme le mandarin entre en jeu. J'ai emballé le processus dans un flux de travail qui permet des itérations rapides.

"Imaginez vouloir faire une affiche sur votre ville natale et son histoire."

Attention aux problèmes d'espacement du texte, surtout dans les langues avec des caractères plus longs. L'outil a montré son efficacité même avec des langues comme le chinois et le bengali, mais des ajustements sont parfois nécessaires pour éviter les chevauchements.

Améliorer la précision du rendu de petit texte

Pour améliorer la clarté des petits textes, j'ai ajusté les paramètres du modèle. Cela a nécessité quelques essais et erreurs pour trouver le bon équilibre. Ne sur-détaillez pas trop, sinon cela ralentit le rendu. L'amélioration de la précision est notable dans les zones de texte fin.

Le modèle peut rendre du texte petit et des paragraphes denses avec précision, même en chinois ou en japonais. Mes amis de Taïwan ont été impressionnés par la précision du rendu des petits caractères, ce qui est un bon indicateur de la robustesse du modèle.

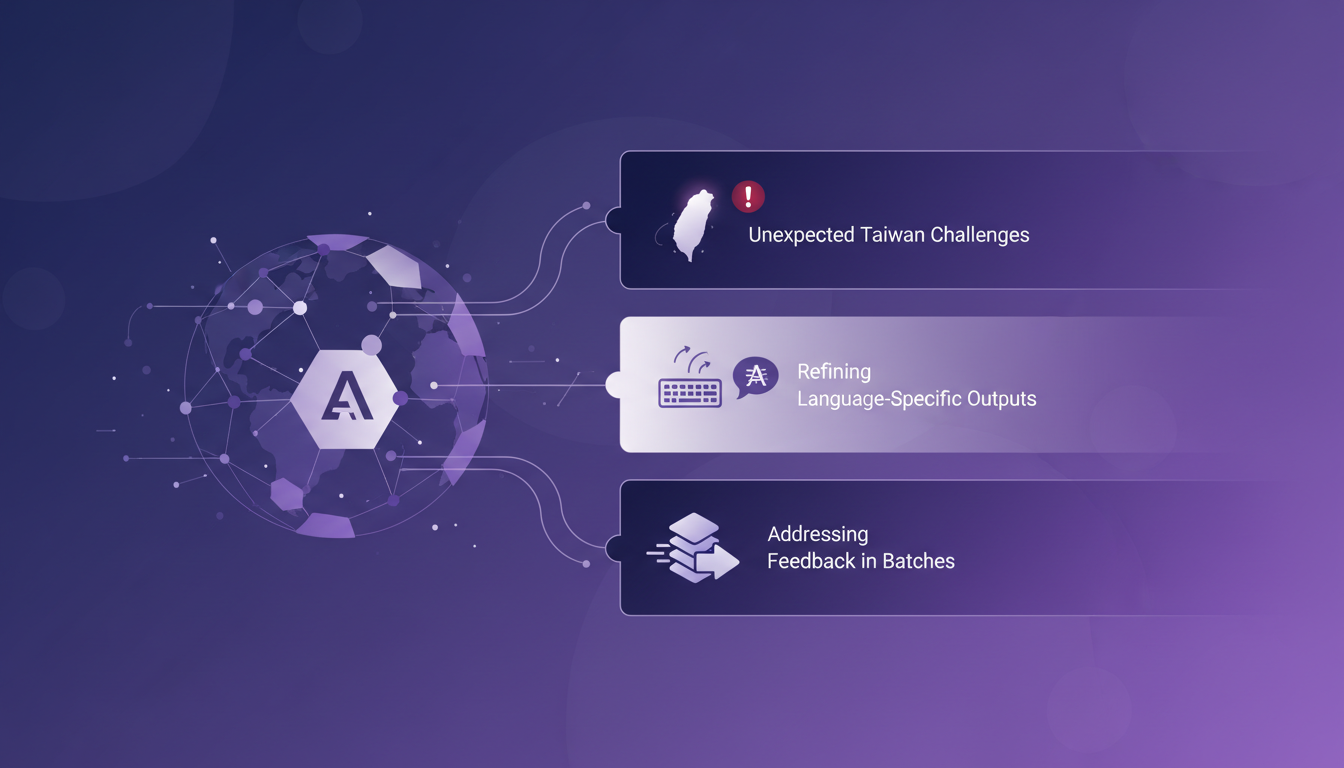

Intégrer les retours utilisateurs de différentes régions

Les retours de Taïwan ont mis en lumière certains défis inattendus. J'ai intégré leurs suggestions pour affiner les sorties spécifiques à chaque langue. Parfois, il est plus rapide de traiter les retours par lots.

Les retours utilisateurs sont cruciaux pour une amélioration continue. Cela permet d'adapter le modèle aux besoins réels des utilisateurs, ce qui est essentiel pour garantir une expérience optimale.

Traduire et rendre des papiers techniques

Enfin, j'ai abordé un papier technique de 100 pages, que j'ai traduit et rendu. La clé était de décomposer le papier en sections gérables. La traduction automatisée a accéléré le processus, mais nécessite des ajustements manuels.

Le rendu des diagrammes techniques a nécessité une attention supplémentaire aux détails. Mais une fois les ajustements effectués, le résultat final était satisfaisant, montrant l'efficacité de l'outil dans des contextes complexes.

Avec ChatGPT Images 2.0, je me suis vraiment plongé dans l'amélioration du rendu multilingue. C'est un vrai changement de jeu pour les affiches de ville et les articles techniques, avec des améliorations tangibles. Mais attention, les détails sont cruciaux — ces petites spécificités linguistiques peuvent vous surprendre.

- Le rendu multilingue est désormais plus précis, même pour le texte en petits caractères.

- Les affiches de ville en plusieurs langues prennent vraiment vie.

- La capacité à gérer des documents techniques, comme ces 100 pages du papier GPT, est impressionnante, mais nécessite encore une attention aux détails.

Je suis enthousiaste pour l'avenir : c'est une étape vers des projets multilingues encore plus ambitieux. Prêt à franchir le pas ? Plongez dans ChatGPT Images 2.0 et partagez vos retours. Poussons ensemble les limites de ce qui est possible. Pour creuser davantage, je vous recommande vivement de regarder la vidéo originale ici. Nous apprendrons ensemble.

Questions Fréquentes

Thibault Le Balier

Co-fondateur & CTO

Issu de l'écosystème startup tech, Thibault a développé une expertise en architecture de solutions IA qu'il met aujourd'hui au service de grands groupes (Atos, BNP Paribas, beta.gouv). Il intervient sur deux axes : la maîtrise des déploiements IA (LLM locaux, sécurisation MCP) et l'optimisation des coûts d'inférence (offloading, compression, gestion des tokens).

Articles liés

Découvrez d'autres articles sur des sujets similaires

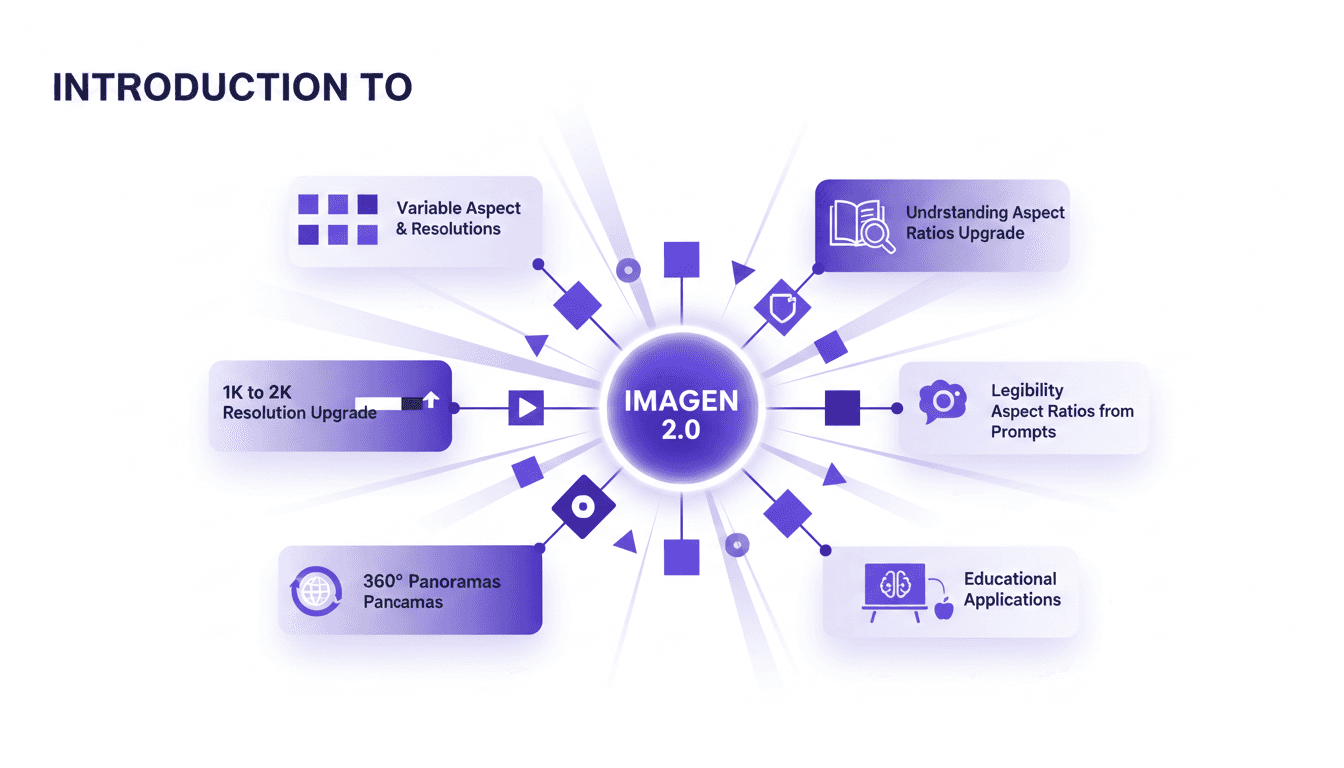

Ratios d'aspect avec Imagen 2.0: Guide pratique

Je suis plongé dans Imagen 2.0 en pensant que c'était juste une mise à jour de plus, mais quelle découverte ! Passer de 1K à 2K en résolution et jouer avec les ratios d'aspect, c'est un vrai changement de jeu pour mes projets. Imaginez créer des panoramas à 360° ou adapter des affiches avec un ratio de 3 par 1, tout cela avec une précision impressionnante. Imagen 2.0 ne se contente pas de vous offrir une meilleure résolution — c'est une question de flexibilité et de précision dans la création d'images. Que vous travailliez sur des matériaux pédagogiques ou des panoramas immersifs, comprendre ces outils est crucial. Je vous emmène dans ce tutoriel pour découvrir comment maîtriser les ratios d'aspect avec Imagen 2.0, et je vous promets que vous ne regarderez plus jamais vos projets de la même manière.

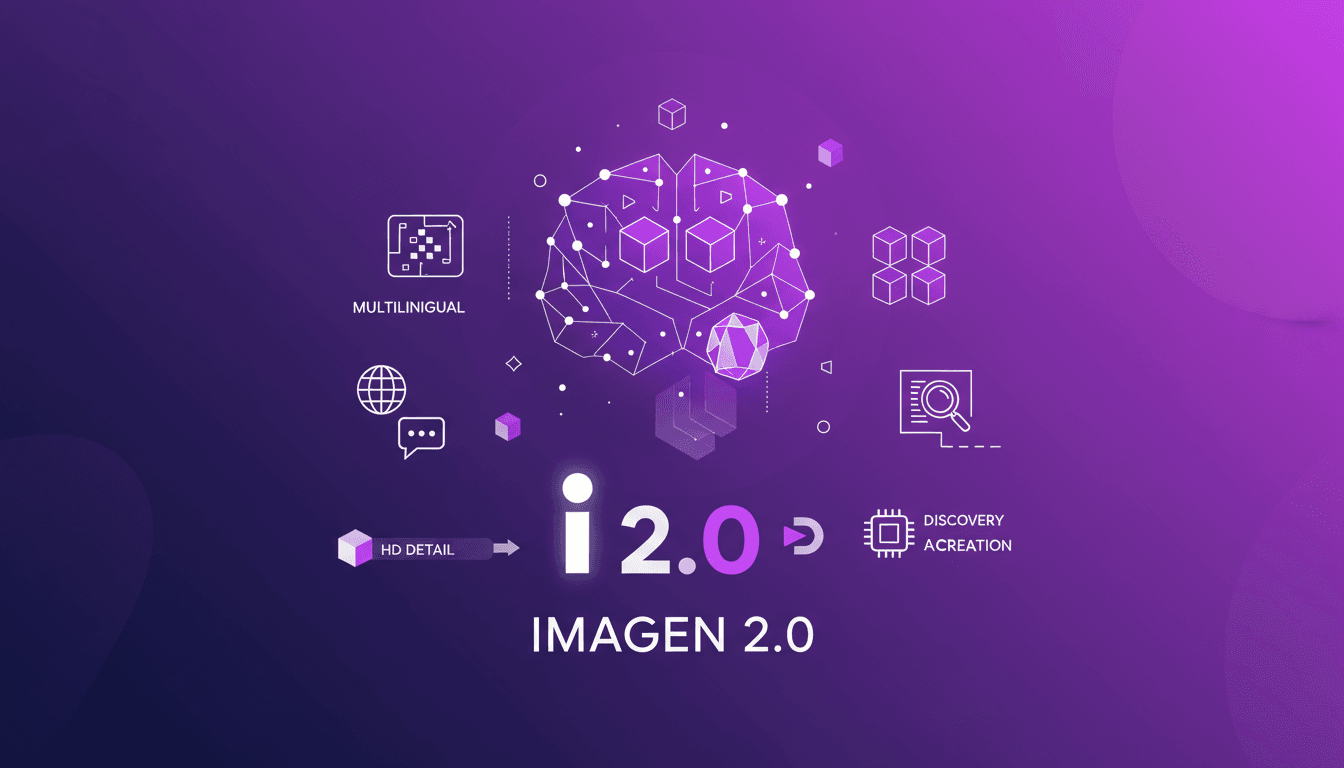

Imagen 2.0 : Génération d'images révolutionnaire

Quand j'ai mis la main sur Imagen 2.0, j'ai été époustouflé par son potentiel. On parle d'un outil qui génère des images en résolution 2K avec un support multilingue. D'abord, je l'ai intégré à mon workflow, et la différence est flagrante. L'amélioration de la résolution et du détail est un vrai game changer, mais attention aux limites techniques lors de la génération multiple. Comparé aux modèles précédents et à DALL-E, Imagen 2.0 se démarque vraiment. On n'est pas dans la théorie ici; je vous parle de l'impact quotidien sur ma pratique. Si vous cherchez à innover, c'est l'outil à explorer.

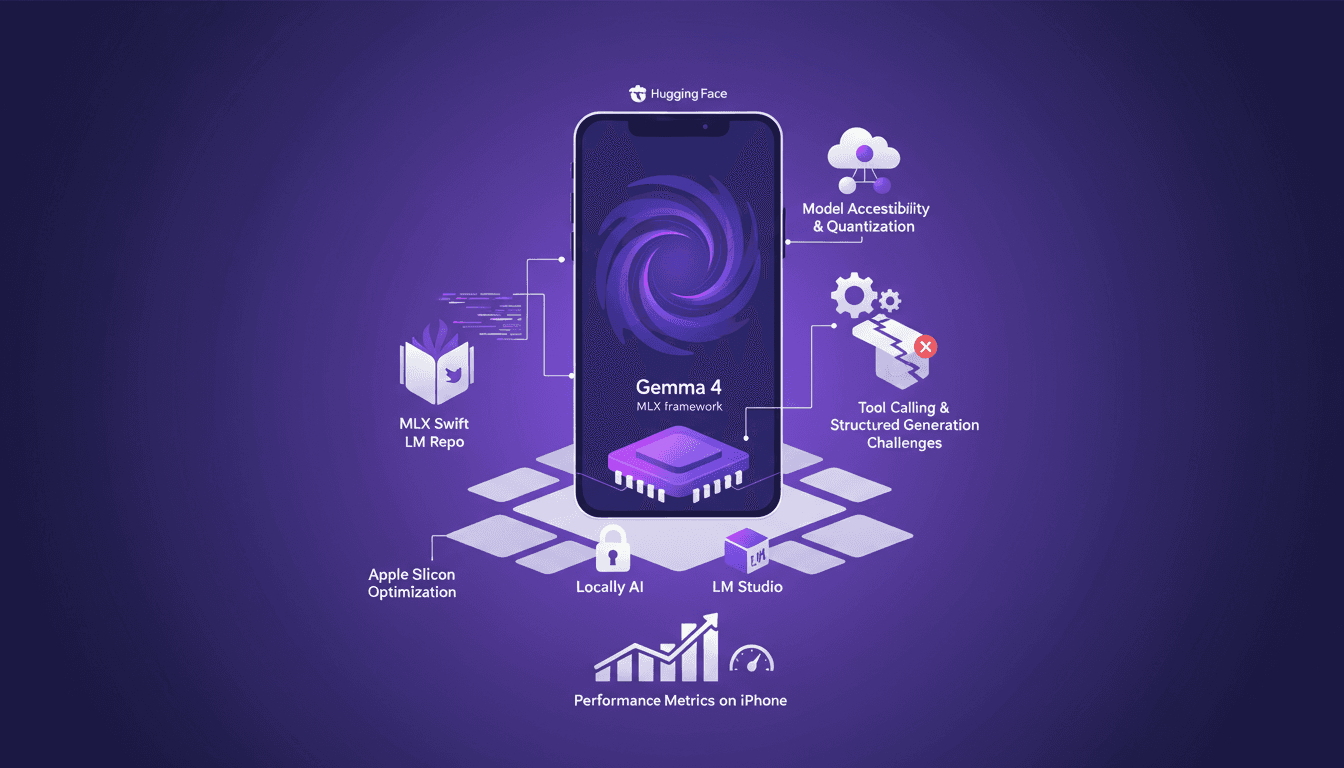

Gemma 4 & MLX : IA sur iPhone à 40 tok/s

J'ai passé un bon moment à essayer de faire tourner des modèles d'IA sur des iPhones, mais atteindre 40 tokens par seconde avec Gemma 4 grâce à MLX, c'était vraiment un tournant. Dans cet article, je vous emmène à travers le processus, étape par étape, pour optimiser l'utilisation de Gemma 4 sur iPhone avec le framework MLX. On parle des optimisations pour le silicium d'Apple, de la quantification en 4 bits et 6 bits, et des défis que j'ai rencontrés avec la compatibilité des modèles. En gros, c'est du concret, pas de la théorie. Et si vous avez déjà essayé de faire tourner un LLM sur un iPhone et avez trouvé ça lent ou compliqué, ce guide est pour vous.

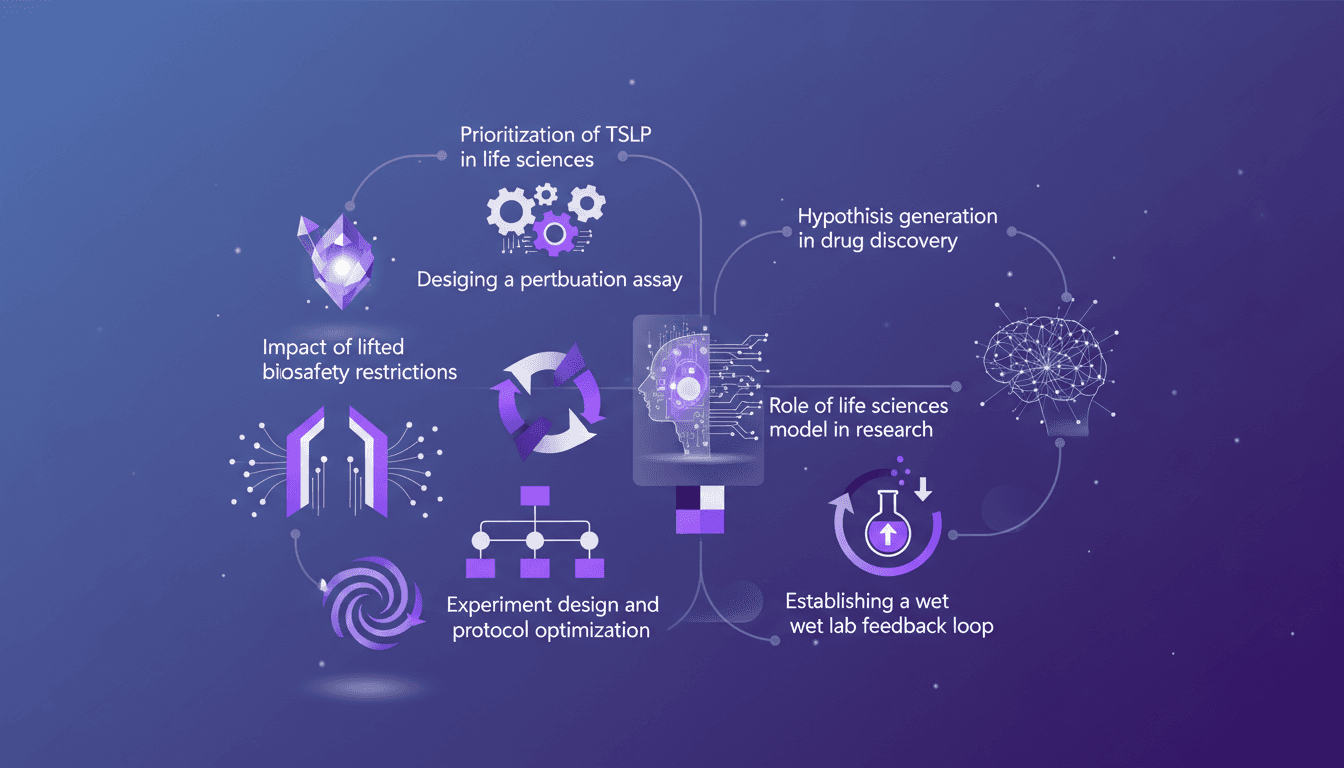

TSLP Priorisation : Accélérer la Recherche

Je me souviens du jour où nous avons finalement donné la priorité au TSLP dans notre modèle de sciences de la vie. C'était un véritable game changer. Nos expériences n'étaient pas seulement plus rapides, mais aussi plus intelligentes. Dans cet article, je vous explique comment nous avons fait et pourquoi c'est crucial. Dans le monde effréné des sciences de la vie, la conception d'expériences efficaces est essentielle. Avec la levée des restrictions de biosécurité, un nouveau champ de possibilités s'ouvre. Je vous guide à travers la priorisation du TSLP, la conception d'un test de perturbation, l'impact des nouvelles libertés en biosécurité, et l'optimisation des protocoles expérimentaux. Ne ratez pas comment établir une boucle de rétroaction en laboratoire humide et générer des hypothèses en découverte de médicaments.

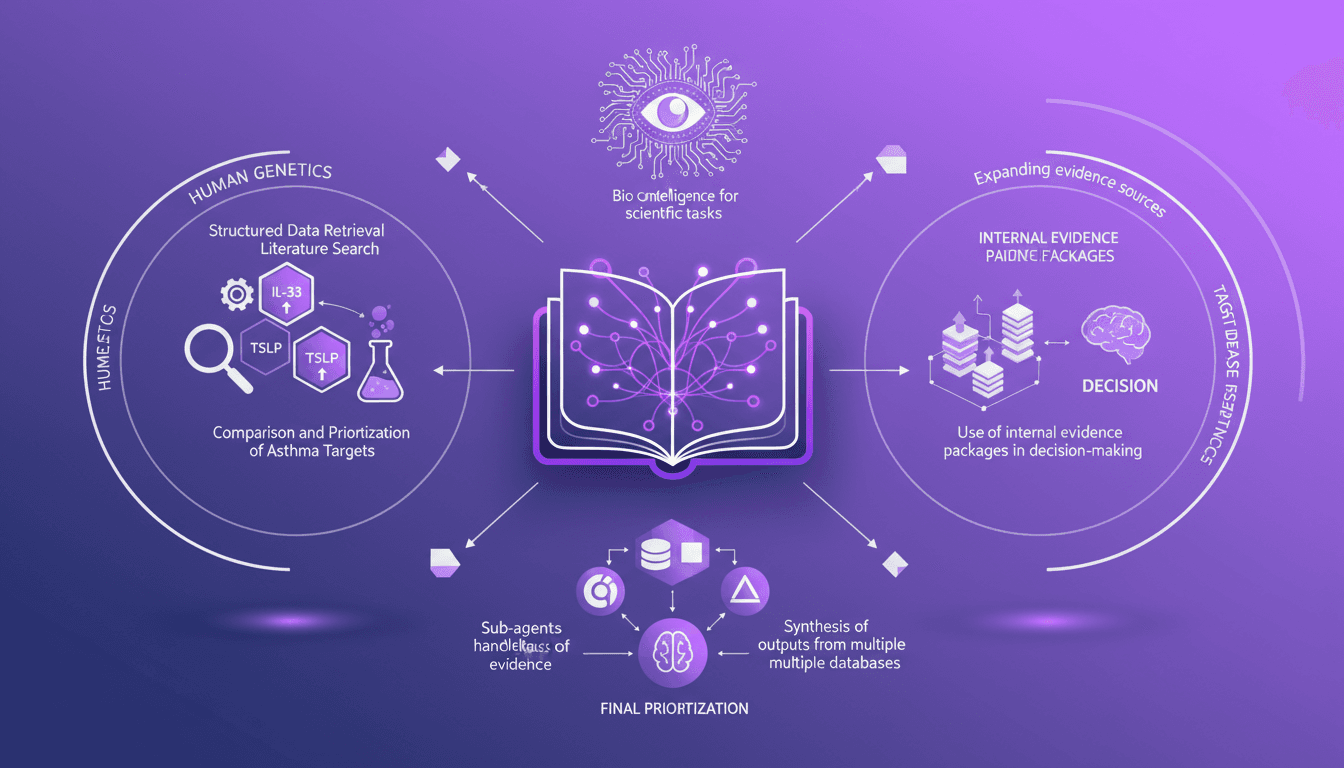

Intégration des données : cibles IL-33, TSLP

J'ai plongé dans le chaos des données, cherchant à démêler les preuves disparates en sciences de la vie. Avec Codex, j'ai transformé ce désordre en insights actionnables. Dans cette vidéo, je vous montre comment j'ai intégré la recherche de données structurées avec l'analyse scientifique pour comparer les cibles de l'asthme comme IL-33, TSLP et IL-1 RA1. Je partage mon workflow, en utilisant des packages de preuves internes pour prendre des décisions éclairées. C'est une plongée technique, mais je suis là pour vous guider à travers chaque étape.