Évolution des LLMs: 8 ans de progrès en IA

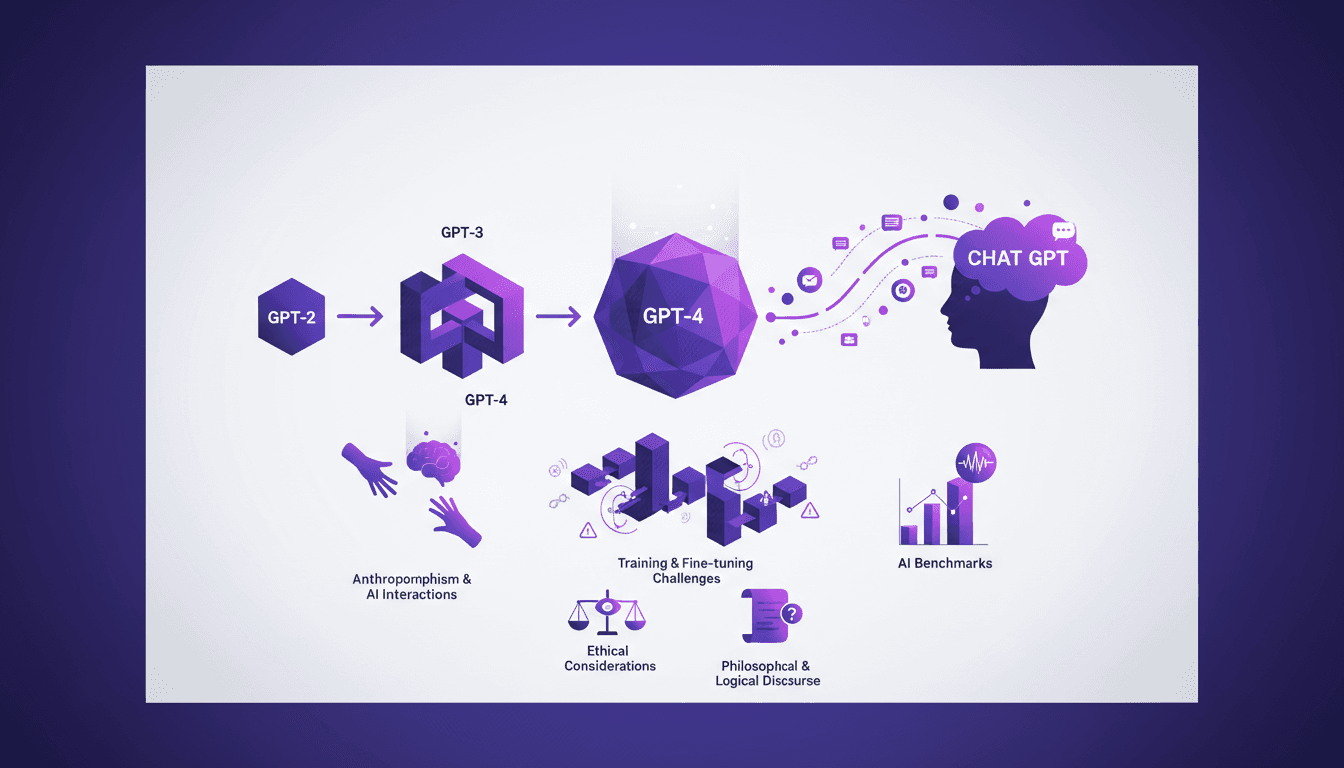

Je me souviens quand GPT-2 a débarqué. C'était un vrai tournant, mais pas sans ses bizarreries. Quelques années plus tard, on nage en plein dans les LLMs qui redéfinissent notre interaction avec la technologie. Alors, plongeons ensemble dans ce que ces modèles sont vraiment, ce qu'ils peuvent accomplir, et là où ils pourraient vous faire trébucher. Depuis l'évolution de GPT-2 à GPT-4, ces modèles ont transformé la génération de texte et la perception publique de l'IA. Mais attention, avec une grande puissance viennent de grandes complexités. Nous allons explorer les progrès, les défis d'entraînement, l'anthropomorphisme, et les considérations éthiques, tout en décortiquant l'impact des LLMs sur le discours philosophique et logique.

Je me souviens quand GPT-2 a fait son apparition. C'était un véritable bouleversement, un vrai game changer, mais il avait ses bizarreries. En avançant de quelques années, nous voilà plongés dans ce monde des LLMs qui redéfinissent notre interaction avec la technologie. J'ai vu comment ces modèles ont évolué, de GPT-2 à GPT-4, marquant des jalons significatifs dans les capacités de l'IA. Mais ne vous y trompez pas, avec une grande puissance viennent de grandes complexités. En tant que praticien, j'ai navigué à travers les défis de l'entraînement et du fine-tuning des modèles, j'ai confronté les perceptions anthropomorphiques et les idées fausses qui planent toujours autour de l'IA. Dans ce podcast, on va décortiquer l'impact des LLMs sur la génération de texte, les débats philosophiques, et les considérations éthiques. On va aussi explorer les benchmarks et les évaluations d'intelligence dans un contexte où les perceptions publiques oscillent entre fascination et méfiance.

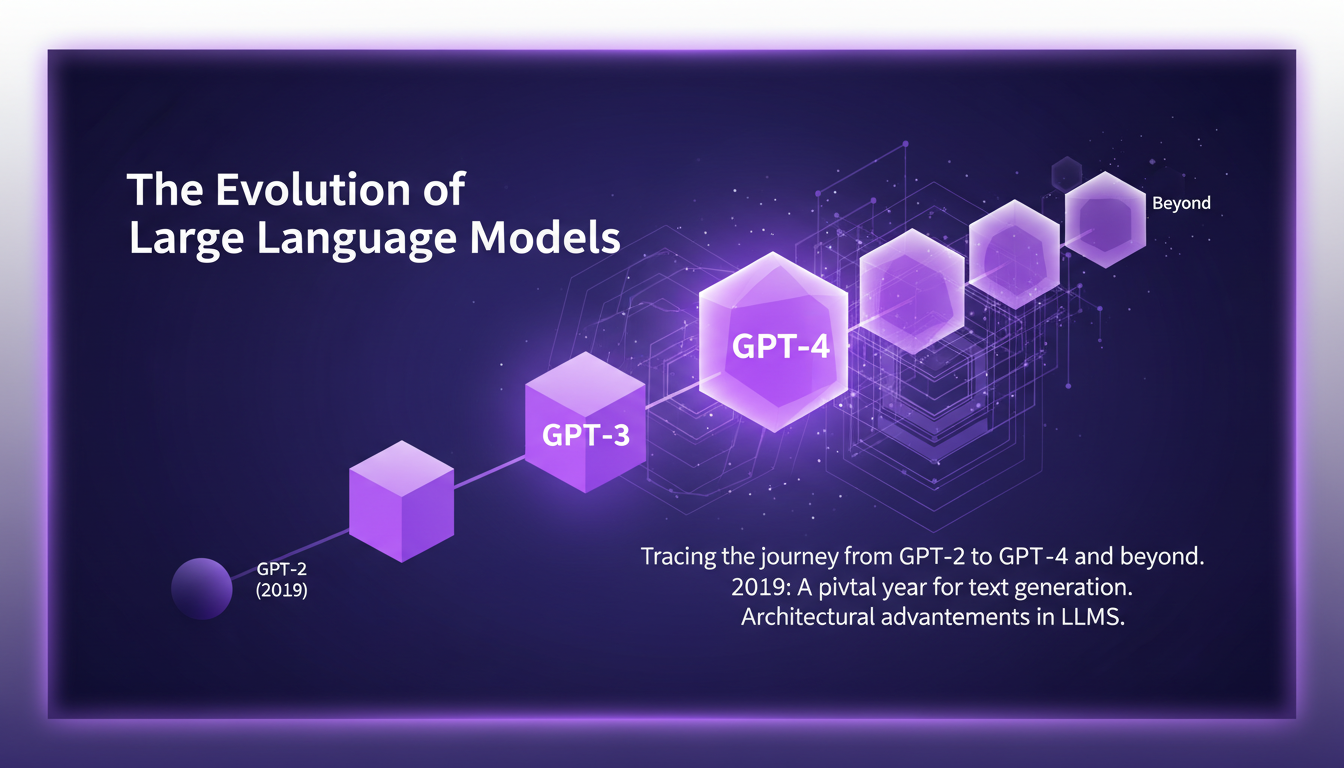

L'Évolution des Grands Modèles de Langage

Quand on parle des grands modèles de langage (LLM), il est crucial de revenir sur les étapes clés de leur évolution. En 2019, le paysage de la génération de texte a changé radicalement avec l'introduction de GPT-2. Ce modèle a marqué un tournant dans l'authenticité de la génération de texte, en produisant des réponses qui paraissaient étonnamment humaines. On a vu ensuite l'arrivée de GPT-3 en 2020, avec ses 175 milliards de paramètres, qui a véritablement redéfini les standards de l'intelligence artificielle. Ce modèle a pu exécuter de nouvelles tâches avec peu ou pas d'exemples, une révolution que je n'avais pas anticipée à l'époque.

GPT-4, sorti en 2023, a amené des capacités multimodales, traitant à la fois le texte et les images, ce qui est un véritable game changer. Mais attention, avec chaque avancée vient aussi son lot de défis. Par exemple, la gestion des coûts et des ressources reste un enjeu critique. Dans ma propre expérience, il s'agit toujours de trouver le bon équilibre entre performance et faisabilité économique.

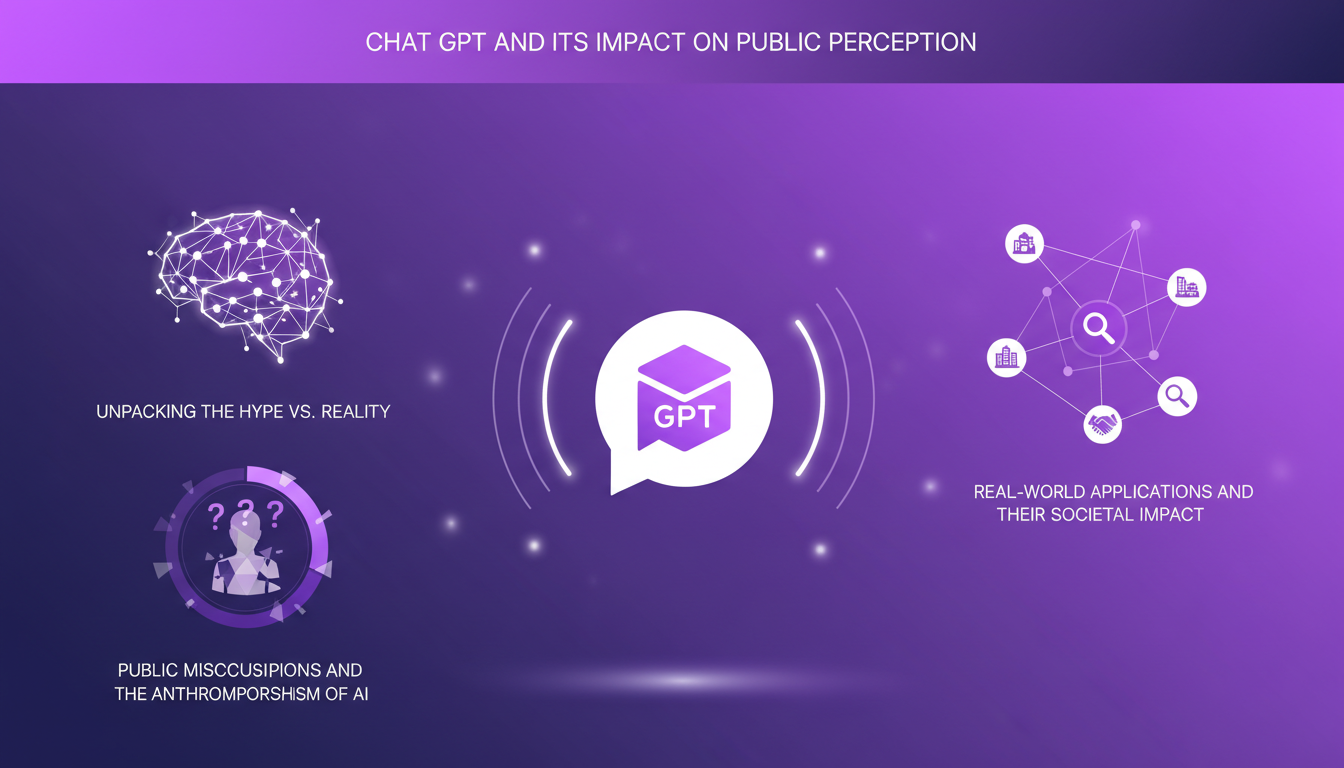

Chat GPT et l'Impact sur la Perception Publique

Chat GPT a propulsé les LLMs sur le devant de la scène publique. Cependant, la perception du public est souvent biaisée par l'anthropomorphisme, cette tendance à attribuer des caractéristiques humaines aux machines. J'ai souvent entendu des gens parler de Chat GPT comme d'un "robot qui pense", ce qui est loin de la réalité. Oui, ces modèles peuvent générer du texte de manière impressionnante, mais ils n'ont ni conscience ni sentiment. Les applications réelles sont nombreuses, allant de la rédaction automatique de contenu à la synthèse de données, mais elles ne sont pas sans limites.

Les médias jouent un rôle crucial dans la formation de ces perceptions, souvent amplifiant les capacités tout en ignorant les limitations. Il est essentiel de tempérer les attentes avec la réalité des capacités actuelles. Personnellement, je me suis fait avoir en surestimant ces capacités lors de mes premiers projets d'implémentation.

Défis dans l'Entraînement et le Fine-Tuning des LLMs

L'entraînement de modèles comme GPT-3 présente des défis colossaux. D'abord, la taille du modèle : plus un modèle est grand, plus il nécessite de ressources. Mais ce n'est pas tout, car la qualité des données est primordiale. J'ai appris à mes dépens que des données biaisées peuvent conduire à des résultats inutilisables. Lors du fine-tuning pour des tâches spécifiques, il faut souvent jongler entre précision et performance, tout en gardant un œil sur les coûts. Parfois, optimiser un modèle plus petit pour une tâche précise s'avère plus efficient.

Un autre problème récurrent est la complexité des modèles. Avec des milliards de paramètres, la gestion des ressources informatiques devient un casse-tête. J'ai souvent dû réévaluer mes approches pour maximiser l'efficacité sans exploser le budget. C'est un jeu d'équilibriste, mais c'est là que réside tout l'intérêt du travail avec les LLMs.

Considérations Éthiques et Benchmarks en IA

Dans le développement et le déploiement des IA, les considérations éthiques sont incontournables. Les LLMs, avec leur capacité à générer du texte autonome, posent des questions de biais et de manipulation potentielle. Il est impératif d'évaluer leur "intelligence" de manière objective, en utilisant des benchmarks et des métriques solides. Cependant, il ne faut pas se laisser leurrer par des scores élevés ; un modèle peut être performant tout en étant biaisé.

J'ai personnellement adopté une approche prudente, en intégrant des vérifications rigoureuses dans tous mes déploiements. Il est crucial d'équilibrer l'innovation avec la responsabilité éthique, surtout quand on travaille avec des modèles qui influencent directement les interactions humaines.

Implications Philosophiques et Prédictions Futures

Les implications philosophiques des avancées en IA sont vastes. Les modèles de langage, bien qu'impressionnants, soulèvent des questions sur la nature de l'intelligence et de la conscience. Dans mes discussions avec des collègues, la question revient souvent : "Qu'est-ce que cela signifie pour notre perception de l'humain ?"

En regardant vers l'avenir, les LLMs continueront de transformer divers secteurs, de l'éducation à la santé. Mais attention, ces avancées peuvent aussi apporter des perturbations. J'ai vu de première main comment l'automatisation, bien qu'utile, peut aussi déstabiliser des emplois traditionnels. Il est impératif de se préparer à la prochaine vague d'avancées en IA, en veillant à ce que la technologie serve réellement nos valeurs sociétales.

Quand je repense à l'évolution des LLMs, je me dis qu'on a parcouru un sacré bout de chemin depuis 2019, où la génération de texte a vraiment changé la donne. En 8 ans, on est passés de GPT2 à GPT4, et franchement, ça a été rapide ! Mais attention, l'innovation ne doit pas faire oublier les enjeux éthiques. On voit des défis dans l'entraînement et le fine-tuning de ces modèles, et surtout, il ne faut pas tomber dans l'anthropomorphisme des IA, elles ne sont pas humaines.

- Impact concret: GPT4, c'est arrivé seulement 4 mois après les premiers tests de GPT3. Ça nous pousse à rester à jour.

- Perception et réalité: Ne pas oublier que malgré l'avancée, les modèles ont leurs limites (surtout au niveau éthique).

- Enjeux: Les interactions avec l'IA doivent rester rationnelles et éviter l'anthropomorphisme.

Pour l'avenir, je suis optimiste mais prudent. Si on reste informés et critiques, on peut construire des systèmes d'IA plus intelligents et responsables. Regarde la vidéo "Les LLMs sont-ils intelligents? Retour sur 8 ans de progrès" pour plonger plus en profondeur. On se retrouve là-bas ? Lien YouTube

Questions Fréquentes

Thibault Le Balier

Co-fondateur & CTO

Issu de l'écosystème startup tech, Thibault a développé une expertise en architecture de solutions IA qu'il met aujourd'hui au service de grands groupes (Atos, BNP Paribas, beta.gouv). Il intervient sur deux axes : la maîtrise des déploiements IA (LLM locaux, sécurisation MCP) et l'optimisation des coûts d'inférence (offloading, compression, gestion des tokens).

Articles liés

Découvrez d'autres articles sur des sujets similaires

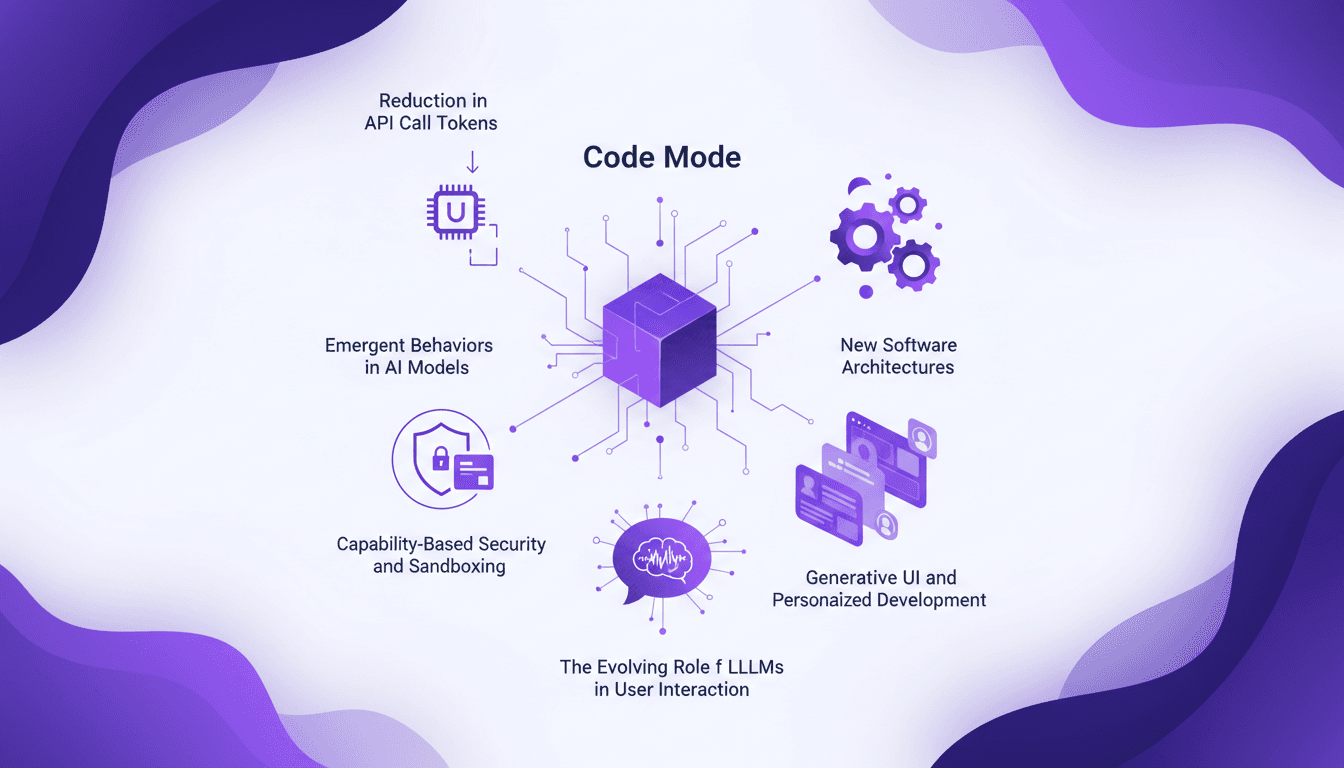

Mode Code : Réduisez les appels API efficacement

J'ai passé des jours à jongler avec les appels API, et laissez-moi vous dire, le Mode Code est un véritable bouleversement. Au début, j'étais sceptique, mais quand j'ai vu une réduction de 99,9% de l'utilisation des tokens, j'ai compris. Plongeons dans le fonctionnement de cette méthode et pourquoi elle est cruciale dans le paysage technologique actuel. Le Mode Code ne se contente pas de réduire les appels API, il transforme notre interaction avec les modèles d'IA, la sécurité basée sur les capacités et même nos interfaces utilisateur génératives. Ce n'est pas juste un mot à la mode, c'est la prochaine étape pour une architecture logicielle plus efficace et sécurisée.

Open Source AI dépasse ChatGPT : mon workflow

Je suis plongé dans l'IA depuis des années, et croyez-moi, les modèles open source bouleversent vraiment le jeu. Quand j'ai vu GLM 5.1 dépasser les géants comme ChatGPT, j'ai su qu'on tenait quelque chose de révolutionnaire. Mais ce n'est pas qu'une question de scores—c'est ce qu'on peut faire avec ces outils, littéralement entre nos mains, qui est excitant. Avec des scores qui font trembler les piliers établis, l'open source redéfinit notre approche du développement et du déploiement de l'IA. On va explorer comment cela se traduit concrètement, des puces Huawei en Chine aux modèles vidéo concurrents à l'échelle mondiale. Cette transformation est bien plus qu'une simple mise à jour technologique—c'est un véritable séisme dans le paysage de l'IA.

Effets Psychologiques des Chatbots: Étude MIT

Je me demandais si ce n'était pas juste du battage médiatique, jusqu'à ce que je plonge dans l'étude du MIT sur les chatbots psychophantes. Et là, le choc : 300 cas de psychoses liées à ChatGPT. On parle d'interactions où des gens perdent pied, et ce n'est pas juste des histoires de science-fiction. Je connecte les points entre les effets psychologiques, les implications légales et éthiques, et les stratégies pour naviguer dans cet espace complexe. Comprendre les limites et les biais de l'IA n'est pas facultatif—c'est essentiel. Il est temps de regarder comment nous pouvons atténuer ces risques et utiliser ces outils de manière efficace.

Tesla passe aux robots : pourquoi et comment

Je configurais un nouveau module d'IA pour un client quand l'annonce est tombée : Tesla délaisse ses emblématiques Model S et X pour se lancer dans la robotique humanoïde. Un véritable séisme technologique que je devais explorer. Alors, je me suis plongé dans les détails de l'Optimus Generation 3 de Tesla et de la puce AI5, découvrant une stratégie qui pourrait redéfinir des industries entières. Tesla ne se contente plus de fabriquer des voitures. Avec l'ambition de produire un million de robots par an, l'entreprise fait un pari colossal sur l'Intelligence Artificielle Générale (AGI) et les machines auto-réplicantes. Examinons ensemble ce que cela signifie pour l'avenir.

Démystifier les AI Closers : Vérités et Limites

J'ai passé des années dans les tranchées de la tech IA, et si j'ai bien appris une chose, c'est que tout ce qui brille n'est pas or—surtout quand on parle d'AI closers. On va couper court au bruit et être réalistes sur ce qui se passe vraiment sur le marché. Les AI closers font beaucoup de bruit, mais sont-ils vraiment les révolutionnaires qu'on nous vend ? Décortiquons les affirmations, la réalité et là où la technologie se situe vraiment. Entre les limites technologiques actuelles, la différence entre fixer un rendez-vous et conclure une vente, et les affirmations de solutions propriétaires, il est temps de démystifier tout ça. Et si les grandes entreprises ne s'y mettent pas, il y a probablement une bonne raison à cela.