Open Source AI dépasse ChatGPT : mon workflow

Je suis plongé dans l'IA depuis des années, et croyez-moi, les modèles open source bouleversent vraiment le jeu. Quand j'ai vu GLM 5.1 dépasser les géants comme ChatGPT, j'ai su qu'on tenait quelque chose de révolutionnaire. Mais ce n'est pas qu'une question de scores—c'est ce qu'on peut faire avec ces outils, littéralement entre nos mains, qui est excitant. Avec des scores qui font trembler les piliers établis, l'open source redéfinit notre approche du développement et du déploiement de l'IA. On va explorer comment cela se traduit concrètement, des puces Huawei en Chine aux modèles vidéo concurrents à l'échelle mondiale. Cette transformation est bien plus qu'une simple mise à jour technologique—c'est un véritable séisme dans le paysage de l'IA.

Plongé dans l'IA depuis des années, je peux vous dire que les modèles open source sont en train de bouleverser le paysage comme jamais auparavant. Quand j'ai vu GLM 5.1 surpasser les grands noms comme ChatGPT avec un score de 58,4% sur le benchmark SWE Bench Pro, là j'ai compris : on tient quelque chose de révolutionnaire. Mais attention, ce n'est pas juste une histoire de chiffres—c'est ce qu'on peut faire avec ces outils, directement entre nos mains, qui change la donne. Imaginez pouvoir orchestrer des modèles qui tiennent tête aux géants, et ce, avec une flexibilité qu'on n'avait jamais vue. De l'écosystème chinois d'IA et des puces Huawei aux investissements de Meta et leur modèle M Spark, sans oublier la concurrence mondiale sur les modèles vidéo, on assiste à un vrai bouleversement. C'est plus qu'une simple mise à jour technologique : c'est un séisme qui redéfinit notre manière d'aborder le développement et le déploiement de l'IA. Et je vais vous montrer comment on peut surfer sur cette vague.

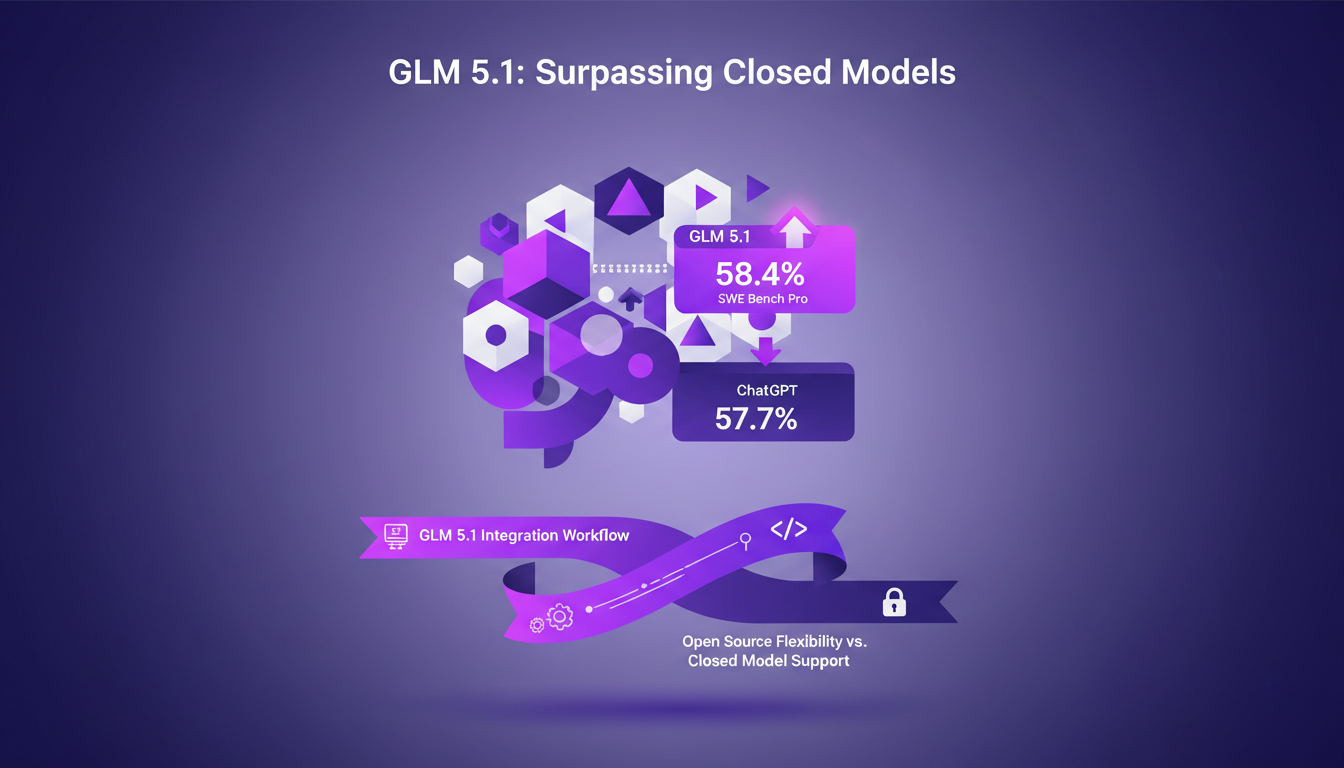

GLM 5.1 : Surpasser les Modèles Fermés

Quand j'ai intégré GLM 5.1 dans nos systèmes, j'ai immédiatement senti la différence. Ce modèle open source a marqué un tournant en obtenant un score de 58,4% sur le SWE Bench Pro, surpassant le célèbre ChatGPT à 57,7%. Oui, c'est un basculement qui force le respect.

Pour l'intégration, j'ai dû d'abord connecter notre dépôt Supabase, puis envelopper l'API dans un service maison. Mais attention, c'est la gestion des tokens qui peut vite déraper si on ne fait pas gaffe. GLM 5.1 est taillé pour travailler sur des tâches autonomes jusqu'à 8 heures d'affilée — un vrai marathonien du code.

Trade-offs ? L'open source offre une flexibilité inégalée, mais ne vous attendez pas au support client d'un modèle fermé. Les scénarios où GLM 5.1 excelle incluent le traitement lourd de données et l'optimisation de requêtes. J'ai vu ce modèle atteindre 21 500 requêtes par seconde, explosant le record précédent. Mais attention à ne pas le surcharger inutilement.

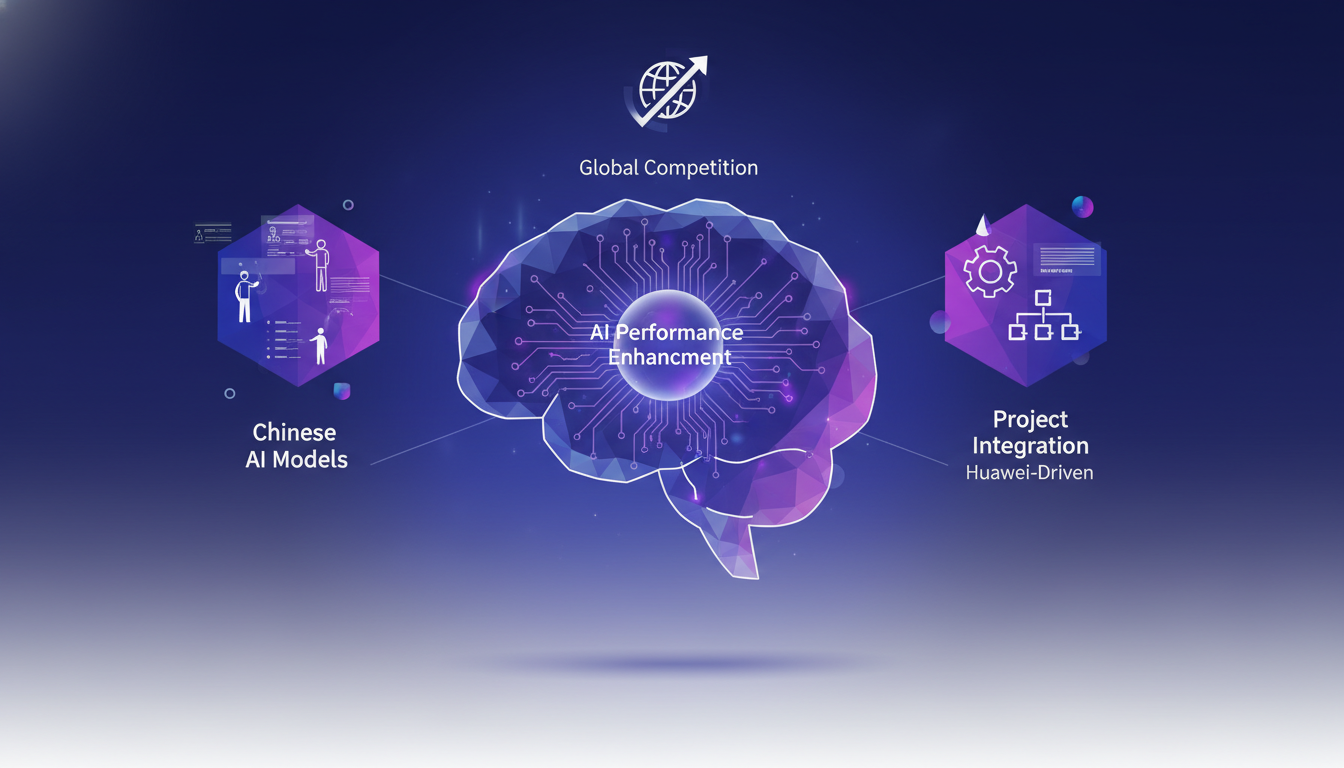

Les Modèles IA Chinois et les Puces Huawei

Les puces Huawei ont joué un rôle pivot dans la montée en performance des modèles IA chinois. Intégrer des modèles propulsés par Huawei a été une expérience révélatrice. Ces modèles, optimisés pour le hardware chinois, m'ont permis d'atteindre une efficacité que je n'avais pas anticipée.

Mais n'oublions pas les trade-offs. Oui, on parle de performances accrues, mais à quel coût ? Les coûts d'implémentation et de maintenance peuvent grimper, surtout si on vise une synergie hardware-software optimale. Cependant, une fois bien orchestré, le résultat est impressionnant. J'ai pu observer une nette amélioration de la capacité d'inférence en intégrant ces modèles sur des projets complexes.

La synergie entre le hardware et le software n'est plus une option, c'est une nécessité. L'impact est direct : puissance de calcul accrue et délais réduits. Pour en savoir plus sur cette tendance, consultez cet article sur l'IA open source chinoise.

Le Modèle M Spark de Meta et l'Investissement

Meta a sorti les gros moyens avec un investissement de 14 milliards de dollars pour mettre au point le modèle M Spark. Ce n'est pas rien, mais les retours sont mitigés. J'ai eu l'occasion de tester ce modèle, et sa puissance est indéniable. Toutefois, l'innovation ne se fait pas sans risques.

Avec M Spark, j'ai dû jongler entre les ressources pour maximiser son potentiel. En orchestrant correctement, on peut vraiment tirer parti de ses fonctionnalités uniques. Mais attention aux limitations : certains aspects du modèle demeurent propriétaires, ce qui peut freiner l'adoption large. Pour un aperçu de ces défis, regardez cet article du New York Times.

Défis ? Eh bien, l'intégration n'est pas de tout repos. Une orchestration fine est nécessaire pour éviter les goulets d'étranglement. Et puis, il y a les coûts d'exploitation. Mais une fois en place, le potentiel est énorme. J'ai pu déployer M Spark sur des projets exigeants, où il a brillé par sa rapidité.

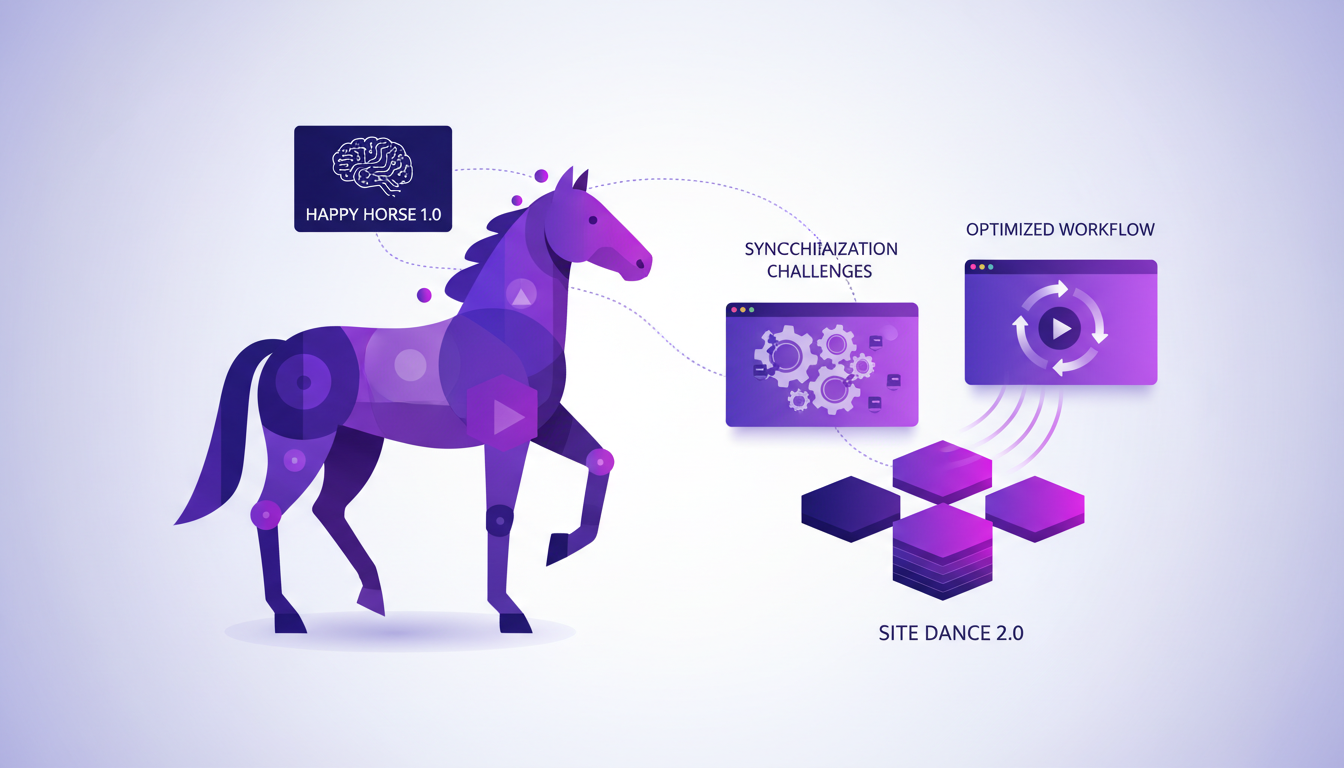

Modèles Vidéo IA : Happy Horse 1.0 et au-delà

Les modèles vidéo IA posent des défis uniques, notamment en termes de synchronisation. Avec Happy Horse 1.0, j'ai dû affiner ma stratégie pour optimiser les performances. Ce modèle a surpassé les précédents, mais attention aux complexités de traitement en temps réel.

Pour optimiser Happy Horse 1.0, j'ai intégré Site Dance 2.0 qui compense les limitations de traitement vidéo. Mais attention, trop de complexité peut nuire à la fluidité. En pratique, il vaut mieux privilégier la simplicité pour des applications en temps réel. Pour plus de conseils pratiques, jetez un œil à comment j'ai utilisé l'IA pour gérer les objections de vente.

Pratique : Évitez de surcharger vos systèmes avec des modèles trop gourmands. Parfois, la simplicité est la clé pour une mise en œuvre efficace.

Sorties à Venir : Dipsic V4 et Lightrix's LTX 2.3

Les nouvelles sorties comme Dipsic V4, avec ses 1000 milliards de paramètres, et Lightrix's LTX 2.3 promettent de bouleverser le paysage IA. Avec l'architecture MOE (Mixture of Experts), Dipsic V4 devrait apporter des capacités inédites. Je suis impatient de voir comment ces innovations vont s'intégrer dans nos workflows.

Ce qui m'intéresse surtout, c'est comment équilibrer l'innovation avec des stratégies de déploiement pratiques. Avec LTX 2.3, j'ai pu tester des modèles de vidéo synchronisée qui ouvrent de nouvelles perspectives pour les créateurs de contenu. Pour préparer l'avenir, ces modèles nécessitent une planification minutieuse des ressources et une adaptation continue.

En conclusion, ces sorties représentent un défi mais aussi une opportunité. Il est crucial de rester à jour avec les dernières avancées, tout en gardant un œil sur les limites techniques et les coûts. Dans ce domaine en constante évolution, l'adaptabilité est la clé.

Alors, voilà ce qu'on voit clairement : les modèles IA open source ne se contentent plus de rattraper leur retard, ils prennent carrément les devants. GLM 5.1 claque un 58,4% sur SWE Bench Pro, dépassant Chat GPT 5.4. Et avec Dipsic V4 qui arrive, on parle de 1000 milliards de paramètres—ça, c'est du lourd. Mais attention, ces avancées s'accompagnent de nouveaux défis techniques qu'il faut piloter intelligemment.

- Les modèles open source dépassent les modèles fermés, c'est un vrai game changer.

- Huawei et le modèle M Spark de Meta montrent que la Chine est un acteur clé avec ses chips.

- Les IA vidéo et la concurrence mondiale s'intensifient, ne pas les négliger.

Regard vers l'avenir : l'écosystème IA open source devient de plus en plus incontournable. Les outils sont là, il faut les mettre à profit dans vos projets. Mais chaque modèle a ses limites—ne vous laissez pas surprendre par les compromis techniques.

Alors, creusez ces modèles, expérimentez, et adaptez vos stratégies. Pour une compréhension plus profonde, je vous recommande de visionner l'intégralité de la vidéo ici. Croyez-moi, ça vaut le détour.

Questions Fréquentes

Thibault Le Balier

Co-fondateur & CTO

Issu de l'écosystème startup tech, Thibault a développé une expertise en architecture de solutions IA qu'il met aujourd'hui au service de grands groupes (Atos, BNP Paribas, beta.gouv). Il intervient sur deux axes : la maîtrise des déploiements IA (LLM locaux, sécurisation MCP) et l'optimisation des coûts d'inférence (offloading, compression, gestion des tokens).

Articles liés

Découvrez d'autres articles sur des sujets similaires

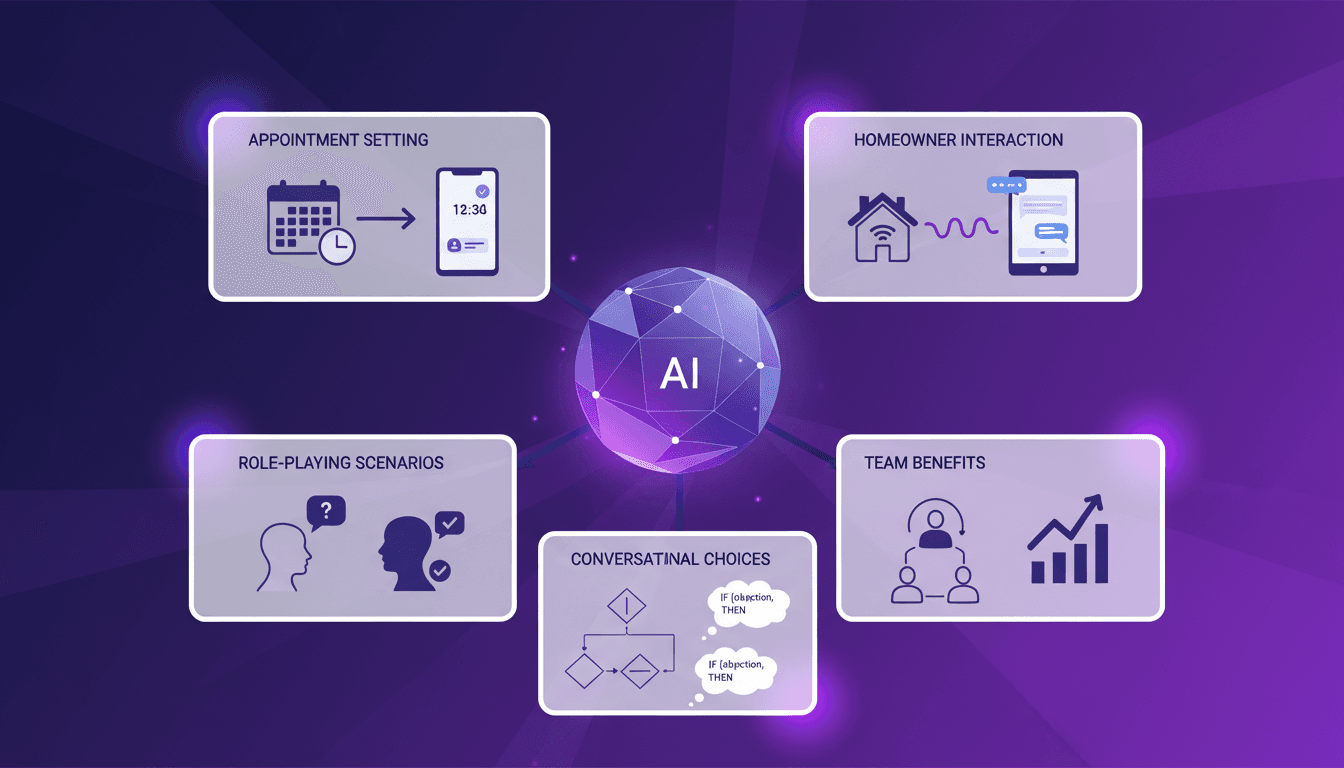

Gérer les Objections de Vente avec l'IA: Expérience

Je me souviens de la première fois que j'ai configuré un gestionnaire de leads IA pour gérer les objections de vente. C'était comme confier les clés à un nouveau conducteur. Le potentiel était énorme, mais il fallait que je voie cela en action pour y croire. Dans le monde hyper rapide des ventes d'aujourd'hui, répondre efficacement aux objections est crucial. Les gestionnaires de leads IA promettent de rationaliser les processus et de gagner du temps. Mais comment se comportent-ils vraiment sous pression ? Je vais vous montrer comment je les ai intégrés, en jouant des scénarios et en interagissant avec des propriétaires. Les bénéfices pour les équipes sont réels, mais attention aux limites !

Effets Psychologiques des Chatbots: Étude MIT

Je me demandais si ce n'était pas juste du battage médiatique, jusqu'à ce que je plonge dans l'étude du MIT sur les chatbots psychophantes. Et là, le choc : 300 cas de psychoses liées à ChatGPT. On parle d'interactions où des gens perdent pied, et ce n'est pas juste des histoires de science-fiction. Je connecte les points entre les effets psychologiques, les implications légales et éthiques, et les stratégies pour naviguer dans cet espace complexe. Comprendre les limites et les biais de l'IA n'est pas facultatif—c'est essentiel. Il est temps de regarder comment nous pouvons atténuer ces risques et utiliser ces outils de manière efficace.