GPT-5.5 : Efficacité augmentée dès les premiers pas

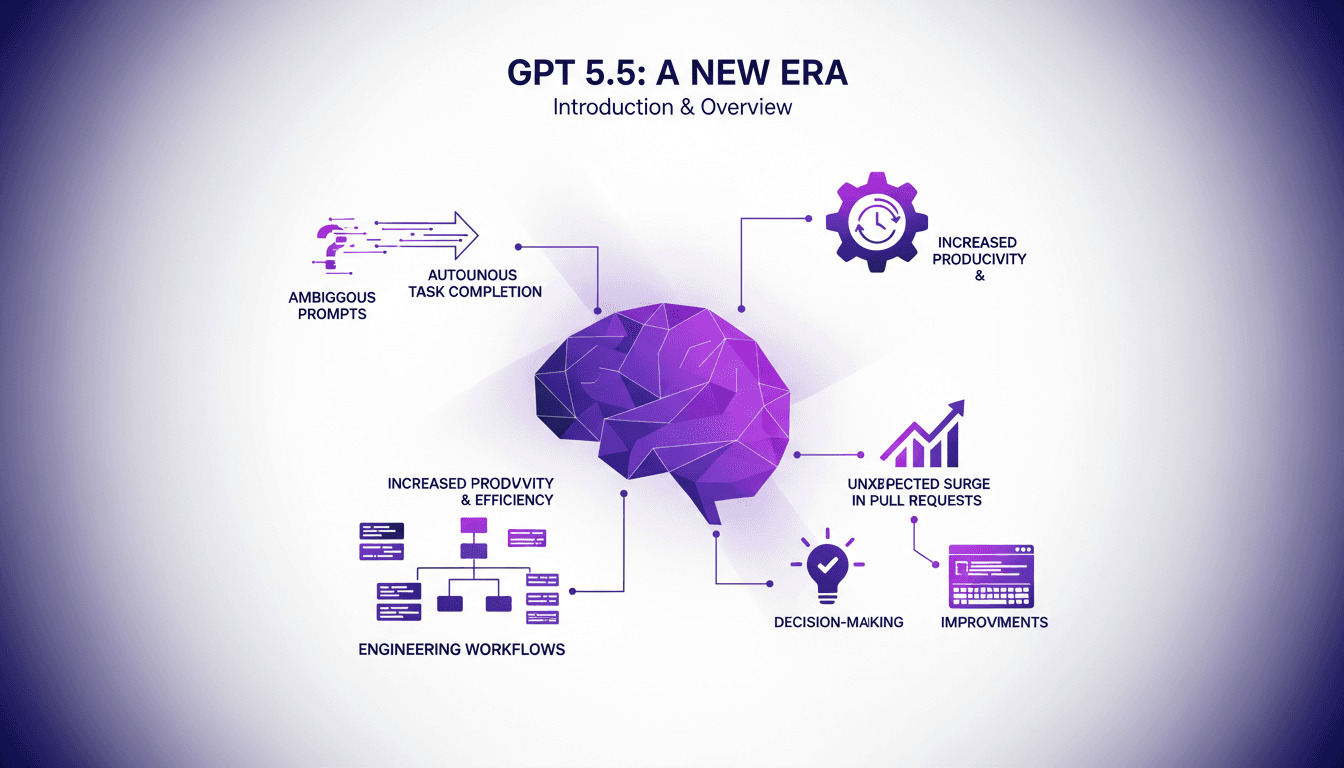

Quand j'ai intégré GPT-5.5 dans ma routine quotidienne, je ne cherchais pas juste un nouvel outil, mais un vrai game changer. Et croyez-moi, il ne m'a pas déçu. En tant qu'ingénieur, je suis toujours en quête de solutions pour optimiser mes processus et booster ma productivité. GPT-5.5 promet de le faire en gérant les prompts ambigus et en complétant les tâches de manière autonome. Les premiers essais ont révélé une efficacité accrue, un impact direct sur mes workflows d'ingénierie et une amélioration notable de la prise de décision et de l'écriture de code. Mais attention, l'augmentation soudaine des pull requests était inattendue. Je vous partage ici mes premières impressions et comment GPT-5.5 peut transformer notre manière de travailler.

Quand j'ai intégré GPT-5.5 dans ma routine quotidienne, je ne cherchais pas juste un nouvel outil, mais un vrai game changer. Et croyez-moi, il ne m'a pas déçu. En tant qu'ingénieur, je suis toujours en quête de solutions pour optimiser mes processus et booster ma productivité. GPT-5.5 promet de le faire en gérant les prompts ambigus et en complétant les tâches de manière autonome. J'ai d'abord connecté mon environnement de travail avec ce modèle et dès les premières heures, j'ai vu une amélioration notable de l'efficacité. On parle ici de prompts ambigus, des tâches qu'il complète sans que je doive intervenir. Ça m'a permis de libérer du temps pour me concentrer sur des décisions stratégiques et peaufiner des lignes de code cruciales. Mais attention, l'augmentation soudaine des pull requests était inattendue. Ça m'a pris par surprise, mais en ajustant mes workflows, j'ai pu l'orchestrer différemment. Je vous partage ici mes premières impressions et comment GPT-5.5 peut transformer notre manière de travailler.

Comprendre GPT-5.5 : Une Nouvelle Ère de l'IA

GPT-5.5, c'est un peu comme passer d'une voiture manuelle à une automatique. Avant, chaque commande devait être précise, presque chirurgicale. Mais là, je balance des instructions un peu floues, et ça fonctionne. Pourquoi ? Parce que GPT-5.5 a été conçu pour gérer l'ambiguïté. C'est un game changer, vraiment. J'ai commencé par créer des arbres de travail pour chaque projet en attente. Le système est rapide, réactif, il va jusqu'au bout. Et les options multiples pour accomplir une tâche, c'est ultra précieux.

Les ingénieurs, moi inclus, ont été bluffés par cette autonomie. Imaginez pouvoir organiser une tâche complexe sans devoir tout détailler. Mes premières impressions ? On s'attend à des gains de productivité, et je ne suis pas déçu. Je m'attendais à des améliorations, mais pas à ce point-là.

Gérer l'Ambiguïté : Accomplissement Autonome des Tâches

GPT-5.5 traite les prompts ambigus comme un pro. C'est là que ça se démarque vraiment des versions précédentes. J'ai testé ça avec un projet complexe, où les instructions étaient intentionnellement vagues. Résultat ? Il a tout décomposé, exploré les différentes possibilités, et a exécuté la tâche de manière autonome. Pas besoin de babysitting. C'est un vrai atout pour les projets où les exigences évoluent constamment.

Mais attention, l'autonomie a ses limites. Parfois, ça peut mener à des résultats inattendus. J'ai dû ajuster mes flux de travail pour maximiser cette caractéristique. Le secret ? Configurer des balises claires pour éviter les dérives.

Augmenter la Productivité et l'Efficacité

Dans mes projets, l'impact sur les métriques de productivité a été immédiat. GPT-5.5, ça coupe dans le gras. Les gains d'efficacité ? Du temps et des coûts réduits, sans compromis sur la qualité. J'organise les tâches de façon à ce qu'elles s'enchaînent naturellement. L'IA s'occupe de tout, des détails aux exécutions complexes.

Mais attention, il ne faut pas en abuser. Trop de tâches autonomes peuvent parfois créer des incohérences. J'ai appris à équilibrer l'input de l'IA avec une supervision humaine pour m'assurer que tout reste sur les rails.

Flux de Travail en Ingénierie et Prise de Décision

GPT-5.5 s'intègre parfaitement dans les flux de travail existants. Je l'ai testé dans plusieurs environnements, et il améliore clairement la prise de décision. Le code est plus précis, les revues de code plus fluides. C'est un assistant qui ne dort jamais, qui ne fait pas d'erreurs de fatigue.

Mais il faut savoir doser. L'IA ne remplace pas l'expertise humaine. Elle l'enrichit. J'ai remarqué que les meilleures décisions se prennent en combinant les deux.

Augmentation Inattendue des Pull Requests : Gérer le Changement

Depuis l'adoption de GPT-5.5, il y a eu une vague de pull requests. C'est comme si l'IA avait ouvert les vannes. Pour l'équipe, ça a changé la donne. Les dynamiques de travail ont évolué, tout comme la charge de travail. J'ai dû mettre en place des stratégies pour gérer cette augmentation. Par exemple, prioriser les revues et organiser des sessions régulières de feedback.

Sur le long terme, cette intelligence accrue va améliorer la qualité du code, mais il faut être vigilant. Ne pas se laisser submerger par la quantité au détriment de la qualité.

Avec GPT-5.5, j'ai redéfini mes workflows d'ingénierie. D'abord, sa capacité à gérer l'ambiguïté transforme les prompts flous en tâches autonomes, ce qui est un vrai game changer. Ensuite, j'ai vu un gain brut en productivité et efficacité; les temps de réponse sont optimisés, et ça, ça fait la différence au quotidien. Mais attention, sans une stratégie claire, vous risquez de vous perdre dans les multiples options qu'il offre pour chaque tâche.

🔹 GPT-5.5 gère sans souci les prompts ambigus et booste la productivité. 🔹 Multiples options pour chaque tâche, mais la clarté est clé pour éviter la surcharge. 🔹 Un vrai impact sur les workflows d'ingénierie, à condition de l'attaquer avec méthode.

Regarder vers l'avenir, c'est comprendre que les outils comme GPT-5.5 sont là pour rester et nous aider à repousser les limites de l'ingénierie. Alors, si vous êtes prêt à élever vos processus, c'est le moment de tester GPT-5.5. N'hésitez pas à visionner la vidéo originale pour une plongée plus profonde. Parfois, un coup d'œil de plus fait toute la différence. [Lien vidéo: https://www.youtube.com/watch?v=nL0lKxZydOk]

Questions Fréquentes

Thibault Le Balier

Co-fondateur & CTO

Issu de l'écosystème startup tech, Thibault a développé une expertise en architecture de solutions IA qu'il met aujourd'hui au service de grands groupes (Atos, BNP Paribas, beta.gouv). Il intervient sur deux axes : la maîtrise des déploiements IA (LLM locaux, sécurisation MCP) et l'optimisation des coûts d'inférence (offloading, compression, gestion des tokens).

Articles liés

Découvrez d'autres articles sur des sujets similaires

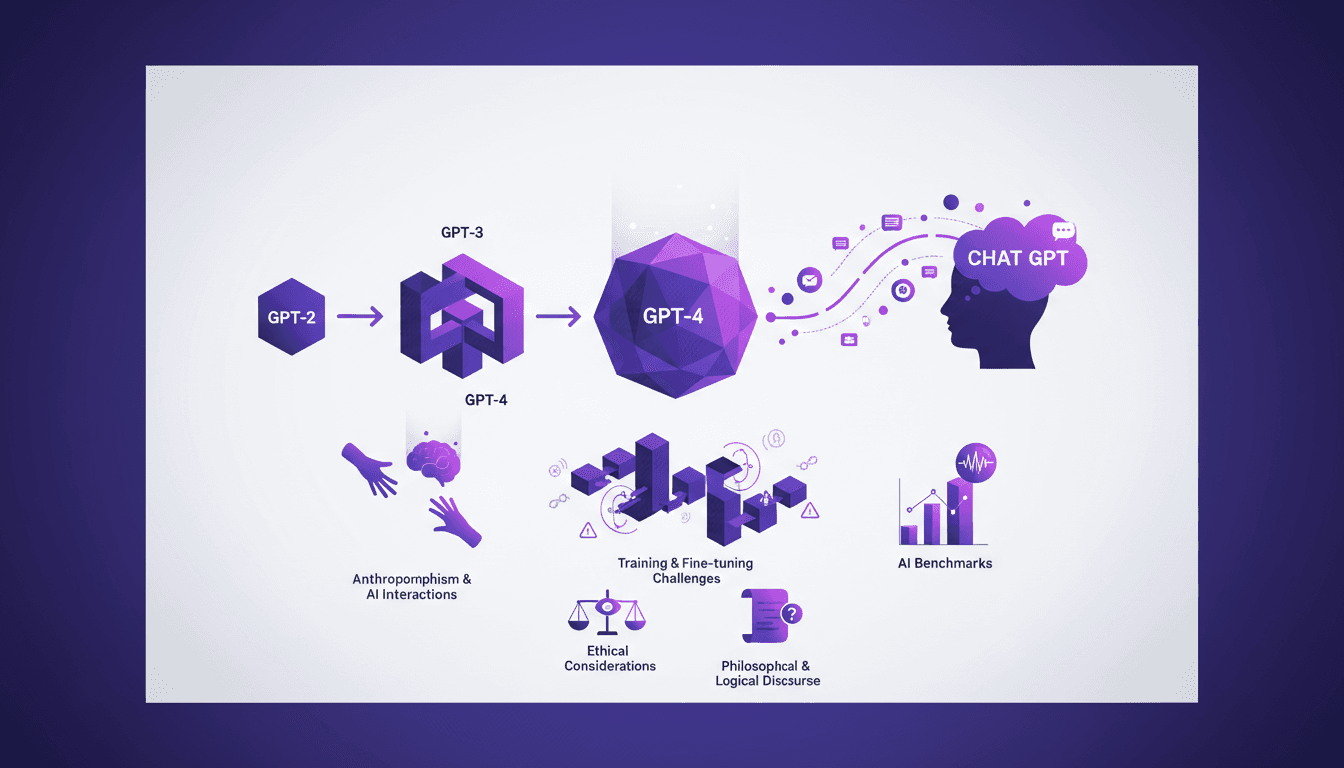

Évolution des LLMs: 8 ans de progrès en IA

Je me souviens quand GPT-2 a débarqué. C'était un vrai tournant, mais pas sans ses bizarreries. Quelques années plus tard, on nage en plein dans les LLMs qui redéfinissent notre interaction avec la technologie. Alors, plongeons ensemble dans ce que ces modèles sont vraiment, ce qu'ils peuvent accomplir, et là où ils pourraient vous faire trébucher. Depuis l'évolution de GPT-2 à GPT-4, ces modèles ont transformé la génération de texte et la perception publique de l'IA. Mais attention, avec une grande puissance viennent de grandes complexités. Nous allons explorer les progrès, les défis d'entraînement, l'anthropomorphisme, et les considérations éthiques, tout en décortiquant l'impact des LLMs sur le discours philosophique et logique.

GitHub: Trouvez un emploi sans postuler

Je n'ai jamais rempli une seule candidature, et pourtant, me voilà embauché grâce à GitHub. C'est fou, non ? Dans le monde de l'open source, vos contributions valent bien plus qu'un CV. GitHub ne se résume pas à un simple dépôt de code, c'est un tremplin pour montrer vos compétences, nouer des contacts avec des employeurs potentiels, et même recevoir des offres d'emploi sans passer par les voies traditionnelles. Je vous expliquerai comment j'ai réussi, en analysant les pull requests pour détecter les opportunités et en gardant toujours un œil sur mon identité et mon travail. Attention, l'utilisation des agents peut être délicate dans votre recherche d'emploi. Et puis, parler le langage des reviewers est essentiel. Je vais partager mes erreurs, mes succès et comment naviguer dans les défis des contributions open source.

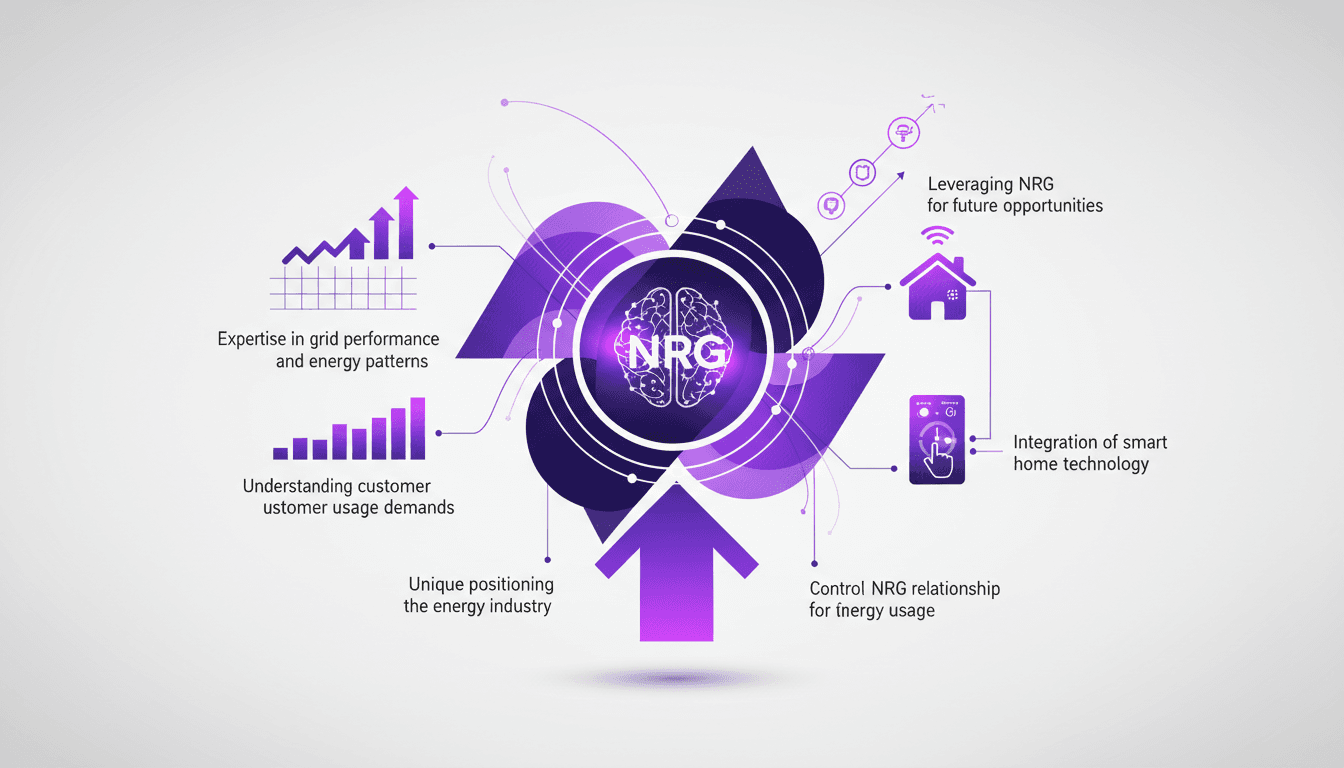

Intégration IA dans l'énergie: Expérience NRG

Rejoindre la famille NRG n'était pas juste un changement de carrière; c'était comme entrer dans une nouvelle ère d'innovation énergétique. Je connecte directement notre expertise en IA à la performance du réseau, et chaque jour, je suis aux commandes de la technologie de maison intelligente qui redéfinit notre façon de penser l'énergie. Dans cet article, je vais vous montrer comment nous avons utilisé notre position au sein de NRG pour améliorer la performance du réseau, comprendre les schémas énergétiques et répondre aux nouvelles demandes des clients, tout en intégrant une technologie de maison intelligente de pointe. Nous parlerons de l'impact de notre acquisition par NRG, de notre expertise en performance de réseau et des modèles énergétiques, et de notre position unique dans l'industrie énergétique. Cette exploration vous donnera un aperçu de notre véritable avantage concurrentiel et de comment nous préparons le terrain pour les opportunités futures.

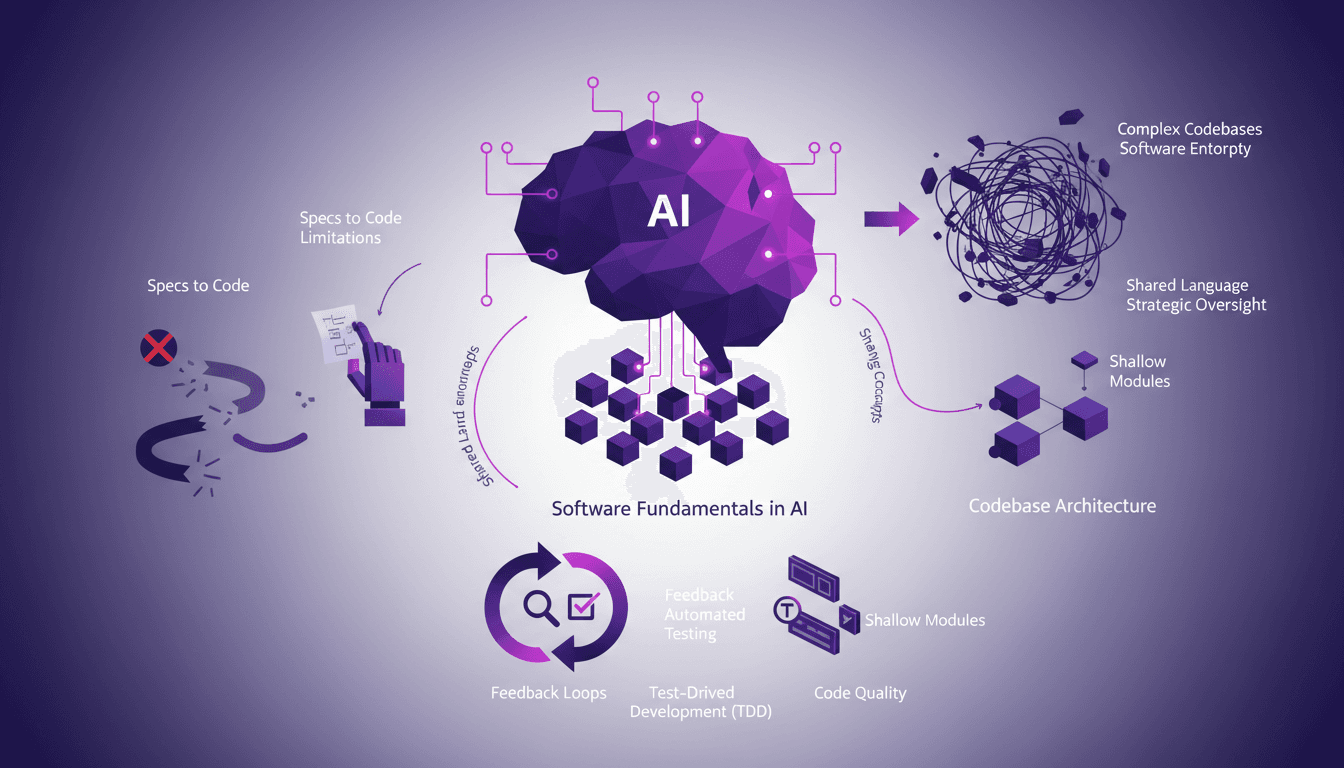

Fondamentaux Logiciels en IA: Pourquoi Ça Compte

Je suis tombé dans les tranchées du développement IA, et si j'ai retenu une chose, c'est que les fondamentaux logiciels ne sont pas juste des bonus, ce sont des game changers. Dans un monde où l'IA évolue à une vitesse fulgurante, il est facile de se laisser emporter par les dernières tendances et d'oublier les principes de base qui assurent la stabilité. Ce n'est pas une question de théorie, mais de workflows pratiques et éprouvés qui peuvent vous faire économiser du temps et des migraines. On va explorer pourquoi le mouvement 'specs to code' a ses limites, comment gérer l'entropie logicielle, et pourquoi des concepts partagés et un bon feed-back sont essentiels. Le Test-Driven Development, c'est ma troisième astuce et c'est crucial pour la qualité du code. Allons démystifier tout cela ensemble.

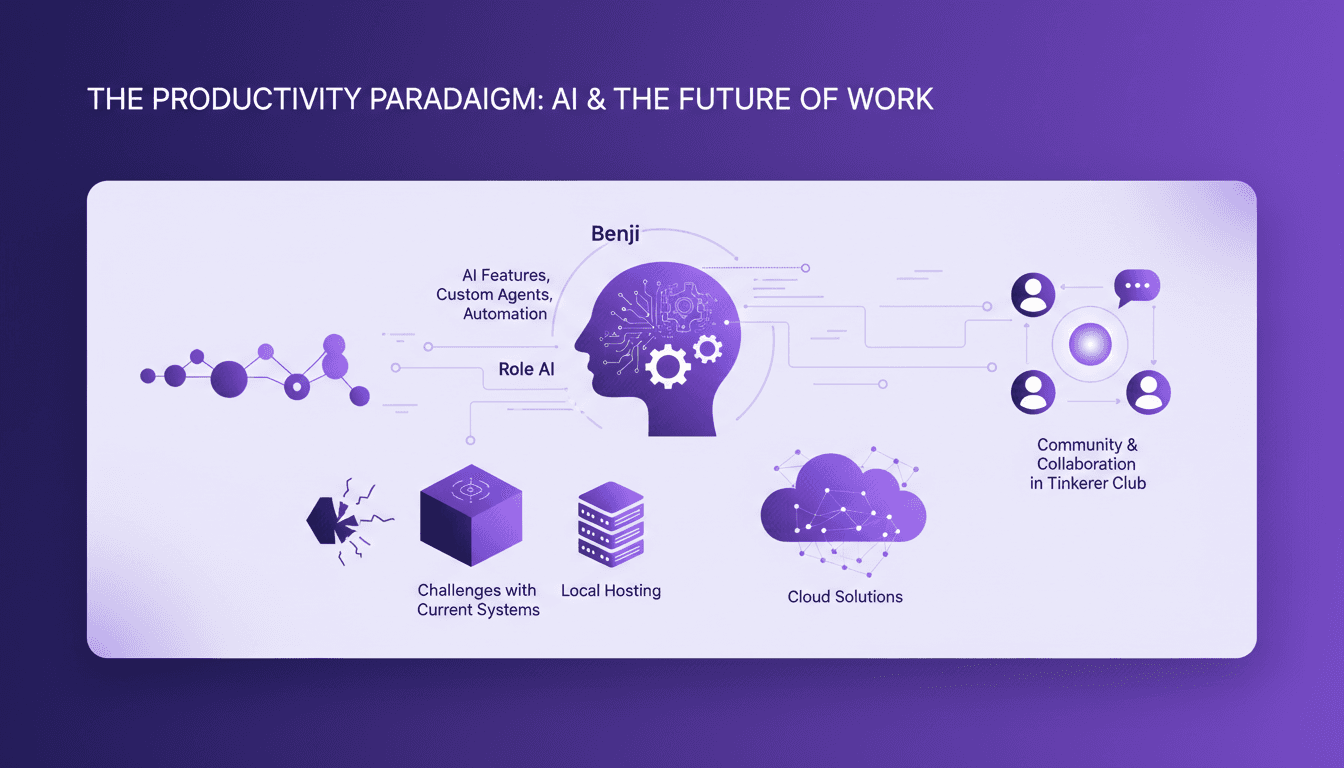

Évolution des Outils: Fin des Apps, Début de Benji

Depuis l'âge de 10 ans, je suis obsédé par les outils de productivité. Aujourd'hui, à 34 ans, je poursuis toujours le système parfait. J'ai construit Benji pour simplifier et redéfinir notre façon de travailler. Ce n'est pas juste une app de plus. C'est une nouvelle approche de la productivité qui remet en question le concept même d'application. Benji intègre l'IA, l'hébergement local et des agents personnalisés pour automatiser nos flux de travail. Les défis avec les systèmes actuels sont nombreux, mais en les abordant différemment, nous pouvons maximiser notre efficacité. Rejoignez-moi pour découvrir comment Benji et la communauté Tinkerer Club changent la donne.