Caractéristiques et Avantages des Petits Modèles

Quand j'ai commencé à entraîner des petits modèles, je me suis dit : 'Ça doit pas être si compliqué.' Mais en fait, c'est une danse subtile entre efficacité et performance. Je vais vous raconter ce que j'ai appris. Dans le monde de l'IA, les petits modèles gagnent en popularité grâce à leur efficacité et leurs applications spécialisées. Je vous dévoile mon parcours avec ces modèles, de l'architecture aux applications réelles. On parle caractéristiques, avantages, techniques d'entraînement, défis comme le 'doom looping', et futures expérimentations. En gros, un vrai tour d'horizon des petits modèles, leur puissance et leurs limites.

Quand j'ai plongé pour la première fois dans l'entraînement des petits modèles, je me suis dit : 'Ça doit pas être si compliqué.' En fait, c'est une danse subtile entre efficacité et capacité. Laissez-moi vous emmener à travers ce que j'ai appris. Dans le monde de l'IA, les petits modèles sont de plus en plus prisés pour leur efficacité et leurs applications spécialisées. J'ai commencé par connecter l'architecture et les couches d'embedding (et là, j'ai découvert que ça demande plus qu'un simple clic). J'ai aussi exploré les techniques d'entraînement et les défis comme le 'doom looping', qui m'ont brûlé plus d'une fois. Et puis, il y a les cas d'usage concrets qui montrent vraiment où ces modèles brillent. Je vais aussi vous parler des directions futures et des expérimentations que je mène. Bref, c'est un tour d'horizon complet de la puissance et des limites des petits modèles.

Caractéristiques et Avantages des Petits Modèles

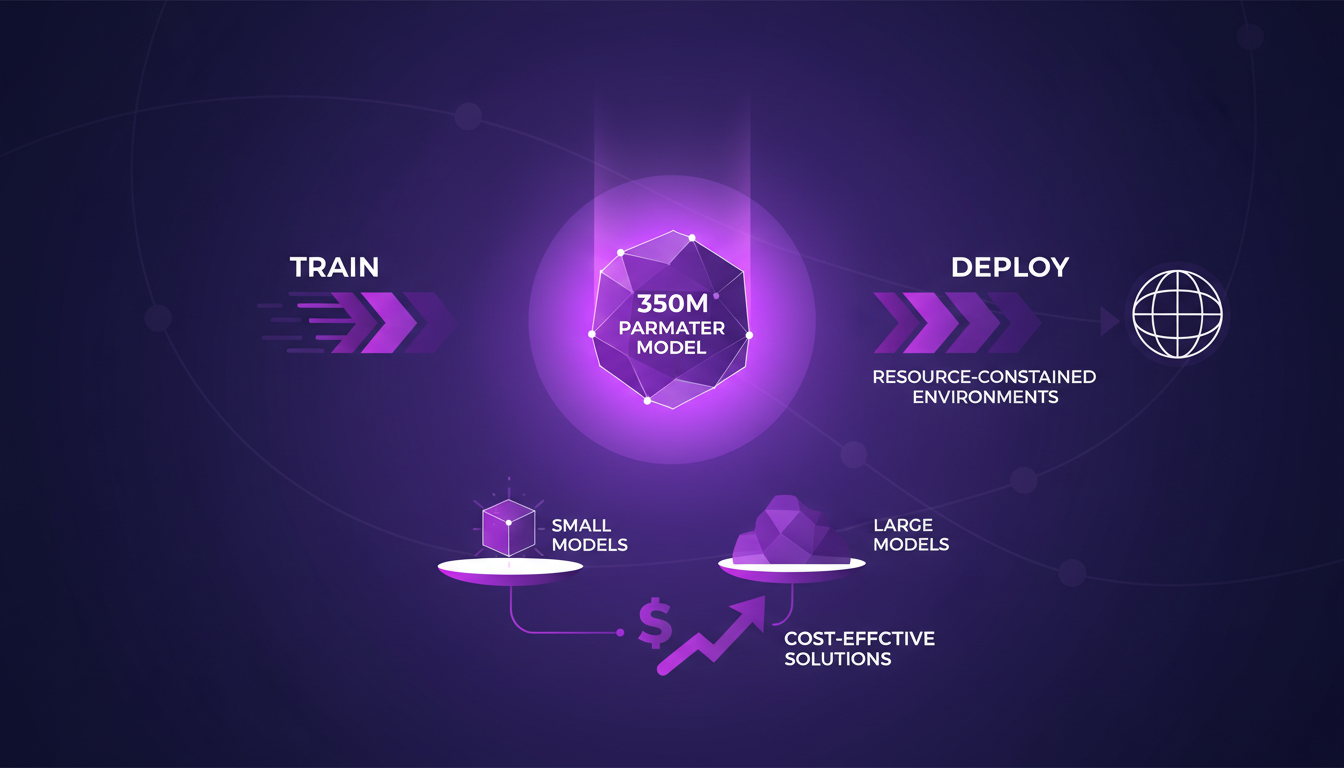

Dans mon expérience chez Liquid AI, j'ai souvent constaté que les petits modèles, comme celui de 350 millions de paramètres, occupent une position idéale entre performance et demande de ressources. Ces modèles sont plus rapides à entraîner et à déployer, ce qui les rend parfaits pour des environnements spécifiques où les ressources sont limitées. Par exemple, dans les applications en temps réel, où la latence doit être minimale, ces modèles brillent par leur efficacité.

Mais attention, il y a un compromis à faire entre la taille du modèle et la précision. Le défi est de trouver l'équilibre. J'ai souvent vu des modèles plus grands être surdimensionnés pour certaines tâches où un modèle plus petit aurait suffi. C'est là que réside le réel avantage : une solution rentable qui ne sacrifie pas la performance.

- Rapidité d'entraînement et de déploiement

- Idéal pour les environnements à ressources limitées

- Compromis entre taille et précision

- Solutions rentables pour des tâches spécifiques

Architecture du Modèle et Couches d'Embedding

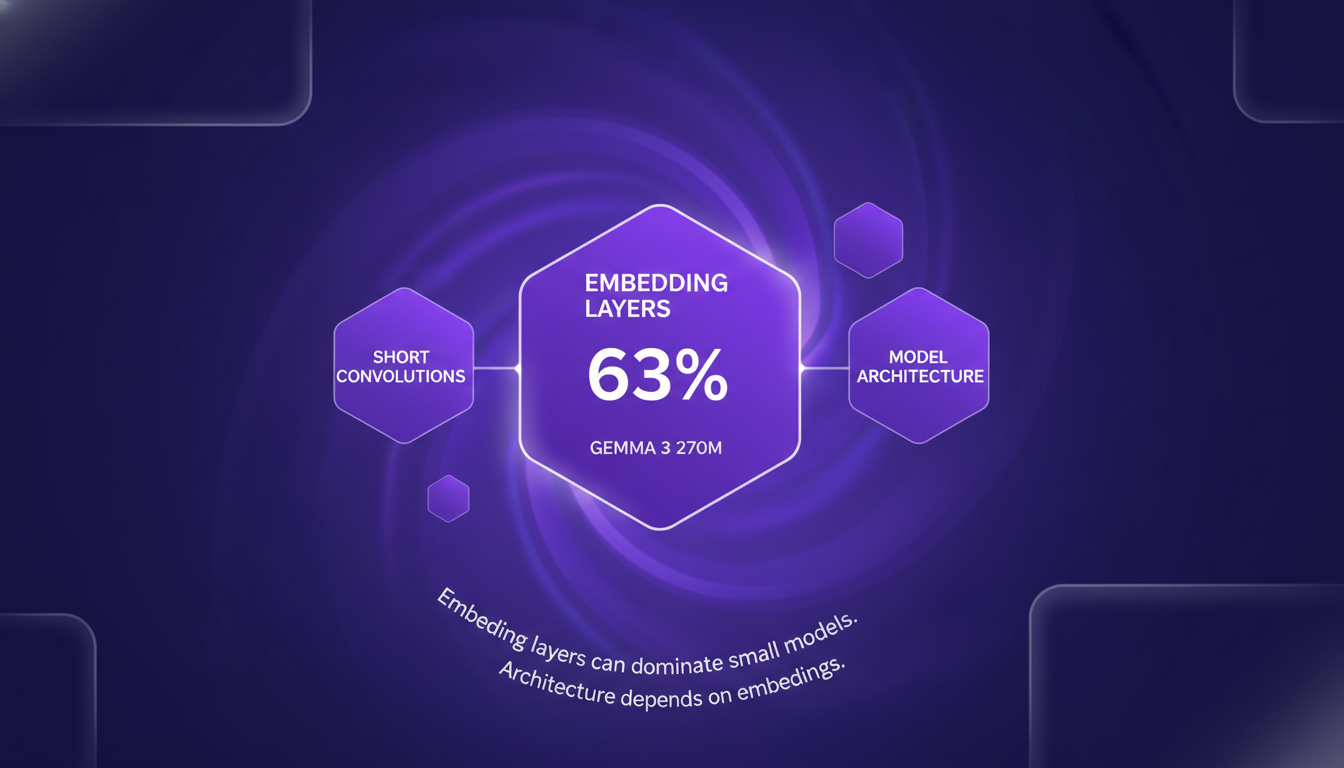

L'architecture joue un rôle crucial dans l'optimisation des modèles pour des tâches spécifiques. J'ai expérimenté différentes architectures, et ce que j'ai souvent remarqué, c'est que les couches d'embedding représentent une part significative des modèles plus petits. Prenez le modèle Gemma 3 270M, où ces couches représentent 63% de l'ensemble des paramètres. C'est énorme !

Les convolutions courtes sont également essentielles pour maintenir l'efficacité sans sacrifier la performance. Dans mes tests, elles se sont avérées plus rapides que d'autres alternatives. Comprendre l'architecture permet d'optimiser le modèle pour des tâches spécifiques, et ça, c'est non négligeable.

- Les couches d'embedding dominent souvent les modèles

- Les convolutions courtes sont cruciales pour l'efficacité

- Optimisation de l'architecture pour des tâches spécifiques

Techniques d'Entraînement pour Petits Modèles

Quand il s'agit d'entraîner des petits modèles, deux techniques se démarquent : le Supervised Fine-Tuning (SFT) et le Reinforcement Learning (RL). Personnellement, je commence toujours par le SFT pour poser une base solide au modèle avant de passer au RL.

Attention, l'entraînement des petits modèles demande de la précision. Une petite erreur peut conduire à des inefficacités. Mais une fois bien entraînés, ces modèles se déploient plus rapidement et à moindre coût.

- SFT pour une base solide

- RL pour la généralisation des tâches

- Précision essentielle pour éviter des inefficacités

- Déploiement rapide et économique

Défis avec le Doom Looping

Un piège courant lors de l'entraînement de modèles est le doom looping, où le modèle s'enlise dans des cycles d'entraînement non productifs. Je me suis fait prendre plusieurs fois avant de comprendre comment identifier les signes avant-coureurs et corriger rapidement le tir.

Prévenir le doom looping implique souvent une surveillance attentive et l'ajustement des hyperparamètres. L'astuce réside dans l'équilibre entre exploration et exploitation pendant l'entraînement.

- Identification rapide des signes de doom looping

- Surveillance des hyperparamètres

- Équilibre entre exploration et exploitation

Cas d'Utilisation et Futures Directions pour les Petits Modèles

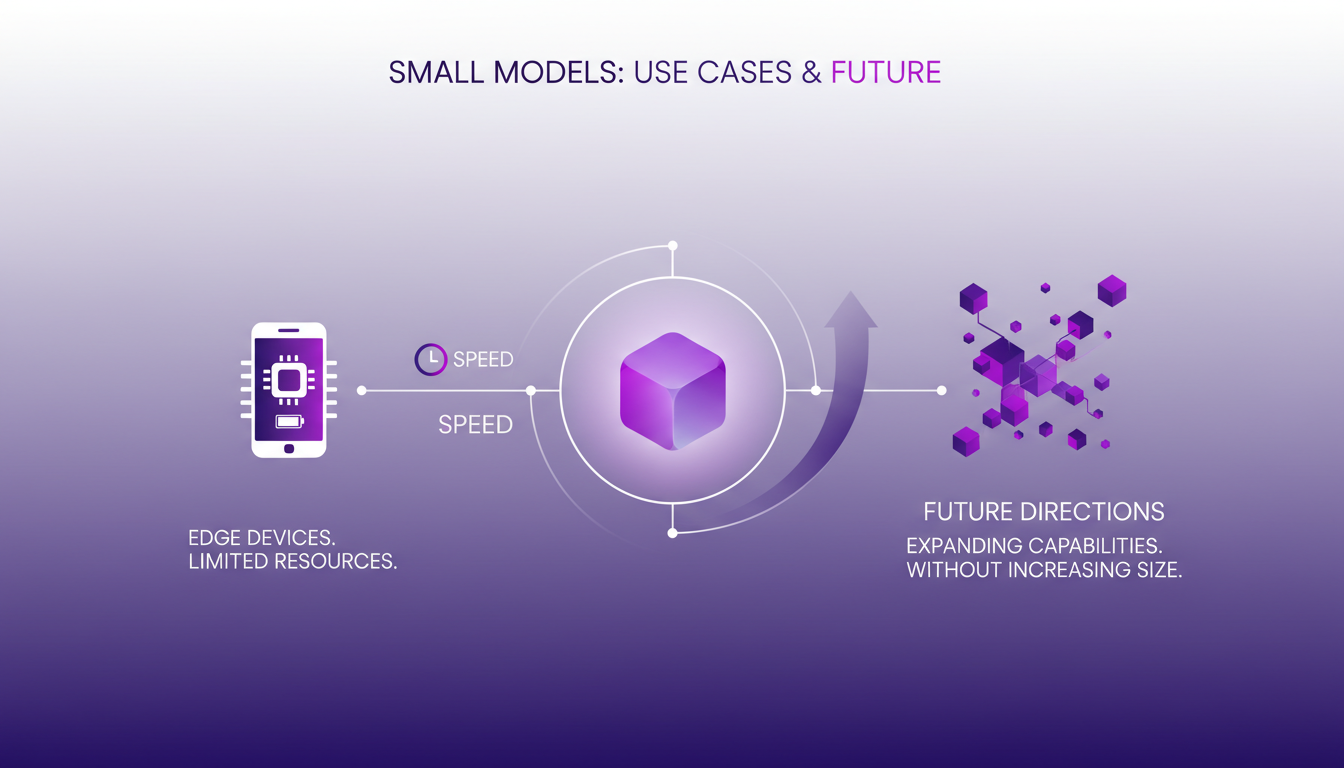

Les petits modèles sont parfaits pour les appareils à ressources limitées, comme les dispositifs en périphérie. J'ai vu des succès dans le déploiement de petits modèles dans des applications en temps réel grâce à leur rapidité.

Les futures expérimentations se concentrent sur l'expansion des capacités sans augmenter la taille. Le modèle 450M VLM en est une preuve vivante des améliorations continues dans les capacités des petits modèles.

- Parfaits pour les appareils en périphérie

- Succès dans les applications en temps réel

- Expérimentations futures pour augmenter les capacités

- Modèle 450M VLM comme preuve d'amélioration

En formant des modèles de petite taille, j'ai compris que l'efficacité et la capacité doivent constamment être équilibrées. D'abord, j'ai pré-entrainé un modèle de 350 millions de paramètres, ce qui a été un véritable défi, surtout quand on compare avec les mastodontes de 24 milliards. Ensuite, j'ai intégré des couches d'embedding astucieuses pour maximiser la performance tout en restant compact. Mais attention, éviter le Doom Looping est crucial pour ne pas stagner.

- Architecture solide et couches d'embedding : C'est la base pour un modèle efficace.

- Techniques d'entrainement ciblées : Elles font toute la différence pour tirer le maximum des petits modèles.

- Éviter le Doom Looping : Une vigilance constante est nécessaire pour ne pas tourner en rond.

À l'avenir, les petits modèles pourraient bien être des game changers, surtout dans des environnements contraints. Alors, commencez à expérimenter dès aujourd'hui; les bénéfices sont tangibles et la courbe d'apprentissage en vaut vraiment la peine. Regardez la vidéo complète de Maxime Labonne sur YouTube pour creuser davantage et échanger sur vos expériences.

Questions Fréquentes

Thibault Le Balier

Co-fondateur & CTO

Issu de l'écosystème startup tech, Thibault a développé une expertise en architecture de solutions IA qu'il met aujourd'hui au service de grands groupes (Atos, BNP Paribas, beta.gouv). Il intervient sur deux axes : la maîtrise des déploiements IA (LLM locaux, sécurisation MCP) et l'optimisation des coûts d'inférence (offloading, compression, gestion des tokens).

Articles liés

Découvrez d'autres articles sur des sujets similaires

Réaliser ses rêves: Événement DreamLIVE à Londres

Avez-vous déjà été dans une pièce avec 600 rêveurs ? Je l'ai fait à DreamLIVE à Londres, où aspirations et actions se rencontrent. On a parlé de tout, des micro-pousses à la créativité propulsée par l'IA. Ce n'était pas juste des paroles en l'air, mais un plan pour construire l'avenir. Parmi les sujets abordés : réalisation personnelle, production alimentaire durable, défis de l'industrie du sport automobile, préservation des races de chevaux indigènes, et l'autonomisation des femmes issues de minorités ethniques dans les entreprises. La diversité des parcours et des visions a transformé cette rencontre en une véritable source d'inspiration, et j'ai quitté l'événement avec une énergie renouvelée pour construire mes propres rêves.

Construire l'AGI: Techniques et Défis

J'ai passé plus de 30 ans dans les tranchées de l'IA, et construire l'avenir, ce n'est pas juste un slogan — c'est un travail quotidien. Parlons d'Intelligence Artificielle Générale (AGI), un concept qui n'est pas seulement à l'horizon mais déjà en train de remodeler nos workflows. Avec les jalons de Deep Mind comme guide, on explore les modèles d'IA efficaces et les techniques de distillation, en passant par le travail interdisciplinaire qui repousse les limites. Construire l'AGI, c'est un marathon, pas un sprint. On y va, un modèle à la fois.

Comprendre l'IA Générative: Guide Pratique

Je me souviens encore de mes débuts dans le codage IA, pensant que l'IA générative n'était qu'un mot à la mode. Puis j'ai réalisé que c'était un vrai game changer, mais seulement si on sait l'exploiter correctement. D'abord, j'ai plongé dans ses fondamentaux – comprendre comment ces outils transforment notre manière de coder. Les ingénieurs passent à peine deux heures par jour sur du codage réel, le reste du temps, c'est l'orchestration. Et c'est là que l'IA entre en jeu, boostant la productivité et redéfinissant nos rôles. Je vous explique comment j'ai navigué ce paysage complexe, de l'impact environnemental des technologies IA à l'ingénierie des prompts et la gestion du contexte. Suivez-moi, explorons comment maîtriser l'IA générative pour révolutionner notre approche du développement logiciel.

Fusées Réutilisables: Clé de l'Espace

Je me souviens encore du premier lancement de fusée réutilisable que j'ai vu. Un véritable bouleversement pour la capacité spatiale. Aujourd'hui, alors que nous repoussons les limites de la puissance de calcul dans l'espace, la demande pour des puces spécialisées explose. Avec des acteurs comme SpaceX et Stoke Space, les fusées réutilisables transforment notre approche de la capacité spatiale. Mais ce n'est pas juste une question d'y arriver—c'est ce qu'on fait une fois en orbite qui compte. C'est là que les puces d'inférence entrent en jeu, optimisées pour les conditions uniques de l'espace. Plongeons dans la manière dont nous optimisons l'électronique pour les réalités difficiles de l'espace.

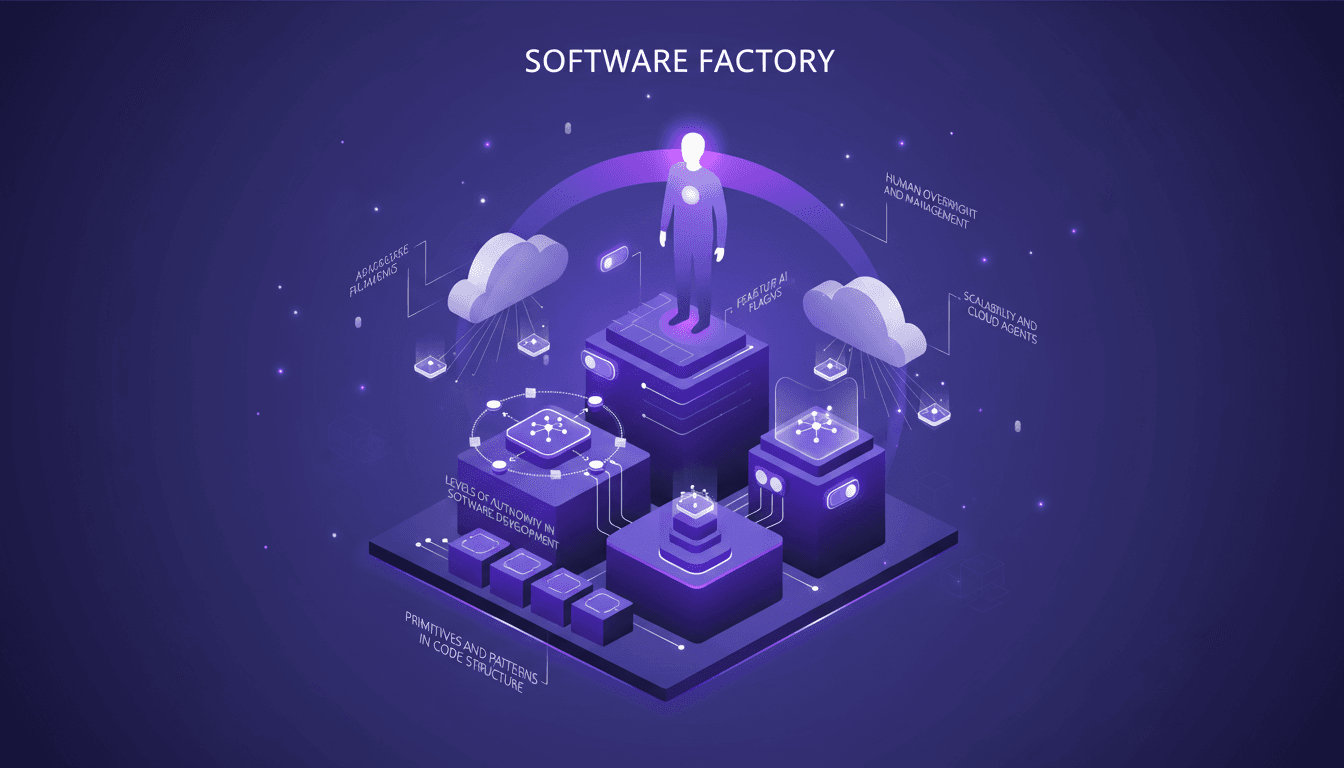

Construire une usine logicielle: étapes clés

Je me souviens de la première fois où j'ai pensé à construire une usine logicielle. Ça m'a semblé colossal, mais avec une approche en étapes, ça l'est devenu beaucoup moins. Dans cet article, je vous emmène à travers mon parcours pour mettre en place ma propre usine logicielle, en mettant l'accent sur l'efficacité et l'évolutivité. On va explorer les composants clés et les stratégies pour réussir, en passant par le rôle des agents AI et le feature flagging, jusqu'à la vérification et les tests dans des systèmes automatisés. Pour moi, une usine logicielle, c'est bien plus qu'une simple automatisation, c'est un changement de paradigme complet qui peut transformer la productivité. Alors, comment on pilote ça sans se brûler les ailes ? Je partage mes erreurs, mes succès, et surtout les leçons apprises.