Construire l'AGI: Techniques et Défis

J'ai passé plus de 30 ans dans les tranchées de l'IA, et construire l'avenir, ce n'est pas juste un slogan — c'est un travail quotidien. Parlons d'Intelligence Artificielle Générale (AGI), un concept qui n'est pas seulement à l'horizon mais déjà en train de remodeler nos workflows. Avec les jalons de Deep Mind comme guide, on explore les modèles d'IA efficaces et les techniques de distillation, en passant par le travail interdisciplinaire qui repousse les limites. Construire l'AGI, c'est un marathon, pas un sprint. On y va, un modèle à la fois.

J'ai plongé dans l'IA il y a plus de trois décennies, et croyez-moi, construire l'avenir n'est pas qu'un slogan accrocheur — c'est un véritable travail de fond. Parlons de l'Intelligence Artificielle Générale (AGI). Ce n'est pas une simple idée dans le futur lointain ; elle s'infiltre déjà dans nos workflows, redéfinissant nos approches. Avec les exploits de Deep Mind pour nous orienter, on va décortiquer les modèles d'IA efficaces, les techniques de distillation et le travail interdisciplinaire qui pousse les frontières. Je me suis fait avoir plus d'une fois en sous-estimant ces défis. Les limites de la mémoire et du raisonnement de l'IA restent des obstacles, mais chaque avancée nous rapproche de notre objectif : une AGI d'ici 2030. C'est un marathon, pas un sprint, et on progresse, un modèle à la fois. Alors, prêt à explorer comment nous bâtissons réellement cet avenir?

Développement de l'AGI : Feuille de route et réalités

Quand on parle de l'Intelligence Artificielle Générale (AGI), le calendrier 2030 n'est pas qu'une simple spéculation. Deep Mind, co-fondée en 2010 par Demis Hassabis, a déjà marqué des jalons impressionnants, que ce soit avec AlphaGo ou AlphaFold. Ces réalisations montrent que l'AGI est sur la bonne voie. Mais ne nous emballons pas trop vite, il y a des défis pratiques : mémoire, raisonnement, et surtout, l'apprentissage par renforcement qui joue un rôle crucial. J'ai moi-même souvent eu du mal à équilibrer ces éléments dans mes projets, et je peux vous dire qu'il n'y a pas de solution miracle.

Si l'on veut atteindre l'AGI d'ici 2030, il faut résoudre ces questions de manière pragmatique. Par exemple, l'apprentissage continu et le raisonnement à long terme sont encore des sujets non résolus, même si des progrès ont été réalisés. Mais attention, cela demande des ajustements constants et une vigilance accrue pour éviter les erreurs coûteuses.

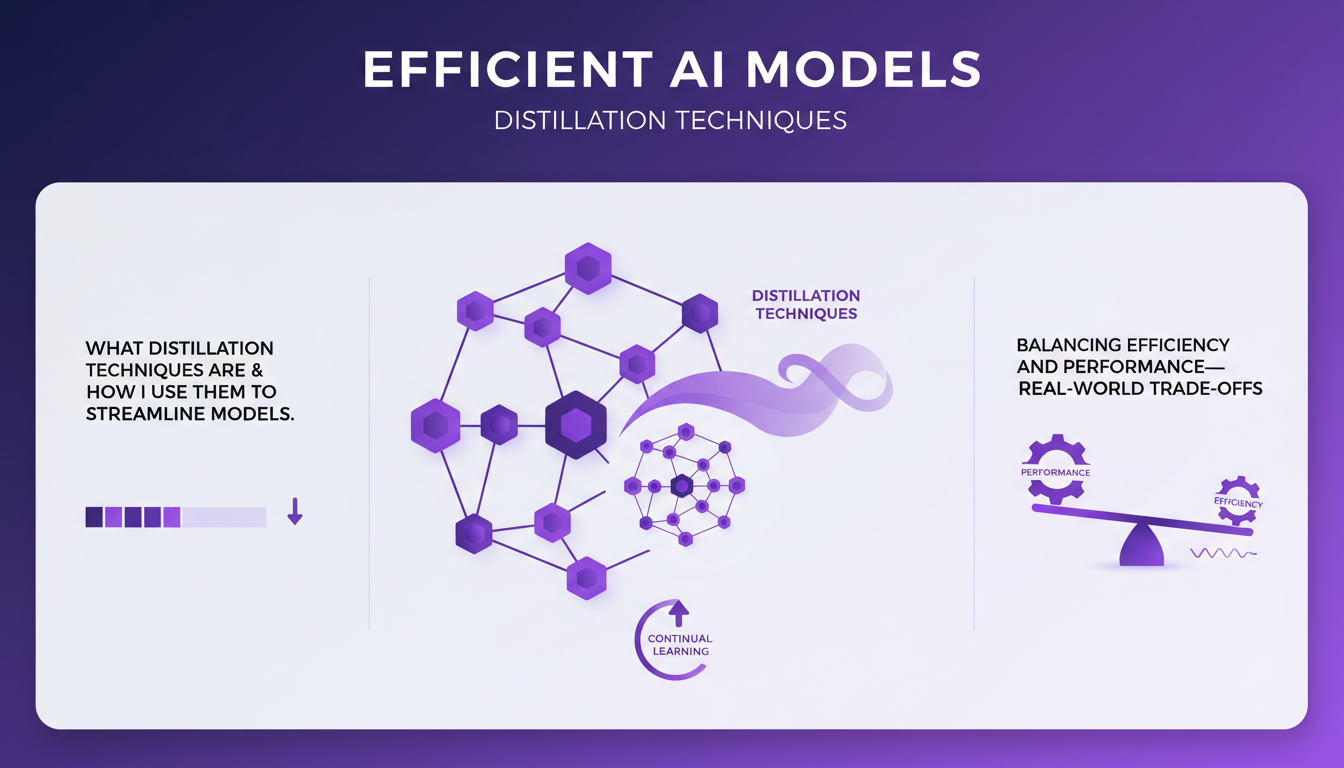

Modèles d'IA efficaces : Techniques de distillation

Les techniques de distillation sont essentielles pour optimiser nos modèles d'IA. En gros, elles permettent d'extraire l'essence d'un modèle complexe pour le rendre plus léger sans sacrifier la performance. Je les utilise souvent pour gagner en efficacité. Mais là encore, il y a un équilibre à trouver : entre performance et efficacité, il faut naviguer avec prudence.

La continual learning est une autre pièce du puzzle. Elle permet de raffiner les capacités de l'IA au fur et à mesure. Pour implémenter la distillation dans vos projets, commencez par identifier les modèles lourds qui pourraient bénéficier d'une réduction, puis appliquez la distillation pour les alléger. Mais attention à ne pas trop réduire, sous peine de perdre en qualité.

L'IA dans la découverte scientifique : Approches interdisciplinaires

On ne peut pas ignorer l'impact de l'IA sur la découverte scientifique. Des avancées comme AlphaFold ont transformé la biologie structurelle. On parle même de modéliser une cellule virtuelle complète d'ici dix ans, ce qui est monumental. Pour y arriver, la collaboration interdisciplinaire est cruciale. J'ai vu des équipes coupler IA et biologie, et les résultats sont souvent bien plus que la somme de leurs parties.

Si vous travaillez dans ce domaine, assurez-vous de bâtir des ponts entre disciplines pour exploiter pleinement le potentiel de l'IA. Parfois, ça signifie mettre de côté l'égo et écouter les experts d'autres domaines. Les résultats peuvent être incroyablement enrichissants.

Open Source et Accessibilité : Démocratiser l'IA

Le code source ouvert révolutionne le développement de l'IA. Il permet une accessibilité accrue, mais pose aussi des défis, notamment en matière de sécurité et de qualité. Dans mon travail quotidien, j'utilise énormément d'outils open source. Cela me permet de réduire les coûts tout en accélérant le développement. Mais, il faut être vigilant quant à la maintenance et à la sécurité de ces solutions.

L'impact de l'open source sur l'innovation est indéniable. Cela permet à des petites structures d'accéder à des technologies de pointe sans coûts prohibitifs, ce qui nourrit l'innovation à tous les niveaux.

Technologies futures : Le rôle croissant de l'IA

L'IA ne cesse d'étendre son influence, mais il ne faut pas se laisser emporter par le battage médiatique. Il y a un équilibre à trouver entre innovation et éthique. Dans les secteurs émergents, l'IA joue un rôle clé, mais il faut être prêt à naviguer entre innovation et considérations éthiques. Préparez-vous en acquérant les compétences nécessaires dès maintenant.

Les applications pratiques de l'IA dans ces secteurs sont variées : de la santé à l'environnement. Pour être prêt, formez-vous et restez à jour sur les outils et compétences en demande. AI Native Services est une bonne ressource pour commencer.

Dans l'aventure de développement de l'IA, on a vu que l'AGI n'est pas juste un rêve lointain mais un objectif tangible. D'abord, en exploitant des modèles efficaces, on a réduit le temps et les coûts de calcul. Ensuite, le travail interdisciplinaire nous a permis de briser les silos de connaissance, et l'accessibilité open-source ouvre des portes à tous. Ne nous trompons pas, les défis demeurent, notamment au niveau de la mémoire et du raisonnement de l'IA, mais on avance. D'ici 2030, atteindre l'AGI est sur la table, un horizon fascinant à prendre avec une bonne dose de pragmatisme.

- Modèles efficaces : Réduisent le temps de calcul et les coûts.

- Travail interdisciplinaire : Briser les silos de connaissances.

- Accessibilité open-source : Facilite l'innovation collective.

Prêt à plonger plus profondément ? Intégrez ces techniques dans vos projets et rejoignez la conversation sur les technologies de demain. Pour plus de perspectives, je vous encourage à regarder la vidéo complète: "How to Build the Future: Demis Hassabis".

Questions Fréquentes

Thibault Le Balier

Co-fondateur & CTO

Issu de l'écosystème startup tech, Thibault a développé une expertise en architecture de solutions IA qu'il met aujourd'hui au service de grands groupes (Atos, BNP Paribas, beta.gouv). Il intervient sur deux axes : la maîtrise des déploiements IA (LLM locaux, sécurisation MCP) et l'optimisation des coûts d'inférence (offloading, compression, gestion des tokens).

Articles liés

Découvrez d'autres articles sur des sujets similaires

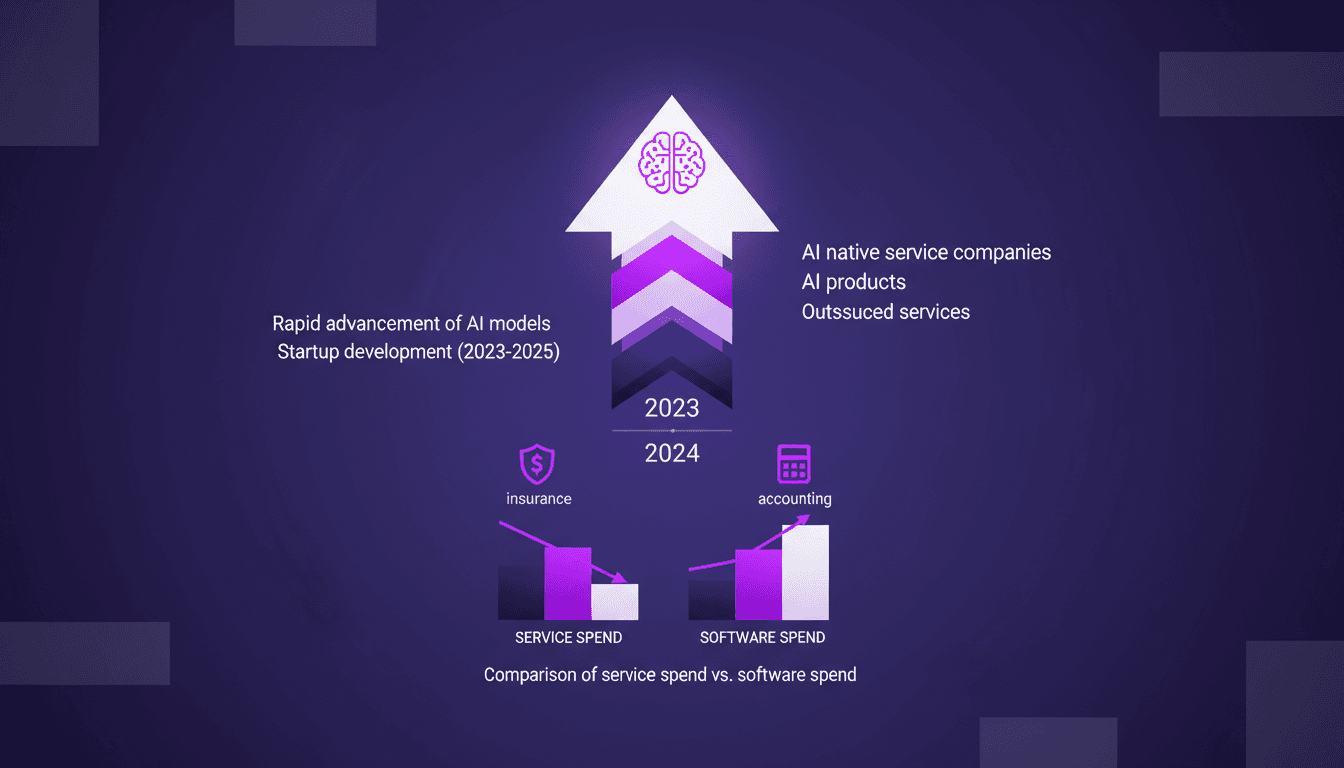

Services IA natifs : Révolution dans l'industrie

Depuis des années, je suis immergé dans le monde de l'IA, observant les outils se transformer en véritables services natifs IA. Ce n'est pas juste une tendance, c'est une révolution en marche. Avec l'avancée fulgurante des modèles d'IA, on assiste à un glissement des outils logiciels traditionnels vers des services entièrement repensés par l'IA. On parle ici de remplacer des secteurs entiers d'externalisation par des produits IA, et c'est un changement majeur. Des industries comme l'assurance et la comptabilité ressentent déjà l'impact. Je vais vous expliquer comment tout cela se déroule et pourquoi c'est un véritable game changer. Vous verrez, ce n'est pas juste du bruit médiatique, c'est concret.

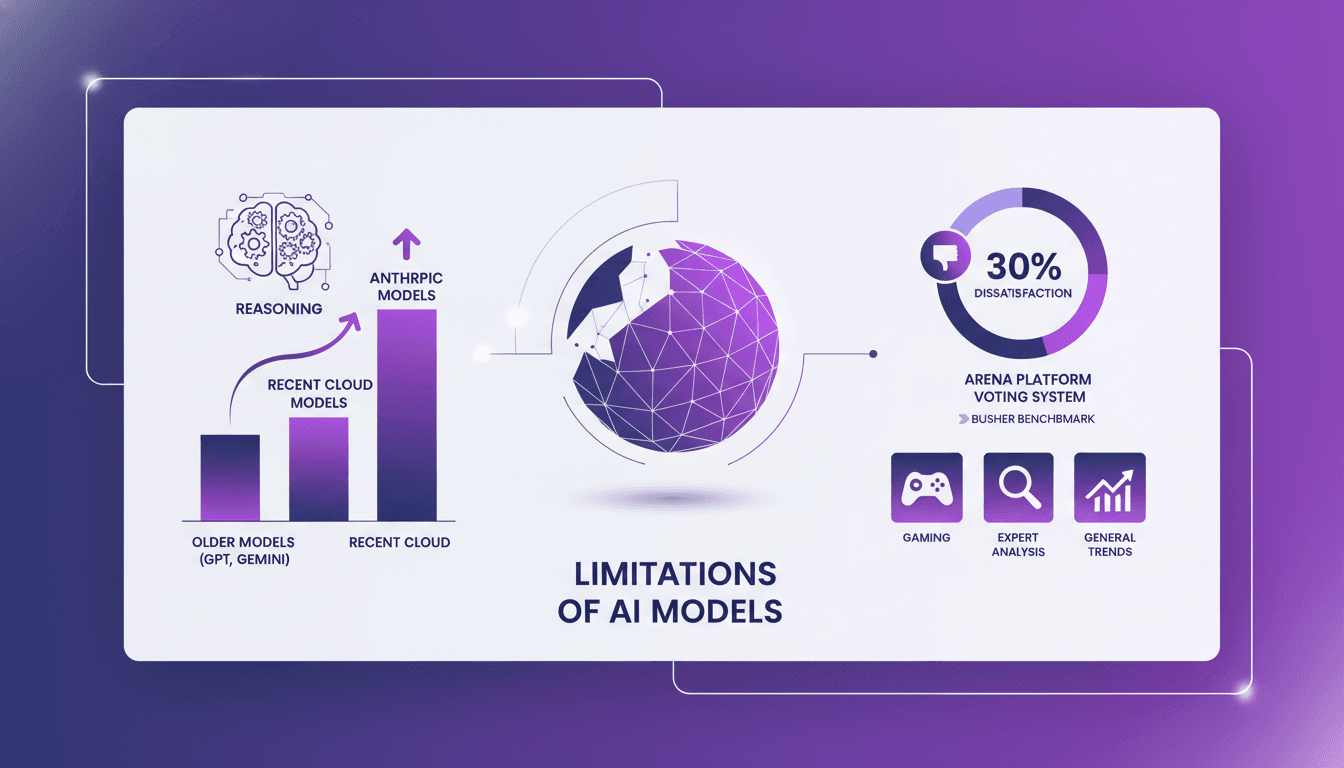

Limites des Modèles IA: Ce Qui Ne Fait Pas le Job

Plongé jusqu'au cou dans les modèles IA, j'ai testé et retesté — et croyez-moi, il reste encore beaucoup de choses qu'ils ne peuvent pas gérer. Je me suis souvent brûlé les ailes par excès de confiance, pensant que les modèles allaient tout comprendre. Mais entre les benchmarks 'Busher' et le système de vote d'Arena, j'ai vu où ils brillent et où ils trébuchent. On va disséquer ces limites ensemble et comprendre le véritable paysage de performance. Des modèles cloud récents aux anciens comme GPT et Gemini, il y a des tendances claires et des domaines spécifiques, comme le gaming, où les performances sont encore loin d'être parfaites. Prêt à voir au-delà du battage médiatique? Allons-y !

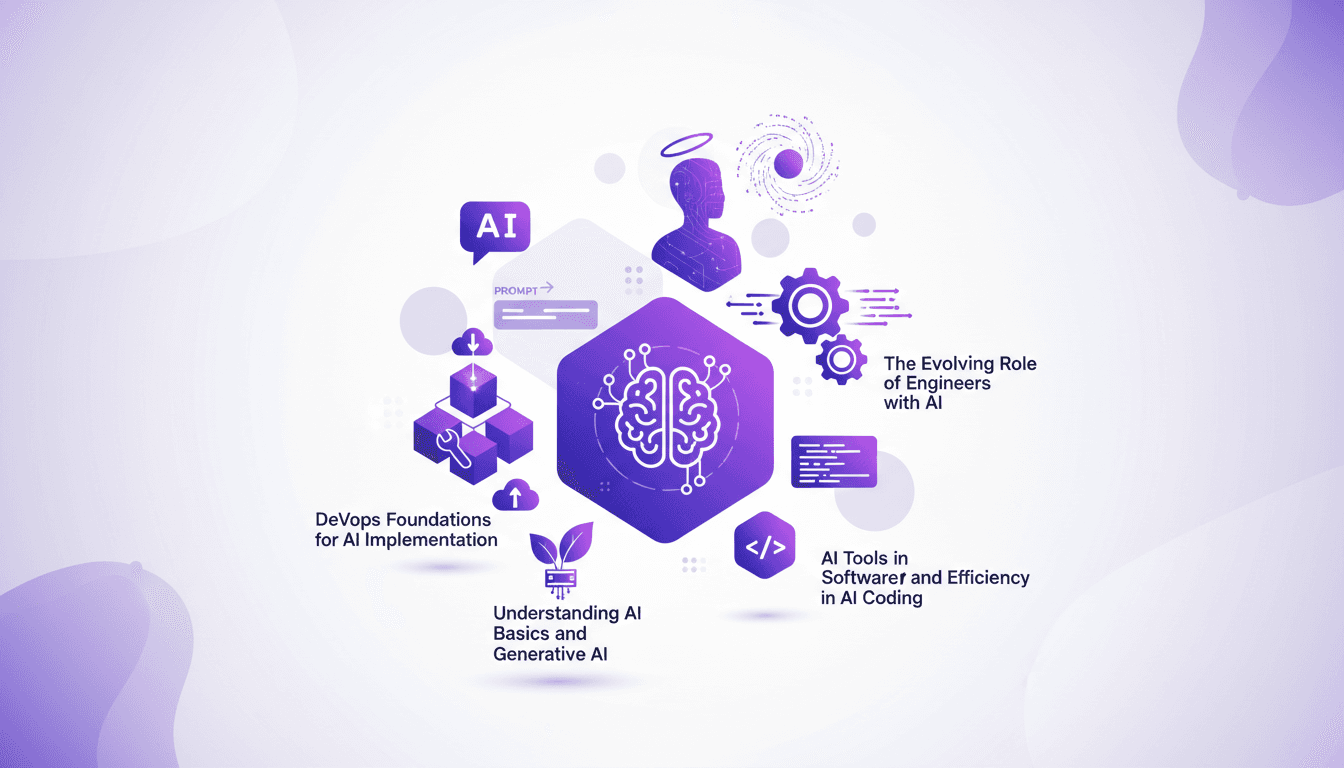

Comprendre l'IA Générative: Guide Pratique

Je me souviens encore de mes débuts dans le codage IA, pensant que l'IA générative n'était qu'un mot à la mode. Puis j'ai réalisé que c'était un vrai game changer, mais seulement si on sait l'exploiter correctement. D'abord, j'ai plongé dans ses fondamentaux – comprendre comment ces outils transforment notre manière de coder. Les ingénieurs passent à peine deux heures par jour sur du codage réel, le reste du temps, c'est l'orchestration. Et c'est là que l'IA entre en jeu, boostant la productivité et redéfinissant nos rôles. Je vous explique comment j'ai navigué ce paysage complexe, de l'impact environnemental des technologies IA à l'ingénierie des prompts et la gestion du contexte. Suivez-moi, explorons comment maîtriser l'IA générative pour révolutionner notre approche du développement logiciel.

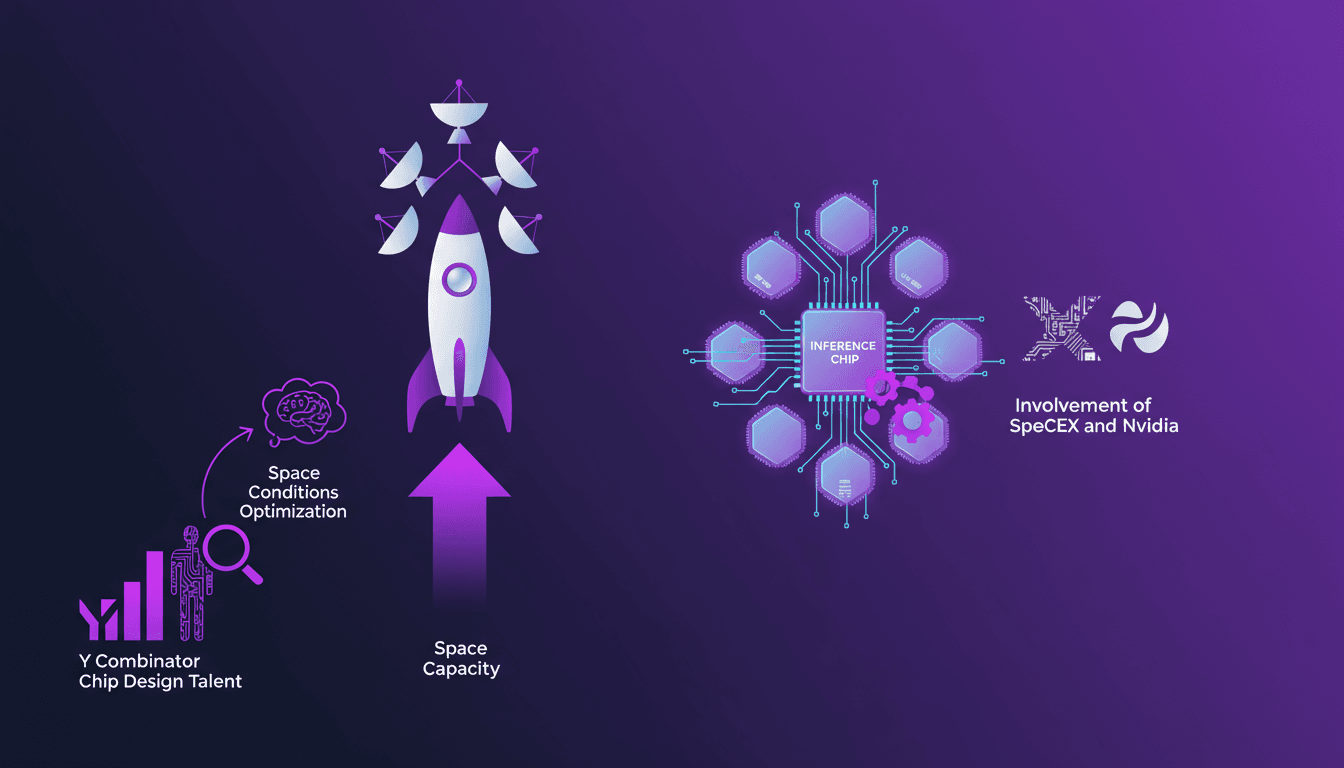

Fusées Réutilisables: Clé de l'Espace

Je me souviens encore du premier lancement de fusée réutilisable que j'ai vu. Un véritable bouleversement pour la capacité spatiale. Aujourd'hui, alors que nous repoussons les limites de la puissance de calcul dans l'espace, la demande pour des puces spécialisées explose. Avec des acteurs comme SpaceX et Stoke Space, les fusées réutilisables transforment notre approche de la capacité spatiale. Mais ce n'est pas juste une question d'y arriver—c'est ce qu'on fait une fois en orbite qui compte. C'est là que les puces d'inférence entrent en jeu, optimisées pour les conditions uniques de l'espace. Plongeons dans la manière dont nous optimisons l'électronique pour les réalités difficiles de l'espace.

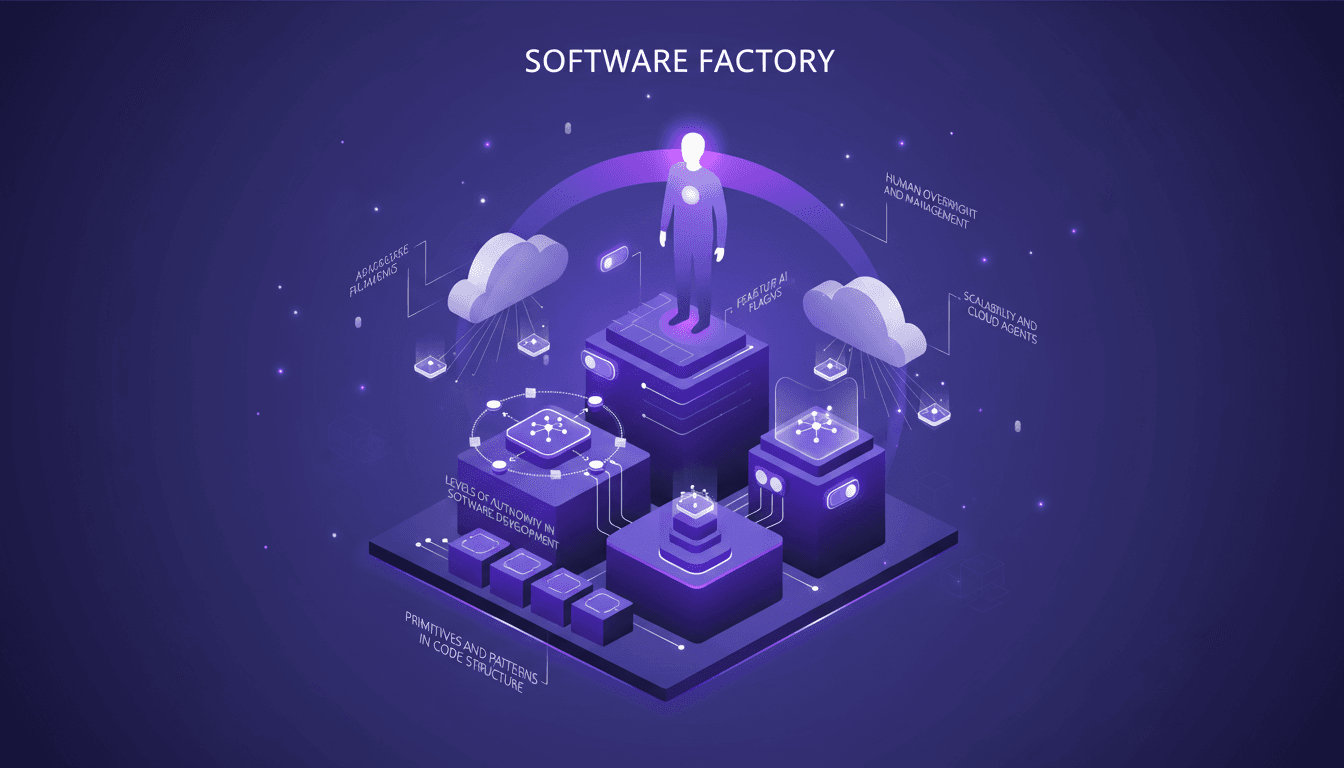

Construire une usine logicielle: étapes clés

Je me souviens de la première fois où j'ai pensé à construire une usine logicielle. Ça m'a semblé colossal, mais avec une approche en étapes, ça l'est devenu beaucoup moins. Dans cet article, je vous emmène à travers mon parcours pour mettre en place ma propre usine logicielle, en mettant l'accent sur l'efficacité et l'évolutivité. On va explorer les composants clés et les stratégies pour réussir, en passant par le rôle des agents AI et le feature flagging, jusqu'à la vérification et les tests dans des systèmes automatisés. Pour moi, une usine logicielle, c'est bien plus qu'une simple automatisation, c'est un changement de paradigme complet qui peut transformer la productivité. Alors, comment on pilote ça sans se brûler les ailes ? Je partage mes erreurs, mes succès, et surtout les leçons apprises.