IA Vocale : Défis et Opportunités Pratiques

J'ai les mains dans le cambouis du Voice AI depuis un moment, et croyez-moi, c'est une aventure folle. Vous pensez qu'on est proches du moment 'Her' ? Pas encore, mais on s'en rapproche. Entrons dans le vif du sujet chez Gradian et voyons pourquoi les modèles full duplex changent la donne — à condition de savoir les manier. Entre latence et imprévisibilité des appels d'outils, comprendre ces défis est crucial pour quiconque travaille dans ce domaine. On va aussi explorer le traitement sur appareil pour la confidentialité et l'efficacité des coûts, et ce que cela signifie pour la voix AI de demain.

J'ai les mains dans le cambouis du Voice AI depuis un moment, et croyez-moi, c'est une aventure folle. Vous pensez qu'on est proches du moment 'Her' ? Pas encore, mais on s'en rapproche. Avec Gradian AI, on repousse les limites de la technologie vocale, mais les défis du monde réel sont bien là : latence, imprévisibilité des appels d'outils... Il faut comprendre ces enjeux si vous voulez vraiment avancer dans ce domaine. Les modèles full duplex, parlons-en — ils changent la donne, mais attention à savoir les manipuler correctement. Je suis passé par là, je me suis fait avoir plus d'une fois. On va aussi explorer le traitement sur appareil pour la confidentialité et l'efficacité des coûts, et ce que cela signifie pour la voix AI de demain. Bref, plongeons ensemble dans cette conférence de Neil Zeghidour pour découvrir ce qui se passe vraiment dans les coulisses de Gradian AI.

Mission de Gradian et Potentiel de l'IA Vocale

Gradian, c'est un peu comme l'artisan du futur. Nous ne faisons pas que commenter, nous construisons. Notre mission? Débloquer le potentiel non réalisé de l'IA vocale. Imaginez un monde où l'interaction homme-machine est aussi naturelle qu'une conversation entre amis. C'est ça notre objectif. On s'appuie sur des modèles vocaux, du speech-to-text au speech-to-speech, en passant par la traduction. Mais attention, on n'est pas encore dans le film "Her". Les limitations actuelles, comme la latence et la prédictibilité des appels d'outils, nous rappellent que le moment 'Her' est encore un peu loin. Comprendre la technologie sous-jacente est crucial pour exploiter pleinement son potentiel.

"Man, avez-vous vu ce que Gradian fait avec la clonage vocal? C'est un peu fou."

Gradian a été créé il y a deux ans, soutenu par des philanthropes comme Eric Schmidt. Notre approche est ouverte, orientée vers la recherche, et nous développons des solutions comme Moshi et Pocket TTS. On veut être le fournisseur de modèles pour tous ceux qui construisent des agents vocaux.

Défis de l'IA Vocale : Latence et Impredictibilité des Appels d'Outils

En pratique, la latence est notre ennemi juré. Imaginez une latence de 200ms pour le text-to-speech et de 500ms à 4s pour les appels d'outils. Je ne sais pas pour vous, mais dans une conversation humaine, ces retards tuent l'expérience utilisateur. On doit trouver des stratégies pour réduire cette latence. Par exemple, utiliser des fillers pour garder la conversation fluide pendant l'attente des résultats. Mais attention, la prédictibilité des appels d'outils est encore un casse-tête. Cette imprévisibilité affecte la consistance du système.

Modèles Full Duplex vs Half Duplex : La Réalité

Alors, parlons un peu des modèles full duplex et half duplex. Les modèles full duplex permettent des interactions plus naturelles, avec des discours qui se chevauchent, un peu comme dans une vraie conversation. Mais les implémenter n'est pas sans limites. Par exemple, Moshi est le seul modèle full duplex actuellement disponible. Les modèles half duplex, par contre, ne peuvent écouter ou parler qu'à tour de rôle. Gradian utilise ces modèles pour créer des interactions plus humaines, mais il faut être prêt à gérer les compromis en termes de complexité et de ressources nécessaires.

- Les modèles full duplex sont plus naturels, mais complexes à implémenter.

- Moshi est un exemple de modèle full duplex.

- Les modèles half duplex sont plus simples mais moins naturels.

Modèles Speech-to-Speech et Traitement sur Appareil

Les modèles speech-to-speech sont une avancée pour réduire la latence, en combinant l'entrée et la sortie vocale en un seul modèle. Cela permet une réduction significative du temps de traitement. Mais ce qui change vraiment la donne, c'est le traitement sur appareil. Il s'agit d'une solution plus privée et rentable. Gradian a introduit Gradion Phonon, une solution text-to-speech sur appareil, qui promet d'être un tournant en termes de coût et de confidentialité.

L'Avenir de l'IA Vocale : Proche du Moment 'Her'?

Alors, où en est-on avec l'IA vocale et que nous réserve l'avenir? Pour atteindre le moment 'Her', il nous faut encore des avancées en termes de latence, de complexité et de compréhension contextuelle. L'amélioration continue et l'itération sont clés pour atteindre ces objectifs futurs. Les impacts sociétaux d'une IA vocale avancée pourraient être énormes, modifiant notre manière de travailler, de communiquer, et même d'apprendre. Mais il nous reste du chemin à parcourir, et chaque étape est cruciale.

- Amélioration continue et itération sont essentielles.

- Latence et compréhension contextuelle doivent être améliorées.

- Les impacts sociétaux pourront transformer nos habitudes.

Alors, où en sommes-nous avec l'IA vocale ? Pas encore au niveau du film 'Her', mais ça avance. Voici ce que je retiens :

- Latence et modèles : Comprendre la latence et le type de modèle que vous utilisez est crucial. Trop de latence peut ruiner l'expérience utilisateur, et choisir entre des modèles full duplex et half duplex peut changer la donne.

- Traitement sur l'appareil : Les modèles qui traitent sur l'appareil sont prometteurs, mais attention aux limitations en termes de puissance de calcul.

- Applications pratiques : Les modèles de parole à parole sont déjà en train de transformer des secteurs spécifiques, mais gardez un œil sur les imprévus dans l'appel d'outils. Regarder vers l'avenir, c'est continuer à tester et à comprendre ces complexités. Chaque itération nous rapproche du 'moment Her'. Regardez la vidéo complète ici pour entrer dans les détails, ça vaut le coup. Continuez à expérimenter et à partager vos trouvailles avec la communauté.

Questions Fréquentes

Thibault Le Balier

Co-fondateur & CTO

Issu de l'écosystème startup tech, Thibault a développé une expertise en architecture de solutions IA qu'il met aujourd'hui au service de grands groupes (Atos, BNP Paribas, beta.gouv). Il intervient sur deux axes : la maîtrise des déploiements IA (LLM locaux, sécurisation MCP) et l'optimisation des coûts d'inférence (offloading, compression, gestion des tokens).

Articles liés

Découvrez d'autres articles sur des sujets similaires

Routine quotidienne: Productivité maximale

Je me lève chaque matin avec la même routine, et ce n'est pas juste une habitude—c'est mon arme secrète. Pas de téléphone, pas de distractions, juste une concentration pure. Laissez-moi vous expliquer comment j'ai transformé cela en un business à 77K$/mois. Dans notre monde technologique effréné, les distractions sont infinies. Pourtant, maintenir une routine cohérente peut être votre plus grand atout pour atteindre la productivité et le succès financier. Je vais vous montrer comment je structure mes journées pour maximiser l'efficacité, éviter le FOMO et m'assurer que chaque journée commence avec un focus inébranlable.

Maximiser les tokens: Construire avec efficacité

Je suis retourné au code après des années de gestion, et c'était comme rentrer chez moi. Mais le paysage avait changé. Les outils avaient évolué, tout comme mon approche. Dans cette aventure, je vais vous montrer comment j'ai développé 'Gary's List' et comment j'ai affronté le défi du token maxing. On va plonger dans ma méthode plan-ge-review et voir l'impact des IA personnelles. C'est un guide pratique pour naviguer dans le développement logiciel moderne, avec une comparaison des outils et une réflexion sur l'éducation de qualité. Et oui, j'ai dépensé 200 dollars sur un compte Claude Code Max, mais le retour en valait la peine.

Recherche Agentique: Optimiser l'Ingénierie Contextuelle

Je me souviens quand je me suis lancé dans l'ingénierie contextuelle avec une approche de pipeline fixe. Limité, lourd, et franchement, un peu dépassé. Puis, j'ai découvert la recherche agentique—véritable changement de jeu. Dans cet article, je vous fais découvrir comment j'ai transformé mon approche. On passe d'une logique rigide à des outils dynamiques comme Lang Chain, qui boostent nos capacités de recherche. On parlera des défis, de la complexité des paramètres, et des outils hybrides qui changent la donne. Si vous êtes dans le domaine, vous savez que 80% de l'ingénierie contextuelle, c'est ça : la recherche agentique.

Introduction à Claude Design : Guide Rapide 10 Min

Je me suis plongé dans Claude Design par Anthropic, curieux de voir si cet outil pouvait vraiment tenir ses promesses en seulement 10 minutes. Spoiler : il l'a fait, et voilà comment. Ayant déjà navigué dans le paysage du design pendant des années, j'avais hâte de voir si Claude Design pouvait optimiser mon flux de travail et me faire gagner du temps sans compromettre la qualité. En seulement 10 minutes, j'ai exploré ses fonctionnalités, créé des projets avec de simples prompts, et optimisé mes designs avec des outils IA. Comparé à d'autres outils de design, Claude Design se distingue par sa simplicité et son efficacité. Je vous partage tout cela, étape par étape, comme si je discutais avec un collègue autour d'un café.

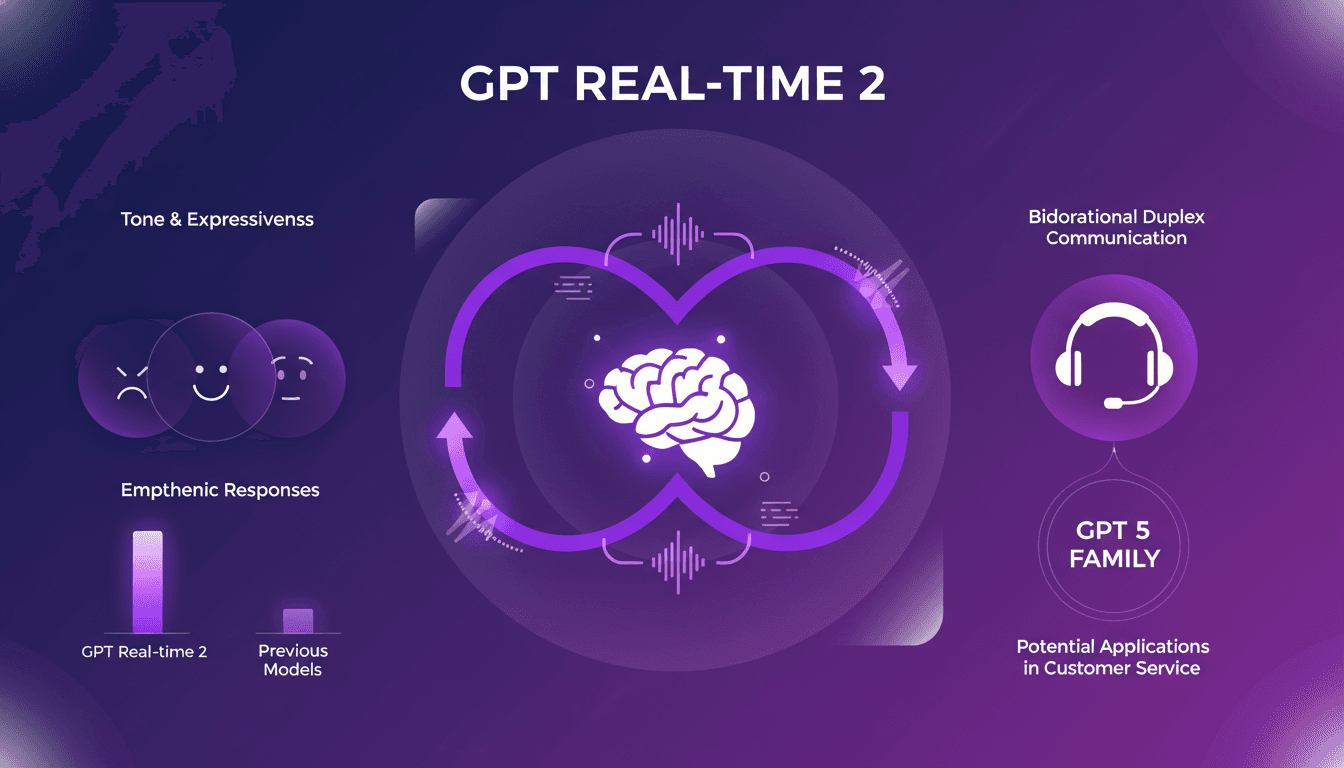

GPT Realtime-2 : Révolution pour les agents vocaux

J'ai mis les mains sur GPT Realtime-2 et croyez-moi, c'est un vrai game changer pour les agents vocaux. Quand je l'ai intégré pour la première fois, la fluidité et la réactivité m'ont bluffé. Dans ma pratique quotidienne avec les modèles d'IA, je combats les problèmes de latence et de manque d'expressivité. GPT Realtime-2 aborde ces défis de front, et ce n'est pas juste du bruit marketing. Il y a une amélioration notable dans la communication bidirectionnelle et l'expressivité tonale des agents. Les réponses sont plus empathiques, les conversations plus naturelles. Comparé aux modèles précédents, c'est une avancée significative. En service client, les applications potentielles sont énormes. Intégré dans la famille GPT 5, ce modèle redéfinit les limites de ce que les agents vocaux peuvent accomplir.