LangChain et React: Messages d'agents en streaming

Je me souviens de la première fois où j'ai tenté de streamer des messages d'agents dans une application React. C'était un vrai bazar... jusqu'à ce que je découvre LangChain et Langraph. Je vais vous expliquer comment j'ai configuré tout ça pour créer une interaction fluide entre le frontend et les agents IA. Dans ce tutoriel, je vous montre comment connecter LangChain et React en utilisant Langraph Dev Server. On plongera dans le streaming de messages d'agents, avec des outils comme la météo et la recherche web, et on verra comment les rendre efficacement dans l'interface utilisateur. Vous verrez comment j'intègre ces messages grâce au hook React Ustream, et comment je gère différents types de messages dans l'UI. Prêt à transformer vos interactions IA ? Allons-y.

Je me souviens encore de la première fois où j'ai essayé de streamer des messages d'agents dans une app React. C'était le chaos total — franchement, une galère jusqu'à ce que je découvre LangChain et Langraph. Laissez-moi vous expliquer comment j'ai tout configuré pour orchestrer une interaction sans accroc entre le frontend et les agents IA. Dans ce tutoriel, je vais vous montrer comment connecter LangChain et React en utilisant Langraph Dev Server. On va explorer le streaming de messages d'agents, en utilisant des outils comme la météo (10,8° Celsius, selon notre outil météo, ça vous dit quelque chose ?), et la recherche web, et on verra comment les rendre efficacement dans l'UI. Je vais aussi vous montrer comment j'ai intégré ces messages dans React avec le hook Ustream, et comment je gère les différents types de messages dans l'interface utilisateur. Prêt à révolutionner vos interactions IA ? C'est parti !

Mise en Place du Serveur de Développement Langraph

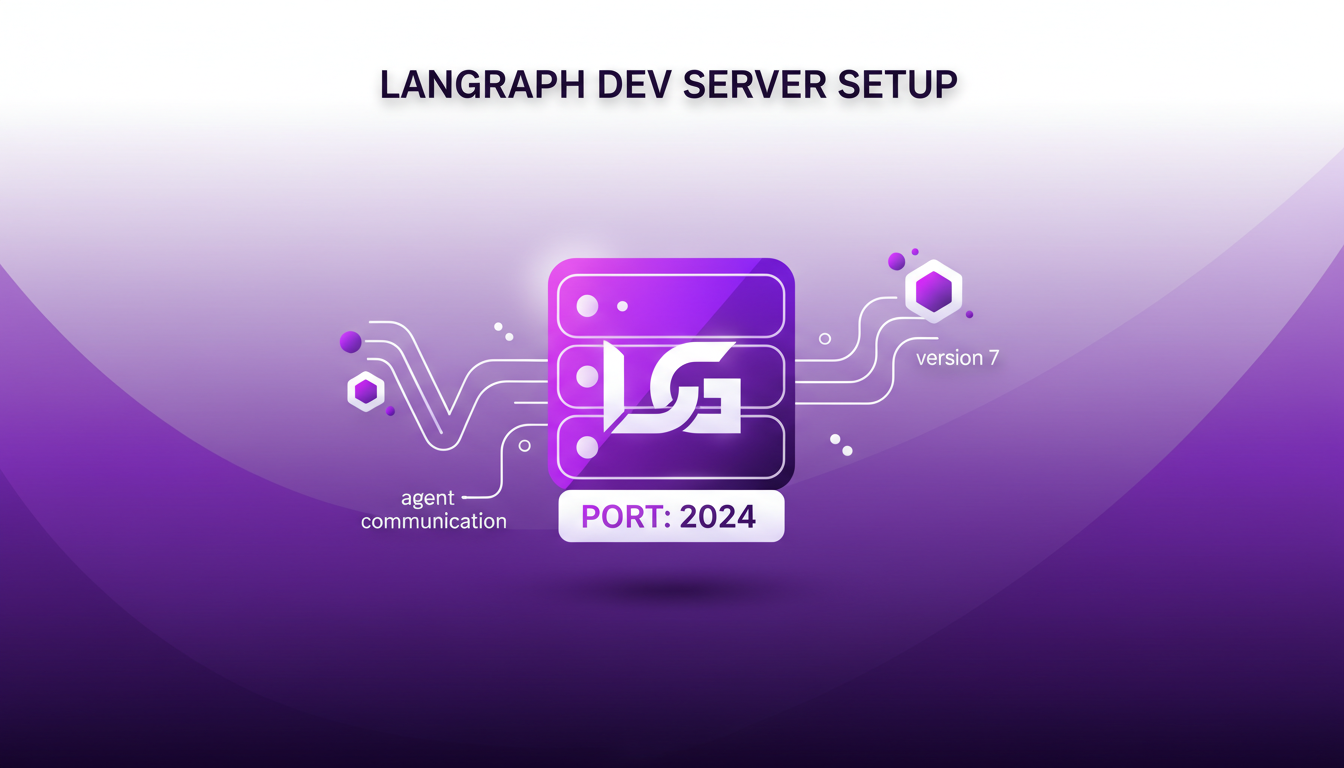

Déjà, j'ai installé le Langraph Dev Server et je l'ai configuré sur le port par défaut 2024. Cette étape était assez simple mais cruciale, car une configuration incorrecte peut rapidement devenir un cauchemar. Pour l'hébergement de l'application, j'ai utilisé V version 7, garantissant une compatibilité optimale.

Ensuite, j'ai connecté le serveur pour gérer efficacement la communication des agents. Cela implique de créer un fichier de configuration qui détecte tous les agents dans les sous-répertoires de votre application. Une simple commande npm create langraph set fait le travail, et voilà, votre serveur est prêt à héberger vos agents. Simple, non ?

- Utilisation de V version 7 pour la compatibilité

- Configuration sur le port 2024 par défaut

- Création d'un fichier de configuration pour détecter les agents

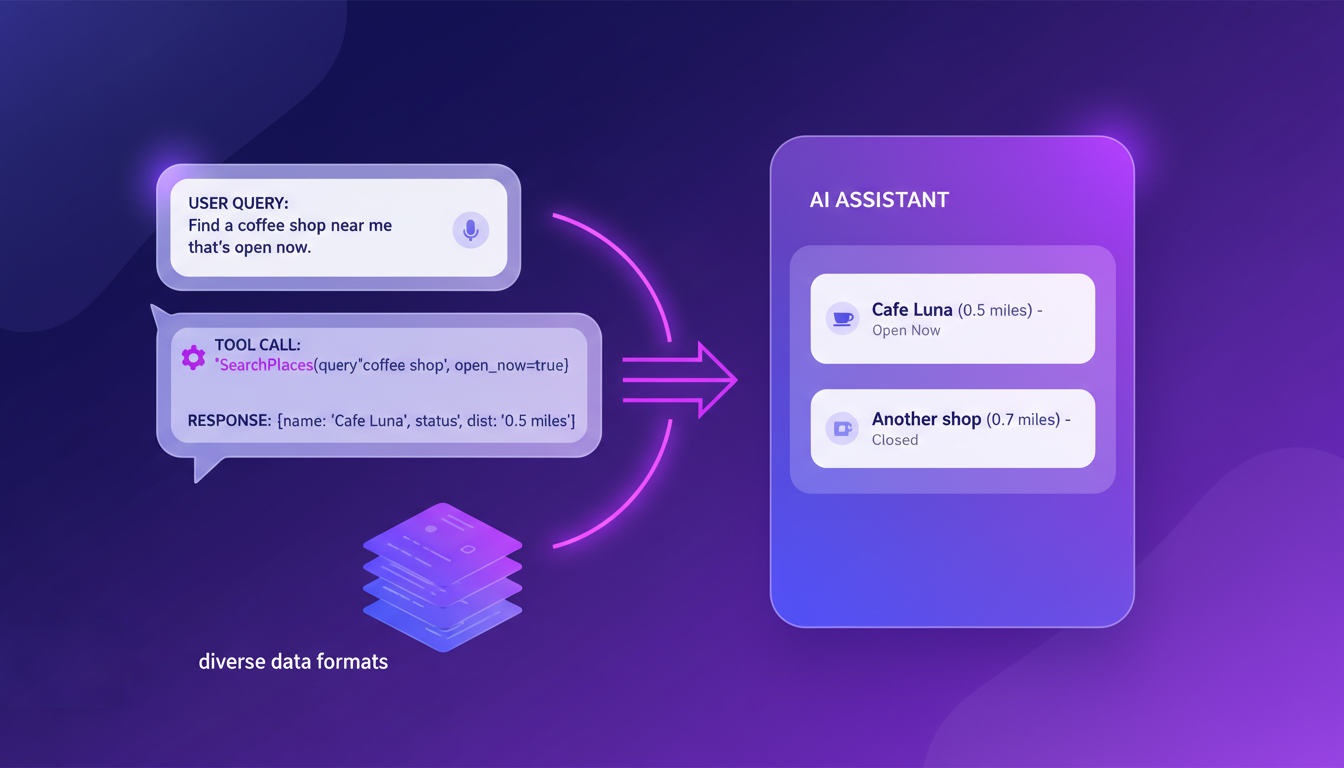

Intégration d'Outils dans les Agents

Ensuite, j'ai implémenté des outils comme le weather tool et le web search tool pour étendre les fonctionnalités des agents. En utilisant GPT4 mini, j'ai veillé à ce que les outils fournissent des réponses précises et pertinentes. Mais attention, intégrer trop d'outils peut ralentir les temps de réponse. J'ai configuré l'outil météo pour afficher des données précises comme 10.8° Celsius—croyez-moi, ça fait toute la différence.

Ces outils ne sont pas seulement des gadgets; ils ajoutent une réelle valeur en permettant à vos agents de fournir des informations actualisées et pertinentes. Cependant, il faut veiller à ce que l'intégration soit fluide pour ne pas surcharger vos agents.

- Intégration d'outils de recherche et météo

- Utilisation de GPT4 mini pour la précision

- Affichage précis des données météorologiques

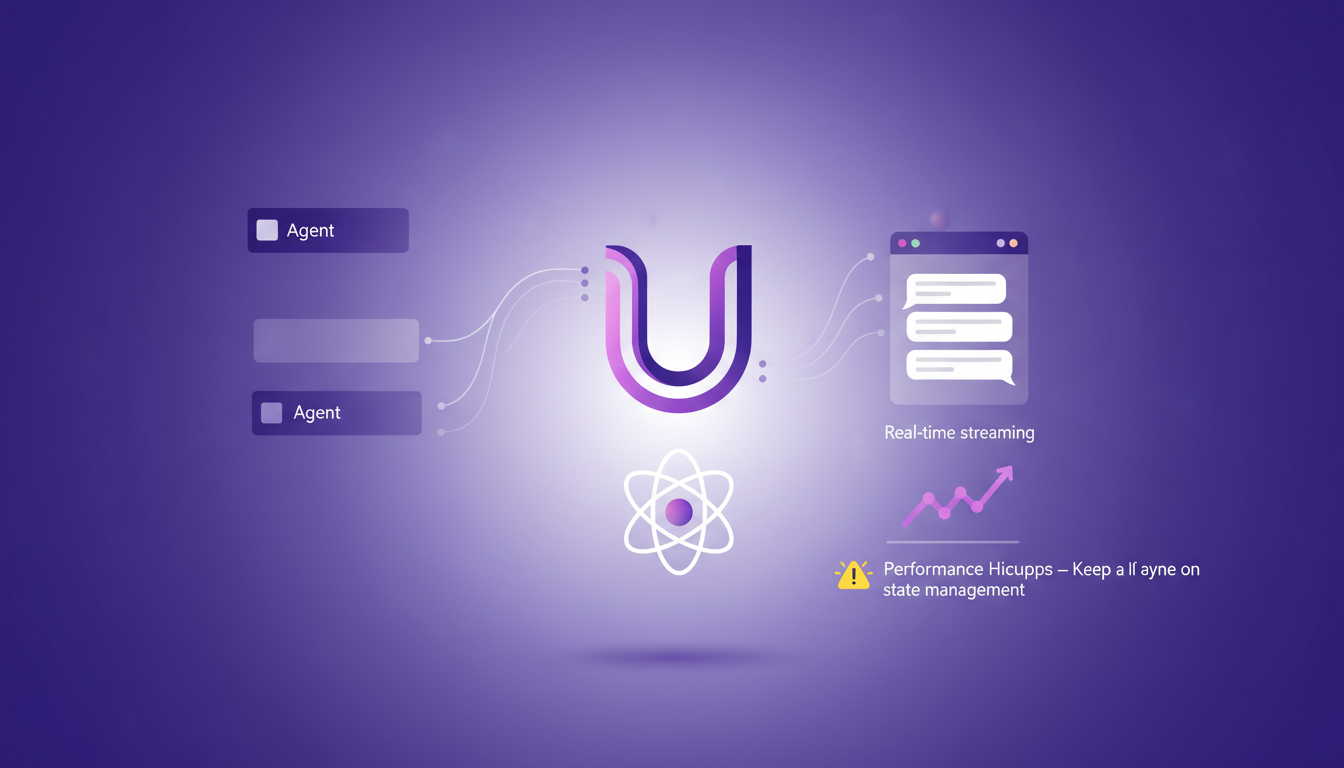

Utilisation du Ustream Hook dans React

Ensuite, j'ai intégré le Ustream Hook pour gérer les interactions des agents dans React. Ce hook a permis le streaming en temps réel des messages de l'agent vers l'interface utilisateur (UI). C'était un véritable changement de jeu, même si j'ai eu quelques soucis de performance au début. Assurez-vous de bien gérer votre état pour éviter des ralentissements inattendus.

Les messages sont transmis directement à l'UI, rendant l'application plus réactive et fluide. Mais attention, une mauvaise gestion de l'état peut vraiment nuire à la performance globale de l'application.

- Intégration du Ustream Hook pour le streaming en temps réel

- Surveillance des performances lors de l'intégration

- Amélioration de la réactivité de l'application

Rendu des Messages et Appels d'Outils dans l'UI

Enfin, je me suis concentré sur le rendu clair des différents types de messages dans l'UI. Les appels d'outils et les réponses étaient affichés de manière transparente, améliorant l'expérience utilisateur globale. C'est ici que j'ai rencontré quelques difficultés, notamment dans la gestion de formats de données variés. Il est crucial de s'assurer que votre UI peut gérer ces variations.

Une efficacité de rendu optimale impacte directement la satisfaction utilisateur, alors n'oubliez pas d'optimiser vos composants. J'ai fini par utiliser des cartes d'appel d'outils pour afficher les détails, ce qui a vraiment aidé à structurer les informations de manière logique et visuelle.

- Rendu efficace des messages variés

- Utilisation de cartes pour structurer les appels d'outils

- Optimisation des composants pour une meilleure expérience utilisateur

En intégrant LangChain et React via Langraph, j'ai mis au point un système dynamique pour le streaming des messages des agents. C'est vraiment un game changer : ça a amélioré la qualité des interactions et optimisé l'utilisation des outils et le rendu de l'interface. Voici les points clés :

- Intégration fluide : Avec Langraph Dev Server, je gère la communication des agents sans accroc.

- Utilisation des outils : En intégrant des outils spécifiques dans les agents, j'ai obtenu des fonctionnalités ciblées, par exemple, l'affichage précis de la température de 10,8°C.

- React Ustream Hook : Il a boosté l'interaction agent/UI en temps réel, sans ralentir le système.

En regardant vers l'avenir, je suis convaincu que cette approche va réellement transformer nos projets. Mais attention, il faut bien comprendre les limites, comme la version de V utilisée (version 7) pour bien gérer l'application.

Je vous invite à essayer cette configuration dans vos propres projets et à partager vos expériences. Et pour une compréhension plus approfondie, regardez la vidéo complète : Streaming Typed Agent Messages in LangChain and React. Construisons de meilleurs systèmes ensemble !

Questions Fréquentes

Thibault Le Balier

Co-fondateur & CTO

Issu de l'écosystème startup tech, Thibault a développé une expertise en architecture de solutions IA qu'il met aujourd'hui au service de grands groupes (Atos, BNP Paribas, beta.gouv). Il intervient sur deux axes : la maîtrise des déploiements IA (LLM locaux, sécurisation MCP) et l'optimisation des coûts d'inférence (offloading, compression, gestion des tokens).

Articles liés

Découvrez d'autres articles sur des sujets similaires

Sommet du Code IA 2025 : Avancées et Nouveautés

Je suis entré au Sommet du Code IA 2025 à New York, et l'énergie était palpable. Ce n'était pas juste un autre événement tech; c'était un rassemblement des esprits qui façonnent l'avenir du codage IA. Avec l'expansion du rôle de l'IA dans les entreprises, comprendre les derniers outils et collaborations est crucial. DeepMind se démarque avec ses nouveaux lancements comme Gemini 3 et Nano Banana Pro. Ces innovations ne sont pas seulement des gadgets; elles transforment la façon dont nous abordons le développement logiciel. J'ai expérimenté ces outils, et je peux vous dire qu'ils redéfinissent la manière dont nous orchestrons nos projets. C'est une période passionnante pour l'IA, et ce sommet est le point de convergence de ces bouleversements.

Utilisation de ChatGPT en équipe: Efficacité

Je me souviens de la première fois où j'ai intégré ChatGPT dans notre réunion d'équipe. On était en panique totale, à essayer de résoudre un problème en temps réel, et l'horloge tournait. C'est à ce moment-là que ChatGPT est intervenu, transformant notre manière de communiquer et de prendre des décisions. Dans cet article, je partage comment j'ai intégré ChatGPT dans nos opérations quotidiennes, particulièrement dans des situations collaboratives et sous haute pression. Vous découvrirez comment cet outil a modifié notre dynamique d'équipe et notre approche de la résolution de problèmes en temps réel.

Adoption rapide de Cloud Code : Pourquoi ça change tout

J'ai commencé à utiliser Cloud Code en 2026, et franchement, ça a bouleversé ma manière de coder. Au début, j'étais sceptique—encore un outil de plus qui promet de révolutionner le développement. Mais ensuite, j'ai vu l'interface au niveau commande en action, et j'ai compris. Cloud Code devient rapidement l'outil incontournable pour les développeurs. Ce n'est pas juste une question d'écrire du code, c'est une véritable transformation de notre approche du développement. Dans cet article, je vous explique pourquoi tant de gens effectuent le switch et comment vous pouvez exploiter cette puissance. On va aborder l'adoption rapide de Cloud Code, son interface unique, et comment l'écosystème s'élargit. Ne manquez pas ça si vous voulez garder une longueur d'avance!

DSPI : Révolutionner l'Ingénierie de Prompt

J'ai plongé dans DSPI et croyez-moi, ce n'est pas juste un autre framework — c'est un véritable changement de jeu pour l'ingénierie de prompt. Au début, j'étais sceptique, mais en voyant son approche modulaire en action, j'ai réalisé le potentiel d'efficacité et de flexibilité. Avec DSPI, on simplifie les tâches complexes grâce à un cadre déclaratif, ce qui est une avancée majeure. Et cette modularité ? Elle permet une gestion optimisée des entrées, que ce soit des textes ou des images. Imaginez, pour une tâche de classification, seulement trois images suffisent pour obtenir des résultats précis. C'est cette capacité à gérer des entrées multimodales qui distingue DSPI des autres frameworks. Que ce soit pour le développement de logiciels modulaires ou l'optimisation des métriques, DSPI ne se contente pas de faire le travail, il le réinvente.

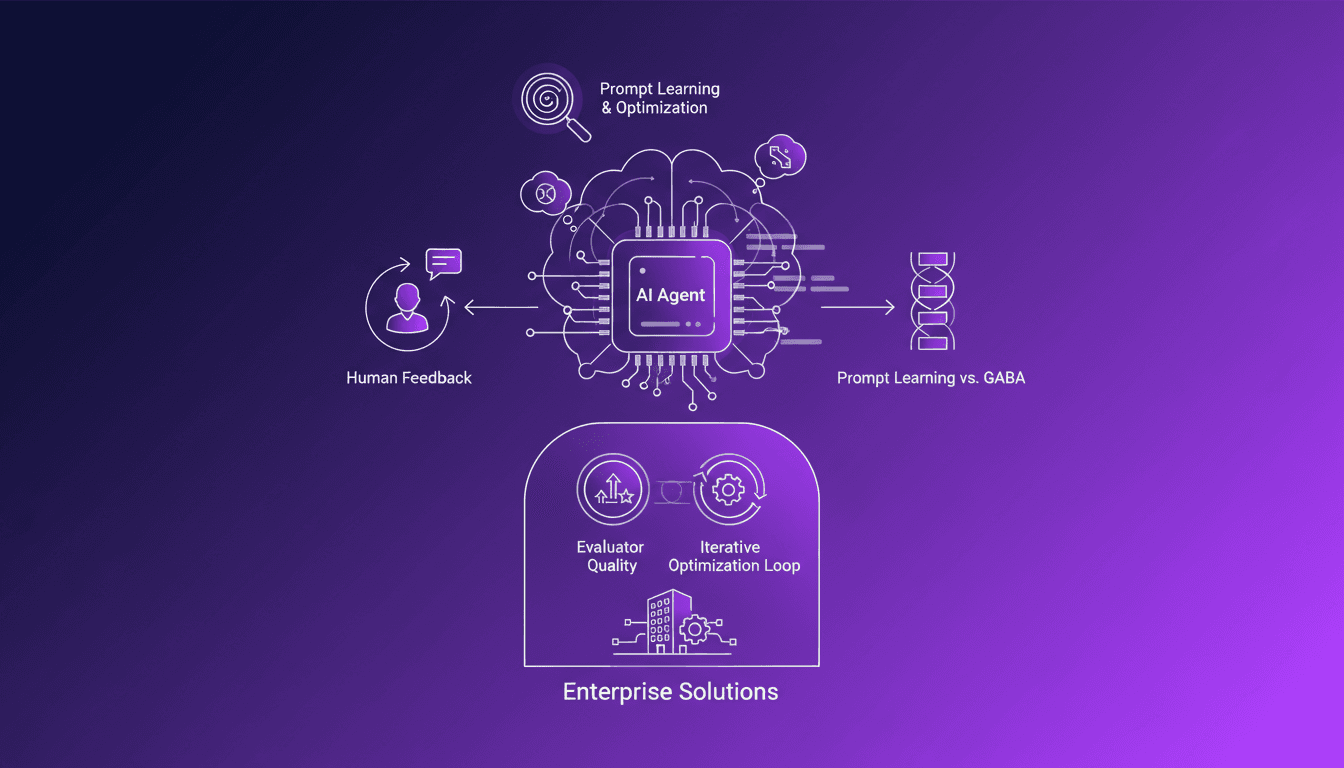

Optimiser les Boucles d'Apprentissage de Prompts

J'ai passé des mois à perfectionner comment mes agents IA apprennent. Ce n'est pas juste une question de balancer des prompts et de croiser les doigts. Non, il s'agit de construire une boucle d'apprentissage robuste qui évolue à chaque itération. Les défis dans le développement d'agents IA sont nombreux, et optimiser ces prompts est là où le vrai travail commence. Dans cette vidéo, je partage les techniques et solutions que j'ai découvertes, du rôle crucial du feedback humain à l'importance de la qualité de l'évaluateur. C'est un voyage dans le monde complexe de l'optimisation des prompts, et je vous montre comment j'ai craqué le code.