Optimiser la Mémoire des Agents IA: Techniques Avancées

J'ai passé des heures dans les tranchées avec des agents IA, à jongler avec des schémas de mémoire qui peuvent littéralement faire ou défaire votre setup. D'abord, plongeons dans ce que signifient vraiment les schémas de mémoire d'agent et pourquoi ils sont cruciaux. Dans les systèmes IA avancés, gérer la mémoire et le contexte ne se résume pas à stocker des données—c'est optimiser leur utilisation. Cet article explore les techniques et défis de la gestion du contexte, en s'appuyant sur des applications concrètes. On parle de différences entre mémoire à court et long terme, des écueils possibles, et des techniques pour une gestion efficace du contexte. Vous verrez, deux membres de notre équipe d'architecture ont vraiment creusé la question, et leurs insights pourraient changer la donne pour votre prochain projet.

Je me suis fait avoir plus d'une fois en jonglant avec des schémas de mémoire d'agents IA. Ces petites bêtes peuvent vraiment faire ou défaire votre configuration si vous n'y faites pas attention. Alors, qu'est-ce qu'un schéma de mémoire d'agent et pourquoi est-ce si crucial? Dans les systèmes IA avancés, la gestion de la mémoire et du contexte ne consiste pas seulement à stocker des données, mais à optimiser leur utilisation. Dans cet article, je plonge dans les techniques et les défis liés à la gestion du contexte, en m'appuyant sur des applications du monde réel. On va parler des différences entre mémoire à court et à long terme, des modes d'échec en gestion de contexte, et des techniques pour une gestion efficace. Avec deux membres de notre équipe d'architecture, on a vraiment creusé la question. Par exemple, après trois tours, on conserve les informations pour le résumé, mais attention, au quatrième, le contexte se compacte. Ces insights pourraient transformer votre prochaine configuration IA.

Comprendre les schémas de mémoire des agents

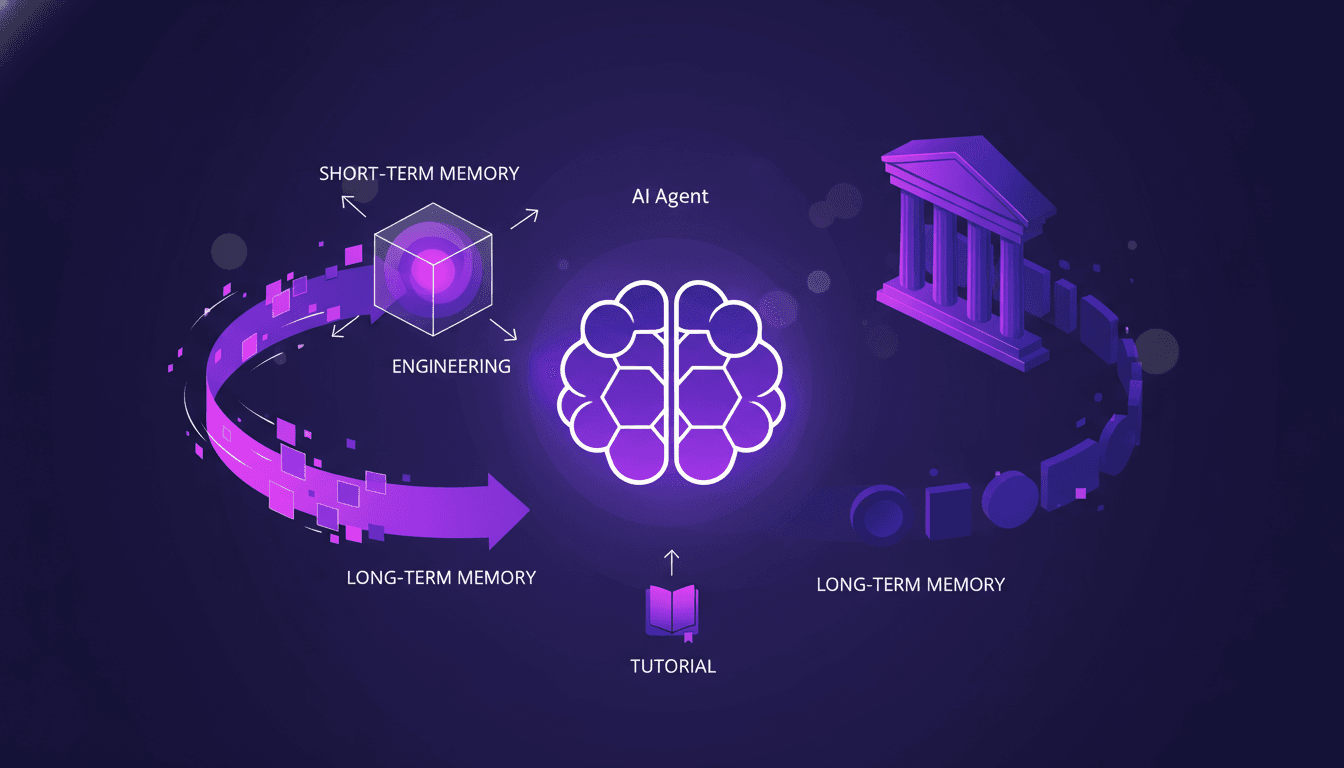

Dans le monde des systèmes d'IA, les schémas de mémoire des agents jouent un rôle crucial. C'est un sujet sur lequel je me suis penché à plusieurs reprises, et chaque fois, je découvre quelque chose de nouveau. La mémoire à court terme gère les demandes immédiates, tandis que la mémoire à long terme — comprenant des éléments sémantiques, épisodiques et procéduraux — construit une base plus profonde. Mais attention, gérer ces types de mémoire n'est pas un jeu d'enfant.

Premièrement, il y a la mémoire à court terme, qui assure des interactions fluides et cohérentes sur le moment. Par contre, la mémoire à long terme fournit continuité et personnalisation au fil des sessions. Et c'est là que les choses se compliquent : comment équilibrer les deux ? J'ai souvent constaté que lorsque l'on surcharge la mémoire à court terme, les performances chutent. La clé est dans l'ingénierie contextuelle, un domaine que je considère comme une combinaison d'art et de science.

Ingénierie contextuelle : L'art et la science

L'ingénierie contextuelle est un art autant qu'une science. On doit jongler avec le jugement et les méthodes concrètes. J'utilise souvent des techniques comme reshape and fit et isolate and route pour optimiser le contexte. Par exemple, lors d'un projet récent où les agents avaient tendance à "oublier", j'ai appliqué du trimming et de la compaction pour alléger la charge cognitive. Résultat, une réduction significative de la consommation de tokens.

Il est vital de comprendre que l'ingénierie contextuelle ne se limite pas à une seule technique. C'est un écosystème d'optimisation contextuelle. J'ai appris que combiner différentes approches selon le budget de contexte est souvent la stratégie gagnante.

- Reshape and fit : Ajustement du contexte pour une meilleure performance.

- Isolate and route : Répartition des contextes pour cibler les agents appropriés.

- Compaction et trimming : Réduction des données inutiles pour optimiser le stockage.

Techniques pour une gestion efficace du contexte

Je vais vous parler de quelques techniques que j'utilise quotidiennement, comme extract and retrieve et memory injection. Ces méthodes sont essentielles pour gérer efficacement le contexte. Par exemple, l'extraction et la récupération de la mémoire permettent à l'agent de se rappeler d'informations clés au bon moment, sans surcharger la mémoire à court terme.

Mais attention, il y a des compromis à faire. Parfois, il est plus rapide de compacter l'information que de la résumer, surtout si vous n'avez que trois tours récents à garder pour la summarization.

- Extract and retrieve : Pour des récupérations efficaces.

- Memory injection : Pour des réponses personnalisées.

- Summarization : Impacte directement l'efficacité.

Naviguer dans les modes d'échec de la gestion du contexte

Les modes d'échec comme le context burst, le conflit, l'empoisonnement et le bruit peuvent ruiner votre projet. J'ai eu des expériences d'échec retentissantes, mais elles m'ont appris à anticiper et à mitiger ces problèmes. Par exemple, le fait de créer des context profiles m'a permis de mieux gérer les agents selon leurs besoins spécifiques.

Un conseil : ne prenez pas ces échecs à la légère. Établir des profils de contexte peut vraiment changer la donne, en vous permettant de catégoriser vos agents en fonction de leurs besoins en contexte.

"J'ai compris que la détection précoce des context burst est cruciale pour éviter le chaos."

Bonnes pratiques et orientations futures

En fin de compte, la gestion du contexte est une danse délicate entre efficacité et complexité. Je recommande fortement d'adopter les meilleures pratiques que j'ai évoquées. De plus, les tendances émergentes montrent que l'équilibre entre les composants dynamiques et statiques du contexte devient de plus en plus important.

Je vous encourage à expérimenter avec de nouveaux outils et techniques. L'avenir est prometteur, surtout avec des innovations comme le Gemini 3 Flash OCR qui peuvent vraiment améliorer votre efficacité quotidienne.

- Expérimentez avec divers outils pour trouver ce qui fonctionne le mieux.

- Suivez les tendances pour rester à jour.

- Équilibrez l'efficacité et la complexité pour des résultats optimaux.

Gérer la mémoire des agents AI, c'est un peu comme jongler avec des balles de feu – complexe mais tellement gratifiant quand on maîtrise le sujet. Voici ce que j'ai appris en travaillant sur le terrain :

- Maîtriser l'ingénierie du contexte, c'est le sésame pour booster les performances de votre AI. Les trois derniers tours, c'est là que je concentre ma récapitulation.

- Différencier les mémoires à court et long terme est crucial. Après quatre tours, je compacte le contexte pour éviter de perdre en efficacité.

- Prendre en compte les modes d'échec vous évite des mauvaises surprises. Deux membres de mon équipe s'assurent de tout ça dans notre architecture de solution.

En jouant avec ces techniques, on peut vraiment faire avancer le management du contexte AI. N'oubliez pas, chaque expérimentation compte – partagez vos expériences ! Pour une vue plus approfondie, je vous invite à regarder la vidéo 'Build Hour: Agent Memory Patterns'. Vous verrez que c'est un vrai game changer, mais attention aux limites. Lien vers la vidéo.

Questions Fréquentes

Thibault Le Balier

Co-fondateur & CTO

Issu de l'écosystème startup tech, Thibault a développé une expertise en architecture de solutions IA qu'il met aujourd'hui au service de grands groupes (Atos, BNP Paribas, beta.gouv). Il intervient sur deux axes : la maîtrise des déploiements IA (LLM locaux, sécurisation MCP) et l'optimisation des coûts d'inférence (offloading, compression, gestion des tokens).

Articles liés

Découvrez d'autres articles sur des sujets similaires

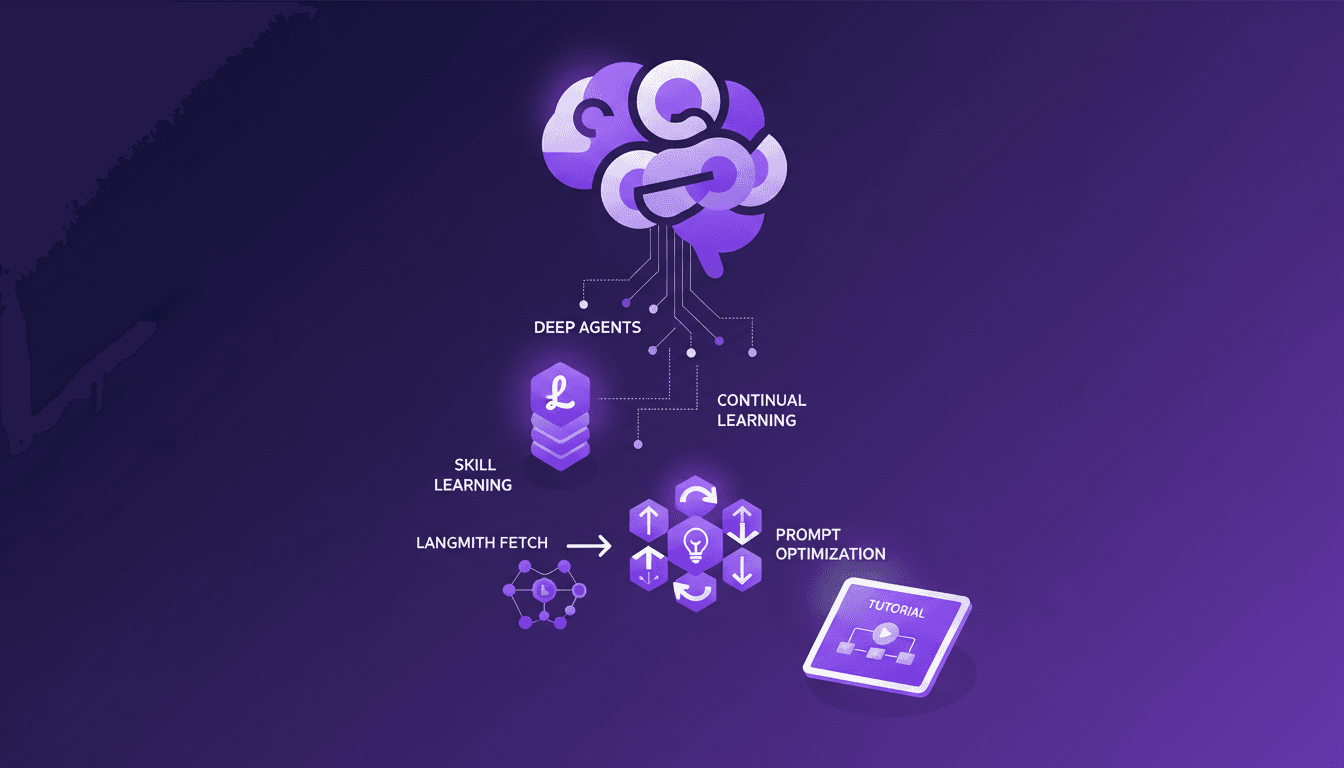

Apprentissage Continu avec Deep Agents: Mon Workflow

J'ai plongé dans l'apprentissage continu avec des deep agents, et franchement, c'est un vrai game changer pour la création de compétences. Mais attention, ça n'est pas sans ses particularités. J'ai exploré le processus en utilisant des mises à jour de poids, des réflexions sur les trajectoires et le Deep Agent CLI. Grâce à ces outils, j'ai pu optimiser l'apprentissage des compétences de manière efficace. Dans cet article, je partage comment j'ai orchestré l'utilisation des deep agents pour créer des compétences persistantes, tout en évitant les erreurs courantes. Si vous êtes prêts à vous lancer dans l'apprentissage continu, suivez mon workflow détaillé pour ne pas vous faire avoir comme moi au début.

Apprentissage Continu avec Deepagents: Guide Complet

Imaginez une IA qui apprend comme un humain, s'améliorant continuellement. Bienvenue dans le monde des Deepagents. Dans le domaine de l'IA en constante évolution, l'apprentissage continu est une révolution. Deepagents exploitent ce potentiel en optimisant les compétences grâce à des techniques avancées. Découvrez comment ces agents intelligents utilisent les mises à jour de poids pour s'adapter et se perfectionner. Ils réfléchissent à leurs trajectoires et créent de nouvelles compétences, toujours en quête d'optimisation. Plongez-vous dans l'univers du Langmith Fetch Utility et du Deep Agent CLI. Ce guide complet vous mènera à maîtriser ces outils puissants pour une expérience d'apprentissage inégalée.

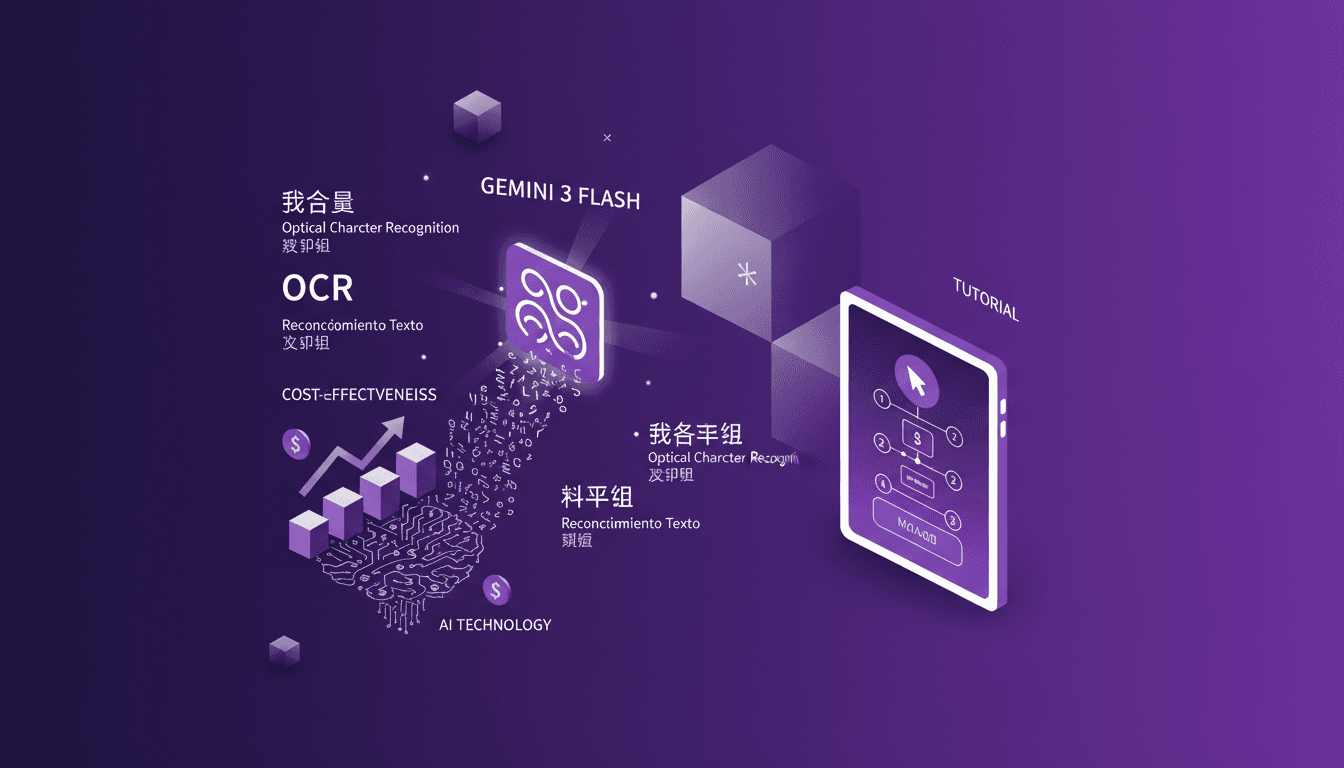

Optimisez vos coûts avec Gemini 3 Flash OCR

J'ai plongé dans les tâches OCR depuis des années, et quand Gemini 3 Flash est arrivé, j'ai su que je devais tester ses promesses de réduction de coûts et de performances. Imaginez un modèle qui coûte quatre fois moins cher que le Gemini 3 Pro, à seulement 0,50 $ par million de tokens en entrée et 3 $ pour ceux en sortie. Je vous explique comment ce modèle se compare aux gros calibres et pourquoi c'est un véritable atout pour l'OCR multilingue. De la rentabilité aux capacités multilingues, en passant par les benchmarks techniques, je vous livre mes découvertes pratiques. Ne vous laissez pas avoir par le battage, venez découvrir comment Gemini 3 Flash transforme le jeu pour les tâches OCR.

Gemini 3 Flash : Optimisez votre flux de travail

Je pataugeais dans les problèmes d'utilisation de jetons quand j'ai mis la main sur le Gemini 3 Flash. Franchement, c'était comme passer du vélo à la voiture de sport. Je l'ai intégré dans mon flux de travail quotidien, et il est devenu mon outil incontournable. Avec ses capacités multimodales et sa compréhension spatiale améliorée, il redéfinit l'efficacité. Mais attention, il y a des limites. Au-delà de 100K tokens, ça devient compliqué. Je vous explique comment j'ai optimisé mes opérations et les erreurs à éviter.

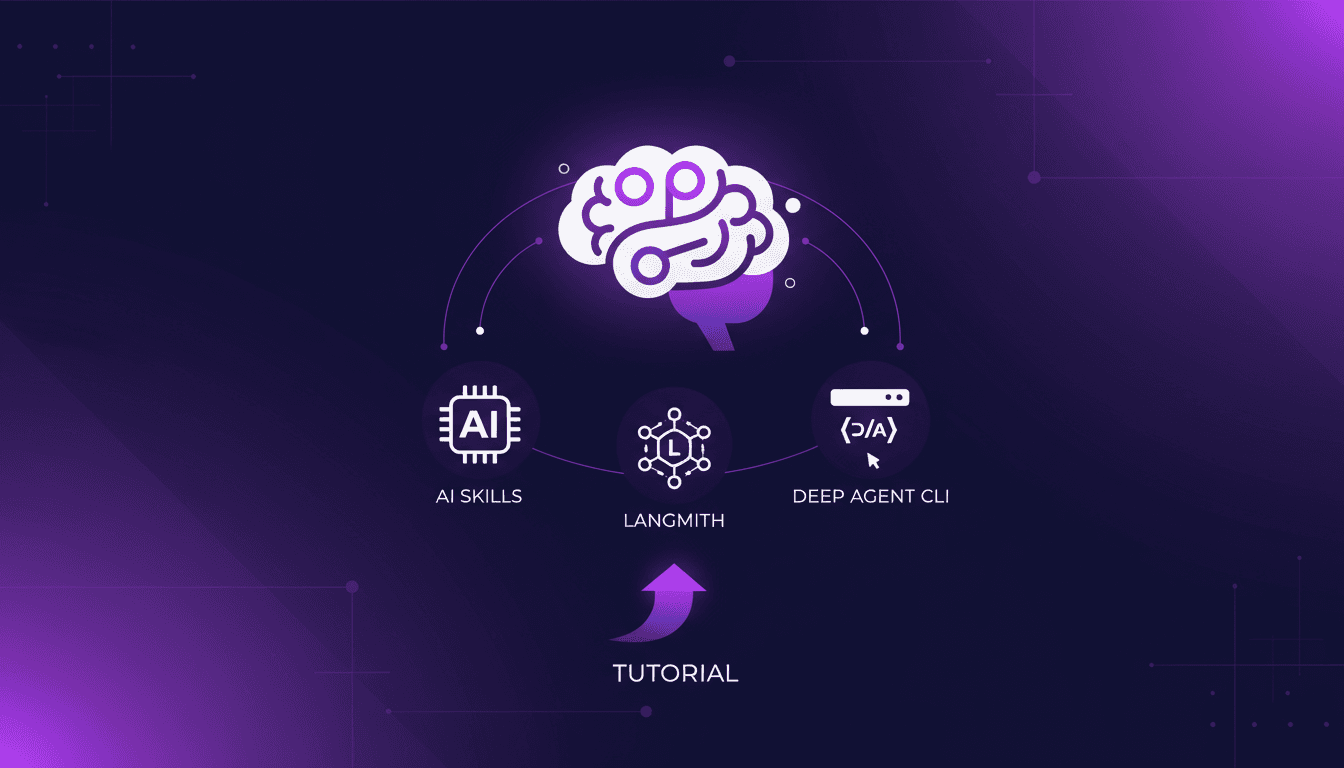

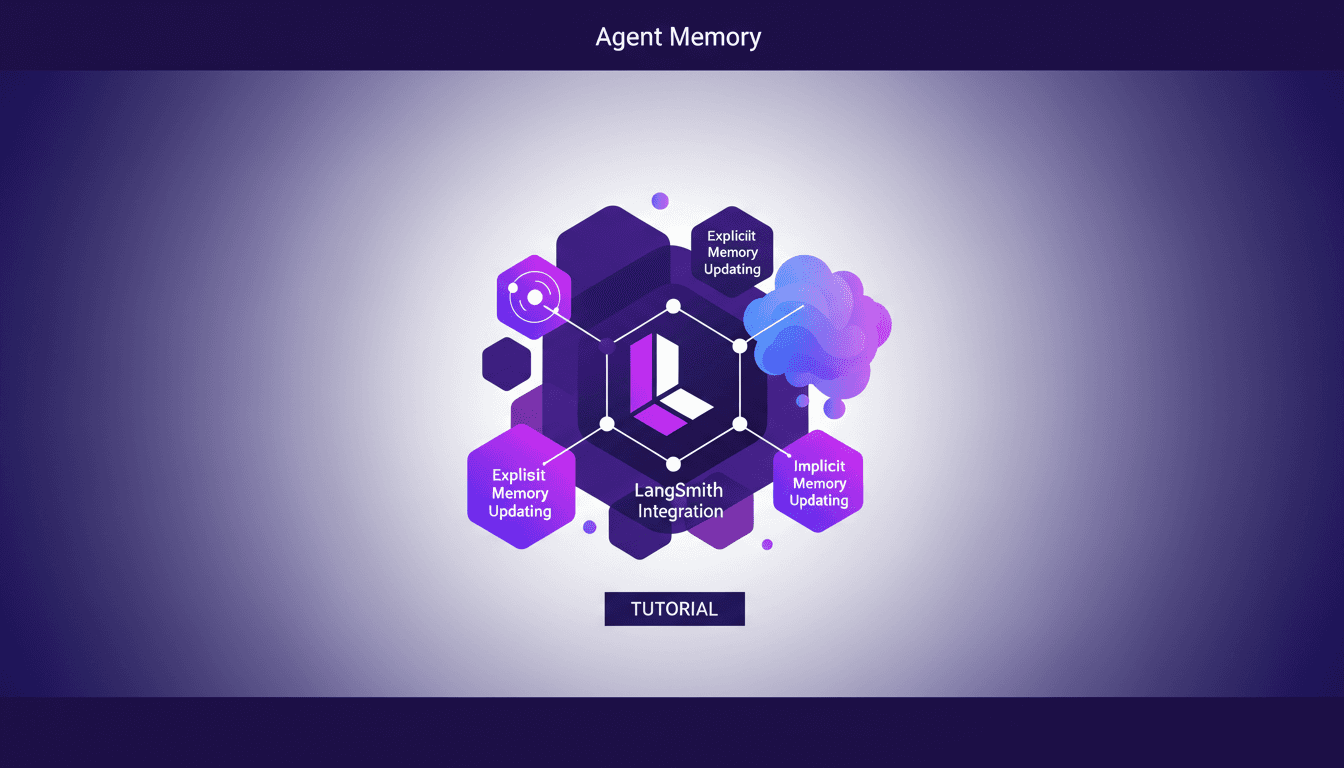

Gérer la Mémoire des Agents: Approches Pratiques

Je me souviens de la première fois où j'ai dû gérer la mémoire d'un agent IA. C'était comme apprendre à un poisson rouge à se souvenir de son chemin dans un étang. C'est là que j'ai compris : la gestion de la mémoire n'est pas juste un complément, c'est la colonne vertébrale d'une interaction IA intelligente. Je vais vous montrer comment j'ai abordé cela avec des approches pratiques. D'abord, on doit comprendre les mises à jour explicites et implicites de la mémoire des agents. Ensuite, l'intégration d'outils comme Langmith est essentielle. On explore aussi l'utilisation des journaux de session pour optimiser les mises à jour de mémoire. Si vous avez déjà lutté avec la gestion des agents profonds et la configuration, je vous donne mes astuces pour éviter les pièges. Cette vidéo est un tutoriel avancé, donc accrochez-vous, ça va valoir le coup.