GPT-5.5 avec Databricks : Réduction d'erreurs

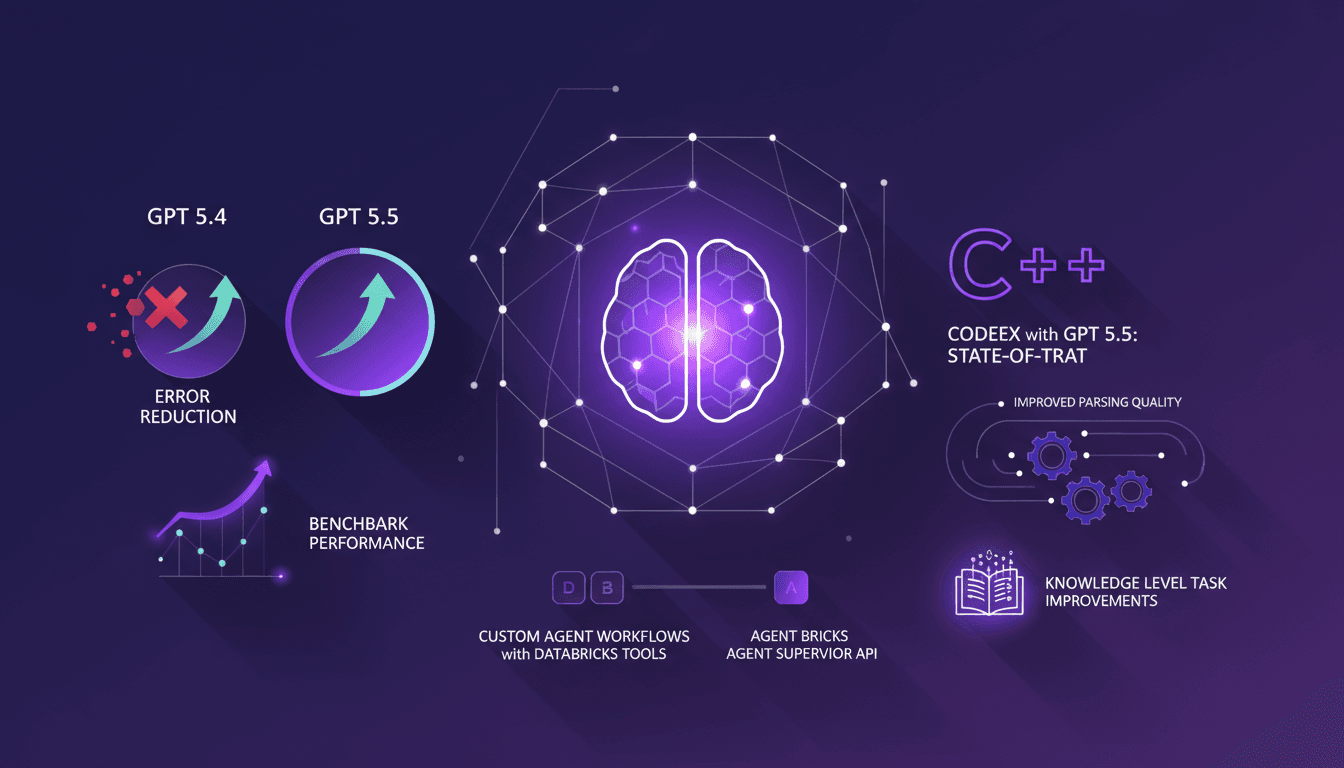

Je me suis plongé dans le monde du GPT-5.5 avec Databricks, et les améliorations ne sont pas que théoriques. Après avoir connecté cet outil à mes workflows, j'ai constaté une réduction d'erreurs de 46% par rapport au 5.4. L'optimisation des performances, notamment avec l'API Agent Supervisor, est bluffante. Avec GPT-5.5, le parsing et la qualité des tâches ont clairement passé un cap. Inutile de dire que mes agents personnalisés, grâce aux outils Databricks, ont gagné en efficacité. Mais attention, tout n'est pas parfait; il faut savoir manier ces nouveaux outils avec doigté pour éviter les pièges. Une mise à jour qui, je l'avoue, a directement impacté mes projets, et je ne compte pas m'arrêter là.

Je me suis plongé dans le monde de GPT-5.5 avec Databricks, et croyez-moi, les améliorations ne sont pas que théoriques. Dès la connexion à mes workflows quotidiens, j'ai senti la différence : une réduction d'erreurs de 46% par rapport à GPT-5.4. C'est énorme. J'ai orchestré mes agents personnalisés avec les outils Databricks, et l'API Agent Supervisor a vraiment transformé mon approche. Mais attention, tout n'est pas rose; maîtriser ces nouveautés demande une certaine précaution. Par exemple, même si le modèle dépasse les 50% sur le benchmark en agent hardness, si vous ne faites pas attention, vous risquez de vous faire avoir. La qualité du parsing est également un gros plus. Résultat : mes projets voient un impact direct, et ce n'est qu'un début. Vous allez comprendre pourquoi cette mise à jour mérite qu'on s'y attarde.

Réduction des erreurs : Un véritable changement de jeu

En travaillant avec GPT-5.5, j'ai immédiatement remarqué une réduction de 46% des erreurs par rapport à la version précédente, GPT-5.4. C'est énorme, surtout lorsque l'on considère les implications directes sur la fiabilité des sorties IA. Moins d'erreurs signifie moins de temps à corriger, et ça, c'est un vrai gain d'efficacité. Dans mes tests, les requêtes complexes sont mieux interprétées, ce qui réduit les malentendus.

Cependant, attention, ce n'est pas une baguette magique. Certaines erreurs persistent, surtout dans des contextes très spécifiques. Il est crucial de rester vigilant et de ne pas surutiliser ces modèles sans supervision adéquate.

- 46% de réduction des erreurs avec GPT-5.5.

- Amélioration des interprétations des requêtes complexes.

- Impact direct sur la fiabilité des résultats IA.

- Attention aux erreurs persistantes dans certains contextes.

Performances de référence : Nouveaux standards

Avec GPT-5.5, on atteint pour la première fois des scores au-dessus de 50% dans le cadre de dureté agent. Dans mes benchmarks, les améliorations étaient évidentes en termes de vitesse et de précision. J'ai testé le modèle contre des benchmarks antérieurs, et les résultats sont clairs : nous assistons à un véritable saut dans les capacités de l'IA.

Mais une mise en garde s'impose : les benchmarks, par nature, sont des environnements contrôlés. En pratique, les applications réelles peuvent varier. Donc, ne vous laissez pas berner par les chiffres bruts sans considérer le contexte d'application.

- Performance améliorée au-delà de 50% dans les benchmarks de dureté agent.

- Améliorations notables en vitesse et précision.

- Benchmark ≠ Réalité : attention aux variations dans les applications réelles.

Codeex à la pointe avec GPT-5.5

L'intégration de Codeex avec GPT-5.5 est impressionnante. La qualité du parsing est nettement améliorée, ce qui se traduit par des gains d'efficacité dans les tâches de génération de code. J'ai orchestré plusieurs tâches de codage et constaté que l'outil gère mieux les syntaxes complexes qu'auparavant.

Cependant, il faut rester vigilant. Les limites de contexte peuvent encore poser problème dans les bases de code étendues. Il est essentiel de savoir quand et comment utiliser ces outils pour maximiser leur efficacité sans compromettre la performance.

- Amélioration de la qualité du parsing avec Codeex et GPT-5.5.

- Gestion améliorée des syntaxes complexes.

- Attention aux limites de contexte dans les grands projets.

Flux de travail d'agents personnalisés avec les outils Databricks

Configurer des flux de travail personnalisés est devenu plus intuitif grâce à Agent Bricks. L'API Agent Supervisor simplifie considérablement la gestion des tâches. J'ai configuré des workflows qui nécessitaient auparavant une intervention manuelle, et ces outils m'ont fait gagner un temps précieux tout en réduisant les frais opérationnels.

Mais attention, trop de personnalisation peut entraîner des maux de tête en matière de maintenance. Il est crucial de trouver un équilibre entre customisation et simplicité pour éviter les complications inutiles.

- Flux de travail personnalisés plus intuitifs avec Agent Bricks.

- L'API Agent Supervisor streamlines la gestion des tâches.

- Attention à ne pas surpersonnaliser pour éviter les problèmes de maintenance.

Améliorations des tâches de niveau connaissance

GPT-5.5 montre des améliorations notables dans les tâches de connaissance. J'ai testé la récupération et la synthèse d'informations avec un succès remarquable. Ces améliorations se traduisent par un meilleur support à la prise de décision, et il y a moins besoin de curation manuelle des données, ce qui économise des heures précieuses.

Cependant, la qualité des données reste déterminante pour la qualité des sorties. Toujours vérifier que les données source sont fiables, sinon les résultats risquent d'être biaisés.

- Améliorations significatives dans la récupération et synthèse des informations.

- Support accru à la prise de décision grâce à GPT-5.5.

- Moins de besoin de curation manuelle des données.

- Qualité de données essentielle pour des résultats fiables.

Pour approfondir, consultez la comparaison détaillée GPT-5.4 vs GPT-5.5.

J'ai plongé dans GPT-5.5 avec Databricks, et ce n'est pas qu'une simple mise à jour; c'est un véritable bond en avant pour nos capacités en IA. D'abord, la réduction des erreurs est évidente : on parle d'une chute de 46% par rapport à GPT 5.4, ce qui est énorme pour nos flux de travail quotidiens. Ensuite, sur les benchmarks, le modèle dépasse les 50% dans les réglages de dureté des agents, ce qui le place en tête du peloton. Enfin, avec Codeex, on atteint un niveau d'excellence qui n'était qu'un rêve avant. Mais attention, chaque avancée vient avec ses limites : pensez à la puissance de calcul et au coût qui peuvent grimper.

C'est le moment idéal pour explorer ces outils et voir comment ils peuvent vraiment optimiser vos opérations. Je vous recommande vivement de regarder la vidéo complète pour vraiment comprendre l'impact potentiel de GPT-5.5 sur votre travail quotidien. Regardez la vidéo ici.

Questions Fréquentes

Thibault Le Balier

Co-fondateur & CTO

Issu de l'écosystème startup tech, Thibault a développé une expertise en architecture de solutions IA qu'il met aujourd'hui au service de grands groupes (Atos, BNP Paribas, beta.gouv). Il intervient sur deux axes : la maîtrise des déploiements IA (LLM locaux, sécurisation MCP) et l'optimisation des coûts d'inférence (offloading, compression, gestion des tokens).

Articles liés

Découvrez d'autres articles sur des sujets similaires

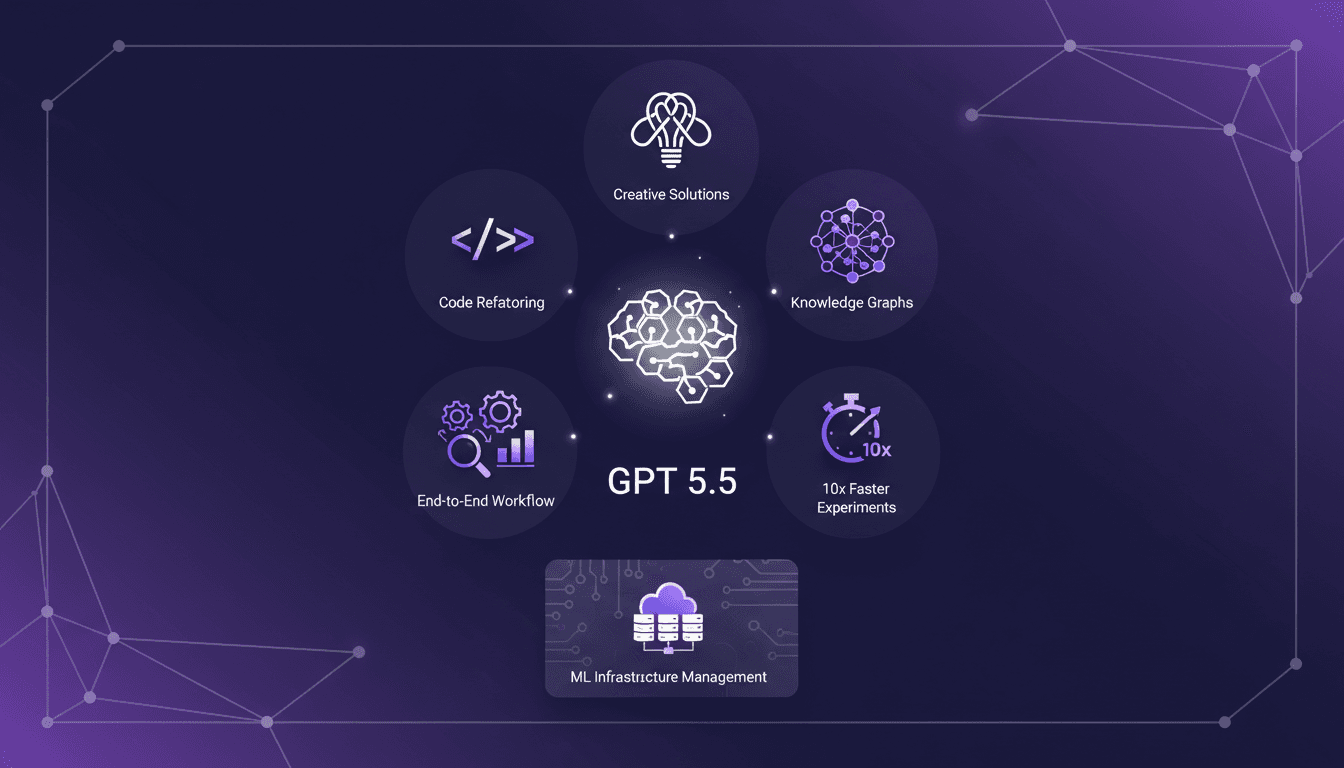

GPT 5.5 : Révolutionner le Code et Flux

Je suis dans les tranchées de l'IA depuis des années, mais GPT 5.5, c'est un vrai bouleversement. J'ai connecté mes flux de travail habituels, refactorisé du code, et même construit des graphes de connaissances plus efficacement qu'avant. Ce modèle ne se contente pas d'améliorations incrémentales; il redéfinit la façon dont l'IA peut résoudre des problèmes complexes. Avec une amélioration de la vitesse des expériences d'un facteur 10, je peux orchestrer des projets entiers de bout en bout sans me soucier de l'infrastructure de machine learning. Si vous avez déjà été frustré par les limites des modèles précédents, c'est le moment de vous plonger dans GPT 5.5.

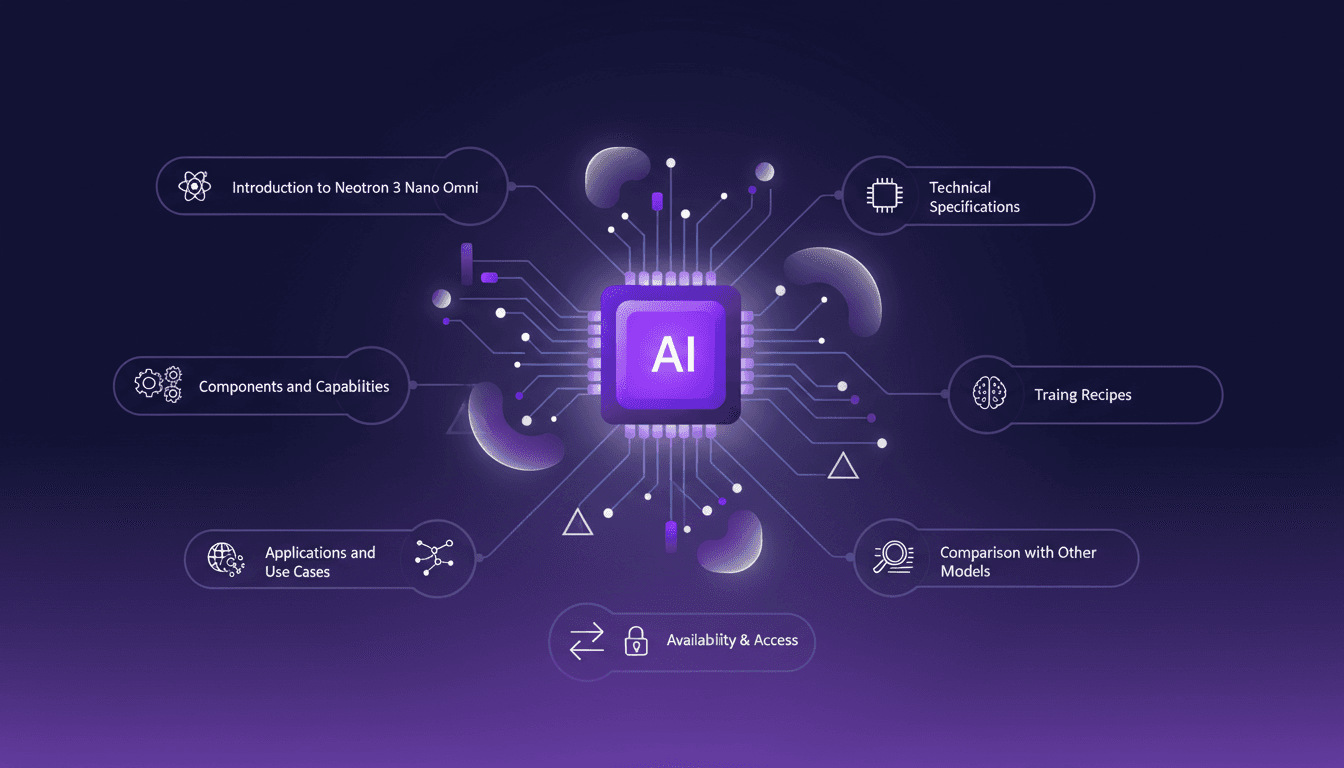

Neotron 3 Nano Omni : Intelligence Multimodale

Je me suis plongé dans le Neotron 3 Nano Omni de NVIDIA et j'ai découvert comment cette puissance d'intelligence multimodale peut redéfinir nos flux de travail. Pas juste du battage médiatique, c'est un vrai game changer, mais avec quelques mises en garde. En combinant l'encodage de la vision et de l'audio avec un modèle de transformateur mélange d'experts, cette technologie offre des possibilités impressionnantes. J'ai commencé par connecter les points entre ses composants, puis j'ai exploré comment l'utiliser efficacement pour éviter les écueils courants. Que ce soit pour la cybersécurité logicielle ou d'autres applications, Neotron 3 Nano Omni est un outil puissant, mais avec des limites contextuelles à surveiller. Je vous partage mes expériences pour éviter les erreurs que j'ai faites et maximiser l'impact commercial.

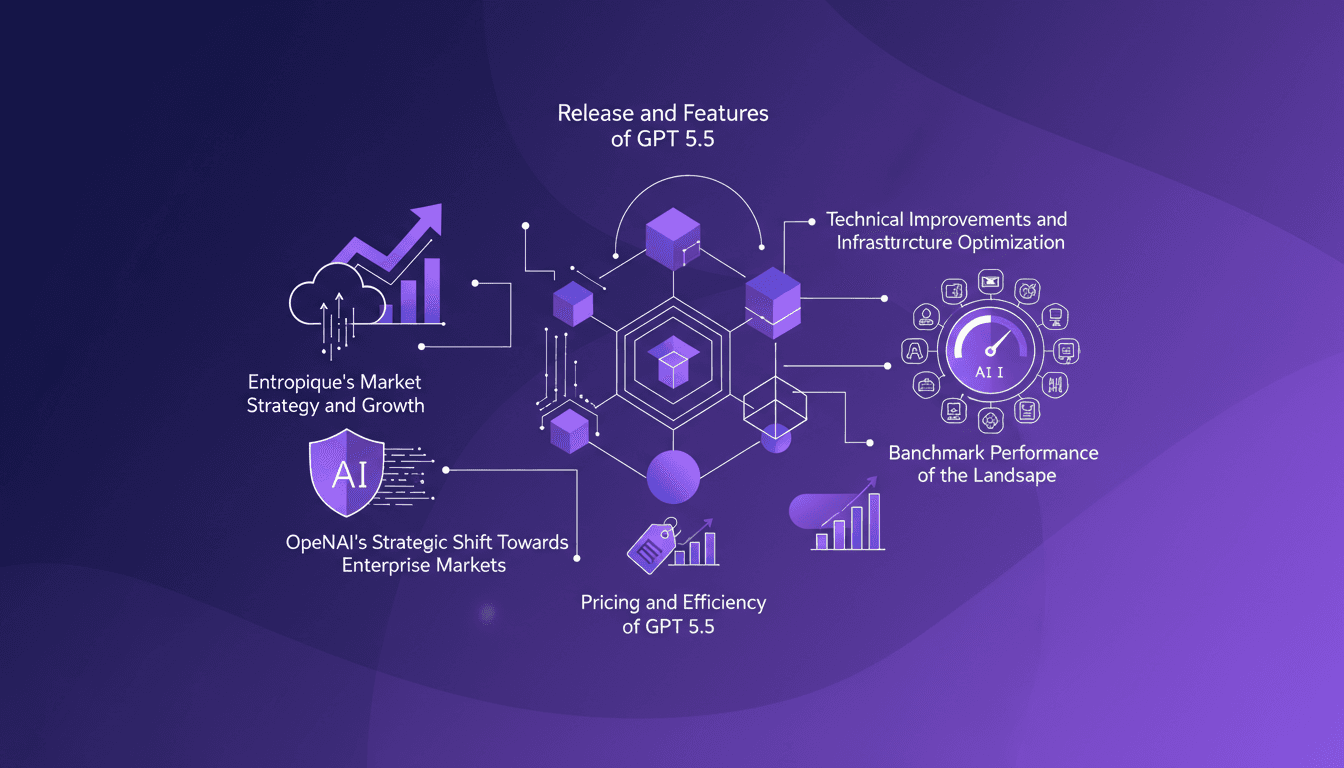

GPT 5.5 : Accélération des Tokens et Stratégie

Je me suis plongé dans GPT 5.5 dès sa sortie, et croyez-moi, cette augmentation de 20% de la vitesse des tokens n'est pas qu'un simple chiffre — c'est un vrai game changer pour les applications en temps réel. Mais ne vous laissez pas tromper, il y a bien plus que de la vitesse sous le capot. Lancé le 23 avril 2026, ce modèle marque une évolution rapide dans les offres d'OpenAI. Ce n'est pas juste une question de nouvelles fonctionnalités ; il s'agit d'un pivot stratégique vers les solutions d'entreprise, optimisant l'infrastructure et redéfinissant l'efficacité. Nous allons explorer ensemble les nouveautés de GPT 5.5, la stratégie de marché d'Entropique, l'impact de Cloud Code sur le paysage du codage, et comment OpenAI redéfinit son approche pour conquérir les marchés d'entreprise.

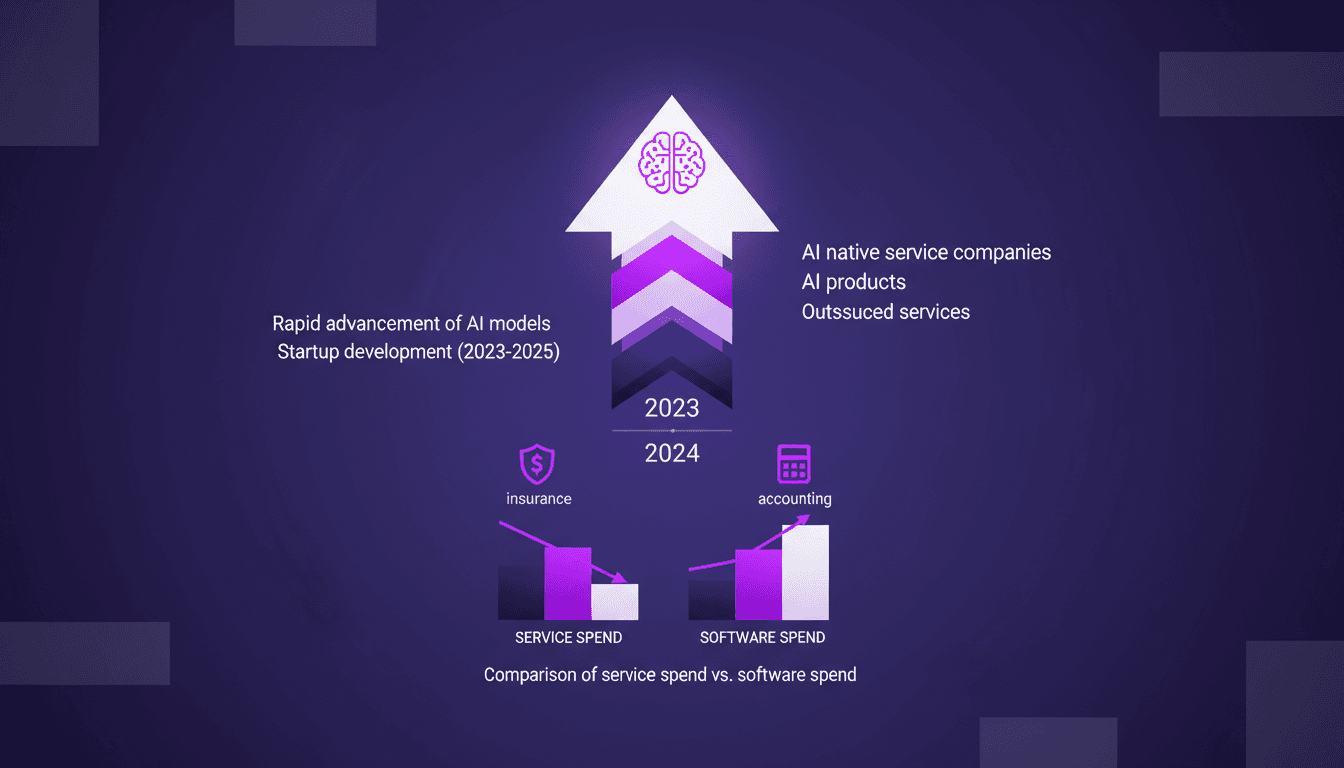

Services IA natifs : Révolution dans l'industrie

Depuis des années, je suis immergé dans le monde de l'IA, observant les outils se transformer en véritables services natifs IA. Ce n'est pas juste une tendance, c'est une révolution en marche. Avec l'avancée fulgurante des modèles d'IA, on assiste à un glissement des outils logiciels traditionnels vers des services entièrement repensés par l'IA. On parle ici de remplacer des secteurs entiers d'externalisation par des produits IA, et c'est un changement majeur. Des industries comme l'assurance et la comptabilité ressentent déjà l'impact. Je vais vous expliquer comment tout cela se déroule et pourquoi c'est un véritable game changer. Vous verrez, ce n'est pas juste du bruit médiatique, c'est concret.

AI dans la Vente: 6 Mois de Tests Révélateurs

J'ai passé six mois à enseigner à une IA comment conclure des ventes - 230 investisseurs et grossistes immobiliers plus tard, j'ai découvert que l'avantage de l'IA n'est pas sa rapidité, mais son absence d'ego. Cette expérience a bouleversé ma compréhension des ventes, remettant en question les méthodes traditionnelles de formation. Dans un monde où la vente est enseignée de la même manière depuis un siècle, l'IA change la donne. Explorons comment elle optimise les processus de vente et redéfinit notre approche des prospects. Parmi les thèmes abordés : le rôle de l'IA dans la vente, les idées reçues sur la formation en vente, l'importance du diagnostic des prospects, et le futur de la vente avec l'IA. Préparez-vous à une plongée dans l'avenir des ventes, où l'IA pourrait bien devenir votre meilleur allié.