Déployer des agents avec A2A sur LangSmith

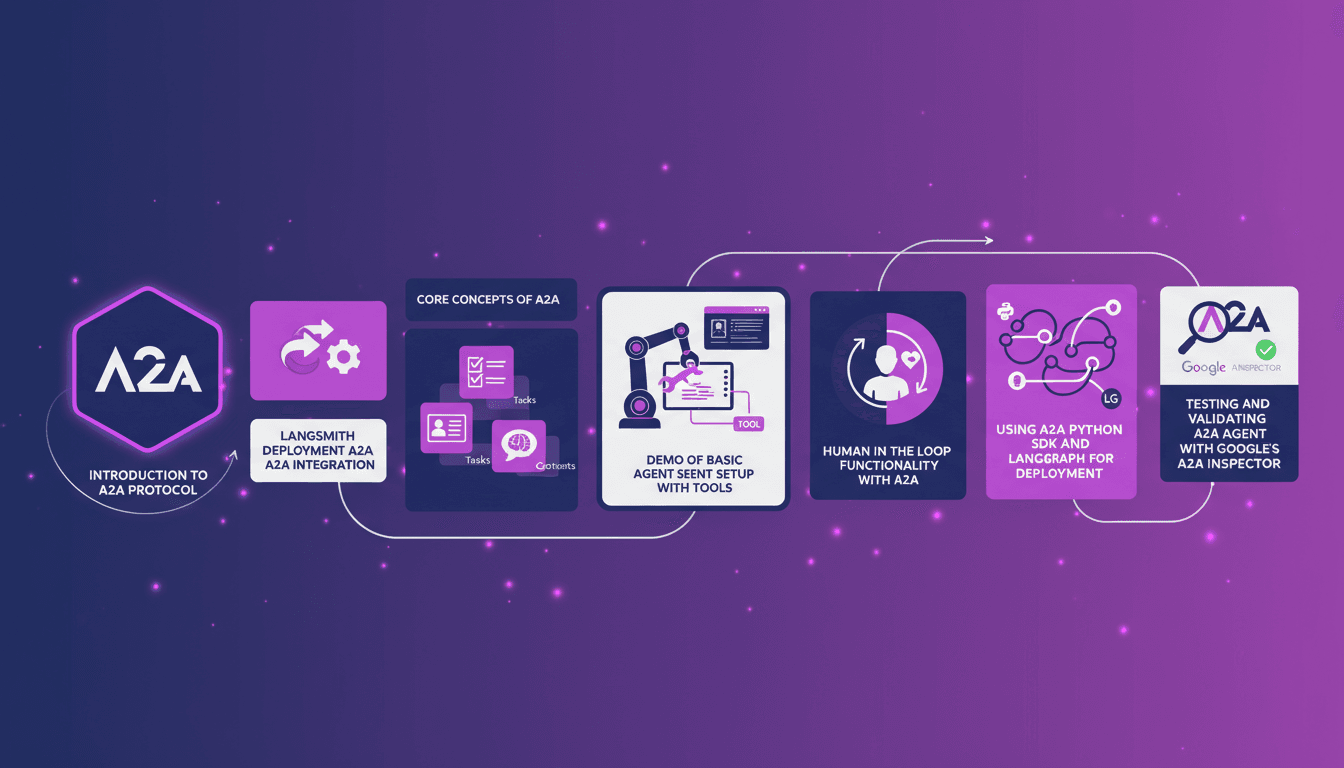

Avez-vous déjà essayé de déployer des agents avec le protocole A2A sur LangSmith ? Moi, oui, et ça a transformé mon workflow. Quand Google a lancé A2A en 2024, j'étais curieux. J'ai intégré ça avec LangSmith et, honnêtement, ça m'a facilité la vie, économisant du temps et des ressources. Je vais vous montrer comment j'ai configuré tout ça, les pièges que j'ai évités, et comment j'ai utilisé LangGraph et le SDK Python pour orchestrer le tout. On parle de cartes d'agents, de tâches, de contextes, et bien sûr, du test avec l'inspecteur de Google. Vous allez voir, c'est puissant, mais attention aux limites, surtout quand on dépasse les 100K tokens.

Déployer des agents avec le protocole A2A sur LangSmith, c'était un vrai tournant pour moi. Quand Google a sorti A2A en 2024, je me suis dit que ça pouvait vraiment optimiser mes procédures. J'ai plongé dedans, et l'intégration avec LangSmith a été une révélation. Imaginez pouvoir configurer des agents avec quatre outils de base et les voir exécuter des calculs aussi simplement que 3 * 2 * 2. C'est là que j'ai vraiment vu le gain de temps et de ressources. Mais attention, ça n'a pas été sans défis. J'ai dû jongler avec des cartes d'agents, des tâches, des contextes et même mettre en place une boucle avec l'humain. J'ai aussi utilisé le SDK Python et LangGraph pour orchestrer tout ça. Et pour les tests, l'inspecteur A2A de Google a été un compagnon essentiel. Bref, je vous emmène dans mon parcours, avec les réussites et les erreurs, pour que vous puissiez aussi tirer parti de cette technologie sans vous brûler les ailes.

Comprendre le Protocole A2A

Le protocole A2A, sorti par Google en 2024, est un véritable tournant pour la communication entre agents. Imaginez un monde où les agents, peu importe leur provenance ou leur modèle sous-jacent, peuvent interagir sans problèmes. C'est ça l'A2A : un protocole standardisé qui facilite la coordination des actions entre agents. Mais attention, ça devient vite complexe surtout quand on parle des contexts. Chaque agent est décrit par une agent card, un fichier JSON qui récapitule ses capacités, son URL et d'autres métadonnées essentielles. Ensuite, on a les tasks, qui représentent des demandes-réponses dans un contexte donné. Ce dernier regroupe plusieurs tâches et devient crucial dans une conversation à plusieurs tours. Je me suis fait avoir plusieurs fois à cause de la complexité de ces contexts ; il faut vraiment bien les maîtriser.

Intégration d'A2A avec LangSmith

Pour intégrer le protocole A2A avec LangSmith, j'ai d'abord configuré l'intégration, et c'est là que les vraies difficultés ont commencé. La configuration initiale est cruciale. Il m'a fallu plusieurs essais pour que tout fonctionne correctement. On a souvent tendance à sous-estimer cette étape, mais elle est fondamentale pour éviter des erreurs plus tard. Une fois l'intégration réussie, les gains d'efficacité étaient notables : les agents communiquaient de manière fluide, et les tâches s'exécutaient sans accroc. Mais attention, ne négligez pas les paramètres initiaux, ça peut vous coûter cher en temps et en performance.

Configurer des Agents de Base avec des Outils

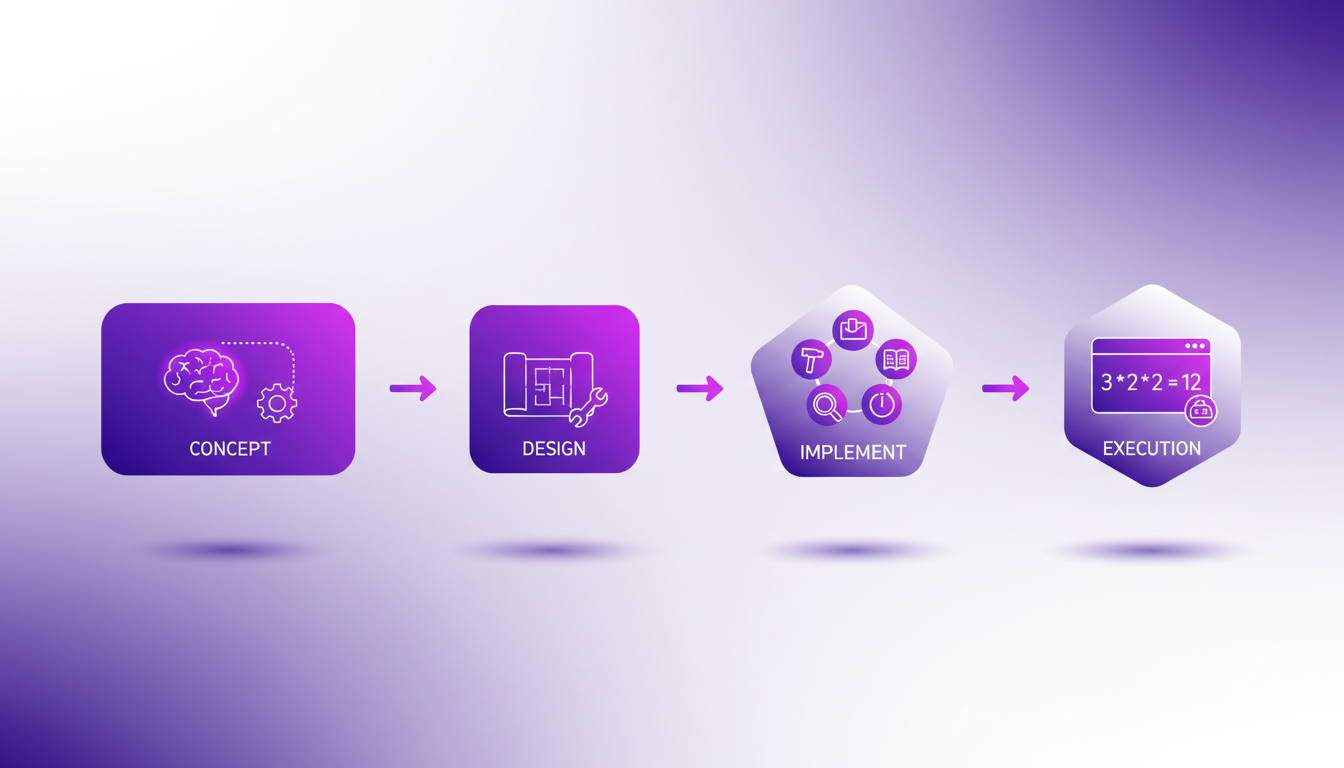

Pour configurer un agent de base, j'ai utilisé quatre outils différents : un pour dire l'heure, un pour des calculs simples, et deux autres pour gérer les emails. Le workflow est assez simple : d'abord, créer l'agent, puis ajouter les outils un par un. Lors de la démonstration, j'ai demandé à l'agent de calculer 3 * 2 * 2, et il a répondu instantanément. Équilibrer la complexité et la fonctionnalité est un vrai défi. Trop de complexité et l'agent devient difficile à gérer ; trop peu, et il n'est pas assez performant. C'est un jeu d'équilibriste que j'ai appris à maîtriser avec le temps.

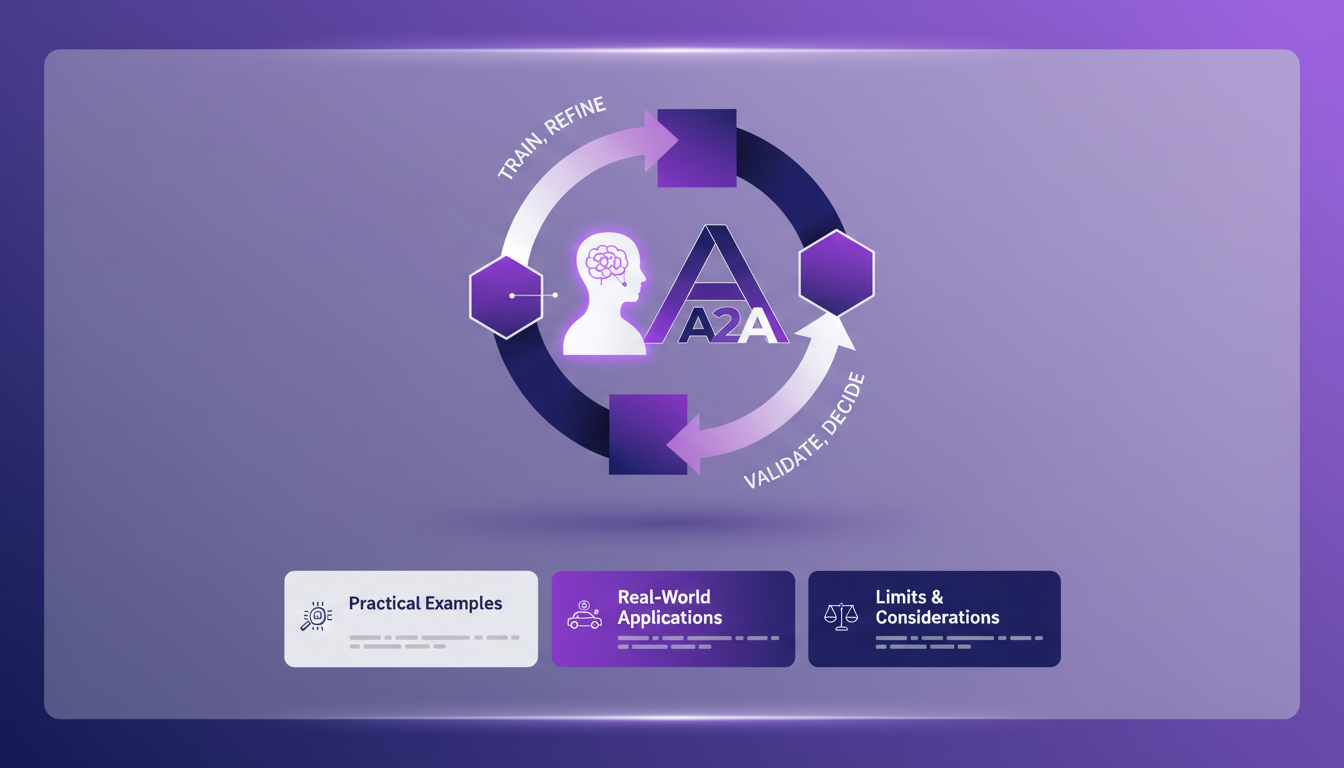

Fonctionnalité de l'Humain dans la Boucle

Intégrer l'humain dans la boucle (HITL) avec le protocole A2A apporte une dimension intéressante. J'ai utilisé cette fonctionnalité pour superviser l'envoi d'emails. Cela permet de valider ou de modifier les actions des agents avant qu'elles ne soient exécutées. Dans certaines situations, l'intervention humaine est nécessaire pour éviter des erreurs coûteuses. Les coûts peuvent augmenter, mais l'assurance de qualité vaut bien cet investissement. Je recommande d'utiliser HITL lorsque des décisions critiques doivent être prises.

Déploiement et Validation avec A2A

Pour le déploiement, j'ai utilisé le A2A Python SDK et LangGraph. Les tests et la validation avec l'inspecteur A2A de Google sont essentiels pour s'assurer que tout fonctionne comme prévu. Mais attention aux pièges courants : une mauvaise configuration peut entraîner des échecs de communication. Mon conseil : prendre le temps de bien configurer et tester chaque composant avant le déploiement final. Ainsi, vous éviterez bien des soucis et optimiserez les performances de vos agents.

Déployer des agents avec A2A sur LangSmith, c'est un peu comme passer à la vitesse supérieure dans tes workflows. D'abord, je me suis plongé dans le protocole A2A sorti en 2024 par Google. Ensuite, j'ai intégré les cartes d'agent et les tâches dans mon setup avec 4 outils. Et là, j'ai vu, 3 * 2 * 2, ça calcule vite ! Mais attention, l'intégration du HITL (Human-In-The-Loop) peut être un vrai casse-tête si mal géré.

- Prends le temps de comprendre le protocole A2A, c'est la base solide.

- Intègre les cartes d'agent et les tâches pour vraiment booster l'efficacité.

- Ne néglige pas l'importance des contextes pour un setup optimal.

Ce que je retiens, c'est que bien maîtrisé, A2A peut vraiment transformer tes projets. Mais comme toujours, il faut tester, ajuster et itérer pour éviter les mauvaises surprises. Prêt à déployer tes propres agents ? Plonge dedans, expérimente et constate l'impact. Je te recommande de regarder la vidéo originale pour une meilleure compréhension : Vidéo YouTube.

Questions Fréquentes

Thibault Le Balier

Co-fondateur & CTO

Issu de l'écosystème startup tech, Thibault a développé une expertise en architecture de solutions IA qu'il met aujourd'hui au service de grands groupes (Atos, BNP Paribas, beta.gouv). Il intervient sur deux axes : la maîtrise des déploiements IA (LLM locaux, sécurisation MCP) et l'optimisation des coûts d'inférence (offloading, compression, gestion des tokens).

Articles liés

Découvrez d'autres articles sur des sujets similaires

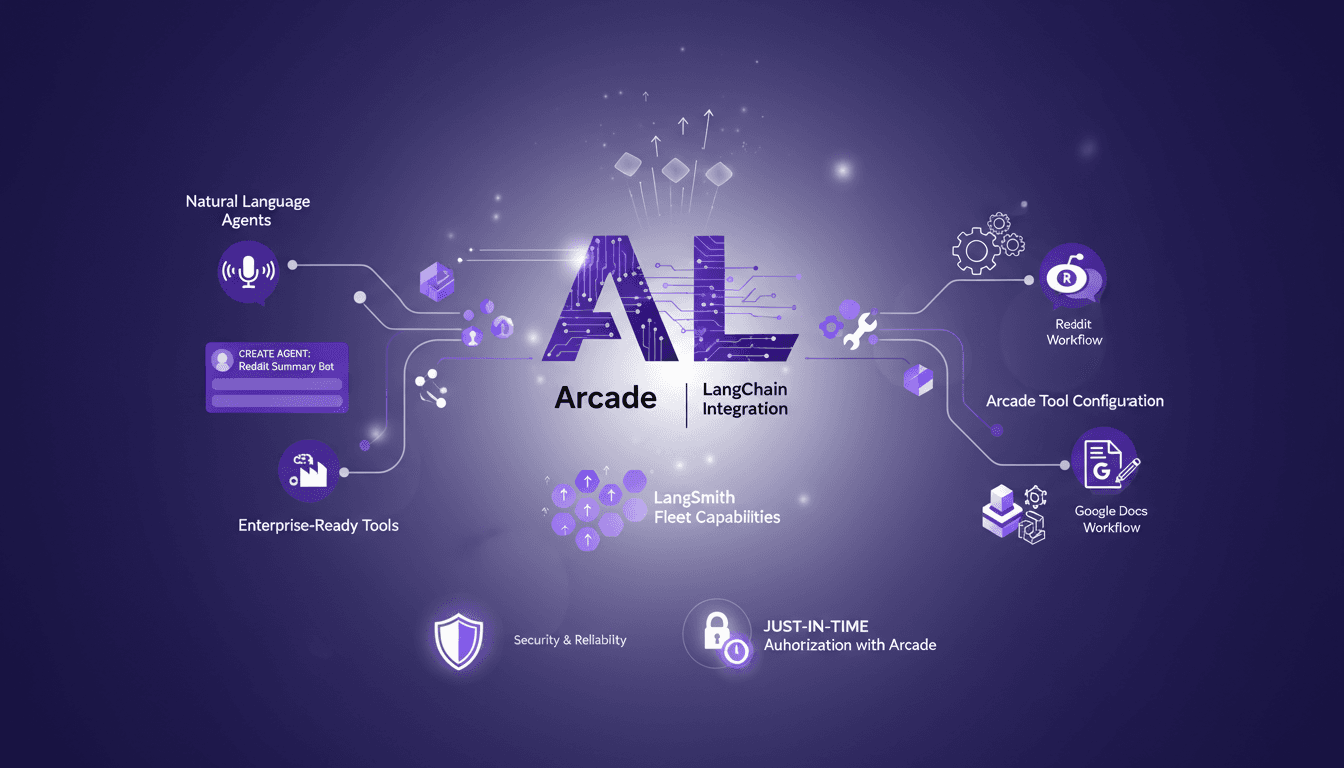

Intégration LangChain avec Arcade: Guide Pratique

J'ai plongé tête la première dans l'intégration de LangChain avec Arcade, et croyez-moi, les capacités sont révolutionnaires. Mais comme tout outil puissant, tout dépend de la manière dont vous le configurez et l'utilisez. Avec plus de 7 500 outils Arcade.dev désormais disponibles dans LangSmith Fleet, les possibilités pour créer des agents IA avec du langage naturel sont sans précédent. Mais attention, il faut savoir orchestrer ces outils pour éviter les pièges. Dans ce guide, je vais vous montrer comment tirer le meilleur parti de cette intégration, avec des exemples concrets comme l'utilisation de Reddit et Google Docs. Et surtout, je vous parlerai des défis de sécurité et de fiabilité en environnement de production, ainsi que des autorisations just-in-time avec Arcade. Bref, un vrai tour d'horizon pour ceux qui cherchent à maximiser l'impact de leurs projets IA.

Gérer les Objections en Vente: Techniques Pratiques

Vous êtes déjà resté sans voix lors d'une réunion de vente, incapable de lire la pièce ? Ça m'est arrivé, et je vais vous dire comment je gère ça quand les objections semblent invisibles. Dans le monde des ventes, reconnaître les objections, ou l'absence de celles-ci, est crucial. Et je ne parle pas de théorie académique, mais de ce qui se passe réellement sur le terrain. Comment l'IA peut-elle intervenir pour aider ? Je vais partager comment je détecte les motivations cachées par des questions précises et comment je crée un espace pour une communication authentique. Attention, il ne s'agit pas de surutiliser l'IA, mais de l'intégrer intelligemment dans le processus de vente.

Évitez Objections Identité Vente Auto

Dans le monde impitoyable de la vente automobile, j'ai appris à mes dépens que les objections d'identité peuvent faire ou défaire une transaction. La première fois que j'ai été confronté à cela, je me suis pris les pieds dans le tapis. Mais aujourd'hui, j'aborde ces situations avec une stratégie claire. Il ne s'agit pas seulement de caractéristiques techniques ou de prix, mais de qui le client est ou aspire à être. Nous allons décortiquer comment l'identité joue un rôle crucial dans les ventes et comment vous pouvez tourner cela à votre avantage.

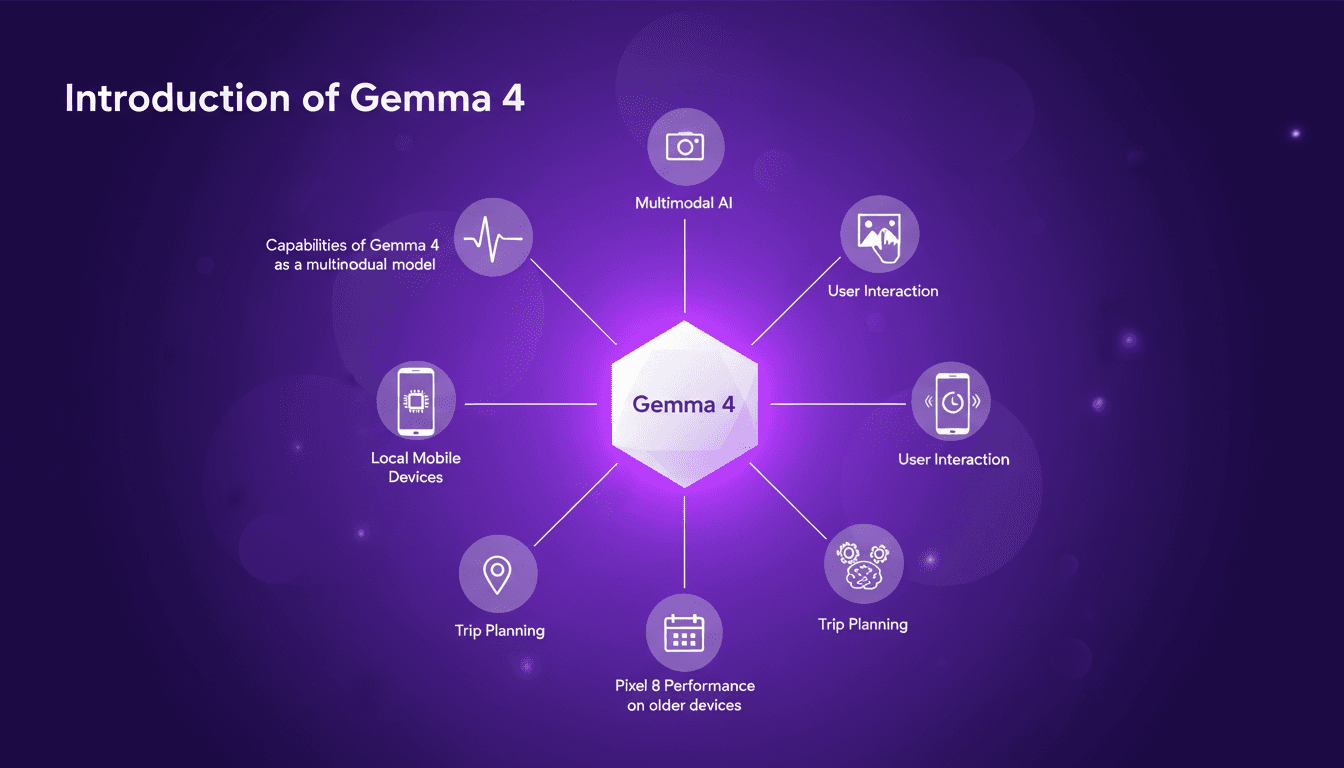

Découverte de Gemma 4 : Modèle Multimodal Google

Je viens de mettre la main sur Gemma 4, le dernier modèle IA de Google, et c'est une vraie centrale multimodale ! J'ai commencé à le tester sur mes appareils mobiles, et franchement, ça décoiffe. Il ne s'agit pas seulement de technologie tape-à-l'œil ; c'est une question d'applications pratiques et d'efficacité, même sur des appareils plus anciens comme le Pixel 8. Imaginez planifier votre prochain voyage avec une IA qui comprend non seulement du texte mais aussi des images et de la voix : voilà ce que Gemma 4 promet. J'ai été agréablement surpris par ses performances sur des appareils plus anciens. Dans ce tutoriel, je vais vous montrer comment tirer le meilleur parti de Gemma 4 avec la Google AI Edge Gallery. Prêts à voir comment ça fonctionne ?

L'auto-évolution de l'IA : vers l'autonomie

Je me souviens de la première fois où j'ai vu une IA modifier son propre code. C'était comme voir un enfant faire ses premiers pas—exaltant et un peu effrayant. Dans cet article, je plonge dans l'univers de l'auto-amélioration de l'IA, où les machines ne se contentent plus d'exécuter des tâches, mais redéfinissent leurs propres capacités. Avec des systèmes capables de modifier leur propre code source, nous assistons à un changement dans l'évolution des logiciels. Ce n'est pas qu'un saut théorique; c'est une réalité pratique qui impacte des industries comme l'e-commerce et l'automobile. Explorez comment cette auto-évolution de l'IA transforme des acteurs majeurs comme Shopify, Stripe et Tesla, et ce que cela signifie pour l'avenir du développement dirigé par l'IA.