Claude : Philosophie et éthique dans l'IA

J'ai rejoint Anthropic non seulement en tant que philosophe, mais aussi comme bâtisseur d'une IA éthique. D'abord, il a fallu que je comprenne le caractère de Claude, le modèle d'IA que je devais façonner. Ce voyage ne se résume pas à du code—il s'agit d'intégrer des nuances éthiques dans la prise de décision de l'IA. Dans un monde de l'IA en constante évolution, s'assurer que des modèles comme Claude prennent des décisions éthiquement solides est crucial. Ce n'est pas théorique; c'est l'application pratique de la philosophie dans l'IA. Nous abordons le caractère de Claude, les questions nuancées sur le comportement de l'IA, et comment enseigner à l'IA un comportement éthique. En tant que praticien, je vous parle des défis et des aspirations de l'éthique dans l'IA.

Pourquoi un philosophe travaille-t-il dans l'IA ? C'est exactement la question que je me posais avant de rejoindre Anthropic. Je ne suis pas venu ici pour philosopher dans l'abstrait, mais pour construire—et surtout, pour intégrer des nuances éthiques dans les décisions de Claude, notre modèle d'IA. D'abord, j'ai dû comprendre qui était Claude, son caractère. Et là, on ne parle pas juste de lignes de code. On parle d'enseigner à une IA comment prendre des décisions complexes, avec des enjeux éthiques réels. Dans le monde de l'IA qui évolue à une vitesse folle, il est crucial que des modèles comme Claude prennent des décisions éthiquement solides. Ce n'est pas juste de la théorie ; c'est de la philosophie appliquée au concret. Je vous parle ici de la personnalité de Claude, des questions nuancées qu'on lui pose, et de ce que signifie vraiment enseigner un comportement éthique à une IA. En tant que praticien, je vais vous montrer les défis et les aspirations réelles de l'éthique dans l'IA.

Comprendre le Caractère de Claude

Claude, ce n'est pas simplement un ensemble de lignes de code. C'est un modèle qui incarne des considérations éthiques. La première chose que j'ai faite, c'est de cartographier les processus de décision de Claude pour identifier les angles morts éthiques potentiels. C'est un peu comme dresser une carte des défis moraux avant de s'y aventurer. Ensuite, j'ai intégré des cadres philosophiques dans l'architecture de Claude. Ceci a permis de s'assurer que ses capacités techniques sont équilibrées par des contraintes éthiques. Pourquoi est-ce si crucial ? Parce que sans cela, on risque de dériver vers des décisions purement fonctionnelles, sans prise en compte de l'impact humain.

C'est une danse délicate entre puissance technique et contrainte morale. Par exemple, imaginez Claude confronté à une décision où la solution la plus efficace est aussi la plus discutable sur le plan éthique. C'est là que l'intégration de ces cadres prend tout son sens.

- Caractère de Claude : Équilibrer capacités techniques et contraintes éthiques.

- Cartographie : Identifier les angles morts éthiques potentiels.

Naviguer dans les Questions Nuancées de l'IA

Les questions nuancées ne sont pas juste des exercices académiques. Elles influencent directement le comportement de l'IA. À ce stade, j'ai développé des scénarios où Claude était confronté à des dilemmes éthiques complexes. C'était un processus d'essais et erreurs, de tests itératifs et de raffinement des voies de décision. Attention toutefois à ne pas simplifier à l'excès. Les décisions réelles ne sont que rarement binaires.

J'ai réalisé que les décisions de Claude devaient refléter des nuances éthiques comparables à celles qu'un humain idéal pourrait prendre, surtout dans des situations difficiles. Imaginez un instant Claude devant choisir entre deux mauvaises options. Chaque choix devait être pesé avec soin.

- Dilemmes éthiques : Test et raffinement des décisions.

- Nuances éthiques : Éviter la simplification binaire des décisions.

Enseigner la Prise de Décision Éthique à l'IA

Ensuite, j'ai implémenté des modules de formation éthique dans le processus d'apprentissage de Claude. L'objectif était de simuler des défis éthiques réels. J'ai utilisé une boucle de rétroaction pour affiner les réponses de Claude au fil du temps. Mais attention, ne vous fiez pas trop aux règles préétablies. La flexibilité est essentielle. J'ai souvent dû ajuster le tir, notamment quand des comportements inattendus apparaissaient.

C'est un peu comme enseigner à un enfant à naviguer dans des situations nouvelles. Le modèle doit apprendre à s'adapter, et non simplement appliquer des règles figées.

- Modules de formation : Simuler des défis éthiques réels.

- Rétroaction : Raffinement continu des réponses de Claude.

- Flexibilité : Importance de l'adaptation plutôt que l'application rigide des règles.

Émuler le Comportement d'une Personne Idéale

L'aspiration ultime est que l'IA imite la prise de décision d'une personne idéale. J'ai élaboré des critères de comportement idéal basés sur des principes philosophiques. Ce processus impliquait un alignement continu avec les objectifs éthiques. Attention aux biais culturels qui pourraient s'insinuer dans le modèle. C'est un risque constant, surtout quand l'IA est déployée dans des contextes variés.

C'est là que réside la complexité : garantir que l'IA ne reflète pas simplement une culture ou un point de vue, mais qu'elle embrasse une perspective éthique universelle.

- Comportement idéal : Critères basés sur des principes philosophiques.

- Alignement éthique : Ajustement continu des objectifs.

- Biais culturels : Surveillance constante pour éviter leur intégration.

Objectifs Aspirants pour l'Éthique de l'IA

L'objectif à long terme est d'établir une norme pour le comportement éthique de l'IA. J'ai piloté de nouvelles directives éthiques pour guider le développement de l'IA. Cela nécessite une collaboration continue avec des équipes interdisciplinaires. Rappelez-vous, l'éthique de l'IA est un voyage, pas une destination. C'est un processus qui exige une réévaluation constante et une adaptation aux nouvelles découvertes.

Pour moi, chaque itération de Claude représente une étape vers cet objectif ultime. Mais il est essentiel de se rappeler que chaque décision éthique doit être contextualisée et revue.

- Normes éthiques : Établir des standards pour le comportement de l'IA.

- Collaboration : Travail interdisciplinaire pour le développement de l'IA.

- Voyage éthique : Processus continu de réévaluation et d'adaptation.

Construire une IA éthique comme Claude, c’est plus qu’une question de prouesse technique; c'est l'intégration d'idées philosophiques profondes dans nos décisions quotidiennes. D’abord, je m'assure que Claude pose les questions nuancées — celles qui nous poussent à réfléchir à deux fois sur le comportement éthique. Ensuite, c’est un travail continu d’entraîner Claude à se comporter comme une 'personne idéale'. Mais attention, les décisions difficiles restent un défi; il faut équilibrer la complexité des choix avec la rapidité des réponses. Clairement, intégrer ces comportements dans une IA est un game changer, mais il y a toujours le risque de simplifier à l’excès. L'avenir ? Je suis convaincu que nous pouvons faire de l’IA un acteur éthique majeur. Rejoignez-moi dans ce voyage vers le développement d'une IA éthique. Partagez vos expériences, et ensemble, façonnons le futur de l’IA. Pour aller plus loin, je vous recommande de regarder la vidéo originale : "Pourquoi un philosophe travaille-t-il dans l'IA ?" Vidéo YouTube.

Questions Fréquentes

Thibault Le Balier

Co-fondateur & CTO

Issu de l'écosystème startup tech, Thibault a développé une expertise en architecture de solutions IA qu'il met aujourd'hui au service de grands groupes (Atos, BNP Paribas, beta.gouv). Il intervient sur deux axes : la maîtrise des déploiements IA (LLM locaux, sécurisation MCP) et l'optimisation des coûts d'inférence (offloading, compression, gestion des tokens).

Articles liés

Découvrez d'autres articles sur des sujets similaires

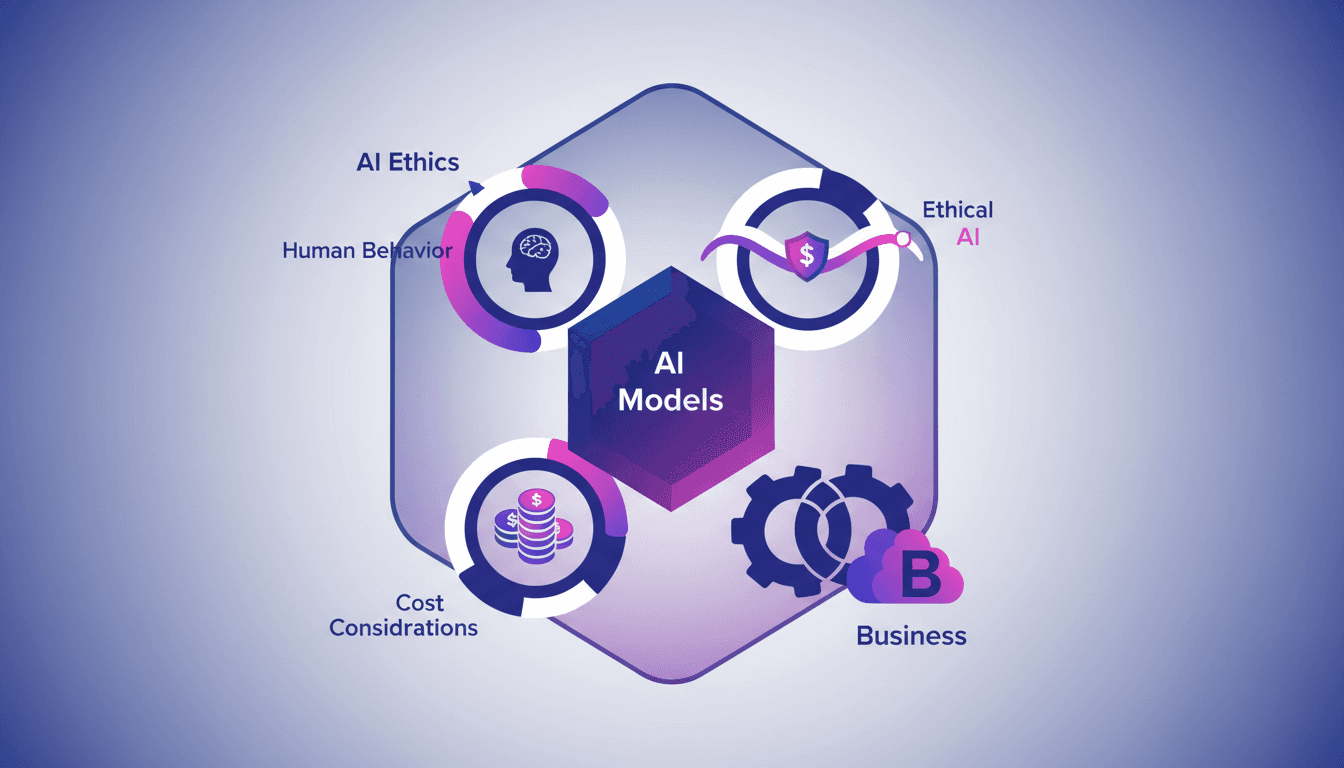

Traiter les modèles IA: Pourquoi ça compte

J'ai passé du temps dans les tranchées avec les modèles d'IA, et laissez-moi vous dire : la façon dont nous les traitons va bien au-delà d'une simple question technique. C'est un reflet de nos valeurs. D'abord, il faut comprendre que bien traiter les modèles d'IA n'est pas seulement une question d'éthique. C'est aussi une affaire d'impact réel et de coûts. Dans le développement de l'IA, chaque choix a des conséquences éthiques et pratiques. Que ce soit pour maintenir les modèles ou pour interagir avec eux, ces décisions façonnent notre technologie et notre société. On parle de l'impact des interactions IA sur le comportement humain, des considérations de coûts, et des questions éthiques autour des entités quasi-humaines. En gros, nos modèles d'IA sont un peu le miroir de nous-mêmes.

Poolside : Révolutionner l'IA avec Jason Warner

Imaginez un monde où l'IA transforme instantanément le code d'une langue à l'autre. Poolside fait de cela une réalité. Lors d'une conférence récente, Jason Warner et Eiso Kant ont levé le voile sur leur mission audacieuse. Leur agent, Malibu, promet d'optimiser l'efficacité et l'innovation. Découvrez comment Poolside redéfinit l'avenir de l'IA. Une démonstration impressionnante de conversion de code a captivé l'audience. Quels sont les défis de l'IA dans des environnements à haute conséquence ? Quels sont les plans futurs de Poolside pour déployer leur modèle ? Jason Warner et Eiso Kant partagent leur voyage et la collaboration qui alimente cette révolution. Le renforcement de l'apprentissage propulse les capacités de l'IA à de nouveaux sommets. Poolside est prêt à transformer l'infrastructure et l'échelle du développement de modèles IA. Ne manquez pas cette exploration captivante de l'IA révolutionnaire.

Cadre d'évaluation IA: Guide pour PMs

Imaginez lancer un produit IA qui dépasse toutes les attentes. Comment garantir son succès ? Découvrez le Cadre d'évaluation IA. Dans le monde en constante évolution de l'intelligence artificielle, les chefs de produit font face à des défis uniques pour évaluer et intégrer efficacement les solutions IA. Cet article explore un cadre complet conçu pour aider les chefs de produit à naviguer dans ces complexités. Découvrez comment construire des applications IA, évaluer des modèles et intégrer des systèmes IA. Le rôle crucial des PMs dans le développement, le développement itératif et l'humain dans la boucle sont au cœur de cette approche. Prêt à révolutionner votre gestion de produit avec l'IA ?

Claude Code : Architecture et Simplicité Dévoilées

Imaginez un monde où des agents de codage peuvent écrire et déboguer du code de manière autonome. Claude Code, développé par Jared Zoneraich, est à la pointe de cette révolution. Cet article vous emmène dans les coulisses de son architecture simple mais puissante. Découvrez comment la gestion du contexte et la simplicité du design redéfinissent l'efficacité des agents d'IA. Plongez dans l'évolution des agents de codage, comparez différentes philosophies et explorez ce que l'avenir réserve à l'ingénierie des prompts. Les innovations ne s'arrêtent pas là; test et évaluation jouent un rôle crucial. Découvrez comment ces éléments façonnent l'avenir des agents d'IA.

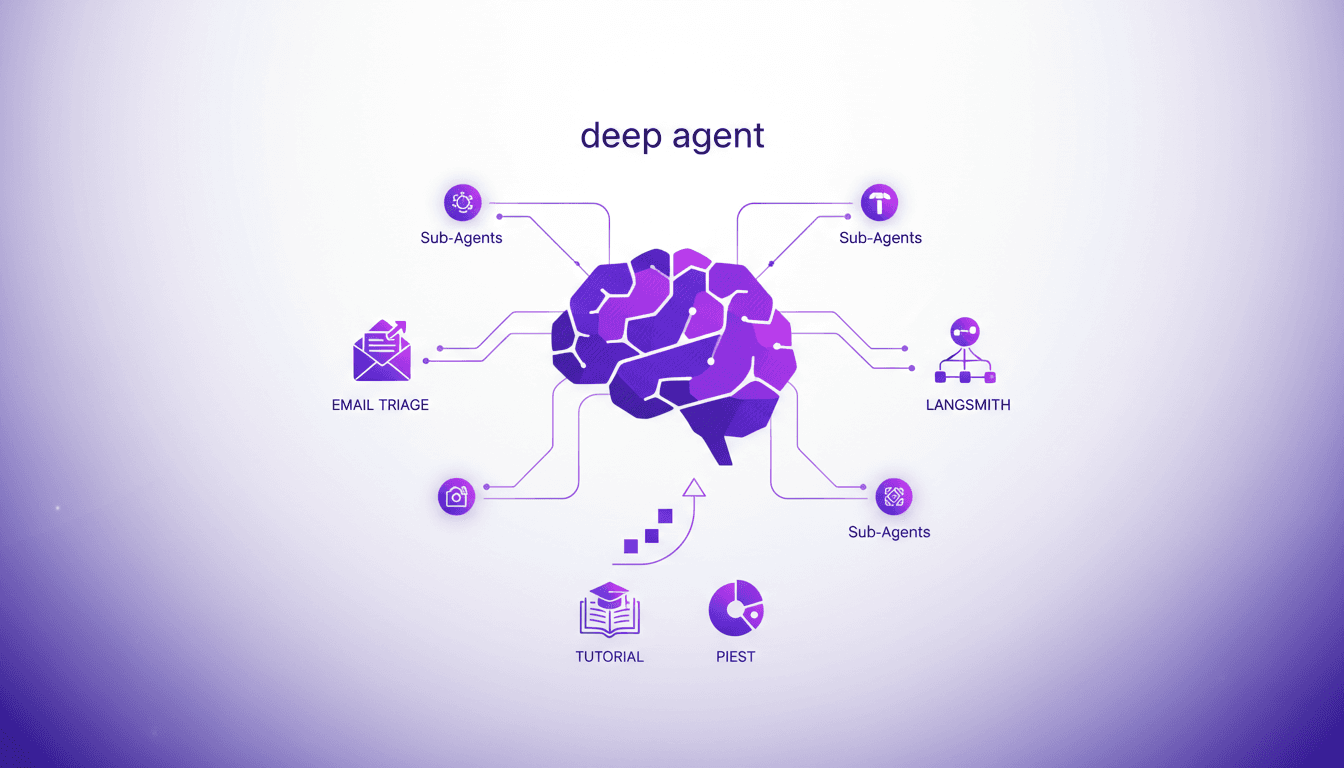

Construire un Agent Profond pour le Triage des Emails

Je suis plongé jusqu'au cou dans le développement d'IA, et bâtir un agent profond pour le triage des emails avec Langmith, c'est comme orchestrer une symphonie. D'abord, je mets en place mes instruments — ici, des prompts de système et sous-agents — puis je conduis la performance avec des outils de précision comme Piest et Viest. Le but ? Simplifier la gestion des emails, intégrer la planification de calendrier et améliorer la performance des agents grâce à une mise en œuvre pratique et concrète avec Langmith. Faisons le tour de comment j'ai réussi à faire fonctionner tout ça.