Défis de Construction Plateformes d'Évaluation

Je me souviens la première fois que j'ai essayé de construire une plateforme d'évaluation. C'était comme essayer de faire entrer un carré dans un trou rond. La complexité, les pièces mobiles, le besoin constant d'itération — c'est une bête. Mais une fois que vous avez réussi, l'efficacité et les idées que vous en tirez changent la donne. Dans nos environnements LMS d'aujourd'hui, ces plateformes sont essentielles pour comprendre la variabilité et améliorer la qualité des agents. Construire ces systèmes n'est pas une promenade de santé. Je vais vous expliquer les défis rencontrés et comment je les ai surmontés. De la transition des tableurs aux outils avancés, en passant par l'intégration de solutions basées sur l'IA, chaque étape est cruciale.

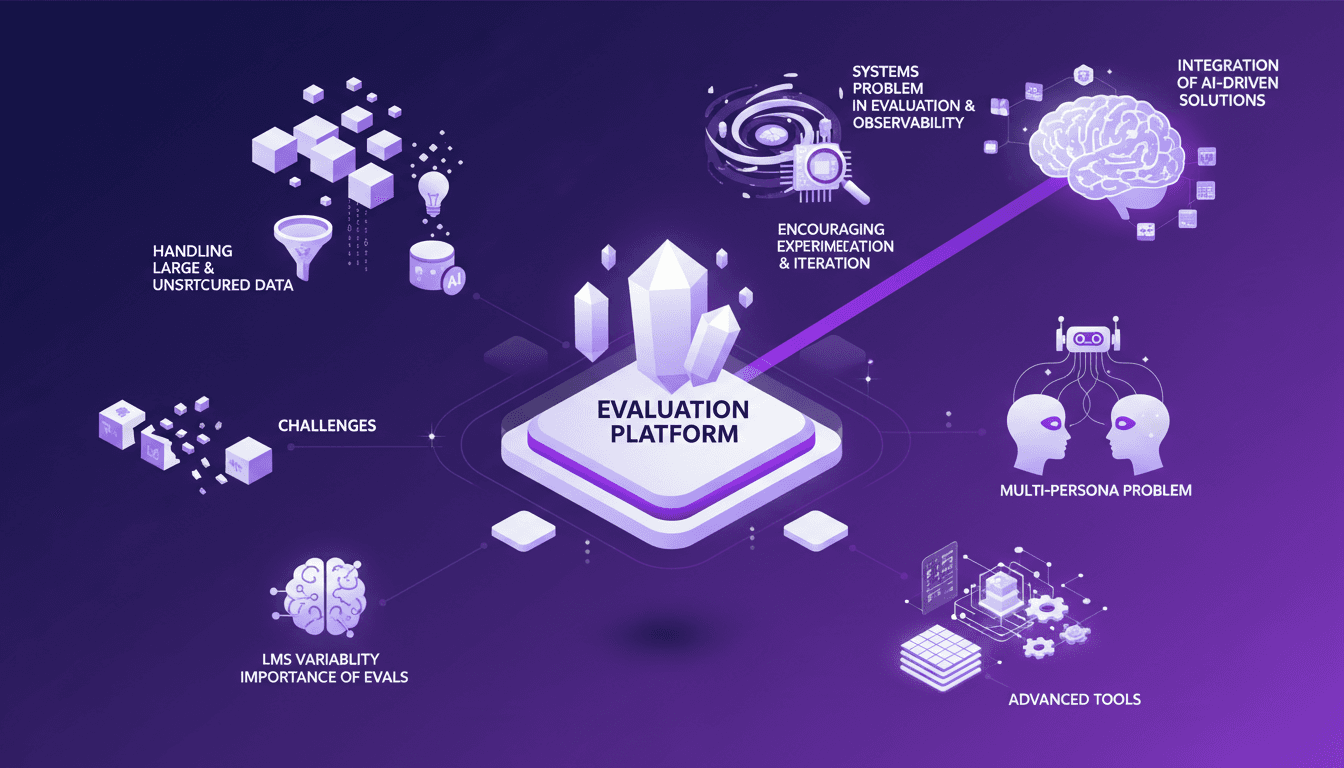

Je me souviens la première fois que j'ai essayé de construire une plateforme d'évaluation. C'était comme essayer de faire entrer un carré dans un trou rond. Franchement, la complexité, les pièces mobiles, le besoin constant d'itération — c'est une vraie bête. Mais une fois que vous avez réussi, l'efficacité et les idées que vous en tirez sont tout simplement révolutionnaires. Dans nos environnements LMS actuels, ces plateformes sont cruciales pour comprendre la variabilité et améliorer la qualité des agents. Mais ne vous y trompez pas, construire ces systèmes n'est pas une promenade de santé. Je vais vous expliquer les défis que j'ai rencontrés, depuis la transition des tableurs aux outils avancés jusqu'à l'intégration de solutions basées sur l'IA. On a affaire à un problème multi-personas et à un vrai casse-tête de systèmes — et c'est là qu'encourager l'expérimentation et l'itération devient vital. Attraper et gérer des données massives et non structurées, c'est aussi un gros morceau. Alors, attachez vos ceintures. Je vais vous montrer comment j'ai navigué dans ce labyrinthe.

Relever les défis des plateformes d'évaluation

Je me souviens encore de mes débuts avec les plateformes d'évaluation. Le défi principal est d'abord de comprendre la complexité de l'observabilité des évaluations. Quand vous jonglez avec plusieurs agents, chacun avec son propre ensemble de tâches, vous réalisez vite que la simple observation ne suffit pas. C'est un vrai casse-tête, surtout quand vous devez gérer le problème des multi-personas dans le développement d'agents. Vous avez des ingénieurs, des experts de domaine, et chacun a ses propres attentes.

Ensuite, il y a le problème des systèmes dans l'évaluation et l'observabilité. Vous devez aligner la technologie avec les processus métiers. Et les tableurs ? Ils ne suffisent plus. J'ai vu des équipes se noyer dans des lignes et des colonnes avant même de réaliser qu'elles étaient dépassées par la complexité des tâches à accomplir. La gestion des données devient vite ingérable, et croyez-moi, vous ne voulez pas être la personne qui doit expliquer pourquoi les résultats ne concordent pas.

L'importance des évaluations dans la variabilité des LMS

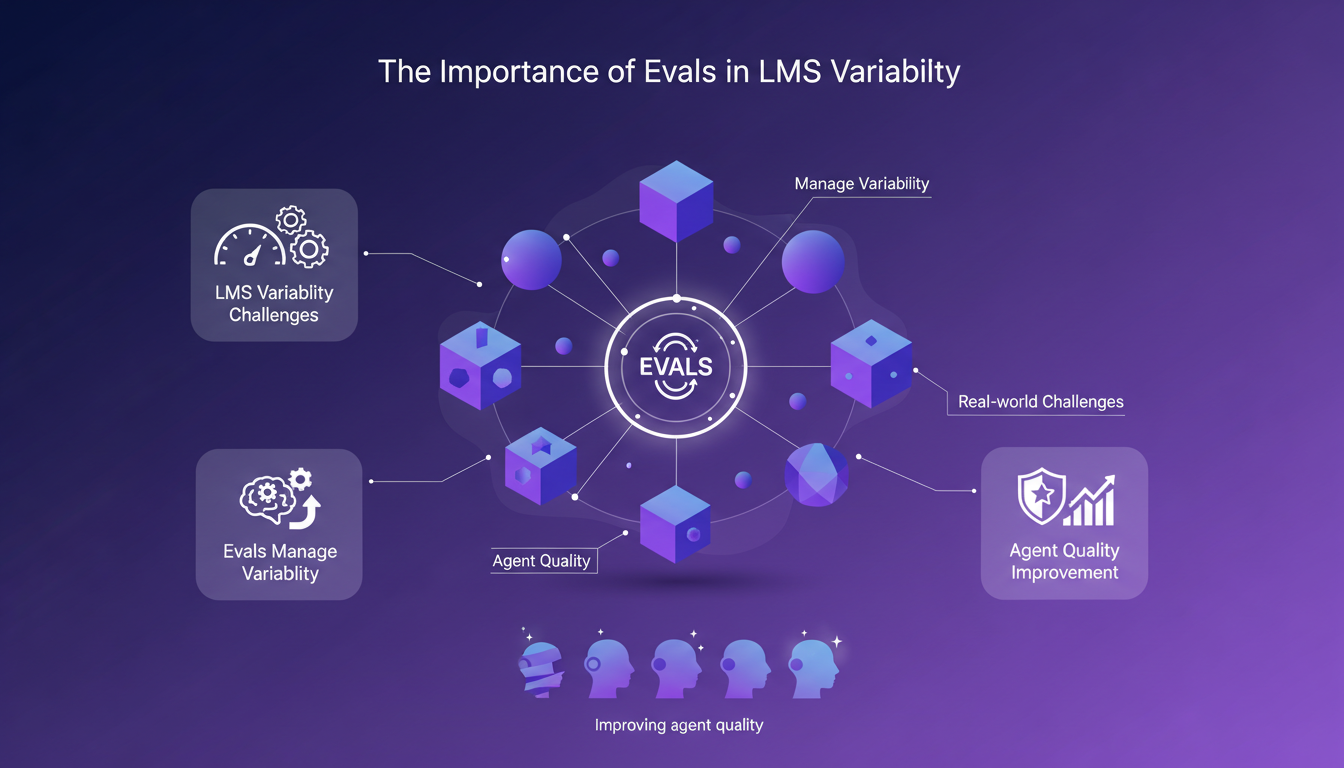

Les évaluations, c'est un peu comme le GPS pour gérer la variabilité des LMS. Avec la variabilité extrême que l'on rencontre, c'est un outil indispensable. Les évaluations permettent d'améliorer la qualité des agents en fournissant des retours constants. Cela me rappelle une fois où, en passant de 130 à 60 étudiants, j'ai réalisé l'importance d'ajuster les méthodes d'enseignement pour maintenir une qualité constante. C'est pareil avec les LMS ; vous devez adapter et évaluer en continu.

J'ai appris des leçons précieuses en passant à des tailles de classes différentes. Par exemple, quand vous passez de 130 à 60, chaque agent doit être évalué différemment. C'est là que des plateformes comme Brain Trust entrent en jeu, en fournissant un cadre pour l'évaluation de la qualité des agents.

Passer des tableurs aux outils avancés

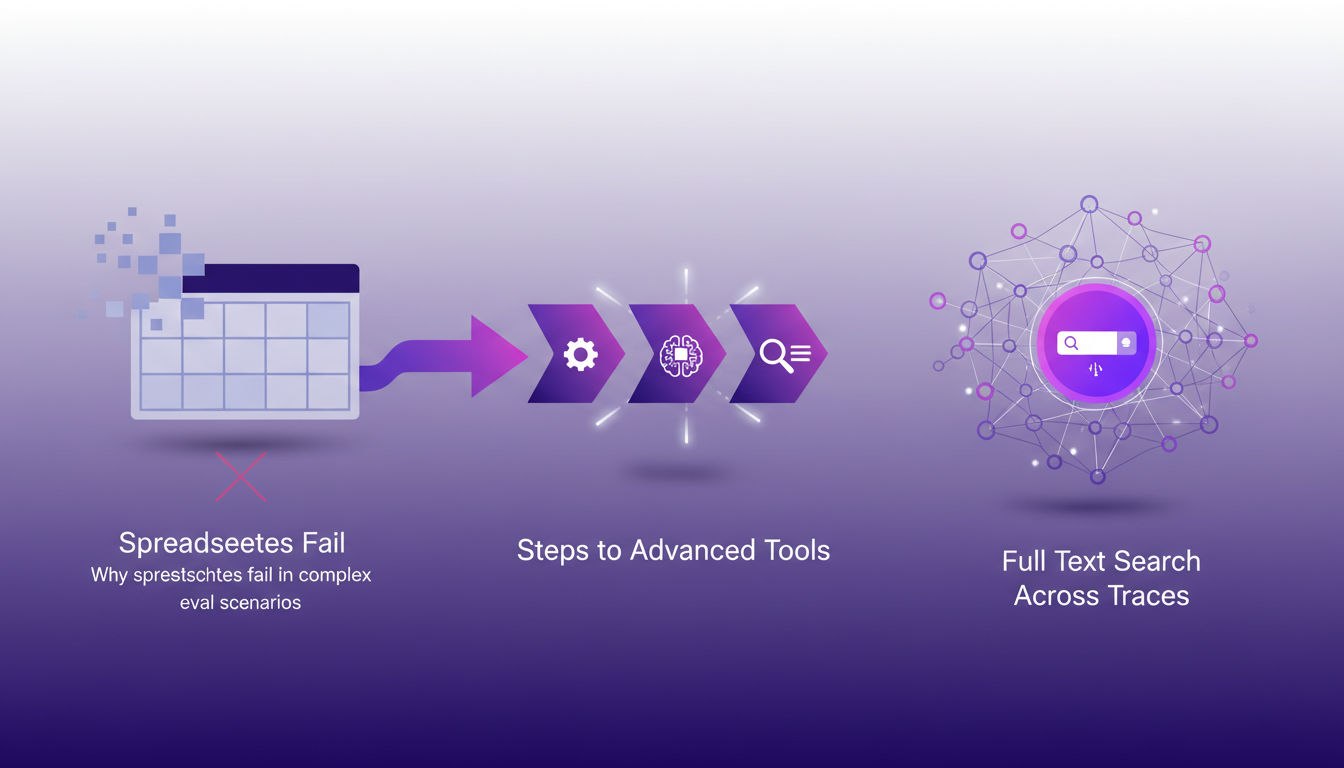

Alors, pourquoi les tableurs échouent-ils dans les scénarios complexes d'évaluation ? Simplement parce qu'ils deviennent vite obsolètes quand on doit comparer des expériences et gérer des itérations. Passer aux outils avancés est essentiel. D'abord, je recommanderais d'intégrer une recherche en texte intégral à travers les traces. Cela change la donne.

Mais attention aux pièges. Lors de la transition, gardez à l'esprit que l'implication des membres de l'équipe, tant techniques que non techniques, est cruciale. Autrement, vous risquez de perdre en performance et en persistance d'évaluation. Expérimentez, mais n'en abusez pas.

Gérer les données volumineuses et non structurées

Quand vous gérez des ensembles de données volumineux, il faut des stratégies solides. Utiliser les bons outils et techniques pour les données non structurées est vital. Par exemple, j'ai utilisé des bases de données NoSQL pour équilibrer le volume des données avec la vitesse de traitement.

J'ai constaté qu'en intégrant des solutions en temps réel, on peut améliorer considérablement la réactivité des évaluations. L'astuce est de ne pas se laisser submerger par le volume et de bien orchestrer les processus.

Intégrer des solutions pilotées par l'IA

Enfin, comment l'IA améliore-t-elle les plateformes d'évaluation ? En automatisant certaines tâches et en fournissant des analyses plus précises. Par exemple, j'ai intégré des algorithmes d'apprentissage automatique pour analyser les données plus rapidement, ce qui a permis d'améliorer la qualité des évaluations.

Mais il y a des limites. Parfois, les solutions pilotées par l'IA peuvent être coûteuses et complexes à mettre en œuvre. Encouragez l'expérimentation et l'itération, mais sachez quand vous devez faire marche arrière.

- Points clés :

- Éviter la surcharge des données en se concentrant sur l'essentiel.

- Utiliser les outils avancés pour dépasser les limites des tableurs.

- Intégrer l'IA de manière contrôlée pour améliorer les processus.

Construire des plateformes d'évaluation, c'est un vrai défi, mais avec la bonne approche et les outils adéquats, on peut vraiment simplifier le processus et enrichir la fonctionnalité des LMS. D'abord, j'ai abandonné les tableurs au profit d'outils avancés. Ça change tout, mais attention aux coûts qui peuvent grimper vite. Ensuite, il faut toujours adapter et itérer. J'ai commencé avec une classe de 130 étudiants, et l'itération m'a permis de réduire ça à 60 pour une efficacité optimale. Enfin, le problème multi-persona dans le développement d'agents, c'est une vraie galère si on ne s'y attaque pas directement. Mais l'intégration de l'IA peut devenir un atout majeur. Prêt à amener votre plateforme d'évaluation au niveau supérieur ? Commencez à expérimenter avec l'intégration de l'IA et voyez la différence. Pour des insights approfondis, je vous recommande de jeter un œil à la vidéo de Phil Hetzel sur YouTube – c'est un game changer.

Questions Fréquentes

Thibault Le Balier

Co-fondateur & CTO

Issu de l'écosystème startup tech, Thibault a développé une expertise en architecture de solutions IA qu'il met aujourd'hui au service de grands groupes (Atos, BNP Paribas, beta.gouv). Il intervient sur deux axes : la maîtrise des déploiements IA (LLM locaux, sécurisation MCP) et l'optimisation des coûts d'inférence (offloading, compression, gestion des tokens).

Articles liés

Découvrez d'autres articles sur des sujets similaires

Replit : Démocratiser le Développement d'Applications

J'ai plongé dans l'univers de Replit, et croyez-moi, la façon dont ils transforment le développement logiciel mérite d'être vue. Avec leur mission de démocratiser la création d'applications, ils ouvrent la porte à un avenir où programmer devient accessible à tous. Leur récente levée de fonds de 400 millions de dollars, qui les propulse à une valorisation de 9 milliards, n'est que le début. Replit ne se contente pas de réinventer le développement pour les développeurs aguerris, mais pousse aussi vers un avenir où les non-développeurs et les développeurs natifs d'IA peuvent briller. C'est un véritable changement de paradigme, et vous voulez être là pour le voir.

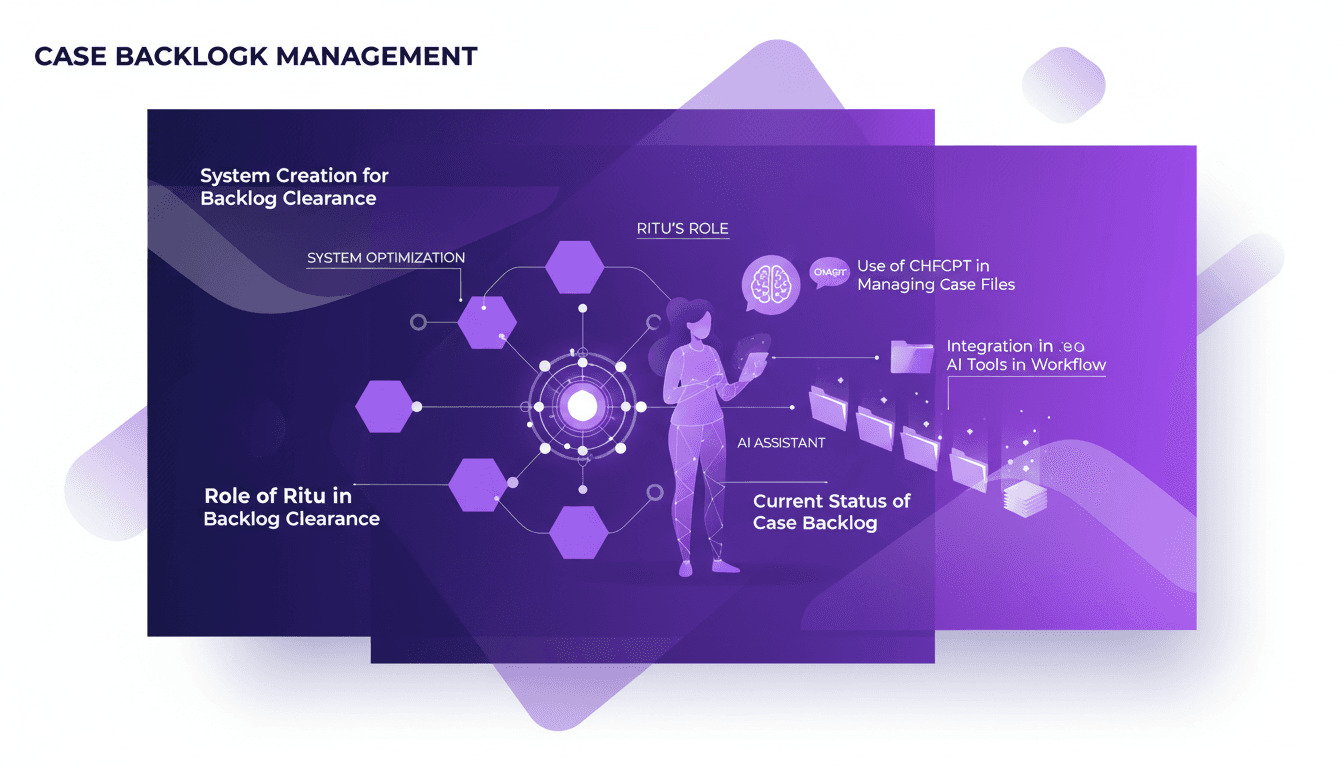

Gestion des Dossiers avec ChatGPT: Optimisation

J'ai été dans les tranchées de la gestion des arriérés de dossiers, et croyez-moi, atteindre le zéro arriéré change tout. Avec ChatGPT, j'ai créé un système qui a transformé ma façon de travailler. D'abord, j'ai intégré Ritu dans mon workflow pour optimiser le traitement des dossiers. Ensuite, j'ai connecté ChatGPT pour automatiser et accélérer le processus. Résultat : un arriéré à zéro et une efficacité décuplée. Mais attention, ne sous-estimez pas l'importance de bien orchestrer vos outils pour éviter les pièges de performance. Si vous cherchez à dominer vos dossiers, cet article est pour vous.

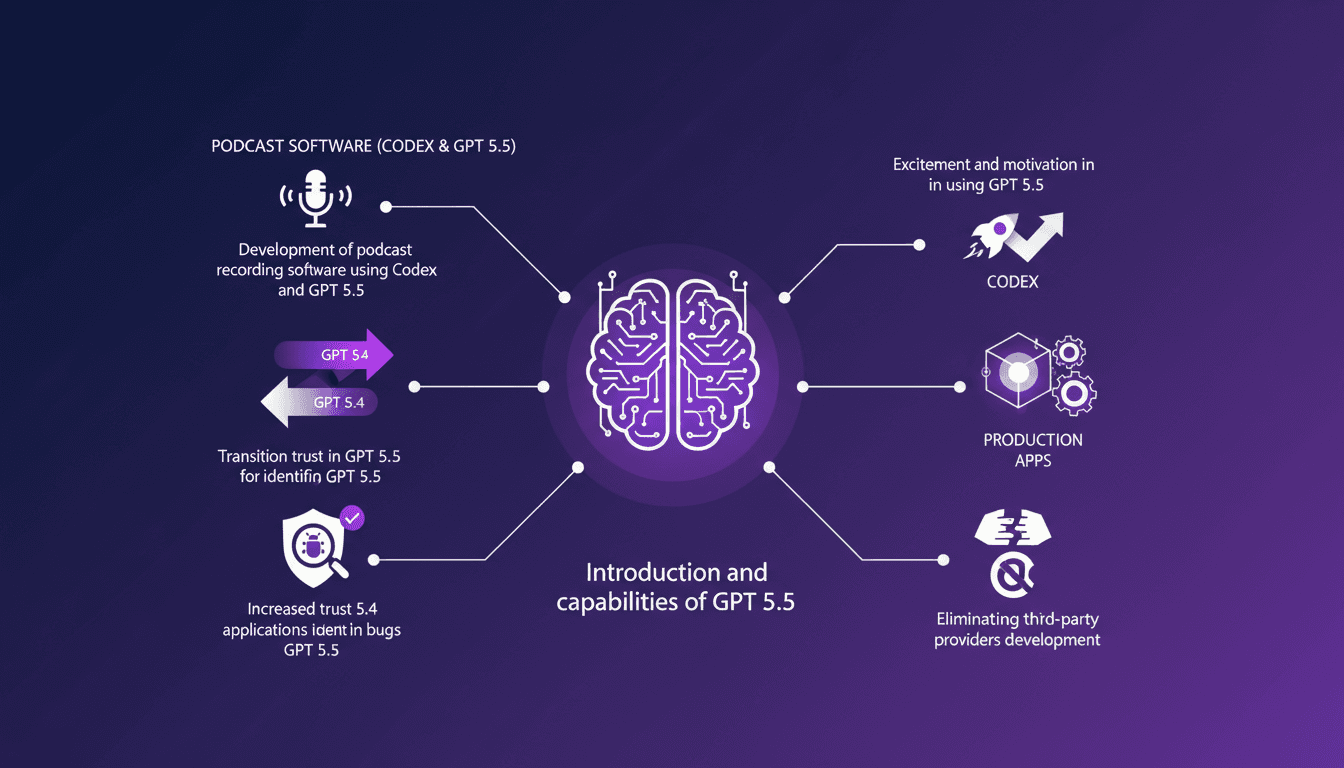

GPT 5.5 : Construire avec Codex, Éliminer Tiers

J'ai plongé tête première dans GPT 5.5, et quelle aventure ! De la construction d'un logiciel de podcast à l'élimination des fournisseurs tiers, cette version a changé la donne pour moi. Avec GPT 5.5, on ne parle pas simplement de mises à jour. On parle d'un tout nouveau niveau de confiance et de capacité. D'abord, j'ai intégré Codex pour développer une application de podcast et j'ai coupé les intermédiaires. Ensuite, les bugs ? GPT 5.5 les détecte comme un pro. Vous en avez marre des solutions tierces qui plombent votre productivité ? Cet outil pourrait bien être votre nouvelle arme secrète. Abordons ensemble les applications concrètes.

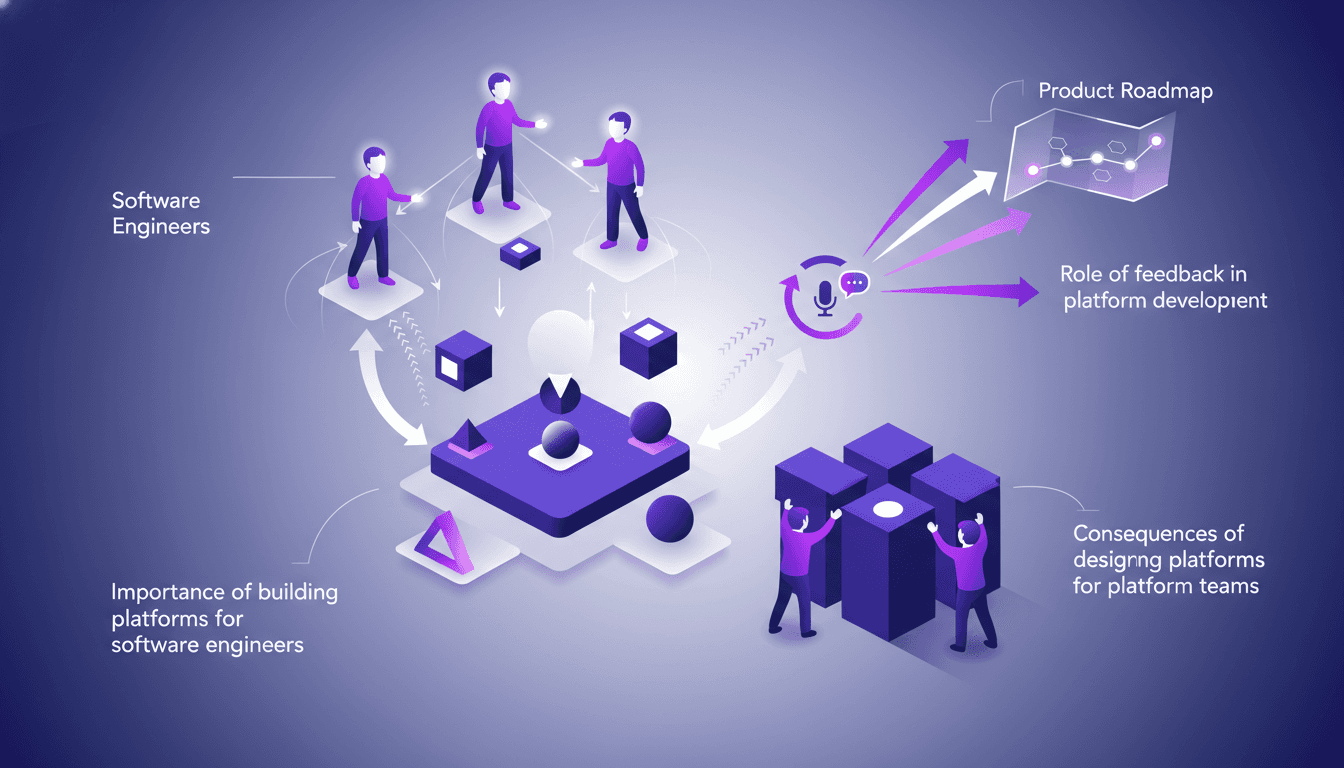

Construire des Plateformes Internes pour Ingénieurs

J'ai été dans cette situation où la plateforme semble servir tout le monde sauf ceux qui l'utilisent vraiment pour construire. C'est crucial de se rendre compte que si votre plateforme interne n'est pas conçue pour les ingénieurs logiciels, vous ratez la cible. Dans le développement logiciel, les plateformes internes sont essentielles, mais elles sont souvent pensées pour la mauvaise audience. Je vais vous parler de pourquoi elles doivent être orientées vers les ingénieurs, des pièges à éviter quand on les conçoit pour les équipes de plateforme, et de l'importance du feedback pour ajuster le tir. En designant une plateforme pour ceux qui créent et codent, on change la donne. Je vous emmène dans les coulisses des échanges entre ingénieurs et équipes de plateforme pour montrer comment le feedback peut transformer une roadmap produit.

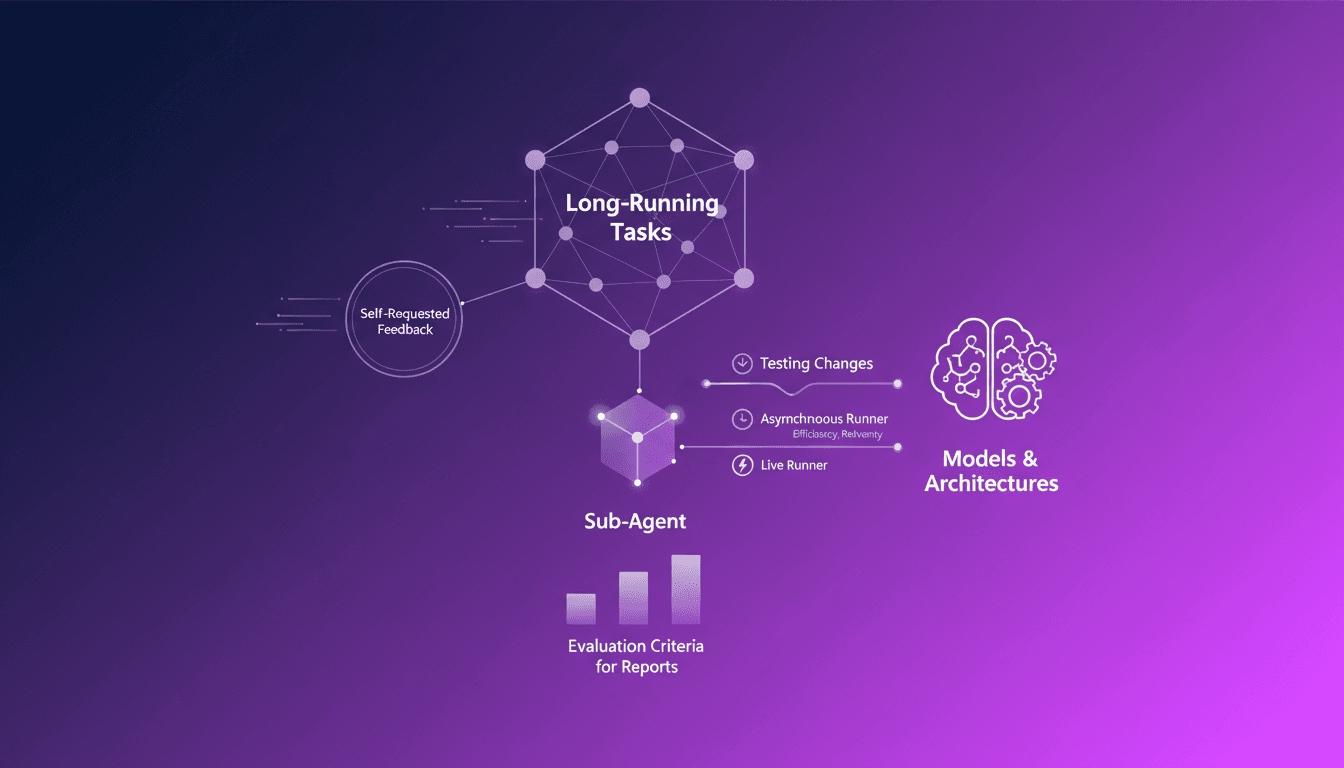

Agents IA: Demander des Retours Efficacement

Vous êtes-vous déjà retrouvé coincé dans une boucle infinie de tâches interminables, incertain de la direction à prendre ? Moi oui, et c'est là que les agents IA qui demandent des retours entrent en jeu. Dans ce podcast, je vous explique comment j'orchestre ce processus. Dans le monde de l'IA, les tâches de longue durée peuvent rapidement devenir un cauchemar sans mécanismes de rétroaction adéquats. Les sous-agents, en particulier, brillent ici en sollicitant des retours de manière autonome, rendant le processus plus efficace et moins sujet aux erreurs. On plonge dans les retours auto-demandés pour les tâches longues, le rôle des sous-agents, les critères d'évaluation des rapports, et comment j'utilise des runners asynchrones et en direct pour tester les modifications dans les modèles et architectures.