Modèles Génératifs à Grande Échelle: Optimisation

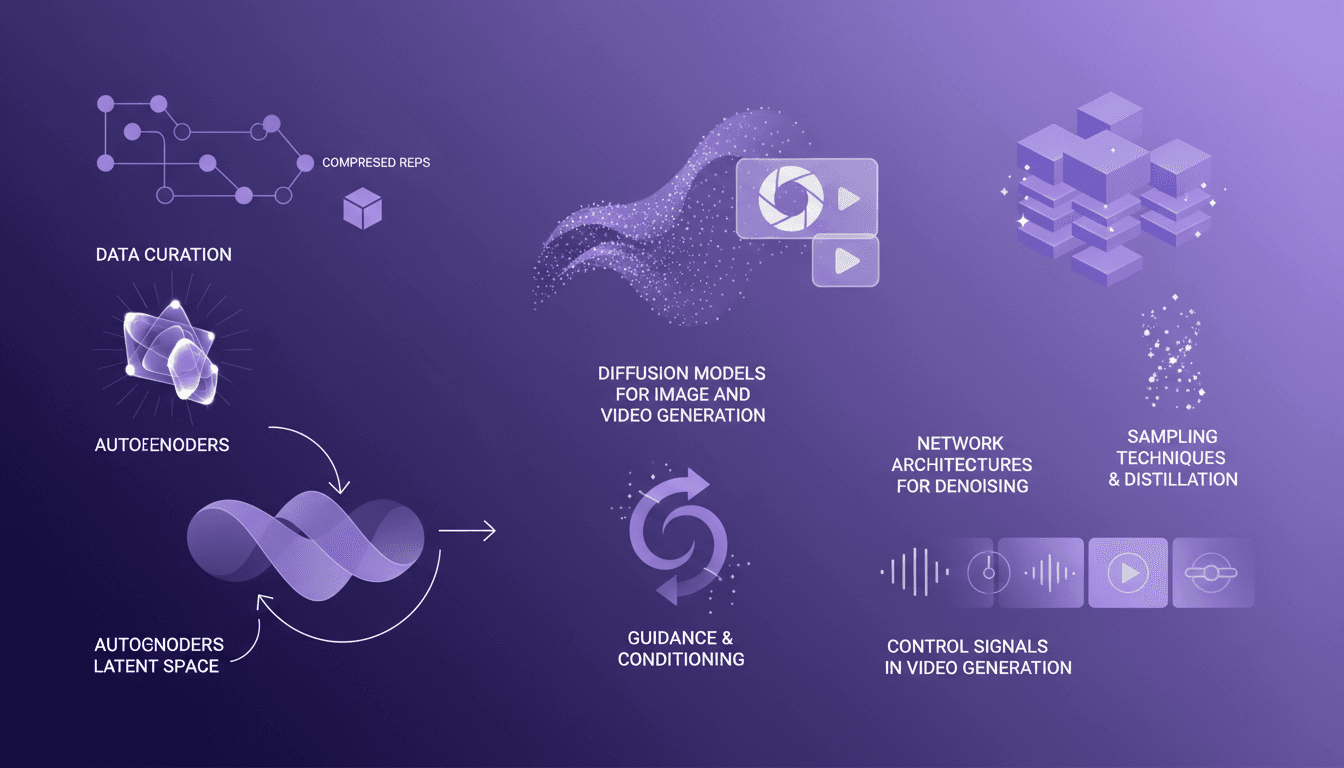

J'ai passé des heures interminables à jongler avec les modèles génératifs, et croyez-moi, c'est une aventure périlleuse. La clé, c'est de soigner son jeu de données comme un chef. Sans ça, c'est comme construire sur du sable. Dans cet exposé, on plonge dans l'univers des modèles d'image et de vidéo génératifs à grande échelle. On part de la curation des données, on s'enfonce dans les représentations compressées avec les autoencodeurs, et on explore les modèles de diffusion pour la génération d'images et de vidéos. On parlera aussi de l'espace latent, du décodage, des signaux de contrôle, et bien sûr, des architectures de réseaux pour débruiter tout ça. Attachez vos ceintures, on va à 30 images par seconde !

J'ai passé des heures interminables à me débattre avec des modèles génératifs, et laissez-moi vous dire, c'est un véritable casse-tête. D'abord, il faut être un pro du tri de données. Sans ça, c'est comme construire sur du sable mouvant. Dans le monde de l'IA, bâtir des modèles génératifs d'image et de vidéo à grande échelle, ce n'est pas qu'une histoire d'algorithmes; c'est orchestrer une symphonie de données, de compression et de calcul. Dans cette conférence, on va décortiquer la curation des données pour les modèles à grande échelle, les représentations compressées et les autoencodeurs, les modèles de diffusion pour la génération d'image et de vidéo. On va explorer l'espace latent et le décodage, l'orientation et le conditionnement dans les modèles génératifs, les architectures de réseaux pour le débruitage, les techniques d'échantillonnage et la distillation, ainsi que les signaux de contrôle dans la génération vidéo. Préparez-vous à un rythme effréné, on file à 30 images par seconde !

Curateur de Données : La Fondation de l'Échelle

Quand je me suis lancé dans la construction de modèles à grande échelle, la première leçon que j'ai apprise était l'importance cruciale de la curation des données. Sans données bien préparées, même le modèle le plus avancé ne donnera que des résultats médiocres. Personnellement, je gère des gigaoctets de données, et croyez-moi, c'est un véritable défi.

Premièrement, j'évite les pièges courants dans la préparation des données, comme l'utilisation excessive de données non filtrées. Je privilégie la qualité à la quantité, car un dataset mal calibré peut entraîner un entraînement biaisé et inefficace. Pour gérer de grandes quantités de données, j'utilise des outils comme Pandas et Apache Spark, qui facilitent le traitement et le nettoyage de mes datasets massifs.

- Mise en place de systèmes automatisés pour la collecte et le filtrage des données.

- Utilisation de techniques d'échantillonnage pour réduire la taille des ensembles de données tout en conservant leur pertinence.

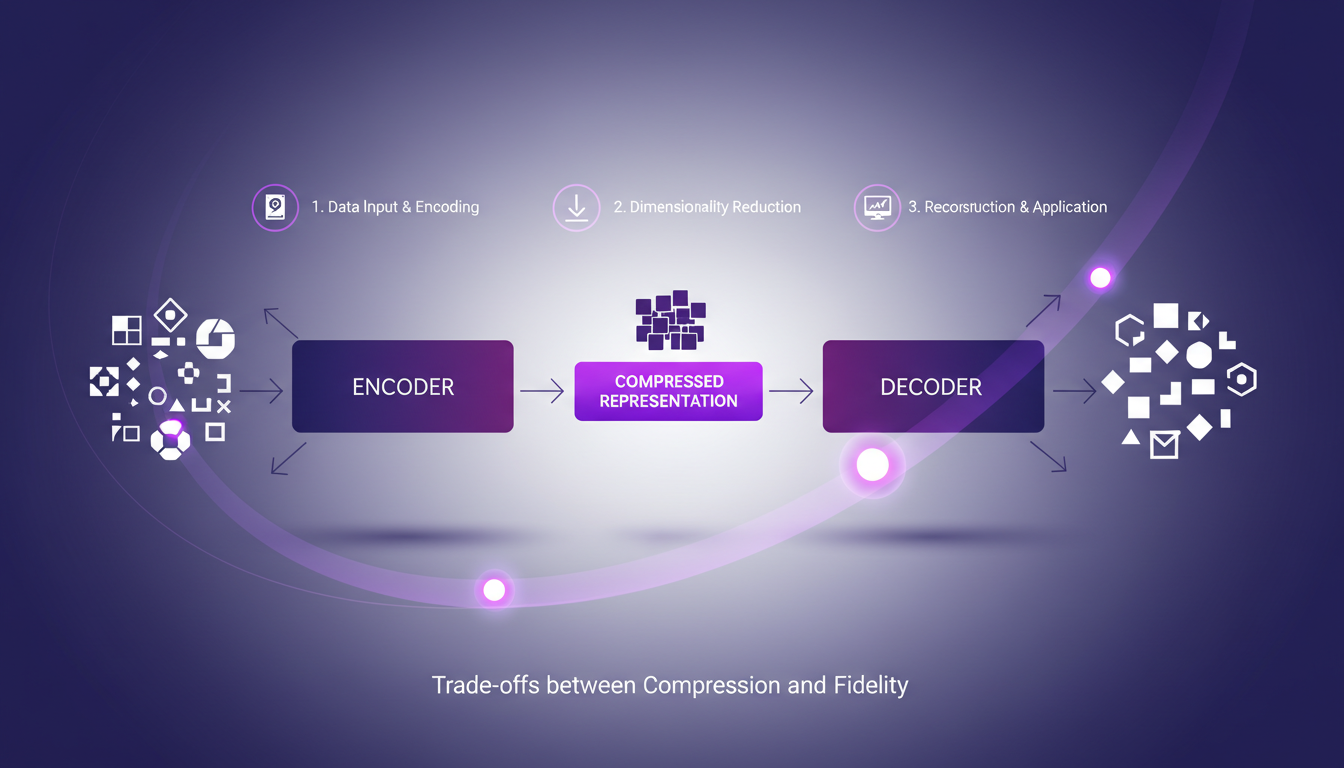

Représentations Compressées et Autoencodeurs

Les autoencodeurs sont devenus essentiels pour moi dans la réduction de la taille des données. Ce qui est génial, c'est qu'ils permettent de compresser les données sans sacrifier leur intégrité. Le compromis, c'est bien sûr entre la compression et la fidélité des données.

Pour intégrer les autoencodeurs dans mon workflow, je commence par m'assurer que mes données sont bien normalisées. Ensuite, je configure mon autoencodeur pour qu'il apprenne à créer des représentations compressées. Cela permet à mon modèle de gérer plus efficacement les images haute résolution, par exemple, en passant de gigaoctets à quelques mégaoctets.

- Implémentation d'autoencodeurs pour créer des représentations latentes compactes.

- Équilibrer la compression pour maintenir la qualité des données.

La clé est de ne pas sur-comprimer, car sinon, on perd des détails cruciaux qui peuvent impacter la performance du modèle. La représentation compressée est essentielle pour l'évolutivité, surtout quand on travaille avec des vidéos de 1080p à 30 fps.

Modèles de Diffusion : Une Plongée Approfondie

Les modèles de diffusion ont changé la donne pour moi en matière de génération d'images. Contrairement aux modèles autoregressifs, ils sont plus adaptés à la génération de données audiovisuelles. Configurer un modèle de diffusion pour la génération d'images implique plusieurs étapes, mais la clé est de bien comprendre le processus de diffusion et de décodage.

Un des défis est l'entraînement de ces modèles, qui nécessite une gestion fine de l'espace latent et du décodage. Je m'assure que le modèle puisse ajouter du bruit de manière progressive et que le débruiteur (ou denoiser) soit efficace pour préserver la structure globale tout en éliminant les détails superflus.

- Comprendre la différence entre diffusion et modèles autoregressifs.

- Optimiser le processus de corruption et de débruitage pour l'entraînement.

Guidance et Conditionnement dans les Modèles Génératifs

Le guidance joue un rôle crucial dans l'amélioration des résultats des modèles. Pour moi, le conditionnement des modèles est une technique essentielle qui permet de mieux contrôler les signaux lors de la génération vidéo. Leçons apprises : il faut savoir équilibrer les signaux de contrôle pour éviter d'obtenir des résultats artificiels.

Le guidance impacte directement la qualité du contenu généré, et j'ai appris à éviter les erreurs courantes dans le conditionnement des modèles, comme la dépendance excessive à un type de signal de contrôle.

- Techniques efficaces de conditionnement pour les modèles génératifs.

- Impact du guidance sur la qualité du contenu généré.

En fin de compte, il s'agit d'apporter des ajustements subtils mais impactants pour obtenir des résultats plus naturels et réalistes.

Architectures Réseau et Techniques d'Échantillonnage

Quand je construis des modèles de débruitage, le choix de l'architecture réseau est crucial. J'ai testé différentes approches, et celles qui fonctionnent le mieux équilibrent la complexité du réseau avec la vitesse. Des techniques comme l'échantillonnage stratifié peuvent considérablement améliorer l'efficacité des modèles.

Le processus de distillation, bien que souvent sous-estimé, permet d'améliorer la performance des modèles en réduisant le nombre d'étapes nécessaires pour obtenir un bon échantillon. C'est un vrai game changer.

- Choix architecturaux pour optimiser la rapidité et la précision.

- Techniques d'échantillonnage pour améliorer l'efficacité des modèles.

"La distillation dans les modèles de diffusion permet de réduire les étapes tout en améliorant la qualité des échantillons."

En résumé, en ajustant finement l'architecture et les techniques d'échantillonnage, j'ai pu créer des modèles plus robustes et rapides, sans sacrifier la qualité.

Construire des modèles génératifs à grande échelle, ce n'est pas seulement choisir le bon algorithme. C'est une question de savoir orchestrer la donnée, la compression et les stratégies de calcul de manière efficace. Voilà les clés que j'ai retenues :

- Curage des données : On commence par une curation méticuleuse des données. Si vos données ne sont pas bien triées, vos modèles ne feront que refléter ce désordre.

- Représentations compressées et autoencodeurs : J'utilise ces outils pour réduire la taille des données sans perdre l'essentiel. Ça économise du temps et de la puissance de calcul.

- Modèles de diffusion pour l'image et la vidéo : Générer des vidéos en 1080p à 30 fps avec une durée de 30 secondes, c'est faisable, mais attention à la puissance nécessaire.

En regardant vers l'avenir, ces techniques pourraient bien transformer la manière dont on conçoit les modèles génératifs. Mais attention, les ressources doivent être à la hauteur des ambitions. Prêt à plonger plus profondément ? Allez regarder la vidéo complète de Sander Dieleman : lien YouTube. C'est une mine d'or pour quiconque veut vraiment faire évoluer ses modèles.

Questions Fréquentes

Thibault Le Balier

Co-fondateur & CTO

Issu de l'écosystème startup tech, Thibault a développé une expertise en architecture de solutions IA qu'il met aujourd'hui au service de grands groupes (Atos, BNP Paribas, beta.gouv). Il intervient sur deux axes : la maîtrise des déploiements IA (LLM locaux, sécurisation MCP) et l'optimisation des coûts d'inférence (offloading, compression, gestion des tokens).

Articles liés

Découvrez d'autres articles sur des sujets similaires

AI et ventes émotionnelles : Révélation et impact

Hier encore, je pensais que l'IA ne pouvait pas conclure les ventes émotionnelles. Puis, j'ai construit un système autour et j'ai vu mes clôtures de deals s'envoler. Alors, comment j'ai procédé ? Plongeons dans le potentiel des IA pour transformer les processus de vente, en particulier sur le plan émotionnel. Construire l'architecture adéquate est un game-changer pour l'efficacité opérationnelle et les opérations plus légères. Les entreprises peuvent non seulement fonctionner de manière plus lean, mais elles ferment aussi plus de deals. Et attention, ne pas adopter ces technologies à temps peut vous laisser à la traîne. Découvrons pourquoi il est crucial de maîtriser cette nouvelle vague technologique.

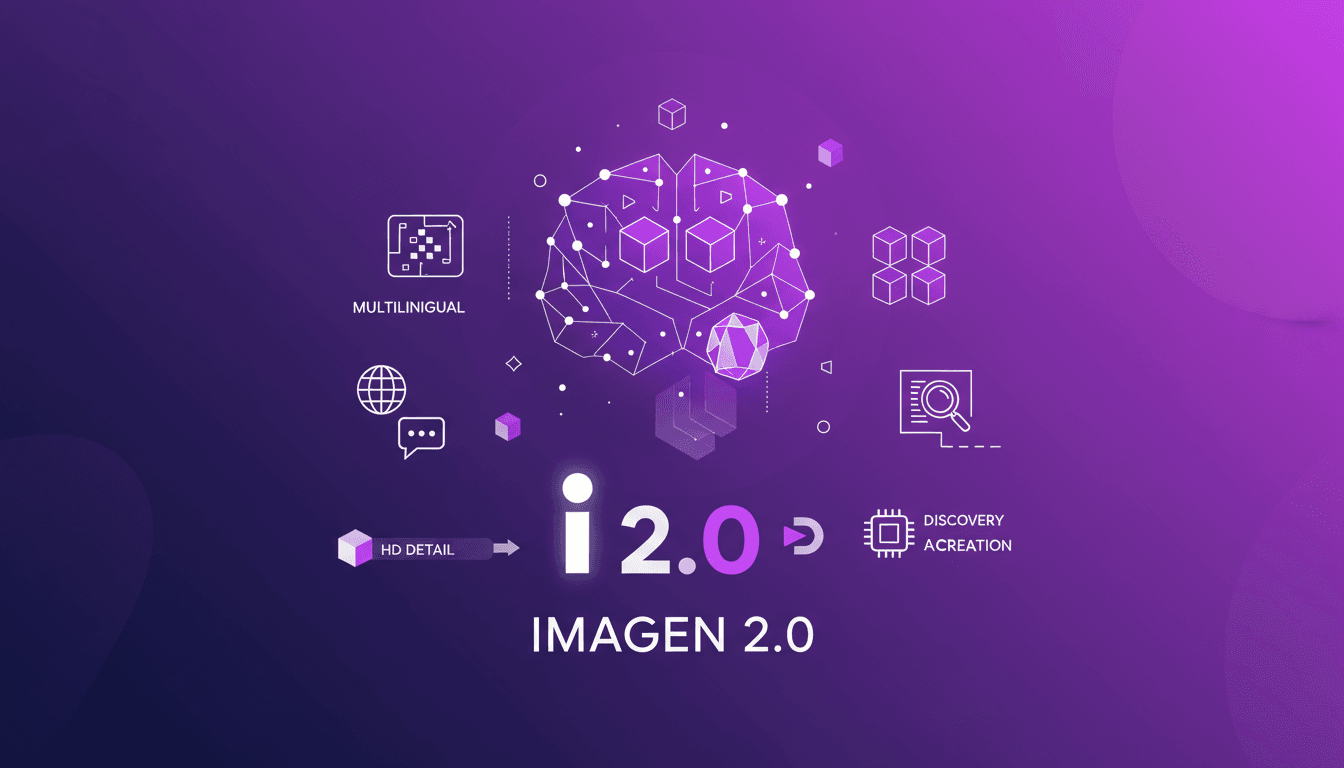

Imagen 2.0 : Génération d'images révolutionnaire

Quand j'ai mis la main sur Imagen 2.0, j'ai été époustouflé par son potentiel. On parle d'un outil qui génère des images en résolution 2K avec un support multilingue. D'abord, je l'ai intégré à mon workflow, et la différence est flagrante. L'amélioration de la résolution et du détail est un vrai game changer, mais attention aux limites techniques lors de la génération multiple. Comparé aux modèles précédents et à DALL-E, Imagen 2.0 se démarque vraiment. On n'est pas dans la théorie ici; je vous parle de l'impact quotidien sur ma pratique. Si vous cherchez à innover, c'est l'outil à explorer.

Entreprendre jeune: Lancer sa marque de vêtements

Je me souviens de mes 14 ans, quand j'ai décidé de lancer ma propre marque de vêtements. C'était comme escalader l'Everest avec juste un sac à dos. Mais je l'ai fait, et je vais vous montrer comment vous pouvez faire de même. Beaucoup pensent qu'il faut être adulte pour entreprendre, mais avec la bonne dose de passion, de stratégie et d'inspiration, on peut transformer une simple idée en une entreprise florissante. Dans cet article, je partage mon expérience, les défis rencontrés en tant que jeune entrepreneur, et comment des entrepreneurs à succès m'ont inspiré. Lancer une marque à cet âge, c'est comme jongler entre l'école et le business, mais c'est faisable avec les bonnes stratégies de contenu et une passion sans faille.

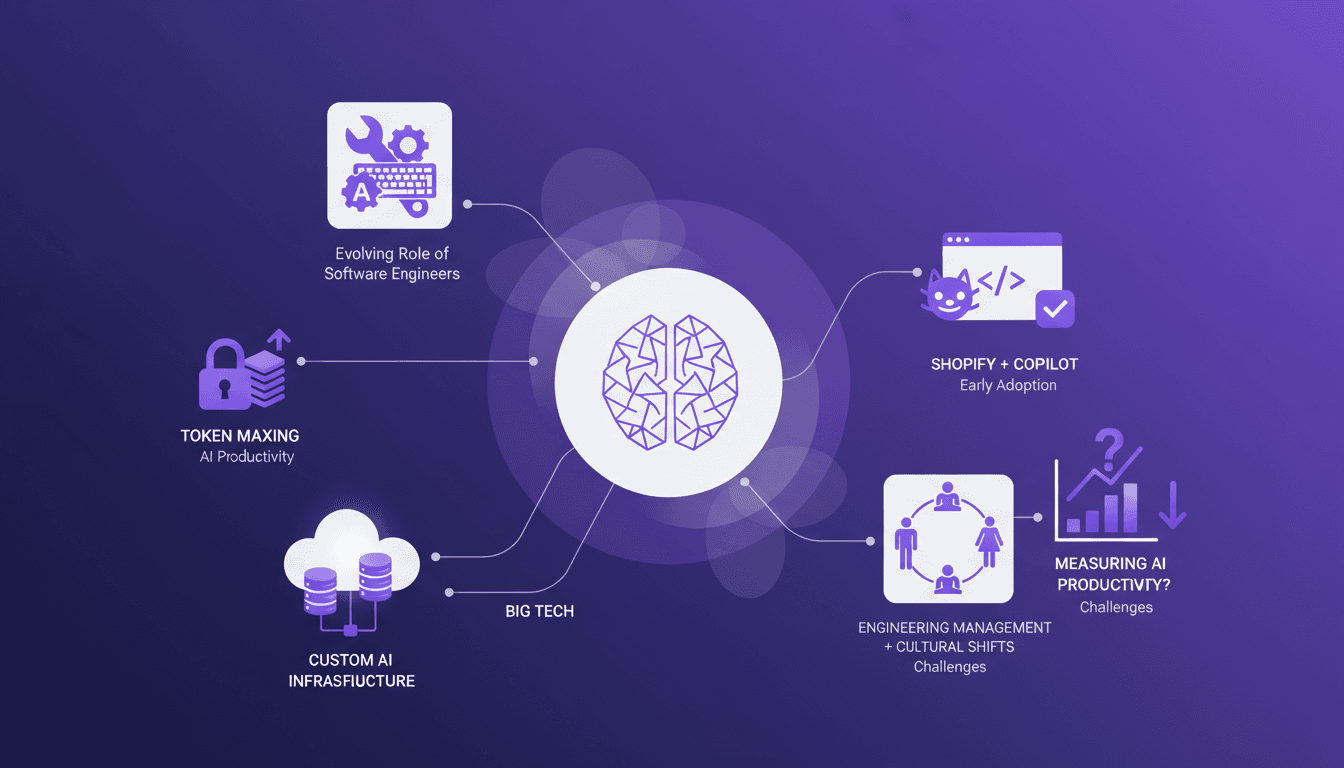

Maximisation des jetons : Révolution IA ingénierie

Je suis plongé dans l'IA depuis un moment, et croyez-moi, la manière dont l'IA bouleverse l'ingénierie logicielle est un vrai changement de jeu. Mais attention, ce n'est pas tout rose. Dans notre domaine, l'adoption des outils IA amène son lot de défis, comme la maximisation des jetons et l'évolution du rôle des ingénieurs. Lors d'une conférence récente, des experts comme Gergely Orosz ont partagé des insights précieux sur ces transformations, des impacts sur la productivité aux changements culturels dans la gestion des équipes. Nous devrons naviguer entre ces opportunités et défis pour tirer le meilleur parti de cette révolution technologique.

Impact de l'Ingénierie de Plateforme sur l'Autonomie

Je me souviens de la première fois que notre équipe plateforme a déployé un nouveau portail en libre-service. C'était un vrai bouleversement, un 'game changer'. Mais très vite, j'ai réalisé que ça grignotait notre autonomie. L'ingénierie de plateforme est en train de transformer notre façon de livrer des fonctionnalités, souvent en améliorant l'efficacité, mais parfois au détriment de l'autonomie des développeurs. On va plonger dans l'impact de cette dynamique sur notre travail quotidien. Je vais vous parler des capacités en libre-service, de la communication entre développeurs et équipes plateformes, et des défis que l'on rencontre pour satisfaire les attentes des développeurs. On va aussi discuter des outils comme le portail et l'interface en ligne de commande (CLI) pour livrer ces fonctionnalités.